Pemimpin pemikiran

Dari Kode ke Obat: Revolusi AI Berikutnya Membutuhkan Bantuan (Dan Mata)

Bagaimana sistem agen, kacamata pintar XR, dan robotika akan memberdayakan manusia – bukan menggantikannya

Kita sedang hidup dalam paradoks dalam kecerdasan buatan.

Di layar, AI adalah superhuman. Model bahasa besar menulis kode Python fungsional dalam beberapa detik. Sistem generatif menghasilkan gambar dan video photorealistic dalam beberapa menit. Sistem pemenang Nobel seperti AlphaFold telah memprediksi struktur hampir semua protein yang diketahui. Kemenangan digital sedang menumpuk.

Namun di dunia nyata penelitian biomedis, proses penemuan masih sangat manual. Kita tidak benar-benar merasakan AI mempercepat sains atau kedokteran, setidaknya belum. Angka-angka mengungkapkan kedalaman masalah ini. Survei landmark Nature dari lebih dari 1.500 ilmuwan menemukan bahwa lebih dari 70% telah mencoba dan gagal mereproduksi eksperimen peneliti lain. Bahkan lebih mengkhawatirkan: lebih dari setengah tidak bisa mereproduksi pekerjaan mereka sendiri. Dalam biologi kanker secara khusus, proyek reproduktifitas delapan tahun menemukan bahwa hanya 40% temuan dampak tinggi bisa direplikasi dan 68% eksperimen kekurangan dokumentasi yang cukup untuk bahkan mencoba replikasi.

Ini adalah rahasia kotor sains modern: kita memiliki masalah penangkapan pengetahuan, bukan hanya masalah penemuan. Detail eksperimental kritis hidup di kepala peneliti, bukan di kertas. Protokol bergeser. Pengetahuan tak tertulis berjalan keluar pintu ketika trainee lulus. Sistem AI yang dilatih pada literatur terbitan mewarisi semua celah ini.

Masalah dasar adalah bahwa sementara AI dapat merancang protein baru untuk terapi kanker dalam simulasi digital, itu tidak bisa mengambil pipet untuk mengujinya. Itu tidak bisa menavigasi kenyataan yang berantakan dan tidak terduga dari laboratorium basah untuk memvalidasi hipotesisnya sendiri. Itu tidak bisa menonton tangan ilmuwan berpengalaman dan belajar teknik halus yang membuat eksperimen berhasil.

“Gap eksekusi” ini adalah bottleneck terbesar yang mencegah revolusi AI menjadi revolusi medis. Sementara sebagian besar perusahaan robotika masih sibuk mengajari mesin untuk melipat pakaian atau memuat mesin pencuci piring, mereka tertinggal di belakang kemampuan transformasional yang sebenarnya dari kemajuan ini di bidang seperti kedokteran.

Untuk memecahkan ini, kita harus melampaui chatbot dan menuju AI Co-Ilmuwan, sistem agen yang menjembatani dunia digital dan fisik, mendorong melampaui perencanaan dan pengkodean dan ke eksekusi dunia nyata. Di Stanford, kita sedang mengembangkan LabOS, kerangka AI digital-fisik yang menunjukkan bagaimana agen AI, kacamata pintar XR, dan robotika kolaboratif dapat bersatu untuk menutup loop ini, mengubah eksperimen ilmiah menjadi percakapan kolaboratif antara manusia dan mesin, sambil secara otomatis menangkap pengetahuan yang saat ini hilang.

Divisi Besar: Mengapa AI Membutuhkan “Mata” dan “Tangan”

Banyak kemenangan AI yang paling terlihat telah terjadi di mana lingkungan sepenuhnya digital: repositori kode, dataset yang dikurasi, atau benchmark simulasi (di mana AI bersaing untuk menjalankan bisnis virtual atau berinvestasi secara digital di saham).

Laboratorium basah berbeda. Biologi, dan pada umumnya, penemuan ilmiah, adalah proses yang sangat berisik. Instrumen bergeser, operator melakukan improvisasi, dan “protokol” sering hidup sebagian di kepala orang. Perbedaan antara hasil yang bersih dan run yang gagal dapat menjadi sudut pipet, pola vortex, penggantian reagen, atau inkubasi yang berjalan 10 menit lebih lama. Detail kontekstual ini jarang membuatnya ke dalam kertas dan mereka adalah apa yang model AI butuhkan jika ingin menggeneralisasi melampaui dataset.

Itulah mengapa AI laboratorium kelas membutuhkan mata (untuk memahami apa yang terjadi dalam konteks), tangan (untuk memstandarisasi dan mengotomatisasi langkah-langkah varians tinggi), dan memori (untuk merekam apa yang sebenarnya terjadi). Tanpa kemampuan ini, model dapat merekomendasikan apa yang harus dilakukan, tetapi tidak dapat secara andal menerjemahkan rekomendasi menjadi eksekusi fisik yang divalidasi atau menjelaskan kegagalan ketika kenyataan menyimpang dari rencana.

Melampaui Chatbot: Dari Co-Pilot ke Co-Ilmuwan

Istilah “AI agen” kadang-kadang digunakan longgar. Dalam pengaturan biomedis, itu harus berarti sesuatu yang tepat: sistem yang dapat mengambil tujuan (misalnya, “optimalkan efisiensi pengeditan gen CRISPR sambil meminimalkan target yang tidak diinginkan”), memecahnya menjadi urutan tugas, menjalankan tugas tersebut di seluruh alat, mengevaluasi hasil, dan menyesuaikan rencana di bawah kendala dan dengan pengambilan keputusan yang dapat diaudit.

Hal ini penting karena alur kerja penelitian tidak hanya satu model panggilan. Mereka adalah pipa end-to-end yang melintasi formulasi hipotesis, desain eksperimental, pemrosesan data, pengujian statistik, dan interpretasi. Pemikiran baru dalam penemuan obat telah mulai menekankan sistem agen yang dapat menskalakan pipa ini daripada hanya mempercepat langkah individu (misalnya, diskusi Unite.AI tentang agen dalam penemuan molekul kecil).

Dalam rekayasa perangkat lunak, kita telah melihat bukti empiris awal bahwa co-pilot AI dapat meningkatkan throughput pengembang. Dalam biomedis, kesempatan yang setara bukan hanya menulis kode, tetapi menulis dan memvalidasi protokol, membangun data, memantau eksekusi, dan menutup loop antara prediksi dan pengukuran, menghubungkan AI dengan ilmuwan manusia di laboratorium.

LabOS: Ketika AI Berjalan pada Sistem Operasi untuk Laboratorium Masa Depan

Dalam pekerjaan kita di Stanford pada AI4Science, yang meliputi kopilot pengeditan gen CRISPR seperti CRISPR-GPT dan sistem co-eksekusi AI-XR seperti LabOS yang membantu ilmuwan di laboratorium biomedis dan ilmu bahan, kita telah menjelajahi pergeseran arsitektur:

1. Merancang sistem operasi laboratorium “ujung-ke-ujung” yang menghubungkan laboratorium digital (kering) ke laboratorium fisik (basah).

Premisnya sederhana: jika buku catatan laboratorium adalah memori sains, maka sistem operasi laboratorium harus menjadi lapisan eksekusi, menangkap niat, menerjemahkannya menjadi tindakan, mengamati hasil, dan mengubah setiap run menjadi pengetahuan terstruktur.

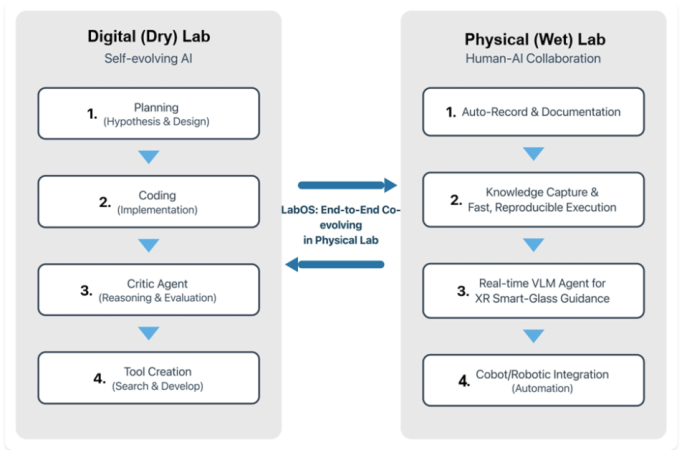

Gambar. Tampilan konseptual LabOS yang menghubungkan loop laboratorium digital yang berkembang sendiri (perencanaan, pengkodean, kritik, pembuatan alat) dengan loop laboratorium basah manusia-AI (otodokumentasi, penangkapan pengetahuan, panduan XR, dan integrasi robotika).

2. AI di Laboratorium Digital – Perencanaan dan Pembangunan Alat yang Berkembang Sendiri

Di laboratorium digital (kering), kita dapat membiarkan AI melakukan apa yang sudah dilakukannya dengan baik: mencari, mensintesis, dan mengusulkan. Tetapi kita juga ingin itu menjadi self-improving. Tidak dengan “menghalusinasi sains baru”, tetapi dengan belajar alat dan alur kerja yang lebih baik dari umpan balik.

Loop laboratorium digital yang praktis dapat dirangkum dalam empat tahap berulang:

- Perencanaan (hipotesis + desain): usulkan hipotesis, pilih variabel eksperimental, antisipasi confounder, dan spesifikkan titik akhir yang dapat diukur.

- Pengkodean (implementasi): generate atau adapt skrip analisis, pipa simulasi, dan template kontrol instrumen jika perlu.

- Agen kritik (penalaran + evaluasi): stress-test asumsi, periksa kekuatan statistik, usulkan kontrol, dan bendera mode kegagalan yang mungkin.

- Pembuatan alat (pencarian + pengembangan): ketika alur kerja kekurangan komponen (parser, rutinitas QC, dashboard), bangun dan tambahkan kembali ke toolkit.

3. AI di Laboratorium Fisik – AI Dengan “Mata” (Kacamata XR) dan “Tangan” (Robotika)

Laboratorium fisik (basah) adalah tempat sistem baik memenangkan kepercayaan – atau kehilangannya. Tujuannya bukan menggantikan ilmuwan, tetapi mengurangi gesekan dan kesalahan sambil meningkatkan keterbacaan.

Kita melihat loop laboratorium fisik sebagai empat kemampuan komplementer:

- Otodokumentasi dan dokumentasi: tangkap tindakan, timestamp, pengaturan instrumen, dan deviasi secara otomatis, sehingga dokumentasi tidak menjadi pemikiran belakangan.

- Penangkapan pengetahuan untuk eksekusi yang cepat dan dapat direproduksi: ubah run menjadi artefak yang terstruktur dan dapat diquery (versi protokol, set parameter, hasil QC) yang sejalan dengan prinsip pengelolaan data seperti FAIR.

- Panduan bahasa-waktu nyata melalui kacamata pintar XR: gunakan model multimodal untuk menafsirkan adegan (apa yang operator lakukan, reagen mana yang ada di tangan) dan berikan panduan langkah-demi-langkah dan pemeriksaan keamanan. AR/XR telah menunjukkan nilai dalam alur kerja fisik berisiko tinggi seperti panduan eksperimental (LabOS, Stanford, Princeton, dalam kolaborasi dengan NVIDIA).

- Integrasi robotika/cobot untuk otomatisasi: standarisasi langkah berulang, enable hand-off yang aman, dan kurangi variabilitas. Platform untuk alur kerja simulasi-ke-nyata (misalnya NVIDIA Isaac) dan pemrosesan AI waktu nyata di tepi seperti streaming langsung dan interaksi manusia-AI di LabOS adalah lapisan penting yang memungkinkan.

Arsitektur ini sejalan dengan arah yang lebih luas di bidang ini: laboratorium “self-driving” atau otonom yang menggabungkan otomatisasi dengan pembelajaran mesin untuk merencanakan eksperimen berikutnya. Apa yang LabOS tambahkan adalah lapisan antarmuka manusia yang lebih ketat, sehingga otonomi tidak datang dengan biaya transparansi.

Mengapa AI Laboratorium Kelas Bukan Hanya “AI pada Dataset”

Sistem AI untuk kecerdasan ilmiah/super biomedis sering terlihat mengesankan dalam evaluasi retrospektif atau mengambil ujian, dan kemudian berkinerja buruk di laboratorium fisik. Alasannya jarang karena bug tunggal. Ini biasanya karena kesenjangan antara asumsi model dan kenyataan laboratorium.

Tiga kesenjangan muncul berulang:

- Kesenjangan konteks: dataset biasanya omit variabel kontekstual yang operator tahu penting (eksursi suhu, nomor lot reagen, deviasi protokol halus).

- Kesenjangan tindakan: banyak sistem AI dapat merekomendasikan apa yang harus dilakukan, tetapi tidak dapat secara andal menerjemahkan rekomendasi menjadi langkah fisik yang divalidasi.

- Kesenjangan umpan balik: tanpa umpan balik terstruktur dan berkualitas tinggi dari eksekusi, model tidak dapat belajar di mana mereka gagal – dan ilmuwan tidak dapat audit mengapa.

Menutup kesenjangan ini kurang tentang menghasilkan arsitektur jaringan neural baru, tetapi lebih tentang membangun instrumentasi, antarmuka, dan kontrak data yang membuat laboratorium dapat dibaca oleh mesin, dan memungkinkan AI untuk melihat dan bekerja dengan manusia.

Kepercayaan dengan Desain: Keamanan dan Pemerintahan untuk AI yang Dapat Bertindak

AI agen dalam penelitian penemuan tidak hanya meningkatkan kekhawatiran tentang akurasi. Ini memperkenalkan mode kegagalan baru karena dapat bertindak. Di laboratorium, tindakan berarti potensi limbah, kerusakan, atau kesimpulan menyesatkan, terutama ketika eksperimen memberi makan ke hipotesis klinis.

Suatu pola pikir yang berguna adalah untuk mengobati tumpukan laboratorium AI yang diaktifkan sebagai sistem sosio-teknis yang membutuhkan jaminan. Beberapa kerangka kerja yang ada membantu, tetapi mereka harus diterjemahkan ke kenyataan laboratorium:

- Manajemen risiko sebagai praktik berkelanjutan: Kerangka Manajemen Risiko AI NIST (AI RMF 1.0) menyediakan kosakata praktis untuk memetakan, mengukur, dan mengelola risiko AI di seluruh siklus hidup.

- Penyesuaian regulasi untuk AI medis-adjacen: pekerjaan FDA pada AI/ML Perangkat Lunak sebagai Perangkat Medis (SaMD), termasuk Rencana Tindakan dan pedoman terkait, menawarkan pandangan konkret tentang apa yang terlihat seperti “praktik baik” ketika AI memengaruhi perawatan pasien.

Untuk domain seperti pengeditan gen, pemerintahan sudah menjadi percakapan global. Rekomendasi sedang dibahas pada pengeditan genom manusia, untuk menekankan kebutuhan akan mekanisme pengawasan yang tepat dan pemerintahan yang bertanggung jawab, seperti yang diajukan oleh American Society for Gene and Cell Therapy, atau ASGCT. Sistem seperti LabOS harus dirancang untuk membuat kepatuhan lebih mudah, bukan lebih sulit.

Daftar Periksa: Kontrol untuk AI Co-Ilmuwan Aman untuk Penemuan Ilmiah

Dalam pandangan kita, sistem operasi laboratorium yang sadar keamanan harus mengimplementasikan setidaknya desain berikut:

- Provenance secara default: setiap dataset, versi protokol, dan output model harus dapat dilacak ke input dan timestamp.

- Otonomi terbatas: sistem harus memiliki izin eksplisit (apa yang dapat dilakukan tanpa konfirmasi) dan aturan eskalasi (kapan harus bertanya).

- Pengambilalihan manusia dan degradasi yang elegan: ketika sensor atau aliran data gagal, atau ketidakpastian tinggi, sistem harus kembali ke mode yang lebih aman dan sederhana.

- Validasi terus-menerus: prediksi in-silico harus dipasangkan dengan validasi laboratorium fisik; run laboratorium fisik harus mencakup gerbang QC sebelum kesimpulan dipropagasikan ke hilir kembali ke model/agen AI di dunia digital.

- Keamanan dan kesadaran penggunaan ganda: melindungi infrastruktur laboratorium dari perusakan.

Memberdayakan Manusia Di Mana-Mana: Bisakah AI Co-Ilmuwan Meratakan Lapangan?

Salah satu janji paling menggoda dari AI “co-ilmuwan” XR adalah tidak hanya kecepatan untuk lembaga elit, tetapi juga aksesibilitas untuk semua orang. Pertimbangkan apa yang saat ini membatasi laboratorium kecil, startup, dan klinik regional/jauh:

- Akses terbatas ke keahlian khusus untuk protokol dan instrumen kelas emas.

- Biaya relatif tinggi untuk pelatihan, kesalahan, dan pekerjaan ulang.

- Tooling yang terfragmentasi: buku catatan, spreadsheet, log instrumen, dan skrip analisis jarang terhubung dengan baik.

Sistem yang dapat memandu eksekusi dalam konteks (melalui kacamata XR), menangkap apa yang terjadi secara otomatis, dan menyarankan langkah berikutnya berdasarkan run sebelumnya bisa membuat asai lanjutan lebih dapat direproduksi di seluruh situs. Secara prinsip, itu juga bisa mendukung penelitian klinis terdistribusi di mana protokol harus dijalankan secara konsisten, bahkan ketika sumber daya bervariasi.

Timeline: Kapan Setiap Ilmuwan dan Klinisi Mendapatkan Co-Ilmuwan?

Singkatnya, kita lebih dekat daripada yang banyak pikir untuk beberapa tugas bernilai tinggi dan frekuensi tinggi (seperti menghasilkan obat secara andal di laboratorium) dan lebih jauh daripada yang banyak demo implikasikan untuk yang lain (seperti AI sepenuhnya memecahkan masalah besar seperti kanker atau Alzheimer). Rencana jalan yang realistis terlihat seperti ini:

- Near term (dalam 1 tahun): Co-pilot alur kerja yang mengurangi beban administratif: pendrafan protokol, sintesis literatur, template analisis, dan laporan QC otomatis. Faktor pembatas adalah integrasi, bukan kemampuan model.

- Mid term (1-2 tahun): Sistem co-eksekusi di laboratorium: panduan kacamata XR, dokumentasi otomatis, dan robotika selektif untuk langkah-langkah varians tinggi. Kepercayaan akan bergantung pada jejak audit dan desain human-in-the-loop yang ketat.

- Longer term (3+ tahun): Co-peneliti antar domain yang menghubungkan penemuan ke terjemahan: menghubungkan data laboratorium ke titik akhir klinis, memantau sinyal keamanan, dan membantu merancang uji coba – sambil mematuhi harapan regulasi dan etika.

Dari Kode ke Obat: Jalan Maju untuk Penemuan Ilmiah 1000x

LabOS adalah salah satu upaya untuk menjawab pertanyaan sederhana: apa jika eksperimen bisa dijalankan sebagai percakapan, di mana niat, eksekusi, dan bukti terhubung ujung-ke-ujung? Jika kita membangun sistem ini dengan baik, mereka dapat membantu mengatasi kesenjangan terjemahan yang memperlambat biomedis dan banyak disiplin ilmu fisik (misalnya ilmu bahan). Jika kita membangunnya dengan buruk, mereka akan memperkuat ketidakreproduksibilitas dan menciptakan risiko keamanan baru.

Pekerjaan paling penting dalam beberapa tahun ke depan akan menjadi fondasi: antarmuka data dan perangkat yang standar melalui pembangunan sistem operasi (seperti iOS menjalankan semua jenis aplikasi), membangun benchmark AI yang mencakup eksekusi dan ketidakpastian (seperti benchmark LabSuperVision di LabOS), dan memulai penerapan di dunia nyata yang mendorong inovasi sambil melindungi pasien dan integritas penelitian.

Untuk peneliti dan klinisi, pertanyaannya bukanlah apakah AI akan memasuki laboratorium. Itu sudah terjadi. Pertanyaannya adalah apakah kita akan mengintegrasikan AI sebagai kumpulan alat yang terputus atau sebagai sistem yang dapat dipercaya, yang dirancang untuk kenyataan sains biomedis.

Bacaan dan sumber yang disarankan

- Survei reproduktifitas (Nature, 2016): https://www.nature.com/articles/533452a

- Artikel peer-review CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Berita Stanford Medicine tentang CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Pracetak LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Situs web benchmark LabOS dan LabSuperVision: https://ai4lab.stanford.edu

- Kerangka Manajemen Risiko AI NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Ringkasan FDA tentang AI/ML Perangkat Lunak sebagai Perangkat Medis: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Prinsip data FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI tentang hambatan dalam penemuan obat molekul kecil: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI tentang AI dan bedah robot: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/