Kecerdasan buatan

Kartel Dataset Berpengaruh Mendominasi Penelitian Pembelajaran Mesin, Saran Studi Baru

Sebuah makalah baru dari Universitas California dan Google Research telah menemukan bahwa sejumlah kecil ‘benchmark’ dataset pembelajaran mesin, sebagian besar dari lembaga Barat yang berpengaruh, dan sering dari organisasi pemerintah, semakin mendominasi sektor penelitian AI.

Para peneliti menyimpulkan bahwa kecenderungan untuk ‘default’ ke dataset sumber terbuka yang sangat populer, seperti ImageNet, menimbulkan sejumlah alasan praktis, etis, dan bahkan politis untuk dikhawatirkan.

Di antara temuan mereka – berdasarkan data inti dari proyek komunitas yang dipimpin Facebook Papers With Code (PWC) – para penulis berpendapat bahwa ‘dataset yang banyak digunakan diperkenalkan oleh hanya segelintir lembaga elit’, dan bahwa ‘konsolidasi’ ini telah meningkat menjadi 80% dalam beberapa tahun terakhir.

‘[Kami] menemukan bahwa ada ketidaksetaraan yang meningkat dalam penggunaan dataset secara global, dan bahwa lebih dari 50% dari semua penggunaan dataset dalam sampel kami dari 43.140 sesuai dengan dataset yang diperkenalkan oleh dua belas lembaga elit, terutama Barat.’

Peta penggunaan dataset non-tugas spesifik selama sepuluh tahun terakhir. Kriteria untuk dimasukkan adalah di mana lembaga atau perusahaan menyumbang lebih dari 50% penggunaan yang diketahui. Ditampilkan di sebelah kanan adalah koefisien Gini untuk konsentrasi dataset dari waktu ke waktu untuk lembaga dan dataset. Sumber: https://arxiv.org/pdf/2112.01716.pdf

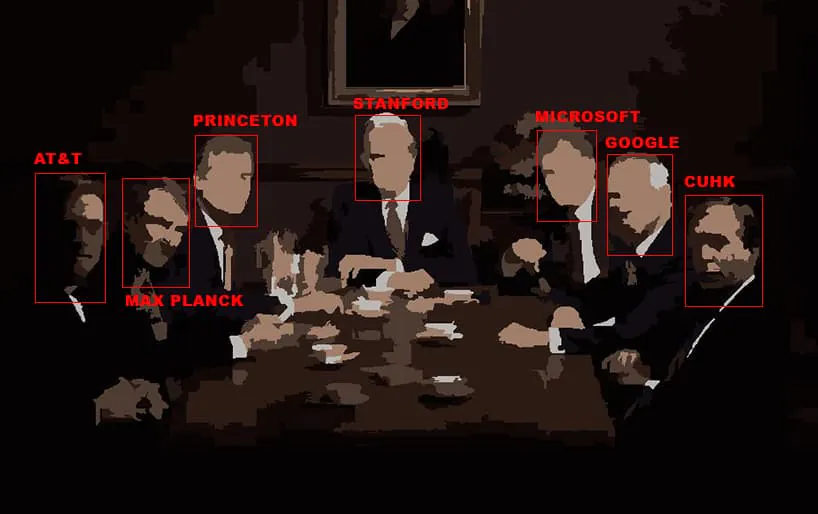

Lembaga dominan termasuk Stanford University, Microsoft, Princeton, Facebook, Google, Max Planck Institute, dan AT&T. Empat dari sepuluh sumber dataset teratas adalah lembaga korporat.

Makalah ini juga menggambarkan penggunaan dataset elit yang semakin meningkat sebagai ‘sarana untuk ketidaksetaraan dalam sains’. Ini karena tim peneliti yang mencari pengakuan komunitas lebih termotivasi untuk mencapai hasil state-of-the-art (SOTA) terhadap dataset yang konsisten daripada menghasilkan dataset asli yang tidak memiliki standing seperti itu, dan yang akan memerlukan rekan untuk beradaptasi dengan metrik baru bukan indeks standar.

Dalam hal apa pun, seperti yang diakui makalah, membuat dataset sendiri adalah upaya yang sangat mahal bagi lembaga dan tim yang kurang ber资源.

‘prima facie validitas ilmiah yang diberikan oleh benchmarking SOTA secara umum dikacaukan dengan kredibilitas sosial yang diperoleh peneliti dengan menunjukkan bahwa mereka dapat bersaing pada dataset yang secara luas diakui, bahkan jika benchmark yang lebih kontekstual mungkin lebih tepat secara teknis.

‘Kami berpendapat bahwa dinamika ini menciptakan “Efek Matius” (yaitu “orang kaya menjadi lebih kaya dan orang miskin menjadi lebih miskin”) di mana benchmark yang sukses, dan lembaga elit yang memperkenalkannya, memperoleh posisi yang tidak seimbang dalam bidang ini.’

Makalah ini berjudul Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research, dan berasal dari Bernard Koch dan Jacob G. Foster di UCLA, dan Emily Denton dan Alex Hanna di Google Research.

Karya ini menimbulkan sejumlah masalah dengan tren konsolidasi yang didokumentasikan, dan telah diterima dengan pengakuan umum di Open Review. Seorang peninjau dari NeurIPS 2021 mengomentari bahwa karya ini ‘sangat relevan bagi siapa saja yang terlibat dalam penelitian pembelajaran mesin.’ dan memprediksi inklusinya sebagai bahan bacaan yang ditugaskan di kursus universitas.

Dari Kebutuhan ke Korupsi

Para penulis mencatat bahwa budaya ‘mengalahkan-benchmark’ saat ini muncul sebagai obat untuk kurangnya alat evaluasi objektif yang menyebabkan minat dan investasi di AI runtuh untuk kedua kalinya lebih dari tiga puluh tahun yang lalu, setelah penurunan antusiasme bisnis terhadap penelitian baru di ‘Sistem Pakar’:

‘Benchmark biasanya memformalkan tugas tertentu melalui dataset dan metrik kuantitatif evaluasi yang terkait. Praktik ini awalnya diperkenalkan ke [penelitian pembelajaran mesin] setelah “Musim Dingin AI” pada 1980-an oleh pemberi dana pemerintah, yang berusaha untuk menilai nilai yang diterima pada hibah dengan lebih akurat.’

Makalah ini berpendapat bahwa keuntungan awal dari budaya standarisasi informal ini (mengurangi hambatan partisipasi, metrik konsisten, dan kesempatan pengembangan yang lebih gesit) mulai ditimbang oleh kerugian yang secara alami terjadi ketika tubuh data menjadi cukup kuat untuk secara efektif mendefinisikan ‘syarat penggunaan’ dan cakupan pengaruhnya.

Para penulis menyarankan, sejalan dengan banyak pemikiran industri dan akademis baru-baru ini tentang masalah ini, bahwa komunitas penelitian tidak lagi memposkan masalah baru jika masalah tersebut tidak dapat diatasi melalui dataset benchmark yang ada.

Mereka juga mencatat bahwa ketaatan buta terhadap sejumlah kecil ‘dataset emas’ ini mendorong peneliti untuk mencapai hasil yang overfitted (yaitu yang khusus dataset dan tidak mungkin berkinerja sebaik itu pada data dunia nyata, pada dataset akademis atau asli baru, atau bahkan pada dataset yang berbeda dalam ‘standar emas’).

‘Mengingat konsentrasi penelitian yang tinggi pada sejumlah kecil dataset benchmark, kami percaya bahwa diversifikasi bentuk evaluasi sangat penting untuk menghindari overfitting ke dataset yang ada dan salah menyajikan kemajuan di bidang ini.’

Pengaruh Pemerintah dalam Penelitian Penglihatan Komputer

Menurut makalah, Penelitian Penglihatan Komputer terkena dampak yang cukup signifikan oleh sindrom yang dijelaskannya daripada sektor lain, dengan para penulis mencatat bahwa penelitian Pemrosesan Bahasa Alami (NLP) kurang terpengaruh. Para penulis berpendapat bahwa hal ini mungkin karena komunitas NLP ‘lebih koheren’ dan lebih besar dalam ukuran, dan karena dataset NLP lebih mudah diakses dan lebih mudah dikurasi, serta lebih kecil dan kurang intensif sumber daya dalam hal pengumpulan data.

Dalam Penglihatan Komputer, dan terutama mengenai dataset Pengenalan Wajah (FR), para penulis berpendapat bahwa kepentingan korporat, negara, dan swasta sering bertabrakan:

‘Lembaga korporat dan pemerintah memiliki tujuan yang mungkin bertentangan dengan privasi (misalnya, pengawasan), dan penimbangan prioritas ini kemungkinan berbeda dari yang diadakan oleh akademisi atau pemangku kepentingan AI yang lebih luas.’

Untuk tugas pengenalan wajah, para peneliti menemukan bahwa insiden dataset akademis murni menurun secara dramatis dibandingkan dengan rata-rata:

‘[Empat] dari delapan dataset (33,69% dari total penggunaan) didanai secara eksklusif oleh perusahaan, militer AS, atau pemerintah Tiongkok (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M akhirnya ditarik karena kontroversi seputar nilai privasi untuk berbagai pemangku kepentingan.’

Dalam grafik di atas, seperti yang dicatat oleh para penulis, kita juga melihat bahwa bidang Pembangkitan Gambar (atau Sintesis Gambar) yang relatif baru sangat bergantung pada dataset yang ada dan jauh lebih tua yang tidak dimaksudkan untuk penggunaan ini.

Pada kenyataannya, makalah ini mengamati tren yang semakin meningkat untuk ‘migrasi’ dataset dari tujuan yang dimaksudkan, mempertanyakan kesesuaian mereka untuk kebutuhan sektor penelitian baru atau terpencil, dan seberapa besar keterbatasan anggaran mungkin ‘menggeneralisasi’ cakupan ambisi peneliti ke dalam kerangka yang lebih sempit yang disediakan oleh bahan yang tersedia dan oleh budaya yang begitu terobsesi dengan peringkat benchmark tahun-ke-tahun sehingga dataset baru memiliki kesulitan mendapatkan traksi.

‘Temuan kami juga menunjukkan bahwa dataset secara teratur berpindah antara komunitas tugas yang berbeda. Pada tingkat paling ekstrem, sebagian besar dataset benchmark yang beredar untuk beberapa komunitas tugas dibuat untuk tugas lain.’

Mengenai tokoh-tokoh pembelajaran mesin (termasuk Andrew Ng) yang telah semakin meminta lebih banyak keanekaragaman dan kurasi dataset dalam beberapa tahun terakhir, para penulis mendukung sentimen ini, tetapi percaya bahwa upaya semacam itu, bahkan jika sukses, bisa potensial ditenggelamkan oleh ketergantungan budaya saat ini pada hasil SOTA dan dataset yang mapan:

‘Penelitian kami menunjukkan bahwa hanya meminta peneliti pembelajaran mesin untuk mengembangkan lebih banyak dataset, dan menggeser struktur insentif sehingga pengembangan dataset dihargai dan dihargai, mungkin tidak cukup untuk diversifikasi penggunaan dataset dan perspektif yang akhirnya membentuk dan menetapkan agenda penelitian MLR.

‘Selain mendorong pengembangan dataset, kami mendukung intervensi kebijakan yang berorientasi pada kesetaraan yang memprioritaskan pendanaan yang signifikan bagi orang-orang di lembaga yang kurang ber资源 untuk membuat dataset berkualitas tinggi. Ini akan diversifikasi – dari perspektif sosial dan budaya – dataset benchmark yang digunakan untuk mengevaluasi metode ML modern.’

6 Desember 2021, 16:49 WIB +2 – Koreksi possessive di judul. – MA