कृत्रिम बुद्धिमत्ता

गहरे नकली की अस्पष्ट परिभाषा

एक प्रेरक नया अध्ययन जर्मनी से यूरोपीय संघ के एआई अधिनियम की ‘डीपफेक’ शब्द की परिभाषा की आलोचना करता है, जिसे विशेष रूप से डिजिटल छवि मैनिपुलेशन के संदर्भ में अत्यधिक अस्पष्ट माना जाता है। लेखकों का तर्क है कि अधिनियम का वास्तविक लोगों या घटनाओं की तरह दिखने वाली सामग्री पर जोर – फिर भी संभावित रूप से नकली दिखाई दे सकता है – अस्पष्टता की कमी है।

वे यह भी रेखांकित करते हैं कि अधिनियम के ‘मानक संपादन’ (अर्थात कथित रूप से छवियों में न्यूनतम एआई-सहायता प्राप्त संशोधन) के अपवाद डिजिटल छवि मैनिपुलेशन में एआई के व्यापक प्रभाव और कलात्मक सम्मेलनों की व्यक्तिपरक प्रकृति को ध्यान में नहीं रखते हैं जो एआई के आगमन से पहले ही मौजूद थे।

इन मुद्दों पर अस्पष्ट कानूनी नियमन दो प्रमुख जोखिमों को जन्म देता है: एक ‘चिलिंग इफेक्ट’, जहां कानून का व्यापक व्याख्यात्मक दायरा नवाचार और नए सिस्टम को अपनाने को दबा देता है; और एक ‘स्कोफ्लॉ इफेक्ट’, जहां कानून को अत्यधिक या अप्रासंगिक माना जाता है।

दोनों मामलों में, अस्पष्ट कानून व्यावहारिक कानूनी परिभाषाओं को स्थापित करने की जिम्मेदारी भविष्य के न्यायिक निर्णयों पर छोड़ देते हैं – एक सावधान और जोखिम-विरोधी विधायी दृष्टिकोण।

एआई-आधारित छवि मैनिपुलेशन प्रौद्योगिकियां कानून की क्षमता से आगे निकलती हैं जो उन्हें संबोधित करती हैं, ऐसा लगता है। उदाहरण के लिए, एआई-चालित ‘स्वचालित’ पोस्ट-प्रोसेसिंग की अवधारणा के लचीलेपन का एक उल्लेखनीय उदाहरण यह है कि हाल के सैमसंग कैमरों में ‘सीन ऑप्टिमाइज़र’ फ़ंक्शन, जो उपयोगकर्ता-ली गई छवियों को चंद्रमा (एक चुनौतीपूर्ण विषय) के साथ बदल सकता है, एक एआई-चालित, ‘परिष्कृत’ छवि के साथ:

[कैप्शन id=”attachment_210152″ align=”alignnone” width=”639″]<img class="wp-image-210152" src="https://www.unite.ai/wp-content/uploads/2024/12/samsung-moon-photo.jpg" alt="शीर्ष बायें, एक वास्तविक उपयोगकर्ता-ली गई छवि का एक उदाहरण चंद्रमा का, सैमसंग-एहंस्ड संस्करण के बगल में स्वचालित रूप से दृश्य अनुकूलक के साथ बनाया गया; दायें, सैमसंग का इस प्रक्रिया का आधिकारिक चित्रण; निचले बायें, रेडिट उपयोगकर्ता u/ibreakphotos के उदाहरण, (बायें) एक जानबूझकर धुंधली छवि चंद्रमा के और (दायें), सैमसंग का इस छवि का पुनः कल्पना – भले ही स्रोत फोटो चंद्रमा की नहीं थी, और एक मॉनिटर की तस्वीर थी। स्रोत (घड़ी की दिशा से शीर्ष-बायें): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/[/कैप्शन]

नीचे की छवि में, हम चंद्रमा की दो छवियों को देखते हैं। बायीं ओर की छवि एक फोटो है जो एक रेडिट उपयोगकर्ता द्वारा ली गई है। यहाँ, छवि को उपयोगकर्ता द्वारा जानबूझकर धुंधली और डाउनस्केल की गई है।

इसके दायीं ओर हम एक फोटो देखते हैं जो उसी डिग्रेडेड छवि को एक सैमसंग कैमरे में एआई-चालित पोस्ट-प्रोसेसिंग के साथ लिया गया है। कैमरा स्वचालित रूप से 'अपग्रेड' की गई 'मून' वस्तु को मान्यता देता है, भले ही यह वास्तविक चंद्रमा न हो।

कागज़ गूगल के हाल के स्मार्टफ़ोन में शामिल 'बेस्ट टेक' फीचर पर गहरी आलोचना करता है – एक विवादास्पद एआई सुविधा जो एक समूह फोटो के 'सर्वश्रेष्ठ' भागों को संपादित करती है, एक फोटोग्राफ़ अनुक्रम की कई सेकंड को स्कैन करती है ताकि मुस्कान को आगे या पीछे की ओर समय के रूप में आवश्यकतानुसार स्कैन किया जा सके – और कोई भी मध्य में पलक झपकते हुए नहीं दिखाई देता है।

कागज़ यह तर्क देता है कि इस प्रकार की संयुक्त प्रक्रिया में घटनाओं को गलत तरीके से प्रस्तुत करने की क्षमता है:

‘[एक] एक टिपिकल समूह फोटो सेटिंग में, एक औसत दर्शक शायद अभी भी परिणामी फोटो को प्रामाणिक मानेगा। मुस्कान जो डाली गई है वह कुछ सेकंड के भीतर शेष फोटो लेने से मौजूद है।

‘दूसरी ओर, बेस्ट टेक फीचर का दस सेकंड का समय फ्रेम एक मूड परिवर्तन के लिए पर्याप्त है। एक व्यक्ति हो सकता है जो हंसते हुए रुक गया हो जबकि समूह एक चुटकुले पर हंसता है जो उनके खिलाफ है।

‘परिणामस्वरूप, हम मानते हैं कि ऐसा समूह फोटो अच्छी तरह से एक गहरा नकली हो सकता है।’

नया कागज़ क्या एक गहरा नकली बनाता है? यूरोपीय संघ के एआई अधिनियम के तहत वैध प्रोसेसिंग और मैनिपुलेशन के बीच धुंधली रेखा शीर्षक से है, और ट्यूबिंगन विश्वविद्यालय और सारलैंड विश्वविद्यालय में गणनात्मक कानून प्रयोगशाला के दो शोधकर्ताओं से आता है।

पुराने तरीके

फोटोग्राफी में समय को मैनिपुलेट करना उपभोक्ता-स्तर के एआई से बहुत पुराना है। नए कागज़ के लेखकों का तर्क है कि बहुत पुरानी तकनीकें मौजूद हैं जिन्हें ‘अस्वाभाविक’ के रूप में तर्क दिया जा सकता है, जैसे कि एक हाई डायनामिक रेंज (एचडीआर) फोटो में कई अनुक्रमिक छवियों का संयोजन, या एक ‘सिले हुए’ पैनोरमिक फोटो।

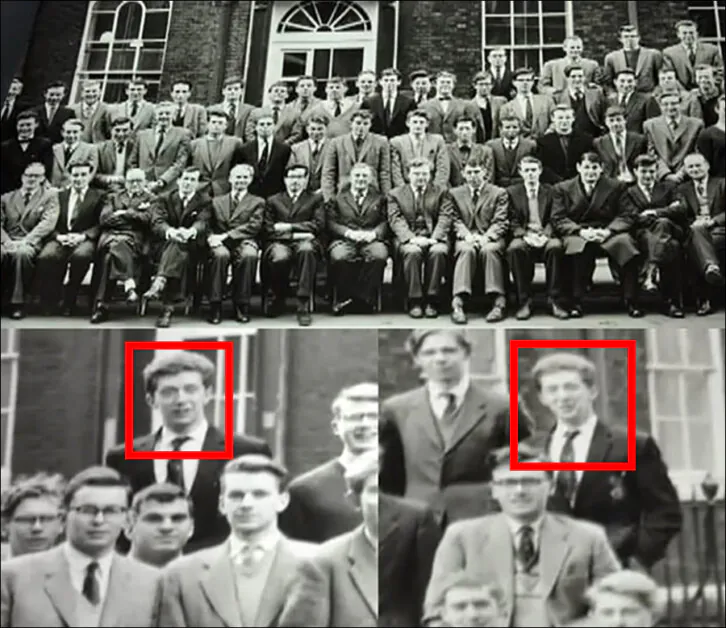

वास्तव में, कुछ पुराने और सबसे मजेदार फोटोग्राफिक नकली पारंपरिक रूप से स्कूली बच्चों द्वारा बनाई गई थीं जो स्कूल समूह फोटोग्राफी के लिए उपयोग की जाने वाली विशेष पैनोरमिक कैमरों के ट्रैक के सामने दौड़कर बनाई जाती थीं – जिससे छात्र एक ही छवि में दो बार दिखाई दे सकते थे:

[कैप्शन id=”attachment_210153″ align=”alignnone” width=”623″]

जब तक आप रॉ मोड में फोटो नहीं लेते हैं, जो मूल रूप से कैमरा लेंस सेंसर को एक बहुत बड़े फ़ाइल में डंप करता है बिना किसी प्रकार की व्याख्या के, यह संभावना है कि आपकी डिजिटल फोटोग्राफ पूरी तरह से प्रामाणिक नहीं हैं। कैमरा सिस्टम नियमित रूप से ‘सुधार’ एल्गोरिदम जैसे कि छवि तेज़ करना और व्हाइट बैलेंस लागू करते हैं, जो डिफ़ॉल्ट रूप से होता है – और उन्होंने ऐसा उपभोक्ता-स्तर की डिजिटल फोटोग्राफी की उत्पत्ति से किया है।

कागज़ के लेखकों का तर्क है कि यहां तक कि इन पुराने प्रकार के डिजिटल फोटो ऑगमेंटेशन वास्तविकता का प्रतिनिधित्व नहीं करते हैं, क्योंकि ऐसे तरीके फोटोग्राफ को अधिक आकर्षक बनाने के लिए डिज़ाइन किए गए हैं, न कि अधिक ‘वास्तविक’।

अध्ययन सुझाव देता है कि यूरोपीय संघ के एआई अधिनियम, बाद के संशोधनों जैसे रिकाइटल 123-27 के साथ, फोटोग्राफ के उत्पादन के संदर्भ में एक साक्ष्य ढांचे में सभी फोटोग्राफिक आउटपुट को रखता है, जो सुरक्षा कैमरा फुटेज या फोरेंसिक फोटोग्राफी की (नाममात्र वस्तुनिष्ठ) प्रकृति के विपरीत है। अधिनियम द्वारा संबोधित अधिकांश छवियां अधिक संभावना है कि वे संदर्भों में उत्पन्न होती हैं जहां निर्माता और ऑनलाइन प्लेटफ़ॉर्म सक्रिय रूप से रचनात्मक फोटो व्याख्या को बढ़ावा देते हैं, जिसमें एआई का उपयोग भी शामिल है।

शोधकर्ताओं का सुझाव है कि फोटोग्राफ़ वास्तविकता का एक वस्तुनिष्ठ चित्रण कभी नहीं रहे हैं। कैमरे के स्थान, चुने गए गहराई के क्षेत्र, और प्रकाश विकल्प जैसे विचार सभी एक फोटोग्राफ़ को गहराई से व्यक्तिपरक बनाने में योगदान करते हैं।

कागज़ यह देखता है कि नियमित ‘क्लीन-अप’ कार्य – जैसे कि सेंसर धूल या एक अच्छी तरह से बनाई गई दृश्य से अवांछित पावर लाइनों को हटाना – एआई के उदय से पहले केवल अर्ध-स्वचालित थे: उपयोगकर्ताओं को अपने वांछित परिणाम प्राप्त करने के लिए एक क्षेत्र का चयन करना या एक प्रक्रिया को आरंभ करना पड़ता था।

आज, ये संचालन अक्सर उपयोगकर्ता के पाठ प्रॉम्प्ट द्वारा ट्रिगर किए जाते हैं, सबसे उल्लेखनीय रूप से फोटोशॉप जैसे टूल में। उपभोक्ता स्तर पर, ऐसी सुविधाएं अब उपयोगकर्ता के इनपुट के बिना स्वचालित रूप से होती हैं – एक परिणाम जिसे निर्माताओं और प्लेटफ़ॉर्म द्वारा ‘स्पष्ट रूप से वांछनीय’ माना जाता है।

गहरे नकली की पतली अर्थ

एआई-परिवर्तित और एआई-उत्पन्न छवियों के नियमन के लिए एक केंद्रीय चुनौती ‘गहरा नकली’ शब्द की अस्पष्टता है, जिसका अर्थ पिछले दो वर्षों में उल्लेखनीय रूप से विस्तारित किया गया है।

मूल रूप से, शब्द केवल ऑटोएन्कोडर-आधारित सिस्टम जैसे डीपफेसलैब और फेसस्वैप से वीडियो आउटपुट पर लागू होता था, जो 2017 के अंत में रेडिट पर अनाम कोड पोस्ट किया गया था।

2022 से, लेटेंट डिफ्यूजन मॉडल (एलडीएम) जैसे स्टेबल डिफ्यूजन और फ्लक्स के आगमन के साथ-साथ पाठ-से-वीडियो सिस्टम जैसे सोरा के साथ, पहचान-विनिमय और अनुकूलन की अनुमति देने में सक्षम थे, साथ ही साथ सुधारित रिज़ॉल्यूशन, बहुमुखी प्रतिभा और विश्वसनीयता में। अब यह संभव था कि हस्तियों और राजनेताओं को चित्रित करने वाले डिफ्यूजन-आधारित मॉडल बनाए जा सकते हैं। चूंकि ‘गहरा नकली’ शब्द पहले से ही एक हेडलाइन-गार्नरिंग खजाना था मीडिया निर्माताओं के लिए, यह इन प्रणालियों को कवर करने के लिए विस्तारित किया गया था।

बाद में, मीडिया और शोध साहित्य में, शब्द में पाठ-आधारित व्यक्ति की नकल भी शामिल थी। इस बिंदु पर, ‘गहरा नकली’ का मूल अर्थ लगभग खो गया था, जबकि इसका विस्तारित अर्थ लगातार विकसित हो रहा था और बढ़ती जा रहा था।

लेकिन चूंकि शब्द इतना उत्तेजक और शक्तिशाली था, और अब एक शक्तिशाली राजनीतिक और मीडिया टचस्टोन था, यह छोड़ना असंभव साबित हुआ। यह पाठकों को वेबसाइटों पर आकर्षित करता था, शोधकर्ताओं को धन मिलता था, और राजनेताओं को ध्यान मिलता था। यह लेक्सिकल अस्पष्टता नई अनुसंधान का मुख्य फोकस है।

जैसा कि लेखकों का तर्क है, यूरोपीय संघ के एआई अधिनियम के अनुच्छेद 3(60) में चार शर्तें हैं जो एक ‘गहरा नकली’ को परिभाषित करती हैं।

1: सच्चा चंद्रमा

पहले, सामग्री उत्पन्न या मैनिपुलेट की जानी चाहिए, अर्थात या तो एआई का उपयोग करके स्क्रैच से बनाई जाती है (उत्पादन) या मौजूदा डेटा (मैनिपुलेशन) से संशोधित की जाती है। कागज़ इस बात पर जोर देता है कि ‘स्वीकार्य’ छवि संपादन परिणामों और मैनिपुलेटिव गहरे नकली के बीच अंतर करने में कठिनाई है, यह देखते हुए कि डिजिटल फोटोग्राफ वैसे भी वास्तविकता का सच्चा प्रतिनिधित्व नहीं हैं।

कागज़ यह तर्क देता है कि एक सैमसंग-उत्पन्न चंद्रमा तर्कसंगत रूप से प्रामाणिक है, क्योंकि चंद्रमा असंभवत: बदलता है, और क्योंकि एआई-उत्पन्न सामग्री, वास्तविक चंद्र छवियों पर प्रशिक्षित, संभवतः सटीक होगी।

हालांकि, लेखकों का यह भी कहना है कि चूंकि सैमसंग सिस्टम को एक ‘सुधारित’ छवि उत्पन्न करने के लिए दिखाया गया है जिसमें स्रोत छवि वास्तव में चंद्रमा नहीं थी, यह एक ‘गहरा नकली’ माना जाएगा।

यह व्यावहारिक होगा कि इस तरह के अद हॉक कार्यक्षमता के आसपास भिन्न उपयोग के मामलों की एक व्यापक सूची तैयार की जाए। इसलिए, परिभाषा का बोझ फिर से न्यायालय के फैसलों पर लगता है।

2: टेक्स्टफेक्स

दूसरा, सामग्री छवि, ऑडियो या वीडियो के रूप में होनी चाहिए। पाठ सामग्री, जबकि अन्य पारदर्शिता दायित्वों के अधीन, यूरोपीय संघ के एआई अधिनियम के तहत एक गहरा नकली नहीं माना जाता है। यह नए अध्ययन में विस्तार से नहीं किया गया है, हालांकि यह दृश्य गहरे नकली की प्रभावशीलता पर एक उल्लेखनीय प्रभाव डाल सकता है (नीचे देखें)।

3: वास्तविक दुनिया की समस्याएं

तीसरा, सामग्री मौजूदा व्यक्तियों, वस्तुओं, स्थानों, संस्थाओं या घटनाओं की तरह दिखनी चाहिए। यह शर्त वास्तविक दुनिया से एक संबंध स्थापित करती है, जिसका अर्थ है कि केवल कल्पनाशील छवियां, भले ही वे फोटोरियलिस्टिक हों, गहरे नकली के रूप में योग्य नहीं होंगी। रिकाइटल 134 यूरोपीय संघ के एआई अधिनियम में ‘समानता’ पहलू पर जोर देते हुए ‘काफी’ शब्द जोड़कर इस शर्त को रेखांकित करता है।

लेखक, पूर्व कार्य का हवाला देते हुए, यह तर्क देते हैं कि क्या एक एआई-उत्पन्न चेहरे को एक वास्तविक व्यक्ति से संबंधित होना चाहिए, या क्या यह केवल एक वास्तविक व्यक्ति के पर्याप्त समान होना चाहिए, इस परिभाषा को संतुष्ट करने के लिए।

उदाहरण के लिए, कैसे निर्धारित किया जा सकता है कि डोनाल्ड ट्रम्प जैसे राजनेता को चित्रित करने वाली फोटोरियलिस्टिक छवियों की एक श्रृंखला वास्तव में उनका प्रतिनिधित्व करने का इरादा है, यदि छवियों (या संलग्न पाठ) में उन्हें विशेष रूप से उल्लेख नहीं किया गया है? चेहरे की पहचान? उपयोगकर्ता सर्वेक्षण? एक न्यायाधीश की ‘सामान्य ज्ञान’ की परिभाषा?

टेक्स्टफेक्स (ऊपर देखें) के मुद्दे पर लौटते हुए, शब्द अक्सर दृश्य गहरे नकली के कार्य में एक महत्वपूर्ण भूमिका निभाते हैं। उदाहरण के लिए, यह संभव है कि ‘व्यक्ति ए‘ की एक (अपरिवर्तित) छवि या वीडियो लें और ‘व्यक्ति बी‘ के रूप में इसका वर्णन करने वाला एक उपशीर्षक या सोशल मीडिया पोस्ट जोड़ें, (यह मानते हुए कि दोनों व्यक्ति एक समानता साझा करते हैं)।

इस मामले में, कोई एआई की आवश्यकता नहीं है, और परिणाम आश्चर्यजनक रूप से प्रभावी हो सकता है – लेकिन क्या ऐसा कम-तकनीक वाला दृष्टिकोण भी एक ‘गहरा नकली’ है?

4: रीटच, रीमॉडल

अंत में, सामग्री एक व्यक्ति के लिए प्रामाणिक या सच्ची दिखाई देनी चाहिए। यह शर्त मानव दर्शकों की धारणा पर जोर देती है। सामग्री जो केवल एक एल्गोरिदम द्वारा वास्तविक व्यक्ति या वस्तु का प्रतिनिधित्व करने के लिए मान्यता प्राप्त है, नहीं एक गहरा नकली माना जाएगा।

इनमें से सभी शर्तों में, यह सबसे अधिक स्पष्ट रूप से बाद के न्यायिक निर्णय के लिए परिभाषा को सौंप देता है, क्योंकि यह किसी भी तकनीकी या यांत्रिक साधनों के माध्यम से व्याख्या की अनुमति नहीं देता है।

स्पष्ट रूप से इस विषयवस्तु पर सहमति तक पहुंचने में कुछ अंतर्निहित कठिनाइयां हैं। लेखकों का तर्क है कि विभिन्न लोग, और विभिन्न प्रकार के लोग (जैसे बच्चे और वयस्क), विभिन्न रूप से एक विशेष गहरे नकली में विश्वास करने की संभावना रखते हैं।

लेखकों ने आगे कहा कि फोटोशॉप जैसे टूल की उन्नत एआई क्षमताएं पारंपरिक ‘गहरा नकली’ की परिभाषा को चुनौती देती हैं। जबकि इन प्रणालियों में मूल रूप से विवादास्पद या निषिद्ध सामग्री के खिलाफ मूलभूत सुरक्षा उपाय शामिल हो सकते हैं, वे ‘रीटचिंग’ की अवधारणा को नाटकीय रूप से विस्तारित करते हैं। उपयोगकर्ता अब एक उच्च स्तर की पेशेवर प्रामाणिकता के साथ वस्तुओं को जोड़ या हटा सकते हैं, जो छवि मैनिपुलेशन की सीमाओं को पुनः परिभाषित करता है।

लेखकों का कहना है:

‘हम तर्क देते हैं कि एआई अधिनियम और संबंधित दायित्वों में गहरे नकली की वर्तमान परिभाषा गहरे नकली द्वारा प्रस्तुत चुनौतियों से निपटने के लिए पर्याप्त रूप से निर्दिष्ट नहीं है। डिजिटल फोटो के जीवन चक्र का विश्लेषण करके, हम पाते हैं कि:

‘(1.) गहरे नकली यूरोपीय संघ के एआई अधिनियम में अस्पष्ट रूप से परिभाषित किए गए हैं। परिभाषा में एक गहरा नकली के लिए बहुत अधिक स्कोप छोड़ देती है।

‘(2.) यह स्पष्ट नहीं है कि गूगल के ‘बेस्ट टेक’ फीचर जैसे संपादन कार्य पारदर्शिता दायित्वों से अपवाद के रूप में कैसे माना जा सकता है।

‘(3.) सामग्री के लिए अपवाद में यह सवाल उठता है कि क्या सामग्री को काफी हद तक संपादित किया जाना चाहिए और क्या यह संपादन मानव द्वारा दिखाई देना चाहिए।’

अपवाद लेना

यूरोपीय संघ के एआई अधिनियम में अपवाद हैं जिन्हें लेखकों का तर्क है कि बहुत अधिक अनुमति देने वाले हो सकते हैं। अनुच्छेद 50(2), वे कहते हैं, मूल स्रोत छवि के अधिकांश को बदले जाने के मामलों में एक अपवाद प्रदान करता है। लेखकों का तर्क है:

‘अनुच्छेद 50(2) के अर्थ में सामग्री क्या हो सकती है? उदाहरण के लिए, छवियों के मामले में, क्या हमें पिक्सेल-स्पेस या मानव द्वारा दिखाई देने वाली दृश्य स्थान पर विचार करना चाहिए? पिक्सेल स्पेस में व्यावहारिक मैनिपुलेशन मानव धारणा को प्रभावित नहीं कर सकता है, और दूसरी ओर, पिक्सेल स्पेस में छोटे विकार मानव धारणा को नाटकीय रूप से बदल सकते हैं। ‘

शोधकर्ता एक हाथगन को एक व्यक्ति की फोटो में जोड़ने का उदाहरण देते हैं जो किसी की ओर इशारा कर रहा है। हाथगन जोड़कर, आप छवि के केवल 5% को बदल रहे हैं; हालांकि, परिवर्तित हिस्से का सेमेंटिक महत्व उल्लेखनीय है। इसलिए, यह अपवाद सामान्य ज्ञान की किसी भी समझ को ध्यान में नहीं रखता है कि एक छोटी सी विस्ता एक छवि के समग्र महत्व को कैसे प्रभावित कर सकती है।

अनुच्छेद 50(2) में ‘मानक संपादन’ के लिए एक ‘सहायक कार्य’ के लिए भी अपवाद है। चूंकि अधिनियम ‘मानक संपादन’ को परिभाषित नहीं करता है, यहां तक कि गूगल के बेस्ट टेक जैसी पोस्ट-प्रोसेसिंग सुविधाएं भी इस अपवाद द्वारा संरक्षित प्रतीत होती हैं, लेखकों का तर्क है।

निष्कर्ष

नए कार्य का उल्लिखित उद्देश्य गहरे नकली के नियमन के आसपास अंतरानुशासनिक अध्ययन को प्रोत्साहित करना है, और कंप्यूटर वैज्ञानिकों और कानूनी विद्वानों के बीच नए संवादों के लिए एक प्रारंभिक बिंदु के रूप में कार्य करना है।

हालांकि, कागज़ खुद को कई बिंदुओं पर तautology में गिरता है: यह अक्सर ‘गहरा नकली’ शब्द का उपयोग करता है जैसे कि इसका अर्थ स्वयं-स्पष्ट है, जबकि यूरोपीय संघ के एआई अधिनियम पर हमला करते हुए जो वास्तव में एक गहरा नकली की परिभाषा करने में विफल रहता है।

सोमवार, 16 दिसंबर, 2024 को पहली बार प्रकाशित