कृत्रिम बुद्धिमत्ता

एलएलएम्स में ब्लैक बॉक्स समस्या: चुनौतियाँ और उभरते समाधान

मशीन लर्निंग, एआई का एक उपसमूह, तीन घटकों से बना होता है: एल्गोरिदम, प्रशिक्षण डेटा और परिणामी मॉडल। एक एल्गोरिदम, जो मूल रूप से प्रक्रियाओं का एक सेट है, एक बड़े उदाहरण सेट (प्रशिक्षण डेटा) से पैटर्न की पहचान करना सीखता है। इस प्रशिक्षण का परिणाम एक मशीन-लर्निंग मॉडल है। उदाहरण के लिए, कुत्तों की छवियों के साथ प्रशिक्षित एक एल्गोरिदम छवियों में कुत्तों की पहचान करने में सक्षम मॉडल का परिणाम होगा।

मशीन लर्निंग में ब्लैक बॉक्स

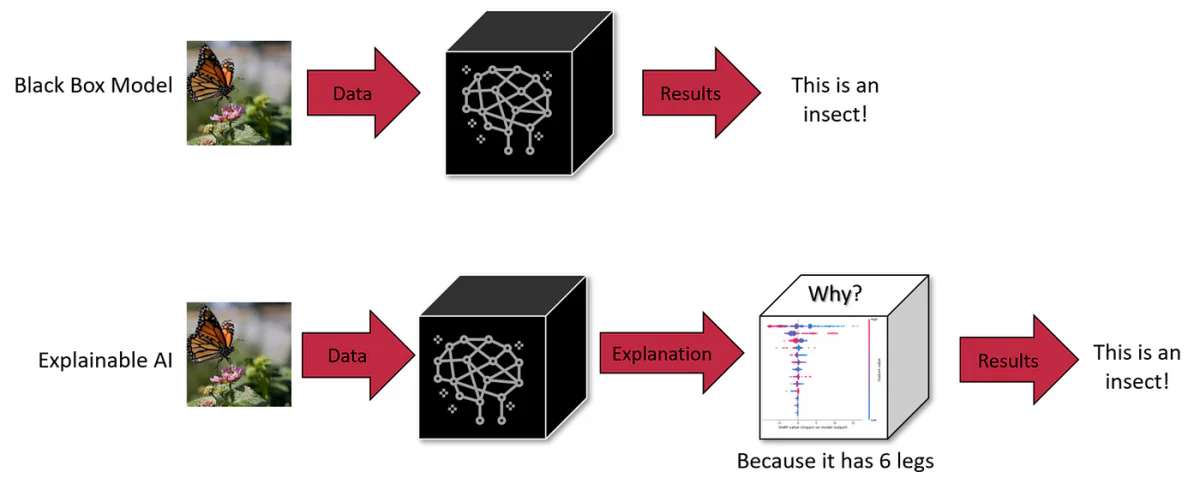

मशीन लर्निंग में, तीन घटकों – एल्गोरिदम, प्रशिक्षण डेटा या मॉडल – में से कोई भी एक ब्लैक बॉक्स हो सकता है। जबकि एल्गोरिदम अक्सर सार्वजनिक रूप से ज्ञात होते हैं, डेवलपर्स बौद्धिक संपदा की रक्षा के लिए मॉडल या प्रशिक्षण डेटा को गोपनीय रखना चुन सकते हैं। यह अस्पष्टता एआई की निर्णय लेने की प्रक्रिया को समझना मुश्किल बना देती है।

एआई ब्लैक बॉक्स वे सिस्टम हैं जिनके आंतरिक कार्य उपयोगकर्ताओं के लिए अपारदर्शी या अदृश्य रहते हैं। उपयोगकर्ता डेटा इनपुट कर सकते हैं और आउटपुट प्राप्त कर सकते हैं, लेकिन आउटपुट उत्पन्न करने वाला तर्क या कोड छिपा रहता है। यह कई एआई सिस्टम में एक सामान्य विशेषता है, जिनमें चैटजीपीटी और डीएलएल-ई 3 जैसे उन्नत जेनरेटिव मॉडल शामिल हैं।

जीपीटी-4 जैसे एलएलएम्स एक महत्वपूर्ण चुनौती प्रस्तुत करते हैं: उनके आंतरिक कार्य बड़े पैमाने पर अपारदर्शी हैं, जिससे वे “ब्लैक बॉक्स” बन जाते हैं। ऐसी अपारदर्शिता न केवल एक तकनीकी पहेली है, बल्कि यह वास्तविक दुनिया की सुरक्षा और नैतिक चिंताएं भी पैदा करती है। उदाहरण के लिए, यदि हम यह नहीं समझ सकते कि ये सिस्टम निष्कर्ष कैसे निकालते हैं, तो क्या हम चिकित्सा निदान या वित्तीय मूल्यांकन जैसे महत्वपूर्ण क्षेत्रों में उन पर भरोसा कर सकते हैं?

लाइम और शाप की तकनीकों का अन्वेषण

मशीन लर्निंग (एमएल) और डीप लर्निंग (डीएल) मॉडल्स में व्याख्यात्मकता हमें इन उन्नत मॉडल्स के अपारदर्शी आंतरिक कार्यों में देखने में मदद करती है। लोकल इंटरप्रिटेबल मॉडल-एग्नोस्टिक एक्सप्लेनेशन्स (लाइम) और शापले एडिटिव एक्सप्लेनेशन्स (शाप) दो ऐसी मुख्यधारा की व्याख्यात्मकता तकनीकें हैं।

लाइम, उदाहरण के लिए, जटिलता को सरल, स्थानीय सरोगेट मॉडल बनाकर तोड़ता है जो मूल मॉडल के व्यवहार को एक विशिष्ट इनपुट के आसपास अनुमानित करते हैं। ऐसा करके, लाइम जटिल मॉडल्स के पूर्वानुमानों पर व्यक्तिगत विशेषताओं के प्रभाव को समझने में मदद करता है, मूल रूप से मॉडल द्वारा एक निश्चित निर्णय लेने के लिए एक ‘स्थानीय’ व्याख्या प्रदान करता है। यह गैर-तकनीकी उपयोगकर्ताओं के लिए विशेष रूप से उपयोगी है, क्योंकि यह मॉडल्स की जटिल निर्णय लेने की प्रक्रिया को अधिक समझने योग्य शब्दों में अनुवादित करता है।

शाप, दूसरी ओर, खेल सिद्धांत से प्रेरित है, विशेष रूप से शापले मूल्यों की अवधारणा से। यह प्रत्येक विशेषता को एक ‘महत्व’ मूल्य सौंपता है, जो दर्शाता है कि प्रत्येक विशेषता वास्तविक पूर्वानुमान और आधार पूर्वानुमान (सभी इनपुट पर औसत पूर्वानुमान) के बीच अंतर में कितना योगदान करती है। शाप की ताकत इसकी निरंतरता और एक वैश्विक दृष्टिकोण प्रदान करने की क्षमता में निहित है – यह न केवल व्यक्तिगत पूर्वानुमानों की व्याख्या करता है, बल्कि मॉडल के बारे में भी अंतर्दृष्टि प्रदान करता है। यह विशेष रूप से मूल्यवान है डीप लर्निंग मॉडल्स में, जहां अंतर्संबंधित परतें और अनेकों पैरामीटर अक्सर पूर्वानुमान प्रक्रिया को एक भूलभुलैया की यात्रा की तरह बना देते हैं। शाप इसे स्पष्ट करता है विशेषताओं के योगदान को मात्रा देकर, मॉडल के निर्णय लेने के मार्गों का एक स्पष्ट नक्शा प्रदान करता है।

शाप (स्रोत)

लाइम और शाप दोनों एआई और एमएल के क्षेत्र में आवश्यक उपकरण के रूप में उभरे हैं, पारदर्शिता और विश्वसनीयता की महत्वपूर्ण आवश्यकता को संबोधित करते हैं। जब हम एआई को विभिन्न क्षेत्रों में गहराई से एकीकृत करते हैं, तो इन मॉडल्स की व्याख्या और समझने की क्षमता न केवल एक तकनीकी आवश्यकता बन जाती है, बल्कि यह नैतिक और जिम्मेदार एआई विकास के लिए एक मूलभूत आवश्यकता भी बन जाती है। ये तकनीकें एमएल और डीएल मॉडल्स की जटिलताओं को समझने में महत्वपूर्ण प्रगति का प्रतिनिधित्व करती हैं, उन्हें अपारदर्शी ‘ब्लैक बॉक्स’ से समझने योग्य प्रणालियों में परिवर्तित करती हैं जिनके निर्णय और व्यवहार को समझा, विश्वास किया जा सकता है और प्रभावी ढंग से उपयोग किया जा सकता है।

एलएलएम्स का पैमाना और जटिलता

इन मॉडल्स का पैमाना उनकी जटिलता में इजाफा करता है। जीपीटी-3 को लें, जिसमें 175 अरब पैरामीटर हैं, और नए मॉडल्स में लाखों करोड़ पैरामीटर हैं। प्रत्येक पैरामीटर न्यूरल नेटवर्क के भीतर जटिल तरीकों से परस्पर क्रिया करता है, जो व्यक्तिगत घटकों को अकेले देखने से अप्रत्याशित क्षमताओं का योगदान करता है। यह पैमाना और जटिलता इसे लगभग असंभव बना देती है कि उनके आंतरिक तर्क को पूरी तरह से समझा जा सके, जो इन मॉडल्स में पूर्वाग्रह या अवांछित व्यवहार का निदान करने में एक बाधा प्रस्तुत करता है।

व्यापार-बंद: पैमाना बनाम व्याख्यात्मकता

एलएलएम्स के पैमाने को कम करने से व्याख्यात्मकता में सुधार हो सकता है, लेकिन इसकी उन्नत क्षमताओं की लागत पर। पैमाना ही उन व्यवहारों को सक्षम बनाता है जो छोटे मॉडल्स हासिल नहीं कर सकते। यह पैमाने, क्षमता और व्याख्यात्मकता के बीच एक अंतर्निहित व्यापार-बंद प्रस्तुत करता है।

एलएलएम ब्लैक बॉक्स समस्या का प्रभाव

1. दोषपूर्ण निर्णय लेना

जीपीटी-3 या बीईआरटी जैसे एलएलएम्स की निर्णय लेने की प्रक्रिया में अपारदर्शिता स्वास्थ्य सेवा या न्यायिक न्याय जैसे क्षेत्रों में अवांछित पूर्वाग्रह और त्रुटियों का कारण बन सकती है, जहां निर्णय दूरगामी परिणामों का कारण बनते हैं। एलएलएम्स को नैतिक और तार्किक ध्वनि के लिए ऑडिट करने में असमर्थता एक बड़ी चिंता है। उदाहरण के लिए, पुराने या पूर्वाग्रहित डेटा पर निर्भर एक चिकित्सा निदान एलएलएम हानिकारक सिफारिशें कर सकता है। इसी तरह, भर्ती प्रक्रियाओं में एलएलएम्स लिंग पूर्वाग्रह को अनजाने में बढ़ावा दे सकते हैं। ब्लैक बॉक्स प्रकृति न केवल दोषों को छुपाती है, बल्कि संभावित रूप से उन्हें बढ़ा सकती है, जिससे पारदर्शिता में सुधार के लिए एक सक्रिय दृष्टिकोण की आवश्यकता होती है।

2. विविध संदर्भों में सीमित अनुकूलन

एलएलएम्स के आंतरिक कार्यों में अंतर्दृष्टि की कमी उनकी अनुकूलन को सीमित करती है। उदाहरण के लिए, एक भर्ती एलएलएम अकादमिक योग्यता की तुलना में व्यावहारिक कौशल को महत्व देने वाली भूमिका के लिए उम्मीदवारों का मूल्यांकन करने में अक्षम हो सकता है, क्योंकि यह अपने मूल्यांकन मानदंड को समायोजित करने में असमर्थ है। इसी तरह, एक चिकित्सा एलएलएम दुर्लभ बीमारी के निदान में संघर्ष कर सकता है क्योंकि डेटा असंतुलन के कारण। यह लचीलापन एलएलएम्स को विशिष्ट कार्यों और संदर्भों के लिए पुनः कैलिब्रेट करने के लिए पारदर्शिता की आवश्यकता को रेखांकित करता है।

3. पूर्वाग्रह और ज्ञान अंतराल

एलएलएम्स द्वारा विशाल प्रशिक्षण डेटा का प्रसंस्करण उनके एल्गोरिदम और मॉडल आर्किटेक्चर द्वारा लगाए गए सीमाओं के अधीन है। उदाहरण के लिए, एक चिकित्सा एलएलएम असंतुलित डेटासेट पर प्रशिक्षित होने पर जनसांख्यिकी पूर्वाग्रह दिखा सकता है। इसके अलावा, एक एलएलएम की विशिष्ट विषयों में प्रवीणता भ्रामक हो सकती है, जिससे अति-आत्मविश्वासी और गलत आउटपुट हो सकते हैं। इन पूर्वाग्रहों और ज्ञान अंतराल को संबोधित करने के लिए केवल अतिरिक्त डेटा की आवश्यकता नहीं है, बल्कि मॉडल की प्रसंस्करण यांत्रिकी की जांच की आवश्यकता है।

4. कानूनी और नैतिक जिम्मेदारी

एलएलएम्स की अस्पष्ट प्रकृति कानूनी रूप से उनके निर्णयों से होने वाले किसी भी नुकसान के लिए जिम्मेदारी के संबंध में एक धुंधला क्षेत्र बनाती है। यदि एक चिकित्सा सेटिंग में एक एलएलएम दोषपूर्ण सलाह प्रदान करता है जिससे रोगी को नुकसान होता है, तो मॉडल की अपारदर्शिता के कारण जिम्मेदारी निर्धारित करना मुश्किल हो जाता है। यह कानूनी अनिश्चितता संवेदनशील क्षेत्रों में एलएलएम्स को तैनात करने वाले संस्थानों के लिए जोखिम पैदा करती है, जो स्पष्ट शासन और पारदर्शिता की आवश्यकता पर जोर देती है।

5. संवेदनशील अनुप्रयोगों में विश्वास के मुद्दे

स्वास्थ्य सेवा और वित्त जैसे महत्वपूर्ण क्षेत्रों में उपयोग किए जाने वाले एलएलएम्स के लिए, पारदर्शिता की कमी उनकी विश्वसनीयता को कमजोर करती है। उपयोगकर्ताओं और नियामकों को यह सुनिश्चित करने की आवश्यकता है कि ये मॉडल्स पूर्वाग्रह या अन्यायपूर्ण मानदंडों पर आधारित निर्णय नहीं लेते हैं। एलएलएम्स में पूर्वाग्रह की अनुपस्थिति की पुष्टि करने के लिए मॉडल की निर्णय लेने की प्रक्रिया को समझना आवश्यक है, जो नैतिक रूप से तैनाती के लिए व्याख्यात्मकता के महत्व पर बल देता है।

6. व्यक्तिगत डेटा के साथ जोखिम

एलएलएम्स को व्यापक प्रशिक्षण डेटा की आवश्यकता होती है, जिसमें संवेदनशील व्यक्तिगत जानकारी शामिल हो सकती है। इन मॉडल्स की ब्लैक बॉक्स प्रकृति यह चिंता पैदा करती है कि यह डेटा कैसे संसाधित किया जाता है और इसका उपयोग कैसे किया जाता है। उदाहरण के लिए, रोगी रिकॉर्ड पर प्रशिक्षित एक चिकित्सा एलएलएम डेटा गोपनीयता और उपयोग के बारे में प्रश्न उठाता है। व्यक्तिगत डेटा के दुरुपयोग या शोषण को रोकने के लिए इन मॉडल्स के भीतर पारदर्शी डेटा हैंडलिंग प्रक्रियाओं की आवश्यकता है।

व्याख्यात्मकता के लिए उभरते समाधान

इन चुनौतियों का सामना करने के लिए, नए तकनीकों का विकास किया जा रहा है। इनमें प्रत्युत्तर मॉडल (सीएफ) अनुमान विधियां शामिल हैं। पहली विधि में एक एलएलएम को एक विशिष्ट पाठ अवधारणा को बदलते हुए अन्य अवधारणाओं को स्थिर रखने के लिए प्रेरित किया जाता है। यह दृष्टिकोण, हालांकि प्रभावी है, अनुमान समय पर संसाधन-गहन है।

दूसरी दृष्टि में प्रशिक्षण के दौरान एक एलएलएम द्वारा निर्देशित एक समर्पित एम्बेडिंग स्पेस बनाना शामिल है। यह स्पेस एक कारण ग्राफ के साथ संरेखित होता है और प्रत्युत्तर मॉडल के अनुमानों की पहचान करने में मदद करता है। यह विधि परीक्षण समय पर कम संसाधनों की आवश्यकता होती है और यहां तक कि अरबों पैरामीटर वाले एलएलएम्स में भी मॉडल के पूर्वानुमानों की प्रभावी व्याख्या प्रदान करने के लिए दिखाया गया है।

इन दृष्टिकों से एनएलपी सिस्टम में कारण व्याख्याओं के महत्व को रेखांकित किया जाता है ताकि सुरक्षा सुनिश्चित की जा सके और विश्वास स्थापित किया जा सके। प्रत्युत्तर अनुमान एक तरीका प्रदान करते हैं कि कैसे एक दिए गए पाठ में एक निश्चित अवधारणा के जेनरेटिव प्रक्रिया में भिन्न होने पर यह कैसे बदल जाएगा, उच्च-स्तरीय अवधारणाओं पर एनएलपी मॉडल्स के व्यावहारिक कारण प्रभाव के अनुमान में सहायता करता है।

गहरा गोता: एलएलएम्स में व्याख्या विधियां और कारणता

प्रोबिंग और फीचर महत्व उपकरण

प्रोबिंग एक तकनीक है जिसका उपयोग मॉडल्स में क्या आंतरिक प्रतिनिधित्व एन्कोड करते हैं, यह जानने के लिए किया जाता है। यह पर्यवेक्षित या अनपर्यवेक्षित हो सकता है और विशिष्ट अवधारणाएं क्या नेटवर्क के कertain स्थानों पर एन्कोड की जाती हैं, यह निर्धारित करने के लिए है। जबकि यह एक हद तक प्रभावी है, प्रोब्स कारण व्याख्याओं को प्रदान करने में कमी महसूस करते हैं, जैसा कि गाइगर एट अल (2021) द्वारा हाइलाइट किया गया है।

फीचर महत्व उपकरण, एक अन्य प्रकार की व्याख्या विधि, अक्सर इनपुट फीचर्स पर केंद्रित होते हैं, हालांकि कुछ ग्रेडिएंट-आधारित विधियां इसे छिपी हुई स्थितियों तक बढ़ाती हैं। एक उदाहरण एकीकृत ग्रेडिएंट विधि है, जो एक कारण व्याख्या प्रदान करती है बेसलाइन (प्रत्युत्तर मॉडल, सीएफ) इनपुट की खोज करके।尽管 इनकी उपयोगिता है, इन विधियों को वास्तविक दुनिया की अवधारणाओं से परे सरल इनपुट विशेषताओं से जुड़ी अपनी विश्लेषणों को जोड़ने में अभी भी संघर्ष करना पड़ता है।

हस्तक्षेप-आधारित विधियां

हस्तक्षेप-आधारित विधियों में इनपुट या आंतरिक प्रतिनिधित्व को संशोधित करना शामिल है ताकि मॉडल के व्यवहार पर प्रभाव का अध्ययन किया जा सके। ये विधियां प्रत्युत्तर राज्य बनाने के लिए कारण प्रभाव का अनुमान लगाने में सक्षम हो सकती हैं, लेकिन उन्हें सावधानी से नियंत्रित किए जाने की आवश्यकता है अन्यथा वे अविश्वसनीय इनपुट या नेटवर्क राज्य उत्पन्न कर सकते हैं। कारण प्रॉक्सी मॉडल (सीपीएम), एस-लर्नर अवधारणा से प्रेरित, इस क्षेत्र में एक नवीन दृष्टिकोण है, जो स्पष्ट मॉडल के व्यवहार की नकल करता है प्रत्युत्तर इनपुट के तहत। हालांकि, प्रत्येक मॉडल के लिए एक अलग एक्सप्लेनर की आवश्यकता एक बड़ी सीमा है।

प्रत्युत्तर अनुमान

प्रत्युत्तर मॉडल्स मशीन लर्निंग में डेटा ऑगमेंटेशन के लिए व्यापक रूप से उपयोग किए जाते हैं, जिसमें विभिन्न कारकों या लेबल में परिवर्तन शामिल है। ये मैनुअल संपादन, सुझाव मूल्य वर्धित प्रतिस्थापन, या स्वचालित पाठ पुनर्लेखन के माध्यम से उत्पन्न किए जा सकते हैं। जबकि मैनुअल संपादन सटीक है, यह संसाधन-गहन भी है। कीवर्ड-आधारित विधियों में उनकी सीमाएं हैं, और उत्पन्न विधियां चिकनाई और कवरेज के बीच संतुलन प्रदान करती हैं।

विश्वासयोग्य व्याख्याएं

व्याख्याओं में विश्वासयोग्यता मॉडल के अंतर्निहित तर्क को सटीक रूप से चित्रित करने को संदर्भित करती है। विश्वासयोग्यता की कोई सार्वभौमिक रूप से स्वीकृत परिभाषा नहीं है, जो इसे विभिन्न मेट्रिक्स जैसे संवेदनशीलता, स्थिरता, फीचर महत्व समझौता, लचीलापन और सिमुलेटेबिलिटी के माध्यम से वर्णित करती है। अधिकांश विधियां फीचर-स्तर की व्याख्याओं पर केंद्रित हैं और अक्सर संबंध को कारण के साथ भ्रमित करती हैं। हमारा काम उच्च-स्तरीय अवधारणा व्याख्याओं प्रदान करने के लिए है, जो कारण साहित्य का लाभ उठाकर एक स्पष्ट मानदंड का प्रस्ताव करता है: ऑर्डर-विश्वासयोग्यता।

हम एलएलएम्स की अंतर्निहित जटिलताओं में गहराई से उतरे हैं, उनकी ‘ब्लैक बॉक्स’ प्रकृति और इससे उत्पन्न महत्वपूर्ण चुनौतियों को समझा है। स्वास्थ्य सेवा और वित्त जैसे संवेदनशील क्षेत्रों में दोषपूर्ण निर्णय लेने के जोखिम से लेकर पूर्वाग्रह और न्याय के नैतिक संकट तक, एलएलएम्स में पारदर्शिता की आवश्यकता कभी भी अधिक स्पष्ट नहीं रही है।

एलएलएम्स और उनके हमारे दैनिक जीवन और महत्वपूर्ण निर्णय लेने की प्रक्रियाओं में एकीकरण का भविष्य न केवल अधिक उन्नत मॉडल्स बनाने पर निर्भर करता है, बल्कि अधिक समझने योग्य और जिम्मेदार मॉडल्स भी बनाने पर निर्भर करता है। व्याख्यात्मकता और व्याख्या की खोज न केवल एक तकनीकी उद्यम है, बल्कि यह एआई सिस्टम में विश्वास बनाने का एक मूलभूत पहलू है। जब एलएलएम्स समाज में अधिक एकीकृत होते हैं, तो पारदर्शिता की मांग न केवल एआई पрак्टिशनर्स से, बल्कि उन सभी उपयोगकर्ताओं से भी बढ़ेगी जो इन सिस्टम के साथ बातचीत करते हैं।