कृत्रिम बुद्धिमत्ता

बड़ी भाषा मॉडल के साथ ग्राफ न्यूरल नेटवर्क को सुपरचार्ज करना: अंतिम गाइड

ग्राफ डेटा संरचनाएं हैं जो विभिन्न डोमेन में जटिल संबंधों का प्रतिनिधित्व करती हैं, जिनमें सोशल नेटवर्क, ज्ञान आधार, जैविक प्रणाली और कई अन्य शामिल हैं। इन ग्राफों में, संस्थाएं नोड के रूप में प्रस्तुत की जाती हैं, और उनके संबंधों को एज के रूप में चित्रित किया जाता है।

इन जटिल संबंधात्मक संरचनाओं का प्रभावी ढंग से प्रतिनिधित्व करने और उनके बारे में तर्क करने की क्षमता नेटवर्क विज्ञान, केमोइन्फॉर्मेटिक्स और रिकॉमेंडर सिस्टम जैसे क्षेत्रों में प्रगति को सक्षम करने के लिए महत्वपूर्ण है।

ग्राफ न्यूरल नेटवर्क (जीएनएन) ग्राफ मशीन लर्निंग कार्यों के लिए एक शक्तिशाली गहरा शिक्षण ढांचे के रूप में उभरे हैं। ग्राफ टोपोलॉजी को न्यूरल नेटवर्क आर्किटेक्चर में पड़ोस के संयोजन या ग्राफ कन्वोल्यूशनल के माध्यम से शामिल करके, जीएनएन नोड विशेषताओं और उनकी संरचनात्मक भूमिकाओं दोनों को एन्कोड करने वाले कम-आयामी वेक्टर प्रतिनिधित्व सीख सकते हैं। यह जीएनएन को विभिन्न अनुप्रयोग क्षेत्रों में नोड वर्गीकरण, लिंक भविष्यवाणी, और ग्राफ वर्गीकरण जैसे कार्यों पर राज्य-ऑफ-द-आर्ट प्रदर्शन प्राप्त करने की अनुमति देता है।

जबकि जीएनएन ने महत्वपूर्ण प्रगति को बढ़ावा दिया है, कुछ प्रमुख चुनौतियां बनी हुई हैं। पर्यवेक्षित जीएनएन मॉडल के प्रशिक्षण के लिए उच्च-गुणवत्ता वाले लेबल वाले डेटा प्राप्त करना महंगा और समय लेने वाला हो सकता है। इसके अलावा, जीएनएन विषम ग्राफ संरचनाओं और स्थितियों के साथ संघर्ष कर सकते हैं जहां परीक्षण समय में ग्राफ वितरण प्रशिक्षण डेटा से काफी भिन्न होता है (बाहर-वितरण सामान्यीकरण)।

इस बीच, बड़ी भाषा मॉडल (एलएलएम) जैसे जीपीटी-4 और एलएलएएमए ने अपनी अविश्वसनीय प्राकृतिक भाषा समझ और पीढ़ी क्षमताओं के साथ दुनिया को झकझोर दिया है। अरबों पैरामीटर के साथ विशाल पाठ निगमों पर प्रशिक्षित, एलएलएम को उल्लेखनीय कुछ-शॉट सीखने की क्षमता, कार्यों में सामान्यीकरण और सामान्य ज्ञान कौशल प्रदर्शित करते हैं जो एक बार एआई प्रणालियों के लिए बहुत चुनौतीपूर्ण माने जाते थे।

एलएलएम की उल्लेखनीय सफलता ने ग्राफ मशीन लर्निंग कार्यों के लिए उनकी शक्ति का लाभ उठाने के अन्वेषण को उत्तेजित किया है। एक ओर, एलएलएम की ज्ञान और तर्क क्षमताएं पारंपरिक जीएनएन मॉडल को बढ़ाने के अवसर प्रस्तुत करती हैं। इसके विपरीत, ग्राफ में निहित संरचित प्रतिनिधित्व और तथ्यात्मक ज्ञान एलएलएम की कुछ प्रमुख सीमाओं को संबोधित करने में महत्वपूर्ण हो सकते हैं, जैसे कि हॉलुसिनेशन और व्याख्यात्मकता की कमी।

ग्राफ न्यूरल नेटवर्क और स्व-पर्यवेक्षित शिक्षण

आवश्यक संदर्भ प्रदान करने के लिए, हम पहले ग्राफ न्यूरल नेटवर्क और स्व-पर्यवेक्षित ग्राफ प्रतिनिधित्व शिक्षण में मुख्य अवधारणाओं और विधियों की संक्षेप में समीक्षा करेंगे।

ग्राफ न्यूरल नेटवर्क आर्किटेक्चर

ग्राफ न्यूरल नेटवर्क आर्किटेक्चर – स्रोत

पारंपरिक गहरे न्यूरल नेटवर्क और जीएनएन के बीच मुख्य अंतर उनकी ग्राफ-संरचित डेटा पर सीधे संचालित करने की क्षमता में निहित है। जीएनएन पड़ोस संयोजन योजना का पालन करते हैं, जहां प्रत्येक नोड अपने पड़ोसियों से विशेषता वेक्टर को एकत्र करके अपना प्रतिनिधित्व गणना करता है।

विभिन्न जीएनएन आर्किटेक्चर प्रस्तावित किए गए हैं जिनमें संदेश और अद्यतन कार्यों के विभिन्न संस्करण हैं, जैसे कि ग्राफ कन्वोल्यूशनल नेटवर्क (जीसीएन), ग्राफसेज, ग्राफ अटेंशन नेटवर्क (जीएटी), और ग्राफ आइसोमोर्फिज्म नेटवर्क (जीआईएन) अन्य लोगों के बीच।

हाल के वर्षों में, ग्राफ ट्रांसफॉर्मर ने ग्राफ-संरचित डेटा पर संचालित करने के लिए प्राकृतिक भाषा ट्रांसफॉर्मर से स्व-ध्यान तंत्र को अनुकूलित करके लोकप्रियता हासिल की है। कुछ उदाहरणों में ग्राफॉर्मरट्रांसफॉर्मर और ग्राफफॉर्मर शामिल हैं। ये मॉडल शुद्ध पड़ोस-आधारित जीएनएन की तुलना में ग्राफ में दूरस्थ निर्भरताओं को बेहतर ढंग से पकड़ सकते हैं।

ग्राफ पर स्व-पर्यवेक्षित शिक्षण

जबकि जीएनएन शक्तिशाली प्रतिनिधित्व मॉडल हैं, उनका प्रदर्शन अक्सर पर्यवेक्षित प्रशिक्षण के लिए आवश्यक बड़े लेबल वाले डेटासेट की कमी से बाधित होता है। ग्राफ डेटा पर जीएनएन को प्री-ट्रेन करने के लिए स्व-पर्यवेक्षित शिक्षण एक आशाजनक परिप्रेक्ष्य के रूप में उभरा है, जो केवल ग्राफ संरचना और नोड विशेषताओं की आवश्यकता वाले पूर्वावलोकन कार्यों का लाभ उठाता है।

स्व-पर्यवेक्षित जीएनएन प्री-प्रशिक्षण के लिए कुछ सामान्य पूर्वावलोकन कार्यों में शामिल हैं:

- नोड प्रॉपर्टी प्रेडिक्शन: नोड विशेषताओं के एक हिस्से को यादृच्छिक रूप से मास्किंग या भ्रष्ट करना और जीएनएन को उन्हें पुनर्निर्माण करने का कार्य सौंपना।

- एज/लिंक प्रेडिक्शन: यादृच्छिक एज मास्किंग के आधार पर एक जोड़े नोड के बीच एक एज की उपस्थिति की भविष्यवाणी करने का शिक्षण।

- विरोधाभासी शिक्षण: एक ही ग्राफ नमूने के ग्राफ दृश्यों के बीच समानता को अधिकतम करना जबकि विभिन्न ग्राफों से दृश्यों को अलग करना।

- पारस्परिक सूचना अधिकतमकरण: स्थानीय नोड प्रतिनिधित्व और एक लक्ष्य प्रतिनिधित्व जैसे वैश्विक ग्राफ एम्बेडिंग के बीच पारस्परिक सूचना को अधिकतम करना।

इन पूर्वावलोकन कार्यों जैसे कार्यों के माध्यम से, जीएनएन अप्रशिक्षित ग्राफ डेटा से अर्थपूर्ण संरचनात्मक और सेमेंटिक पैटर्न निकाल सकता है। प्री-प्रशिक्षित जीएनएन को तब नोड वर्गीकरण, लिंक भविष्यवाणी, और ग्राफ वर्गीकरण जैसे डाउनस्ट्रीम कार्यों पर उत्कृष्टता प्राप्त करने के लिए छोटे लेबल वाले उपसेट पर फाइन-ट्यून किया जा सकता है।

स्व-पर्यवेक्षित शिक्षण का लाभ उठाकर, बड़े अप्रशिक्षित डेटासेट पर प्री-प्रशिक्षित जीएनएन डेटा वितरण में परिवर्तनों के प्रति बेहतर सामान्यीकरण, लचीलापन और दक्षता प्रदर्शित करते हैं। हालांकि, पारंपरिक जीएनएन-आधारित स्व-पर्यवेक्षित विधियों की कुछ प्रमुख सीमाएं बनी हुई हैं, जिन्हें हम आगे एलएलएम का लाभ उठाकर संबोधित करेंगे।

ग्राफ एमएल को बड़ी भाषा मॉडल के साथ बढ़ाना

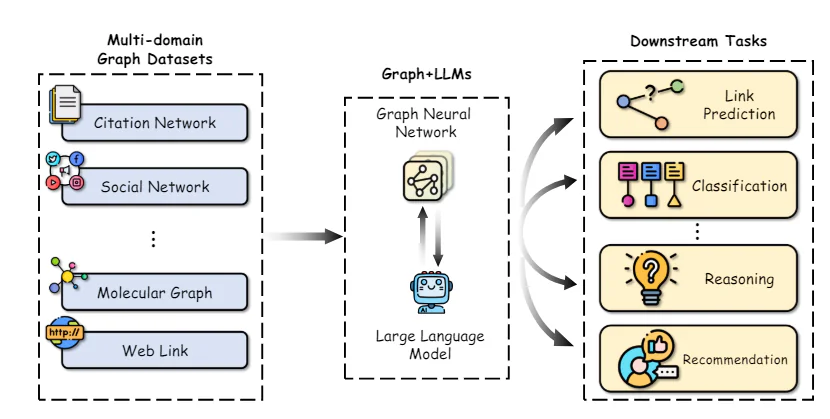

ग्राफ और एलएलएम का एकीकरण – स्रोत

एलएलएम की उल्लेखनीय क्षमताएं प्राकृतिक भाषा समझ, तर्क और कुछ-शॉट सीखने में ग्राफ मशीन लर्निंग कार्यों के लिए उनकी शक्ति का लाभ उठाने के अवसर प्रस्तुत करती हैं। हम इस स्थान में कुछ प्रमुख अनुसंधान दिशाओं का अन्वेषण करते हैं:

एक प्रमुख चुनौती जीएनएन को लागू करने में नोड और एज के लिए उच्च-गुणवत्ता वाले विशेषता प्रतिनिधित्व प्राप्त करना है, विशेष रूप से जब वे समृद्ध पाठ विशेषताओं जैसे विवरण, शीर्षक या सारांश को शामिल करते हैं। पारंपरिक रूप से, बैग-ऑफ-वर्ड्स या प्री-प्रशिक्षित शब्द एम्बेडिंग मॉडल का उपयोग किया जाता था, जो अक्सर सूक्ष्म सेमेंटिक्स को पकड़ने में विफल रहते थे।

हाल के कार्यों ने दिखाया है कि बड़ी भाषा मॉडल को पाठ एन्कोडर के रूप में उपयोग करने की शक्ति का लाभ उठाकर नोड/एज विशेषता प्रतिनिधित्व को बेहतर बनाने के लिए। उदाहरण के लिए, चेन एट अल जैसे एलएलएम का उपयोग पाठ नोड विशेषताओं को एन्कोड करने के लिए करते हैं, जो पारंपरिक शब्द एम्बेडिंग की तुलना में नोड वर्गीकरण कार्यों पर महत्वपूर्ण प्रदर्शन लाभ दिखाते हैं।

एलएलएम का उपयोग करके मूल पाठ विशेषताओं से बढ़ाया जानकारी उत्पन्न करने के अलावा, एलएलएम सेमी-पर्यवेक्षित तरीके से अतिरिक्त सुविधाएं प्रदान कर सकते हैं। टेप एलएलएम का उपयोग नोड के लिए संभावित लेबल/विवरण उत्पन्न करने के लिए करता है और उन्हें अतिरिक्त सुविधाओं के रूप में उपयोग करता है। केईए नोड विशेषताओं से एलएलएम का उपयोग करके शब्दों को निकालता है और उन शब्दों के लिए विस्तृत विवरण प्राप्त करता है ताकि सुविधाओं को बढ़ाया जा सके।

इनपुट विशेषताओं की गुणवत्ता और अभिव्यंजकता में सुधार करके, एलएलएम जीएनएन को अपनी उत्कृष्ट प्राकृतिक भाषा समझ क्षमता प्रदान कर सकते हैं, जिससे डाउनस्ट्रीम कार्यों पर प्रदर्शन में वृद्धि होती है।