विचार नेता

डेटा वैज्ञानिकों को ग्राफ ट्रांसफॉर्मर और संरचित डेटा पर उनके प्रभाव के बारे में क्या जानना चाहिए

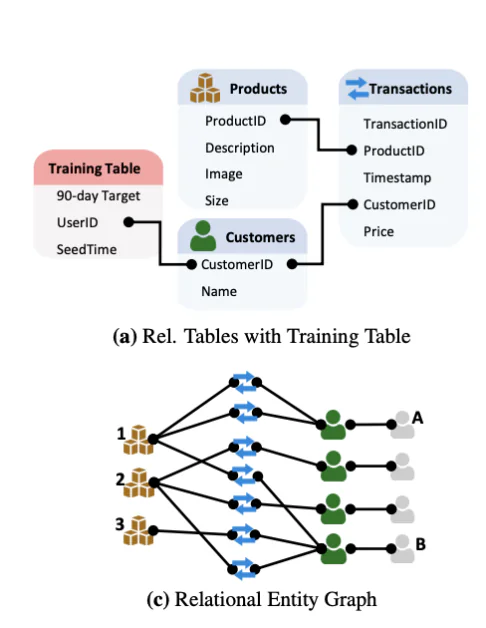

मैंने स्टैनफोर्ड में रहते हुए ग्राफ न्यूरल नेटवर्क का सह-निर्माण किया। मैंने शुरू से ही पहचाना कि यह तकनीक अविश्वसनीय रूप से शक्तिशाली है। प्रत्येक डेटा बिंदु, प्रत्येक अवलोकन, ज्ञान का प्रत्येक टुकड़ा अलगाव में नहीं है; यह अन्य ज्ञान के टुकड़ों से जुड़े एक ग्राफ का हिस्सा है। महत्वपूर्ण बात यह है कि अधिकांश मूल्यवान व्यावसायिक डेटा, अक्सर डेटाबेस और डेटा वेयरहाउस में टेबल के रूप में संग्रहीत, प्राकृतिक रूप से एक ग्राफ के रूप में प्रस्तुत किया जा सकता है। इस संबंधपरक संरचना का दोहन सटीक और गैर-हॉलुसिनेटिंग एआई मॉडल बनाने की कुंजी है।

ग्राफ न्यूरल नेटवर्क (जीएनएन) ने संदेश-पासिंग आर्किटेक्चर पेश किए जो ज्ञान के टुकड़ों के बीच संबंधों को पकड़ते हुए ग्राफ पर कारण बन सकते हैं। लेकिन जैसे ट्रांसफॉर्मर ने भाषा समझ को बदल दिया, एक नए प्रकार के मॉडल, ग्राफ ट्रांसफॉर्मर, ग्राफ-आधारित डेटा में समान लाभ ला रहे हैं। ये मॉडल ध्यान तंत्र की लचीलापन को संरचनात्मक ग्राफ प्राथमिकताओं के साथ जोड़ती हैं ताकि जटिल संबंधों को अधिक प्रभावी ढंग से मॉडल कर सकें जो उनके जीएनएन पूर्ववर्तियों की तुलना में है।

ग्राफ को संदेश पासिंग से अधिक की आवश्यकता क्यों है

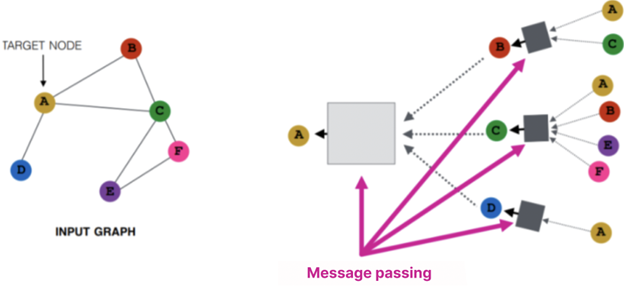

पारंपरिक ग्राफ न्यूरल नेटवर्क (जीएनएन) संदेश पासिंग पर निर्भर करते हैं, एक प्रक्रिया जहां प्रत्येक नोड अपने आंतरिक राज्य को अपने पड़ोसियों से जानकारी एकत्र करके अपडेट करता है। इसे प्रत्येक नोड के रूप में सोचें जो निकटवर्ती नोड्स के साथ सारांश का आदान-प्रदान करता है, फिर उन सारांशों का उपयोग अपनी समझ को परिष्कृत करने के लिए करता है। कई परतों पर, यह जानकारी को ग्राफ के माध्यम से प्रसारित करने की अनुमति देता है।

जबकि स्थानीय पैटर्न सीखने के लिए शक्तिशाली, संदेश पासिंग में महत्वपूर्ण सीमाएं हैं:

- ओवर-स्क्वैशिंग: जैसे ही जानकारी कई कूदों पर एकत्र की जाती है, यह संकुचित हो सकती है, अर्थपूर्ण विवरण खो देती है। यह गहरे जीएनएन में विशेष रूप से समस्याग्रस्त है।

- सीमित संदर्भ: मानक संदेश पासिंग दूरस्थ निर्भरताओं को आसानी से पकड़ नहीं सकता है जिसमें कई परतें हों, जो जटिलता और शोर को बढ़ाता है।

- अभिव्यक्ति: कई ग्राफ संरचनाओं को केवल स्थानीय पड़ोस की जानकारी का उपयोग करके भेद नहीं किया जा सकता है, जो बारीक संरचनात्मक विभेदों की आवश्यकता वाले कार्यों पर मॉडल प्रदर्शन को सीमित करता है।

यहीं पर ग्राफ ट्रांसफॉर्मर कदम रखते हैं। संदेश पासिंग को ध्यान तंत्र से प्रतिस्थापित या पूरक करके, वे प्रत्येक नोड को सीखे हुए महत्व के आधार पर दूरस्थ नोड्स (यहां तक कि दूरस्थ लोगों) पर सीधे ध्यान केंद्रित करने की अनुमति देते हैं। परिणाम समृद्ध प्रतिनिधित्व, बेहतर स्केलेबिलिटी और जटिल संरचनाओं पर अधिक लचीले तरीके से तर्क करने की क्षमता है।

जीएनएन से ग्राफ ट्रांसफॉर्मर

मूल ट्रांसफॉर्मर मॉडल, प्रतिष्ठित पत्र में पेश किया गया, ध्यान ही सब कुछ है, क्रमिक डेटा में टोकन के बीच संबंधों को मॉडल करने के लिए डिज़ाइन किया गया था। इसकी सफलता स्व-ध्यान में निहित है, एक तंत्र जो प्रत्येक इनपुट को सीखे हुए प्रासंगिकता द्वारा भारित अन्य प्रत्येक इनपुट पर विचार करने की अनुमति देता है।

ग्राफ ट्रांसफॉर्मर इस परिदृश्य को अपनाते हैं ताकि नोड्स न केवल अपने पड़ोसियों पर ध्यान केंद्रित कर सकें बल्कि ग्राफ में किसी भी नोड पर, या तो पूरी तरह से जुड़े हुए ध्यान या स्थानीय और वैश्विक संकेतों के बीच संतुलन बनाने वाले हाइब्रिड दृष्टिकोण के माध्यम से। चुनौती एक मॉडल में संरचना की धारणा पेश करना है जो अनस्ट्रक्चर्ड क्रम के लिए डिज़ाइन किया गया है।

ग्राफ-विशिष्ट स्थिति एन्कोडिंग

पाठ के विपरीत, ग्राफ में एक आंतरिक क्रम नहीं है, जो स्थिति एन्कोडिंग को जटिल बनाता है, जो संरचनात्मक या स्थान-आधारित जानकारी को मॉडल में इंजेक्ट करने के लिए तकनीकों को संदर्भित करता है। ग्राफ ट्रांसफॉर्मर विभिन्न तरीकों से इसे संबोधित करते हैं:

- लैप्लासियन आइगेनवेक्टर: ग्राफ लैप्लासियन मैट्रिक्स से प्राप्त, वे एक स्पेक्ट्रल एम्बेडिंग प्रदान करते हैं जो वैश्विक संरचना को पकड़ता है।

- रैंडम वॉक: एक नोड से दूसरे नोड तक कई कूदों पर जाने की संभावना को पकड़ लेता है।

- संरचनात्मक एन्कोडिंग: दूरी मेट्रिक्स, नोड डिग्री, या एज प्रकार शामिल हैं।

इन स्थिति एन्कोडिंग, चाहे वे स्पेक्ट्रल, संभाव्य या संरचनात्मक हों, ग्राफ ट्रांसफॉर्मर को यह समझने का एक तरीका प्रदान करते हैं कि प्रत्येक नोड व्यापक ग्राफ में कहां बैठता है। यह संरचनात्मक जागरूकता असमान, अनियंत्रित डेटा पर ध्यान तंत्र को अर्थपूर्ण रूप से संचालित करने के लिए आवश्यक है, अंततः साधारण, स्थानीय तरीकों के लिए अदृश्य संबंधों को पकड़ने की अनुमति देता है।

वास्तविक दुनिया के कार्यान्वयन और उपयोग के मामले

ग्राफ ट्रांसफॉर्मर को उत्पादन में लाने के लिए वास्तविक दुनिया के डेटा आकार तक स्केल करने में सक्षम बुनियादी ढांचे की आवश्यकता होती है। पुस्तकालय जैसे पाइटोर्च ज्यामिति (पीजी) इसे संभव बना रहे हैं। पाइटोर्च पर निर्मित, पीजी एक मॉड्यूलर फ्रेमवर्क प्रदान करता है जो अनुप्रयोगों की एक श्रृंखला में जीएनएन और ग्राफ ट्रांसफॉर्मर को लागू करने के लिए, अणु मॉडलिंग से लेकर सिफारिश प्रणालियों तक। यह छोटे ग्राफ और एकल बड़े ग्राफ दोनों पर मिनी-बैच प्रशिक्षण का समर्थन करता है, जिसमें मल्टी-जीपीयू और टॉर्च.कंपाइल समर्थन है, जो इसे शोध और उद्यम कार्यप्रवाह दोनों के लिए उपयुक्त बनाता है।

इन उपकरणों ने पहले से ही व्यापक श्रृंखला के वास्तविक दुनिया के अनुप्रयोगों को संचालित किया है। दवा खोज में, ग्राफ ट्रांसफॉर्मर परमाणु बातचीत को ग्राफ के रूप में मॉडल करके अणु गुणों की भविष्यवाणी में मदद करते हैं। लॉजिस्टिक्स और आपूर्ति श्रृंखला अनुकूलन में, वे शिपमेंट, गोदामों और मार्गों के डायनामिक नेटवर्क का प्रतिनिधित्व और तर्क कर सकते हैं। ई-कॉमर्स कंपनियां उत्पाद सह-खरीद और ब्राउज़िंग व्यवहार को संबंधपरक ग्राफ के रूप में समझकर सिफारिशों में सुधार के लिए उनका उपयोग करती हैं। और साइबर सुरक्षा में, ग्राफ-आधारित मॉडल एक्सेस पैटर्न, नेटवर्क टोपोलॉजी और इवेंट अनुक्रमों का विश्लेषण करके असामान्यताओं का पता लगाने के लिए उपयोग किए जाते हैं।

प्रत्येक सेटिंग में, जटिल, अंतर्संबंधित संरचनाओं से सीखने की क्षमता, बिना हाथ से तैयार किए गए विशेषताओं पर निर्भर करते हुए, एक बड़ा लाभ साबित हो रही है।

तकनीकी विचार

ग्राफ ट्रांसफॉर्मर के पास अपने वास्तविक इंजीनियरिंग ट्रेड-ऑफ हैं। पूर्ण स्व-ध्यान नोड्स की संख्या के साथ द्विगुणित रूप से स्केल करता है, जो बड़े पैमाने पर या घने ग्राफ के लिए स्मृति और कंप्यूटर दक्षता को शीर्ष चिंता बनाता है। कई वास्तविक दुनिया के ग्राफ में दिशात्मक किनारे होते हैं, जो संरचनात्मक जानकारी को कैसे एन्कोड किया जाता है इसे जटिल बनाते हैं। और व्यावहारिक तैनाती में, इनपुट शायद ही कभी समान होते हैं: ग्राफ-संरचित डेटा को पाठ, समय श्रृंखला, या छवियों के साथ जोड़ने से सावधानीपूर्वक वास्तुकला विकल्पों और मजबूत डेटा प्रीप्रोसेसिंग की मांग होती है।

इन चुनौतियों का सामना करना असंभव नहीं है, लेकिन उन्हें सावधानीपूर्वक सिस्टम डिज़ाइन की आवश्यकता है, विशेष रूप से जब शोध प्रोटोटाइप से उत्पादन तैयार मॉडल में संक्रमण होता है।

क्या आगे है: एलएलएम मीट ग्राफ

एक प्रमुख शोध दिशा बड़े भाषा मॉडल (एलएलएम) को ग्राफ संरचनाओं के साथ एकीकृत करना है। ये हाइब्रिड सिस्टम एलएलएम का उपयोग पाठ संदर्भ को एन्कोड करने या संस्थाओं को निकालने के लिए करते हैं, फिर उस जानकारी को तर्क और निर्णय लेने के लिए एक ग्राफ में आधार बनाते हैं।

जीव विज्ञान में, इसने अल्फाफोल्ड जैसे उपकरणों को संचालित किया है। उद्यम एआई में, यह दस्तावेज़ीकरण और व्यवहार ग्राफ को मिलाने वाले ग्राहक सहायता प्रणालियों को सक्षम बनाता है। ग्राफ ट्रांसफॉर्मर स्मार्टर, अधिक कार्रवाई योग्य निर्णय लेने में एआई एजेंटों को सक्षम करने में भी बढ़ती भूमिका निभा रहे हैं ताकि वे संरचित राज्य प्रतिनिधित्व पर तर्क कर सकें और गतिशील रूप से बातचीत को प्राथमिकता दे सकें। यह संलयन एजेंटों को पदानुक्रमित संबंधों को बेहतर ढंग से समझने, समय के साथ निर्भरता को ट्रैक करने और जटिल वातावरण में अपने व्यवहार को अनुकूलित करने में मदद करता है।

क्षेत्र अभी भी उभर रहा है, लेकिन संभावना महत्वपूर्ण है।

निष्कर्ष

ग्राफ ट्रांसफॉर्मर जीएनएन का अगला संस्करण नहीं हैं; वे ध्यान, संरचना और स्केलेबिलिटी का संगम प्रतिनिधित्व करते हैं। चाहे आप वित्त, जीवन विज्ञान या रिकमेंडर सिस्टम में काम कर रहे हों, संदेश स्पष्ट है: आपका डेटा एक ग्राफ बनाता है, इसलिए आपके मॉडल को भी ऐसा ही करना चाहिए।