कृत्रिम बुद्धिमत्ता

बहुमोडल एआई का विकास जैसे चैटजीपीटी जीपीटी-4वी(िजन) के साथ दृष्टि प्राप्त करता है

मानवों की तरह एआई बनाने के लिए चल रहे प्रयास में, ओपनएआई के जीपीटी मॉडल ने लगातार सीमाओं को तोड़ा है। जीपीटी-4 अब पाठ और छवियों दोनों के प्रॉम्प्ट स्वीकार करने में सक्षम है।

बहुमोडल जनरेटिव एआई में एक मॉडल की विभिन्न आउटपुट जैसे पाठ, छवियों या ऑडियो का उत्पादन करने की क्षमता शामिल है, जो इनपुट पर आधारित है। ये मॉडल, विशिष्ट डेटा पर प्रशिक्षित, नई डेटा का उत्पादन करने के लिए अंतर्निहित पैटर्न सीखते हैं, एआई अनुप्रयोगों को समृद्ध करते हैं।

बहुमोडल एआई में हाल की प्रगति

एक हालिया उल्लेखनीय छलांग इस क्षेत्र में देखी जा सकती है जब डीएलएल-ई 3 को चैटजीपीटी में एकीकृत किया जाता है, जो ओपनएआई की पाठ-से-छवि प्रौद्योगिकी में एक महत्वपूर्ण अपग्रेड है। यह मिश्रण एक सुचारू इंटरैक्शन की अनुमति देता है जहां चैटजीपीटी डीएलएल-ई 3 के लिए सटीक प्रॉम्प्ट तैयार करने में मदद करता है, उपयोगकर्ता के विचारों को जीवंत एआई-जनरेटेड कला में बदल देता है। इसलिए, जबकि उपयोगकर्ता सीधे डीएलएल-ई 3 के साथ बातचीत कर सकते हैं, चैटजीपीटी को मिलाने से एआई कला बनाने की प्रक्रिया बहुत अधिक उपयोगकर्ता-मित्री हो जाती है।

डीएलएल-ई 3 और इसके चैटजीपीटी के साथ एकीकरण के बारे में अधिक जानकारी प्राप्त करें यहाँ. यह सहयोग न केवल बहुमोडल एआई में प्रगति को प्रदर्शित करता है, बल्कि एआई कला निर्माण को उपयोगकर्ताओं के लिए एक तीव्र प्रक्रिया बनाता है।

गूगल के स्वास्थ्य ने दूसरी ओर जून में मेड-पीएलएम एम की शुरुआत की। यह एक बहुमोडल जनरेटिव मॉडल है जो विविध जैव चिकित्सा डेटा को एनकोड और व्याख्या करने में कुशल है। यह पाल्म-ई, एक भाषा मॉडल को चिकित्सा डोमेन में उपयोग करने के लिए एक ओपन-सोर्स बेंचमार्क, मल्टीमेडबेंच का उपयोग करके किया गया था। इस बेंचमार्क में 7 जैव चिकित्सा डेटा प्रकार और 14 कार्यों जैसे चिकित्सा प्रश्न-उत्तर और रेडियोलॉजी रिपोर्ट जनरेशन के साथ 1 मिलियन से अधिक नमूने शामिल हैं।

विभिन्न उद्योग नवीन बहुमोडल एआई टूल्स को अपना रहे हैं ताकि व्यवसाय विस्तार, संचालन को सुव्यवस्थित करें और ग्राहक जुड़ाव को बढ़ा सकें। आवाज, वीडियो और पाठ एआई क्षमताओं में प्रगति बहुमोडल एआई के विकास को बढ़ावा दे रही है।

उद्यम बहुमोडल एआई अनुप्रयोगों की मांग कर रहे हैं जो व्यवसाय मॉडल और प्रक्रियाओं को बदलने में सक्षम हों, जेनरेटिव एआई पारिस्थितिकी तंत्र में विकास के मार्ग खोलते हैं, डेटा टूल से लेकर उभरते एआई अनुप्रयोगों तक।

जीपीटी-4 के मार्च में लॉन्च होने के बाद, कुछ उपयोगकर्ताओं ने समय के साथ इसकी प्रतिक्रिया गुणवत्ता में गिरावट का अवलोकन किया, जो एक चिंता है जो उल्लेखनीय डेवलपर्स और ओपनएआई के मंचों द्वारा प्रतिध्वनित हुई। शुरू में ओपनएआई द्वारा खारिज किए जाने के बाद, बाद के एक अध्ययन ने इस मुद्दे की पुष्टि की, जिसमें मार्च और जून के बीच जीपीटी-4 की सटीकता में 97.6% से 2.4% की गिरावट का खुलासा किया गया, जो कि बाद के मॉडल अपडेट के साथ उत्तर की गुणवत्ता में गिरावट का संकेत देता है।

ओपन एआई के चैटजीपीटी के आसपास का उत्साह अब वापस आ गया है। यह अब एक दृष्टि सुविधा जीपीटी-4वी के साथ आता है, जिससे उपयोगकर्ताओं को जीपीटी-4 को उनके द्वारा दी गई छवियों का विश्लेषण करने की अनुमति मिलती है। यह नवीनतम सुविधा है जिसे उपयोगकर्ताओं के लिए खोला गया है।

जीपीटी-4 जैसे बड़े भाषा मॉडल (एलएलएम) में छवि विश्लेषण जोड़ना कुछ लोगों द्वारा एआई अनुसंधान और विकास में एक बड़ा कदम माना जाता है। इस प्रकार के बहुमोडल एलएलएम नए संभावनाओं को खोलता है, भाषा मॉडल को पाठ से परे ले जाता है और नए इंटरफेस प्रदान करता है और नए प्रकार के कार्यों का समाधान करता है, उपयोगकर्ताओं के लिए नए अनुभव पैदा करता है।

जीपीटी-4वी का प्रशिक्षण 2022 में पूरा हुआ, और मार्च 2023 में शुरुआती पहुंच शुरू की गई। जीपीटी-4वी में दृश्य सुविधा जीपीटी-4 प्रौद्योगिकी द्वारा संचालित है। प्रशिक्षण प्रक्रिया समान रही। शुरू में, मॉडल को एक पाठ में अगले शब्द की भविष्यवाणी करने के लिए प्रशिक्षित किया गया था, जिसमें विभिन्न स्रोतों से पाठ और छवियों के एक विशाल डेटासेट का उपयोग किया गया था।

बाद में, इसे मानव प्रतिक्रिया से प्रशिक्षण (आरएलएचएफ) नामक एक विधि का उपयोग करके अधिक डेटा के साथ परिष्कृत किया गया, ताकि ऐसे आउटपुट उत्पन्न किए जा सकें जिन्हें मानव पसंद करते हैं।

जीपीटी-4 दृष्टि यांत्रिकी

जीपीटी-4 की उल्लेखनीय दृष्टि भाषा क्षमताओं के बावजूद, इसके नीचे तरीके रहते हैं।

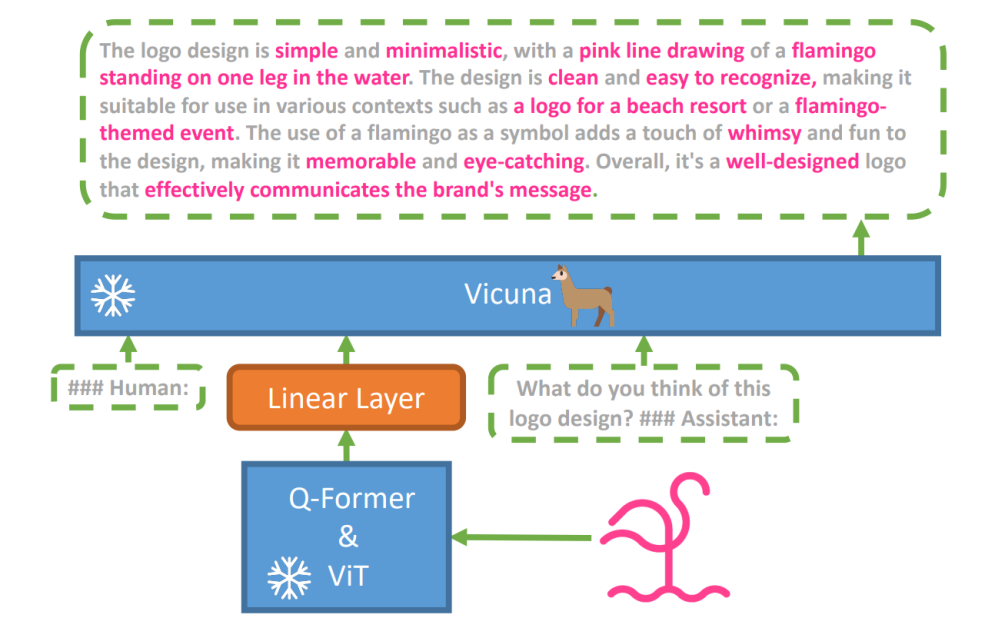

इस धारणा का अन्वेषण करने के लिए, एक नया दृष्टि-भाषा मॉडल, मिनीजीपीटी-4 पेश किया गया था, जो एक उन्नत एलएलएम नामक विकुना का उपयोग करता है। यह मॉडल दृश्य धारण के लिए पूर्व-प्रशिक्षित घटकों के साथ एक दृष्टि एनकोडर का उपयोग करता है, जो विकुना भाषा मॉडल के साथ एक एकल प्रोजेक्शन परत के माध्यम से एनकोडेड दृश्य विशेषताओं को संरेखित करता है। मिनीजीपीटी-4 की वास्तुकला सरल लेकिन प्रभावी है, जो दृश्य और भाषा विशेषताओं को संरेखित करने पर केंद्रित है ताकि दृश्य बातचीत क्षमताओं में सुधार हो सके।

जीपीटी-4 दृष्टि का अन्वेषण

छवि मूल का निर्धारण करने वाला चैटजीपीटी

जीपीटी-4 दृष्टि चैटजीपीटी की छवियों का विश्लेषण करने और उनके भौगोलिक मूल की पहचान करने की क्षमता को बढ़ाती है। यह सुविधा उपयोगकर्ता इंटरैक्शन को केवल पाठ से लेकर पाठ और दृश्यों के मिश्रण में बदल देती है, जो उन लोगों के लिए एक उपयोगी उपकरण बन जाती है जो छवि डेटा के माध्यम से विभिन्न स्थानों के बारे में जानने में रुचि रखते हैं।

जटिल गणितीय अवधारणाएं

जीपीटी-4 दृष्टि जटिल गणितीय विचारों में उत्कृष्टता प्राप्त करती है जो ग्राफिकल या हस्तलिखित अभिव्यक्तियों का विश्लेषण करके करती है। यह सुविधा उन व्यक्तियों के लिए एक उपयोगी उपकरण के रूप में कार्य करती है जो जटिल गणितीय समस्याओं का समाधान करना चाहते हैं, जीपीटी-4 दृष्टि को शैक्षिक और अकादमिक क्षेत्रों में एक उल्लेखनीय सहायता बनाती है।

हस्तलिखित इनपुट को लेटेक्स कोड में परिवर्तित करना

जीपीटी-4वी की एक उल्लेखनीय क्षमता इसकी हस्तलिखित इनपुट को लेटेक्स कोड में अनुवाद करने की क्षमता है। यह सुविधा शोधकर्ताओं, अकादमिकों और छात्रों के लिए एक वरदान है जिन्हें अक्सर हस्तलिखित गणितीय अभिव्यक्तियों या अन्य तकनीकी जानकारी को डिजिटल प्रारूप में परिवर्तित करने की आवश्यकता होती है। हस्तलिखित से लेटेक्स में परिवर्तन दस्तावेज़ डिजिटलीकरण के क्षितिज को विस्तारित करता है और तकनीकी लेखन प्रक्रिया को सरल बनाता है।

तालिका विवरण निकालना

जीपीटी-4वी तालिकाओं से विवरण निकालने और संबंधित प्रश्नों का उत्तर देने में कुशल प्रदर्शन करता है, जो डेटा विश्लेषण में एक महत्वपूर्ण संपत्ति है। उपयोगकर्ता जीपीटी-4वी का उपयोग तालिकाओं को छानने, प्रमुख अंतर्दृष्टि एकत्र करने और डेटा-संचालित प्रश्नों का समाधान करने के लिए कर सकते हैं, जिससे यह डेटा विश्लेषकों और अन्य पेशेवरों के लिए एक मजबूत उपकरण बन जाता है।

जबकि परिणाम मेरी.initial दृष्टि से मेल नहीं खाता, यहाँ मैंने जो हासिल किया है:

जीपीटी-4वी(िजन) की सीमाएं और खामियां

जीपीटी-4वी का विश्लेषण करने के लिए, ओपन एआई टीम ने गुणात्मक और मात्रात्मक मूल्यांकन किया। गुणात्मक मूल्यांकन में आंतरिक परीक्षण और बाहरी विशेषज्ञ समीक्षा शामिल थी, जबकि मात्रात्मक मूल्यांकन ने विभिन्न परिदृश्यों में मॉडल के इनकार और सटीकता को मापा, जैसे कि हानिकारक सामग्री, जनसांख्यिकीय मान्यता, गोपनीयता चिंताएं, भू-स्थान, साइबर सुरक्षा और बहुमोडल जेलब्रेक।

फिर भी, मॉडल परिपूर्ण नहीं है।

<paper

में जीपीटी-4वी की सीमाओं को उजागर किया गया है, जैसे कि छवियों में गलत अनुमान और गायब पाठ या अक्षर। यह कल्पना कर सकता है या तथ्य गढ़ सकता है। विशेष रूप से, यह छवियों में खतरनाक पदार्थों की पहचान करने के लिए उपयुक्त नहीं है, अक्सर उन्हें गलत पहचान देता है।

चिकित्सा इमेजिंग में, जीपीटी-4वी असंगत प्रतिक्रिया प्रदान कर सकता है और मानक अभ्यास के बारे में जागरूकता की कमी है, जिससे संभावित गलत निदान हो सकता है।

चिकित्सा उद्देश्यों के लिए विश्वसनीय प्रदर्शन (स्रोत)

यह निश्चित हेट सимвलों की बारीकियों को भी समझने में विफल रहता है और दृश्य इनपुट के आधार पर अनुचित सामग्री उत्पन्न कर सकता है। ओपनएआई जीपीटी-4वी का उपयोग महत्वपूर्ण व्याख्याओं के लिए, विशेष रूप से चिकित्सा या संवेदनशील संदर्भों में करने के खिलाफ सलाह देता है।

जीपीटी-4 दृष्टि के आगमन के साथ एक समूह की आकर्षक संभावनाएं और नए चुनौतियां सामने आती हैं। इसे रोल आउट करने से पहले, विशेष रूप से तस्वीरों में लोगों से संबंधित जोखिमों को अच्छी तरह से देखा जाना और कम किया जाना आवश्यक है। यह देखना प्रभावशाली है कि जीपीटी-4वी ने कैसे प्रगति की है, जो कठिन क्षेत्रों जैसे कि चिकित्सा और विज्ञान में बहुत सारा वादा दिखा रही है।

अब, कुछ बड़े प्रश्न तालिका में हैं। उदाहरण के लिए, क्या इन मॉडलों को प्रसिद्ध लोगों की तस्वीरों से पहचानना चाहिए? क्या उन्हें एक तस्वीर से किसी व्यक्ति के लिंग, जाति या भावनाओं का अनुमान लगाना चाहिए? और क्या दृष्टिहीन व्यक्तियों के लिए विशेष समायोजन होना चाहिए? ये प्रश्न गोपनीयता, न्याय और एआई को हमारे जीवन में कैसे फिट करना चाहिए, जिस पर हर किसी को बोलना चाहिए।