Tekoäly

RigNeRF: Uusi Deepfakes-Menetelmä, Joka Käyttää Neuraalista Valoaallon Kenttää

Uusi tutkimus, joka on kehitetty Adobessa, tarjoaa ensimmäisen toimivan ja tehokkaan deepfakes-menetelmän, joka perustuu Neuraaliseen Valoaallon Kenttään (NeRF) – ehkä ensimmäinen oikea innovaatio arkkitehtuurissa tai lähestymistavassa viiden vuoden aikana siitä, kun deepfakes ilmaantui vuonna 2017.

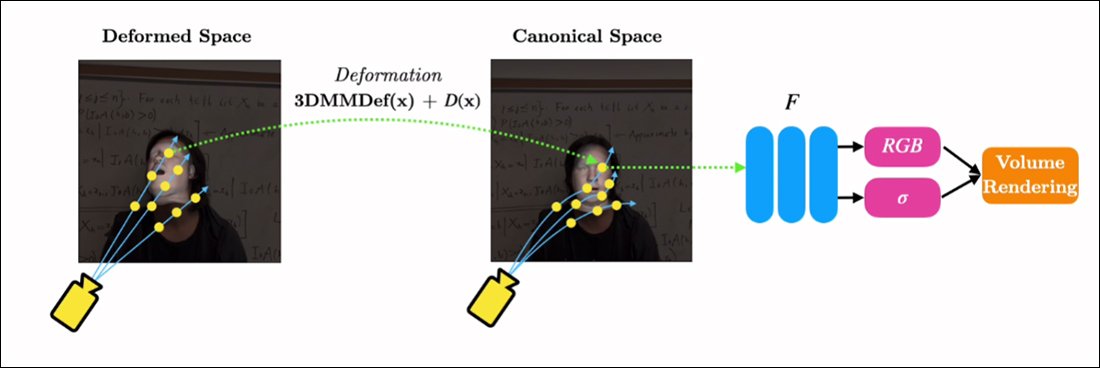

Menetelmä, joka on nimeltään RigNeRF, käyttää 3D-muokattavia kasvomalleja (3DMM) välikappaleena halutun syötteen (ts. identiteetin, joka halutaan asettaa NeRF-renderiin) ja neuroruumisen välillä, menetelmää, jota on laajasti omaksuttu viime vuosina Generative Adversarial Network (GAN) -kasvosynteesimenetelmissä, joista kukaan ei ole tuottanut toimivia ja hyödyllisiä kasvonsiirtorunkoja videolle.

<img class="wp-image-181995 size-full" src="https://www.unite.ai/wp-content/uploads/2022/06/RigNerf_example001.gif" alt="Lisämateriaalista uudesta tutkimuksesta näemme 3D-muokattavan kasvomallin (3DMM) toimivan välikappaleena 70 sekunnin todellisen videon ja neuroruumisen valoaallon visualisoinnin välillä, joka on otettu älypuhelimesta. Korkearesoluutioinen versio tästä klipistä, sekä monista muista, on projektisivulla tai tämän artikkelin lopussa olevissa upotetuissa videoissa. Lähde: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html” width=”800″ height=”346″ /> Eroon perinteisistä deepfake-videosta, ei mikään liikkuva sisältö ole ‘oikein’, vaan se on neuroruumis, joka on koulutettu lyhyestä videomateriaalista. Oikealla näemme 3D-muokattavan kasvomallin (3DMM) toimivan välikappaleena halutuissa muokkauksissa (‘hymy’, ‘katso vasemmalle’, ‘katso ylös’ jne.) ja neuroruumisen valoaallon visualisoinnin välillä. Korkearesoluutioinen versio tästä klipistä, sekä monista muista, on projektisivulla, tai tämän artikkelin lopussa olevissa upotetuissa videoissa. Lähde: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

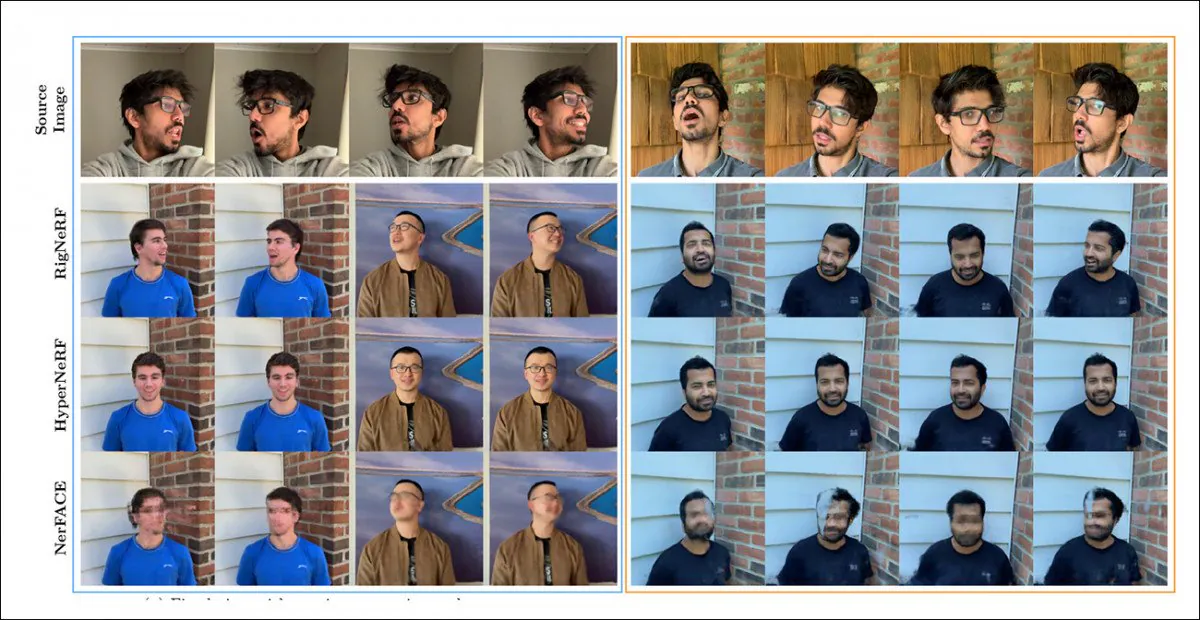

3DMM:t ovat käytännössä CGI-malleja kasvoista, joiden parametreja voidaan sovittaa abstrakteihin kuvansynteesijärjestelmiin, kuten NeRF ja GAN, jotka ovat muuten vaikeita hallita. Mitä näet yllä olevassa kuvassa (keskikuva, mies sinisessä paidassa), sekä kuvassa suoraan alla (vasen kuva, mies sinisessä paidassa), ei ole ‘oikeaa’ videota, johon on lisätty ‘väärennetty’ kasvo, vaan täysin syntetisoitu kohtaus, joka on olemassa ainoastaan volumetrinen neurorenderöinti – mukaan lukien keho ja tausta: Esimerkissä suoraan yllä, todellinen video oikealla (nainen punaisessa mekossa) käytetään ‘nukkeksi’ tallennetun identiteetin (mies sinisessä paidassa) vasemmalla puolella RigNeRF:in kautta, joka (tutkijat väittävät) on ensimmäinen NeRF-pohjainen järjestelmä, joka saavuttaa asennon ja ilmeen erottamisen ja pystyy suorittamaan uusia näkökulmia. Mieshahmo vasemmalla kuvassa ‘tallennettiin’ 70 sekunnin älypuhelinvideosta, ja syötemateriaali (mukaan lukien koko kohtauksen tieto) koulutettiin neljällä V100 GPU:lla saadakseen kohtauksen. Koska 3DMM-tyyliset parametrinen rungot ovat myös saatavilla koko kehon parametrinen CGI-välikappale (eikä vain kasvorunko), RigNeRF avaa mahdollisuuden täysin väärennettyjen kehojen luomiseen, jossa todellinen ihmisen liike, tekstura ja ilme siirretään CGI-pohjaiseen parametriseen kerrokseen, joka kääntäisi toiminnan ja ilmeen renderöidyiksi NeRF-ympäristöiksi ja videoiksi. RigNeRF:stä – kelpaako se deepfakes-menetelmäksi nykyisessä merkityksessä, jossa otsikot ymmärtävät termin? Vai onko se vain toinen puolittainen jäljelle jäänyt DeepFaceLabiin ja muihin vuoden 2017 autoencoder-pohjaisiin deepfakes-järjestelmiin? Tutkimuksen tutkijat ovat selkeät tässä suhteessa: ‘Ollen menetelmä, joka pystyy elävöittämään kasvoja, RigNeRF on altis väärinkäytölle pahantahtoisista toimijoista väärennettyjen deepfakesien luomiseen.’ Uusi tutkimus on nimeltään RigNeRF: Täysin ohjattavat neuronaaliset 3D-muotokuvat, ja se tulee ShahRukh Atharilta Stonybrookin yliopistosta, joka oli Adoben harjoittelija RigNeRF:n kehityksen aikana, ja neljältä muulta Adoben tutkijalta. Suurin osa viraleista deepfakeseista, jotka ovat saaneet otsikot viime vuosina, on tuotettu autoencoder-pohjaisilla järjestelmillä, jotka ovat peräisin koodista, joka julkaistiin vuonna 2017 kieltäytyneellä r/deepfakes-alustalla – ennen kuin se kopioitiin GitHubiin, jossa se on tällä hetkellä forkattu yli tuhat kertaa, ei vähiten suositun (vaikka kiistanalaisen) DeepFaceLab-jakeluun, ja myös FaceSwap-projektiin. Lisäksi GAN ja NeRF, autoencoder-kehykset ovat kokeilleet 3DMM:ien kanssa ‘ohjeita’ parantamaan kasvosynteesijärjestelmiä. Esimerkki tästä on HifiFace-projekti heinäkuulta 2021. Kuitenkaan mikään käyttökelpoinen tai suosittu aloite ei ole kehittynyt tästä lähestymistavasta tähän mennessä. RigNeRF-kohtauksien tiedot hankitaan tallentamalla lyhyitä älypuhelinvideoita. Tutkimuksessa RigNeRF:n tutkijat käyttivät iPhone XR:ää tai iPhone 12:ta kaikissa kokeissa. Ensimmäisen puoliskon aikana kohtaus pyydetään suorittamaan laaja valikoima kasvojen ilmeitä ja puhetta pitäen pää paikallaan, kun kamera liikkuu ympärillä. Toisen puoliskon aikana kamera pitää kiinni paikallaan, kun kohtaus pyydetään liikuttamaan päätään ympärillä osoittaen laajan valikoiman ilmeitä. Tuloksena olevat 40-70 sekunnin mittaiset (n. 1200-2100 kehys) edustavat koko aineistoa, jota käytetään mallin kouluttamiseen. Toisin kuin autoencoder-järjestelmät, kuten DeepFaceLab, vaativat suhteellisen työlään keräämisen ja kuratoinnin tuhansia erilaisia valokuvia, usein otettuina YouTube-videosta ja muista sosiaalisen median kanavista, sekä elokuvista (julkkisten deepfakesien tapauksessa). Tuloksena olevat koulutetut autoencoder-mallit ovat usein tarkoitettu käytettäviksi monissa tilanteissa. Kuitenkaan ahkerimmat ‘julkkisten’ deepfakes-käyttäjät voivat kouluttaa kokonaisia malleja alusta alkaen yhdelle videolle, vaikka koulutus voi kestää viikon tai enemmän. Vaikka varoitusmerkintä uuden tutkimuksen tutkijoilta, ‘patchwork’ ja laajasti kokoamien aineistojen, jotka voimavat AI-pornon ja suositun YouTube/TikTok ‘deepfake-uudelleenjärjestelyn’, näyttävät epätodennäköisiltä tuottavan hyväksyttyjä ja johdonmukaisia tuloksia deepfakes-järjestelmässä, kuten RigNeRF, jolla on kohtauskohtainen menetelmä. Tämä voi olla jonkin verran lisäsuojaa identiteetin väärinkäytölle pahantahtoisista deepfakes-käyttäjiltä. NeRF on fotogrammetria-pohjainen menetelmä, jossa pieni määrä lähdekuvia otetaan eri näkökulmista ja kootaan explorable 3D neuroruumiin. Tämä lähestymistapa tuli tunnetuksi tänä vuonna, kun NVIDIA esitteli Instant NeRF-järjestelmän, joka pystyy leikkaamaan NeRF:n koulutusajat minuutteihin tai jopa sekunteihin: Instant NeRF. Lähde: https://www.youtube.com/watch?v=DJ2hcC1orc4 Tuloksena oleva Neuroruumisen kohtaus on käytännössä staattinen ympäristö, jota voidaan tutkia, mutta jota on vaikea muokata. Tutkijat toteavat, että kaksi aiempaa NeRF-pohjaista aloitetta – HyperNeRF + E/P ja NerFACE – ovat yrittäneet kasvojen videonsynteesiä, ja (ilmeisesti täydellisyyden ja tarkkuuden vuoksi) asettanut RigNeRF:n näiden kahden kehyksen rinnalle testikierrokselle: Laadullinen vertailu RigNeRF:n, HyperNeRF:n ja NerFACE:n välillä. Katso linkitetyt lähdevideot ja PDF korkealaatuisemmista versioista. Staattinen kuva: https://arxiv.org/pdf/2012.03065.pdf Kuitenkaan tulokset, jotka suosivat RigNeRF:ia, ovat melko poikkeuksellisia, kahdesta syystä: ensinnäkin, tutkijat toteavat, että ‘ei ole olemassa olevaa työtä omena-omena-vertailuun’; toiseksi, tämä on edellyttänyt RigNeRF:n kykyjen rajoittamista osittain vastaamaan edellä mainittujen järjestelmien rajoitetumpaa toiminnallisuutta. Koska tulokset eivät ole portaaton parannus edellisiin töihin, vaan edustavat ‘lennonvaraista’ NeRF:n muokattavuudessa ja hyödyllisyydessä, jätämme testikierroksen sivuun ja tarkastelemme, mitä RigNeRF tekee toisin kuin edeltäjänsä. NerFACE:n pääasiallinen rajoitus, joka voi luoda asennon ja ilmeen NeRF-ympäristössä, on se, että se olettaa, että lähdevideota otetaan staattisella kameralla. Tämä tarkoittaa käytännössä, että se ei voi tuottaa uusia näkökulmia, jotka ylittävät sen tallennusrajat. Tämä tuottaa järjestelmän, joka voi luoda ‘liikkuvia muotokuvia’, mutta joka ei sovellu deepfake-tyyppiseen videoon. HyperNeRF, toisaalta, pystyy tuottamaan uusia ja hyperrealistisia näkökulmia, mutta sillä ei ole välikappaleita, jotka sallivat pään asennon tai kasvojen ilmeen muuttamisen, mikä ei johda mihinkään kilpailijaan autoencoder-pohjaisiin deepfakeseihin. RigNeRF pystyy yhdistämään nämä kaksi erillistä toiminnallisuutta luomalla ‘kanonisen avaruuden’, oletusarvon, josta poikkeamat ja muodonmuutokset voidaan suorittaa 3DMM-moduulin syötteen kautta. Kanonisen avaruuden luominen (ei asentoa, ei ilmettä), jolle 3DMM:llä tuotetut muodonmuutokset (ts. asennot ja ilmeet) voivat vaikuttaa. Koska 3DMM-järjestelmä ei vastaa täysin tallennettua kohtauksen, on tärkeää kompensoida tämä prosessissa. RigNeRF saavuttaa tämän deformaatiokentän etuoikeuden kautta, joka lasketaan monikerroksisen perceptronin (MLP) kautta lähdevideosta. Kameraparametrit, jotka tarvitaan deformaatioiden laskemiseen, hankitaan COLMAP:ista, kun taas ilmeen ja muodon parametreja kullekin kehykselle hankitaan DECA:sta. Sijoittelu optimoidaan edelleen maamerkin sovittamisen ja COLMAP:n kameraparametrien kautta, ja lopullinen videotuotos on alennettu 256×256 resoluutioon koulutusta varten (laitevaatimusten rajoittama prosessi, joka vaivaa myös autoencoder-pohjaisen deepfakes-kenttää). Tämän jälkeen deformaatioverkko koulutetaan neljällä V100:lla – vaikuttavalla laitteistolla, joka ei todennäköisesti ole saatavilla harrastelijoille (kuitenkaan koneoppimisen koulutuksessa on usein mahdollista vaihtaa voima ajan kanssa, ja hyväksyä, että mallin koulutus on useiden päivien tai jopa viikkojen asia).

Autoencoder-pohjaisten deepfakesien ulottuvuus

Datakeräilyn vähentäminen

NeRF:n sovittaminen deepfake-videolle

Yhdistetty voima