Inteligencia artificial

Detectores de Deepfake en busca de nuevo terreno: Modelos de difusión latente y GANs

Opinión

Recientemente, la comunidad de investigación de detección de deepfakes, que desde finales de 2017 se ha ocupado casi exclusivamente del marco basado en autoencoder que se estrenó en ese momento con tanto asombro público (y desmayo), ha comenzado a tomar un interés forense en arquitecturas menos estancadas, incluidos modelos de difusión latente como DALL-E 2 y Stable Diffusion, así como la salida de Redes Adversarias Generativas (GANs). Por ejemplo, en junio, la Universidad de California, Berkeley, publicó los resultados de su investigación sobre el desarrollo de un detector para la salida de DALL-E 2, que entonces era dominante.

Lo que parece estar impulsando este creciente interés es el salto evolutivo repentino en la capacidad y disponibilidad de modelos de difusión latente en 2022, con el lanzamiento de código cerrado y acceso limitado de DALL-E 2 en primavera, seguido a finales del verano por la apertura de Stable Diffusion por stability.ai.

Las GANs también han sido estudiadas durante mucho tiempo en este contexto, aunque con menos intensidad, ya que es muy difícil usarlas para recreaciones convincentes y elaboradas de personas en videos; al menos, en comparación con los paquetes de autoencoder venerables como FaceSwap y DeepFaceLab y el primo de este último para transmisión en vivo, DeepFaceLive.

Imágenes en movimiento

En cualquier caso, el factor galvanizador parece ser la perspectiva de un sprint de desarrollo posterior para la síntesis de video. El comienzo de octubre, y la temporada de conferencias principales de 2022, se caracterizó por una avalancha de soluciones repentinas e inesperadas a varios problemas de síntesis de video que llevaban tiempo sin resolverse: apenas Facebook lanzó muestras de su propia plataforma de texto a video, Google Research rápidamente ahogó ese reconocimiento inicial al anunciar su nueva arquitectura Imagen-to-Video T2V, capaz de producir footage de alta resolución (aunque solo a través de una red de 7 capas de escaladores).

Si cree que este tipo de cosas viene en tríos, considere también la promesa enigmática de stability.ai de que ‘el video está llegando’ a Stable Diffusion, aparentemente más tarde este año, mientras que el codesarrollador de Stable Diffusion, Runway, ha hecho una promesa similar, aunque no está claro si se refieren al mismo sistema. El mensaje de Discord del CEO de Stability, Emad Mostaque, también prometió ‘audio, video [y] 3d’.

Lo que parece estar ganando tracción es la idea de que los marcos ‘estáticos’ como las GANs y los difusores finalmente ocuparán su lugar como adjuntos de apoyo a los marcos de animación externos.

En resumen, parece probable que el mundo de los deepfakes de video basados en autoencoder, que solo pueden sustituir efectivamente la porción central de una cara, pueda ser eclipsado en este momento del próximo año por una nueva generación de tecnologías de deepfakes basadas en difusión, enfoques de código abierto y populares con el potencial de falsificar no solo cuerpos enteros, sino también escenas enteras.

Por esta razón, quizás, la comunidad de investigación anti-deepfake está comenzando a tomar la síntesis de imágenes en serio, y a darse cuenta de que podría servir a más fines que solo generar fotos de perfil de LinkedIn falsas; y que si todos sus espacios latentes intractables pueden lograr en términos de movimiento temporal es actuar como un renderizador de texturas realmente grande, eso podría ser más que suficiente.

Blade Runner

Los dos últimos artículos que abordan, respectivamente, la detección de deepfakes basada en modelos de difusión latente y GANs, son, respectivamente, DE-FAKE: Detección y atribución de imágenes falsas generadas por modelos de difusión de texto a imagen, una colaboración entre el Centro Helmholtz CISPA para la Seguridad de la Información y Salesforce; y BLADERUNNER: Contramedida rápida para caras sintéticas (generadas por IA) StyleGAN, de Adam Dorian Wong en el Laboratorio Lincoln de MIT.

Antes de explicar su nuevo método, el último artículo dedica algún tiempo a examinar los enfoques anteriores para determinar si una imagen fue generada por una GAN (el artículo se ocupa específicamente de la familia StyleGAN de NVIDIA).

El método ‘Brady Bunch’ identifica contenido falso de GAN basado en las posiciones fijas que ciertas partes de una cara de GAN ocupan con certeza, debido a la naturaleza rutinaria y templatizada del ‘proceso de producción’.

El método ‘Brady Bunch’ propuesto por una transmisión web de la institución SANS en 2022: un generador de caras de GAN realizará un colocación de características faciales impropiamente uniforme, delatando el origen de la foto, en ciertos casos. Fuente: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Otra indicación útil conocida es la frecuente incapacidad de StyleGAN para representar múltiples caras (primera imagen a continuación), si es necesario, así como su falta de talento en la coordinación de accesorios (imagen del medio a continuación), y una tendencia a usar una línea de cabello como el comienzo de un sombrero improvisado (tercera imagen a continuación).

El tercer método al que el investigador llama la atención es superposición de fotos (un ejemplo del cual se puede ver en nuestro artículo de agosto sobre la evaluación de la expresión facial de AI para el diagnóstico de trastornos de salud mental), que utiliza software de ‘mezcla de imágenes’ compositivo como la serie CombineZ para concatenar múltiples imágenes en una sola imagen, a menudo revelando subyacentes similitudes en la estructura, una posible indicación de síntesis.

La arquitectura propuesta en el nuevo artículo se titula (posiblemente en contra de todos los consejos de SEO) Blade Runner, en referencia a la prueba de Voight-Kampff que determina si los antagonistas en la franquicia de ciencia ficción son ‘falsos’ o no.

La tubería consta de dos fases, la primera de las cuales es el analizador PapersPlease, que puede evaluar datos extraídos de sitios web de caras de GAN conocidos como thispersondoesnotexist.com o generated.photos.

Aunque una versión reducida del código se puede inspeccionar en GitHub (ver a continuación), se proporcionan pocos detalles sobre este módulo, excepto que se utilizan OpenCV y DLIB para delinear y detectar caras en el material recopilado.

El segundo módulo es el detector AmongUs. El sistema está diseñado para buscar la colocación coordinada de los ojos en las fotos, una característica persistente de la salida de caras de StyleGAN, tipificada en el escenario ‘Brady Bunch’ detallado anteriormente. AmongUs está impulsado por un detector de puntos de referencia faciales estándar de 68 puntos.

Anotaciones de puntos faciales a través del Grupo de Comprensión de Comportamiento Inteligente (IBUG), cuyo código de trazado de puntos de referencia faciales se utiliza en el paquete Blade Runner.

AmongUs depende de puntos de referencia preentrenados basados en las coordenadas ‘Brady Bunch’ conocidas de PapersPlease, y está destinado a ser utilizado contra muestras en vivo y orientadas a la web de imágenes de caras basadas en StyleGAN.

Blade Runner, sugiere el autor, es una solución plug-and-play destinada a empresas u organizaciones que carecen de recursos para desarrollar soluciones internas para el tipo de detección de deepfakes que se ocupa aquí, y una ‘medida de stop-gap para ganar tiempo para contramedidas más permanentes’.

En realidad, en un sector de seguridad tan volátil y en rápido crecimiento, no hay muchas soluciones personalizadas o de proveedores de nube listas para usar a las que una empresa con pocos recursos pueda recurrir con confianza.

Aunque Blade Runner se desempeña mal contra personas con gafas falsas de StyleGAN, este es un problema relativamente común en sistemas similares, que esperan poder evaluar delineaciones de ojos como puntos de referencia principales, oscurecidas en tales casos.

Una versión reducida de Blade Runner ha sido lanzada a código abierto en GitHub. Existe una versión más rica en características de propiedad privada, que puede procesar múltiples fotos, en lugar de una sola foto por operación del repositorio de código abierto. El autor tiene la intención, dice, de actualizar la versión de GitHub al mismo nivel eventualmente, según lo permita el tiempo. También admite que StyleGAN probablemente evolucionará más allá de sus debilidades conocidas o actuales, y el software también necesitará desarrollarse en consonancia.

DE-FAKE

La arquitectura DE-FAKE tiene como objetivo no solo lograr la ‘detección universal’ para imágenes producidas por modelos de difusión de texto a imagen, sino también proporcionar un método para discernir cuál modelo de difusión latente (LD) produjo la imagen.

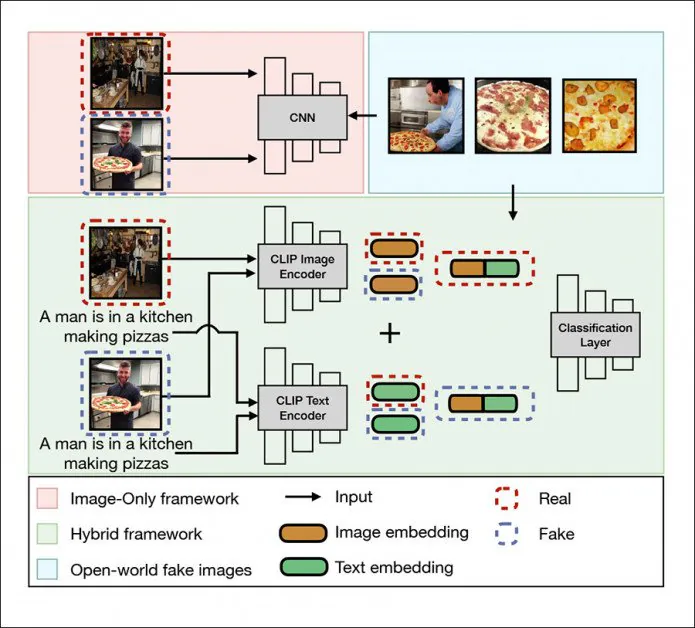

El marco de detección universal en DE-FAKE aborda imágenes locales, un marco híbrido (verde) e imágenes del mundo abierto (azul). Fuente: http://export.arxiv.org/pdf/2210.06998

Para ser honesto, en este momento, esta es una tarea bastante sencilla, ya que la mayoría de los modelos LD populares, ya sean de código cerrado o abierto, tienen características distinguibles notables.

Además, la mayoría comparten algunas debilidades comunes, como una predisposición a cortar cabezas, debido a la forma arbitraria en que las imágenes no cuadradas extraídas de la web se ingieren en los enormes conjuntos de datos que alimentan sistemas como DALL-E 2, Stable Diffusion y MidJourney:

Los modelos de difusión latente, al igual que todos los modelos de visión por computadora, requieren entrada en formato cuadrado; pero la extracción agregada de la web que alimenta el conjunto de datos LAION5B no ofrece ‘lujo’ como la capacidad de reconocer y centrarse en caras (o cualquier otra cosa), y trunca las imágenes de manera bastante brutal en lugar de rellenarlas (lo que conservaría la imagen de origen completa, pero a una resolución más baja). Una vez entrenado, estos ‘recortes’ se normalizan y se producen con mucha frecuencia en la salida de sistemas de difusión latente como Stable Diffusion. Fuentes: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac y Stable Diffusion.

DE-FAKE tiene como objetivo ser algoritmo-agnóstico, un objetivo largamente anhelado por los investigadores de anti-deepfakes de autoencoder, y, en este momento, bastante alcanzable en cuanto a los sistemas LD.

La arquitectura utiliza la biblioteca multimodal de preentrenamiento de lenguaje e imagen de OpenAI (CLIP) como una forma de extraer incrustaciones de imágenes LD ‘falsificadas’ y entrenar un clasificador en los patrones y clases observados.

En un escenario más ‘caja negra’, donde los fragmentos PNG que contienen información sobre el proceso de generación han sido eliminados por procesos de carga y por otras razones, los investigadores utilizan el marco BLIP de Salesforce (también un componente en al menos una distribución de Stable Diffusion) para ‘sondear ciegamente’ las imágenes en busca de la estructura semántica probable de las solicitudes que las crearon.

Los investigadores utilizaron Stable Diffusion, Latent Diffusion (él mismo un producto discreto), GLIDE y DALL-E 2 para poblar un conjunto de datos de entrenamiento y prueba utilizando MSCOCO y Flickr30k.

Normalmente, tomaríamos una mirada bastante extensa a los resultados de los experimentos de los investigadores para un nuevo marco; pero en realidad, los hallazgos de DE-FAKE parecen ser más útiles como una referencia futura para iteraciones posteriores y proyectos similares, en lugar de como una métrica significativa del éxito del proyecto, considerando el entorno volátil en el que opera, y que el sistema con el que compite en los ensayos del artículo es casi tres años mayor, desde que la escena de síntesis de imágenes era verdaderamente incipiente.

Imágenes más a la izquierda: el marco anterior, originado en 2019, se desempeña predeciblemente peor que DE-FAKE (imágenes más a la derecha) en los cuatro sistemas LD probados.

Los resultados del equipo son abrumadoramente positivos por dos razones: no hay trabajo previo con el que compararlo (y ninguno que ofrezca una comparación justa, es decir, que cubra los meros doce semanas desde que Stable Diffusion se lanzó como código abierto).

En segundo lugar, como se mencionó anteriormente, aunque el campo de síntesis de imágenes LD se está desarrollando a una velocidad exponencial, el contenido de salida de las ofertas actuales se ‘marca’ efectivamente por sus propias limitaciones estructurales (y muy predecibles) y excentricidades, muchas de las cuales probablemente se remediarán, en el caso de Stable Diffusion al menos, con el lanzamiento del checkpoint de 1.5 (es decir, el modelo de 4 GB que impulsa el sistema).

Al mismo tiempo, Stability ya ha indicado que tiene una hoja de ruta clara para la versión 2 y la versión 3 del sistema. Dado el acontecimiento de los últimos tres meses, cualquier letargo corporativo por parte de OpenAI y otros jugadores en el espacio de síntesis de imágenes probablemente se haya evaporado, lo que significa que podemos esperar un ritmo de progreso igualmente rápido también en el espacio de síntesis de imágenes de código cerrado.

Publicado por primera vez el 14 de octubre de 2022.