El ángulo de Anderson

Ojos que no ven, corazón que no siente: Abordando el mayor problema del vídeo con IA

El mayor problema incluso de los mejores generadores de vídeo con IA es que sufren de amnesia crónica, un reto que una nueva investigación procedente de China está abordando actualmente.

El mayor problema incluso con los mejores y más avanzados sistemas de generación de vídeo por IA es que todos tienen amnesia crónicaSi la cámara se aleja del objeto en el que está enfocada y luego vuelve a enfocarlo, nunca encontrará lo que estaba allí al principio: los personajes habrán desaparecido, cambiado de apariencia o de tipo de movimiento, y es probable que el fondo también haya cambiado.

Esto se debe a que el sistema de generación basado en difusión tiene una rodadura limitada. ventana de atencióny porque siempre está lidiando con lo que puede ver en ese momento; en una verdadera puesta en escena de solipsismo, que es outside El marco es inexistente para la IA generativa; literalmente se descarta de la memoria.

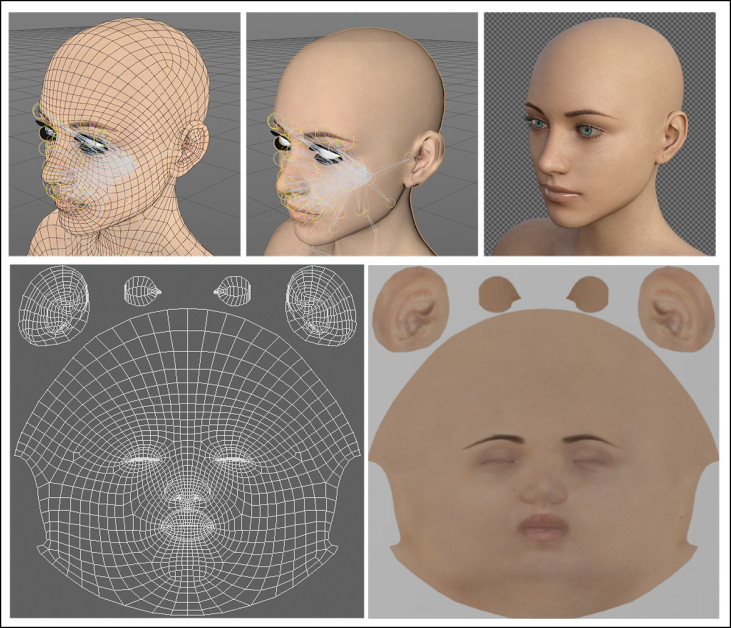

Esto tiene Nunca ha sido un problema en la CGI tradicional., que siempre pueden referirse a un sujeto y recrearlo con precisión, incluyendo su apariencia y movimiento, en cualquier punto de un vídeo renderizado donde puedan ser necesarios de nuevo:

Las mallas CGI tradicionales y las texturas de mapa de bits siempre se pueden volver a dibujar en un renderizado, lo que proporciona una apariencia consistente; un truco mucho más difícil de lograr en los enfoques de IA, porque no existe un archivo de "referencia plana" equivalente, o una colección de archivos relacionados.

Esto se debe a que los elementos que componen los gráficos generados por computadora (CGI), como la malla y las texturas (ver la imagen superior), así como los archivos de movimiento y otros comportamientos dinámicos, pueden almacenarse de forma independiente en el disco y ser incorporados a una composición en cualquier momento.

No existe tal "repositorio plano" en la IA de vídeo generativo; lo más cerca que puede estar de esta funcionalidad es LoRA – Archivos auxiliares especialmente entrenados que pueden entrenarse en equipos de consumo, lo que permite crear personajes novedosos y prendas de vestir específicas. ser 'obligado' a aparecer en el video:

Dele "click" para jugar. El problema del solipsismo en los vídeos con IA se puede mitigar hasta cierto punto mediante el uso de LoRA, pero los resultados pueden ser abrumadores.

Sin embargo, esta no es una solución ideal. Para empezar, LoRA está vinculado a una versión específica exacta de un modelo base (como Wan2+ o Vídeo de Hunyuan), o necesitan ser recreados cada vez que cambia el modelo base. Por otro lado, LoRAs tienden a distorsionar los pesos del modelo de la fundación, de modo que la identidad entrenada de LoRA se impone a todos los personajes en una escena. Además, sintonia FINA métodos de este tipo son muy sensible a conjuntos de datos mal seleccionados.

Bises precisos

Ahora, una nueva colaboración académica/industrial de China está ofreciendo el primer remedio significativo que ha llegado a mi conocimiento en más de tres años informando sobre este tema. El método utiliza lo que los investigadores denominan memoria híbrida para mantener el personaje fuera de pantalla y su entorno directo activos y precisos en el espacio latente del modelo, de modo que cuando nuestro punto de vista vuelve a ellos, el efecto es consistente:

Dele "click" para jugar. En la página del proyecto del nuevo artículo se muestran dos ejemplos de caracteres generados por IA (WAN) que salen del fotograma y vuelven a entrar correctamente. Fuente

Cabe destacar que esto no es lo mismo que lograr consistencia del carácter en diferentes tomas, algo que se afirmó haber logrado. hace un año en el lanzamiento de la Generación 4 de Runway, y que permanece an en marcha búsqueda en la literatura de investigación.

Más bien, lo que se resuelve aquí es algo que ningún marco comercial o experimental que haya visto ha podido lograr: reaparición visualmente consistente del aspecto, los movimientos y el entorno anteriores de un personaje que no aparece en pantalla:

Dele "click" para jugar. Los otros dos ejemplos principales se dan en el sitio web del proyecto de la nueva iniciativa.

Obviamente, los principios que se aplican aquí pueden ser igualmente aplicables a otros ámbitos, como la exploración urbana, la conducción desde la perspectiva del conductor u otros tipos de representaciones que no sean de personajes.

También cabe destacar que este nuevo enfoque no resuelve ni aborda el problema que Runway Gen4 y otras plataformas de código cerrado afirman haber solucionado, mediante la recreación de personajes. a través de diferentes tomas; en cambio, hace lo que ninguno de ellos ha logrado hasta ahora: mantener un personaje y un entorno en la memoria, sin necesidad de que permanezcan visibles para el espectador en todo momento..

El nuevo trabajo comprende un conjunto de datos dedicado generado a través de Motor irreal, así como métricas personalizadas para el problema del solipsismo*, y un marco generativo a medida construido sobre WAN. En pruebas realizadas contra los pocos sistemas análogos disponibles, los autores afirman obtener resultados de vanguardia y comentan:

Los mecanismos de memoria se han convertido en una frontera fundamental para el avance de los modelos del mundo, ya que la capacidad de memoria determina la coherencia espacial y temporal del contenido generado.

En concreto, se trata del ancla cognitiva que permite al modelo conservar el contexto histórico durante los cambios de perspectiva o las extrapolaciones a largo plazo.

«Sin una memoria sólida, un mundo simulado se desmorona rápidamente en imágenes inconexas y caóticas».

El sitio nuevo documento se titula Fuera de la vista, pero no fuera de la mente: Memoria híbrida para modelos dinámicos del mundo del vídeoy proviene de siete investigadores de la Universidad de Ciencia y Tecnología de Huazhong y del equipo Kling de Kuaishou Technology.

Método

El pilar central de la nueva obra es memoria híbrida, lo que facilita la "extrapolación fuera de la vista": la retención de los personajes y sus contextos mientras el espectador "mira hacia otro lado" (o mientras el propio personaje sale de la vista). En este escenario, se requiere que el marco realice desacoplamiento espacio-temporal, en la que se centra simultáneamente en la generación visible para el espectador y en la existencia fuera de pantalla del personaje que ahora está fuera de la vista.

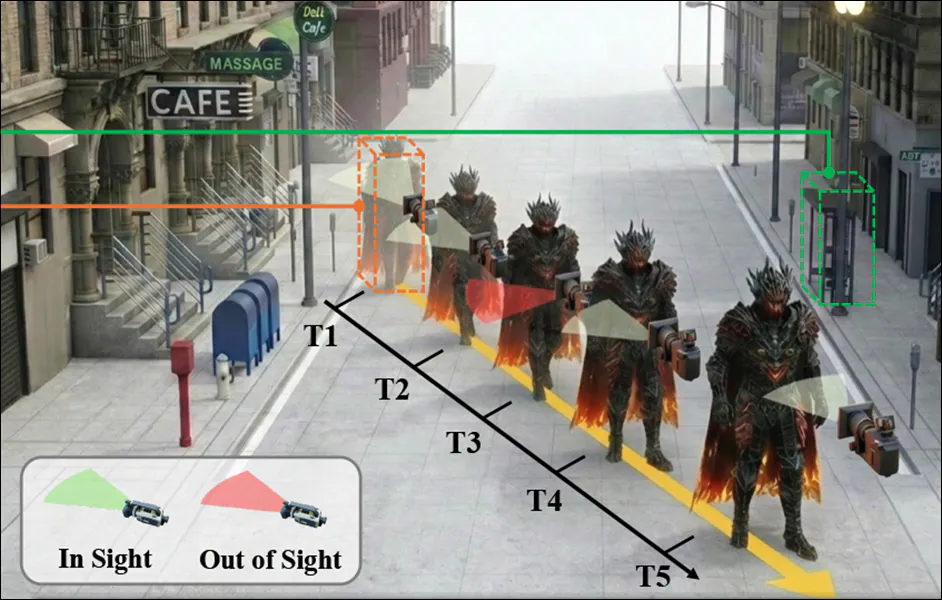

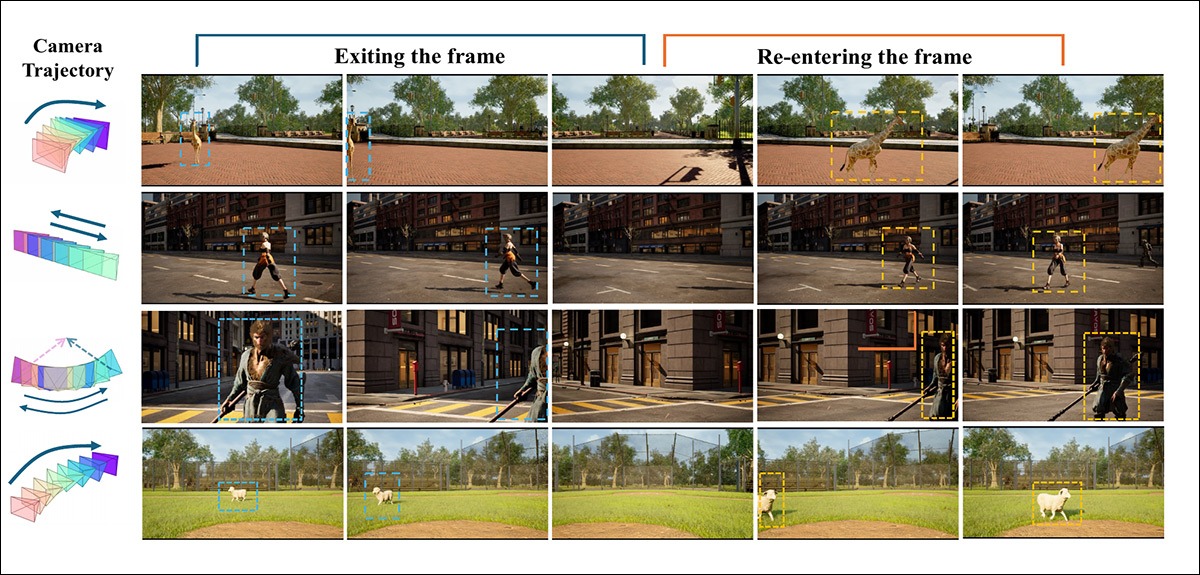

Ejemplos de movimiento de cámara de entrada/salida. En estos casos, es el movimiento de la cámara el que provoca que el personaje salga del encuadre, pero en diversas muestras también podemos observar que el propio personaje se desplaza temporalmente fuera de la pantalla. Fuente

Los autores señalan que en la difusión latente incrustaciones, las características que deben extraerse y utilizarse son muy enredado con otras características y propiedades; y que intentar extraerlas a menudo provoca que el sujeto se "congele" en el fondo. Por lo tanto, idearon y seleccionaron el HM-World conjunto de datos**, específicamente diseñado para entrenar la memoria híbrida:

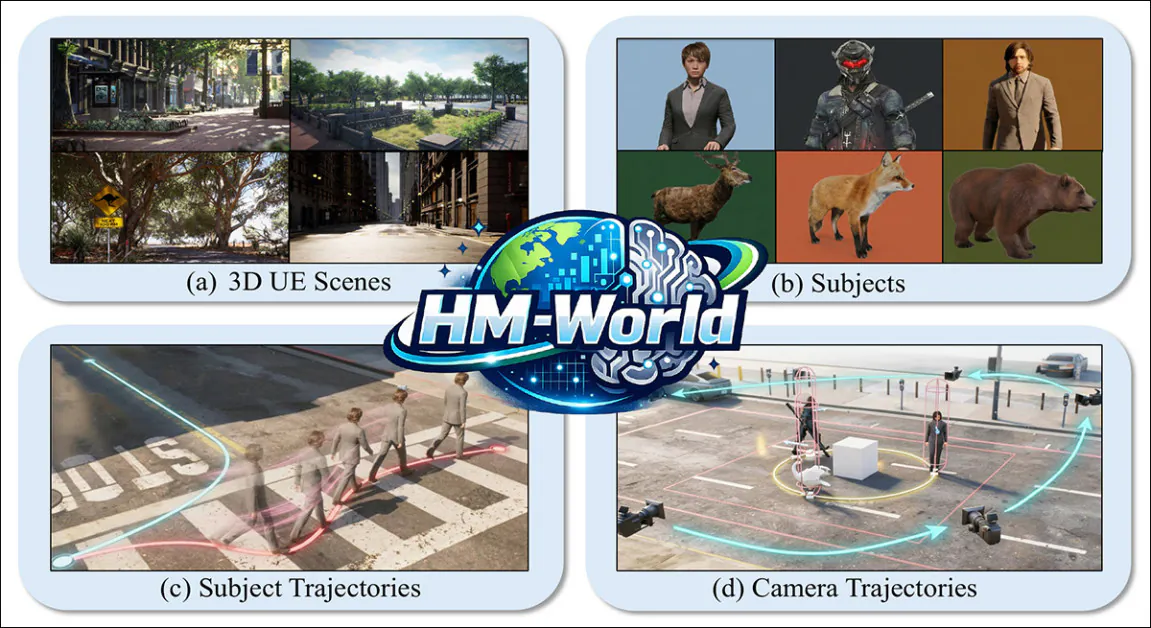

Del artículo se extraen muestras de las cuatro categorías contenidas en el conjunto de datos HM-World.

La colección se construye a lo largo de cuatro dimensiones: trayectorias de los sujetos, trayectorias de la cámara, Escenas y temas.

El sitio datos sintéticos HM-World incluye 17 escenas y 49 sujetos, entre ellos personas de apariencia diversa y animales de múltiples especies. Estas combinaciones se colocan proceduralmente en una escena mediante Unreal Engine, cada una con una animación de movimiento distinta, y luego se les asigna una trayectoria seleccionada aleatoriamente.

Los autores afirman que un conjunto variado de entrada-salida En el conjunto de datos se representan los eventos, incluyendo 28 trayectorias de cámara diferentes, cada una con múltiples puntos de partida.

La colección final consta de 59,225 videoclips, cada uno anotado por el MiniCPM-V Modelo de lenguaje multimodal a gran escala (MLLM).

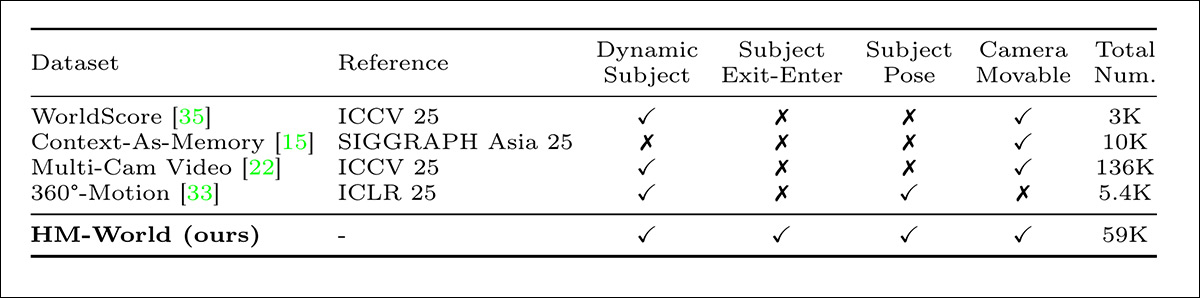

Los investigadores destacan las ventajas estadísticas de su colección frente a conjuntos de datos anteriores. Puntuación mundial; Contexto como memoria; Vídeo multicámara; y Movimiento de 360°:

Comparación entre los conjuntos de datos existentes y el conjunto de datos HM-World, donde "Sujeto dinámico" indica la presencia de entidades en movimiento, "Salida y entrada del sujeto" denota clips que contienen sujetos que salen y vuelven a entrar en el fotograma, y "Pose del sujeto" se refiere a la inclusión de poses 3D anotadas.

El camino menos transitado

A partir de varios fotogramas anteriores y una trayectoria de cámara conocida, la tarea consiste en predecir las vistas futuras a medida que cambia la perspectiva del espectador, teniendo en cuenta los sujetos que se mueven de forma independiente y que pueden salir del encuadre antes de regresar. Esto requiere más que mantener un fondo estable, ya que el modelo también debe conservar un registro interno coherente de cómo se ve y se comporta cada sujeto en movimiento, incluso durante los periodos en que no es visible.

Los autores Atención de recuperación dinámica híbrida El método (HyDRA) aborda este problema introduciendo una vía de memoria dedicada que separa los sujetos dinámicos de la representación estática de la escena, lo que les permite persistir en el tiempo y reaparecer con una apariencia y un movimiento consistentes:

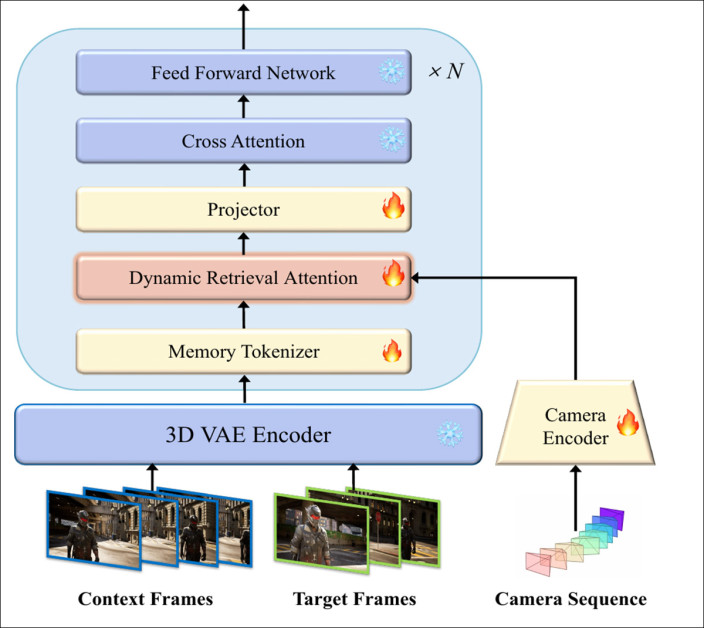

Esquema conceptual del modelo HyDRA.

HyDRA está construido sobre Wan2.1-T2V-1.3B, con la tubería de difusión central prácticamente intacta, al tiempo que se introduce una modificada transformador Bloque que incorpora atención de recuperación dinámica. Esto permite que el modelo recuerde selectivamente señales de movimiento y apariencia de fotogramas anteriores, en lugar de depender de un contexto fijo o local.

Este proceso utiliza un adaptado Coincidencia de flujo objetivo de capacitación en lugar del estándar pérdida por difusión.

Para mantener las escenas alineadas con el movimiento de la cámara, las trayectorias de la cámara se inyectan como una señal de condicionamiento explícita, con la pose de cada fotograma definida por rotación y traslación, y luego se convierten en una representación compacta que captura cómo evoluciona el punto de vista a lo largo del tiempo.

En consonancia con lo anterior (Kling) ReCamMaster iniciativa, el resultado luego es analizado por el codificador de la cámara, implementado como un Perceptrón multicapa, luego transmitido y añadido a la Transformador de difusión características que permiten al modelo mantener una colocación consistente de los objetos a medida que la cámara se mueve.

Tokenization

Las imágenes latentes de difusión sin procesar mezclan el movimiento del sujeto, su apariencia y el fondo en una única representación entrelazada, y tratar de recuperarlas directamente de este espacio conlleva el riesgo de introducir contexto irrelevante o de provocar que los sujetos en movimiento se "confundan" con el escenario.

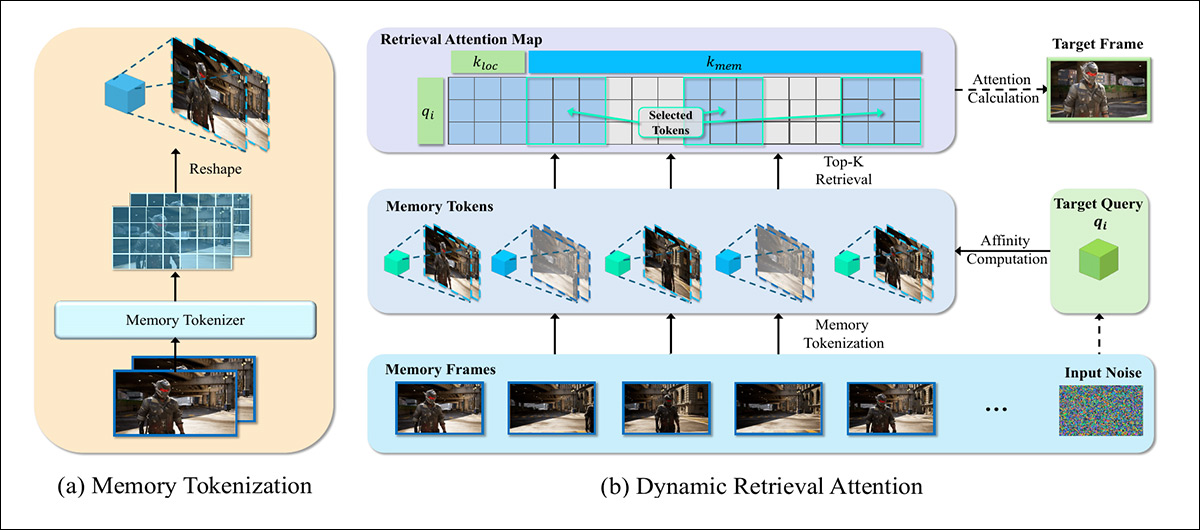

HyDRA aborda esto con un tokenizador de memoria basado en convolución 3D que procesa el espacio y el tiempo conjuntamente; en lugar de transmitir historiales latentes completos, los comprime en tokens de memoria compactos y sensibles al movimiento que preservan la apariencia y los movimientos de los sujetos:

Descripción general de HyDRA. A la izquierda, el Tokenizador de Memoria convierte fotogramas anteriores en tokens de memoria compactos que tienen en cuenta el movimiento; a la derecha, la Atención de Recuperación Dinámica evalúa la consulta actual en función de estos tokens, recupera los más relevantes y los utiliza para restaurar la apariencia y el movimiento consistentes en el fotograma generado.

Estos tokens forman una memoria híbrida estructurada que filtra el ruido a la vez que conserva la dinámica a largo plazo. Al pasarlos al módulo de Atención de Recuperación Dinámica, permiten que el modelo recuerde selectivamente sujetos que no aparecen en pantalla, de modo que reaparezcan con una apariencia, movimiento y contexto consistentes.

Atención de recuperación dinámica

El mecanismo de memoria dual de HyDRA también utiliza atención de recuperación dinámica desempeñando un papel distinto pero complementario dentro del marco.

La tokenización de memoria comprime las representaciones latentes pasadas en tokens estructurados y sensibles al movimiento que separan los sujetos dinámicos del contenido estático de la escena, reduciendo la confusión que a menudo provoca que los sujetos se mimeticen con el fondo. Estos tokens forman un banco de memoria persistente en lugar de un historial completo de fotogramas.

El mecanismo de atención de recuperación dinámica opera sobre este banco durante la generación, evaluando la consulta actual en función de los tokens almacenados y recuperando selectivamente aquellos más relevantes para el fotograma en evolución. Esto permite que los sujetos fuera de pantalla continúen su evolución latente (es decir, que sigan caminando o corriendo cuando no se les ve) y que reaparezcan con una apariencia y movimiento consistentes cuando vuelven a ser visibles, en lugar de reiniciarse o degradarse.

Datos y Pruebas

En las pruebas, el sistema HyDRA basado en Wan codificó y redujo el muestreo de 77 fotogramas de contexto antes de analizarlos con un autoencoder variacional 3D (VAE), mientras que el tokenizador de memoria mencionado anteriormente utilizaba Convolución 3D en un tamaño del núcleo de 2x4x4.

El modelo fue entrenado en HW-World durante 10,000 iteraciones en 32 GPU (no especificadas), a una tamaño del lote de 32.

En las pruebas se utilizó un número inusualmente alto de métricas: además de la habitual relación señal-ruido máxima (PSNR), Índice de similitud estructural (SSIM), y Métricas de similitud perceptual aprendidas (LPIPS), los autores también emplearon consistencia del sujeto y el consistencia de fondo de la Banco virtual suite, para evaluar la coherencia a nivel de trama.

Además, idearon una métrica personalizada titulada Coherencia dinámica del sujeto (DSC), que utiliza cuadros delimitadores de YOLO V11, para crear regiones recortadas que muestran sujetos en movimiento, de las cuales se extrajeron características semánticas y luego se calcularon sus similitudes.

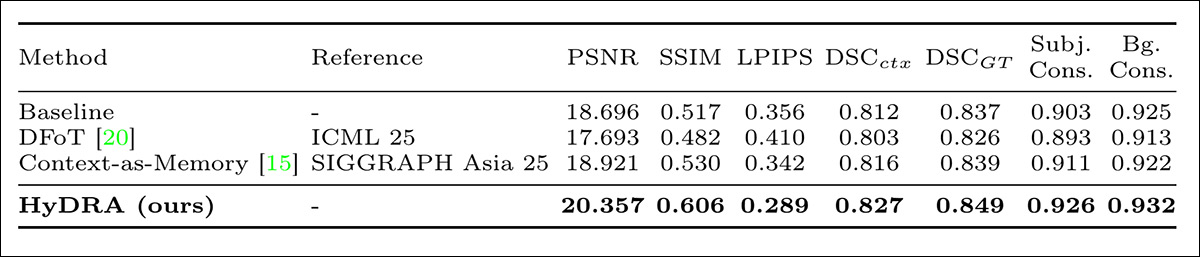

HyDRA se lanzó contra Transformador de forzamiento por difusión (DFoT) y Contexto como memoria, sobre un modelo base Wan2.1-T2V-1.3B equipado con un codificador de cámara (para representar el punto de vista subjetivo común a todos los clips). Todos los modelos fueron entrenados en HW-World, y Juego mundial También se utilizó como una colección de prueba secundaria de cero disparos:

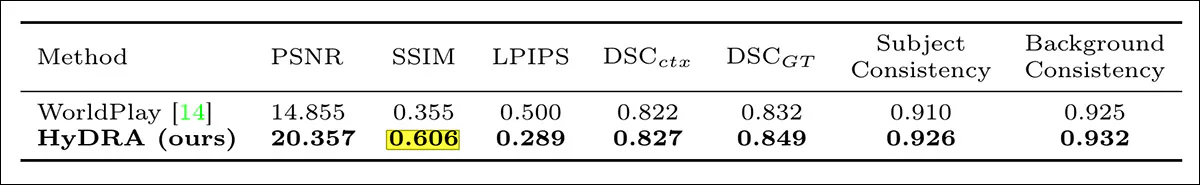

En las comparaciones cuantitativas iniciales, HyDRA superó a todos los métodos de referencia, elevando el PSNR de 18.696 a 20.357 y el SSIM de 0.517 a 0.606. También alcanzó las puntuaciones Dice contextuales y de referencia más altas, 0.827 y 0.849, con una consistencia de sujeto y fondo de 0.926 y 0.932.

Resultados de la comparación cuantitativa inicial con enfoques previos.

DFoT alcanzó 17.693 PSNR y Context as Memory 18.921, atribuyéndose las ganancias a la tokenización de la memoria combinada con la atención de recuperación dinámica:

Comparación cuantitativa que sitúa a HyDRA frente a la tecnología más avanzada actual.

En cuanto a las pruebas realizadas contra WorldPlay, los autores afirman:

Nuestro método supera a WorldPlay en todas las métricas, con una notable diferencia de PSNR de 5.502. Aunque WorldPlay muestra un rendimiento inferior en las métricas referenciadas a GT (por ejemplo, PSNR de 14.855, DSCGT de 0.832) debido a la brecha en la distribución del dominio y la falta de un ajuste fino específico, demuestra una notable robustez en las métricas referenciadas al contexto al lograr un DSCctx de 0.822.

Esta observación no solo confirma que los modelos entrenados exhaustivamente poseen una consistencia híbrida aceptable, sino que también valida indirectamente la racionalidad de nuestras métricas DSC propuestas para reflejar la consistencia dinámica de los sujetos.

«En definitiva, estos impresionantes resultados ponen de relieve las excepcionales capacidades de nuestro modelo, demostrando su superioridad incluso sobre los modelos comerciales ya consolidados».

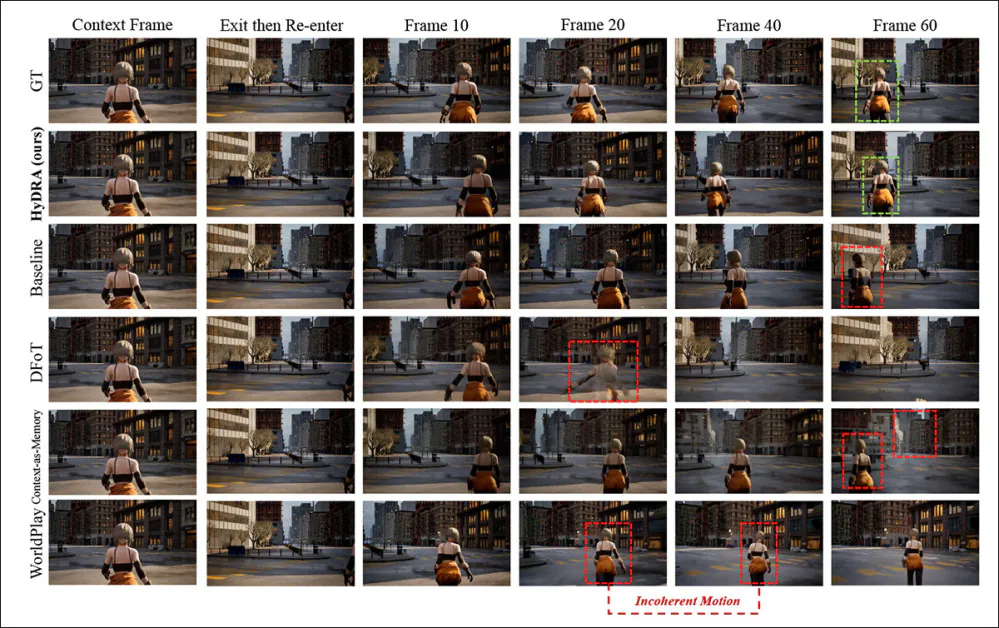

El artículo ofrece una representación estática de las comparaciones cualitativas realizadas para las pruebas:

Comparación cualitativa de la salida y reentrada bajo movimiento de cámara. Los autores afirman que HyDRA preserva la identidad, la postura y la continuidad del movimiento del sujeto tras salir y volver al encuadre, coincidiendo estrechamente con la realidad, mientras que los métodos de la competencia muestran deriva, movimiento incoherente o degradación del sujeto, resaltados en rojo (las recuperaciones consistentes están marcadas en verde).

De estos resultados los autores comentan:

En el caso de eventos complejos de entrada y salida, la línea base y Contexto como Memoria presentan una grave distorsión del sujeto e incoherencia en el movimiento. DFoT no logra mantener la integridad del sujeto, lo que provoca su desaparición total. Si bien WorldPlay consigue preservar la coherencia de la apariencia del sujeto, sufre de movimientos entrecortados y acciones poco naturales.

«Por el contrario, nuestro método mantiene con éxito la consistencia híbrida, preservando tanto la identidad del sujeto como la coherencia del movimiento después de que este vuelva a entrar en el encuadre».

Se pueden ver más resultados en formato de vídeo en el sitio complementario, de los cuales los primeros cuatro ejemplos han sido recopilados (por nosotros) en el siguiente vídeo:

Dele "click" para jugar. Cuatro de los seis resultados de las pruebas se mostraron en el lugar del proyecto. Fuente

Conclusión

Si bien cualquier intento de abordar uno de los mayores problemas de la generación de vídeo mediante IA es bienvenido, me parece inevitable que la solución óptima para los problemas de entrada/salida de este tipo resulte ser, como sucedió con los CGI, en forma de materiales de referencia distintos que puedan editarse de forma independiente e incorporarse al espacio de composición.

Este asunto de tratar de mantener viva una incrustación en un ad hoc El enfoque improvisado resulta agotador y, además, no ofrece una solución clara para lograr la coherencia entre tomas que ofrecen actualmente diversos portales de edición de vídeo como Runway. Si una toma posterior requiere acceso al espacio latente de la toma anterior, ¿por qué no utilizar en ambos casos una representación de personaje independiente?

* Nadie más le ha dado un nombre, y la conversación resulta difícil sin términos comunes.

** Actualmente se indica que estará disponible "próximamente" en la página del proyecto.

Publicado por primera vez el viernes 27 de marzo de 2026