Ángulo de Anderson

La IA está dividiendo la búsqueda web en tres realidades diferentes

Una nueva investigación encuentra que Google ahora utiliza tres sistemas de información diferentes dentro de su propio imperio de búsqueda, con Search regular, Resúmenes de IA y Gemini, todos favoreciendo fuentes, clasificaciones y contenido diferentes.

El reduccionismo gobierna. En los últimos doce meses, el ‘Déjame buscar eso para ti’ meme ha sido superado por una nueva ‘Déjame resumir esa búsqueda de Google para ti’ tendencia, en la que los resúmenes de IA en los resultados de búsqueda cada vez más ahorran a los lectores la molestia de hacer clic en los enlaces de búsqueda (arguablemente desfinanciando los sitios de origen en el proceso), condensando los resultados de búsqueda completos en unos pocos párrafos generados.

Uno podría pensar que el conocimiento central que se presenta y la elección de sitios de los que se extrae ese conocimiento serían relativamente similares en los tres métodos más populares de búsqueda de información en Internet: en la búsqueda web tradicional; en los resúmenes de IA (AIOs) que ahora encabezan la mayoría de los resultados de búsqueda web; y a través del uso creciente de LLMs como ChatGPT como oráculos web (con o sin llamadas RAG externas).

Sin embargo, una investigación reciente en EE. UU. indica que esto es, sorprendentemente, muy lejos de ser el caso; y que incluso dentro de la propia trinidad de oráculos de Google – SERPS*, resúmenes de IA y interacción directa con la serie LLM Gemini – parecen haber discrepancias significativas e interesantes, para cada ruta.

División en tres

En un nuevo documento claro y extenso, titulado Cómo la IA generativa interrumpe la búsqueda: un estudio empírico de Google Search, Gemini y Resúmenes de IA, seis investigadores del Instituto de Tecnología de Nueva Jersey describen las formas en que los tres métodos de búsqueda están divergiendo y ofrecen algunas teorías posibles para estas fracturas en el enfoque.

El documento establece:

‘[Primero, encontramos] que para el 51,5% de las consultas de usuario reales representativas, se generan AIOs y se muestran por encima de los resultados de búsqueda orgánicos. Las preguntas polémicas frecuentemente resultan en un AIO.

‘En segundo lugar, mostramos que las fuentes recuperadas son sustancialmente diferentes para cada motor de búsqueda (<0,2 de similitud media de Jaccard). La búsqueda de Google tradicional es significativamente más probable que recupere información de sitios web populares o institucionales en gobierno o educación, mientras que los motores de búsqueda generativos son significativamente más propensos a recuperar contenido propiedad de Google.

‘En tercer lugar, observamos que los sitios web que bloquean el rastreador de IA de Google son significativamente menos propensos a ser recuperados por AIOs, a pesar de tener acceso al contenido.’

Dado que el documento es un festín de ideas fascinantes, en lugar de ajustarse al flujo de trabajo lineal y dirigido habitual, tomaremos un vistazo más cercano a estas y otras de sus ideas más sorprendentes e iluminadoras.

El viejo ‘Dos-Uno’

Uno de los hallazgos interesantes del estudio indica que los resúmenes de IA de Google tienden a ser suprimidos para eventos de noticias de última hora, ya que las fuentes más tempranas y disponibles pueden no ser las más precisas.

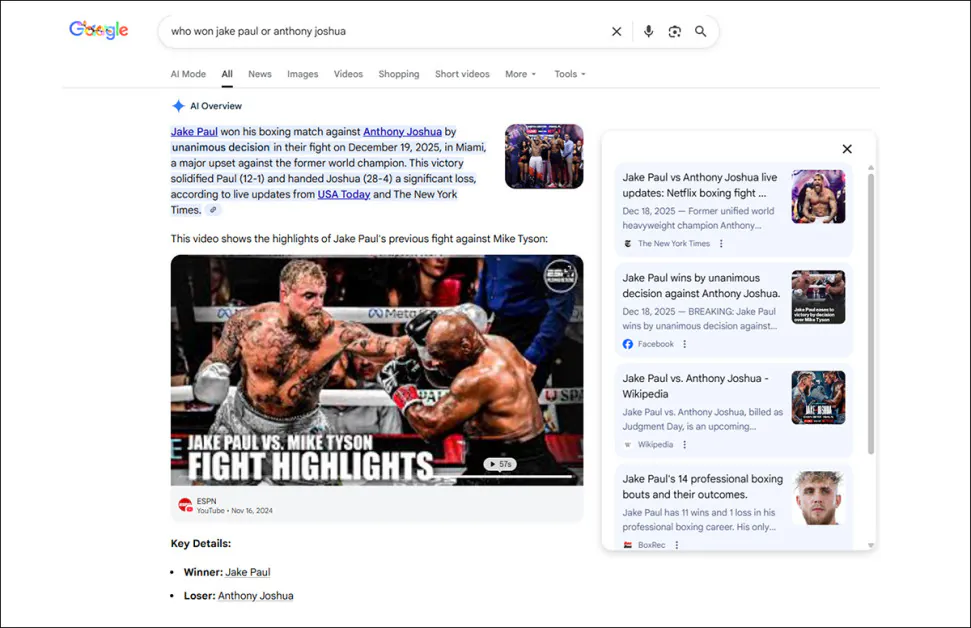

Este sistema no siempre funciona: en el ejemplo a continuación, señalado por los investigadores, un resumen de IA de Google sobre el resultado de un combate de boxeo atribuyó la victoria al boxeador equivocado, incluso aunque la única fuente que establecía este resultado (incorrecto) era un feed de deportes satírico en Facebook:

Una de las razones por las que los resúmenes de IA de Google evitan resúmenes de tiempo crítico es que la información temprana puede ser incompleta o completamente inexacta. En este caso, el boxeador Jake Paul en realidad perdió el combate. Fuente

Los autores señalan que los AIOs tienden a aparecer cuando un evento tiene al menos cinco días de antigüedad, lo que lo califica como una anomalía, pero de todos modos, una que los investigadores pudieron invocar con facilidad.

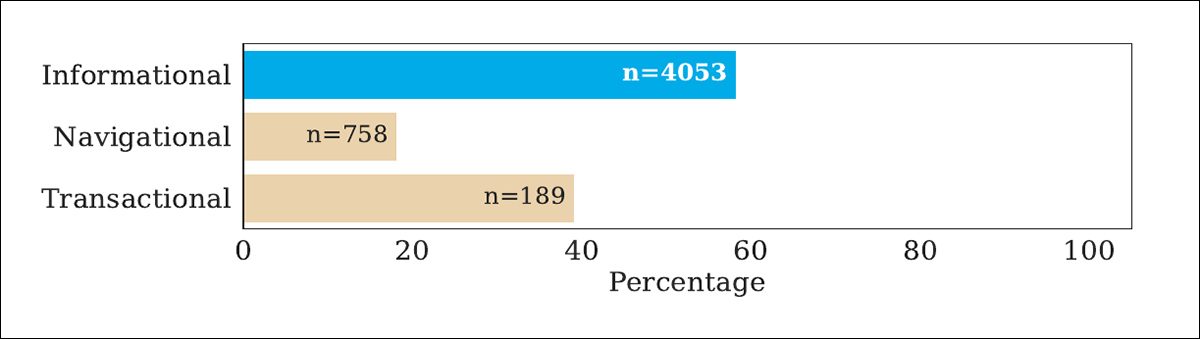

Los AIOs se encontraron más propensos a ser generados cuando la consulta se cerraba con un signo de interrogación, y que la intención de la consulta era un factor en si se presentaría un AIO:

Porcentaje de incidentes en los que se produjo un resumen de búsqueda de IA en una de las pruebas de los investigadores. Aquí, ‘informativo’ indica preguntas directas, que tienden a producir AIOs más que cualquier otro tipo de interacción.

Además, el documento sostiene que las consultas más largas tienden a ser más propensas a producir un resumen de IA en lugar de solo resultados de búsqueda directos, aunque los autores no ofrecen aún una teoría para explicar esto.

Un reino dividido

Quizás el resultado más sorprendente del nuevo trabajo es el pequeño cruce en la calidad de los resultados entre los tres plataformas de búsqueda de Google.

El documento muestra una y otra vez que la búsqueda de Google regular, los resúmenes de IA y Gemini (LLM) recuperan fuentes notablemente diferentes para la misma consulta, con puntuaciones de superposición lo suficientemente bajas como para implicar tres lógicas de recuperación en competencia dentro de una empresa, mientras que los usuarios podrían asumir que Google tiene un índice autorizado y una filosofía de clasificación:

Incluso dentro del propio ecosistema de Google, la superposición entre la búsqueda tradicional, los resúmenes de IA y Gemini resultó sorprendentemente pequeña, con la misma consulta a menudo produciendo listas de fuentes sustancialmente diferentes dependiendo de qué sistema de Google manejara la solicitud. En esta comparación, vemos cómo se parecieron los tres sistemas entre sí a lo largo de miles de consultas de búsqueda, desde temas de compras y debates hasta búsquedas locales y preguntas de conocimiento general, con puntuaciones más bajas que indican menos acuerdo entre las fuentes seleccionadas.

Con respecto a esta sección de su análisis, los autores establecen†:

‘[La tabla anterior] presenta la similitud media entre la lista de fuentes devueltas por el AIO, Gemini y la SERP tradicional para cada consulta en el conjunto de datos de referencia.

‘La principal idea es que independientemente del subconjunto de consulta y de qué par de motores de búsqueda se compara, las listas recuperadas son disímiles, a pesar de que los tres fueron desarrollados por Google.’

Los investigadores señalan además que ningún método de búsqueda probado demostró tener una superposición sesgada por rango (RBO) por encima de 0,27, lo que es una puntuación muy baja. Notan además que Amazon Retail y consultas localizadas (es decir, ‘tiendas cerca de mí’) tuvieron la menor similitud entre los métodos de búsqueda.

Attribuyen la baja concordancia a la ‘inconsistencia fundamental entre los motores de búsqueda’, señalando que ni la aleatoriedad ni ningún otro factor obvio pueden hacerse responsables de esta desincronización.

Una explicación intuitiva, arguablemente, es que los puntos de datos de entrenamiento se asignan rangos de una manera muy diferente a los métodos que Google ha estado desarrollando para PageRank y sus sucesores en las últimas dos décadas. Además, en la remota posibilidad de que el algoritmo de búsqueda de Google tenga una agenda secreta, ese tipo de interferencia o ‘juego’ es mucho más difícil de implementar consistentemente en AIs basadas en difusión como Gemini (incluso a través de filtrado, prompts del sistema y los varios otros métodos de acorralamiento que se imponen en los modelos comerciales).

Auto-servicio..?

Ciertos sitios web, o categorías de sitios web, parecen haber sido afectados por la aparición de resúmenes de IA y la incursión de la búsqueda basada en LLM en el espacio de búsqueda tradicional – tanto adversa como positivamente, dependiendo del caso:

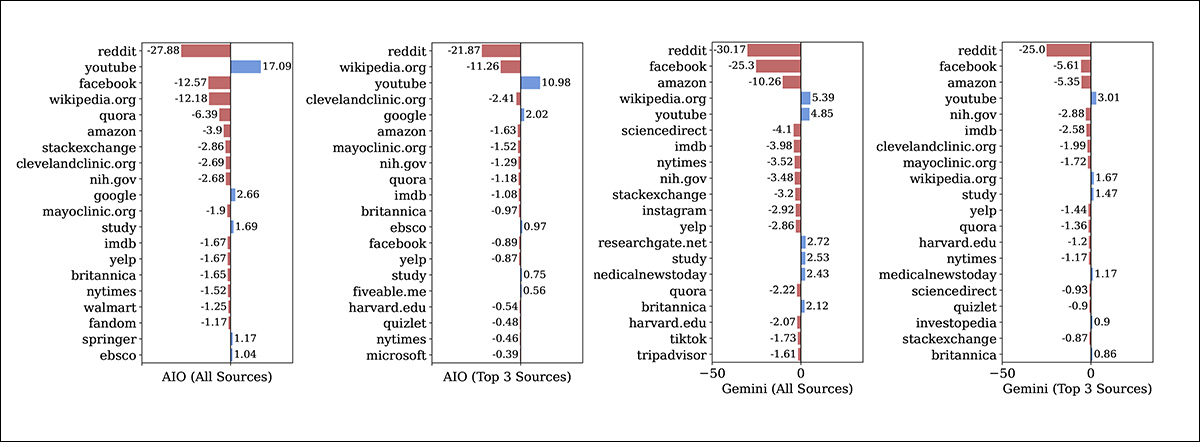

En comparación con la búsqueda de Google tradicional, los resúmenes de IA y Gemini redujeron las citas de muchos sitios web importantes, mientras que aumentaron la visibilidad para un número menor de dominios favoritos. YouTube resultó ser uno de los mayores beneficiarios en ambos sistemas, mientras que Reddit, Wikipedia, Facebook y muchas fuentes institucionales aparecieron con menos frecuencia en la recuperación generada por IA.

Los autores señalan que algunas preferencias inesperadas surgen entre los tres métodos, durante las pruebas:

‘Tenemos tres conclusiones principales de [los gráficos anteriores]. Primero, los sitios web grandes y conocidos son los más afectados (tanto positiva como negativamente). Esto es intuitivo, ya que los sitios web grandes tienen la reputación y la diversidad en el contenido para ser relevantes para muchas consultas diferentes.

‘En segundo lugar, la abrumadora mayoría de estos sitios web reciben menos citas generales y menos citas en los tres primeros puestos con motores de búsqueda generativos (indicados por barras rojas y números negativos en [los gráficos anteriores]). Esto sugiere que la búsqueda generativa tiende a obtener información de fuentes más nicho que los motores de búsqueda tradicionales.

‘En tercer lugar, los resúmenes de IA de Google favorecen los sitios web de Google (es decir, dominios google.com y youtube.com).

‘Gemini también favorece a YouTube en comparación con la búsqueda de Google tradicional, pero la diferencia absoluta es menor.’

¿Algunos ‘bloqueadores’..?

El estudio también encontró que los editores que bloquean el rastreador web de IA de Google – el robot web automatizado que raspa datos de su sitio a menos que se le diga que no con un archivo robots.txt – tienden a no aparecer en los resúmenes de IA.

Esto puede parecer una herida autoinfligida, pero en realidad Google ha declarado públicamente que el contenido de las plataformas que bloquean los rastreadores de IA no se verá impedido para aparecer en los resúmenes de IA; más bien, los editores simplemente no tendrán sus datos raspados, curados en una colección y ejecutados en la siguiente ronda de entrenamiento de IA para Gemini y otros proyectos de IA de Google.

Sin embargo, esa no fue la conclusión a la que llegaron los investigadores del nuevo documento, sino que encontraron que los editores de AI más populares que bloqueaban fueron muy infrecuentemente citados por Gemini, ya sea en la LLM o en la encarnación de resultados de búsqueda más ágil. Los editores ‘efectivamente prohibidos’ se informaron en el documento como NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports y STAT.

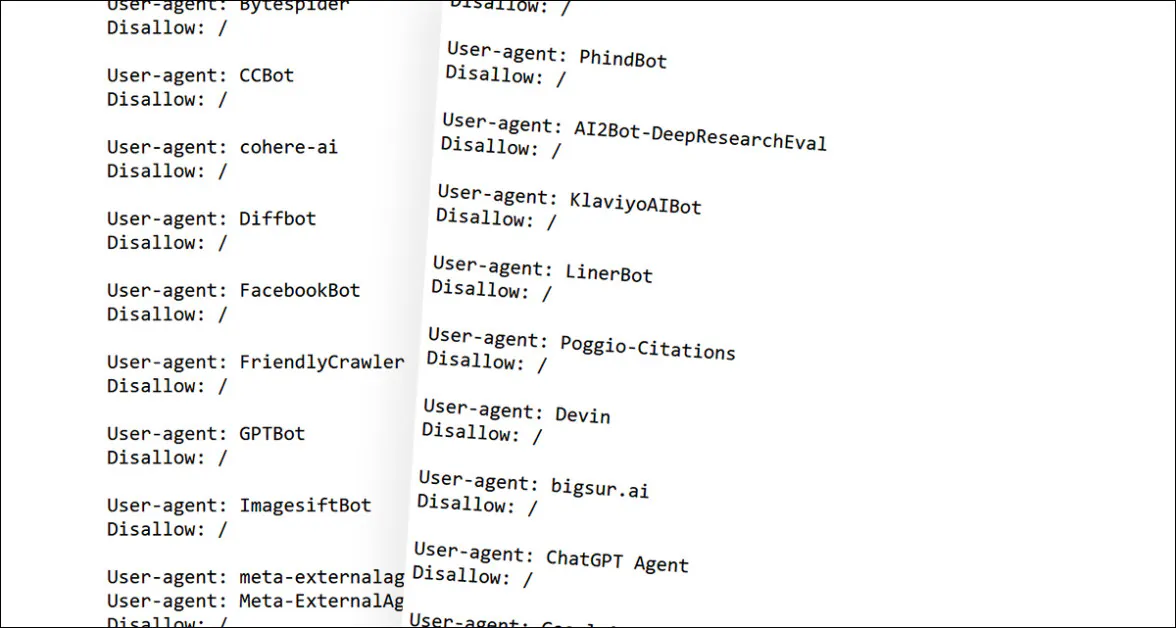

Algunas de las prohibiciones de raspado de IA de robots.txt efectuadas por los editores enumerados anteriormente. Pero ¿ha llevado a una censura más amplia por parte de Google?

Los autores establecen:

‘En nuestro análisis de los dominios más afectados, encontramos que 21 editores populares (que se recuperan para al menos 20 consultas únicas por la búsqueda de Google y los AIOs) nunca fueron citados por Gemini.

‘Varias redes sociales (Facebook, Instagram, Tiktok) y sitios web de reseñas (IMDb, Yelp, Tripadvisor) también recibieron cero citas de Gemini. Al investigar más a fondo, encontramos que todos estos sitios web bloquean el bot Google-Extended en sus archivos robots.txt.’

Si este hallazgo resulta verificado en otros lugares y persistente, uno podría especular que estas empresas están siendo presionadas por Google para capitular y cooperar con sus operaciones de IA a través de una deslistación parcial. A primera vista, los resultados parecen punitivos, pero entonces, los hallazgos del nuevo trabajo son más indicativos de caos que de premeditación; por lo tanto, el único comentario razonable que se puede establecer es que estos resultados parecen ‘vengativos’ superficialmente, sea lo que sea lo que realmente los cause.

Conclusión

Opinión Este es un documento claro y conciso, cuyas diez páginas primarias se despliegan en una cascada casi abrumadora de hallazgos adicionales. Dado que hemos tenido tiempo de cubrir solo una pequeña sección de estos, recomiendo el PDF de origen incluso al lector casual (un evento raro).

Aunque una disposición ‘amarilla’ podría interpretar muchas interpretaciones negativas de los descubrimientos de los autores, el trabajo es quizás mejor tratado como indicativo de un líder tecnológico global que intenta obtener y retener una ventaja global en la búsqueda basada en IA, utilizando plataformas muy contrastantes que se desarrollaron en circunstancias y eras muy diferentes.

Mientras que se examinan tres métodos de búsqueda en el documento, la verdadera controversia es entre los resultados de búsqueda tradicionales, clasificados por métodos propietarios, y los métodos de selección basados en la distribución que dominan la curación de datos y el entrenamiento de IA.

IA como en 1999

Antes de la aparición de Google, era posible ‘jugar’ con los resultados de búsqueda a través del mero volumen, y de esta manera, a menudo se podía lograr una colocación en la primera página de SERPS con un esfuerzo mínimo (frecuentemente automatizado). Este ‘juego de números’ fue efectivamente terminado alrededor de 2002 por el algoritmo de clasificación de búsqueda de Google más sofisticado y secreto. Pero como las apuestas eran significativas, el contenido de alto volumen y baja calidad nunca desapareció en ningún sentido significativo.

Por lo tanto, para cuando se crearon colecciones de gran escala como Common Crawl que sentaron las bases de la revolución de IA moderna, la prominencia de los datos estaba destinada a ser dominada por la medida en que los procesos automatizados podían filtrar y clasificar la calidad de los datos entrantes, y (mucho menos probable), la medida en que había dinero disponible para pagar a las personas para que clasificaran esos datos.

Había mucha mala o baja calidad de datos en esas enormes y indiscriminadas colecciones; datos que pueden no haber incluido desnudez o blasfemias o estereotipos racistas, o cualquier otra cosa que sea relativamente fácil de filtrar de los conjuntos de datos de entrenamiento – pero que sin embargo eran interesados y voluminosos, al igual que los resultados de la búsqueda de Internet alrededor de 1999-2001.

Debido a que esos procesos de inducción de datos no son aún grandes, es muy difícil incluso para Google hacer que la IA actúe de manera comercial, ya que las decisiones de estilo PageRank de Gemini están dictadas no por los ingenieros de política de Google, sino por una comprensión imperfecta de cómo los datos de gran escala se transforman en distribuciones de datos y representaciones latentes durante el entrenamiento de un modelo de IA.

* Páginas de resultados de búsqueda.

† Énfasis de los autores, no mío. Sin embargo, he sustituido el énfasis en negrita por cursiva, ya que el énfasis en cursiva no funciona bien en citas que ya son principalmente cursivas.

Publicado por primera vez el miércoles 13 de mayo de 2026