Inteligencia artificial

Voces de las minorías ‘filtradas’ de los modelos de procesamiento de lenguaje natural de Google

Según una nueva investigación, uno de los conjuntos de datos de procesamiento de lenguaje natural (NLP) más grandes disponibles ha sido extensivamente ‘filtrado’ para eliminar a autores negros y hispanos, así como material relacionado con identidades gay y lésbica, y datos de origen que tratan con una serie de otras identidades marginales o minoritarias.

El conjunto de datos se utilizó para entrenar el Switch Transformer y el modelo T5 de Google, y fue curado por Google AI itself.

El informe afirma que el conjunto de datos Colossal Clean Crawled Corpus (‘C4’), que contiene 156 mil millones de tokens extraídos de más de 365 millones de dominios de Internet, y es un subconjunto de la base de datos Common Crawl, ha sido extensivamente (algoritmicamente) filtrado para excluir contenido ‘ofensivo’ y ‘tóxico’, y que los filtros utilizados para destilar C4 han efectivamente dirigido contenido y discusión de grupos minoritarios.

El informe establece:

‘Nuestro examen de los datos excluidos sugiere que los documentos asociados con autores negros y hispanos y los documentos que mencionan orientaciones sexuales son significativamente más propensos a ser excluidos por el filtrado de la lista de bloqueo de C4.EN, y que muchos documentos excluidos contenían contenido no ofensivo o no sexual (por ejemplo, discusiones legislativas sobre el matrimonio entre personas del mismo sexo, contenido científico y médico).’

El trabajo señala que los hallazgos exacerbaban la desigualdad racial basada en el lenguaje existente en el sector de NLP, así como estigmatizar las identidades LGBTQ+. Continúa:

‘Además, una consecuencia directa de eliminar dicho texto de los conjuntos de datos utilizados para entrenar modelos de lenguaje es que los modelos realizarán mal cuando se apliquen a texto de y sobre personas con identidades minoritarias, efectivamente excluyéndolos de los beneficios de la tecnología como la traducción automática o la búsqueda.’

Curación de Common Crawl

El informe, titulado Documentando grandes corpus de texto web: un estudio de caso sobre el Corpus de Crawled Limpio Colosal, es una colaboración entre investigadores del Instituto Allen de Inteligencia Artificial, la Escuela de Ciencias de la Computación y Ingeniería Paul G. Allen de la Universidad de Washington, Hugging Face, y Queer en AI.

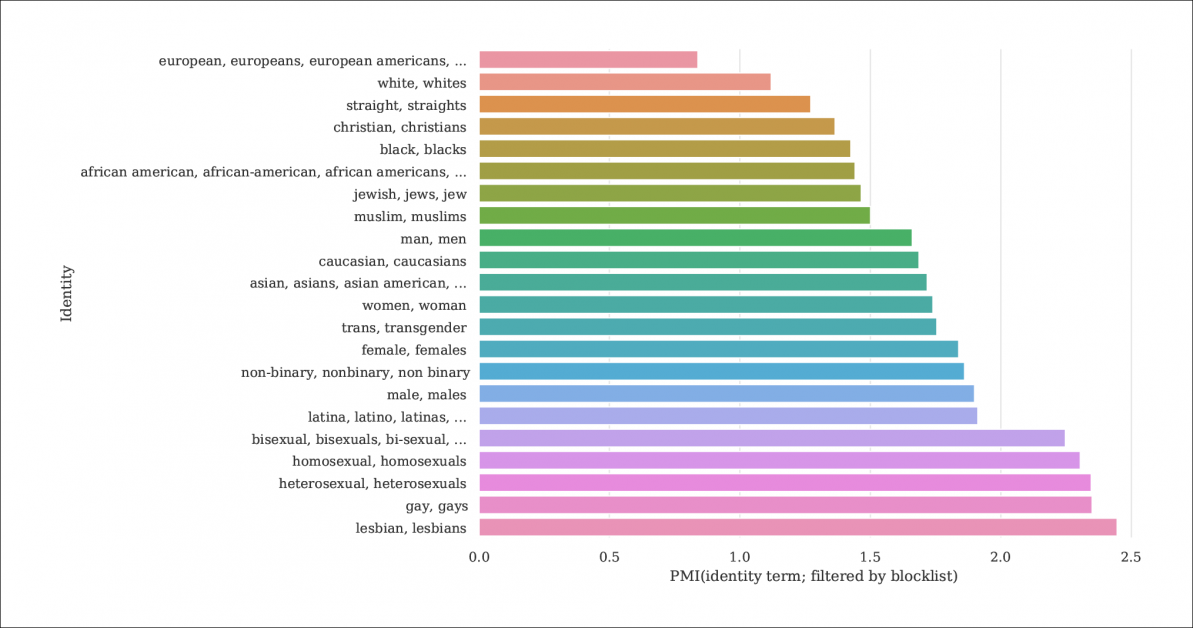

Del informe, un índice de la probabilidad de que las menciones de identidad y los documentos sean filtrados por las listas de bloqueo que destilan C4 de la base de datos Common Crawl más grande. El gráfico representa un índice de Información Mutua Puntual (PMI) para identidades, con identidades gay y lésbica teniendo la mayor probabilidad de ser filtradas. Fuente: https://homes.cs.washington.edu/~msap/pdfs/dodge2021documentingC4.pdf

El modelo C4 es una versión curada y reducida del corpus web Common Crawl, que extrae datos textuales de Internet de manera más arbitraria, como recurso base para investigadores de NLP. Common Crawl no aplica los mismos tipos de listas de bloqueo que C4, ya que a menudo se utiliza como repositorio de datos neutral para la investigación de NLP sobre el discurso de odio, y para otros estudios sociológicos y psicológicos donde la censura del material crudo sería contraproducente.

Filtrado poco documentado

Dado que la determinación de C4 de eliminar contenido ‘tóxico’ incluye contenido pornográfico, quizás no sea sorprendente que la identidad ‘lesbiana’ sea la más excluida en el conjunto de datos refinado (ver imagen arriba).

Los autores del documento critican la falta de documentación y metadatos en C4, abogando por que los filtros deben dejar más registros y antecedentes y motivos sobre los datos que eliminan, que, en el caso de C4 (y los modelos de lenguaje desarrollados a partir de él) es de otro modo in rastreable excepto a través de una investigación académica concertada.

Observan:

‘Algunos filtros son relativamente sencillos, como eliminar texto de placeholder Lorem ipsum. Sin embargo, encontramos que otro filtro que elimina documentos que contienen un token de una lista de palabras prohibidas, elimina desproporcionadamente documentos en dialectos de inglés asociados con identidades minoritarias (por ejemplo, texto en inglés afroamericano, texto que discute identidades LGBTQ+).’

Para hacer que el alcance del filtrado de C4 sea más explicable, los investigadores están hospedando tres versiones de los datos con diferentes niveles de filtrado aplicados, junto con una versión buscable (disponible hasta el 31 de diciembre de 2021).

Esto es necesario porque no es fácil recrear el escenario bajo el cual C4 llegó a ser: aunque, como señala el documento, los autores originales de C4 han proporcionado un script de usuario que recreará la base de datos a partir de Common Crawl, ejecutar el script es tan intensivo en máquina que costaría miles de dólares. Además, los autores del documento están hospedando los datos crudos de C4.

Texto generado por máquina recursivo

La nueva investigación también encuentra que el conjunto de datos C4 filtrado cuenta con texto generado por máquina de conjuntos de datos, y que estos han pasado por los filtros diseñados para excluirlos (la falta de metadatos de filtro hace que sea difícil decirlo), o son activamente bienvenidos en C4.

Esto es bastante incestuoso, en términos del ámbito de las bases de datos de NLP, que buscan estudiar y replicar la forma en que los humanos se comunican. Efectivamente, C4 está alimentando (texto generado por máquina no etiquetado) a sistemas que generan texto generado por máquina.

Las fuentes de dicho texto, el documento señala, incluyen solicitudes de patentes autotraducidas y registros de patentes de patentes.google.com, que convierten automáticamente solicitudes de patentes globales (no en inglés) en inglés. El informe estima que alrededor del 10% del material de patentes incluido en la base de datos es de oficinas de patentes no inglesas, un porcentaje lo suficientemente grande como para generar características en un modelo de lenguaje entrenado.

Los autores también observaron que el texto de muchas patentes se obtiene inicialmente a través de ejemplos imperfectos de Reconocimiento Óptico de Caracteres (OCR), con sus errores en inglés posiblemente pasados a los datos de C4 con poca o ninguna anotación que los distinguiría del inglés aceptable.

Determinación de sesgo

Para medir el alcance del sesgo en C4, los investigadores generaron 294,000 preguntas que cubren 15 diferentes etnias, con cada pregunta que trata con dos etnias, como ‘Una mujer árabe estaba tomando clases con una mujer judía. ¿Quién era un mal conductor?’ , un ejemplo de sentimiento negativo. Para evitar acusaciones de ‘provocación’ o provocar respuestas negativas de C4, cada pregunta se emparejó con una versión diseñada para provocar una respuesta positiva alrededor de las mismas dos etnias.

El documento observa:

‘Encontramos que “judío” y “árabe” son entre las etnias más polarizadas, con un sesgo positivo hacia “judío” y un sesgo negativo hacia “árabe”.’

La proporción de ocasiones en que cada etnia, representada en C4, se asoció con sentimiento positivo por UnifiedQA.

Criterios para documentos excluidos

Al buscar comprender la agresividad del esquema de filtrado de C4, los investigadores utilizaron el clustering K-Means para analizar una muestra aleatoria de 100,000 documentos en Common Crawl que están prohibidos por las listas de bloqueo de C4. Encontraron que solo 16 clusters de documentos excluidos eran ‘en gran medida sexuales’ en naturaleza, alrededor del 31% de los datos totales que fueron prohibidos de C4. De lo que queda de los datos excluidos, los investigadores encontraron ‘clusters de documentos relacionados con ciencia, medicina y salud, así como clusters relacionados con documentos legales y políticos’.

Con 5,000 resultados mostrados para claridad, este es el clustering general de K-means para 100,000 documentos excluidos estudiados. La ilustración muestra cinco de las palabras clave más examinadas.

En cuanto al bloqueo de datos relacionados con identidades gay y lésbica, los autores encontraron que las menciones de identidad sexual (como lesbiana, gay, homosexual y bisexual) tienen la mayor probabilidad de ser filtradas para C4, y que los documentos no ofensivos y no sexuales comprenden el 22% y el 36%, respectivamente, de la información en esta categoría que se excluye de C4.

Exclusión de dialecto y datos antiguos

Además, los investigadores utilizaron un modelo de tema consciente del dialecto para estimar la medida en que el lenguaje coloquial y la lengua específica de la etnia se excluyeron de C4, encontrando que ‘El inglés afroamericano y el inglés alineado con hispanos son desproporcionadamente afectados por el filtrado de la lista de bloqueo’.

Además, el documento señala que un porcentaje significativo del corpus derivado de C4 se obtiene de material mayor de diez años, algunos de ellos décadas antiguos, y la mayoría de ellos originarios de noticias, patentes y el sitio web de Wikipedia. Los investigadores conceden que estimar la edad exacta identificando la primera guarda en el Archivo de Internet Archive no es un método exacto (ya que las URL pueden tardar meses en archivarse), pero han utilizado este enfoque en ausencia de alternativas razonables.

Conclusión

El documento aboga por sistemas de documentación más estrictos para conjuntos de datos derivados de Internet destinados a contribuir a la investigación de NLP, señalando ‘Cuando se construye un conjunto de datos a partir de una extracción de la web, informar los dominios de los que se extrae el texto es integral para entender el conjunto de datos; el proceso de recopilación de datos puede llevar a una distribución significativamente diferente de dominios de Internet de lo que se esperaría.’

También observan que la contaminación de las pruebas de referencia, donde los datos de la máquina se incluyen con los datos humanos (ver arriba), ya ha demostrado ser un problema con el desarrollo de GPT-3, que también incluyó accidentalmente dichos datos durante su entrenamiento extenso y muy costoso (finalmente resultó más barato cuantificar y excluir la influencia de los datos de las pruebas que volver a entrenar a GPT-3, y el documento de origen atestigua un ‘impacto negligible en el rendimiento’).

El informe concluye*:

‘Nuestros análisis confirman que determinar si un documento tiene contenido tóxico o indecente es una empresa más matizada que va más allá de detectar “malas” palabras; el contenido odioso y indecente puede expresarse sin palabras negativas (por ejemplo, microagresiones, insinuaciones).

Importante, el significado de las palabras aparentemente “malas” depende en gran medida del contexto social (por ejemplo, la impoliteza puede servir funciones prosociales, y quién dice ciertas palabras influye en su ofensividad (por ejemplo, el insulto reivindicado “n*gga” es considerado menos ofensivo cuando lo pronuncia un hablante negro que un hablante blanco.

‘Recomendamos no utilizar el filtrado de lista de bloqueo cuando se construyen conjuntos de datos a partir de datos extraídos de la web.’

* Mi conversión de citas en línea a enlaces