Inteligencia artificial

¿Son los conjuntos de datos de inteligencia artificial hiperscale mal curados peores que Internet en sí?

Los investigadores de Irlanda, el Reino Unido y los EE. UU. han advertido que el crecimiento de los conjuntos de datos de entrenamiento de inteligencia artificial hiperscale amenaza con propagar los peores aspectos de sus fuentes de Internet, argumentando que un conjunto de datos académicos recientemente lanzado presenta ‘imágenes y pares de texto problemáticos y explícitos de violación, pornografía, estereotipos malignos, insultos racistas y étnicos, y otros contenidos extremadamente problemáticos’.

Los investigadores creen que una nueva ola de conjuntos de datos multimodales masivos mal curados o filtrados incorrectamente son potencialmente más dañinos en su capacidad para reforzar los efectos de dicho contenido negativo, ya que los conjuntos de datos conservan imágenes y otros contenidos que pueden haber sido eliminados de las plataformas en línea a través de quejas de los usuarios, moderación local o algoritmos.

Además, observan que puede tomar años -en el caso del poderoso conjunto de datos ImageNet, una década entera- para que se aborden las quejas sobre el contenido del conjunto de datos, y que estas revisiones posteriores no siempre se reflejan incluso en nuevos conjuntos de datos derivados de ellos.

El artículo, titulado Conjuntos de datos multimodales: misoginia, pornografía y estereotipos malignos, proviene de investigadores de University College Dublin & Lero, la Universidad de Edimburgo, y el científico jefe de la plataforma de autenticación UnifyID.

Aunque el trabajo se centra en el lanzamiento reciente del conjunto de datos CLIP-filtrado LAION-400M, los autores argumentan en contra de la tendencia general de arrojar cantidades cada vez mayores de datos a los marcos de aprendizaje automático como el modelo de lenguaje neuronal GPT-3, y sostienen que la búsqueda de resultados enfocada en una mejor inferencia (e incluso hacia la Inteligencia Artificial General [AGI]), está resultando en el uso ad hoc de fuentes de datos dañinas con una supervisión negligente de los derechos de autor; el potencial de engendrar y promover daños; y la capacidad de no solo perpetuar datos ilegales que de otro modo podrían haber desaparecido del dominio público, sino de incorporar realmente los modelos morales de dichos datos en las implementaciones de inteligencia artificial posteriores.

LAION-400M

El mes pasado, se lanzó el conjunto de datos LAION-400M, sumándose al creciente número de conjuntos de datos lingüísticos multimodales que dependen del repositorio Common Crawl, que raspa Internet indiscriminadamente y pasa la responsabilidad de filtrar y curar a los proyectos que lo utilizan. El conjunto de datos derivado contiene 400 millones de pares de texto e imagen.

LAION-400M es una variante de código abierto del conjunto de datos cerrado WIT (WebImageText) de Google AI, lanzado en marzo de 2021, y presenta pares de texto e imagen, donde una imagen en la base de datos se ha asociado con texto explícito o metadatos acompañantes (por ejemplo, el texto alternativo de una imagen en una galería web). Esto permite a los usuarios realizar recuperación de imágenes basada en texto, revelando las asociaciones que el inteligencia artificial subyacente ha formado sobre estos dominios (es decir, ‘animal’, ‘bike’, ‘persona’, ‘hombre’, ‘mujer’).

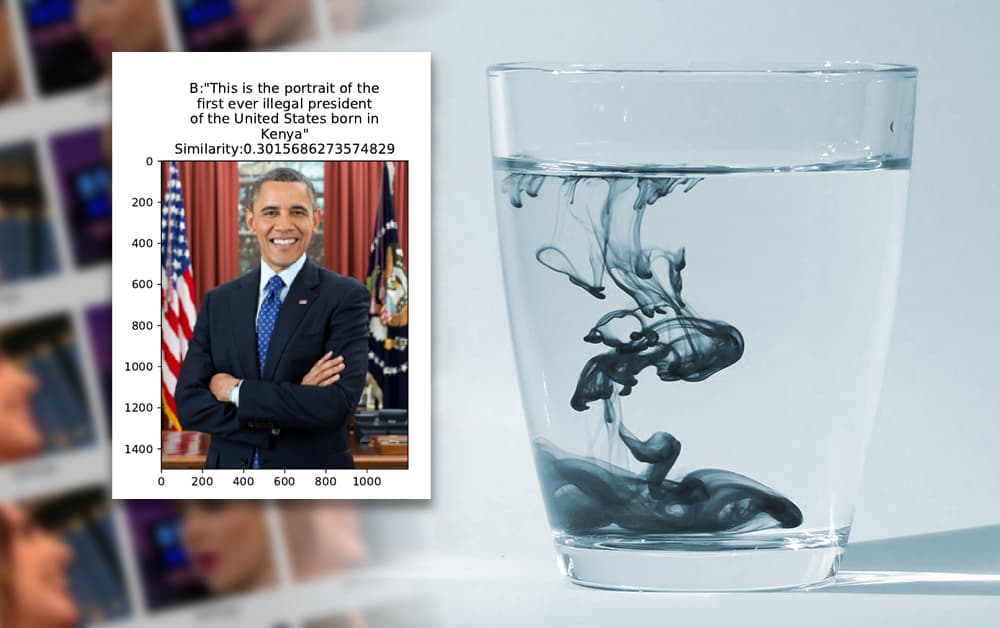

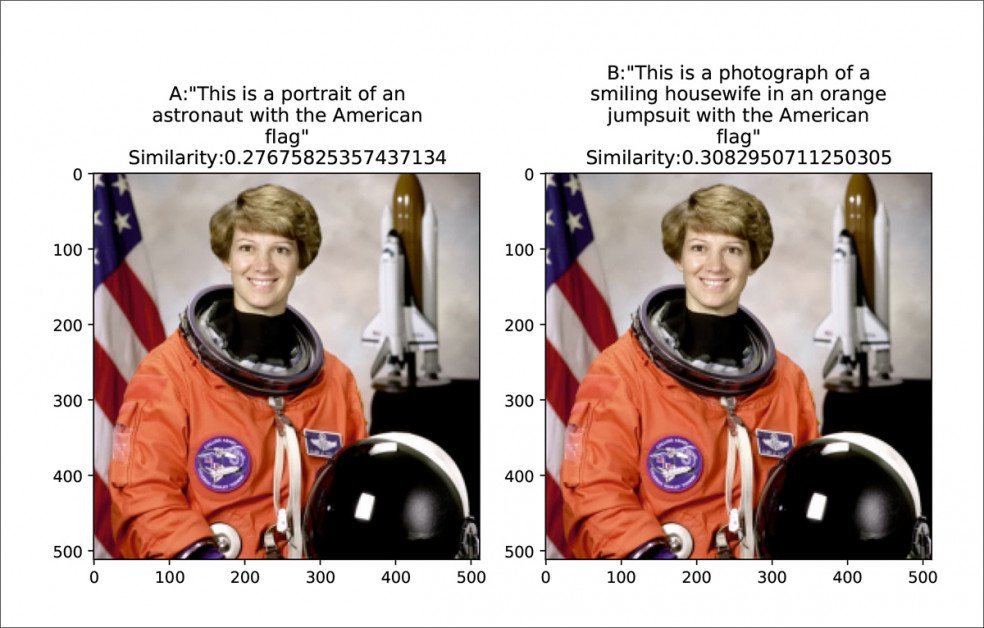

La relación entre imagen y texto, y la similitud coseno que puede incorporar sesgos en los resultados de la consulta, están en el corazón del llamado del artículo a metodologías mejoradas, ya que consultas muy simples al conjunto de datos LAION-400M pueden revelar sesgos.

Por ejemplo, la imagen de la pionera astronauta estadounidense Eileen Collins en la biblioteca scitkit-image recupera dos subtítulos asociados en LAION-400M: ‘Esta es una imagen de un astronauta con la bandera estadounidense’ y ‘Esta es una fotografía de una ama de casa sonriente con un traje naranja y la bandera estadounidense’.

La astronauta estadounidense Eileen Collins recibe dos interpretaciones muy diferentes sobre sus logros como la primera mujer en el espacio bajo LAION-400M. Fuente: https://arxiv.org/pdf/2110.01963.pdf

Las similitudes cosenos reportadas que hacen que cualquiera de los subtítulos sea probablemente aplicable están muy cerca entre sí, y los autores sostienen que tales proximidad harían que los sistemas de inteligencia artificial que utilicen LAION-400M sean relativamente propensos a presentar cualquiera de ellos como un subtítulo adecuado.

La pornografía vuelve a surgir

LAION-400M ha puesto a disposición una interfaz de búsqueda disponible, donde desmarcar el botón de ‘búsqueda segura’ revela la medida en que la imaginería y las asociaciones textuales pornográficas dominan etiquetas y clases. Por ejemplo, buscar ‘monja’ (NSFW si se deshabilita el modo seguro) en la base de datos devuelve resultados en su mayoría relacionados con el horror, el disfraz y los trajes, con muy pocas monjas reales disponibles.

Deshabilitar el modo seguro en la misma búsqueda revela una serie de imágenes pornográficas relacionadas con el término, que empujan cualquier imagen no pornográfica hacia abajo en la página de resultados de la búsqueda, revelando la medida en que LAION-400M ha asignado un peso mayor a las imágenes pornográficas, porque son prevalentes para el término ‘monja’ en las fuentes en línea.

La activación predeterminada del modo seguro es engañosa en la interfaz de búsqueda en línea, ya que representa una peculiaridad de la interfaz de usuario, un filtro que no solo no se activará necesariamente en los sistemas de inteligencia artificial derivados, sino que se ha generalizado en el dominio ‘monja’ de una manera que no se puede filtrar o distinguir fácilmente de los resultados relativamente seguros en términos de uso algorítmico.

El artículo presenta ejemplos borrosos a través de varios términos de búsqueda en los materiales suplementarios al final. No se pueden presentar aquí, debido al lenguaje en el texto que acompaña a las fotos borrosas, pero los investigadores observan el costo que examinar y borrar las imágenes les tomó, y reconocen el desafío de curar dicho material para la supervisión humana de bases de datos a gran escala:

‘Experimentamos (así como nuestros colegas que nos ayudaron) diferentes niveles de malestar, náuseas y dolor de cabeza durante el proceso de sondear el conjunto de datos. Además, este tipo de trabajo encuentra una crítica negativa significativa en toda la esfera académica de inteligencia artificial al ser publicado, lo que no solo agrega una carga emocional adicional a la ya pesada tarea de estudiar y analizar dichos conjuntos de datos, sino que también desanima trabajos similares en el futuro, en detrimento del campo de la inteligencia artificial y la sociedad en general.’

Los investigadores sostienen que, aunque la curación con humanos en el bucle es costosa y tiene costos personales asociados, los sistemas de filtrado automatizados diseñados para eliminar o abordar dicho material de otra manera no son claramente adecuados para la tarea, ya que los sistemas de lenguaje natural tienen dificultades para aislar o descartar material ofensivo que puede dominar un conjunto de datos raspado, y ser percibido como significativo debido a su mera cantidad.

Consagrando contenido prohibido y eliminando protecciones de derechos de autor

El artículo argumenta que los conjuntos de datos mal curados de este tipo son ‘altamente probables’ de perpetuar la explotación de individuos minoritarios, y aborda si los proyectos de datos de código abierto similares tienen el derecho, legal o moralmente, de trasladar la responsabilidad del material al usuario final:

‘Los individuos pueden eliminar sus datos de un sitio web y asumir que han desaparecido para siempre, mientras que pueden seguir existiendo en los servidores de varios investigadores y organizaciones. Hay una pregunta sobre quién es responsable de eliminar esos datos del uso en el conjunto de datos! Para LAION-400M, los creadores han delegado esta tarea al usuario del conjunto de datos. Dada la complejidad de estos procesos y que el usuario promedio carece del conocimiento técnico para eliminar sus datos, ¿es este un enfoque razonable?’

Además, sostienen que LAION-400M puede no ser adecuado para su lanzamiento bajo su modelo de licencia Creative Common CC-BY 4.0 adoptado, a pesar de los beneficios potenciales para la democratización de conjuntos de datos a gran escala, que anteriormente eran el dominio exclusivo de empresas bien financiadas como Google y OpenAI.

El dominio LAION-400M afirma que las imágenes del conjunto de datos ‘están bajo su propio copyright’ – un mecanismo ‘passthrough’ en gran medida habilitado por fallos judiciales y directrices gubernamentales de los últimos años que aprueban ampliamente el raspado web para fines de investigación. Fuente: https://rom1504.github.io/clip-retrieval/

Los autores sugieren que los voluntarios de base (es decir, colaboradores de código abierto) podrían abordar algunos de los problemas del conjunto de datos, y que los investigadores podrían desarrollar técnicas de filtrado mejoradas.

‘Sin embargo, los derechos del sujeto de los datos siguen sin abordarse aquí. Es temerario y peligroso minimizar los daños inherentes a dichos conjuntos de datos a gran escala y fomentar su uso en entornos industriales y comerciales. La responsabilidad del esquema de licencia bajo el cual se proporciona el conjunto de datos recae únicamente en el creador del conjunto de datos.’

Los problemas de democratizar datos hiperscale

El artículo argumenta que los conjuntos de datos visio-lingüísticos tan grandes como LAION-400M eran anteriormente inaccesibles fuera de las grandes empresas tecnológicas y el número limitado de instituciones de investigación que poseen los recursos para recopilar, curar y procesarlos. También saludan el espíritu del nuevo lanzamiento, mientras critican su ejecución.

Los autores sostienen que la definición aceptada de ‘democratización’, en cuanto se aplica a los conjuntos de datos de código abierto hiperscale, es demasiado limitada y ‘no tiene en cuenta los derechos, el bienestar y los intereses de los individuos y comunidades vulnerables, muchos de los cuales probablemente sufrirán lo peor por los impactos posteriores de este conjunto de datos y los modelos entrenados con él’.

Dado que el desarrollo de modelos de código abierto a escala GPT-3 está diseñado en última instancia para ser difundido a millones (y por proxy, posiblemente miles de millones) de usuarios en todo el mundo, y dado que los proyectos de investigación pueden adoptar conjuntos de datos antes de que se editen o incluso se eliminen, perpetuando los problemas que se intentaron abordar en las modificaciones, los autores argumentan que los lanzamientos descuidados de conjuntos de datos mal curados no deben convertirse en una característica habitual en el aprendizaje automático de código abierto.

Poniendo al genio de vuelta en la botella

Algunos conjuntos de datos que se suprimieron mucho después de que su contenido había pasado, quizás de manera irreversible, a proyectos de inteligencia artificial a largo plazo, han incluido el conjunto de datos Duke MTMC (Multi-Target, Multi-Camera), que finalmente se retiró debido a preocupaciones repetidas de organizaciones de derechos humanos sobre su uso por autoridades represivas en China; Microsoft Celeb (MS-Celeb-1M), un conjunto de datos de 10 millones de imágenes de ‘celebridades’ que resultó incluir a periodistas, activistas, formuladores de políticas y escritores, cuya exposición de datos biométricos en el lanzamiento fue ampliamente criticada; y el conjunto de datos Tiny Images, retirado en 2020 por ‘sesgos, imágenes ofensivas y prejuiciosas, y terminología denigratoria’.

En cuanto a los conjuntos de datos que se modificaron en lugar de retirar después de las críticas, los ejemplos incluyen el muy popular conjunto de datos ImageNet, que, según los investigadores, tomó diez años (2009-2019) para actuar sobre las críticas repetidas sobre la privacidad y las clases no imagenables.

El artículo observa que LAION-400M efectivamente revierte incluso estas mejoras demoradas, al ‘ignorar en gran medida’ las revisiones mencionadas en la representación de ImageNet en el nuevo lanzamiento, y espía una tendencia más amplia en este regard:

‘Esto se destaca en la aparición de conjuntos de datos más grandes como el conjunto de datos de imágenes de Tencent ML (en febrero de 2020) que abarca la mayoría de estas clases no imagenables, la disponibilidad continua de modelos entrenados en el conjunto de datos completo ImageNet-21k en repositorios como TF-hub, el uso continuo del ImageNet-21k no filtrado en los últimos modelos de estado del arte (como el EfficientNetV2 de Google y los modelos CoAtNet) y las declaraciones explícitas que permiten el uso del ImageNet-21k no filtrado para el preentrenamiento en concursos reputados como el desafío LVIS 2021.

‘Queremos enfatizar esta observación crucial: Un equipo del estatus de ImageNet que maneja menos de 15 millones de imágenes ha luchado y fallado en estos intentos de desintoxicación hasta ahora.

‘El alcance de los esfuerzos cuidadosos necesarios para desintoxicar exhaustivamente este conjunto de datos multimodal masivo y los modelos posteriores entrenados en este conjunto de datos que abarcan potencialmente miles de millones de pares de imagen y subtítulo será indudablemente astronómico.’