Τεχνητή νοημοσύνη

RigNeRF: Μια Νέα Μέθοδος Deepfakes που Χρησιμοποιεί Νευρωνικά Πεδία Ραδιάντσας

Νέα έρευνα που αναπτύχθηκε στην Adobe προσφέρει την πρώτη βιώσιμη και αποτελεσματική μέθοδο deepfakes που βασίζεται σε Νευρωνικά Πεδία Ραδιάντσας (NeRF) – ίσως η πρώτη πραγματική καινοτομία σε αρχιτεκτονική ή προσέγγιση τα τελευταία πέντε χρόνια από την εμφάνιση των deepfakes το 2017.

Η μέθοδος, με τίτλο RigNeRF, χρησιμοποιεί τρισδιάστατα μοντέλα προσώπου (3DMMs) ως ενδιάμεσο στρώμα εργαλείων μεταξύ της επιθυμητής εισόδου (δηλ. της ταυτότητας που θα επιβληθεί στο NeRF render) και του νευρωνικού χώρου, μια μέθοδος που έχει εγκατασταθεί ευρέως τις τελευταίες χρόνια από προσεγγίσεις σύνθεσης προσώπου με τη χρήση Αντισταθμιστικών Ανταγωνιστικών Νευρωνικών Δικτύων (GAN), καμία από τις οποίες δεν έχει ακόμη παράγει λειτουργικά και χρήσιμα πλαίσια αντικατάστασης προσώπου για βίντεο.

Σε αντίθεση με τα παραδοσιακά βίντεο deepfakes, κανένα από το κινούμενο περιεχόμενο που απεικονίζεται εδώ δεν είναι ‘πραγματικό’, αλλά μάλλον είναι ένας εξερεύνησιμος νευρωνικός χώρος που εκπαιδεύτηκε σε σύντομο βίντεο. Στο δεξί μέρος βλέπουμε το τρισδιάστατο μοντέλο προσώπου (3DMM) να ενεργεί ως διεπαφή μεταξύ των επιθυμητών χειρισμών (‘γέλιο’, ‘κοίταξε αριστερά’, ‘κοίταξε επάνω’, κ.λπ.) και των συνήθως αδιανόητων παραμέτρων ενός οπτικού πεδίου Νευρωνικής Ραδιάντσας. Για μια υψηλής ανάλυσης εκδοχή αυτής της κλιπ, μαζί με άλλες, δείτε τη σελίδα του έργου, ή τα ενσωματωμένα βίντεο στο τέλος του άρθρου. Πηγή: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

Τα 3DMMs είναι αποτελεσματικά μοντέλα CGI προσώπων, των οποίων οι παράμετροι μπορούν να προσαρμοστούν σε πιο αφηρημένα συστήματα σύνθεσης εικόνας, όπως το NeRF και το GAN, τα οποία είναι διαφορετικά δύσκολο να ελεγχθούν.

Τι βλέπετε στην εικόνα παραπάνω (μεσαία εικόνα, άνθρωπος με μπλε πουκάμισο), καθώς και την εικόνα κατευθείαν κάτω (αριστερή εικόνα, άνθρωπος με μπλε πουκάμισο), δεν είναι ‘πραγματικό’ βίντεο στο οποίο έχει επιβληθεί ένα μικρό τμήμα ‘ψεύτικου’ προσώπου, αλλά μια εντελώς συνθετημένη σκηνή που υπάρχει μόνο ως ογκομετρική νευρωνική απόδοση – συμπεριλαμβανομένου του σώματος και του φόντου:

Στο παράδειγμα κατευθείαν πάνω, το βίντεο της πραγματικής ζωής στη δεξιά πλευρά (γυναίκα με κόκκινο φόρεμα) χρησιμοποιείται για να ‘μαριονέτα’ την κατεγραμμένη ταυτότητα (άνθρωπος με μπλε πουκάμισο) στη αριστερή πλευρά μέσω του RigNeRF, το οποίο (οι συγγραφείς ισχυρίζονται) είναι το πρώτο σύστημα NeRF που επιτυγχάνει διαχωρισμό στάσης και έκφρασης ενώ μπορεί να εκτελέσει καινοτόμες συνθέσεις απόψεων.

Ο άνδρας στη αριστερή πλευρά της εικόνας πάνω ‘καταγράφηκε’ από ένα βίντεο 70 δευτερολέπτων από ένα smartphone, και τα δεδομένα εισόδου (συμπεριλαμβανομένων όλων των πληροφοριών της σκηνής) εκπαιδεύτηκαν σε 4 V100 GPUs για να ληφθεί η σκηνή.

Εφόσον τα 3DMM-style παραμετρικά ρίγος είναι επίσης διαθέσιμα ως ολόσωμα παραμετρικά μοντέλα CGI (και όχι μόνο ως ρίγος προσώπου), το RigNeRF ανοίγει την πιθανότητα για deepfakes ολόσωμου όπου πραγματική ανθρώπινη κίνηση, υφή και έκφραση περνάει στο στρώμα CGI-παραμετρικής, το οποίο στη συνέχεια θα μεταφράσει δράση και έκφραση σε απόδοση NeRF περιβαλλόντων και βίντεο.

Όσον αφορά το RigNeRF – κατάτασσε ως μέθοδο deepfakes με την τρέχουσα έννοια που καταλαβαίνουν οι τίτλοι τον όρο; Ή είναι απλά ένα άλλο ημι-αναπηδημένο also-ran στο DeepFaceLab και άλλα αυτοencoder συστήματα deepfakes της εποχής του 2017;

Οι ερευνητές του νέου εγγράφου είναι αδιαμφισβήτητοι σε αυτό το σημείο:

‘Ως μέθοδος που είναι ικανή να αναζωογονήσει τα πρόσωπα, το RigNeRF είναι ευάλωτο σε κακοποίηση από κακούς ηθοποιούς για τη δημιουργία deep-fakes.’

Το νέο έγγραφο έχει τίτλο RigNeRF: Πλήρως Ελεγχόμενα Νευρωνικά 3D Πορτρέτα, και προέρχεται από τον ShahRukh Atha του Πανεπιστημίου Stonybrook, einem стажист στην Adobe κατά την ανάπτυξη του RigNeRF, και τέσσερις άλλους συγγραφείς από την Adobe Research.

Πέρα από τα Αυτοencoder-Βάσει Deepfakes

Η πλειοψηφία των ιογενών deepfakes που έχουν κατακτήσει τους τίτλους τα τελευταία χρόνια παράγονται από αυτοencoder-βάσει συστήματα, που προέρχονται από τον κώδικα που δημοσιεύτηκε στο απαγορευμένο r/deepfakes subreddit το 2017 – αν και όχι πριν να αντιγραφεί στο GitHub, όπου έχει τώρα forked πάνω από χίλια φορές, όχι τουλάχιστον στο δημοφιλές (αν αμφιλεγόμενο) DeepFaceLab distribution, και επίσης το FaceSwap project.

Εκτός από το GAN και το NeRF, τα αυτοencoder πλαίσια έχουν επίσης πειραματιστεί με 3DMMs ως ‘οδηγούς’ για βελτιωμένες πλαίσια σύνθεσης προσώπου. Ένα παράδειγμα αυτού είναι το HifiFace project από τον Ιούλιο του 2021. Ωστόσο, δεν φαίνεται να έχουν αναπτυχθεί καμία χρήσιμη ή δημοφιλής πρωτοβουλίες από αυτήν την προσέγγιση μέχρι σήμερα.

Δεδομένα για τις σκηνές του RigNeRF λαμβάνονται με τη λήψη σύντομων βίντεο από smartphone. Για το έργο, οι ερευνητές του RigNeRF χρησιμοποίησαν ένα iPhone XR ή ένα iPhone 12 για όλες τις πειραματικές διαδικασίες. Για το πρώτο μισό της λήψης, ο υποκείμενος ζητείται να εκτελέσει eine ευρεία ποικιλία εκφράσεων προσώπου και ομιλίας ενώ διατηρεί το κεφάλι του ακίνητο καθώς η κάμερα κινείται γύρω του.

Για το δεύτερο μισό της λήψης, η κάμερα διατηρεί μια σταθερή θέση ενώ ο υποκείμενος πρέπει να κινεί το κεφάλι του γύρω ενώ εκφράζει eine ευρεία ποικιλία εκφράσεων. Τα αποτέλεσμα 40-70 δευτερολέπτων βίντεο (περίπου 1200-2100 καρέ) αντιπροσωπεύουν το σύνολο του συνόλου δεδομένων που θα χρησιμοποιηθεί για την εκπαίδευση του μοντέλου.

Μείωση της Συλλογής Δεδομένων

Σε αντίθεση, τα αυτοencoder συστήματα όπως το DeepFaceLab απαιτούν τη σχετικά εργατική συλλογή και επιμέλεια χιλιάδων διαφορετικών φωτογραφιών, συχνά ληφθέντων από βίντεο του YouTube και άλλων κοινωνικών μέσων, καθώς και από ταινίες (στην περίπτωση των celebrity deepfakes).

Τα αποτέλεσμα εκπαιδευμένα αυτοencoder μοντέλα είναι συχνά προορίζονται να χρησιμοποιηθούν σε eine ποικιλία καταστάσεων. Ωστόσο, οι πιο φειδωλοί ‘celebrity’ deepfakers μπορεί να εκπαιδεύσουν ολόκληρα μοντέλα από την αρχή για ένα μόνο βίντεο, παρά το γεγονός ότι η εκπαίδευση μπορεί να διαρκέσει μια εβδομάδα ή περισσότερο.

Παρά την προειδοποιητική σημείωση από τους ερευνητές του νέου εγγράφου, τα ‘patchwork’ και ευρέως συναρμολογημένα σύνολα δεδομένων που τροφοδοτούν την AI πορνογραφία καθώς και τις δημοφιλείς ανακατασκευές ‘deepfake’ του YouTube/TikTok φαίνεται απίθανο να παράγουν αποδεκτά και συνεπή αποτελέσματα σε ένα σύστημα deepfakes όπως το RigNeRF, το οποίο έχει μια μεθοδολογία ειδική για την σκηνή. Λόγω των περιορισμών στη συλλογή δεδομένων που περιγράφονται στην νέα εργασία, αυτό μπορεί να αποδειχθεί, σε κάποιο βαθμό, ένα πρόσθετο μέσο ασφαλείας ενάντια στην εύκολη απαγωγή ταυτότητας από κακόβουλους deepfakers.

Προσαρμογή του NeRF για Βίντεο Deepfake

Το NeRF είναι μια μεθοδολογία φωτογραμμετρίας με την οποία ένας μικρός αριθμός πηγαίων εικόνων που λήφθηκαν από διάφορες οπτικές γωνίες συναρμολογούνται σε einen εξερεύνησιμο 3D νευρωνικό χώρο. Αυτή η προσέγγιση ήρθε στην προσοχή νωρίτερα φέτος όταν η NVIDIA παρουσίασε το Instant NeRF σύστημα, ικανό να μειώσει τους εξωφρενικούς χρόνους εκπαίδευσης για το NeRF σε λεπτά, ή ακόμη και δευτερόλεπτα:

Instant NeRF. Πηγή: https://www.youtube.com/watch?v=DJ2hcC1orc4

Το αποτέλεσμα Neural Radiance Field σκηνή είναι ουσιαστικά một στατική περιβάλλον η οποία μπορεί να εξερευνηθεί, αλλά η οποία είναι δύσκολο να επεξεργαστεί. Οι ερευνητές σημειώνουν ότι δύο προηγούμενες πρωτοβουλίες NeRF-βάσει – HyperNeRF + E/P και NerFACE – έχουν δοκιμάσει τη σύνθεση βίντεο προσώπου.

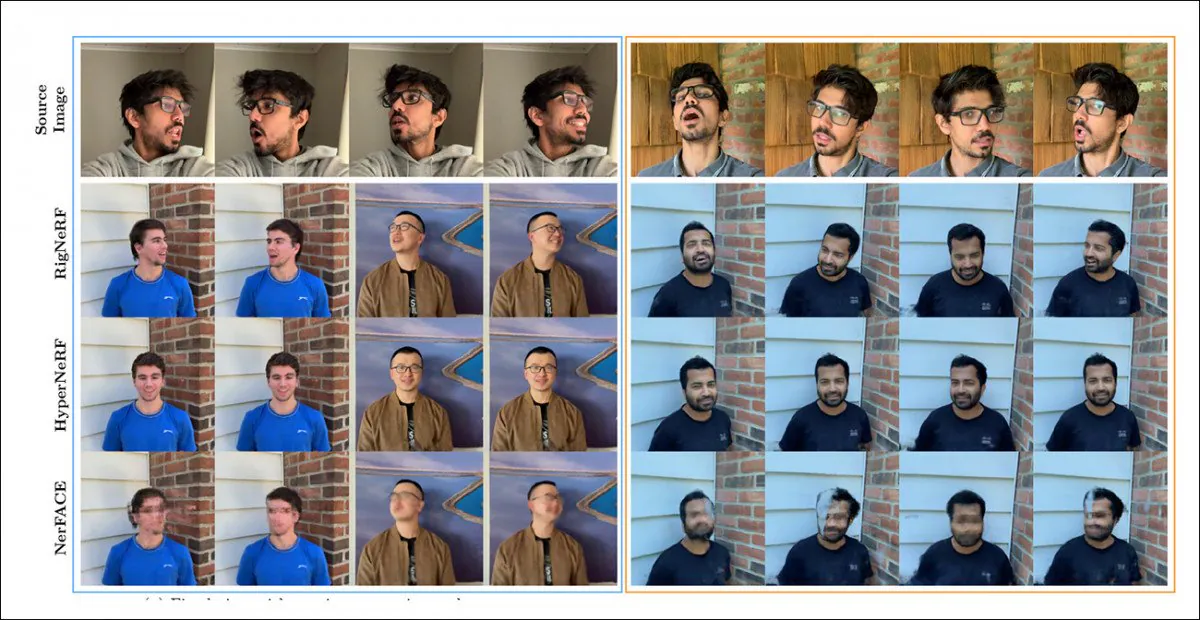

Μια ποιοτική σύγκριση μεταξύ RigNeRF, HyperNeRF, και NerFACE. Δείτε τις συνδεδεμένες πηγές βίντεο και PDF για υψηλής ποιότητας εκδοχές. Στατική εικόνα πηγή: https://arxiv.org/pdf/2012.03065.pdf

Ωστόσο, σε αυτήν την περίπτωση, τα αποτελέσματα, τα οποία ευνοούν το RigNeRF, είναι αρκετά ανώμαλα, για δύο λόγους: πρώτον, οι συγγραφείς παρατηρούν ότι ‘δεν υπάρχει υπάρχουσα εργασία για μια σύγκριση apple-to-apple’; δεύτερον, αυτό έχει απαιτήσει την περιορισμό των ικανοτήτων του RigNeRF για να ταιριάζει τουλάχιστον μερικώς με τη πιο περιορισμένη λειτουργικότητα των προηγούμενων συστημάτων.

Εφόσον τα αποτελέσματα δεν είναι μια σταδιακή βελτίωση της προηγούμενης εργασίας, αλλά μάλλον αντιπροσωπεύουν μια ‘βήμα’ στην επεξεργασία και χρηστικότητα του NeRF, θα αφήσουμε την δοκιμαστική γύρο στην άκρη, και θα δούμε τι κάνει το RigNeRF διαφορετικά από τους προκατόχους του.

Συνδυασμένες Ισχύες

Η κύρια περιορισμός του NerFACE, το οποίο μπορεί να δημιουργήσει έλεγχο στάσης/έκφρασης σε ένα περιβάλλον NeRF, είναι ότι υποθέτει ότι η πηγή βίντεο θα ληφθεί με μια στατική κάμερα. Αυτό ουσιαστικά σημαίνει ότι δεν μπορεί να παράγει καινοτόμες απόψεις που υπερβαίνουν τους περιορισμούς λήψης. Αυτό παράγει ένα σύστημα που μπορεί να δημιουργήσει ‘κινούμενα πορτρέτα’, αλλά το οποίο είναι ακατάλληλο για βίντεο τύπου deepfake.

Το HyperNeRF, από την άλλη πλευρά, ενώ μπορεί να παράγει καινοτόμες και υπερ-πραγματικές απόψεις, δεν έχει κανένα μέσο που να του επιτρέπει να αλλάξει στάσεις κεφαλιού ή εκφράσεις προσώπου, το οποίο και πάλι δεν οδηγεί σε κανένα είδος ανταγωνιστή για τα αυτοencoder-βάσει deepfakes.

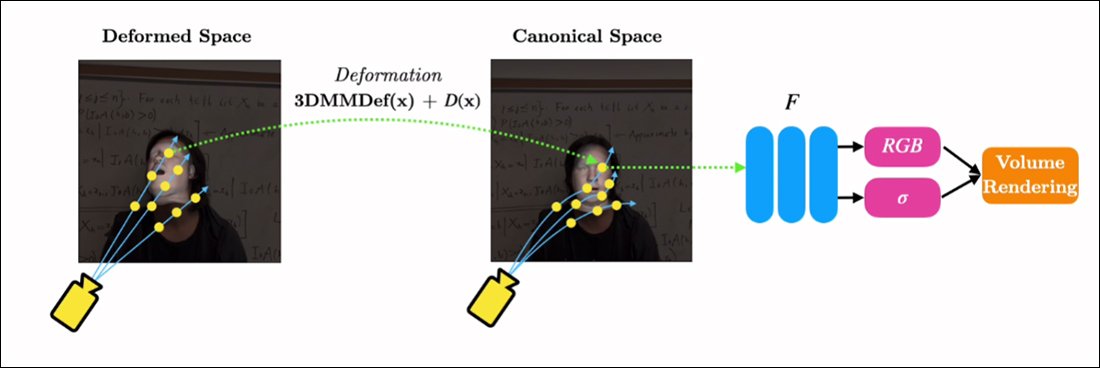

Το RigNeRF είναι ικανό να συνδυάσει αυτές τις δύο απομονωμένες λειτουργίες δημιουργώντας ένα ‘κανωνικό χώρο’, μια προεπιλογή από την οποία οι αποκλίσεις και οι παραμορφώσεις μπορούν να ενεργηθούν μέσω εισόδου από το 3DMM module.

Δημιουργία ενός ‘κανωνικού χώρου’ (χωρίς στάση, χωρίς έκφραση), στον οποίο οι παραμορφώσεις (δηλ. στάσεις και εκφράσεις) που παράγονται μέσω του 3DMM μπορούν να ενεργηθούν.

Εφόσον το 3DMM σύστημα δεν θα ταιριάζει ακριβώς με τον κατεγραμμένο υποκείμενο, είναι σημαντικό να αποζημιωθεί αυτό στη διαδικασία. Το RigNeRF επιτυγχάνει αυτό με ένα πεδίο παραμόρφωσης που υπολογίζεται από ένα Πολυστιβάδιο Νευρωνικό Δίκτυο (MLP) που προέρχεται από το πηγή βίντεο.

Οι παράμετροι κάμερας που απαιτούνται για τον υπολογισμό των παραμορφώσεων λαμβάνονται μέσω COLMAP, ενώ οι παράμετροι έκφρασης και σχήματος για κάθε καρέ λαμβάνονται από DECA.

Η τοποθέτηση είναι περαιτέρω βελτιωμένη μέσω προσαρμογή ορόσημων και των παραμέτρων κάμερας του COLMAP, και, λόγω περιορισμών υπολογιστικών πόρων, η έξοδος βίντεο είναι υποδειγματοποιημένη σε ανάλυση 256×256 για την εκπαίδευση (μια διαδικασία συρρίκνωσης που επίσης πλήττει την σκηνή αυτοencoder deepfaking).

Μετά από αυτό, το δίκτυο παραμόρφωσης εκπαιδεύεται στα 4 V100s – एक φοβερό υλικό που δεν είναι πιθανό να βρίσκεται στο έπαθλο των ερασιτεχνών (ωστόσο, όπου η εκπαίδευση μοντέλων μηχανικής μάθησης αφορά, είναι συχνά δυνατό να ανταλλάξει δύναμη με χρόνο, και απλά να αποδεχτεί ότι η εκπαίδευση μοντέλου θα είναι θέμα ημερών ή ακόμη και εβδομάδων).

Συμπερασματικά, οι ερευνητές δηλώνουν:

‘Σε αντίθεση με άλλες μεθόδους, το RigNeRF, χάρη στη χρήση ενός 3DMM-οδηγού μοντέλου παραμόρφωσης, είναι ικανό να μοντελοποιήσει στάση κεφαλιού, εκφράσεις προσώπου και την πλήρη 3D πορτρέτο σκηνή με υψηλή πιστότητα, δίνοντας καλύτερες ανακατασκευές με οξυές λεπτομέρειες.’

Δείτε τα ενσωματωμένα βίντεο παρακάτω για περαιτέρω λεπτομέρειες και αποτέλεσματα βίντεο.

Πρώτη δημοσίευση 15ης Ιουνίου 2022.