Τεχνητή νοημοσύνη

Ερευνητές Δημιουργούν Εναλλακτική Λύση για το GPU

Οι επιστήμονες υπολογιστών από το Πανεπιστήμιο Rice, μαζί με συνεργάτες από την Intel, έχουν αναπτύξει μια πιο οικονομική εναλλακτική λύση για το GPU. Το νέο αλγόριθμο ονομάζεται “υπο-γραμμικός μηχανισμός βαθιάς μάθησης” (SLIDE) και χρησιμοποιεί γενικού σκοπού κεντρικούς επεξεργαστές (CPUs) χωρίς εξειδικευμένο υλικό επιτάχυνσης.

Τα αποτελέσματα παρουσιάστηκαν στο Κέντρο Συνεδρίων του Όστιν, το οποίο φιλοξενεί τη διάσκεψη συστημάτων μηχανικής μάθησης MLSys.

Μια από τις μεγαλύτερες προκλήσεις μέσα στην τεχνητή νοημοσύνη (AI) περιβάλλει εξειδικευμένο υλικό επιτάχυνσης όπως οι μονάδες επεξεργασίας γραφικών (GPUs). Πριν από τις νέες αναπτύξεις, πιστευόταν ότι για να επιταχύνουν την τεχνολογία βαθιάς μάθησης, απαιτείτο η χρήση этого εξειδικευμένου υλικού επιτάχυνσης.

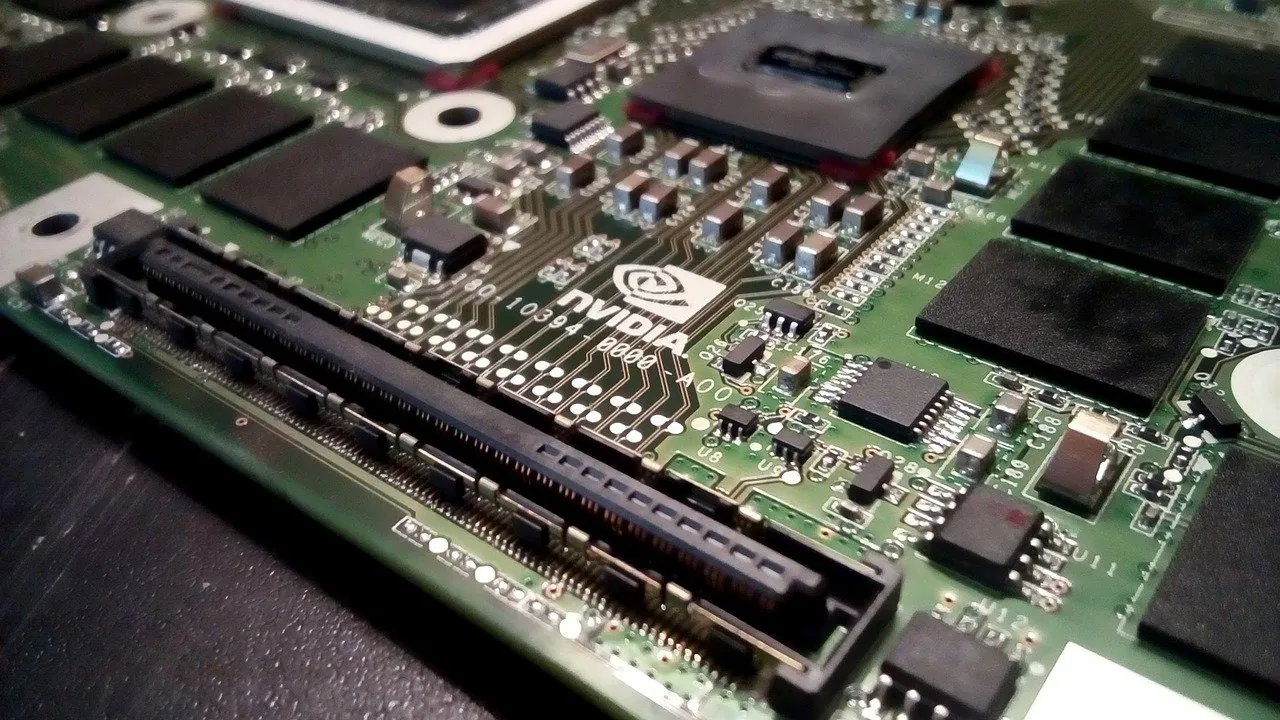

Πολυάριθμες εταιρείες έχουν δώσει μεγάλη σημασία στην επένδυση σε GPUs και εξειδικευμένο υλικό για βαθιά μάθηση, το οποίο είναι υπεύθυνο για τεχνολογία όπως ψηφιακοί βοηθοί, αναγνώριση προσώπου και συστήματα σύστασης προϊόντων. Μια τέτοια εταιρεία είναι η Nvidia, η οποία δημιουργεί τις Tesla V100 Tensor Core GPUs. Η Nvidia αναφέρθηκε πρόσφατα μια αύξηση 41% στα έσοδα του τέταρτου τριμήνου σε σύγκριση με πέρυσι.

Η ανάπτυξη του SLIDE ανοίγει εντελώς νέες δυνατότητες.

Ο Anshumali Shrivastava είναι βοηθός καθηγητής στη Σχολή Μηχανικής Brown του Rice και βοήθησε να εφευρεθεί ο SLIDE με τους μεταπτυχιακούς φοιτητές Beidi Chen και Tharun Medini.

“Οι δοκιμές μας δείχνουν ότι ο SLIDE είναι η πρώτη έξυπνη αλγοριθμική υλοποίηση βαθιάς μάθησης σε CPU που μπορεί να υπερβεί την επιτάχυνση υλικού GPU σε βιομηχανικής κλίμακας συνόλου δεδομένων συστάσεων με μεγάλες πλήρως συνδεδεμένες αρχιτεκτονικές”, είπε ο Shrivastava.

Ο SLIDE ξεπερνά την πρόκληση των GPUs λόγω της εντελώς διαφορετικής προσέγγισής του στην βαθιά μάθηση. Η τρέχουσα τυπική τεχνική εκπαίδευσης για βαθιά νευρωνικά δίκτυα είναι η “πίσω διάδοση” και απαιτεί πολλαπλασιασμό πινάκων. Αυτό το φορτίο εργασίας απαιτεί τη χρήση GPUs, οπότε οι ερευνητές άλλαξαν την εκπαίδευση του νευρωνικού δικτύου ώστε να μπορεί να επιλυθεί με πίνακες κατακερματισμού.

Αυτή η νέα προσέγγιση μειώνει σημαντικά το υπολογιστικό φορτίο για τον SLIDE. Η τρέχουσα καλύτερη πλατφόρμα GPU που χρησιμοποιούν εταιρείες όπως η Amazon και η Google για cloud-based βαθιά μάθηση έχει οκτώ Tesla V100s και η ετικέτα τιμής είναι γύρω στα 100.000 δολάρια.

“Έχουμε ένα στο εργαστήριο και στην περίπτωση δοκιμής μας πήραμε ένα φορτίο εργασίας που είναι ιδανικό για V100, ένα με περισσότερα από 100 εκατομμύρια παραμέτρους σε μεγάλες, πλήρως συνδεδεμένες δικτύωση που ταιριάζει στη μνήμη GPU”, είπε ο Shrivastava. “Εκπαιδεύσαμε το με το καλύτερο (λογισμικό) πακέτο εκεί έξω, το TensorFlow της Google, και χρειάστηκε 3 1/2 ώρες για την εκπαίδευση.

“Στη συνέχεια δείξαμε ότι ο νέος αλγόριθμος μας μπορεί να κάνει την εκπαίδευση σε μια ώρα, όχι σε GPUs αλλά σε einen 44-πυρήνα Xeon-κλάσης CPU”, συνέχισε.

Ο κατακερματισμός είναι ένας τύπος μεθόδου ευρετηρίου δεδομένων που εφευρέθηκε τη δεκαετία του 1990 για την αναζήτηση στο διαδίκτυο. Χρησιμοποιούνται αριθμητικές μεθόδους για να κωδικοποιήσουν μεγάλες ποσότητες πληροφοριών ως eine σειρά ψηφίων, η οποία ονομάζεται κατακερματισμός. Οι κατακερματισμοί καταγράφονται για να δημιουργήσουν πίνακες που μπορούν να αναζητηθούν γρήγορα.

“Θα ήταν αδιανόητο να υλοποιήσουμε τον αλγόριθμο μας στο TensorFlow ή PyTorch γιατί το πρώτο που θέλουν να κάνουν είναι να μετατρέψουν ό,τι κάνετε σε πρόβλημα πολλαπλασιασμού πίνακα”, είπε ο Chen. “Αυτό είναι ακριβώς αυτό που θέλαμε να αποφύγουμε. Έτσι, γράψαμε τον δικό μας κώδικα C++ από την αρχή.”

Σύμφωνα με τον Shrivastava, το μεγαλύτερο πλεονέκτημα του SLIDE είναι ότι είναι παράλληλος δεδομένων.

“Με παράλληλο δεδομένων εννοώ ότι αν έχω δύο περιπτώσεις δεδομένων που θέλω να εκπαιδεύσω, π.χ. μια είναι μια εικόνα μιας γάτας και η άλλη ενός λεωφορείου, θα ενεργοποιήσουν πιθανώς διαφορετικά νευρώνες και ο SLIDE μπορεί να ενημερώσει ή να εκπαιδεύσει αυτά τα δύο ανεξάρτητα”, είπε. “Αυτό είναι πολύ καλύτερη αξιοποίηση του παραλληλισμού για τους CPUs”.

“Η ανάστροφη πλευρά, σε σύγκριση με το GPU, είναι ότι απαιτούμε μια μεγάλη μνήμη”, είπε. “Υπάρχει μια ιεραρχία cache στη κύρια μνήμη και αν δεν είμαστε προσεκτικοί με αυτήν, μπορούμε να πέσουμε σε ένα πρόβλημα που ονομάζεται cache thrashing, όπου παίρνουμε πολλά cache misses.”

Ο SLIDE έχει ανοίξει την πόρτα για νέους τρόπους υλοποίησης βαθιάς μάθησης και ο Shrivastava πιστεύει ότι είναι μόνο η αρχή.

“Μόλις έχουμε σκάψει την επιφάνεια”, είπε. “Υπάρχει πολύ που ακόμα μπορούμε να κάνουμε για να βελτιώσουμε. Δεν έχουμε χρησιμοποιήσει διανυσματισμό, για παράδειγμα, ή ενσωματωμένα επιταχυντές στο CPU, όπως η Intel Deep Learning Boost. Υπάρχουν πολλά άλλα κόλπα που ακόμα μπορούμε να χρησιμοποιήσουμε για να το κάνουμε ακόμα πιο γρήγορο.”