Künstliche Intelligenz

RigNeRF: Eine neue Deepfakes-Methode, die neuronale Radiance-Felder verwendet

Neue Forschung, die bei Adobe entwickelt wurde, bietet die erste praktikable und effektive Deepfakes-Methode auf Basis von Neuralen Radiance-Feldern (NeRF) – vielleicht die erste echte Innovation in Architektur oder Ansatz seit dem Auftauchen von Deepfakes im Jahr 2017.

Die Methode, die RigNeRF genannt wird, verwendet 3D-morphable Gesichtsmodelle (3DMMs) als Zwischenlayer der Instrumentalität zwischen der gewünschten Eingabe (d. h. der Identität, die in die NeRF-Darstellung eingefügt werden soll) und dem neuronalen Raum, einer Methode, die in den letzten Jahren weit verbreitet von Generative Adversarial Network (GAN)-Gesichtssynthese-Ansätzen verwendet wurde, von denen jedoch keine funktionalen und nützlichen Gesichtsersatz-Frameworks für Videos produziert haben.

Im Gegensatz zu herkömmlichen Deepfake-Videos ist keiner der bewegten Inhalte hier ‘echt’, sondern vielmehr ein erforschbares neuronales Feld, das auf kurzen Aufnahmen trainiert wurde. Auf der rechten Seite sehen wir das 3D-morphable Gesichtsmodell (3DMM) als Schnittstelle zwischen den gewünschten Manipulationen (‘Lächeln’, ‘nach links schauen’, ‘nach oben schauen’ usw.) und den üblicherweise unzugänglichen Parametern einer NeRF-Visualisierung. Für eine hochauflösende Version dieses Clips sowie weitere Beispiele siehe die Projektseite, oder die eingebetteten Videos am Ende des Artikels. Quelle: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs sind im Wesentlichen CGI-Modelle von Gesichtern, deren Parameter an abstraktere Bildsynthesesysteme wie NeRF und GAN angepasst werden können, die ansonsten schwierig zu kontrollieren sind.

Was Sie in dem Bild oben (Mittleres Bild, Mann im blauen Hemd) sowie in dem Bild direkt darunter (linkes Bild, Mann im blauen Hemd) sehen, ist kein ‘echtes’ Video, in das ein kleiner Teil ‘falschen’ Gesichts eingefügt wurde, sondern eine vollständig synthetisierte Szene, die ausschließlich als volumetrische neuronale Darstellung existiert – einschließlich Körper und Hintergrund:

Im Beispiel direkt oben wird das reale Video auf der rechten Seite (Frau im roten Kleid) verwendet, um die erfasste Identität (Mann im blauen Hemd) auf der linken Seite via RigNeRF zu ‘steuern’, was (wie die Autoren behaupten) das erste NeRF-basierte System ist, das eine Trennung von Pose und Ausdruck erreicht und gleichzeitig in der Lage ist, neue Ansichten zu synthetisieren.

Die männliche Figur auf der linken Seite im Bild oben wurde aus einem 70-Sekunden-Smartphone-Video ‘erfasst’, und die Eingabedaten (einschließlich der gesamten Szeneinformation) wurden anschließend auf 4 V100-GPUs trainiert, um die Szene zu erhalten.

Da 3DMM-Style-Parameterrigging auch als gesamtkörper-Parameterrigging (und nicht nur als Gesichtsrigging) verfügbar sind, öffnet RigNeRF möglicherweise die Möglichkeit für Full-Body-Deepfakes, bei denen reale menschliche Bewegung, Textur und Ausdruck an die CGI-basierte Parameterrigging übergeben werden, die dann Aktion und Ausdruck in gerenderte NeRF-Umgebungen und -Videos übersetzen würde.

Was RigNeRF betrifft – qualifiziert es sich als Deepfake-Methode im aktuellen Sinne, in dem die Schlagzeilen den Begriff verstehen? Oder ist es nur ein weiterer, halbherziger Nachzügler zu DeepFaceLab und anderen arbeitsintensiven, 2017-Ära-Autoencoder-Deepfake-Systemen?

Die Forscher des neuen Artikels sind in diesem Punkt unmissverständlich:

‘Als Methode, die in der Lage ist, Gesichter zu reanimieren, ist RigNeRF anfällig für Missbrauch durch böswillige Akteure, um Deepfakes zu generieren.’

Der neue Artikel trägt den Titel RigNeRF: Vollständig steuerbare neuronale 3D-Porträts und stammt von ShahRukh Atha von der Stonybrook University, einem Praktikanten bei Adobe während der Entwicklung von RigNeRF, und vier weiteren Autoren von Adobe Research.

Jenseits von Autoencoder-basierten Deepfakes

Die Mehrheit der viralen Deepfakes, die in den letzten Jahren Schlagzeilen gemacht haben, werden von Autoencoder-basierten Systemen produziert, die von dem Code abgeleitet sind, der 2017 auf dem prompt-gelöschten r/deepfakes-Subreddit veröffentlicht wurde – bevor er jedoch nach GitHub kopiert wurde, wo er derzeit über tausend Mal forked wurde, nicht zuletzt in die beliebte (wenn auch umstrittene) DeepFaceLab-Distribution und auch das FaceSwap-Projekt.

Neben GAN und NeRF haben Autoencoder-Frameworks auch mit 3DMMs als ‘Richtlinien’ für verbesserte Gesichtssynthese-Frameworks experimentiert. Ein Beispiel dafür ist das HifiFace-Projekt aus Juli 2021. Es scheint jedoch, dass keine verwendbaren oder beliebten Initiativen aus diesem Ansatz entwickelt wurden.

Daten für RigNeRF-Szenen werden durch das Aufnehmen kurzer Smartphone-Videos erfasst. Für das Projekt verwendeten RigNeRFs Forscher ein iPhone XR oder ein iPhone 12 für alle Experimente. Für die erste Hälfte der Aufnahme wird der Testteilnehmer aufgefordert, eine breite Palette von Gesichtsausdrücken und Sprache zu zeigen, während er den Kopf still hält, während die Kamera um ihn herum bewegt wird.

Für die zweite Hälfte der Aufnahme hält die Kamera eine feste Position ein, während der Testteilnehmer den Kopf umherbewegen muss, während er eine breite Palette von Ausdrücken zeigt. Die resultierenden 40-70 Sekunden Footage (rund 1200-2100 Frames) stellen die gesamten Daten dar, die zum Trainieren des Modells verwendet werden.

Reduzierung der Datenerfassung

Im Gegensatz dazu erfordern Autoencoder-Systeme wie DeepFaceLab das relativ mühsame Sammeln und Kuratieren von Tausenden von vielfältigen Fotos, oft von YouTube-Videos und anderen sozialen Medienkanälen sowie aus Filmen (im Falle von Celebrity-Deepfakes).

Die resultierenden trainierten Autoencoder-Modelle sind oft dazu gedacht, in einer Vielzahl von Situationen verwendet zu werden. Die meisten ‘celebrity’-Deepfakers trainieren jedoch ganze Modelle von Grund auf für ein einzelnes Video, obwohl das Training eine Woche oder mehr dauern kann.

Trotz der Warnung der Forscher des neuen Artikels scheinen die ‘Flickwerk’- und breit zusammengestellten Datensätze, die AI-Pornos sowie beliebte YouTube/TikTok-‘Deepfake-Neuverfilmungen’ antreiben, unwahrscheinlich, akzeptable und konsistente Ergebnisse in einem Deepfake-System wie RigNeRF zu produzieren, das eine szene-spezifische Methodik hat. Angesichts der Einschränkungen bei der Datenerfassung, die in der neuen Arbeit beschrieben werden, könnte dies zu einem gewissen Grad ein zusätzlicher Schutz vor der missbräuchlichen Aneignung von Identitäten durch böswillige Deepfaker sein.

Anpassung von NeRF an Deepfake-Videos

NeRF ist eine photogrammetrie-basierte Methode, bei der eine kleine Anzahl von Quellbildern, die aus verschiedenen Perspektiven aufgenommen werden, in einen erforschbaren 3D-neuronalen Raum zusammengesetzt werden. Dieser Ansatz gewann Anfang dieses Jahres an Bedeutung, als NVIDIA sein Instant-NeRF-System vorstellte, das in der Lage ist, die exorbitanten Trainingszeiten für NeRF auf Minuten oder sogar Sekunden zu reduzieren:

Instant NeRF. Quelle: https://www.youtube.com/watch?v=DJ2hcC1orc4

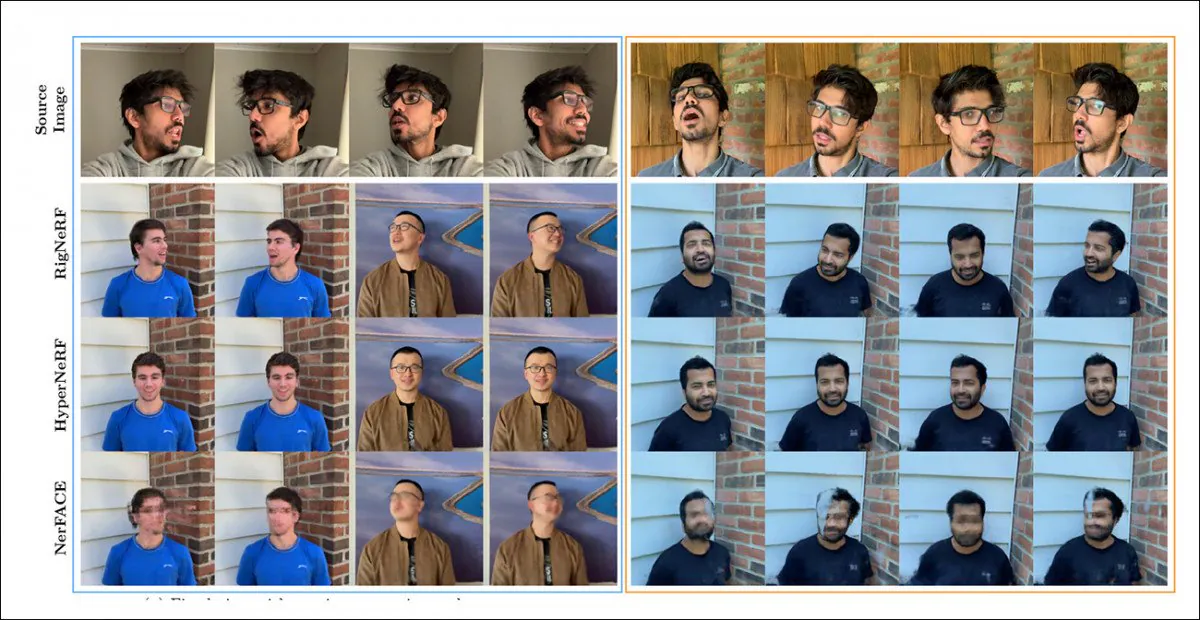

Das resultierende NeRF-Szenenbild ist im Wesentlichen eine statische Umgebung, die erforscht werden kann, aber die schwierig zu bearbeiten ist. Die Forscher bemerken, dass zwei vorherige NeRF-basierte Initiativen – HyperNeRF + E/P und NerFACE – einen Versuch unternommen haben, Gesichtsvideosynthese zu erreichen, und (offensichtlich zur Vollständigkeit und Gewissenhaftigkeit) haben RigNeRF gegen diese beiden Frameworks in einer Testrunde antreten lassen:

Ein qualitativer Vergleich zwischen RigNeRF, HyperNeRF und NerFACE. Siehe die verlinkten Quellvideos und PDF für höher auflösende Versionen. Quelle: https://arxiv.org/pdf/2012.03065.pdf

Jedoch sind die Ergebnisse, die RigNeRF begünstigen, ziemlich anomal, aus zwei Gründen: Erstens bemerken die Autoren, dass ‘es keine existingen Arbeit für einen apfel-zu-apfel-Vergleich gibt’; zweitens hat dies die Einschränkung der Fähigkeiten von RigNeRF erfordert, um zumindest teilweise mit der eingeschränkteren Funktionalität der vorherigen Systeme zu übereinstimmen.

Da die Ergebnisse keine inkrementelle Verbesserung der vorherigen Arbeiten darstellen, sondern vielmehr einen ‘Durchbruch’ in der Bearbeitbarkeit und Nützlichkeit von NeRF darstellen, werden wir die Testrunde beiseite lassen und stattdessen sehen, was RigNeRF anders macht als seine Vorgänger.

Kombination von Stärken

Die primäre Einschränkung von NerFACE, die Pose-/Ausdruckssteuerung in einer NeRF-Umgebung erstellen kann, besteht darin, dass sie annimmt, dass die Quellbilder mit einer statischen Kamera aufgenommen werden. Dies bedeutet im Wesentlichen, dass sie keine neuen Ansichten produzieren kann, die über die Erfassungseinschränkungen hinausgehen. Dies ergibt ein System, das ‘bewegte Porträts’ erstellen kann, aber für Deepfake-Style-Videos nicht geeignet ist.

HyperNeRF hingegen kann zwar neue und hyper-realistische Ansichten generieren, hat jedoch keine Instrumentalität, die es ermöglicht, Kopfhaltungen oder Gesichtsausdrücke zu ändern, was wiederum nicht zu einem Konkurrenten für Autoencoder-basierte Deepfakes führt.

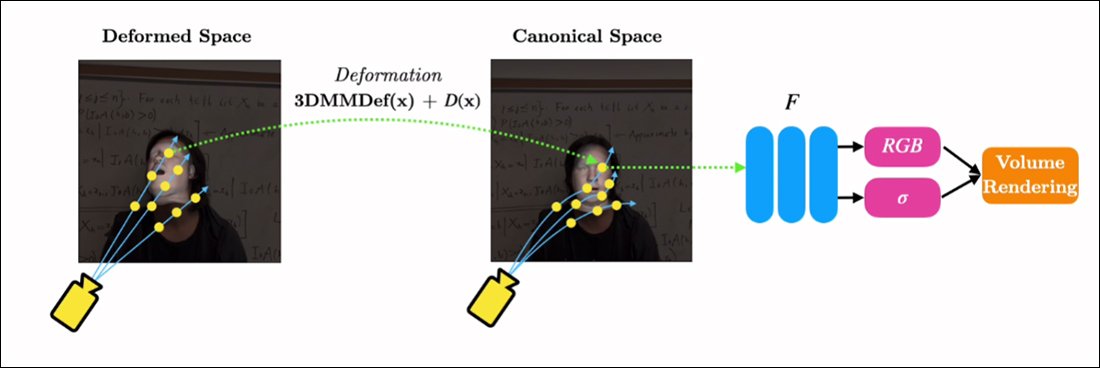

RigNeRF kann diese beiden isolierten Funktionalitäten kombinieren, indem es einen ‘kanonischen Raum’ erstellt, eine Standardbasis, von der aus Abweichungen und Deformationen durch Eingaben vom 3DMM-Modul vorgenommen werden können.

Erstellung eines ‘kanonischen Raums’ (keine Pose, kein Ausdruck), auf dem die Deformationen (d. h. Posen und Ausdrücke) produziert durch das 3DMM wirken können.

Da das 3DMM-System nicht genau mit dem erfassten Testteilnehmer übereinstimmen wird, ist es wichtig, dies im Prozess zu kompensieren. RigNeRF erreicht dies durch ein Deformationsfeld-Prior, das aus einem Multilayer-Perceptron (MLP) abgeleitet wird, das aus den Quellbildern stammt.

Die Kameraparameter, die notwendig sind, um Deformationen zu berechnen, werden über COLMAP ermittelt, während die Ausdrucks- und Formparameter für jeden Frame aus DECA stammen.

Die Positionierung wird weiter durch Landmark-Fitting und COLMAPs Kameraparameter optimiert, und aufgrund von Einschränkungen der Rechenressourcen wird die Videoausgabe auf 256×256-Auflösung für das Training heruntergestuft (ein hardware-begrenzter Schrumpfprozess, der auch die Autoencoder-Deepfake-Szene plagt).

Nach diesem Prozess wird das Deformationsnetz auf den vier V100s trainiert – leistungsstarke Hardware, die wahrscheinlich nicht im Bereich von Casual-Enthusiasten liegt (jedoch ist es in der maschinellen Lernausbildung oft möglich, Leistung gegen Zeit zu tauschen und einfach anzunehmen, dass das Modelltraining eine Frage von Tagen oder sogar Wochen sein wird).