Kunstig intelligens

Supercharging Graph Neural Networks med Large Language Models: Den Ultimative Guide

Grapher er datastrukturer, der repræsenterer komplekse relationer på tværs af en bred vifte af domæner, herunder sociale netværk, videnbasier, biologiske systemer og mange flere. I disse grapher repræsenteres enheder som noder, og deres relationer afbildes som kanter.

Evnen til effektivt at repræsentere og resonere om disse intrikate relationelle strukturer er afgørende for at muliggøre fremskridt inden for områder som netværksvidenskab, kemioinformatik og anbefalingssystemer.

Graph Neural Networks (GNNs) er fremkommet som en kraftfuld dyb læring ramme for graph maskinlæringsopgaver. Ved at inkorporere graf topologien i neuralt netværksarkitekturen gennem naboaggregering eller grafkonvolutioner, kan GNNs lære lavdimensionale vektorrepræsentationer, der koder både nodens funktioner og deres strukturelle roller. Dette giver GNNs mulighed for at opnå state-of-the-art præstationer på opgaver som nodklassificering, linkprædiktion og grafklassificering på tværs af diverse anvendelsesområder.

Selvom GNNs har drevet betydelige fremskridt, er der stadig nogle nøgleudfordringer. At opnå højkvalitetsmærkede data til træning af overvågede GNN-modeller kan være dyrt og tidskrævende. Derudover kan GNNs have svært ved at håndtere heterogene grafstrukturer og situationer, hvor graf fordelt på testtidspunktet afviger væsentligt fra træningsdataene (ud af distributionsgeneralisering).

I mellemtiden har Large Language Models (LLMs) som GPT-4 og LLaMA taget verden med storm med deres utrolige naturlige sprogforståelse og generationskapaciteter. Trænet på massive tekstkorpusser med milliarder af parametre, viser LLMs bemærkelsesværdige few-shot læringsfærdigheder, generalisering på tværs af opgaver og fællesfornuftsskaber, der tidligere blev anset for at være ekstremt udfordrende for AI-systemer.

Den enorme succes med LLMs har katalyseret udforskninger i at udnytte deres kraft til graph maskinlæringsopgaver. På den ene side præsenterer LLMs’ viden og resonanskapaciteter muligheder for at forbedre traditionelle GNN-modeller. Omvendt kunne de strukturerede repræsentationer og faktuelle kundskaber, der er indbygget i grapher, være afgørende for at løse nogle af LLMs’ nøglebegrænsninger, såsom hallucinationer og mangel på fortolkning.

Graph Neural Networks og Selv-Superviseret Læring

For at give den nødvendige kontekst vil vi først kort gennemgå de centrale begreber og metoder i graph neural networks og selv-superviseret grafrepræsentationslæring.

Graph Neural Network Arkitekturer

Graph Neural Network Arkitektur – kilde

Den væsentlige forskel mellem traditionelle dybe neurale netværk og GNNs ligger i deres evne til at operere direkte på grafstruktureret data. GNNs følger en naboaggregeringsskema, hvor hver node aggregerer funktionvektorer fra sine naboer for at beregne sin egen repræsentation.

Mange GNN-arkitekturer er blevet foreslået med forskellige instantieringer af meddelelses- og opdateringsfunktioner, såsom Graph Convolutional Networks (GCNs), GraphSAGE, Graph Attention Networks (GATs) og Graph Isomorphism Networks (GINs) blandt andre.

Mere nyligt har graftransformatorer vundet popularitet ved at tilpasse selv-opmærksomhedsmechanismen fra naturlige sprogtransformatorer til at operere på grafstruktureret data. Nogle eksempler omfatter GraphormerTransformer og GraphFormers. Disse modeller kan fange langdistanceafhængigheder på tværs af grafen bedre end ren nabo-baserede GNNs.

Selv-Superviseret Læring på Grafer

Selvom GNNs er kraftfulde repræsentationsmodeller, er deres præstation ofte begrænset af mangel på store mærkede datasæt, der kræves til overvåget træning. Selv-superviseret læring er fremkommet som en lovende paradigm for at fortræne GNNs på umærkede grafdata ved at udnytte pretext-opgaver, der kun kræver den intrinsiske grafstruktur og nodefunktioner.

Selv-Superviseret Graf – kilde

Nogle almindelige pretext-opgaver, der bruges til selv-superviseret GNN-fortræning, omfatter:

- Node Egenskabsprædiktion: Tilfældigt maskering eller korruption af en del af nodeattributterne/funktionerne og opgaven til GNN at genskabe dem.

- Kant/Link Prædiktion: Læring til at prædiktere, om en kant eksisterer mellem et par noder, ofte baseret på tilfældig kantmaskering.

- Kontrastiv Læring: Maksimering af ligheder mellem grafvisninger af samme grafprøve, mens man skyder visninger fra forskellige grafer fra hinanden.

- Mutual Information Maximisering: Maksimering af den mutual information mellem lokale node-repræsentationer og en målrepræsentation som den globale graf-embedding.

Pretext-opgaver som disse giver GNN mulighed for at trække meningfulde strukturelle og semantiske mønstre fra de umærkede grafdata under fortræning. Den fortrænede GNN kan derefter finjusteres på relativt små mærkede undermængder for at udføre forskellige nedstrømsopgaver som nodeklassificering, linkprædiktion og grafklassificering.

Ved at udnytte selv-supervision viser GNNs, der er fortrænet på store umærkede datasæt, bedre generalisering, robusthed over for distributionsforskydninger og effektivitet i forhold til træning fra scratch. Dog er der stadig nogle nøglebegrænsninger for traditionelle GNN-baserede selv-superviserede metoder, som vi vil udforske ved at udnytte LLMs til at løse næste.

Forbedring af Graph ML med Large Language Models

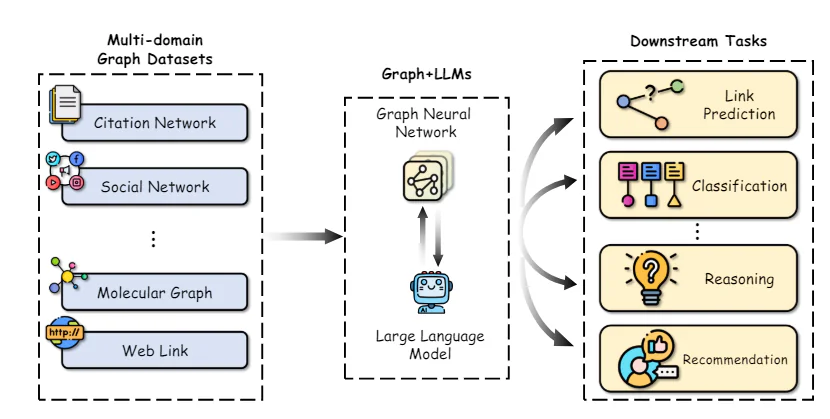

Integration af Grafer og LLM – kilde

De bemærkelsesværdige kapaciteter af LLMs i forståelse af naturligt sprog, resonans og few-shot læring præsenterer muligheder for at forbedre flere aspekter af grafmaskinlæringspipeliner. Vi udforsker nogle nøgleforskningsretninger i dette område:

En nøgleudfordring i anvendelse af GNNs er at opnå højkvalitetsfunktionrepræsentationer for noder og kanter, især når de indeholder rige tekstattributter som beskrivelser, titler eller abstracts. Traditionelt er simple bag-of-words eller fortrænede ord-embedding-modeller blevet brugt, som ofte ikke kan fange de nuancerede semantikker.

Seneste arbejder har demonstreret kraften af at udnytte store sprogmodeller som tekst-encodere til at konstruere bedre node/kant-funktionrepræsentationer, før de sendes til GNN. For eksempel Chen et al. udnytter LLMs som GPT-3 til at kodificere tekstuelle nodeattributter, viser betydelige præstationsforbedringer over traditionelle ord-embeddings på nodeklassificeringsopgaver.

Ud over bedre tekst-encodere kan LLMs bruges til at generere supplerende information fra de oprindelige tekstattributter på en semi-superviseret måde. TAPE genererer potentielle mærker/forklaringer for noder ved hjælp af en LLM og bruger disse som supplerende funktioner. KEA trækker termer fra tekstattributter ved hjælp af en LLM og opnår detaljerede beskrivelser for disse termer for at supplerer funktioner.

Ved at forbedre kvaliteten og udtrykskraften af indgangsfunktioner kan LLMs overføre deres overlegne naturlige sprogforståelseskvaliteter til GNNs, hvilket forbedrer præstationen på nedstrømsopgaver.