Tankeledere

Hvad hver datavidenskabsmand bør vide om Graph Transformers og deres indvirkning på struktureret data

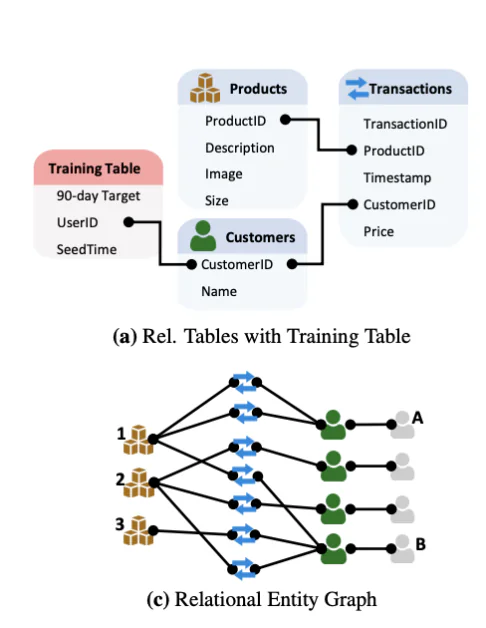

Jeg var med til at skabe Graph Neural Networks, mens jeg var på Stanford. Jeg erkendte tidligt, at denne teknologi var utrolig kraftfuld. Hvert datapunkt, hver observation, hver viden ikke eksisterer i isolation; det er en del af et graf, der er forbundet med andre viden. Vigtigt er, at de fleste værdifulde forretningsdata, ofte gemt som tabeller i databases og data Lager, kan naturligt repræsenteres som et graf. At udnytte denne relationelle struktur er nøgle til at bygge præcise og ikke-hallucinerende AI-modeller.

Graph neurale netværk (GNNs) introducerede message-passing-arkitekturer, der kunne resonere over grafer og fange forbindelser mellem viden. Men ligesom Transformers forvandlede sprogforståelse, er en ny klasse af modeller, Graph Transformers, med til at bringe lignende gevinster til graf-baseret data. Disse modeller kombinerer fleksibiliteten af attention-mekanismer med strukturelle graf-priorer for at modelere komplekse relationer mere effektivt end deres GNN-forgængere.

Hvorfor grafer kræver mere end message-passing

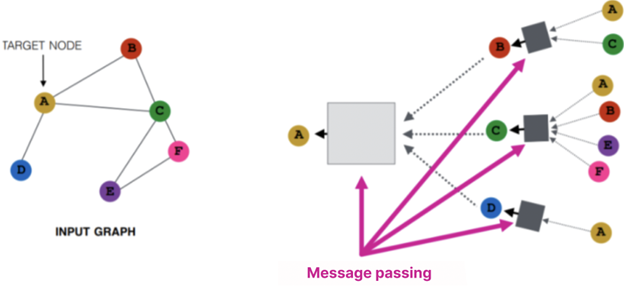

Traditionelle graph neurale netværk (GNNs) afhænger af message-passing, en proces, hvor hver node opdaterer sin interne tilstand ved at aggregere information fra sine naboer. Tænk på det som hver node udveksler sammenfatninger med nærliggende noder, derefter bruger disse sammenfatninger til at forfine sin egen forståelse. Over flere lag ermögiller dette, at information kan propageres gennem grafen.

Men message-passing har vigtige begrænsninger:

- Over-squashing: Da information agregieres over mange hop, kan den blive komprimeret og miste meningsfulde detaljer. Dette er især problematisk i dybe GNNs.

- Begrænset kontekst: Standard message-passing kan ikke let fange lange afhængigheder uden mange lag, hvilket øger kompleksiteten og støjen.

- Udtryksfuldhed: Mange grafstrukturer kan ikke differentieres ved kun at bruge lokal nabo-information, hvilket begrænser modelpræstationen på opgaver, der kræver fine strukturelle distinktioner.

Det er her, Graph Transformers kommer ind. Ved at erstatte eller supplere message-passing med attention-mekanismer ermögiller de, at hver node kan direkte lytte til andre (selv fjerne) baseret på lært vigtighed. Resultatet er rigere repræsentationer, bedre skalerbarhed og evnen til at resonere over komplekse strukturer mere fleksibelt.

Fra GNNs til Graph Transformers

Den originale Transformer-model, introduceret i den ikoniske artikel, Attention Is All You Need, var designed til at modelere relationer mellem tokens i en sekvens. Dens succes ligger i self-attention, en mekanisme, der ermögiller, at hver input kan overveje hver anden input, vægtet af lært relevans.

Graph Transformers adapterer dette paradigme ved at ermögille, at noder kan lytte ikke kun til deres naboer, men til enhver node i grafen, enten gennem fuldt forbundet attention eller en hybrid-tilgang, der balancerer globale og lokale signaler. Udfordringen er at introducere en notion af struktur i en model, der er designed til ustrukturerede sekvenser.

Graf-specifikke positionelle kodninger

I modsætning til tekst har grafer ingen indbygget rækkefølge, hvilket gør positionelle kodninger, der refererer til teknikker for at injicere strukturel eller lokalitetsbaseret information i en model, ikke-trivielle. Graph Transformers tackler dette med forskellige metoder:

- Laplacian-eigenvectors: Afledt fra graf-Laplacian-matrixen, giver disse en spektral indlejring, der fanger global struktur.

- Random Walks: Fanger sandsynligheden for at gå fra en node til en anden over flere hop.

- Strukturelle kodninger: Inkluderer afstandsmalinger, node-grader eller kant-typer.

Disse positionelle kodninger, enten spektrale, sandsynlige eller strukturelle, giver Graph Transformers en måde at forstå, hvor hver node befinder sig i den bredere graf. Denne strukturelle bevidsthed er afgørende for at ermögille attention-mekanismerne til at operere meningsfuldt på uregelmæssige, uordnede data, og tillader modellen at fange relationer, der ville være usynlige for enklere, rent lokale metoder.

Reale implementeringer og brugsområder

At bringe Graph Transformers i produktion kræver infrastruktur, der kan skaleres til reale datasæt. Biblioteker som PyTorch Geometric (PyG) gør det muligt. Bygget på PyTorch, giver PyG en modulær ramme for at implementere GNNs og Graph Transformers på tværs af en række anvendelser, fra molekylemodellering til anbefalingssystemer. Det understøtter mini-batch-træning på både mange små grafer og enkelt store grafer, med multi-GPU og torch.compile-understøttelse, hvilket gør det velegnet til både forskning og virksomhedsarbejde.

Disse værktøjer er allerede med til at drive en bred vifte af reelle anvendelser. I lægemiddelforskning hjælper Graph Transformers med at forudsige molekylægenskaber ved at modelere atomiske interaktioner som grafer. I logistik og forsyningskædeoptimering kan de repræsentere og resonere over dynamiske netværk af forsendelser, lagerhuse og ruter. E-handelsvirksomheder bruger dem til at forbedre anbefalinger ved at forstå produkt-sammenkøbs- og browseadfærd som relationelle grafer. Og i cybersikkerhed bruges graf-baserede modeller til at detektere anomalier ved at analysere adgangsmønstre, netværkstopologi og begivenhedssekvenser.

I hver af disse sammenhænge er evnen til at lære fra komplekse, forbundne strukturer, uden at afhænge af håndbyggede funktioner, ved at vise sig at være en stor fordel.

Tekniske overvejelser

Trods deres potentiale kommer Graph Transformers med reelle ingeniør-mæssige kompromiser. Fuldt self-attention skalerer kvadratisk med antallet af noder, hvilket gør hukommelse og beregnings-effektivitet til en top-bekymring, især for store eller tætte grafer. Mange reelle grafer har også rettede kanter, hvilket introducerer asymmetrier, der komplicerer, hvordan strukturel information kodificeres. Og i praktiske installationer er input sjældent uniform: kombination af graf-struktureret data med tekst, tidsserier eller billeder kræver omhyggelige arkitekturvalg og robust dataforarbejdning.

Disse udfordringer er ikke uovervindelige, men de kræver omhyggelig systemdesign, især når man går fra forskningsprototyper til produktionsklare modeller.

Hvad kommer næste: LLMs møder grafer

En vigtig forskningsretning er integrationen af store sprogmodeller (LLMs) med grafstrukturer. Disse hybrid-systemer bruger LLMs til at kodificere tekstkontekst eller trække entiteter, derefter grundlægge denne information i en graf til resonering og beslutningstagning.

I biologi har dette aktiveret værktøjer som AlphaFold. I virksomheds-AI ermögiller det kundesupportsystemer, der kombinerer dokumentation og adfærdsgrafer. Graph Transformers spiller også en voksende rolle i at ermögille AI-agenter til at træffe smartere, mere handlebare beslutninger ved at låte dem resonere over strukturerede tilstandsrepræsentationer og prioritere interaktioner dynamisk. Denne fusion hjælper agenterne med at forstå hierarkiske relationer, spore afhængigheder over tid og tilpasse deres adfærd i komplekse miljøer.

Området er stadig under udvikling, men potentialet er betydeligt.

Konklusion

Graph Transformers er ikke bare den næste iteration af GNNs; de repræsenterer en konvergens af attention, struktur og skalerbarhed. Uanset om du arbejder i finans, livsvidenskab eller anbefalingssystemer, er beskeden klar: din data danner en graf, så dine modeller skal også gøre det.