Kunstig intelligens

RigNeRF: En ny deepfakes-metode, der bruger Neural Radiance Fields

Ny forskning udviklet hos Adobe tilbyder den første livskraftige og effektive deepfakes-metode baseret på Neural Radiance Fields (NeRF) – måske den første rigtige innovation i arkitektur eller tilgang i de fem år siden deepfakes opstod i 2017.

Metoden, der hedder RigNeRF, bruger 3D-morphable ansigtsmodeller (3DMMs) som et mellemled mellem det ønskede input (dvs. identiteten, der skal indsættes i NeRF-renderingen) og neurale rum, en metode, der er vidt udbredt i de seneste år af Generative Adversarial Network (GAN) ansigts-syntese-tilgange, ingen af dem har endnu produceret funktionelle og nyttige ansigts-erstatnings-rammer for video.

Ulig traditionelle deepfake-videoer, er absolut ingen af den bevægelige indhold afbilledet her ‘rigtig’, men snarere et udforskeligt neuralt rum, der er trænet på kort optagelse. På højre side ser vi 3D-morphable ansigtsmodellen (3DMM) fungere som en grænseflade mellem de ønskede manipulationer (‘smil’, ‘kig til venstre’, ‘kig op’, osv.) og de normalt utilgængelige parametre for en Neural Radiance Field-visualisering. For en højopløselig version af denne klip, samt andre eksempler, se projekt-siden, eller de indlejrede videoer i slutningen af denne artikel. Kilde: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs er effektivt CGI-modeller af ansigter, hvis parametre kan tilpasses mere abstrakte billed-syntese-systemer, såsom NeRF og GAN, som ellers er svære at kontrollere.

Hvad du ser i billedet ovenfor (midterbillede, mand i blå skjorte), samt billedet lige under (venstre billede, mand i blå skjorte), er ikke en ‘rigtig’ video, hvor en lille del ‘falsk’ ansigt er indsættet, men en helt syntetiseret scene, der kun eksisterer som et volumetrisk neuralt render – herunder kroppen og baggrunden:

I eksemplet lige ovenfor, bruges den rigtige video på højre side (kvinde i rød kjole) til at ‘styre’ den fangete identitet (mand i blå skjorte) på venstre side via RigNeRF, som (forfatterne hævder) er det første NeRF-baserede system, der opnår adskillelse af pose og udtryk, samtidig med at det kan udføre nye syn- syntese.

Den mandlige figur på venstre side i billedet ovenfor blev ‘fanget’ fra en 70-sekunders smartphone-video, og input-dataen (herunder hele scenens information) trænet herefter over 4 V100 GPU’er for at opnå scenen.

Da 3DMM-stile parametrisk rigging også er tilgængelig som hele-kroppen parametrisk CGI-proxies (og ikke kun ansigts-rigging), åbner RigNeRF muligheden for fuld-kropp deepfakes, hvor rigtig menneskelig bevægelse, tekstur og udtryk overføres til den CGI-baserede parametrisk lag, der herefter oversætter handling og udtryk til renderet NeRF-miljøer og videoer.

Som for RigNeRF – kvalificerer det som en deepfakes-metode i den nuværende forstand, som overskrifterne forstår begrebet? Eller er det bare endnu en semi-handicappet også-ran til DeepFaceLab og andre arbejdskrævende, 2017-æra autoencoder deepfakes-systemer?

Den nye artikels forskere er ubestemmelige på dette punkt:

‘At være en metode, der kan genanimerer ansigter, er RigNeRF tilbøjelig til misbrug af dårlige aktører til at generere deep-fakes.’

Den nye artikel hedder RigNeRF: Fuldt Kontrollerbare Neurale 3D-Portrætter, og kommer fra ShahRukh Atha fra Stonybrook University, en praktikant hos Adobe under RigNeRF’s udvikling, og fire andre forfattere fra Adobe Research.

Ud over Autoencoder-Baserede Deepfakes

De fleste virale deepfakes, der har fanget overskrifterne i de seneste år, er produceret af autoencoder-baserede systemer, der stammer fra koden, der blev offentliggjort på det prompte-forbudte r/deepfakes subreddit i 2017 – selv om det ikke før, end det blev kopieret over til GitHub, hvor det nu er blevet forket over en tusind gange, ikke mindst ind i den populære (om end kontroversielle) DeepFaceLab-distribution, og også FaceSwap-projektet.

Ud over GAN og NeRF har autoencoder-rammer også eksperimenteret med 3DMMs som ‘retningslinjer’ for forbedret ansigts-syntese-rammer. Et eksempel på dette er HifiFace-projektet fra juli 2021. Men ingen brugbare eller populære initiativer synes at have udviklet sig fra denne tilgang indtil nu.

Data til RigNeRF-scener erhverves ved at fange korte smartphone-videoer. Til projektet brugte RigNeRF’s forskere en iPhone XR eller en iPhone 12 til alle eksperimenter. For den første halvdel af optagelsen bedes subjektet udføre en bred vifte af ansigtsudtryk og tale, mens de holder hovedet stille, mens kameraet bevæger sig rundt om dem.

For den anden halvdel af optagelsen holder kameraet en fast position, mens subjektet må bevæge hovedet rundt, mens de udviser en bred vifte af udtryk. De resulterende 40-70 sekunders optagelse (omkring 1200-2100 billeder) repræsenterer det hele datasæt, der vil blive brugt til at træne modellen.

Nedskæring af Data-Indsamling

I modsætning hertil kræver autoencoder-systemer som DeepFaceLab den relativt arbejdskrævende indsamling og kuratering af tusinder af diverse billeder, ofte taget fra YouTube-videoer og andre sociale medier-kanaler, samt fra film (i tilfælde af celebrity deepfakes).

De resulterende trænede autoencoder-modeller er ofte tiltænkt at blive brugt i en række situationer. Men de mest omhyggelige ‘celebrity’-deepfakers kan træne hele modeller fra scratch for en enkelt video, på trods af at træning kan tage en uge eller mere.

Trods advarselsnoten fra den nye artikels forskere, synes de ‘patchwork’- og bredt-sammensatte datasæt, der driver AI-porno samt populære YouTube/TikTok ‘deepfake-genindcastninger’, usandsynligt at producere acceptabel og konsekvent resultater i et deepfakes-system som RigNeRF, der har en scene-specifik metode. Givet begrænsningerne på data-optagelse, som er fastlagt i den nye artikel, kan dette bevise sig at være en ekstra sikkerhed mod casual misbrug af identitet af dårlige deepfakers.

Tilpasning af NeRF til Deepfake-Video

NeRF er en fotogrammetri-baseret metode, hvor et lille antal kilde-billeder taget fra forskellige vinkler samles i et udforskeligt 3D neuralt rum. Denne tilgang kom til prominens tidligere i år, da NVIDIA præsenterede sit Instant NeRF-system, der kan reducere den ekstreme træningstid for NeRF til minutter eller endda sekunder:

Instant NeRF. Kilde: https://www.youtube.com/watch?v=DJ2hcC1orc4

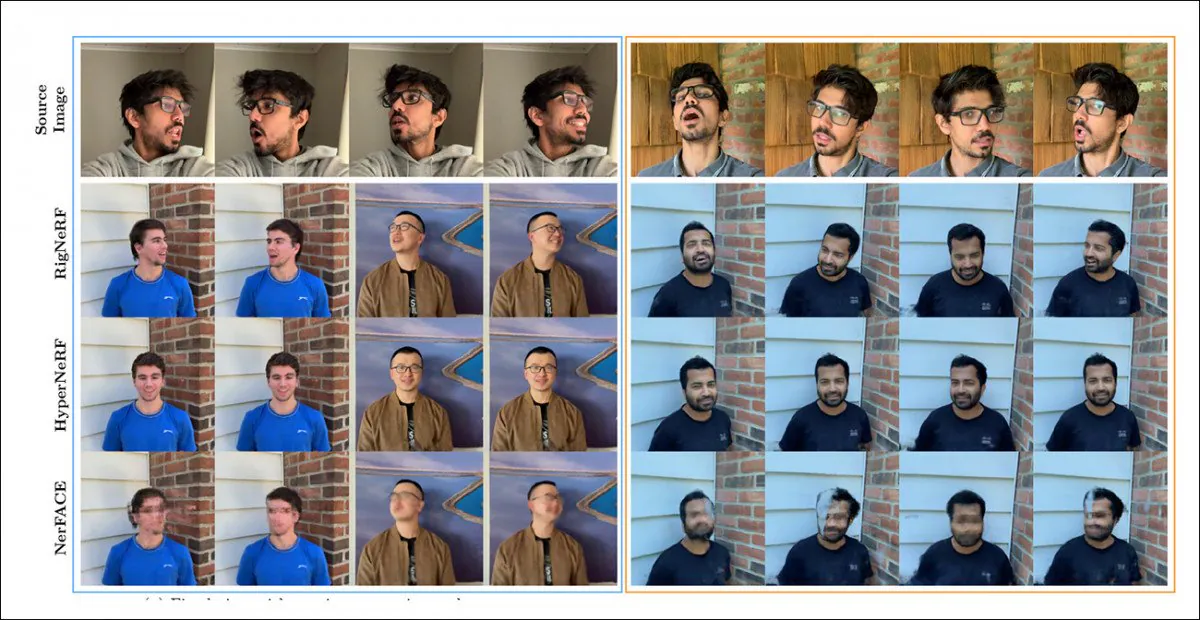

Det resulterende Neural Radiance Field-scene er essentielt et statisk miljø, der kan udforskes, men som er svært at redigere. Forskerne bemærker, at to tidligere NeRF-baserede initiativer – HyperNeRF + E/P og NerFACE – har forsøgt at syntetisere ansigts-video, og (apparent for kompletthed og omhyggelighed) har sat RigNeRF op imod disse to rammer i en test-runde:

En kvalitativ sammenligning mellem RigNeRF, HyperNeRF og NerFACE. Se de linkede kilde-videoer og PDF for højere-kvalitets-versioner. Statiske billedkilder: https://arxiv.org/pdf/2012.03065.pdf

Men i dette tilfælde er resultaterne, der favoriserer RigNeRF, ret anomale, af to grunde: først og fremmest bemærker forfatterne, at ‘der ikke er nogen eksisterende arbejde til en æble-til-æble-sammenligning’; for det andet har dette nødt til at begrænse RigNeRF’s funktioner til at matche de mere begrænsede funktioner af de tidligere systemer.

Da resultaterne ikke er en inkrementel forbedring af tidligere arbejde, men snarere repræsenterer en ‘gennembrud’ i NeRF-redigering og nytte, vil vi lade test-runden ligge og i stedet se, hvad RigNeRF gør anderledes end sine forgængere.

Kombinerede Styrker

Den primære begrænsning af NerFACE, der kan skabe pose/udtryks-kontrol i et NeRF-miljø, er, at det antager, at kilde-optagelser vil blive taget med en statisk kamera. Dette betyder effektivt, at det ikke kan producere nye udsigter, der går ud over dets optagelses-begrænsninger. Dette resulterer i et system, der kan skabe ‘bevægelige portrætter’, men som er uegnet til deepfake-stil video.

HyperNeRF, på den anden side, kan generere nye og hyper-realistiske udsigter, men har ingen instrumentering, der tillader det at ændre hoved-pose eller ansigts-udtryk, hvilket igen ikke resulterer i nogen form for konkurrent til autoencoder-baserede deepfakes.

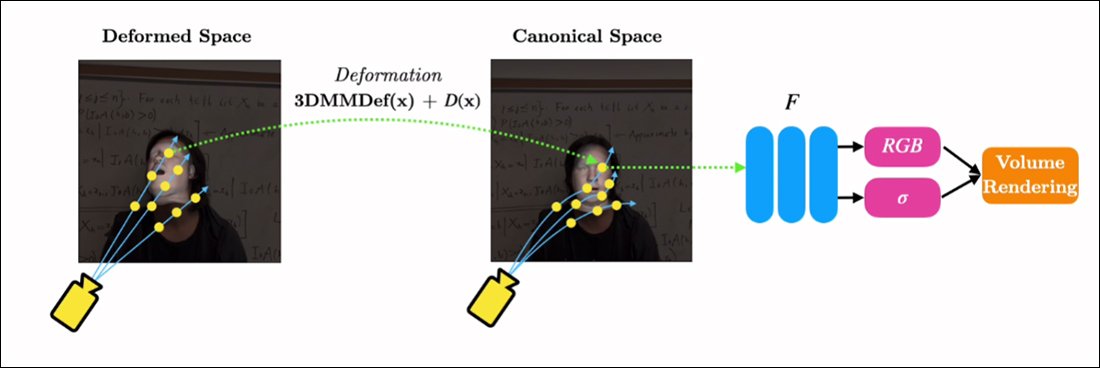

RigNeRF kan kombinere disse to isolerede funktioner ved at skabe et ‘kanonisk rum’, en standard-baseline, fra hvilken afvigelser og deformationer kan udføres via input fra 3DMM-modulen.

Skabelse af et ‘kanonisk rum’ (ingen pose, ingen udtryk), på hvilket deformationer (dvs. poser og udtryk) produceret via 3DMM kan fungere.

Da 3DMM-systemet ikke vil være nøjagtigt matchet til den fangete subjekt, er det vigtigt at kompensere for dette i processen. RigNeRF opnår dette med en deformation-felt-forudsigelse, der beregnes fra en Multilayer Perceptron (MLP) afledt fra kilde-optagelserne.

Kamera-parametrene nødvendige for at beregne deformationer erhverves via COLMAP, mens udtryks- og form-parametre for hvert billede erhverves fra DECA.

Positioneringen optimeres yderligere gennem landmark-tilpasning og COLMAP’s kamera-parametre, og på grund af beregningsressource-begrænsninger nedsamples video-udgangen til 256×256 opløsning til træning (en hardware-begrænset krympnings-proces, der også plager autoencoder deepfaking-scenen).

Efter dette trænes deformation-netværket på de fire V100’er – imponerende hardware, der ikke er sandsynligt at være inden for rækkevidde af casual-entusiaster (men hvor maskinlærings-træning er involveret, er det ofte muligt at handle kraft for tid, og blot acceptere, at model-træning vil være en sag om dage eller endda uger).