Andersons vinkel

Genopretning og redigering af menneskebilleder med AI

Et nyt samarbejde mellem University of California Merced og Adobe tilbyder en fremgang på den hidtil bedste metode til menneskebilledekomplettering – den meget studerede opgave at ‘afskjule’ skjulte eller gemte dele af billeder af mennesker, med formål som f.eks. virtuel prøvning, animation og foto-redigering.

Foruden reparation af beskadigede billeder eller ændring af dem efter brugerens ønske, kan menneskebilledekompletteringssystemer som CompleteMe påføre nye klædningsgenstande (via en hjælpe-referencebillede, som i den midterste kolonne i disse to eksempler) til eksisterende billeder. Disse eksempler er fra den omfattende supplerende PDF til den nye artikel. Kilde: https://liagm.github.io/CompleteMe/pdf/supp.pdf

Den nye tilgang, titlen CompleteMe: Reference-baseret Menneskebilledekomplettering, bruger supplerende inputbilleder til at ‘forslå’ systemet, hvad indhold der skal erstatte den skjulte eller manglende del af menneskeafbildningen (hvilket er årsagen til, at den er anvendelig til mode-baserede prøvningsrammer):

CompleteMe-systemet kan tilpasse referenceindhold til den skjulte eller occluderede del af et menneskebillede.

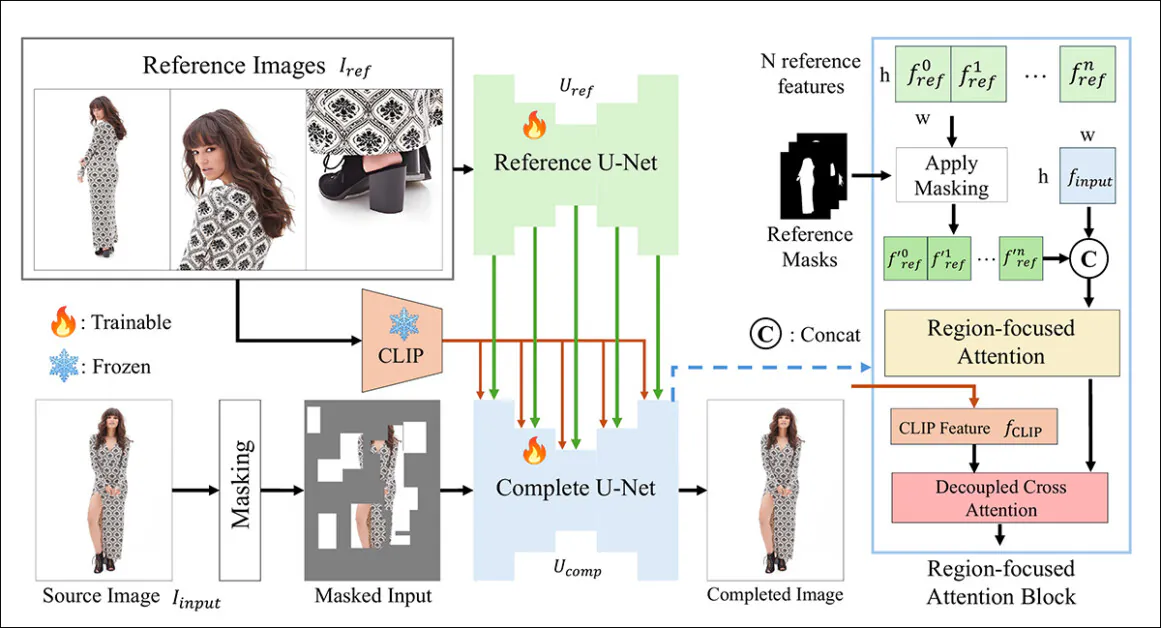

Det nye system bruger en dobbelt U-Net-arkitektur og en Region-Focused Attention (RFA)-blok, der samler ressourcer til den pertinente del af billedrestaureringsinstansen.

Forskere tilbyder også et nyt og udfordrende benchmark-system designet til at evaluere reference-baserede kompletionsopgaver (da CompleteMe er en del af en eksisterende og pågående forskningsstræng i computer vision, selv om den ikke har haft nogen benchmark-skema før nu).

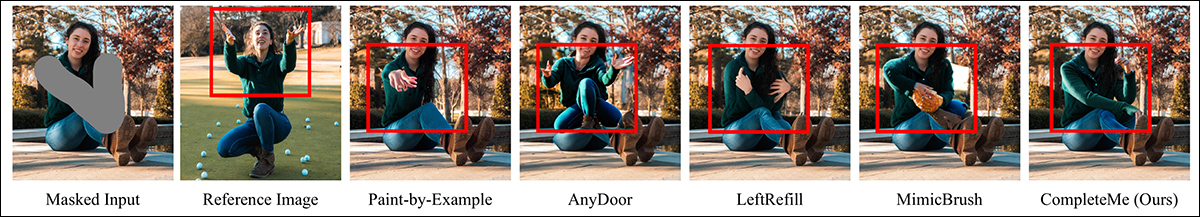

I tests og i en vel-skalaet brugerstudie kom den nye metode ud som den bedste i de fleste mål, og bedst overall. I visse tilfælde var rivaliserende metoder fuldstændig forvirrede af reference-baserede tilgange:

Fra supplerende materiale: AnyDoor-metoden har særlig svigt at afgøre, hvordan man skal fortolke et referencebillede.

Artiklen siger:

‘Omhyggelige eksperimenter på vores benchmark demonstrerer, at CompleteMe overgår state-of-the-art-metoder, både reference-baserede og ikke-reference-baserede, i kvantitative mål, kvalitative resultater og brugerstudier.

‘Især i udfordrende scenarier, der involverer komplekse stillinger, intrikate beklædningsmønstre og karakteristiske tilbehør, opnår vores model konsekvent overlegen visuel troværdighed og semantisk kohærens.’

Desværre indeholder projektets GitHub-præsence ingen kode, og initiativet, der også har en beskeden projektside, synes at være ramt som en proprietær arkitektur.

Yderligere eksempel på det nye systems subjektive præstation i forhold til tidligere metoder. Flere detaljer senere i artiklen.

Metode

CompleteMe-rammen er underbygget af en Reference U-Net, der håndterer integrationen af det hjælpende materiale i processen, og en samlet U-Net, der kan rumme en bredere række processer til at opnå det endelige resultat, som vist i det konceptuelle schema nedenfor:

Det konceptuelle schema for CompleteMe. Kilde: https://arxiv.org/pdf/2504.20042

Systemet kodificerer først det maskerede inputbillede til en latent repræsentation. Samtidig behandler Reference U-Net multiple referencebilleder – hver viser forskellige kropsdele – for at trække detaljerede rumlige træk ud.

Disse træk passerer gennem en Region-focused Attention-blok indbygget i ‘complete’ U-Net, hvor de maskeres selektivt ved hjælp af tilsvarende regionmasker, hvilket sikrer, at modellen kun betragter relevante områder i referencebillederne.

De maskerede træk integreres herefter med globale CLIP-afledte semantiske træk gennem decoupled cross-attention, hvilket tillader modellen at genskabe manglende indhold med både fin detalje og semantisk kohærens.

For at forbedre realisme og robusthed kombinerer input-maskeringsprocessen tilfældige grid-baserede occlusioner med menneskekropsform-masker, hver anvendt med ligelig sandsynlighed, hvilket øger kompleksiteten af de manglende områder, som modellen skal fuldføre.

Kun til reference

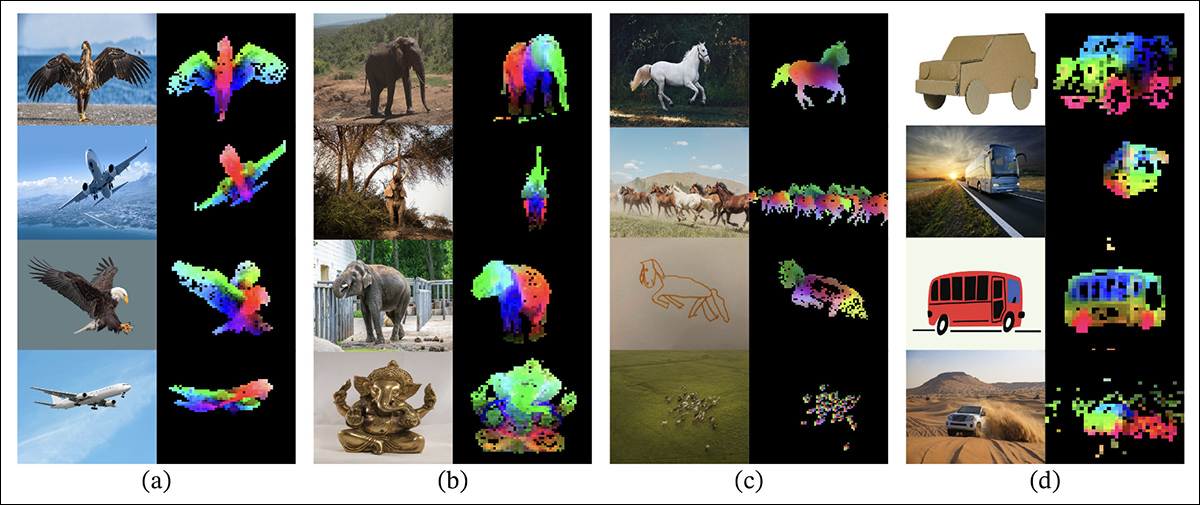

Tidligere metoder til reference-baseret billedindmalning afhængigt typisk af semantisk niveau-kodificerere. Projekter af denne type inkluderer CLIP selv og DINOv2, der begge trækker globale træk ud af referencebilleder, men ofte mister de fine rumlige detaljer, der er nødvendige for præcis identitetsbevarelse.

Fra udgivelsesartiklen for den ældre DINOV2-tilgang, der er inkluderet i sammenligningstests i den nye studie: De farvede overlag viser de første tre hovedkomponenter fra Principal Component Analysis (PCA), anvendt på billedstumper inden for hver kolonne, hvilket fremhæver, hvordan DINOv2 grupperer lignende objektdel sammen på tværs af varierede billeder. Trods forskelle i stilling, stil eller rendering er tilsvarende områder (som vinger, lemmer eller hjul) konsekvent matchet, hvilket illustrerer modellens evne til at lære del-baseret struktur uden tilsyn. Kilde: https://arxiv.org/pdf/2304.07193

CompleteMe adresserer dette aspekt gennem en specialiseret Reference U-Net initialiseret fra Stable Diffusion 1.5, men opererer uden diffusionsstøjtrinnet*.

Hver referencebillede, der dækker forskellige kropsdele, kodificeres til detaljerede latente træk gennem denne U-Net. Globale semantiske træk udtrækkes også separat ved hjælp af CLIP, og begge sæt træk gemmes for effektiv brug under attention-baseret integration. Derfor kan systemet fleksibelt rumme multiple reference-input, mens det bevare fine-grainede fremtoningsinformation.

Orkestrering

Den samlede U-Net håndterer de endelige stadier af kompletionsprocessen. Tilpasset fra inpainting-varianten af Stable Diffusion 1.5, tager den input det maskerede kildebillede i latent form, sammen med detaljerede rumlige træk trukket fra referencebillederne og globale semantiske træk udtrukket af CLIP-kodificeren.

Disse forskellige input kombineres gennem RFA-blokken, der spiller en kritisk rolle i at styre modellens fokus mod de mest relevante områder af referencematerialet.

Før indgang i attention-mekanismen maskeres reference-trækkene eksplicit for at fjerne urelaterede områder og herefter konkateneres med den latente repræsentation af kildebilledet, hvilket sikrer, at attention rettes så præcist som muligt.

For at forbedre integrationen inkorporerer CompleteMe en decoupled cross-attention-mekanisme tilpasset fra IP-Adapter-rammen:

IP-Adapter, en del af hvilken er inkorporeret i CompleteMe, er et af de mest succesfulde og ofte-brugte projekter fra de sidste tre tumultariske år af udvikling i latente diffusionsmodelarkitekturer. Kilde: https://ip-adapter.github.io/

Dette tillader modellen at behandle rumligt detaljerede visuelle træk og bredere semantisk kontekst gennem separate attention-strømme, der senere kombineres, hvilket resulterer i en kohærent rekonstruktion, som forfatterne hævder, bevare både identitet og fine-grainede detaljer.

Benchmarking

I mangelen på en passende dataset til reference-baseret menneskekomplettering har forskerne foreslået deres egen. Benchmarket blev konstrueret ved at kurere udvalgte billedpar fra WPose-datasættet udviklet til Adobe Research’s 2023 UniHuman-projekt.

Eksempler på stillinger fra Adobe Research’s 2023 UniHuman-projekt. Kilde: https://github.com/adobe-research/UniHuman?tab=readme-ov-file#data-prep

Forskere tegnede manuelt kilde-masker for at angive inpainting-områderne, og opnåede til sidst 417 tredoble billedgrupper, der udgjorde et kildebillede, maske og referencebillede.

To eksempler på grupper, der oprindeligt stammer fra reference-WPose-datasættet, og kurateret omfattende af forskerne bag den nye artikel.

Forfatterne brugte LLaVA Large Language Model (LLM) til at generere tekstprompts, der beskriver kildebillederne.

Målene, der blev brugt, var mere omfattende end normalt; ud over den sædvanlige Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM) og Learned Perceptual Image Patch Similarity (LPIPS, i dette tilfælde for at evaluere maskerede områder), brugte forskerne DINO til ligningskarakter; DreamSim til evaluering af genereringsresultat; og CLIP.

Data og tests

For at teste arbejdet brugte forfatterne både den standard Stable Diffusion V1.5-model og 1.5-inpainting-modellen. Systemets billedkodifikator brugte CLIP Vision-modellen sammen med projektilag – beskedne neurale netværk, der omformer eller justerer CLIP-udgangene for at matche de interne funktiondimensioner, der bruges af modellen.

Træning fandt sted i 30.000 iterationer over otte NVIDIA A100†-GPU’er, overvåget af Mean Squared Error (MSE)-tab, ved en batchstørrelse på 64 og en læringsrate på 2×10-5. Forskellige elementer blev tilfældigt droppet under træning for at forhindre, at systemet overfitted på data.

Datasættet blev ændret fra Parts to Whole-datasættet, der selv er baseret på DeepFashion-MultiModal-datasættet.

Eksempler fra Parts to Whole-datasættet, brugt i udviklingen af det kuraterede data til CompleteMe. Kilde: https://huanngzh.github.io/Parts2Whole/

Forfatterne siger:

‘For at opfylde vores krav genopbyggede vi træningsparrene ved at bruge occluerede billeder med multiple referencebilleder, der fanger forskellige aspekter af menneskeligt udseende samt deres korte tekstuelle mærker.

‘Hver prøve i vores træningsdata inkluderer seks udseendetyper: øvre kropsklæder, nedre kropsklæder, hele kropsklæder, hår eller hovedtøj, ansigt og sko. For maskeringsstrategien anvender vi 50% tilfældig grid-masking mellem 1 til 30 gange, mens vi for de andre 50% bruger en menneskekropsform-maske for at øge maskeringskompleksiteten.

‘Efter konstruktionsprocessen opnåede vi 40.000 billedpar til træning.’

Rivaliserende tidligere ikke-reference-metoder, der blev testet, var Large occluded human image completion (LOHC) og plug-and-play billedindmalningsmodellen BrushNet; reference-baserede modeller, der blev testet, var Paint-by-Example; AnyDoor; LeftRefill; og MimicBrush.

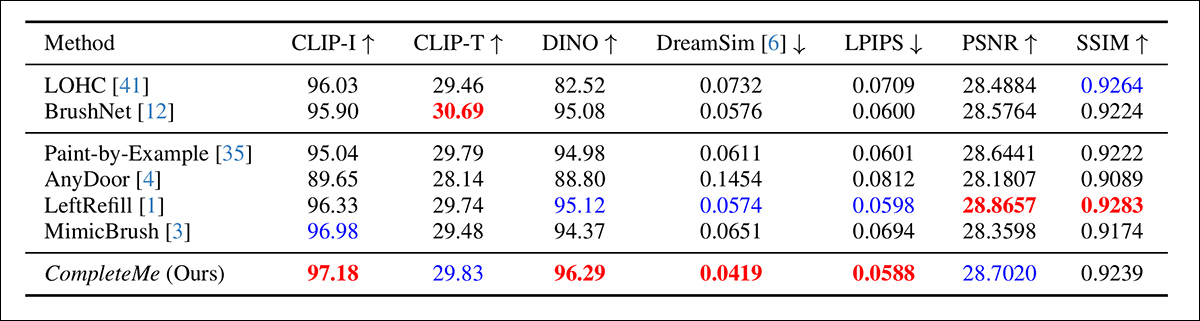

Forfatterne startede med en kvantitativ sammenligning på de nævnte mål:

Resultater for den første kvantitative sammenligning.

Med hensyn til den kvantitative evaluering bemærker forfatterne, at CompleteMe opnår de højeste score på de fleste perceptuelle mål, herunder CLIP-I, DINO, DreamSim og LPIPS, der er designet til at fange semantisk alignment og fremtoningsfidelitet mellem output og referencebillede.

Men modellen overgår ikke alle baseline-metoder på tværs af brættet. Bemærkelsesværdigt scorer BrushNet højest på CLIP-T, LeftRefill leder i SSIM og PSNR, og MimicBrush overgår lidt på CLIP-I.

Selv om CompleteMe viser konsekvent stærke resultater samlet set, er performancesforskellene beskedne i visse tilfælde, og visse mål forbliver ledet af konkurrerende tidligere metoder. Forfatterne fremstiller disse resultater som bevis for CompleteMe’s balancerede styrke på både strukturelle og perceptuelle dimensioner.

Illustrationer for de kvalitative tests, der blev udført i studiet, er alt for talrige til at reproducerer her, og vi henviser læseren ikke kun til kildeartiklen, men også til den omfattende supplerende PDF, der indeholder mange yderligere kvalitative eksempler.

Vi fremhæver de primære kvalitative eksempler, der præsenteres i hovedartiklen, sammen med en udvalg af yderligere tilfælde trukket fra det supplerende billedmateriale, der blev introduceret tidligere i denne artikel:

Første kvalitative resultater præsenteret i hovedartiklen. Venligst se kildeartiklen for bedre opløsning.

Om de kvalitative resultater, der vises ovenfor, kommenterer forfatterne:

‘Givet maskerede input, genererer disse ikke-reference-metoder plausibelt indhold for de maskerede områder ved hjælp af billedpriorer eller tekstprompts.

‘Men, som angivet i den røde ramme, kan de ikke reproducere specifikke detaljer, såsom tatoveringer eller unikke beklædningsmønstre, da de mangler referencebilleder til at guide rekonstruktionen af identisk information.’

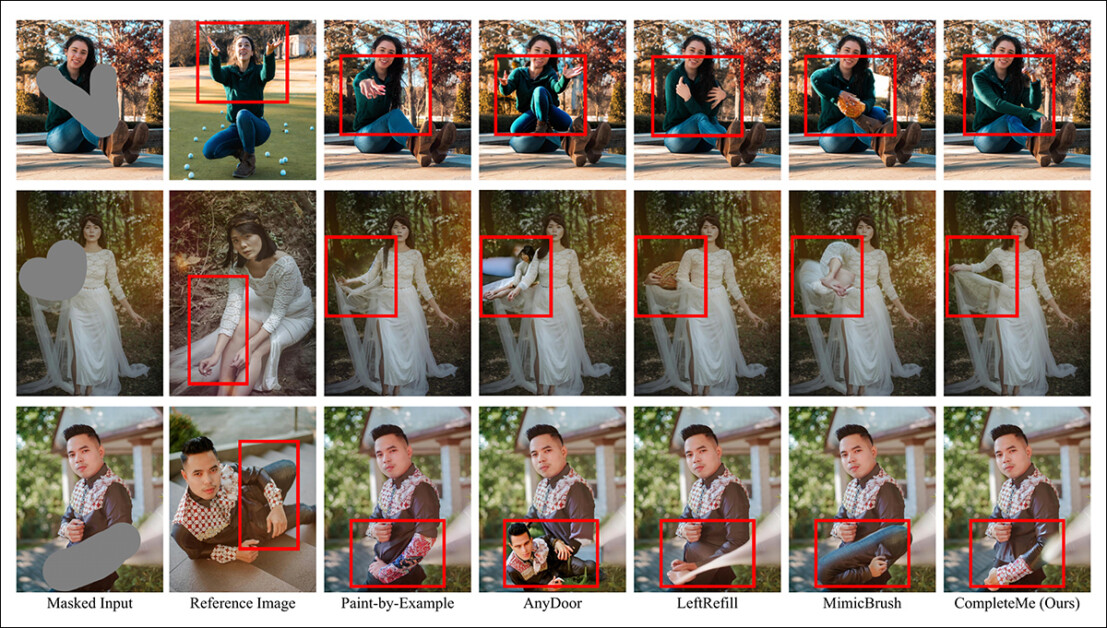

En anden sammenligning, en del af hvilken vises nedenfor, fokuserer på de fire reference-baserede metoder Paint-by-Example, AnyDoor, LeftRefill og MimicBrush. Her blev kun ét referencebillede og en tekstprompt givet.

Kvalitativ sammenligning med reference-baserede metoder. CompleteMe producerer mere realistiske kompletioner og bevare bedre specifikke detaljer fra referencebilledet. De røde rammer fremhæver områder af særlig interesse.

Forfatterne siger:

‘Givet et maskeret menneskebillede og et referencebillede, kan andre metoder generere plausibelt indhold, men ofte fejle i at bevare kontekstuel information fra referencebilledet nøjagtigt.

‘I visse tilfælde genererer de irrelevant indhold eller mapper forkert tilsvarende dele fra referencebilledet. I modsætning hertil kan CompleteMe effektivt fuldføre det maskerede område ved at bevare identisk information og korrekt mappe tilsvarende kropsdele fra referencebilledet.’

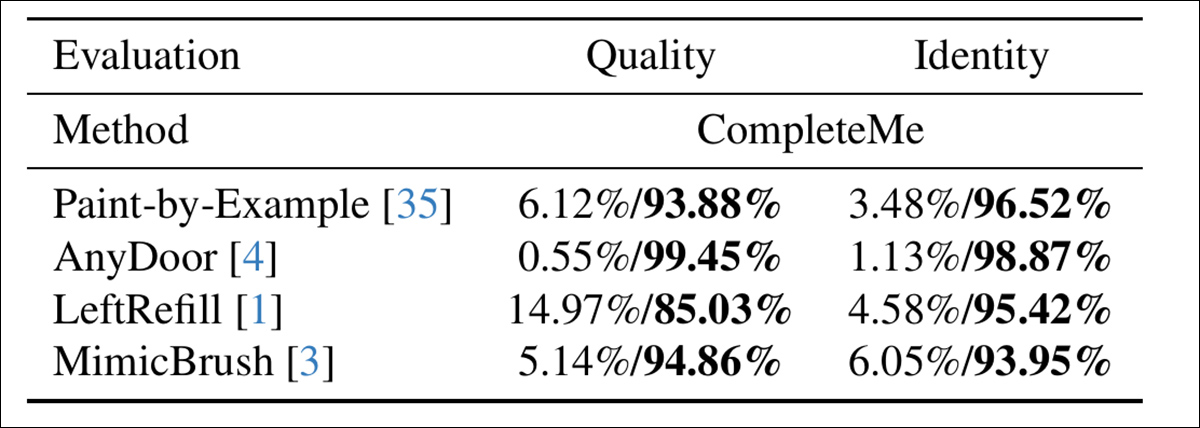

For at evaluere, hvor godt modellerne er i overensstemmelse med menneskelig perception, gennemførte forfatterne en brugerstudie med 15 annotatorer og 2.895 prøvepar. Hver prøve sammenlignede outputtet fra CompleteMe med en af fire reference-baserede baseline-metoder: Paint-by-Example, AnyDoor, LeftRefill eller MimicBrush.

Annotatorerne vurderede hver resultats visuelle kvalitet og udstrækningen, hvori det bevarede identitetsfunktioner fra referencebilledet – og her, hvor man vurderer samlet kvalitet og identitet, opnåede CompleteMe en mere definitiv resultats:

Resultater af brugerstudiet.

Konklusion

Hvis noget, så underminerer de kvalitative resultater i denne studie deres egen kvantitet, da nærmere undersøgelse viser, at det nye system er en meget effektiv indgang i dette relativt niche, men heftigt forfulgte område af neural billedredigering.

Men det kræver lidt ekstra omhu og zoomning på den originale PDF for at værdsætte, hvor godt systemet tilpasser referencematerialet til det occluerede område i sammenligning (i næsten alle tilfælde) med tidligere metoder.

Vi anbefaler stærkt læseren at undersøge nøje de først forvirrende, hvis ikke overvældende mængde af resultater præsenteret i det supplerende materiale.