Andersons vinkel

At bringen en lugtsans til AI-udvikling

En ny AI-dataset lærer maskiner at lugte ved at associerer lugtdata med billeder, så modeller kan matche lugte med objekter, scener og materialer.

Måske på grund af, at lugt-udgangsmaskiner har sådan en broget historie, er lugt en ret forladt sans i AI-forskningslitteraturen. Medmindre du havde planer om at producere endnu en indgang i den langvarige (mere end et århundrede, til dato) smell-o-vision-saga, har brugsændelser altid syntes ret ‘niche’ i forhold til udnyttelsen af billed-, lyd- og video-datasets og de AI-modeller, der trænes fra dem.

I virkeligheden ville muligheden for at automatisere, industrialisere og gøre det muligt at udnytte det slags detectionsfaciliteter, der tilbydes af bombhunde, cadaverhunde, sygdoms-sniffere og forskellige andre typer af canadiske sniffer-enheder, være en bemærkelsesværdig fordel i kommunale og sikkerhedstjenester. Trods høj efterspørgsel, langt i overkanten af udbuddet, er træning og vedligeholdelse af detectionshunde en dyr forretning, der ikke altid giver god værdi for pengene.

Indtil nu har det meste af forskningen, der krænger sig ind på dette studieområde, været begrænset til et laboratorium, med kuraterede samlinger, der typisk består af eksempler med håndlavede funktioner – et profil, der er mere rettet mod beskæftigede hyttesammenløsninger end industrialiserede anvendelser.

Fremad med en næse

Ind i denne ret støvede klima kommer en interessant ny akademisk/industri-samarbejde fra USA, hvor et hold af forskere har brugt flere måneder på at katalogisere forskellige lugte i indendørs- og udendørs-miljøer i New York City – og, for første gang, samlet billeder, der er associeret med de fangete lugte:

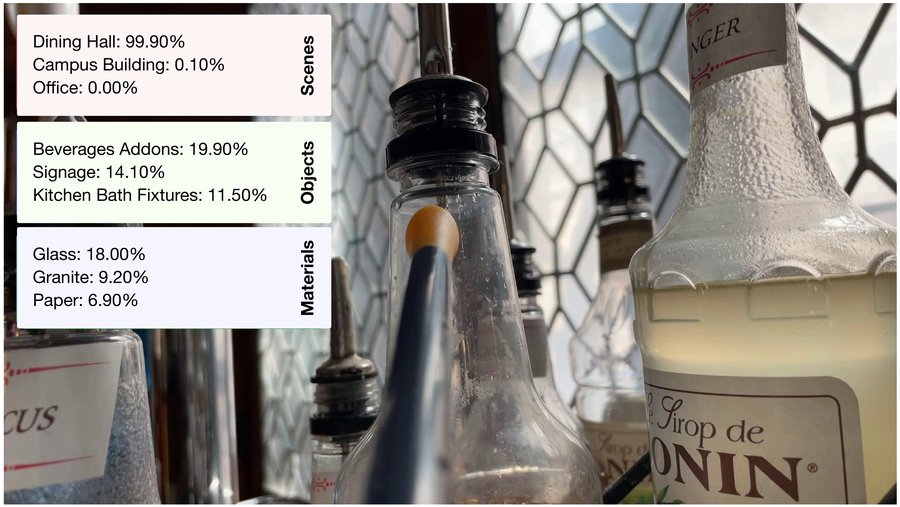

Bemærk den centrale sensor, ‘næsen’ på det olfaktoriske apparat. Trænet kun på lugt, gætter modellen, om den lugter granit, plast eller læder – og identifierer endda rummet, det er i, uden at se et enkelt pixel. Kilde

Denne forskning har ført forfatterne af det nye arbejde til at udvikle en variation af den meget populære Contrastive Language-Image Pretraining (CLIP)-ramme, der forbinder tekst og billeder, i form af Contrastive Olfaktion-Image Pretraining (COIP) – som forbinder lugte og billeder.

Top: synchroniseret video og olfaktorisk sensor-data er fanget i naturlige indstillinger ved hjælp af en camera-e-nose-rig. Bottom venstre (b): en fælles indlejring er lært gennem cross-modal selv-overvågning. (c): systemet henter visuelle match baseret udelukkende på en lugt-forespørgsel. (d): enkelt lugtprøver bruges til at klassificere miljø-, objekt- og materiale-kategorier. (e): meget lignende lugte, såsom to typer græs, adskilles uden visuel input. Kilde

Den nye dataset, titlen New York Smells, indeholder 7.000 lugt-billede-par, der omfatter 3.500 forskellige objekter. Når trænet i tests, blev det nye data fundet at overgå de populære håndlavede funktioner i det relativt små antal lignende tidligere datasets.

Forfatterne håber, at deres første udgangspunkt vil åbne vejen for senere og følgende arbejde mod olfaktoriske detectionsystemer, der er designet til at fungere i det vilde, på samme måde som snifferhunde gør*:

‘Vi ser på denne dataset som et skridt mod i-det-vilde, multimodal olfaktorisk perception, samt et skridt mod at forbinde syn med lugt. Mens olfaktion traditionelt er blevet tilgangen i begrænsede indstillinger, såsom kvalitetskontrol, er der mange anvendelser i naturlige indstillinger.

‘For eksempel, som mennesker, bruger vi konstant vores lugtesans til at vurdere madens kvalitet, identificere farer og opdage usynlige objekter.

‘Desuden viser mange dyr, såsom hunde, bjørne og mus, overmenneskelige olfaktoriske evner kapaciteter, hvilket antyder, at menneskers lugtperception er langt fra grænsen for maskinens evner.’

Selvom det nye papir, titlen New York Smells: En stor multimodal dataset for olfaktion, lover, at data og kode vil blive frigivet, er en 27GB datafil allerede tilgængelig via papirets projektside. Papiret er produceret af ni forskere på Columbia University, Cornell University og Osmo Labs.

Metode

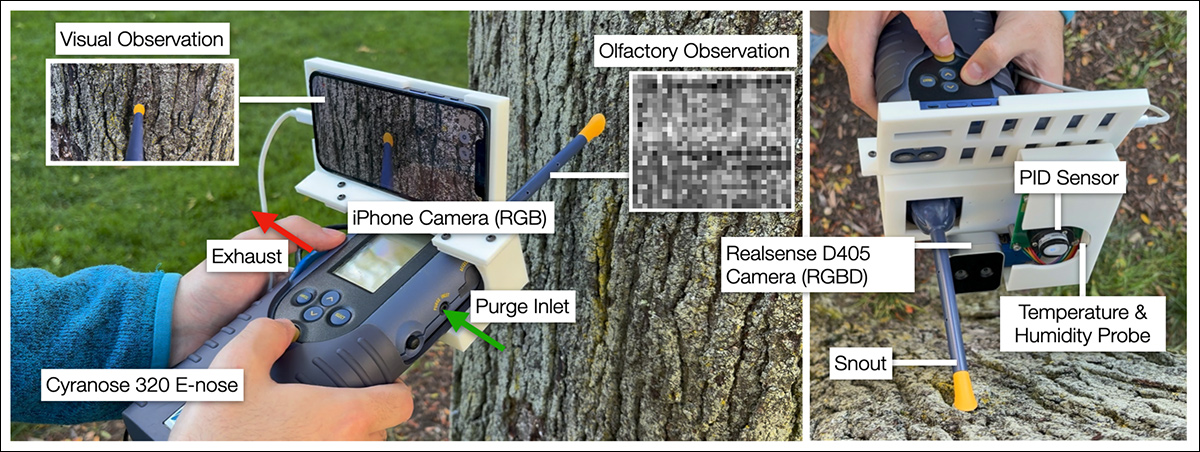

For at indsamle materiale til den nye samling, brugte forskerne Cyranose 320-elektroniske næse, med en iPhone monteret ovenfor den forreste indtagelse til at fange visuelt, hvilke lugte der blev registreret:

En håndholdt sensor-rig indsamler parret video og lugtdata ved at montere en iPhone-kamera på en Cyranose 320 e-nose. Snuden er rettet mod objekter, mens udstødnings- og purge-indtaget håndterer luftstrøm under sampling. En RGB-D-kamera fanger dybde, mens Volatile organic compound (VOC)-koncentration, temperatur og fugtighed er registreret gennem integrerede sensorer, herunder en Proportional-integral-derivative (PID)-modul og en miljø-sonde.

Cyranose-enhed kører med 2Hz, og optager 32-dimensionale olfaktoriske tids-trin. Volatile Organic Compound (VOC)-koncentrationer blev registreret med en MiniPID2 PPM WR-sensor.

Den mobile enhed fungerede som en smidig sensor, der videregav data til en mere compute-kapabel mobil station til behandling.

For at placere mållugten i kontekst, blev en ‘baseline-lugt’ registreret, før det mere specifikke objekt blev målrettet direkte med ‘snuden’ på Cyranose. Den ambient-prøve blev derefter taget fra en side-port i enheden, for at sikre, at den var tilstrækkelig langt fra den primære lugtkilde til ikke at være forurenet.

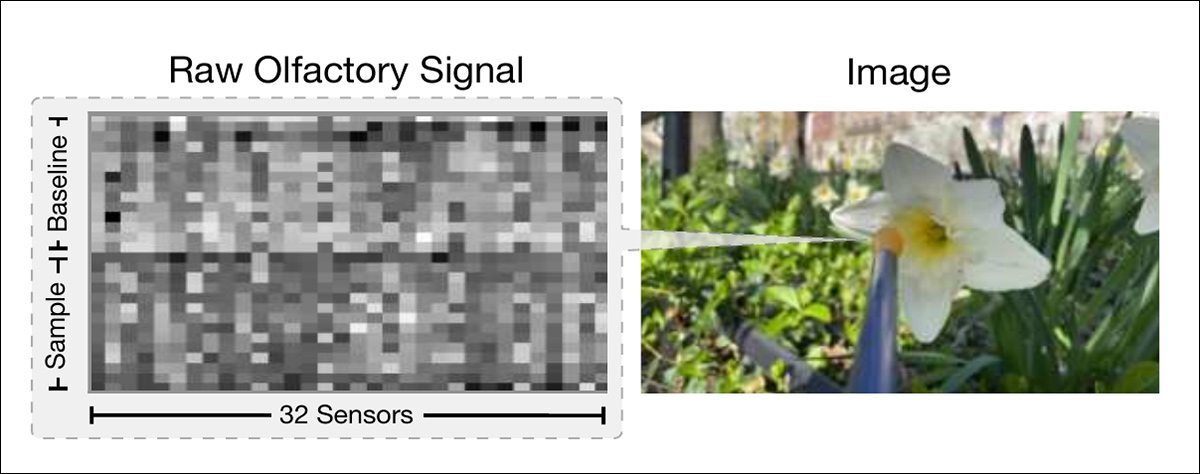

To prøver blev taget gennem hovedindtaget på sensoren, med hver ti-sekunders optagelse fanget fra en anden position omkring objektet, for at forbedre dataeffektiviteten. Prøverne blev derefter kombineret med den ambient-baseline til at danne en 28×32-matrix, der repræsenterer den fulde olfaktoriske måling:

Dette eksempel viser signalen og den tilsvarende billed for en blomst. Den fulde olfaktoriske signal består af en 28×32-matrix, der kombinerer en 14-ramme ambient-baseline med to 10-sekunders-prøver taget fra forskellige vinkler omkring det målte objekt.

Data og tests

Vision Language Models (VLMs) blev brugt til automatisk at mærke objekter og materialer, der blev fanget af iPhone’en i Cyranose-riggen, med GPT-4o brugt til opgaven; dog blev scene kategorier manuelt mærket:

Et lille eksempel fra en omfattende illustration i kildepapiret, der viser de varierede lugtkilder og miljøer, der blev fanget i projektet.

Datasettet blev delt i trænings- og validerings split, med begge prøver fra hvert objekt tildelt samme split for at undgå krydskontamination. Den endelige samling består af 7.000 olfaktorisk-vision-par, der er hentet fra 3.500 umærkede objekter, samt 70 timer video og 196.000 tids-trin af rå olfaktorisk data fra både baseline- og prøvefaser.

Data blev indsamlet over 60 sessioner i løbet af en to-måneders periode, der omfattede parker, universitetsbygninger, kontorer, gader, biblioteker, lejligheder og spisesale, med multiple sessioner gennemført på hver lokalitet. Den resulterende dataset indeholder 41% udendørs og 59% indendørs miljøer.

For at udvikle generelle olfaktoriske repræsentationer, trænede forfatterne en kontrastiv model til at associerer synchroniserede billed-lugt-par fra datasettet. Denne tilgang, den nævnte COIP, bruger en tab-funktion tilpasset fra CLIP til at justere indlejringerne af samtidige visuelle og olfaktoriske signaler.

Træning brugte både en visuel encoder og en lugt-encoder, med målet at lære modellen at bringe matchende lugte og billeder tættere sammen i et fælles repræsentationsrum. Den resulterende repræsentation støtter en række downstream-opgaver, herunder lugt-til-billed-henting, scene- og objekt-genkendelse, materiale-klassificering og fin-grænet lugt-discernment.

Modellen blev trænet ved hjælp af to typer af olfaktoriske input: den fulde rå sensor-signal og en reduceret håndlavet sammenfatning kendt som lugtpræg – en funktion, der er bredt brugt i olfaktorisk forskning, som komprimerer hver sensors respons til et enkelt tal ved at sammenligne peak-modstanden under sampling med gennemsnits-modstanden under den ambient-baseline.

I modsætning hertil består den rå input, der er optaget over hele New York City, af en tids-række fra 32 kemiske sensorer inde i Cyranose-enhed, der fanger, hvordan hver sensors elektrisk modstand ændrer sig over tid, når den reagerer på lugten.

For kurering af datasettet blev denne ubehandlingssignal feedet direkte ind i et neuralt netværk, hvilket muliggjorde end-to-end-læring med enten en konvolutionel eller transformator-baseret ryg.

Modellerne blev trænet ved hjælp af både lugtpræg og den rå input, der blev indsamlet fra forskellige miljøer i New York City, med begge input-typer vurderet ved hjælp af kontrastiv læring.

Krydsmæssig henting

Krydsmæssig henting blev vurderet ved at indlejre hver lugtprøve og dens parrede billed i et fælles repræsentationsrum og teste, om det korrekte billed kunne hentes baseret kun på den olfaktoriske input.

Rangering blev bestemt af nærheden af hver billed-indlejring til den forespurgte lugt i dette rum, og præstationen blev målt ved hjælp af gennemsnits-rang, median-rang og genkald på flere grænser:

Krydsmæssig hentings-nøjagtighed for forskellige lugt-encodere, der viser, hvor godt hver model identificerer det korrekte billed fra en lugt-forespørgsel. Resultaterne sammenligner arkitekturer, der er trænet på rå olfaktoriske signaler med dem, der bruger lugtpræg.

Med hensyn til disse resultater, siger forfatterne:

‘Kontrastiv præ-træning ved hjælp af lugtpræg giver bedre resultater end tilfældighed i alle målinger. Dog giver træning af den olfaktoriske encoder på det rå olfaktoriske signal en betydelig forbedring i forhold til lugtpræg-encoderen, uafhængigt af arkitektur.

‘Dette viser den rigere information, der er til stede i den rå olfaktoriske data, og låser op for stærkere krydsmæssige associationer mellem syn og lugt.’

En detalje fra den syvende illustration i kildepapiret, der er for kondenseret til at kunne reproduceres meningsfuldt her. Her vises krydsmæssig hentings-eksempler, der viser, hvordan modellen forbinder lugte med matchende billeder. Hver række starter med en lugt-forespørgsel, efterfulgt af de øverste rangerede billed-forudsigelser i det fælles indlejningsrum. Det korrekte billed for hver forespørgsel er omrammet i grønt, hvilket viser, hvordan lugte fra bøger, planter, masonry og andre materialer trækker modellen mod visuelt og semantisk relaterede scener.

Forfatterne bemærker også, at hentings-resultaterne viser tydelige semantiske mønstre:

‘Hentinger fra vores model viser ofte semantiske grupperinger. Lugten af en bog henter billeder af andre bøger, lugten af blade henter billeder af løv.

‘Disse resultater antyder, at den lænte repræsentation fanger meningsfuld krydsmæssig struktur.’

Scene, objekt og materiale-genkendelse

Evnen til, at modellen kan genkende lugte uden visuel input, blev vurderet ved at træne den til at identificere scener, objekter og materialer baseret udelukkende på olfaktoriske data; til dette formål blev en lineær sonde (en simpel klassifikator trænet på frosne repræsentationer) brugt til at vurdere, hvor meget information der var kodet i den lænte lugt-indlejring.

Mærkerne blev afledt fra de parrede billeder i træningssættet ved hjælp af GPT-4o – men kun den olfaktoriske signal blev brugt under klassificering.

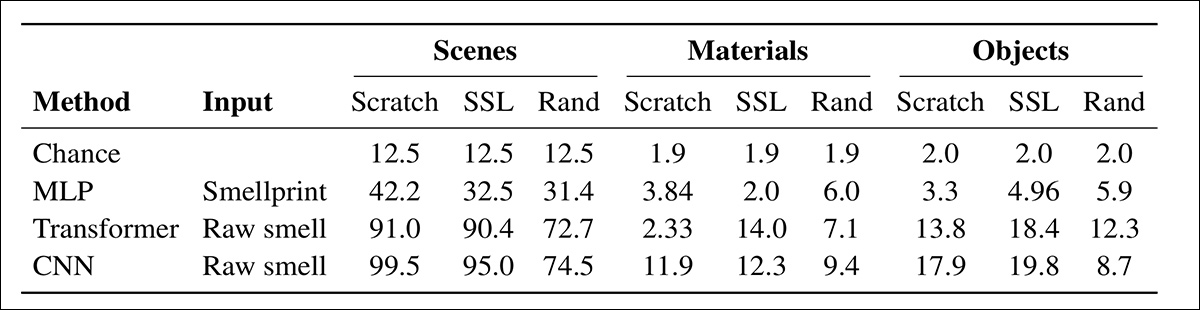

Flere encoder-typer blev testet: nogle initialiseret tilfældigt, nogle trænet fra scratch, og andre trænet ved hjælp af kontrastiv læring til at justere lugt og syn i et fælles repræsentationsrum, med rå data og lugtpræg vurderet:

Klassificerings-nøjagtighed for scener, materialer og objekter blev vurderet ved hjælp af olfaktoriske signaler alene. Rå sensor-input overgik lugtpræg, med CNN’er trænet fra scratch, der gav de bedste resultater, herunder 99,5% for scener. SSL-præ-træning hjalp i nogle tilfælde, men blev generelt overgået af overvåget træning. Tilfældige-vægt-baserede baseline-antyder, at model-kapacitet alene er utilstrækkelig.

Betydeligt højere nøjagtighed blev opnået, når rå olfaktoriske data blev brugt, især i modeller trænet med cross-modalt tilsyn. Forfatterne bemærker**:

‘Modeller trænet på rå sensor-input giver også højere nøjagtighed end modeller trænet med håndlavede lugtpræg-funktioner. Disse resultater viser, at dyb-læring fra rå olfaktoriske signaler er betydeligt bedre end håndlavede funktioner.’

Fin-grænet diskrimination

For at vurdere, om fin-grænet lugt-forskelle kunne læres, blev en benchmark bygget fra to græs-arter, der sam-existerede på samme campus-lawn. Alternativt blev prøver indsamlet over seks 30-minutters sessioner, hvilket gav 256 eksempler. En lineær klassifikator blev trænet på funktioner fra olfaktorisk-visuel kontrastiv læring, og vurderet på en holdt-tilbage-sæt på 42 prøver:

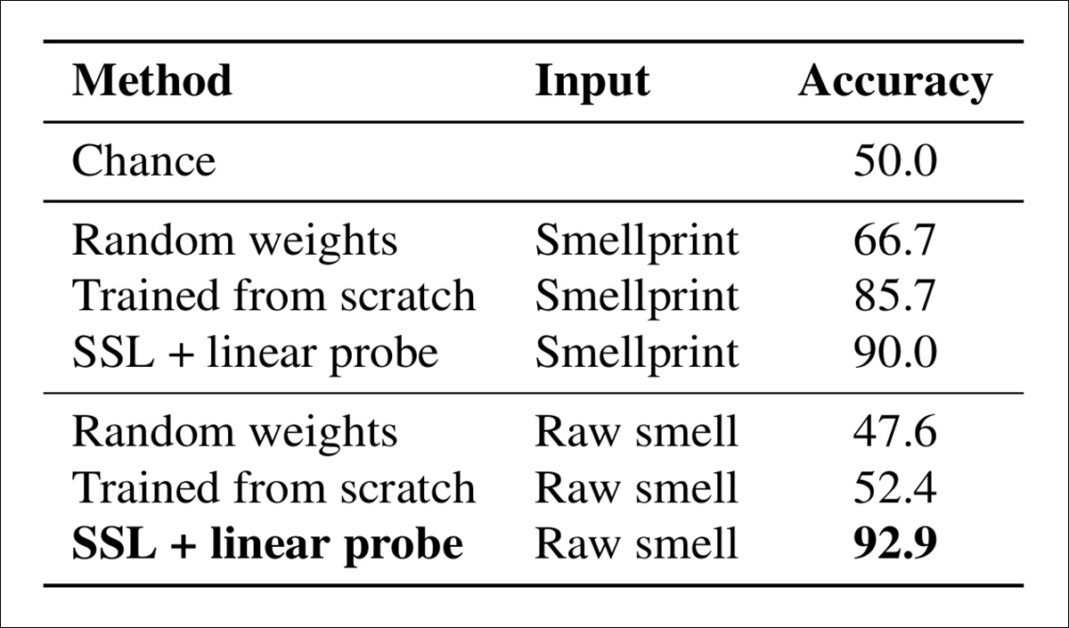

Nøjagtighed af græs-art-klassificering fra lugt alene. Modellerne blev vurderet på deres evne til at skelne mellem to visuelt lignende græs-typer ved hjælp af kun olfaktorisk input. Præstationen blev sammenlignet på tværs af lugtpræg og rå sensor-data, med modeller enten tilfældigt initialiseret, trænet fra scratch eller trænet ved hjælp af selv-tilsyn (SSL) efterfulgt af en lineær sonde. Den højeste nøjagtighed, 92,9%, blev opnået ved hjælp af rå olfaktoriske signaler med SSL, hvilket antyder, at fin-grænet lugt-forskelle bedst kan fanges gennem rå input og vision-guidet træning.

Her siger forskerne:

‘Træning på det rå olfaktoriske sensor-signal (i stedet for håndlavede funktioner) giver den højeste nøjagtighed – overgår alle varianter baseret på lugtpræg.

‘Disse resultater antyder, at olfaktorisk-visuel læring bevarer mere fin-grænet information end læring med lugtpræg, og at visuel tilsyn giver en signal til at udnytte denne information.’

Konklusion

Selvom lugt-syntese sandsynligvis vil forblive et uløst problem en del af vejen ind i fremtiden, har et effektivt og billigt i-det-vilde lugt-analyse-system en enorm potentiale, ikke kun for politi-, sikkerheds- og medicinske formål, men også for kvalitets- og by-til-overvågning.

For tiden er udstyret involveret niche og normalt ret dyrt; derfor synes reel fremgang i ‘olfaktorisk AI’ for detection sandsynligvis at kræve en visionær og billig sensor i ånden af Raspberry PI.

* Min konvertering af forfatterens inline-citationer til hyperlinks.

** Vær venlig at bemærk, at yderligere illustrationer (figur 8) er tilgængelige i kildepapiret, men er bedst set i den sammenhæng.

Først udgivet fredag, 28. november 2025