Umělá inteligence

Nedostatky Amazon Mechanical Turk mohou ohrozit systémy generování přirozeného jazyka

Nová studie z University of Massachusetts Amherst postavila anglické učitele proti pracovníkům z crowdsourcového portálu Amazon Mechanical Turk při hodnocení výstupu systémů generování přirozeného jazyka (NLG), a dospěla k závěru, že laxní standardy a “zneužívání” ceněných úkolů mezi pracovníky AMT mohou brzdit rozvoj tohoto odvětví.

Zpráva dospěla k několika kritickým závěrům ohledně rozsahu, v jakém “industriální” levné outsourcing otevřených úkolů hodnocení NLG může vést k horším výsledkům a algoritmům v tomto odvětví.

Výzkumníci také sestavili seznam 45 článků o generování otevřeného textu, ve kterých výzkumníci využili AMT, a zjistili, že “velká většina” z nich nezveřejnila kritické detaily o používání služby Amazon Mechanical Turk, což znemožňuje reprodukovat výsledky článků.

Potní práce

Zpráva kritizuje jak potní charakter Amazon Mechanical Turk, tak (pravděpodobně rozpočtově omezené) akademické projekty, které dodávají AMT další kredibilitu tím, že ji používají (a citují) jako platný a konzistentní výzkumný zdroj. Autoři uvádějí:

‘Zatímco AMT je pohodlným a dostupným řešením, pozorujeme, že vysoká variabilita mezi pracovníky, špatná kalibrace a kognitivně náročné úkoly mohou vést výzkumníky k zavádějícím vědeckým závěrům (například že text psaný člověkem je “horší” než GPT-2).’

Zpráva viní hru spíše než hráče, přičemž výzkumníci uvádějí:

‘Pracovníci jsou často podpláceni za svou práci, což poškozuje jak kvalitu výzkumu, tak, což je důležitější, schopnost těchto pracovníků vydělat si přiměřený život.’

Článek článek, nazvaný Nebezpečí používání Mechanical Turk pro hodnocení otevřeného textového generování, dále dospívá k závěru, že “expertní hodnotitelé” jako jazykoví učitelé a lingvisté by měli být použiti k hodnocení otevřeného umělého obsahu NLG, i když je AMT levnější.

Testovací úkoly

Při srovnání výkonu AMT s méně časově omezenými, experty čtenáři, výzkumníci utratili 144 dolarů za služby AMT, které byly skutečně použity v porovnávacích testech (i když mnohem více bylo utraceno za “nepoužitelné” výsledky – viz níže), vyžadující náhodné “Turky”, aby vyhodnotili jeden z 200 textů, rozdělených mezi texty vytvořené člověkem a umělými texty.

Náklad na profesionální učitele pro stejnou práci činil 187,50 dolaru, a potvrzoval jejich lepší výkon (ve srovnání s pracovníky AMT) tím, že najal freelance pracovníky z Upwork, aby zopakovali úkoly, za dalších 262,50 dolaru.

Každý úkol se skládal ze čtyř hodnoticích kritérií: gramatika (‘Jak gramaticky správný je text příběhu?’); soudržnost (‘Jak dobře se věty v příběhu.fit together?’); libost (‘Jak příjemný je vám příběh?’); a relevance (‘Jak relevantní je příběh k podnětu?’).

Generování textů

Aby získali materiál NLG pro testy, výzkumníci použili dataset Facebook AI Research’s 2018 Hierarchical Neural Story Generation dataset, který se skládá z 303 358 anglických příběhů složených uživateli na velmi populárním (15 milionů+ uživatelů) r/writingprompts subreddit, kde příběhy uživatelů jsou “osevní” jednoduchými větami “podněty” podobným způsobem jako současné postupy v text-to-image generování – a samozřejmě v otevřených systémech generování přirozeného jazyka systémů.

200 podnětů z datasetu bylo náhodně vybráno a předáno středně velkému modelu GPT-2 pomocí knihovny Hugging-Face Transformers library. Takže byly získány dva sady výsledků z stejného podnětu: texty psané člověkem z uživatelů Redditu a texty generované GPT-2.

Aby se zabránilo tomu, že stejní pracovníci AMT budou hodnotit stejný příběh vícekrát, byly vyžádány tři hodnocení pracovníků AMT pro každý příklad. Společně s experimenty týkajícími se anglických jazykových schopností pracovníků (viz konec článku) a odstraněním výsledků od pracovníků s nízkou úsilím (viz ‘Short Time’ níže), to zvýšilo celkové výdaje na AMT na přibližně 1 500 dolarů.

Aby se vytvořila rovná hra, všechny testy byly provedeny v pracovních dnech mezi 11:00-11:30 PST.

Výsledky a závěry

Široká studie pokrývá mnoho témat, ale klíčové body jsou následující:

Short Time

Článek zjistil, že oficiálně hlášený průměrný čas úkolu 360 sekund se ve skutečnosti snížil na 22 sekund, a medián času byl pouze 13 sekund – čtvrtina času, který strávil nejrychlejší anglický učitel při opakování úkolu.

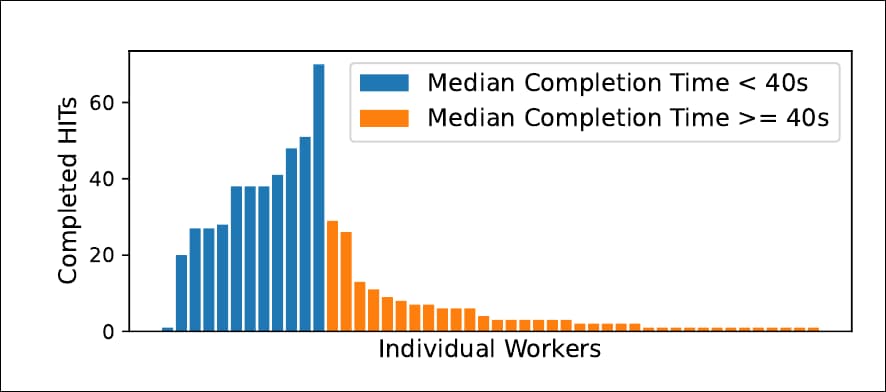

From Day 2 of the study: the individual workers (in orange) spent notably less time evaluating each task than the better-paid teachers, and (later) the even better-paid Upwork contractors. Source: https://arxiv.org/pdf/2109.06835.pdf

Pоскольку AMT neklade žádné omezení na počet úkolů, které může jeden pracovník přijmout, objevili se “velcí hráči” AMT, kteří mají (ziskové) pověsti pro dokončení vysokého počtu úkolů za experiment. Aby se kompenzovalo za přijaté úkoly od stejného pracovníka, výzkumníci měřili čas mezi po sobě jdoucími odeslanými úkoly, srovnávali začátek a konec každého úkolu. Takto se nedostatek mezi hlášeným WorkTimeInSeconds a skutečným časem stráveným na úkolu stal zřetelným.

Pоскольку taková práce nemůže být provedena v těchto zkrácených časových rámcích, výzkumníci museli kompenzovat to:

‘Jako je nemožné pečlivě přečíst odstavec dlouhý příběh a vyhodnotit všechny čtyři vlastnosti za pouhých 13 sekund, měříme dopad na průměrné hodnocení, když filtrování pracovníků, kteří stráví příliš málo času na úkol… Konkrétně, odstraňujeme hodnocení od pracovníků, jejichž medián času je pod 40 s (což je nízká laťka), a najdeme, že v průměru asi 42% našich hodnocení je filtrováno (rozmezí 20-72% napříč všemi experimenty).’

Článek tvrdí, že chybně hlášený skutečný pracovní čas v AMT je “velkým problémem”, který je obvykle přehlížen výzkumníky, kteří používají tyto služby.

Ruční vedení nutné

Zjištění dále naznačují, že pracovníci AMT nemohou spolehlivě rozlišit mezi textem napsaným člověkem a textem napsaným strojem, pokud nevidí oba texty vedle sebe, což by efektivní vyhodnocení znemožnilo (kde by čtenář měl být schopen učinit závěr na základě jediného vzorku textu, “reálného” nebo uměle generovaného).

Přijetí nízkokvalitního umělého textu

Pracovníci AMT konzistentně hodnotili nízkokvalitní umělý text založený na GPT na stejné úrovni jako vyšší kvalitní, soudržný text psaný lidmi, na rozdíl od anglických učitelů, kteří snadno rozlišovali rozdíl v kvalitě.

Žádná přípravná doba, nulový kontext

Vstup do správné mysli pro tak abstraktní úkol, jako je hodnocení autenticity, nepřichází přirozeně; anglickým učitelům bylo třeba 20 úkolů, aby se kalibrovali do hodnotícího prostředí, zatímco pracovníci AMT obvykle nedostávají žádnou “orientační dobu” vůbec, což snižuje kvalitu jejich vstupu.

Hraní systému

Zpráva uvádí, že celkový čas, který pracovníci AMT stráví na jednotlivých úkolech, je zanášen pracovníky, kteří přijímají několik úkolů současně, a procházejí úkoly v různých záložkách prohlížeče, místo aby se soustředili na jeden úkol po zaznamenanou dobu úkolu.

Země původu je důležitá

Výchozí nastavení AMT nefiltruje pracovníky podle země původu, a zpráva uvádí předchozí práci, která ukazuje, že pracovníci AMT používají VPN k obejití geografických omezení, umožňujících ne-rodným mluvčím předstírat, že jsou rodnými mluvčími (v systému, který perhaps rather naivně, rovná se pracovníkovu mateřštině s jeho IP-založenou geografickou polohou).

Takže výzkumníci zopakovali hodnocení testů na AMT s filtry, které omezily potenciální pracovníky na non-anglicky mluvící země, a zjistili, že ‘pracovníci z non-anglicky mluvících zemí hodnotili soudržnost, relevanci a gramatiku…signifikantně nižší než identicky kvalifikovaní pracovníci z anglicky mluvících zemí’.

Zpráva uzavírá:

‘[Expert] hodnotitelé, jako jsou lingvisté nebo jazykoví učitelé, by měli být použiti, kdykoli je to možné, protože již byli školeni k hodnocení psaného textu, a není to mnohem dražší…’

Publikováno 16. září 2021 – Aktualizováno 18. prosince 2021: Přidány tagy