Umělá inteligence

RigNeRF: Nová metoda Deepfakes, která využívá Neural Radiance Fields

Nová výzkum vyvinutý v Adobe nabízí první životaschopnou a efektivní metodu Deepfakes založenou na Neural Radiance Fields (NeRF) – perhaps the first real innovation in architecture or approach in the five years since the emergence of deepfakes in 2017.

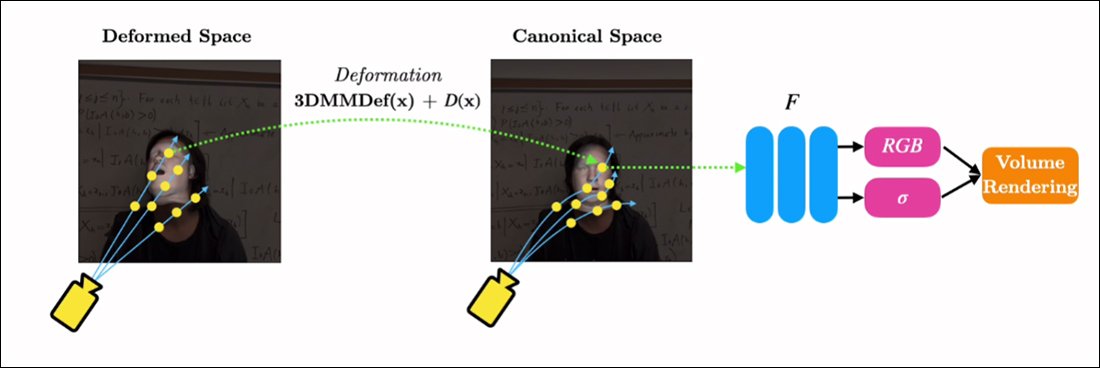

The method, titled RigNeRF, uses 3D morphable face models (3DMMs) as an interstitial layer of instrumentality between the desired input (i.e. the identity to be imposed into the NeRF render) and the neural space, a method that has been widely adopted in recent years by Generative Adversarial Network (GAN) face synthesis approaches, none of which have yet produced functional and useful face-replacement frameworks for video.

Unlike traditional deepfake videos, absolutely none of the moving content pictured here is ‘real’, but rather is an explorable neural space that was trained on brief footage. On the right we see the 3D morphable face model (3DMM) acting as an interface between the desired manipulations (‘smile’, ‘look left’, ‘look up’, etc.) and the usually-intractable parameters of a Neural Radiance Field visualization. For a high-resolution version of this clip, along with other examples, see the project page, or the embedded videos at the end of this article. Source: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs jsou efektivní CGI modely obličejů, jejichž parametry lze přizpůsobit více abstraktním obrazovým syntetickým systémům, jako je NeRF a GAN, které jsou jinak obtížně ovladatelné.

Co vidíte na obrázku výše (střední obrázek, muž v modré košili), stejně jako na obrázku přímo níže (levý obrázek, muž v modré košili), není ‘reálné’ video, do kterého byl vložen malý patch ‘falešné’ tváře, ale zcela syntetizovaná scéna, která existuje pouze jako volumetrická neuronová renderovací scéna – včetně těla a pozadí:

V příkladu přímo výše je reálné video vpravo (žena v červeném šatu) použito k ‘ovládání’ zachycené identity (muž v modré košili) vlevo pomocí RigNeRF, který (autoři tvrdí) je první NeRF-založený systém, který dosáhl oddělení postoje a výrazu a současně dokáže provádět novou syntézu pohledů.

Mužská postava vlevo na obrázku výše byla ‘zachycena’ z 70sekundového videa pořízeného smartphonem a vstupní data (včetně celkové scény) byla poté trénována na 4 V100 GPU, aby se získala scéna.

Pоскольку 3DMM-style parametrické rigy jsou také k dispozici jako celkové parametrické CGI proxy (a not only obličejové rigy), RigNeRF potenciálně otevírá možnost plných deepfakes, kde skutečné lidské pohyby, textura a výraz jsou předány do CGI-založené parametrické vrstvy, která by poté přeložila akci a výraz do renderovaných NeRF prostředí a videí.

Co se týče RigNeRF – kvalifikuje se jako metoda deepfakes v současném smyslu, jak jej chápou titulky? Nebo je to jen další polo-funkční metoda, podobná DeepFaceLab a jiným laboriosním, 2017-era autoencoder deepfake systémům?

Výzkumníci z nového článku jsou jednoznační v tomto bodě:

‘Being a method that is capable of reanimating faces, RigNeRF is prone to misuse by bad actors to generate deep-fakes.’

Nový článek je nazvaný RigNeRF: Fully Controllable Neural 3D Portraits a pochází od ShahRukh Athara z Univerzity Stonybrook, stážisty v Adobe během vývoje RigNeRF, a čtyř dalších autorů z Adobe Research.

Beyond Autoencoder-Based Deepfakes

Většina virálních deepfakes, které získaly pozornost v posledních letech, jsou produkovány autoencoder-založenými systémy, odvozenými z kódu, který byl publikován na subredditu r/deepfakes v roce 2017 – aunque not before being copied over to GitHub, kde byl目前 forkován over a thousand times, not least into the popular (if controversial) DeepFaceLab distribution, and also the FaceSwap project.

Kromě GAN a NeRF také autoencoderové rámce experimentovaly s 3DMM jako ‘návod’ pro vylepšené obličejové syntetické rámce. Příkladem toho je HifiFace project z července 2021. Nicméně, žádná použitelná nebo populární iniciativa se zdá být vyvinuta z tohoto přístupu do současnosti.

Data pro scény RigNeRF jsou získávána pomocí krátkých videí pořízených smartphonem. Pro projekt výzkumníci z RigNeRF použili iPhone XR nebo iPhone 12 pro všechny experimenty. Pro první polovinu zachycení je subjekt požádán, aby provedl širokou škálu obličejových výrazů a řeči, zatímco drží hlavu stále, zatímco kamera se pohybuje kolem nich.

Pro druhou polovinu zachycení kamera udržuje pevnou pozici, zatímco subjekt musí pohybovat hlavou kolem, zatímco projevuje širokou škálu výrazů. Výsledné 40-70 sekundy footage (around 1200-2100 frames) představuje celý dataset, který bude použit pro trénování modelu.

Cutting Down on Data-Gathering

Na rozdíl od toho autoencoderové systémy, jako je DeepFaceLab, vyžadují relativně laboriosné shromažďování a kuraci tisíce rozmanitých fotografií, často pořízených z YouTube videí a dalších sociálních médií, stejně jako z filmů (v případě deepfakes celebrit).

Výsledné trénované autoencoderové modely jsou často určeny k použití v různých situacích. Nicméně, nejpečlivější ‘celebrity’ deepfakers mohou trénovat celé modely od začátku pro jeden video, navzdory skutečnosti, že trénování může trvat týden nebo více.

Navzdory varovnému poznámce z nového článku výzkumníci, ‘patchwork’ a široce sestavené datové sady, které pohání AI porn a populární YouTube/TikTok ‘deepfake recastings’, se zdají nepravděpodobné, že by produkovaly přijatelné a konzistentní výsledky v deepfake systému, jako je RigNeRF, který má scénář-specifickou metodologii. Vzhledem k omezením na zachycení dat uvedeným v novém článku, to může prokázat, do jisté míry, další bezpečnostní opatření proti neoprávněnému zneužití identity ze strany zlých deepfakers.

Adapting NeRF to Deepfake Video

NeRF je fotogrammetrická metoda, ve které je malý počet zdrojových obrázků pořízených z různých úhlů sestaven do prozkoumatelného 3D neuronového prostoru. Tento přístup získal na významu na začátku tohoto roku, kdy NVIDIA představila svůj Instant NeRF systém, schopný snížit enormní trénovací časy pro NeRF na minuty, nebo dokonce sekundy:

Instant NeRF. Source: https://www.youtube.com/watch?v=DJ2hcC1orc4

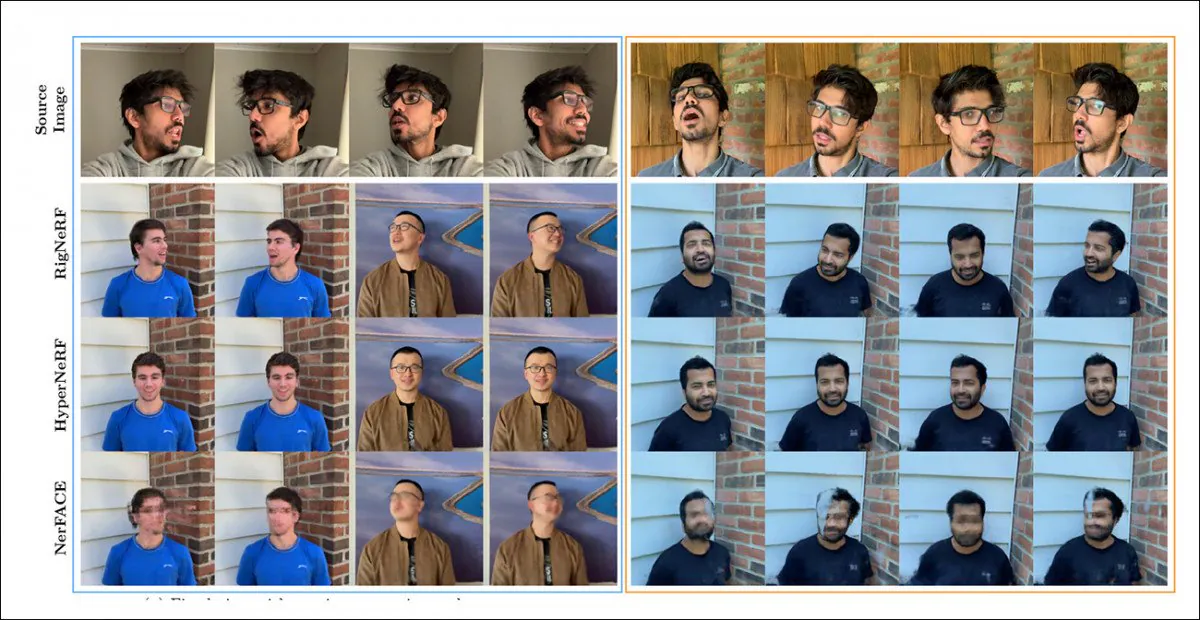

Výsledná Neural Radiance Field scéna je esenciálně statické prostředí, které lze prozkoumat, ale které je obtížné editovat. Výzkumníci poznamenávají, že dvě předchozí NeRF-založené iniciativy – HyperNeRF + E/P a NerFACE – se pokusily o syntézu obličejového videa, a (zdá se pro úplnost a důkladnost) nastavily RigNeRF proti těmto dvěma rámcům v testovacím kole:

A qualitative comparison between RigNeRF, HyperNeRF, and NerFACE. See the linked source videos and PDF for higher-quality versions. Static image source: https://arxiv.org/pdf/2012.03065.pdf

Nicméně, v tomto případě výsledky, které favorizují RigNeRF, jsou poměrně anomální, z dvou důvodů: poprvé, autoři poznamenávají, že ‘there is no existing work for an apple-to-apple comparison’; secondly, to vyžadovalo omezit schopnosti RigNeRF, aby alespoň částečně odpovídaly více omezené funkčnosti předchozích systémů.

Pоскольку výsledky nejsou.incrementální zlepšení předchozích prací, ale spíše představují ‘breakthrough’ v editovatelnosti a užitnosti NeRF, budeme testovací kolo odložit, a místo toho se podíváme, co RigNeRF dělá jinak než jeho předchůdci.

Combined Strengths

Hlavní omezení NerFACE, které může vytvářet kontrolu postoje a výrazu v NeRF prostředí, spočívá v tom, že předpokládá, že zdrojové video bude pořízeno statickou kamerou. To efektivní znamená, že nemůže produkovat nové pohledy, které přesahují jeho zachycení.

HyperNeRF, na druhé straně, zatímco může generovat nové a hyper-reálné pohledy, nemá žádný nástroj, který by mu umožnil měnit hlavy postoje nebo obličejové výrazy, což opět nevytváří žádný konkurent pro autoencoder-založené deepfakes.

RigNeRF je schopen kombinovat tyto dvě izolované funkčnosti vytvořením ‘kanonického prostoru’, výchozího základu, z kterého lze provádět odchylky a deformace pomocí vstupu z 3DMM modulu.

Creating a ‘canonical space’ (no pose, no expression), on which the deformations (i.e. poses and expressions) produced via the 3DMM can act.

Pоскольку 3DMM systém nebude přesně odpovídat zachycenému subjektu, je důležité kompenzovat to v procesu. RigNeRF dosahuje toho pomocí deformace pole předchozího, který je vypočten z Multilayer Perceptron (MLP) odvozeného ze zdrojového videa.

Kamerové parametry nezbytné pro výpočet deformací jsou získány pomocí COLMAP, zatímco parametry výrazu a tvaru pro každý snímek jsou získány z DECA.

Umístění je dále optimalizováno pomocí landmark fitting a kamerových parametrů COLMAP, a, kvůli omezením výpočetních zdrojů, je výstupní video downsampled na 256×256 rozlišení pro trénování (hardware-omezený proces, který také postihuje autoencoder deepfaking scénu).

Po tomto je deformace síť trénována na čtyřech V100 – formidabilním hardwarem, který není pravděpodobně dostupný pro běžné nadšence (nicméně, kde se jedná o trénování strojového učení, je často možné obchodovat heft za čas, a prostě přijmout, že modelové trénování bude záležitostí dnů nebo dokonce týdnů).

Na závěr výzkumníci uvádějí:

‘In contrast to other methods, RigNeRF, thanks to the use of a 3DMM-guided deformation module, is able to model head-pose, facial expressions and the full 3D portrait scene with high fidelity, thus giving better reconstructions with sharp details.’

Viz vložené videa níže pro další podrobnosti a výsledky.

https://www.youtube.com/watch?v=q-SdWAfhVSM

https://www.youtube.com/watch?v=mEuqGy1ZlMA

First published 15th June 2022.