Andersonův úhel

Obnovení a editace lidských obrazů pomocí AI

Nová spolupráce mezi University of California Merced a Adobe nabízí pokrok ve stavu současného umění v dokončování lidských obrazů – veel studovaném úkolu “odhalení” zakrytých nebo skrytých částí obrazů lidí, pro účely jako virtuální vyzkoušení, animace a editace fotografií.

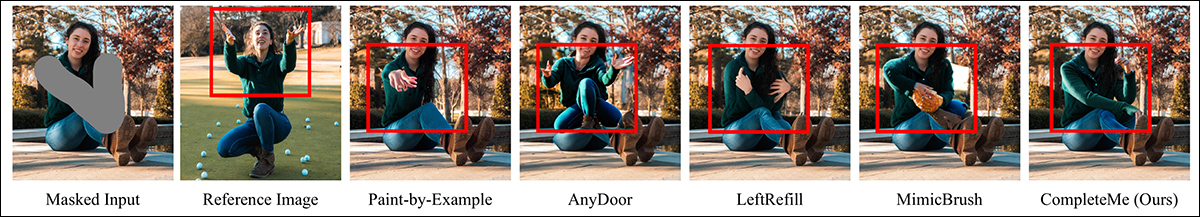

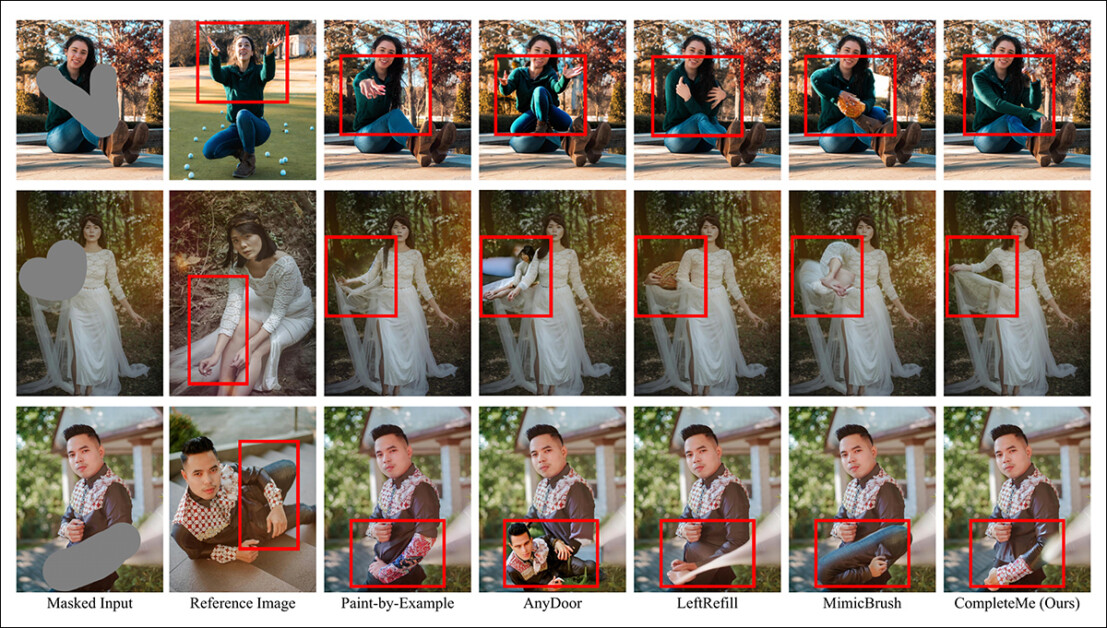

Kromě opravování poškozených obrazů nebo jejich změny podle libosti uživatele, systémy dokončování lidských obrazů, jako je CompleteMe, mohou vkládat nové oblečení (prostřednictvím vedlejší referenční obrazu, jako ve středním sloupci těchto dvou příkladů) do existujících obrazů. Tyto příklady jsou z rozsáhlého doplňkového PDF pro novou práci. Source: https://liagm.github.io/CompleteMe/pdf/supp.pdf

Nový přístup, nazvaný CompleteMe: Reference-based Human Image Completion, používá doplňkové vstupní obrazy, aby “navrhl” systému, jaký obsah by měl nahradit skrytou nebo chybějící část lidského zobrazení (a proto je použitelný pro rámce založené na módě):

Systém CompleteMe může přizpůsobit referenční obsah zakryté nebo zakryté části lidského obrazu.

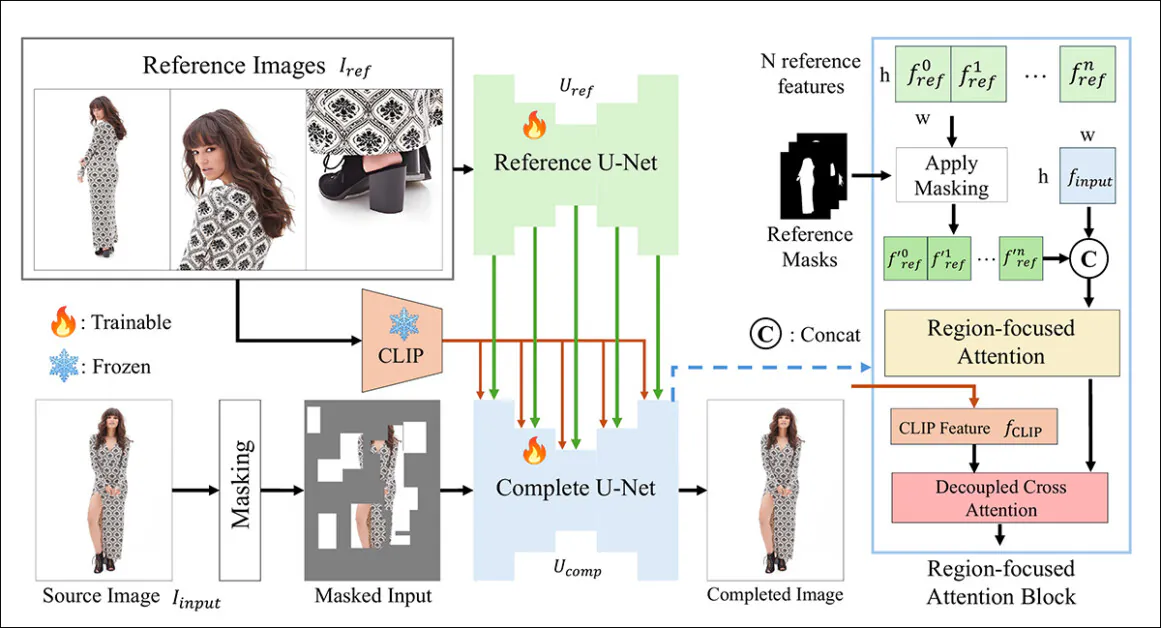

Nový systém používá dvojitou U-Net architekturu a Region-Focused Attention (RFA) blok, který soustředí zdroje na příslušnou oblast obnovy obrazu.

Výzkumníci také nabízejí nový a náročný benchmarkový systém navržen pro hodnocení úkolu dokončování založeného na referenci (protože CompleteMe je součástí stávající a probíhající výzkumné linie v počítačovém vidění, ačkoli dosud neměl žádný schéma benchmarku).

V testech a ve dobře provedené uživatelské studii nová metoda vyšla nejlepším způsobem v meisten metrikách a celkově. V určitých případech byly rivalové metody úplně zmateny referenčním přístupem:

Z doplňkového materiálu: metoda AnyDoor má zvláštní potíže s rozhodnutím, jak interpretovat referenční obraz.

Práce uvádí:

‘Rozsáhlé experimenty na našem benchmarku prokazují, že CompleteMe překonává stávající metody, a to jak reference-based, tak non-reference-based, z hlediska kvantitativních metrik, kvalitativních výsledků a uživatelských studií.

‘Zejména ve složitých scénářích zahrnujících komplexní pózy, složitý vzor oblečení a charakteristické doplňky naše model konzistentně dosahuje vyšší vizuální věrnosti a sémantické koherence.’

Bohužel, projektová GitHub přítomnost neobsahuje žádný kód, ani slibuje žádný, a iniciativa, která také má skromnou projektovou stránku, se zdá být rámována jako proprietární architektura.

Další příklad subjektivního výkonu nového systému proti předchozím metodám. Více detailů později v článku.

Metoda

Rámec CompleteMe je založen na Reference U-Net, který zpracovává integraci pomocných materiálů do procesu, a kohesivní U-Net, který akomoduje širší řadu procesů pro získání konečného výsledku, jak je znázorněno v konceptuálním schématu níže:

Konceptuální schéma pro CompleteMe. Source: https://arxiv.org/pdf/2504.20042

Systém nejprve kóduje maskovaný vstupní obraz do latentního zobrazení. Současně Reference U-Net zpracovává několik referenčních obrazů – každý zobrazující různé části těla – pro extrakci podrobných prostorových funkcí.

Tyto funkce procházejí Region-focused Attention blok vložený do “kompletního” U-Net, kde jsou selektivně maskovány pomocí odpovídajících regionálních masek, zajišťujících, aby se model soustředil pouze na relevantní oblasti referenčních obrazů.

Maskované funkce jsou poté integrovány s globálními CLIP-odvozenými sémantickými funkcemi prostřednictvím decoupled cross-attention, umožňující modelu rekonstruovat chybějící obsah s jemnými detaily a sémantickou koherencí.

Pro zlepšení realismu a robustnosti se vstupní maskovací proces kombinuje s náhodnými gridovými zakrytími a maskami lidského těla, každá aplikovaná s rovnou pravděpodobností, zvyšující složitost chybějících oblastí, které model musí dokončit.

Pouze pro referenci

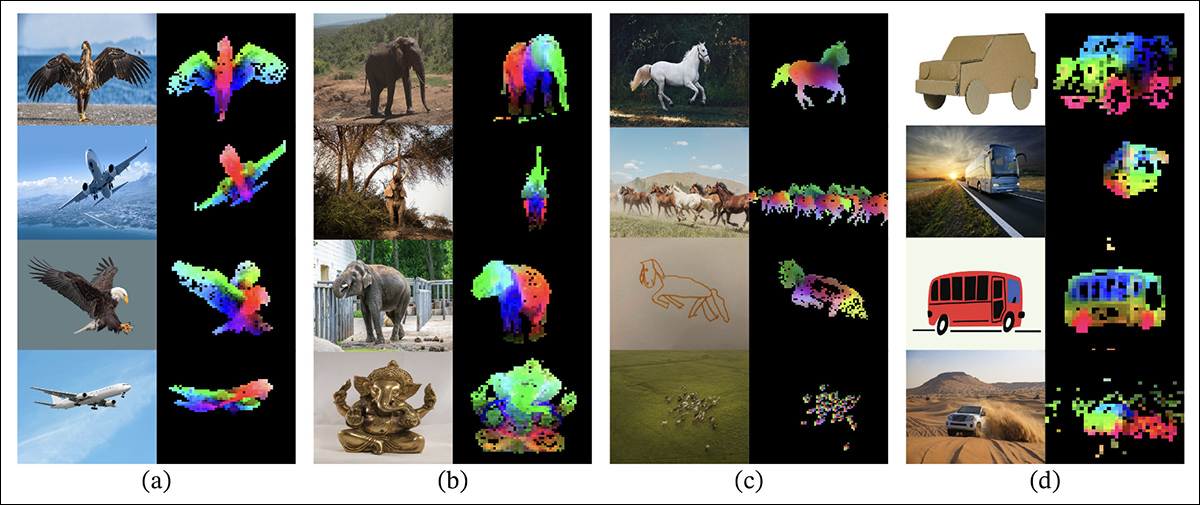

Předchozí metody pro reference-based image inpainting obvykle spoléhaly na sémantické úrovni kódéry. Projekty tohoto druhu zahrnují CLIP sám, a DINOv2, oba extrahují globální funkce z referenčních obrazů, ale často ztrácejí jemné prostorové detaily potřebné pro přesnou identitu.

Z vydání práce pro starší přístup DINOv2, který je zahrnut v porovnávacích testech v nové studii: Barevné překryvy ukazují první tři hlavní komponenty z Principal Component Analysis (PCA), aplikované na obrazové fragmenty v rámci každé sloupce, zdůrazňující, jak DINOv2 seskupuje podobné části objektů dohromady napříč různými obrazy. Source: https://arxiv.org/pdf/2304.07193

CompleteMe řeší tento aspekt prostřednictvím specializovaného Reference U-Net inicializovaného z Stable Diffusion 1.5, ale fungujícího bez difúzního šumu kroku*.

Každý referenční obraz, pokrývající různé části těla, je kódován do podrobných latentních funkcí prostřednictvím tohoto U-Net. Globální sémantické funkce jsou také extrahovány samostatně pomocí CLIP, a obě sady funkcí jsou uloženy pro efektivní použití během attention-based integrace. Tímto způsobem může systém akomodovat multiple referenční vstupy flexibilně, zatímco zachovává jemnozrnné vzhledové informace.

Orchestration

Kohesivní U-Net spravuje konečná stadia dokončovacího procesu. Adaptovaný z inpainting varianty Stable Diffusion 1.5, bere jako vstup maskovaný zdrojový obraz v latentní formě, spolu s podrobnými prostorovými funkcemi vytaženými z referenčních obrazů a globálními sémantickými funkcemi extrahovanými CLIP kódérem.

Tyto různé vstupy jsou spojeny prostřednictvím RFA bloku, který hraje kritickou roli při směrování modelovy pozornosti k nejrelevantnějším oblastem referenčního materiálu.

Před vstupem do attention mechanismu jsou referenční funkce explicitně maskovány, aby se odstranily nepříbuzné oblasti, a poté spojeny s latentním zobrazením zdrojového obrazu, zajišťujícím, aby pozornost byla směrována co nejprecizněji.

Pro zlepšení této integrace CompleteMe zahrnuje decoupled cross-attention mechanismus adaptovaný z IP-Adapter frameworku:

IP-Adapter, část kterého je začleněna do CompleteMe, je jedním z nejúspěšnějších a často využívaných projektů z posledních tří bouřlivých let vývoje v latentních difúzních modelových architekturách. Source: https://ip-adapter.github.io/

To umožňuje modelu zpracovat prostorově detailní vizuální funkce a širší sémantický kontext prostřednictvím samostatných attention proudů, které jsou později kombinovány, vedoucí k koherentní rekonstrukci, která, podle autorů, zachovává jak identitu, tak jemné detaily.

Benchmarking

Vzhledem k absenci vhodného datasetu pro reference-based human completion, výzkumníci navrhli svůj vlastní. Benchmark byl sestaven výběrem vybraných obrazových párů z datasetu WPose vytvořeného pro Adobe Research’s 2023 UniHuman projekt.

Příklady póz z Adobe Research 2023 UniHuman projektu. Source: https://github.com/adobe-research/UniHuman?tab=readme-ov-file#data-prep

Výzkumníci ručně nakreslili zdrojové masky, aby označili oblasti inpainting, nakonec získali 417 tripartitních obrazových skupin tvořících zdrojový obraz, masku a referenční obraz.

Dva příklady skupin odvozených původně z referenčního datasetu WPose a pečlivě kurátorovaných výzkumníky nové práce.

Autoři použili LLaVA Large Language Model (LLM) k vygenerování textových promptů popisujících zdrojové obrazy.

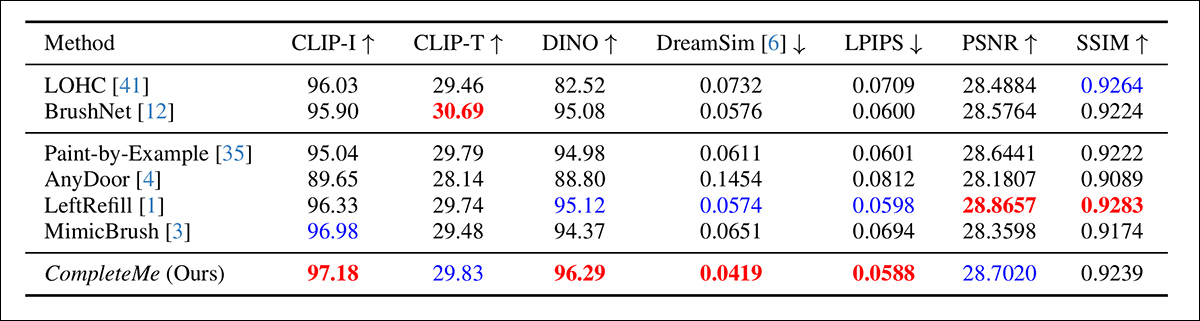

Metriky používané byly rozsáhlejší než obvykle; kromě obvyklého Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM) a Learned Perceptual Image Patch Similarity (LPIPS, v tomto případě pro hodnocení maskovaných oblastí), výzkumníci použili DINO pro podobnostní skóre; DreamSim pro hodnocení výsledků generování; a CLIP.

Data a testy

Pro testování práce autoři využili jak výchozí model Stable Diffusion V1.5, tak model 1.5 inpainting. Obrázky kódér systému používal CLIP Vision model, spolu s projekčními vrstvami – skromnými neuronovými sítěmi, které přebírají nebo zarovnávají výstupy CLIP, aby odpovídaly vnitřním funkcím rozměrů používaných modelem.

Školení proběhlo po 30 000 iteracích na osmi NVIDIA A100† GPU, pod dohledem Mean Squared Error (MSE) ztráty, při velikosti batche 64 a sazbě učení 2×10-5. Různé prvky byly náhodně odstraněny během školení, aby se zabránilo systému přeučení na datech.

Dataset byl modifikován z Parts to Whole datasetu, který je sám založen na DeepFashion-MultiModal datasetu.

Příklady z datasetu Parts to Whole, použitých ve vývoji kurátorovaných dat pro CompleteMe. Source: https://huanngzh.github.io/Parts2Whole/

Autoři uvádějí:

‘Abychom splnili naše požadavky, jsme [přebudovávali] trénovací páry pomocí zakrytých obrazů s několika referenčními obrazy, které zachycují různé aspekty lidského vzhledu spolu s jejich krátkými textovými štítky.

‘Každý vzorek v našich trénovacích datech zahrnuje šest typů vzhledu: oblečení horní části těla, oblečení spodní části těla, oblečení celého těla, vlasy nebo pokrývky hlavy, obličej a boty. Pro strategii maskování používáme 50% náhodného gridového maskování mezi 1 a 30 krát, zatímco pro zbývajících 50% používáme masku lidského těla, aby se zvýšila složitost maskovaných oblastí, které model musí dokončit.

‘Po konstrukční pipeline jsme získali 40 000 obrazových párů pro školení.’

Rivalové předchozí non-reference metody testované byly Large occluded human image completion (LOHC) a plug-and-play image inpainting model BrushNet; reference-based modely testované byly Paint-by-Example; AnyDoor; LeftRefill; a MimicBrush.

Autoři začali kvantitativní srovnáním na výše uvedených metrikách:

Výsledky počátečního kvantitativního srovnání.

Pokud jde o kvantitativní hodnocení, autoři uvádějí, že CompleteMe dosahuje nejvyšších skóre v meisten percepčních metrikách, včetně CLIP-I, DINO, DreamSim a LPIPS, které jsou určeny k zachycení sémantické shody a vzhledové věrnosti mezi výstupem a referenčním obrazem.

Nicméně, model nepřevyšuje všechny základní metody napříč celou deskou. Značně, BrushNet dosahuje nejvyššího skóre v CLIP-T, LeftRefill vede v SSIM a PSNR, a MimicBrush mírně převyšuje v CLIP-I.

Zatímco CompleteMe ukazuje konzistentně silné výsledky celkově, rozdíly ve výkonu jsou skromné v některých případech, a některé metriky zůstávají vedeny předchozími metodami. Možná ne zcela nespravedlivě, autoři rámují tyto výsledky jako důkaz vyvážené síly CompleteMe napříč både strukturními a percepčními rozměry.

Ilustrace pro kvalitativní testy provedené pro studii jsou příliš četné, aby je bylo možné zde reprodukovat, a odkazujeme čtenáře nejen na původní práci, ale také na rozsáhlý suplementní PDF, který obsahuje mnoho dalších kvalitativních příkladů.

Kvalitativní výsledky prezentované výše, autoři komentují:

‘Dané maskované vstupy, tyto non-reference metody generují pravděpodobný obsah pro maskované oblasti pomocí obrazových předloh nebo textových promptů.

‘Nicméně, jak je naznačeno v červené značce, nemohou reprodukovat specifické detaily, jako jsou tetování nebo jedinečné vzory oblečení, protože jim chybí referenční obrazy, které by směrovaly rekonstrukci identických informací.’

Druhé srovnání, část kterého je ukázána níže, se zaměřuje na čtyři reference-based metody Paint-by-Example, AnyDoor, LeftRefill a MimicBrush. Zde byl poskytnut pouze jeden referenční obraz a textový prompt.

Kvalitativní srovnání s reference-based metodami. CompleteMe produkuje více realistických dokončení a lépe zachovává specifické detaily z referenčního obrazu. Červené rámečky zdůrazňují oblasti zvláštního zájmu.

Autoři uvádějí:

‘Daný maskovaný lidský obraz a referenční obraz, jiné metody mohou generovat pravděpodobný obsah, ale často selhávají při zachování kontextuální informace z referenčního obrazu přesně.

‘V některých případech generují irelevantní obsah nebo nesprávně mapují odpovídající části z referenčního obrazu. Naopak, CompleteMe efektivně dokončuje maskovanou oblast, přesně zachovává identické informace a správně mapuje odpovídající části lidského těla z referenčního obrazu.’

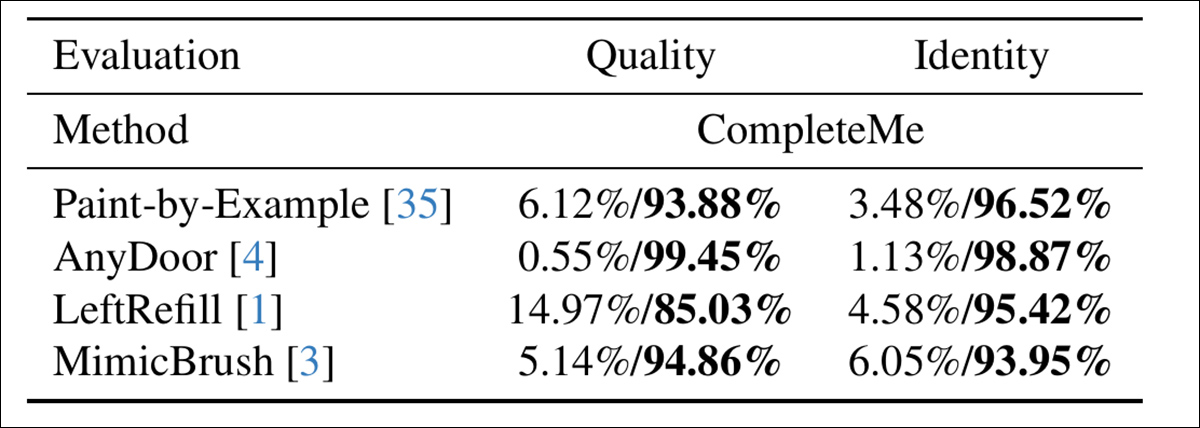

Aby se vyhodnotilo, jak dobře modely odpovídají lidskému vnímání, autoři provedli uživatelskou studii zahrnující 15 anotátorů a 2 895 vzorkových párů. Každý pár porovnával výstup CompleteMe proti jedné ze čtyř reference-based základních metod: Paint-by-Example, AnyDoor, LeftRefill nebo MimicBrush.

Anotátoři hodnotili každý výsledek na základě vizuální kvality dokončené oblasti a rozsahu, ve kterém zachovává identifikační rysy z referenčního obrazu – a zde, hodnotící celkovou kvalitu a identitu, CompleteMe získal více definitivní výsledek:

Výsledky uživatelské studie.

Závěr

Pokud něco, kvalitativní výsledky v této studii jsou podkopány jejich obrovským množstvím, protože detailní prohlížení ukazuje, že nový systém je velmi efektivní vstup v této relativně úzké, ale horkě sledované oblasti neuronového editování obrazů.

Nicméně, vyžaduje trochu více péče a přiblížení se k původnímu PDF, aby se ocenilo, jak dobře systém přizpůsobuje referenční materiál zakryté oblasti ve srovnání (v téměř všech případech) s předchozími metodami.

Doporučujeme čtenáři pečlivě prozkoumat původně matoucí, pokud ne přehlcující lavinu výsledků prezentovaných v suplementním materiálu.

* Je zajímavé poznamenat, jak nyní již zastaralá verze V1.5 zůstává favoritem výzkumníků – částečně kvůli legacy like-on-like testování, ale také proto, že je nejméně cenzurovaná a možná nejsnáze trénovatelná ze všech verzí Stable Diffusion, a nezdí se cenzurní omezení FOSS Flux verzí.

† VRAM specifikaci nebylo uvedeno – mohlo by to být buď 40GB nebo 80GB na kartu.

Poprvé publikováno v úterý, 29. dubna 2025