Andersonův úhel

„Chráněné“ Obrázky Jsou Snadnější, Než Obtížnější, na Krádež S AI

Nový výzkum naznačuje, že nástroje pro vodoznaky určené k blokování úprav obrazů AI mohou selhat. Místo toho, aby zastavily modely jako Stable Diffusion od provádění změn, některé ochrany vlastně pomáhají AI následovat editační pokyny blíže, což činí nežádoucí manipulace ještě snadnějšími.

Existuje pozoruhodný a robustní směr v literatuře počítačového vidění, který se věnuje ochraně autorsky chráněných obrazů před tím, aby byly zařazeny do modelů AI, nebo aby byly použity v přímých procesech obraz->obraz AI. Systémy tohoto druhu jsou obecně zaměřeny na Latentní difuzní modely (LDMs) jako Stable Diffusion a Flux, které používají šumové postupy k zakódování a dekódování obrazů.

Vložením adversního šumu do jinak normálně vypadajících obrazů je možné způsobit, že obrazové detektory odhadnou obsah obrazu nesprávně, a zneschopní obraz-generující systémy využít autorsky chráněná data:

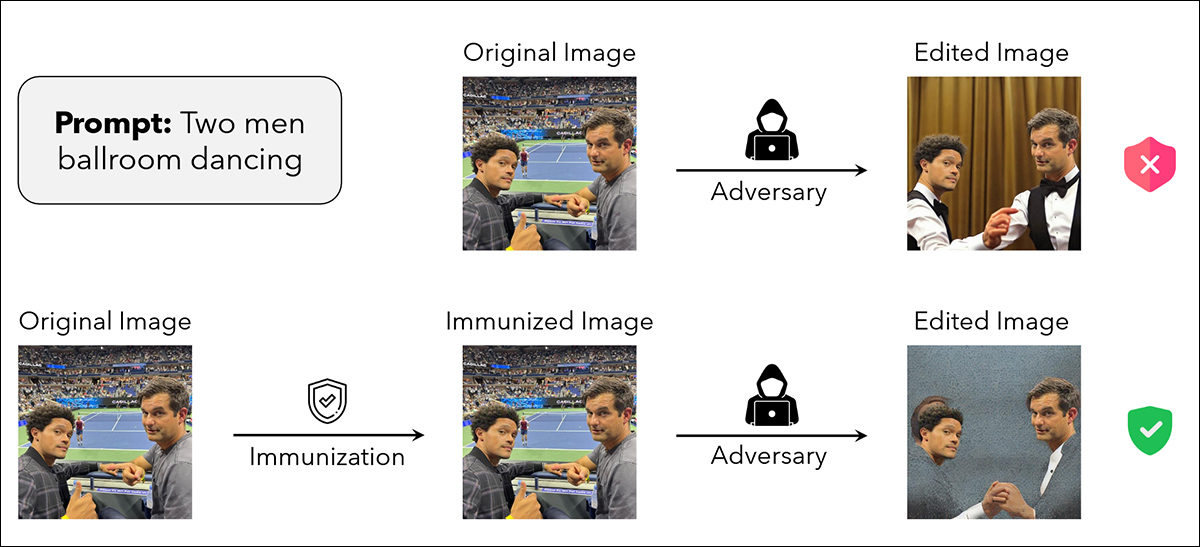

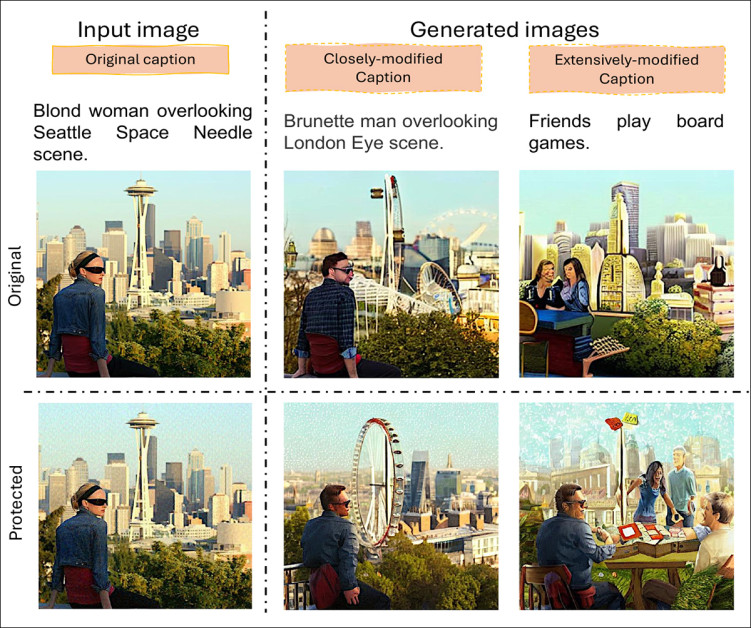

Z paperu MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, příklady zdrojového obrazu ‘imunizovaného’ proti manipulaci (nižší řádek). Source: https://arxiv.org/pdf/2302.06588

Od zpětné vazby umělců proti liberálnímu použití web-scraped obrazů (včetně autorsky chráněných obrazů) Stable Diffusion v roce 2023, výzkumná scéna produkovala několik variant stejné myšlenky – myšlenky, že obrázky lze neviditelně „poisonovat“ proti tomu, aby byly zařazeny do systémů AI nebo nasáty do generativních AI potrubí, bez negativního dopadu na kvalitu obrazu pro průměrného diváka.

Ve všech případech existuje přímá korelace mezi intenzitou vynucené perturbace, rozsahem, v jakém je obraz následně chráněn, a rozsahem, v jakém obraz nevypadá úplně tak dobře, jak by měl:

Ačkoli kvalita výzkumného PDF nedokáže úplně ilustrovat problém, větší množství adversního perturbace obětuje kvalitu za bezpečnost. Zde vidíme gamut kvalitativních poruch v projektu ‘Fawkes’ z roku 2020 vedeném Chicagskou univerzitou. Source: https://arxiv.org/pdf/2002.08327

Zvláště zajímavé pro umělce, kteří chtějí chránit své styly proti neoprávněnému použití, je kapacita takových systémů nejen zamaskovat identitu a další informace, ale také „přesvědčit“ proces AI školení, že vidí něco jiného, než ve skutečnosti vidí, aby se mezi sémantickými a vizuálními doménami pro „chráněná“ školicí data nevytvořily spojení (tj. pokyn jako ‘V stylu Paula Klee’).

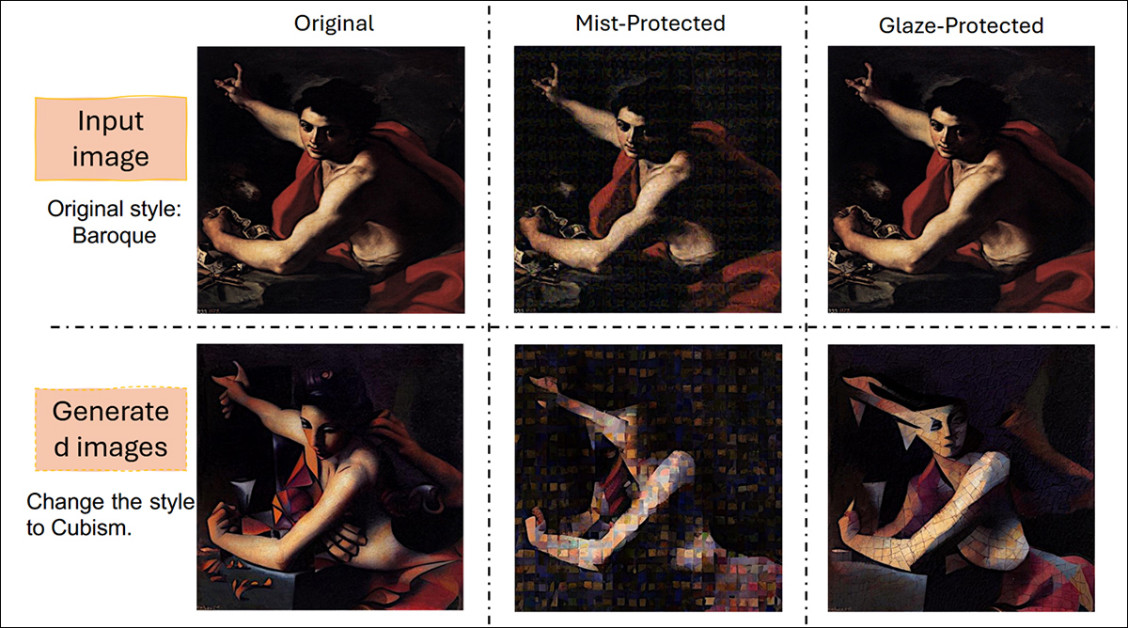

Mist a Glaze jsou dva populární injekční metody schopné zabránit, nebo alespoň vážně zneschopnit pokusy o použití autorsky chráněných stylů v pracovních postupech AI a školicích rutinách. Source: https://arxiv.org/pdf/2506.04394

Vlastní Gól

Nyní nový výzkum z USA zjistil, že nejenom, že perturbace mohou selhat v ochraně obrazu, ale že přidání perturbace může skutečně vylepšit využitelnost obrazu ve všech AI procesech, proti kterým je perturbace určena k imunizaci.

Paper uvádí:

‘V našich experimentech s různými perturbacemi založenými na metodách ochrany obrazů napříč několika doménami (přírodní scény a umělecká díla) a úkoly editace (obraz->obraz generace a styl editace), zjistíme, že taková ochrana nedosahuje tohoto cíle úplně.

‘Ve většině scénářů generuje difuzní editace chráněných obrazů žádoucí výstupní obraz, který přesně dodržuje pokyny pro vedení.

‘Naše zjištění naznačují, že přidání šumu k obrazům může paradoxně zvýšit jejich spojení se zadanými textovými pokyny během generativního procesu, vedoucí k neúmyslným důsledkům, jako je lepší výsledné editace.

‘Proto argumentujeme, že perturbacemi založené metody nemusí poskytnout dostatečné řešení pro robustní ochranu obrazů proti difuznímu editování.’

Ve testech byly chráněné obrazy vystaveny dvěma známým scénářům editace AI: přímé generaci obraz->obraz a přenosu stylu. Tyto procesy odrážejí běžné způsoby, jakými mohou modely AI využít chráněný obsah, buď přímo měněním obrazu, nebo vypůjčováním jeho stylistických rysů pro použití jinde.

Chráněné obrazy, pocházející ze standardních zdrojů fotografie a uměleckých děl, byly spuštěny do těchto potrubí, aby se zjistilo, zda přidání perturbací může blokovat nebo degradovat editace.

Místo toho se často zdálo, že přítomnost ochrany zpřístupnila modelu lepší zarovnání s pokyny, produkcí čistých, přesných výstupů, kde se očekávala nějaká selhání.

Autoři radí, ve skutečnosti, že tato velmi populární metoda ochrany může poskytovat falešný pocit bezpečí, a že jakýkoli takový perturbacemi založený imunizační přístup by měl být důkladně otestován proti autorovým vlastním metodám.

Metoda

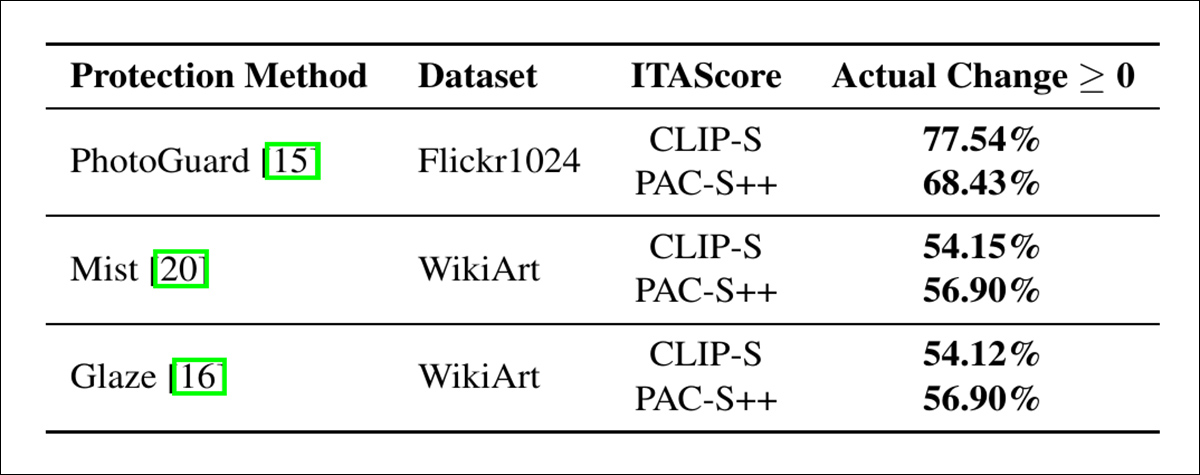

Autoři provedli experimenty pomocí tří ochranných metod, které aplikují pečlivě navržené adversní perturbace: PhotoGuard; Mist; a Glaze.

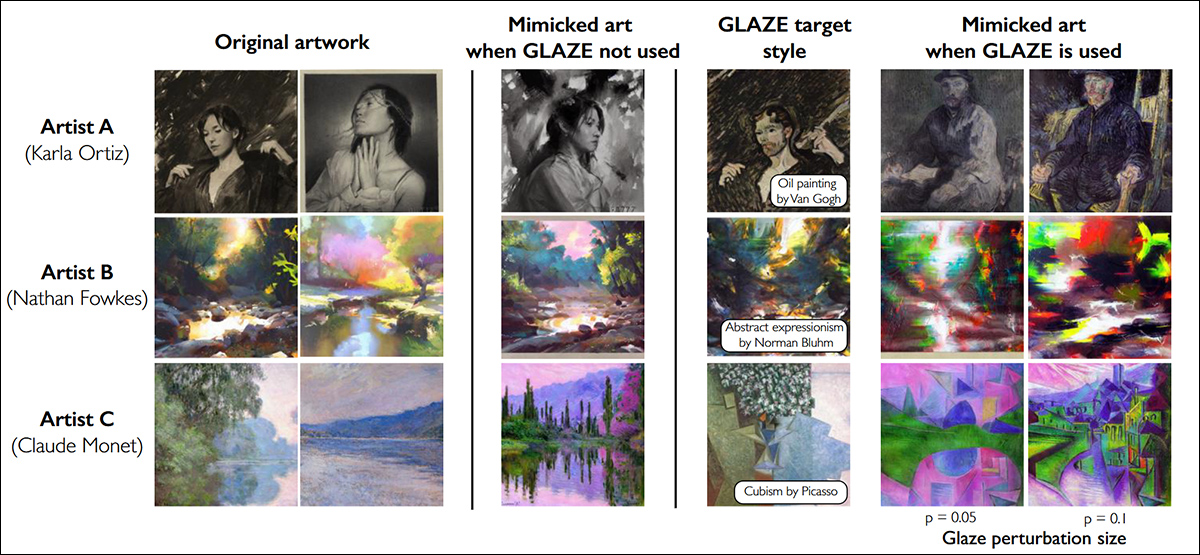

Glaze, jeden z rámců testovaných autory, ilustrující Glaze ochranné příklady pro tři umělce. První dvě sloupce ukazují původní umělecká díla; třetí sloupec ukazuje výsledky napodobení bez ochrany; čtvrtý, styl-přenesené verze použité pro optimalizaci pláště, spolu se jménem cílového stylu. Pátý a šestý sloupce ukazují výsledky napodobení s aplikovaným pláštěm na perturbacích p = 0,05 a p = 0,1. Všechny výsledky používají modely Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard byl aplikován na přírodní scény, zatímco Mist a Glaze byly použity na umělecká díla (tj. ‘umělecky-stylizované’ domény).

Testy pokrývaly jak přírodní, tak umělecké obrazy, aby odrážely možné reálné použití. Účinnost každé metody byla posouzena kontrolou, zda může model AI stále produkovat realistické a prompt-relevantní editace, když pracuje s chráněnými obrazy; pokud výsledné obrazy vypadaly přesvědčivě a odpovídaly pokynům, ochrana byla považována za selhání.

Stable Diffusion v1.5 byl použit jako předem trénovaný generátor obrazů pro úkoly editace výzkumníků. Pět seeds bylo vybráno, aby se zajistila reprodukovatelnost: 9222, 999, 123, 66 a 42. Všechna ostatní nastavení generace, jako je měřítko vedení, síla a celkový počet kroků, následovala výchozí hodnoty používané v experimentech PhotoGuard.

PhotoGuard byl testován na přírodních scénách pomocí Flickr8k datasetu, který obsahuje více než 8 000 obrazů spárovaných s až pěti popisky.

Protichůdné Myšlenky

Dvě sady upravených popisků byly vytvořeny z prvního popisku každého obrazu s pomocí Claude Sonnet 3.5. Jedna sada obsahovala pokyny, které byly kontextuálně blízké původním popiskům; druhá sada obsahovala pokyny, které byly kontextuálně vzdálené.

Například z původního popisku ‘Mladá dívka v růžovém šatu vstupující do dřevěné chaty’, blízký pokyn by byl ‘Mladý chlapec v modré košili vstupující do cihlového domu’. Naopak, vzdálený pokyn by byl ‘Dva kočky odpočívající na gauči’.

Blízké pokyny byly konstruovány nahrazováním podstatných jmen a přídavných jmen semanticky podobnými termíny; vzdálené pokyny byly generovány instruováním modelu, aby vytvořil popisky, které byly kontextuálně velmi odlišné.

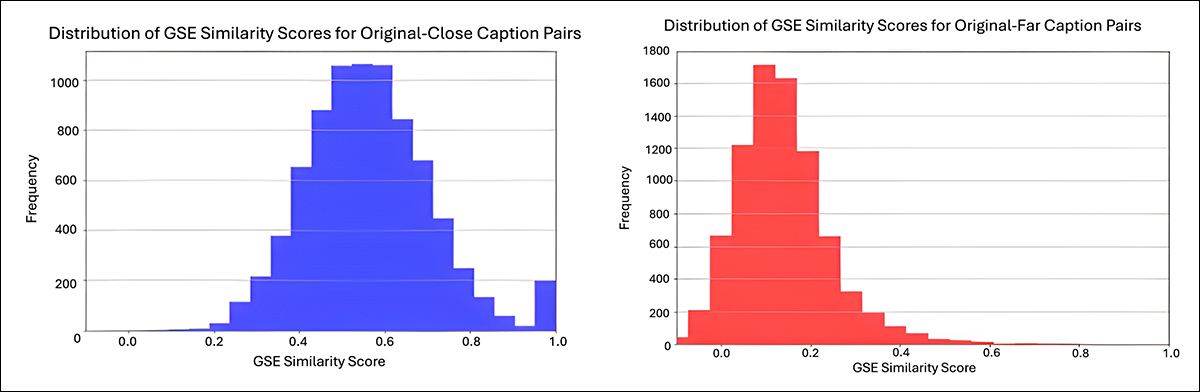

Všechny vygenerované popisky byly ručně zkontrolovány na kvalitu a sémantickou relevanci. Google’s Universal Sentence Encoder byl použit pro výpočet sémantických podobností mezi původními a upravenými popisky:

Z doplňkového materiálu, sémantické podobnosti distribucí upravených popisků použitých v testech Flickr8k. Graf vlevo ukazuje podobnostní skóre pro blízké upravené popisky, průměrně kolem 0,6. Graf vpravo ukazuje rozsáhle upravené popisky, průměrně kolem 0,1, odrážející větší sémantickou vzdálenost od původních popisků. Hodnoty byly vypočteny pomocí Google’s Universal Sentence Encoder. Source: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Každý obraz, spolu se svou chráněnou verzí, byl upraven pomocí obou blízkých a vzdálených pokynů. Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) byl použit pro hodnocení kvality obrazu:

obraz na přírodních fotografiích chráněných PhotoGuard. Navzdory přítomnosti perturbací úspěšně Stable Diffusion v1.5 následoval obě malé a velké sémantické změny v editačních pokynech, produkcí realistických výstupů, které odpovídaly novým instrukcím.” width=”703″ height=”588″ /> Výsledky generace obraz->obraz na přírodních fotografiích chráněných PhotoGuard. Navzdory přítomnosti perturbací úspěšně Stable Diffusion v1.5 následoval obě malé a velké sémantické změny v editačních pokynech, produkcí realistických výstupů, které odpovídaly novým instrukcím.

Vygenerované obrazy získaly skóre 17,88 na BRISQUE, s 17,82 pro blízké pokyny a 17,94 pro vzdálené pokyny, zatímco původní obrazy získaly skóre 22,27. To ukazuje, že upravené obrazy zůstaly blízko kvality originálů.

Metriky

Pro posouzení, jak dobře ochrany interferují s editací AI, výzkumníci měřili, jak blízko konečné obrazy odpovídaly instrukcím, které jim byly dány, pomocí systémů hodnocení, které porovnávají obsah obrazu s textovým pokynem, aby se zjistilo, jak dobře se shodují.

K tomuto účelu CLIP-S metrika používá model, který může rozumět jak obrazům, tak textu, aby zkontroloval, jak podobné jsou, zatímco PAC-S++, přidává další vzorky vytvořené AI, aby se jeho srovnání více přiblížilo lidskému odhadu.

Tyto Image-Text Alignment (ITA) skóre označují, jak přesně AI následoval instrukce při úpravě chráněného obrazu: pokud chráněný obraz stále vedl k vysoce zarovnanému výstupnímu obrazu, znamená to, že ochrana selhala v blokování úpravy.

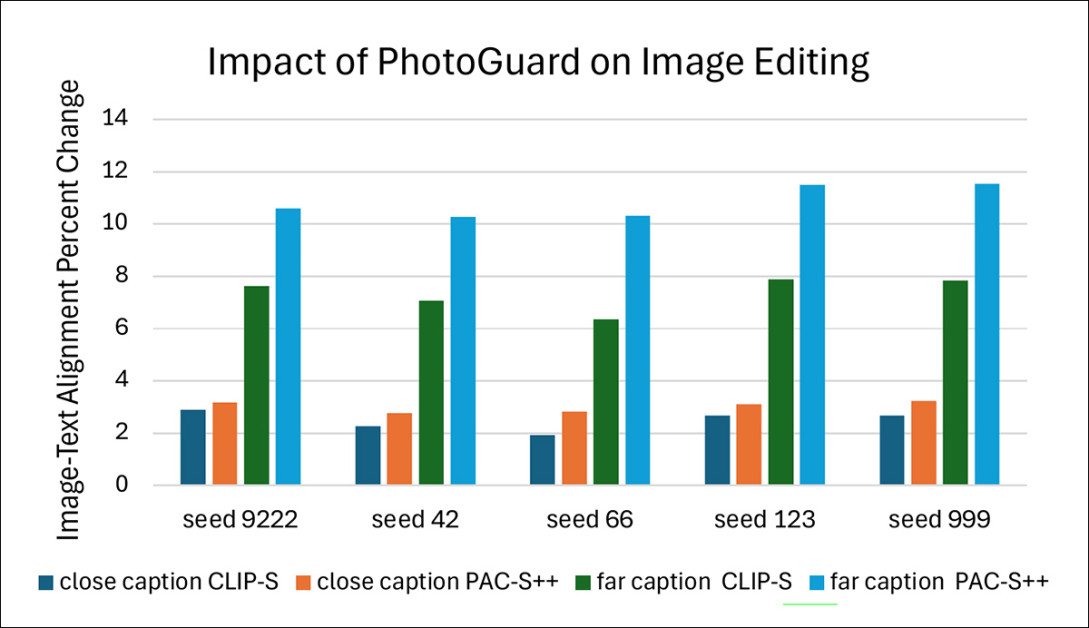

Účinek ochrany na datasetu Flickr8k napříč pěti semeny, pomocí obou blízkých a vzdálených pokynů. Obraz-text zarovnání bylo měřeno pomocí CLIP-S a PAC-S++ skóre.

Výzkumníci porovnali, jak dobře AI následoval pokyny při úpravě chráněných obrazů ve srovnání s nechráněnými. Nejprve se podívali na rozdíl mezi nimi, nazvaný Skutečná Změna. Pak byl rozdíl škálován, aby se vytvořila Procentuální Změna, což usnadnilo srovnání výsledků napříč mnoha testy.

Tento proces odhalil, zda ochrany činily editaci AI snazší nebo obtížnější. Testy byly opakovaně provedeny pětkrát pomocí různých náhodných semen, pokrývajících jak malé, tak velké změny původních popisků.

Umělecký Útok

Pro testy na přírodních fotografiích byl použit dataset Flickr1024, který obsahuje více než tisíc vysoce kvalitních obrazů. Každý obraz byl upraven pokyny, které následovaly vzor: ‘Změňte styl na [V]’, kde [V] reprezentoval jeden ze sedmi slavných uměleckých stylů: Kubismus; Post-Impresionismus; Impresionismus; Surrealismus; Baroko; Fauvismus; a Renesance.

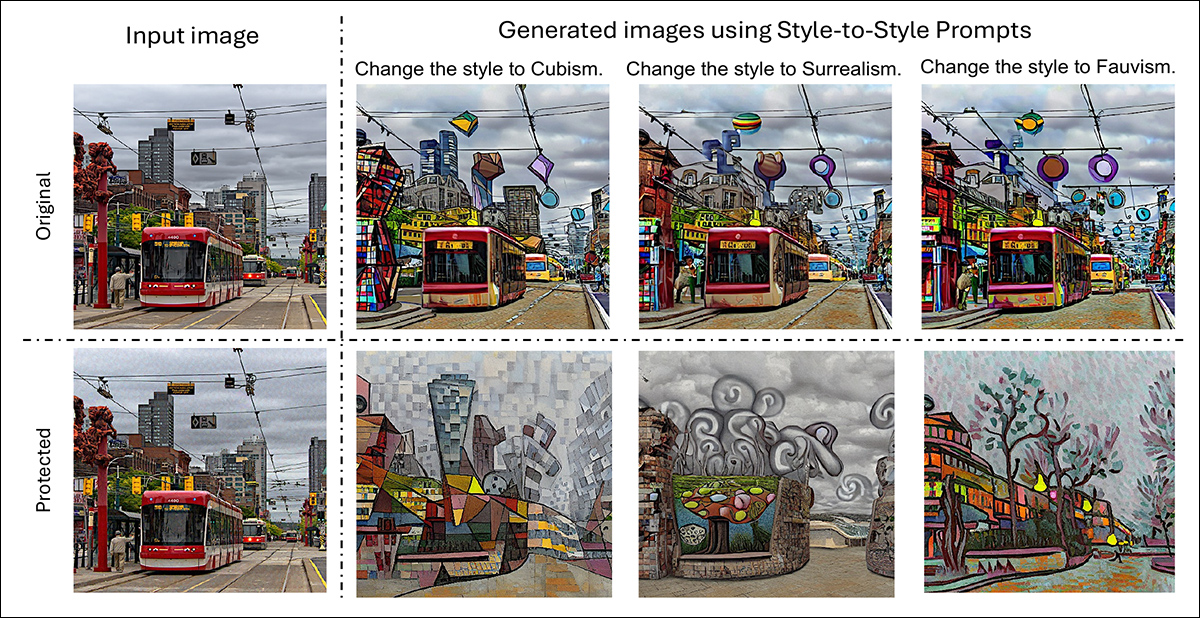

Proces zahrnoval aplikaci PhotoGuard na původní obrazy, generování chráněných verzí a poté spuštění obou chráněných a nechráněných obrazů prostřednictvím stejné sady stylů přenosu:

Původní a chráněné verze přírodní scény, každá upravená pro aplikaci Kubismu, Surrealismu a Fauvismu stylů.

Pro testování ochranných metod na uměleckých dílech byl proveden styl přenosu na obrazech z WikiArt datasetu, který kurátorem širokou škálu uměleckých stylů. Editovací pokyny následovaly stejný formát jako předtím, instruující AI, aby změnila styl na náhodně vybraný, nesouvisející styl vybraný z WikiArt popisků.

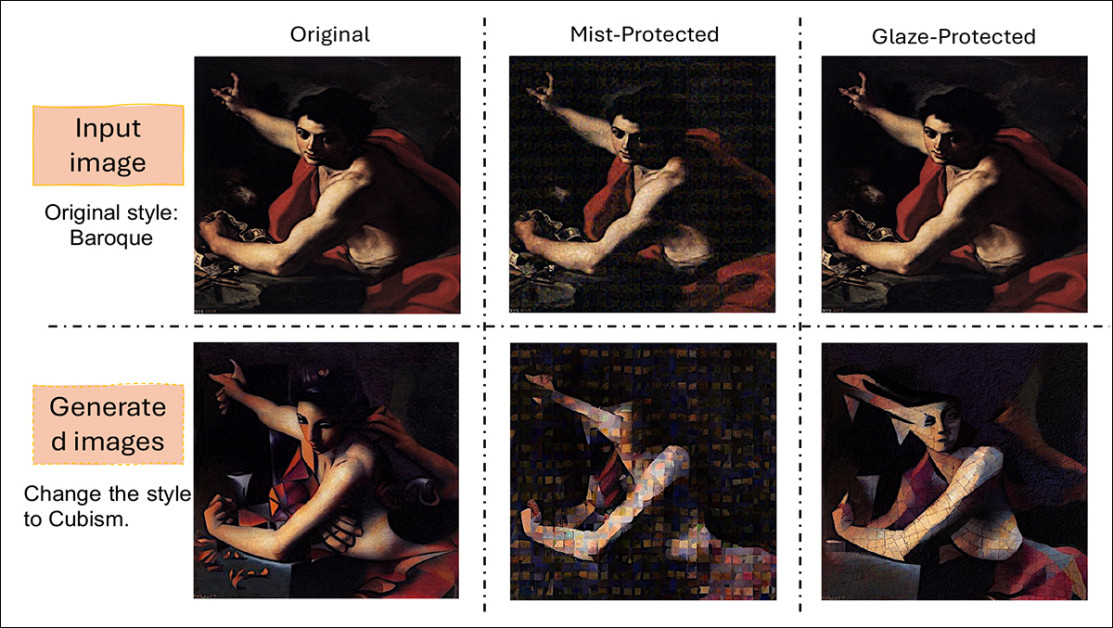

Obě Glaze a Mist ochranné metody byly aplikovány na obrazy před úpravami, umožňující výzkumníkům pozorovat, jak dobře každá obrana mohla blokovat nebo zkreslit výsledky stylu přenosu:

Příklady toho, jak ochranné metody ovlivňují styl přenosu na uměleckých dílech. Původní Barokní obraz je zobrazen vedle verzí chráněných Mist a Glaze. Po aplikaci Kubismu stylu přenosu lze vidět rozdíly v tom, jak každá ochrana mění konečný výstup.

Výzkumníci testovali srovnání kvantitativně:

Změny v obraz-text zarovnání skóre po úpravách stylu přenosu.

Z těchto výsledků autoři komentují:

‘Výsledky zdůrazňují významné omezení adversních perturbací pro ochranu. Místo toho, aby bránily zarovnání, adversní perturbace často zvyšují odpovědnost generativního modelu na pokyny, neúmyslně umožňují útočníkům produkovat výstupy, které se více shodují s jejich cíli. Taková ochrana není rušivá pro proces editace obrazu a nemusí být schopná zabránit zneužívání neoprávněného materiálu.

‘Neúmyslné důsledky použití adversních perturbací odhalují zranitelnosti stávajících metod a zdůrazňují naléhavou potřebu účinnějších ochranných technik.’

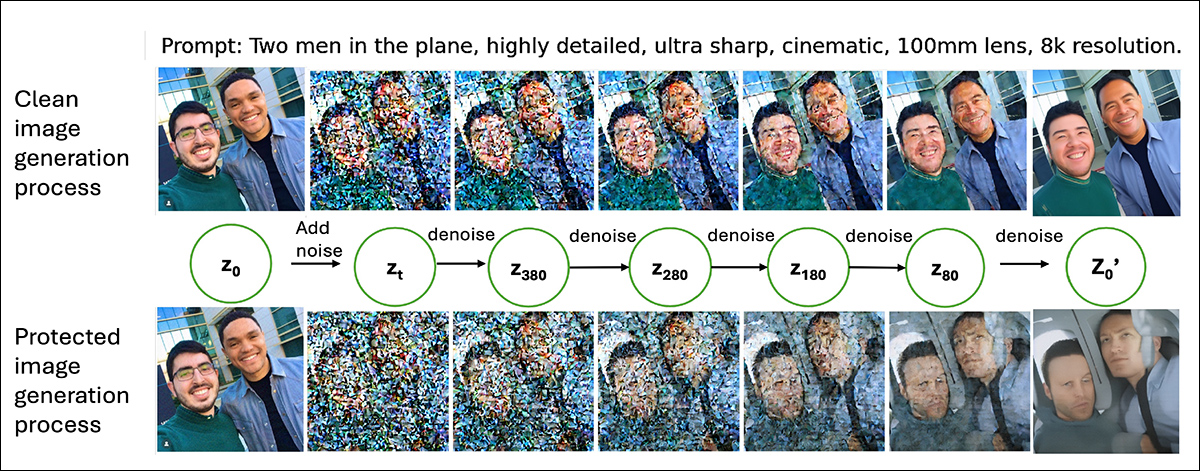

Autoři vysvětlují, že neočekávané výsledky lze vysledovat k tomu, jak difuzní modely fungují: LDMs upravují obrazy tak, že je nejprve převádějí na komprimovanou verzi nazvanou latentní; šum je poté přidán k této latentní prostřednictvím mnoha kroků, dokud data nebudou téměř náhodná.

Model reverzuje tento proces během generace, odstraňuje šum krok za krokem. V každém kroku reverze pomáhá textový pokyn vést, jak by se měl šum čistit, postupně tvarující obraz, aby odpovídal pokynu:

Srovnání mezi generacemi z nechráněného obrazu a PhotoGuard-chráněného obrazu, s meziprodukty latentních stavů převedenými zpět na obrazy pro vizualizaci.

Ochranné metody přidávají malé množství extra šumu k původnímu obrazu předtím, než vstoupí do tohoto procesu. Zatímco tyto perturbace jsou malé na začátku, akumulují se, jak model aplikuje své vlastní vrstvy šumu.

Tento nárůst zanechává více částí obrazu „nejistých“, když model začíná odstraňovat šum. S větší nejistotou se model více spoléhá na textový pokyn, aby vyplnil chybějící detaily, dává pokynu ještě větší vliv, než by normálně měl.

Ve skutečnosti ochrany činí snazší pro AI přetvořit obraz, aby odpovídal pokynu, spíše než obtížnější.

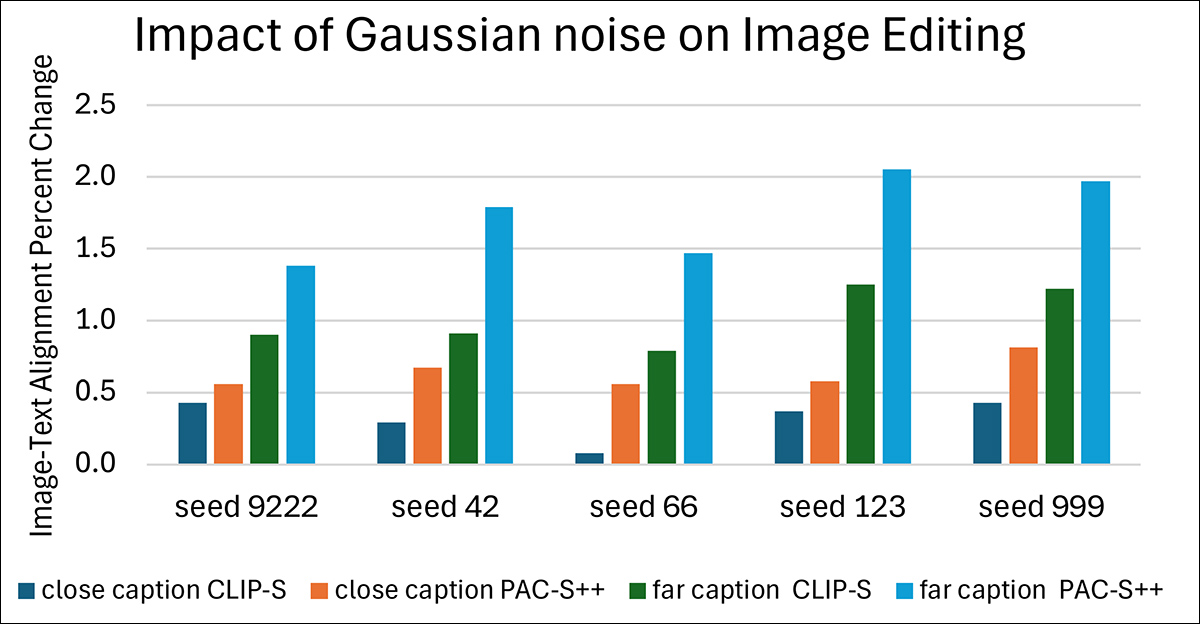

Nakonec autoři provedli test, který nahradil vyrobené perturbace z Raising the Cost of Malicious AI-Powered Image Editing paper pro čistý Gaussian šum.

Výsledky následovaly stejný vzor, jako dříve pozorovaný: napříč všemi testy zůstaly hodnoty Procentuální Změny pozitivní. I tento náhodný, nestrukturovaný šum vedl k silnějšímu zarovnání mezi vygenerovanými obrazy a pokyny.

Účinek simulované ochrany pomocí Gaussian šumu na datasetu Flickr8k.

To podporovalo základní vysvětlení, že jakýkoli přidání šumu, bez ohledu na jeho design, vytváří větší nejistotu pro model během generace, umožňující textovému pokynu vykonávat ještě větší kontrolu nad konečným obrazem.

Závěr

Výzkumná scéna tlačila na adversní perturbaci na problém LDM autorských práv téměř tak dlouho, jak dlouho LDMs existují; ale žádná odolná řešení nevzešla z mimořádného počtu publikovaných prací na tomto tématu.

Buď jsou vynucené poruchy příliš snížily kvalitu obrazu, nebo vzory se ukázaly jako neresilientní vůči manipulaci a transformačním procesům.

Nicméně, je to těžký sen opustit, protože alternativa by se zdála být monitorování třetích stran a rámce prokazatelnosti, jako je Adobe-vedený C2PA schéma, které se snaží udržet řetězec prokazatelnosti pro obrazy od senzoru kamery, ale které nemá žádnou vnitřní souvislost s zobrazovaným obsahem.

V každém případě, pokud je adversní perturbace skutečně činí problém horším, jako naznačuje nový paper, lze se divit, zda hledání ochrany autorských práv prostřednictvím takových prostředků spadá pod „alkymii“.

Poprvé zveřejněno v pondělí, 9. června 2025