Umělá inteligence

NeRF: Školení dronů v neuronových prostředích radiance

Výzkumníci ze Stanfordovy univerzity vyvinuli nový způsob školení dronů pro navigaci v fotorealistických a vysoce přesných prostředích, využívající recentní zával zájmu v Neuronových polích radiance (NeRF).

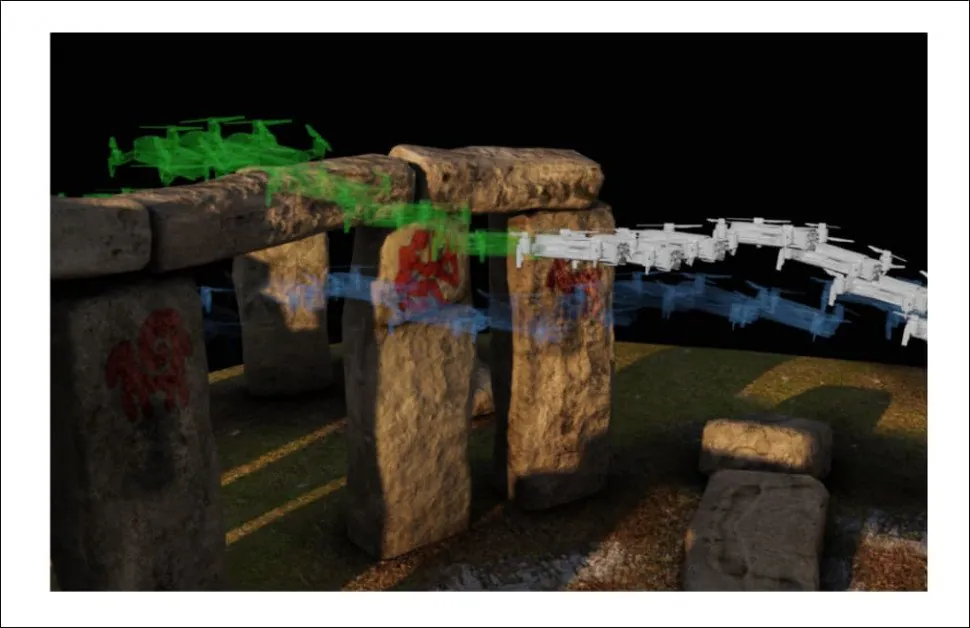

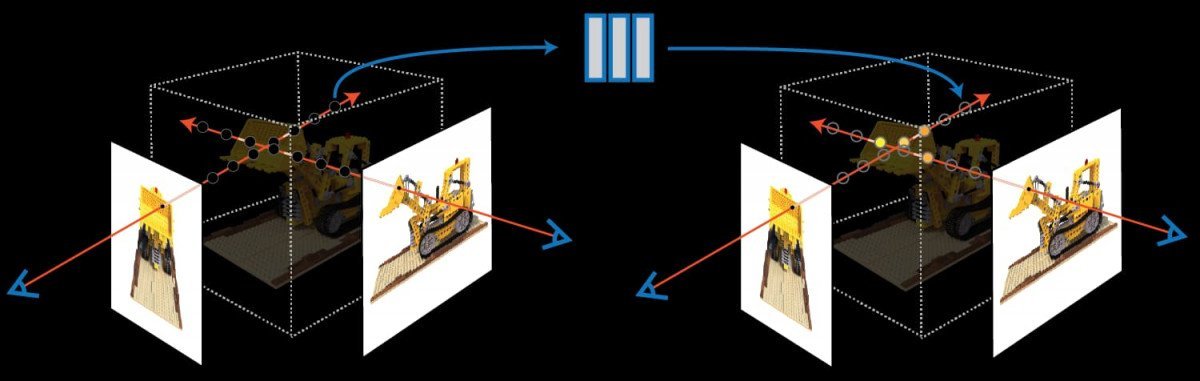

Drony lze školit ve virtuálních prostředích mapovaných přímo z reálných míst, bez potřeby specializované 3D rekonstrukce scény. Na tomto obrázku z projektu je přidána porucha větru jako potenciální překážka pro dron a vidíme, jak dron je na chvíli odchýlen od své trajektorie a kompenzuje v posledním okamžiku, aby se vyhnul potenciální překážce. Source: https://mikh3x4.github.io/nerf-navigation/

Metoda nabízí možnost interaktivního školení dronů (nebo jiných typů objektů) ve virtuálních scénářích, které automaticky zahrnují objemové informace (pro výpočet vyhýbání se kolizím), textury vytvořené přímo z reálných fotografií (pro pomoc při školení sítí rozpoznávání obrazů dronů realističtějším způsobem) a reálné osvětlení (pro zajištění rozmanitých osvětlovacích scénářů, aby se zabránilo přeučení nebo přepřičiněnému optimalizování původního snímku scény).

Objekt gauč prochází složitým virtuálním prostředím, které by bylo velmi obtížné mapovat pomocí geometrické zachycení a retexturování v tradičních pracovních postupech AR/VR, ale které bylo automaticky rekonstruováno v NeRF z omezeného počtu fotografií. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typické implementace NeRF nezahrnují mechanismy trajektorie, protože většina projektů NeRF v posledních 18 měsících se soustředila na jiné výzvy, jako je osvětlení scény, rendering odrazů, kompozice a disentanglement zachycených prvků.

NeRF jako VR/AR

Nová práce se jmenuje Vision-Only Robot Navigation in a Neural Radiance World a je spoluprací mezi třemi odděleními Stanfordovy univerzity: Aeronautika a astronautika, Mechanické inženýrství a Informatika.

Práce navrhuje navigační rámec, který poskytuje robotu předškoleno prostředí NeRF, jehož objemová hustota vymezuje možné dráhy pro zařízení. Zahrnuje také filtr pro odhad, kde se robot nachází ve virtuálním prostředí, na základě rozpoznávání obrazů z RGB kamery na palubě robota. Díky tomu může dron nebo robot “halucinovat” přesněji, co může očekávat v daném prostředí.

Optimalizátor trajektorie projektu prochází modelem Stonehenge, který byl vygenerován pomocí fotogrammetrie a interpretace obrazů (v tomto případě modelů mříží) do neuronového prostředí radiance. Plánovač trajektorie vypočítá několik možných drah, než stanoví optimální trajektorii přes oblouk.

Protože prostředí NeRF obsahuje plně modelované zakrytí, může dron se učit vypočítávat překážky snáze, protože neuronová síť za NeRF může mapovat vztah mezi zakrytím a způsobem, jakým systémy založené na vidění na palubě dronu vnímají prostředí. Automatický generovací pipeline NeRF nabízí relativně triviální metodu pro vytváření hyper-reálných školicích prostorů s pouhými několika fotografiemi.

Online framework pro opětovné plánování vyvinutý pro Stanfordský projekt usnadňuje odolný a zcela založený na vidění navigační pipeline.

Iniciativa Stanfordovy univerzity je mezi prvními, které zvažují možnosti prozkoumání prostoru NeRF v kontextu navigovatelného a imerzivního prostředí VR stylu. Neuronová pole radiance jsou vznikající technologií a v současné době jsou předmětem多 akademických úsilí optimalizovat jejich vysoké požadavky na výpočetní zdroje, stejně jako rozlišovat zachycené prvky.

NeRF není (skutečně) CGI

Protože prostředí NeRF je navigovatelnou 3D scénou, stalo se z něj nepochopená technologie od jeho vzniku v roce 2020, často široce vnímanou jako metodu automatizovaného vytváření mříží a textur, spíše než nahrazování 3D prostředí známých divákům z Hollywoodských efektů a fantastických scén prostředí Augmented Reality a Virtual Reality.

NeRF extrahuje geometrické a texturové informace z velmi omezeného počtu pohledů na obraz, vypočítává rozdíl mezi obrázky jako objemové informace. Source: https://www.matthewtancik.com/nerf

Ve skutečnosti je prostředí NeRF více jako “živé” renderovací prostor, kde je zachována a navigována kombinace pixelových a osvětlovacích informací v aktivní a běžící neuronové síti.

Klíč k potenciálu NeRF spočívá v tom, že vyžaduje pouze omezený počet obrázků pro rekonstrukci prostředí a že vygenerovaná prostředí obsahují všechny nezbytné informace pro vysokofidelityní rekonstrukci, bez potřeby služeb modelérů, texturových umělců, odborníků na osvětlení a dalších přispěvatelů k “tradičnímu” CGI.

Sémantická segmentace

I když NeRF účinně tvoří “počítačově generované obrázky” (CGI), nabízí zcela odlišnou metodologii a vysoce automatizovaný pipeline. Kromě toho může NeRF izolovat a “zabalenit” pohyblivé části scény, aby je bylo možné přidat, odebrat, urychlit a obecně provozovat jako samostatné prvky ve virtuálním prostředí – schopnost, která je daleko za současným stavem umění v “Hollywoodském” výkladu toho, co je CGI.

Spolupráce ze Šanghajské technické univerzity, zveřejněná v létě 2021, nabízí metodu pro individualizaci pohyblivých prvků NeRF do “vkládacích” prvků scény. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativně, architektura NeRF je trochu “černou skříňkou”; v současné době není možné extrahovat objekt z prostředí NeRF a přímo ho manipulovat s tradičními nástroji založenými na mřížích a obrazech, i když několik výzkumných úsilí začíná dosahovat průlomů v dekonstrukci matice za živým renderovacím prostředím neuronových polí radiance.

https://www.youtube.com/watch?v=5JjWpv9BaaE