Andersonův úhel

Jigsaw Puzzles Boost AI Visual Reasoning

Nová výzkum ukazuje, že modely AI mohou být chytřejší při vidění řešením puzzle. Přeuspořádání rozložených obrazů, videí a 3D scén jim pomáhá zlepšit své vizuální dovednosti bez potřeby dalších dat, štítků nebo nástrojů.

V současné době, kdy se všichni snaží tlačit Multimodální velké jazykové modely (MLLM) vpřed, nebo alespoň zůstat tři verze před nejbližším rivalem, existuje málo jednoduchých vítězství a žádné bezplatné obědy.

Ačkoli mnoho z impresivních čínských FOSS vydání z roku 2025 se uvádí, že mají nižší vývojové a provozní náklady, západní vydání mají tendenci házet více na problém: více objemu dat, více inferenčních možností, více elektřiny (i když ne, jak jsme nedávno poznamenali, více skutečných lidských anotátorů, protože to je příliš drahé i pro $trillion+ škálu gen-AI revoluce).

Ve výzkumné literatuře většina údajně “bezplatných” přístupů k evoluci architektur AI nabízí pouze malé incrementální zlepšení; nebo zlepšení v oblastech, které nejsou nejvíce kriticky sledovány. Přesto je hledání dosud neobjevených “základních principů”, které by mohly urychlit tempo vývoje, příliš lákavé, aby se vzdali.

Picking up the Pieces

Zatímco to není přesně v této kategorii, nová akademická spolupráce mezi čínskými institucemi tvrdí, že zjistila, že dělání VLM řešení puzzle zlepšuje jejich výkon pozoruhodně, i když tento reinforcement learning přístup dříve vykazoval špatné výsledky v této oblasti, a i když nevyžaduje žádné další systémy, pomocné modely nebo jiné “přidávací” procesy:

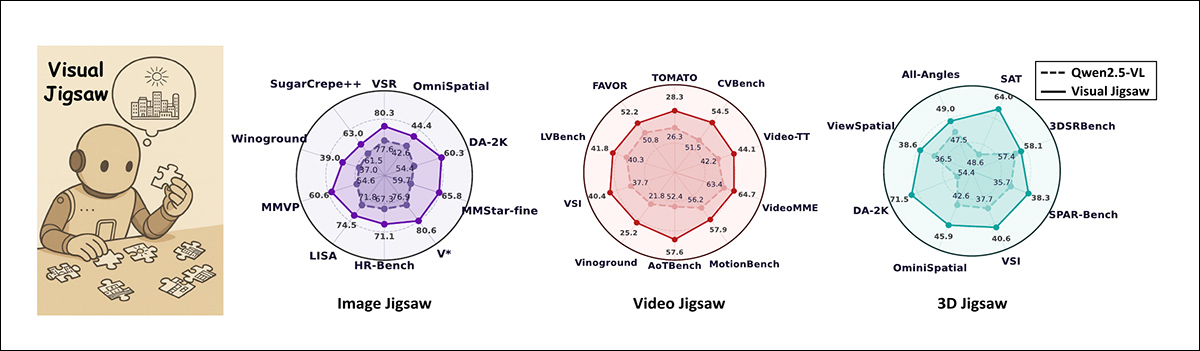

Visual Jigsaw je samo-seznamovací post-trénovací rámec, který zlepšuje vizuální dovednosti v multimodálních velkých jazykových modelech. Školením na puzzle úkolech napříč obrázky, videi a 3D daty modely získávají ostřejší jemné, prostorové a kompoziční vnímání v obrazech, silnější časové usuzování ve videích a vylepšené geometricky-orientované porozumění ve 3D scénách. Radarové grafy v obrázku výše ukazují konzistentní zlepšení oproti základnímu Qwen2.5-VL, s hodnotami měřítek upravenými pro každou benchmarck pro jasnost. Source: https://arxiv.org/pdf/2509.25190

Systém vytvořený výzkumníky se nazývá Visual Jigsaw a zahrnuje školení existujících MLLM na materiálu, který byl rozložen a náhodně rozptýlen, jako puzzle. Autoři vyvinuli tři modalitní verze pro tento přístup: obraz, video a 3D (tj. CGI-styl mřížky), a zjistili, že mírná adaptace stejného procesu prospěla všem třem doménám:

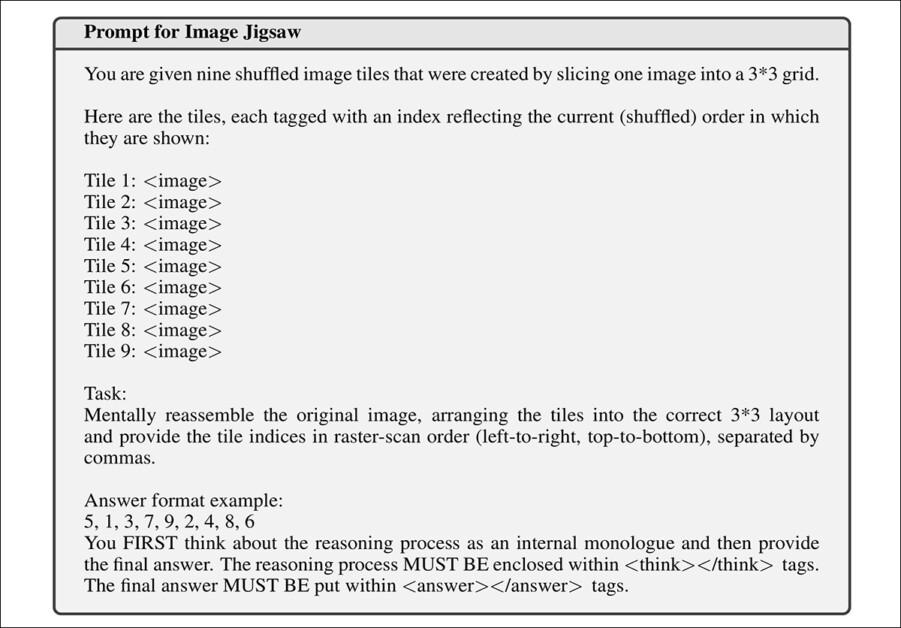

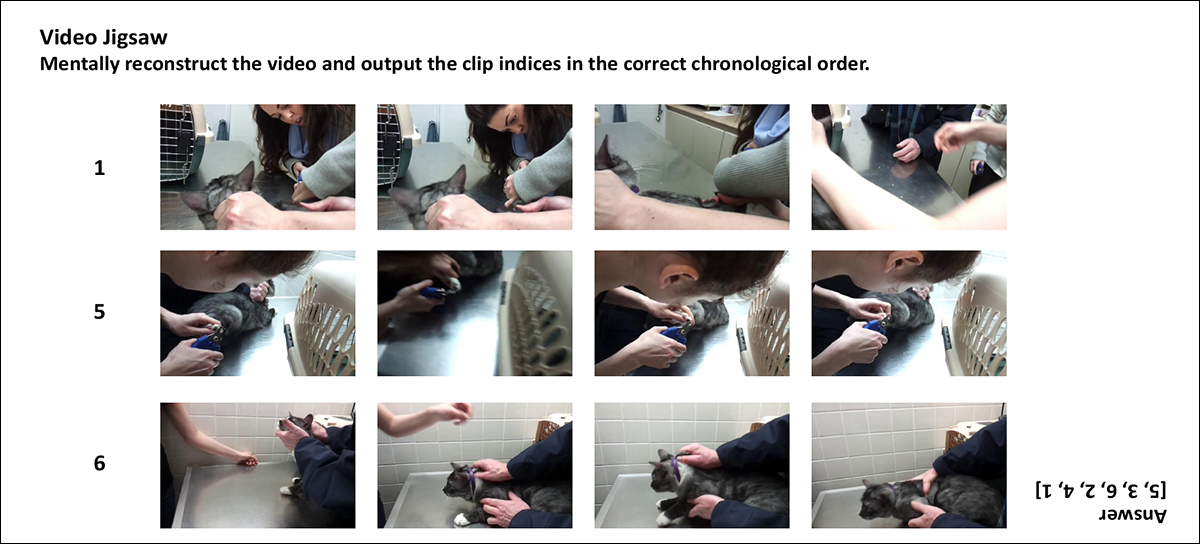

Zobrazení tří Visual Jigsaw úkolů. V Image Jigsaw je obraz rozdělen na fragmenty, promíchán a model předpovídá správnou dispozici; ve Video Jigsaw jsou klipy promíchány a model obnovuje jejich původní časové pořadí; ve 3D Jigsaw jsou body s různými hloubkami promíchány a model jeřazuje od nejbližšího po nejvzdálenější. Výstupy modelu jsou hodnoceny proti skutečnosti, s částečným kreditem za částečně správná řešení.

Školicí metoda Visual Jigsaw pomáhá modelům AI zlepšit porozumění vizuální informace tím, že je nutí znovu sestavit tyto rozložené obrázky, video klipy nebo 3D data.

Proces je založen na slovech spíše než na obrazech, a proto není třeba, aby model generoval obrázky nebo používal jakékoli další vizuální komponenty. Tato metoda se vejde do systému nazvaného Reinforcement Learning from Verifiable Rewards (RLVR), kde model dostává odměnu za správné odpovědi na základě jasných, automatických pravidel; a kde, proto, není třeba žádné lidské označení.

Tato kritická skutečnost je ve skutečnosti těžké získat z nového článku: že systém sestavuje puzzle semanticky, prostřednictvím popisů, a ne způsobem, který lidé učí, aby řešili takové puzzle:

Z nového článku dodatkového materiálu, příklad RL úkolu ilustrující textový charakter tohoto doprovodného učení procesu. Obrázky, které by byly zobrazeny MLLM, nejsou zde zobrazeny.

Ačkoli MLLM se zabývají rozsáhlými vizuálními úkoly, jsou jazykové architektury, ne navržené pro generování obrázků, videí nebo tvarových reprezentací, jako jsou 3D mřížky.

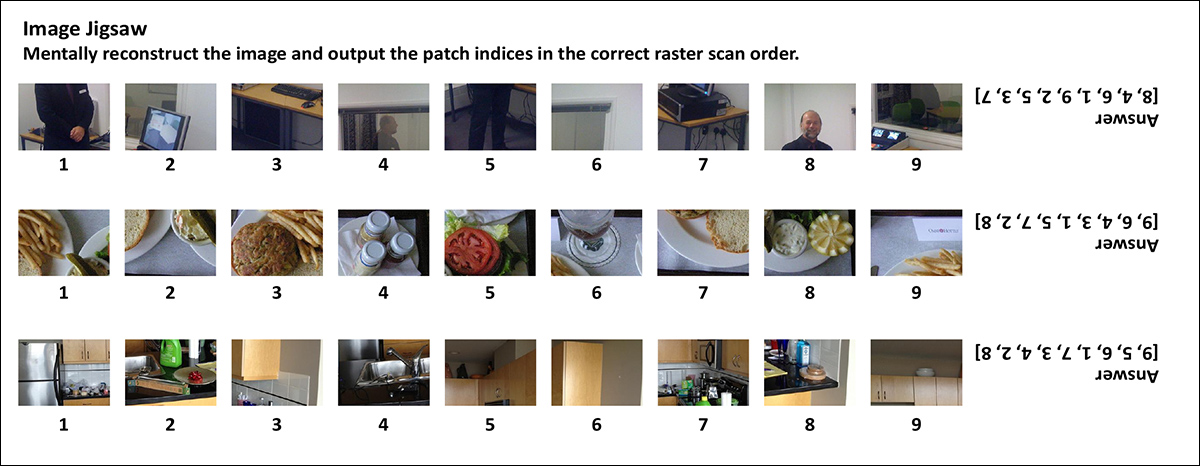

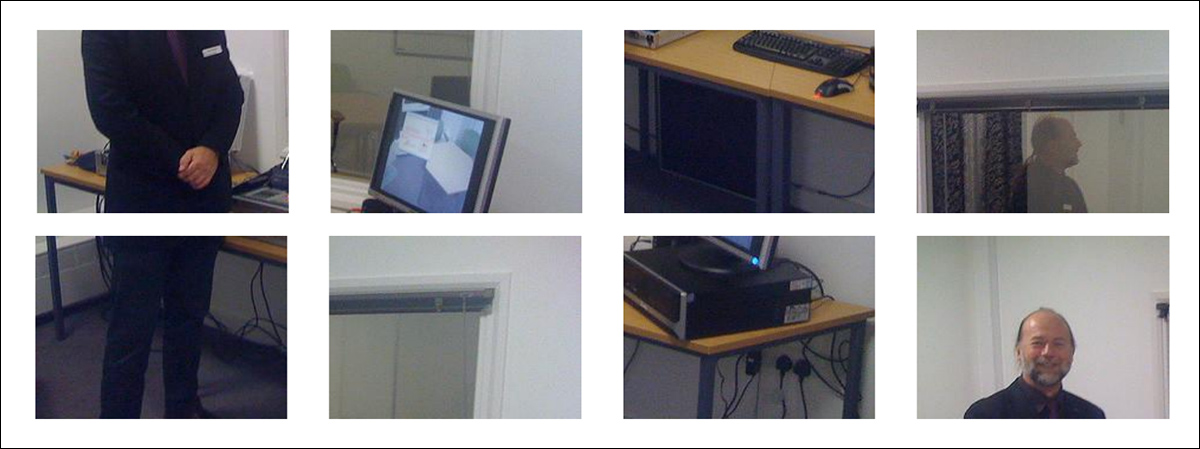

Příklady z image jigsaw úkolu. Každý řádek ukazuje promíchány fragmenty, které model musí uspořádat do jejich původní dispozice, s správnou dispozicí zobrazenou vpravo.

V každém případě je tento typ školení proveden po hlavní fázi učení, kdy model již má некоторou schopnost porozumět obrázkům.

Předchozí přístupy, jako například švýcarská práce Nesupervised Learning of Visual Representations by Solving Jigsaw Puzzles z roku 2017, používaly tento typ posílení přístupu s méně úspěchem, na konvolučních neuronových sítích (CNN), což je značně odlišná architektura ve srovnání s moderním MLLM.

Z vydání z roku 2017 ‘Nesupervised Learning of Visual Representations by Solving Jigsaw Puzzles ‘, raný příklad použití fragmentace jako odměny-založeného výzvy pro neuronový systém. Source: https://arxiv.org/pdf/1603.09246

Ve testech, Visual Jigsaw vedl k tomu, co autoři označují jako konzistentní a měřitelná zlepšení napříč širokým spektrem benchmarcků: image jigsaw úkol zlepšil jemné vnímání, prostorové uspořádání a kompoziční usuzování; video jigsaw úkol vylepšil modelovu schopnost sledovat časové sekvence a usuzovat o pořadí událostí; a 3D jigsaw úkol posílil hloubkově-založené porozumění a prostorové usuzování pomocí pouze RGB-D vstupů.

Napříč všemi třemi modalitami, článek opakuje, že nová metoda překonala několik konkurenčních benchmarcků, a to bez nutnosti architektonických změn, dalších vizuálních modulů nebo dalších supervizních dat:

‘Rozsáhlé experimenty prokazují podstatná zlepšení jemného vnímání, časového usuzování a 3D prostorového porozumění. Naše výsledky zdůrazňují potenciál samo-seznamovacích vizuálních úkolů v post-školení MLLM a snaží se inspirovat další výzkum vizuálních pretextů.’

Nový článek se nazývá Visual Jigsaw Post-Training Improves MLLMs, a pochází od šesti výzkumníků z Nanyang Technological University, Linköping University a SenseTime Research. Článek je doprovázen projektovou stránkou s živými demonstracemi (a můžete dokonce nahrát vlastní obrázek do image-založeného puzzle demo). Kód a váhy pro projekt byly veřejně zpřístupněny,

Method

Ačkoli se podíváme na to, jak jsou informace rozděleny pro přizpůsobení tří testovaných modalit, měli bychom nejprve zvážit odměňovací design pro nový systém.

Visual Jigsaw přístup ohodnocuje modelové odpovědi pomocí stupňovitých odměn, ne jen jednoduchého pasu nebo selhání. Pokud model předpovídá přesně správné pořadí puzzle kousků, dostává plnou odměnu; pokud odpověď je většinou správná, ale ne dokonalá, model dostává částečný kredit, škálován slevovým faktorem pro zabránění nadhodnocení částečných úspěchů (to brání modelu v tom, aby systém hrál opakovanými pokusy, které jsou pouze částečně správné).

Neplatné odpovědi, jako například “podvod” použití stejného čísla opakovaně, dostávají skóre nula. Pro podporu konzistentního formátování, model musí umístit své usuzování uvnitř <think> značek a jeho konečnou odpověď uvnitř <answer> značek. Dostává malou bonus, pokud tento formát je použit správně.

Images

Pro vytvoření puzzle pro obrázky modality, je obraz nejprve rozdělen na mřížku fragmentů rozřezáním na stejné velikosti bloky:

Příklady image-založených fragmentů pro systém k řešení.

Fragmenty jsou rozloženy v pevném pořadí zleva doprava, jako při čtení pořadí na stránce, předtím, než jsou promíchány náhodným shuffle. Model je poté vystaven tomuto promíchanému sadě fragmentů a musí uhádnout původní pořadí předpovědí správné permutace, která obnoví původní rozložení.

Během školení, 118 000 obrázků z COCO datasetu bylo použito, s každým obrázkem poskytujícím devět fragmentů (tj. “puzzle kousků”). Prompt daný systému je uveden výše v tomto článku (obrázek s popiskem začínajícím ‘Z nového článku dodatkového materiálu’).

Video

Pro video jigsaw úkol, je video rozřezáno na sekvenci klipů rozřezáním na stejné časové intervaly, a poté promícháním klipů. Model je poté zobrazen tomuto promíchanému sekvenci, a musí uhádnout jejich správné, původní chronologické pořadí.

Zkrácené příklady video puzzle výzvy, z článku dodatkového materiálu.

Školení pro tuto modalitu použilo 100 000 videí z LLaVA-Video datasetu, s každým videem rozděleným na šest klipů. Pro zabránění modelu v tom, aby využil zřejmé rámcové shody na klip hranicích, 5% rámců na začátku a konci každého klipu bylo odstraněno.

Klipy neobsahovaly více než 12 rámců, každý s maximálním rozlišením 128x28x28 pixelů. Videá kratší než 24 sekund byla vyloučena.

Prompt pro tuto úlohu je uveden níže:

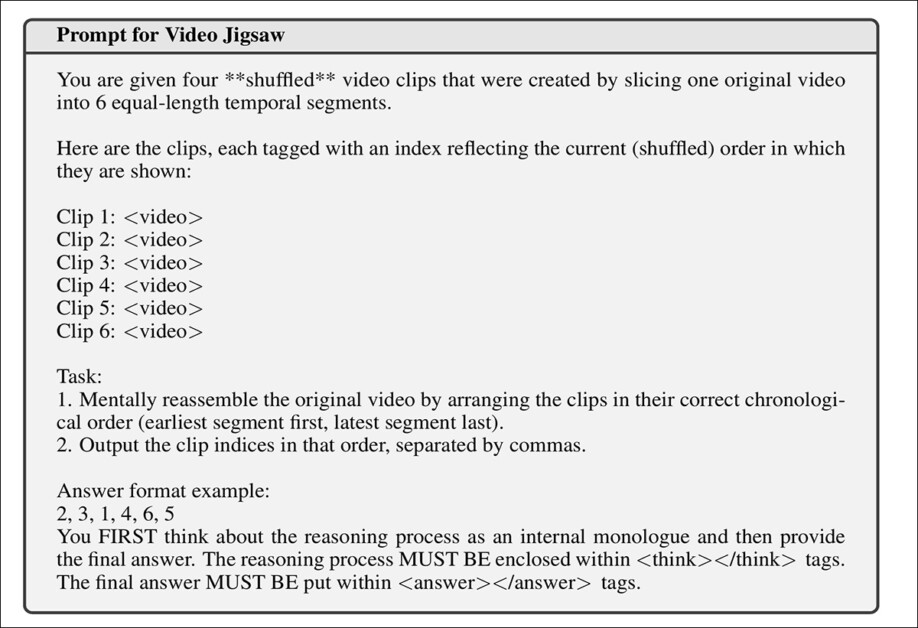

Posílení učení prompt prezentovaný MLLM pro video úkol, bez klipů, které by byly prezentovány MLLM.

3D Data

Plný 3D jigsaw úkol by obvykle zahrnoval rozdělení 3D prostoru (jako voxel bloky nebo point cloud fragmenty) na menší části a školení modelu k rekonstrukci jejich původního prostorového uspořádání.

Nicméně, průměrný MLLM není vybaven pro přímou manipulaci s 3D daty, místo toho spoléhající se na semanticky interpretované image nebo video vstupy. Proto, aby byl vytvořen úkol, který stále využívá 3D usuzování, zatímco zůstává kompatibilní s aktuálními MLLM, autoři zavedli více zpracovatelnou variantu pomocí výše zmíněných RGB-D obrázků (tj. 2D obrázků, které zahrnují hloubkové informace pro každý pixel).

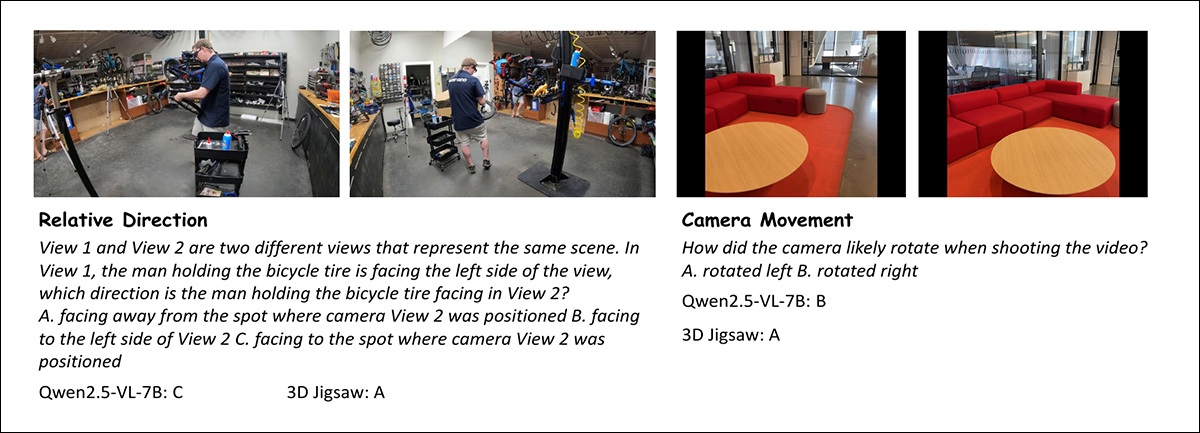

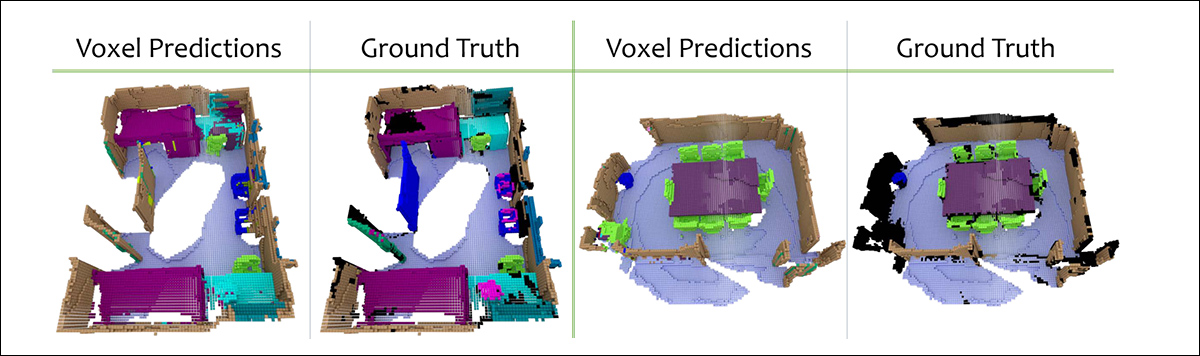

Příklad dotazů z 3D Spatial Understanding Benchmark používaných pro hodnocení výkonu na relativní pohled a kamerový pohyb usuzování. 3D Jigsaw model správně odhaduje jak prostorové vztahy mezi dvěma pohledy scény, tak i pravděpodobný směr kamerové rotace, překonávající Qwen2.5-VL-7B baseline.

Z každého RGB-D obrázku, model obdrží promíchaný seznam bodů, které původně měly rozdílné hloubky, sahající od nejbližší po nejvzdálenější, cílem je obnovit jejich správné hloubkově-založené pořadí pomocí pouze 2D obrázku jako referenci:

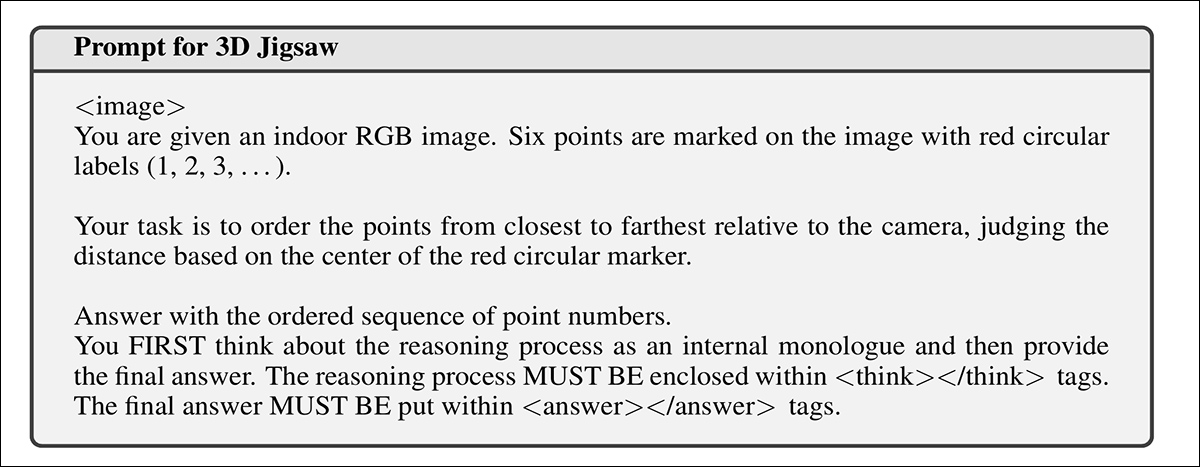

Posílení učení prompt pro 3D jigsaw.

Každý bod je označen na obrázku (který je zobrazen modelu, ale není zobrazen v promptu výše), a model musí předpovědět, který byl nejbližší, druhý nejbližší a tak dále, efektivní rekonstrukce původního hloubkového pořadí bez přístupu k surovým hloubkovým hodnotám.

3D jigsaw úkol je školen na RGB-D obrázcích z ScanNet datasetu, používajících 300 000 vzorků vytvořených výběrem náhodných sad šesti hloubkových bodů na obrázek.

Příklady point cloudů z ScanNet datasetu použitého v 3D jigsaw. Source: https://arxiv.org/pdf/1702.04405

Každý bod musel ležet v hloubkovém rozsahu 0,1 až 10 metrů, a pro podporu rozmanitosti, žádná dvě body v sadě nebyly dovoleny být blíže než 40 pixelů v obrazové rovině, nebo méně než 0,2 metrů od sebe v hloubce.

Tests

Pro počáteční testy, systém využil Qwen2.5-VL-7B-Instruct jako základ multimodálního modelu. Školení použilo Group Relative Policy Optimization (GRPO) algoritmus, s oběma KL regularizací a entropií ztrátou odstraněnou.

Pro částečné předpovědi, byl použit slevový faktor 0,2. Image jigsaw školení použilo globální batch velikost 256, zatímco video a 3D jigsaw použily 128. Učení rychlost byla nastavena na 1×10⁻⁶.

Pro každou prompt, model generoval 16 odpovědí při dekódovací teplotě 1,0. Obraz i video jigsaw úkoly byly školeny po 1 000 krocích, zatímco 3D jigsaw úkol byl školen po 800 krocích.

Image Jigsaw

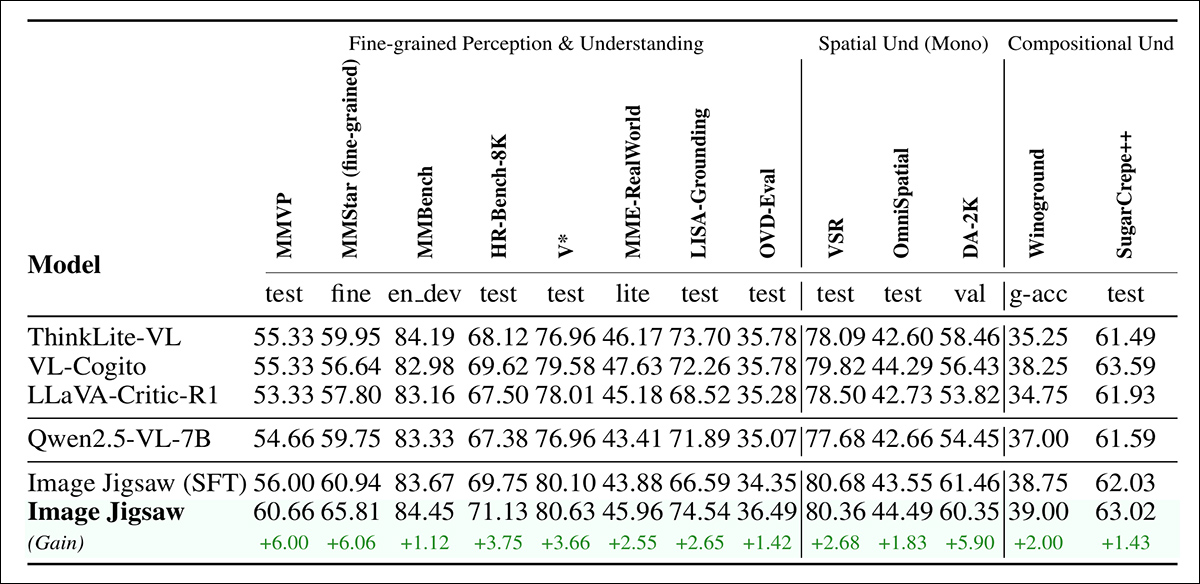

Image jigsaw model byl testován napříč třemi kategoriemi vizuálních benchmarcků: pro jemné vnímání a porozumění, MMVP, jemné vnímání subset MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; a OVD-Eval.

Pro monokulární prostorové porozumění, benchmarcků byly VSR; OmniSpatial; a Depth Anything V2 (DA-2K). Pro kompoziční vizuální porozumění, testy využívaly Winoground a SugerCrepe++.

Tři benchmarcků byly testovány, všechny odvozené z Qwen2.5-VL-7B: ThinkLite-VL pro multimodální usuzování; VL-Cogito pro obecné vizuální a vědecké úkoly; a LLaVA-Critic-R1 pro image vnímání.

Vše byly hodnoceny pomocí krátkých odpovědí pouze, protože řetězec myšlení (CoT) usuzování někdy snižovalo výkon.

Hodnotící výsledky na image benchmarckách. Image Jigsaw zlepšil Qwen2.5-VL-7B základním modelu napříč všemi úkolovými kategoriemi (tj. jemné vnímání a porozumění; monokulární prostorové porozumění; a kompoziční vizuální usuzování), překonávající předchozí post-školené benchmarcků.

Z výsledků pro image jigsaw, uvedených výše, autoři uvádějí:

‘[Obrázek výše] ukazuje, že naše metoda konzistentně zlepšuje vizuální schopnosti na třech typech benchmarcků. Tyto výsledky potvrzují, že začlenění image jigsaw post-školení významně zlepšuje MLLM vizuální zakotvení a jemné vizuální porozumění nad rámec usuzovacího post-školení strategií.

‘Připisujeme tato zlepšení skutečnosti, že řešení image jigsaw vyžaduje, aby model se soustředil na místní fragment detaily, odhadl globální prostorové uspořádání, a usuzoval o mezifragment vztazích, což přímo prospívá jemnému, prostorovému a kompozičnímu porozumění.’

Video Jigsaw

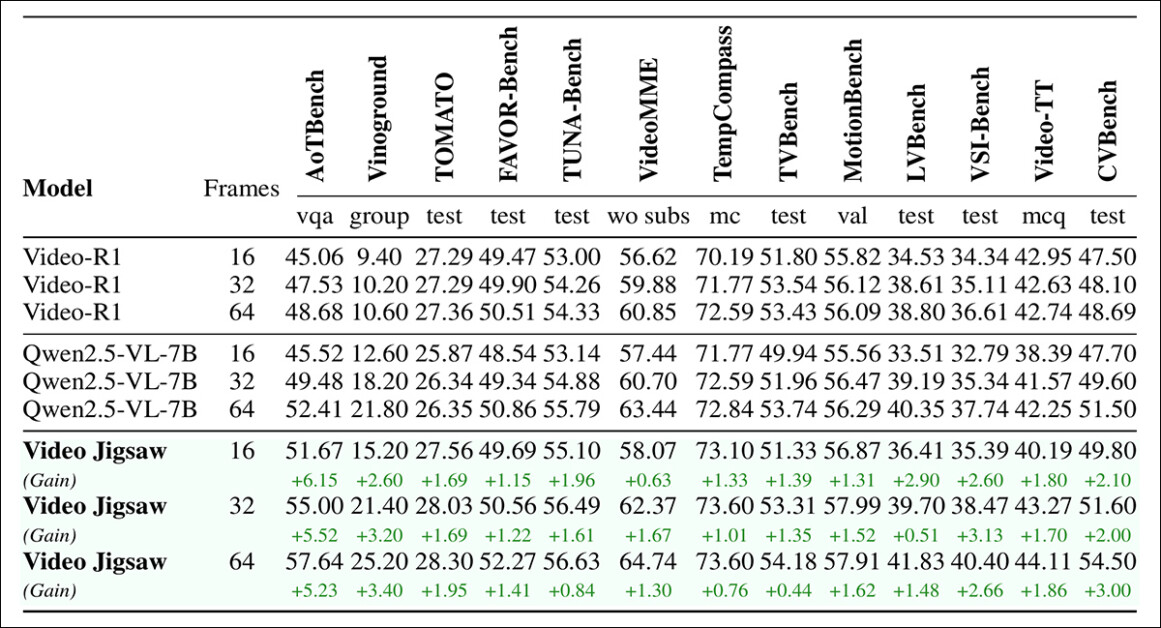

Pro video jigsaw, hodnocení bylo provedeno na AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; a CVBench.

Video-R1 byl použit jako benchmarck, který byl trénován s cold-start supervizním jemným tunelem následovaným posílením učení pro video porozumění a usuzování. V tomto případě, hodnocení zahrnovalo celý usuzovací proces, protože to konzistentně produkovalo lepší výsledky než přímé odpovědi.

Všechny modely byly omezeny na 256x28x28 pixelů, a testovány napříč třemi rámcovými nastaveními – 16, 32, a 64:

Hodnotící výsledky na video benchmarckách, s Video Jigsaw překonávajícím benchmarck konzistentně napříč všemi úkoly a rámcovými nastaveními.

Video Jigsaw produkoval konzistentní zlepšení napříč všemi video porozumění benchmarckami a rámcovými nastaveními, s zisky obzvláště silnými na úkolech vyžadujících časové usuzování a směrovost, jako jsou ty v AoTBench, a také v cross-video usuzování benchmarckách, jako je CVBench:

‘Tyto výsledky potvrzují, že řešení video jigsaw úkolů nutí model lépe zachytit časovou kontinuitu, porozumět vztahům napříč videi, usuzovat o směrovosti, a generalizovat na holistické a generalizovatelné video porozumění scénáře.’

3D Data

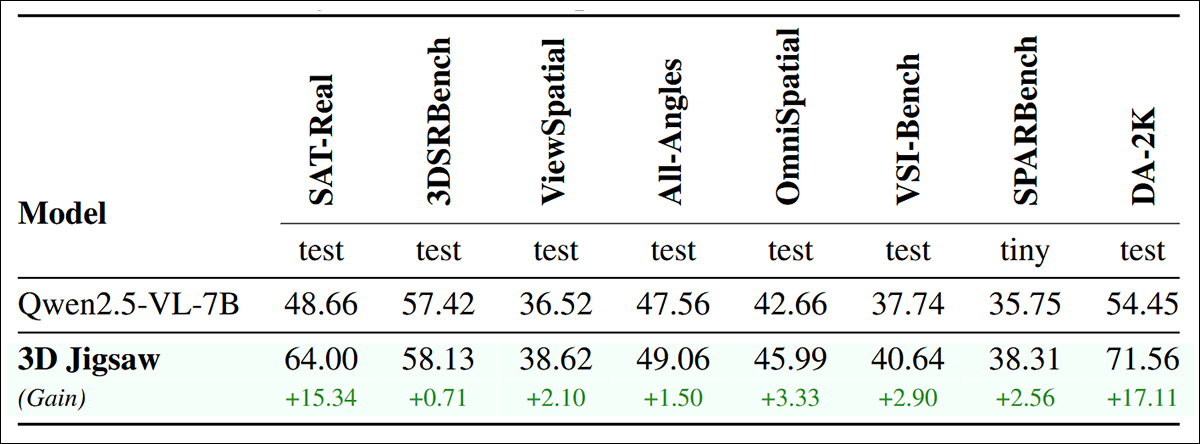

Pro 3D modalitu, model byl hodnocen na SAT-Real; 3DSRBench; ViewSpatial; All-Angles; výše zmíněný OmniSpatial; VSI-Bench; SPARBench (tiny); a výše zmíněný DA-2K.

Hodnotící výsledky na 3D benchmarckách: 3D Jigsaw zlepšil výkon napříč hloubkovými srovnávacími úkoly, jako je DA-2K, a také širší 3D percepci benchmarckách pokrývajících single-view, multi-view, a egocentrická video vstupy.

Zde autoři uvádějí:

‘[3D] Jigsaw dosahuje významných zlepšení napříč všemi benchmarckami. Nečekaně, největší zisk je na DA-2K, hloubkové odhadovací benchmarck, který je přímo související s našim hloubkově-založeným pořadím úkolem. Více důležitější, pozorujeme konzistentní zlepšení na širokém spektru dalších úkolů, včetně těch se single-view (např. 3DSRBench, [OmniSpatial]), multi-view (např. ViewSpatial, All-Angles), a egocentrická video vstupy (např. VSI-Bench).

‘Tyto výsledky demonstrují, že náš přístup nejen učí konkrétní dovednost hloubkové objednávky, ale také účinně posiluje modelovu obecnou schopnost vnímat a usuzovat o 3D prostorové struktuře.’

Závěr

Co není zcela jasné z tohoto článku, je přesná souvislost mezi obrázky a popisy, která pohání toto zlepšení MLLM výkonu.

Na první pohled, proces učení prostřednictvím puzzle řešení se zdá velmi analogický k našim vlastním raným pokusům a rozvoji. Nicméně, naše vlastní prostorová interpretace světa instinktivně cítí méně semanticky a související s jazykem, a hlubší pohled na článek odhaluje rozsah, v jakém jazyk slouží MLLM jako zajímavý most mezi vizuální a semantickou realitou.

* Poznámka, že autoři článku preferují méně běžný termín ‘Multimodální velké jazykové modely’, zkrácené na ‘MLLM’. Tento termín je nově vznikající nebo zřídka používaný, a vztahuje se na modely, které mohou rozsáhle usuzovat a analyzovat obrázky prostorově, ale které ne generují obrázky. Jak nové paradigma a modely vznikají, tento lexikon je pod neustálou revizí.

Poprvé zveřejněno ve čtvrtek, 2. října 2025