Partnerství

Infineon Technologies a d-Matrix Partner na nízkoodběrovou AI Infrastrukturu

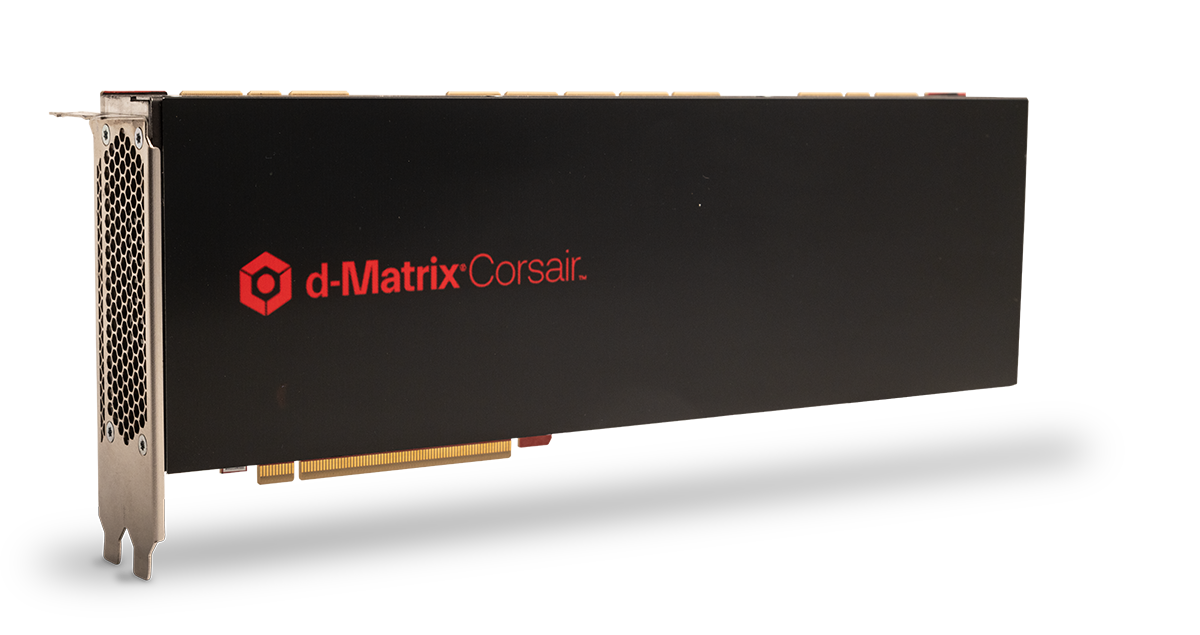

Infineon Technologies oznámily spolupráci s d-Matrix zaměřenou na zlepšení výkonu a energetické účinnosti systémů AI inference používaných v moderních datových centrech. Partnerství se točí kolem platformy Corsair AI inference accelerator od d-Matrix a OptiMOS dual-phase power modules od Infineon, které jsou navrženy pro podporu vysokohustotních výpočetních prostředí pro interaktivní AI úlohy.

Oznámení zdůrazňuje rostoucí trend v rámci AI hardwarového průmyslu. Zatímco většina infrastrukturního boomu v posledních letech se soustředila na školení stále větších AI modelů, průmysl se nyní rychle rozšiřuje do inference — procesu skutečného běhu modelů v reálných aplikacích, jako jsou chatboti, agentic AI systémy, copiloti, vyhledávání, finanční analýzy a podporu rozhodování ve zdravotnictví. Tyto úlohy kladou na hardware odlišné požadavky, zejména kolem latence, odezvy a spotřeby energie.

Proč se AI inference stává významným bojištěm hardwaru

AI inference se stal jednou z nejrychleji rostoucích segmentů trhu AI infrastruktury, protože interaktivní AI systémy vyžadují odpovědi v milisekundách spíše než v sekundách. d-Matrix se zaměřila na Corsair speciálně pro tyto úlohy, zdůrazňující ultra-nízkou latenci a energeticky efektivní inference pro velké jazykové modely a AI agenty.

Podle d-Matrix byl Corsair navržen kolem digitální in-memory compute architektury, která má snižovat paměťové úzká místa, která často zpomalují generativní AI inference. Společnost tvrdí, že platforma může významně snížit latenci a zlepšit propustnost ve srovnání s tradičními GPU-centrickými systémy inference, zejména pro interaktivní aplikace.

Partnerství s Infineon řeší další rostoucí výzvu: dodávku energie.

Jak AI servery pokračují ve zvyšování hustoty, efektivně dodávat energii akcelerátorům se stalo omezujícím faktorem pro škálování infrastruktury. OptiMOS TDM2254xx moduly od Infineon jsou navrženy pro vertikální architektury dodávky energie, které pomáhají snižovat elektrické ztráty a zlepšovat hustotu energie uvnitř kompaktních serverových systémů.

Směr k reálným čase AI systémům

Společnosti rámovaly spolupráci kolem vzestupu “interaktivního AI”, kde systémy inference musí nepřetržitě generovat výstupy s extrémně nízkou latencí. To zahrnuje konverzační AI, AI agenty, systémy reálného uvažování a aplikace vyžadující rychlou generaci tokenů z velkých jazykových modelů.

Zakladatel a CEO d-Matrix Sid Sheth řekl, že architektura za Corsair byla postavena speciálně pro sub-2 milisekundovou latenci tokenů, metriku, která se stala stále důležitější, protože podniky přesouvají AI systémy z experimentů do zákaznicky orientovaných prostředí.

Širší AI průmysl také začíná rozpoznávat, že infrastruktura inference se může vyvíjet odlišně od infrastruktury školení. Zatímco GPU klastry dominovaly první fázi expanze generativního AI, inference stále více odměňuje architektury optimalizované kolem paměťové šířky, latence, sítí a energetické účinnosti spíše než surového výpočtu samotného.

Energetická účinnost se stává centrální pro škálování AI

Jednou z největších omezení, kterým čelí hyperscalers a AI cloudoví poskytovatelé, je poptávka po elektřině. AI inference úlohy mohou běžet nepřetržitě napříč miliony požadavků denně, což činí provozní účinnost kritickou pro nasazení nákladů.

Infineon se agresivně rozšiřuje svou pozici v rámci AI infrastruktury prostřednictvím polovodičových technologií založených na křemíku, karbidu křemíku (SiC) a nitridu gallia (GaN). Společnost se stále více soustředila na dodávku vrstvy dodávky energie pod AI akcelerátory a serverovou infrastrukturu.

Spolupráce s d-Matrix odráží, jak polovodičové firmy se stávají více integrovanými s AI akcelerátory, protože průmysl hledá alternativy k tradičním GPU-heavy architekturám.

AI infrastruktura se rozšiřuje za hranice tradičních GPU

Partnerství také přichází během širší vlny experimentování v AI hardwaru. Rostoucí počet startupů vyvíjí specializované akcelerátory zaměřené specificky na inference, paměťově centrické výpočty nebo AI sítě.

d-Matrix se odlišila svým zaměřením na compute-in-memory technologie a nízkolatenční inference systémy přizpůsobené pro generativní AI. Společnost také rozšířila svou infrastrukturní strategii za hranice samotných akcelerátorových čipů, nedávno zdůrazňujíc sítě, komponovatelnou infrastrukturu a plnou systémovou optimalizaci pro inference klastry.

Jak AI aplikace stále více získávají agentic a interaktivní charakter, poskytovatelé infrastruktury se očekává, že budou klást větší důraz na snižování latence, snižování spotřeby energie a zlepšování systémové účinnosti napříč celou datovou center stack, spíše než se soustředit pouze na surovou výpočetní sílu.