Umělá inteligence

Google’s LipSync3D nabízí vylepšenou synchronizaci ‘Deepfaked’ pohybů úst

Spolupráce mezi výzkumníky Google AI a Indickým technologickým institutem v Kharagpuru nabízí nový rámec pro syntézu mluvících hlav z audioobsahu. Projekt si klade za cíl produkovat optimalizované a rozumně zdrojové způsoby vytváření ‘mluvících hlav’ videoobsahu z audio, za účelem synchronizace pohybů rtů s dabovaným nebo strojově přeloženým audio a pro použití v avatarech, interaktivních aplikacích a v jiných reálných prostředích.

Source: https://www.youtube.com/watch?v=L1StbX9OznY

Modely strojového učení školené v tomto procesu – nazvané LipSync3D – vyžadují pouze jeden video cílové identitě obličeje jako vstupní data. Datový přípravný pipeline odděluje extrakci obličejové geometrie od hodnocení osvětlení a dalších aspektů vstupního videa, což umožňuje ekonomičtější a zaměřené školení.

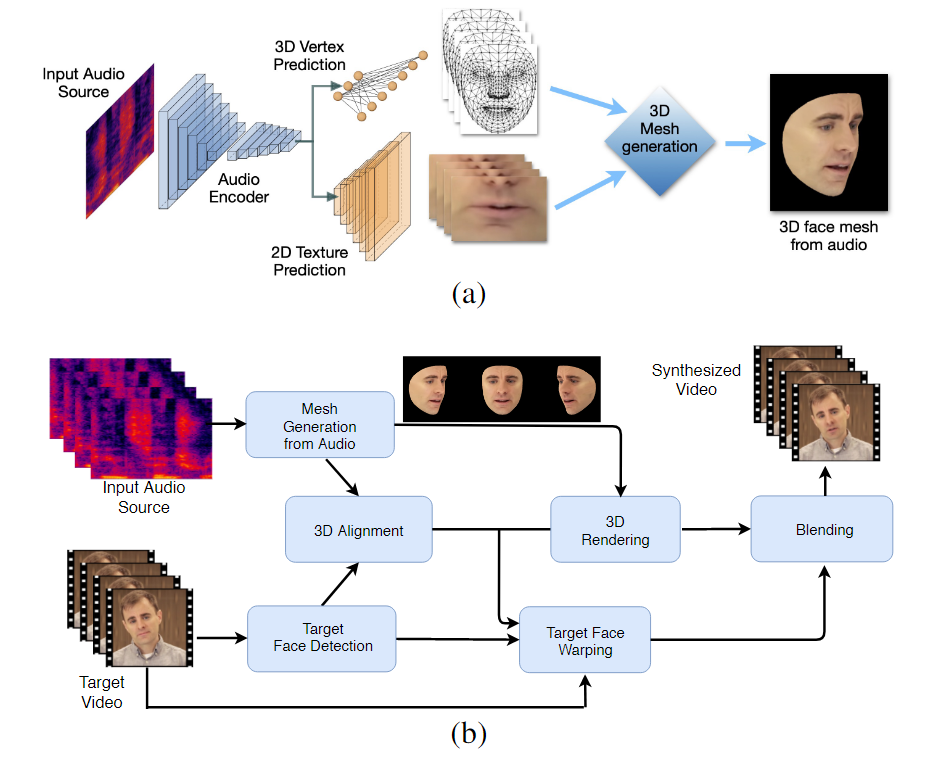

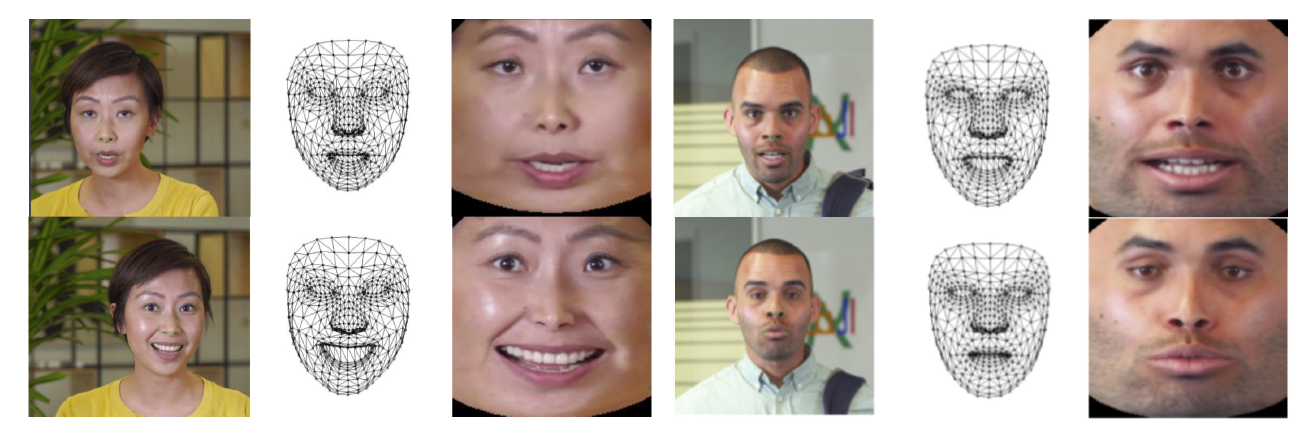

The two-stage work-flow of LipSync3D. Above, the generation of a dynamically textured 3D face from the ‘target’ audio; below, the insertion of the generated mesh into a target video.

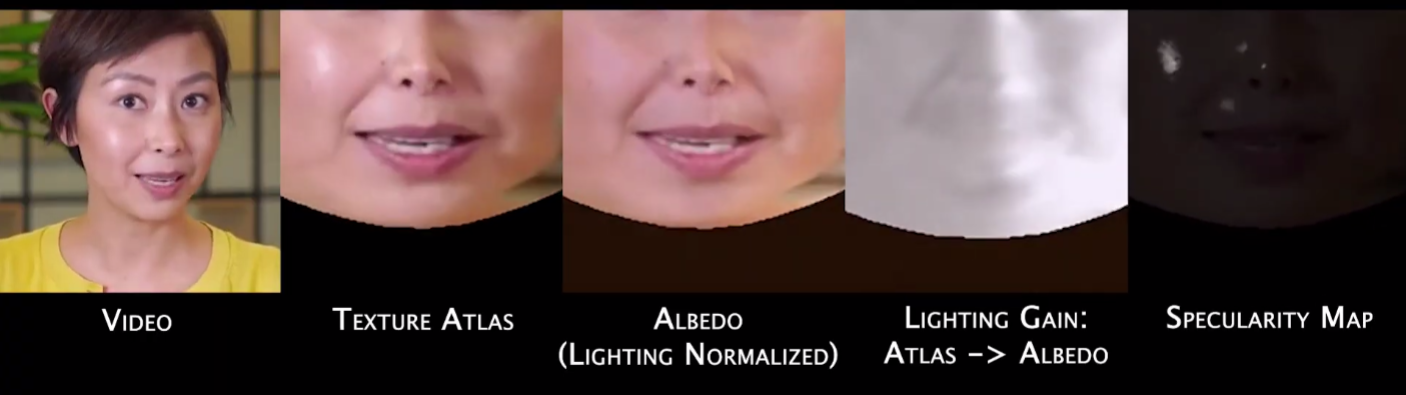

Ve skutečnosti může být nejvýznamnějším příspěvkem LipSync3D k výzkumu v této oblasti jeho algoritmus normalizace osvětlení, který odděluje školení a inference osvětlení.

Decoupling illumination data from general geometry helps LipSync3D to produce more realistic lip movement output under challenging conditions. Other approaches of recent years have limited themselves to ‘fixed’ lighting conditions that won’t reveal their more limited capacity in this respect.

Během předzpracování vstupních datových rámců musí systém identifikovat a odstranit specifické body, protože tyto jsou specifické pro osvětlení, za kterých bylo video pořízeno, a jinak by interferovaly s procesem přeosvětlení.

LipSync3D, jak jeho název naznačuje, neprovádí pouze pixelovou analýzu obličeje, které vyhodnocuje, ale aktivně používá identifikované obličejové orientační body k generování pohyblivých CGI-stylů sítí, spolu s ‘rozvinutými’ texturami, které jsou zabaleny kolem nich v tradičním CGI potrubí.

Pose normalization in LipSync3D. On the left are the input frames and detected features; in the middle, the normalized vertices of the generated mesh evaluation; and on the right, the corresponding texture atlas, which provides the ground truth for texture prediction. Source: https://arxiv.org/pdf/2106.04185.pdf

Kromě nového metodou osvětlení tvrdí výzkumníci, že LipSync3D nabízí tři hlavní inovace oproti předchozím pracím: oddělení geometrie, osvětlení, postoje a textury do samostatných datových proudů v normalizovaném prostoru; snadno školený auto-regresivní texturový předpovědní model, který produkuje časově konzistentní video syntézu; a zvýšenou realističnost, jak bylo vyhodnoceno lidskými hodnoceními a objektivními metrikami.

Splitting out the various facets of the video facial imagery allows greater control in video synthesis.

LipSync3D může odvodit vhodné geometrické pohyby rtů přímo z audio, analýzou fonémů a dalších aspektů řeči, a překladem jich do známých odpovídajících svalových póz kolem oblasti úst.

Tento proces používá společný předpovědní pipeline, kde inferované geometrie a textury mají věnované kódéry v autoencoderovém nastavení, ale sdílejí audio kódér se speech, který má být uložen v modelu:

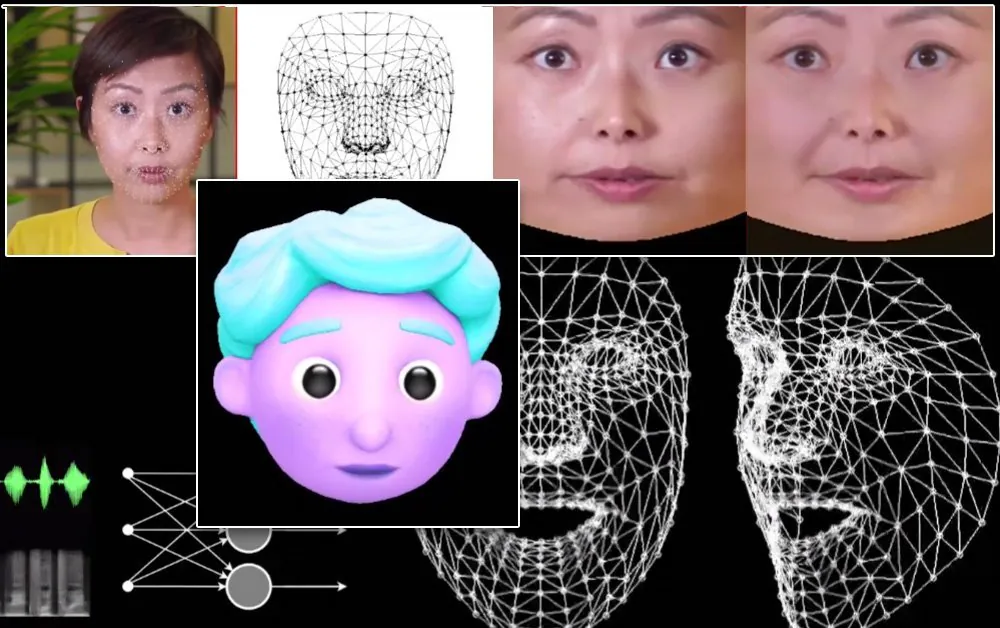

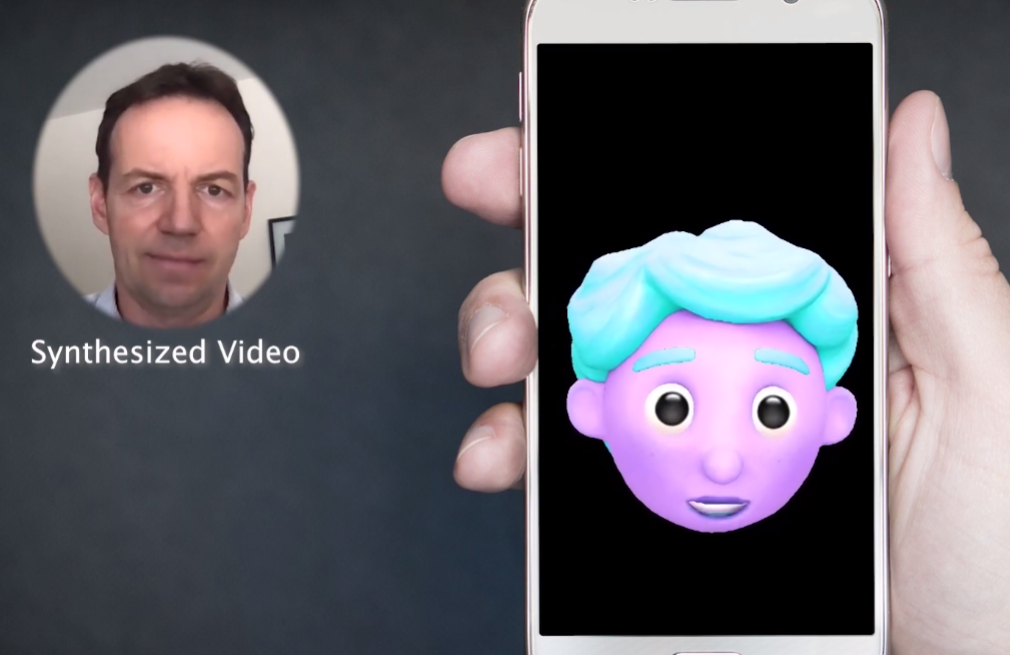

LipSync3D’s labilní pohyb syntézy je také určen k napájení stylizovaných CGI avatářů, které ve skutečnosti jsou pouze stejný druh sítě a texturové informace jako reálná obrazová informace:

A stylized 3D avatar has its lip movements powered in real time by a source speaker video. In such a scenario, the best results would be obtained by personalized pre-training.

Výzkumníci také předpokládají použití avatářů s trochu realističtějším pocitem:

![]()

Vzorkovací školicí časy pro videa se pohybují od 3-5 hodin pro 2-5 minutové video, v potrubí, které používá TensorFlow, Python a C++ na GeForce GTX 1080. Školicí sezení používala velikost dávky 128 rámců přes 500-1000 epoch, s každým epochem reprezentujícím kompletní vyhodnocení videa.

Towards Dynamic Re-Synching Of Lip Movement

Obor re-synching rtů pro přizpůsobení novému audio tracku získal velkou pozornost ve výzkumu počítačového vidění v posledních letech (viz níže), nejméně jako je to vedlejší produkt kontroverzní deepfake technologie.

V roce 2017 University of Washington představil výzkum schopný naučit se lip sync z audio, používající ho k změně pohybů rtů bývalého prezidenta Obamy. V roce 2018; Max Planck Institute for Informatics vedl další výzkumnou iniciativu pro umožnění identity>identity video transferu, s lip synch jako vedlejší produkt procesu; a v květnu 2021 AI startup FlawlessAI odhalil svou proprietární lip-sync technologii TrueSync, široce přijatou v tisku jako umožňující vylepšené dabingové technologie pro hlavní filmová vydání v různých jazycích.

A, samozřejmě, probíhající vývoj deepfake open source repozitářů poskytuje další větev aktivního uživatelsky přispívaného výzkumu v této sféře obličejové obrazové syntézy.