Andersonův úhel

I když základní AI může nyní psát zprávy, které se jeví jako lidské

Nový výzkum ukazuje, že i malé lokální modely AI mohou nyní psát zprávy, které lidé nemohou rozlišit od skutečné žurnalistiky, a to na stejné úrovni jako nejlepší systémy, a čtenáři nejsou schopni určit, kdo článek napsal.

Podle nového výzkumného projektu spolupráce mezi Německem a Francií lidé nemohou určit, zda je článek napsán AI nebo člověkem – ani když je napsán otevřenými modely, které lze stáhnout a spustit na relativně průměrném spotřebitelském počítači.

V další indikaci toho, že malé modely AI jsou na vzestupu, průzkum 2 318 soudů shromážděných z 1 054 účastníků v akademickém studijním portálu ukázal, že lidský čtenář nemůže identifikovat původ článku na vyšší než náhodné úrovni, dokonce i když byl vygenerován relativně skromnými modely s toliko sedmi miliardami parametrů, včetně Mistral a Llama variant:

Průměrné skóre zdroje a autenticity pro testované LLM. GPT-4o má 200 miliard parametrů, ale nepřevyšuje výrazně 7 miliard parametrů menších modelů. Testované modely byly Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o a GPT-3.5. Zdroj

Autoři se vracejí k tématu, které poprvé prozkoumali v roce 2024 zveřejnění Blessing or curse? A survey on the Impact of Generative AI on Fake News. Samotné výsledky jsou nově zveřejněné výsledky z většího projektu, který byl poprvé oznámen v lednu, a využívají autorské JudgeGPT online participační rámce.

Featherweight Power

Nazvaný Can Humans Tell? A Dual-Axis Study of Human Perception of LLM-Generated News, a pocházející od tří výzkumníků z Frankfurt University of Applied Sciences a IRISA výzkumné jednotky v Nantes, nová studie metodologie dělá důležitý rozdíl mezi ‘fake news’ a ‘AI-written news’ (protože fake news může být napsána lidmi nebo AI, a tyto dva aspekty nejsou nutně synonymní).

Nicméně, možná nejzajímavějším aspektem je závěr studie, že malé modely, včetně Mistral 7B a Gemma 7B, mohou s toliko sedmi miliardami parametrů, obstát proti modelům jako ChatGPT (4o) s 200 miliardami parametrů:

‘Otevřené modely s toliko 7 miliardami parametrů produkují text, který je hodnocen stejně jako výstup GPT-4o, což ukazuje, že schopnost generovat text, který je nerozlišitelný od lidského, již není omezena na přední modely.’

Nicméně, ‘AI-generované zprávy’ mohou představovat mnoho různých typů lidské/ai spolupráce, od kontrol拼ování pravopisu až po plné, kariérní ústup, a studie nezřetelně neurčuje, jaký typ AI obsahu byl vygenerován pro testy (ačkoli popisuje metodologii pro jeho produkci – viz níže).

Metoda

Pro účastníky zapojené do JudgeGPT platformy, každý news fragment byl hodnocen pomocí duální osy rámce, ve kterém poskytli tři nezávislé hodnocení na kontinuálních 0-100 posuvnících:

JudgeGPT portál GUI, kde hodnotitelé hodnotí materiál na základě zdroje; autenticity; a téma povědomí. Prosím, odkážete se na zdroj papíru pro lepší rozlišení.

Source judgment zachytil, zda pasáž vypadala jako strojově napsaná nebo lidsky napsaná; authenticity judgment, zda se jednalo o padělek nebo legitimní; a topic familiarity, jak dobře čtenář znal téma.

Kontinuální škály byly použity místo Likert škály, aby bylo možné zachytit stupně jistoty přesněji, a aby podpořit statistickou analýzu, včetně Pearson korelace a klusteringu.

Machine-generated text fragmenty byly vygenerovány autorským RogueGPT frameworkem, který je zdrojovým rámcem pro JudgeGPT. RogueGPT orchestruje příspěvky ze šesti Large Language Models (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; a Mistral 7B.

Persona-based prompting byl použit pro generování textů, a AI generace byly založeny na skutečných zpravodajských tématech, a byly ověřeny lidmi.

Naopak, lidsky psané fragmenty byly vzorkovány z ‘zavedených zpravodajských zdrojů’ a neurčených ‘informačních databází’.

Autoři pozorují:

‘Stimulus set je úmyslně zkreslený směrem k strojově generovaným fragmentům (∼98%), s lidsky generovanými položkami, které slouží jako kalibrační kotvy.

‘Tato designová volba odráží studii zaměřenou na vnitřní variaci AI (přes modely) spíše než na srovnání člověk vs. AI; účastníci nejsou informováni o základních rychlostech, a výsledky se blíží náhodnému rozpoznání [výsledků] při analýze na lidsky generované podmnožině samostatně.’

Účastníci nejprve poskytli informovaný souhlas a dokončili demografický dotazník, který pokrýval věk, vzdělání, politickou orientaci a znalost AI, po kterém hodnotili sekvenci zpravodajských fragmentů.

Každá osoba prošla 5-87 položkami, s mediánem 12, zatímco pořadí prezentace bylo náhodné, a model přiřazení byl vyvážený napříč účastníky, aby se snížila předpojatost. Platforma zaznamenala tři hodnocení posuvníků spolu s časem reakce a anonymním identifikátorem, což umožnilo propojit jednotlivá hodnocení s pozadími faktory.

Autoři zdůrazňují, že vzorek se naklonil směrem k vzdělaným evropským účastníkům, se 68% vysokoškolsky vzdělanými, a 74% založenými v Evropě – předpojatost, kterou studie označuje jako omezení pro širší generalizaci.

Testy

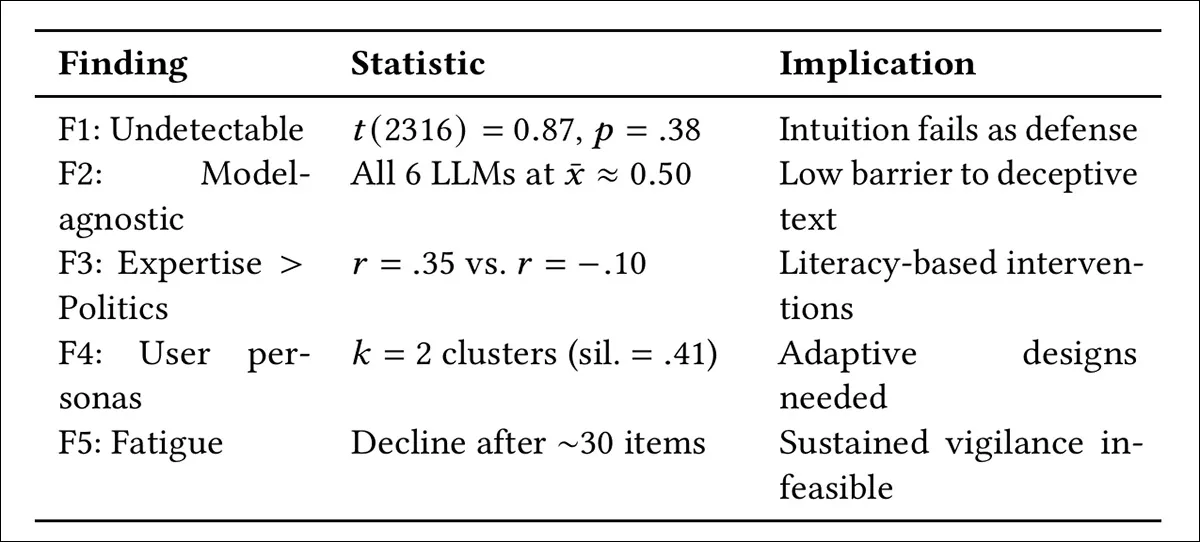

Testy jsou rozděleny do pěti typů zjištění: rozlišení strojově generovaného textu od lidsky psaného textu; srovnání detekce napříč různými LLM; zkoumání efektu doménové odbornosti versus politické orientace na přesnost; identifikace různých reakčních strategií mezi účastníky; a sledování, jak se přesnost mění při opakovaných hodnocení, kvůli únavě:

Souhrn pěti hlavních zjištění z 2 318 soudů napříč 1 054 účastníky, ukazující, že lidská detekce AI-generovaného textu zůstala na náhodné úrovni napříč všemi modely, že přesnost byla spojena s doménovou odborností spíše než politickou orientací, že účastníci se seskupili do různých důvěrných profilů, a že výkon se zhoršoval po zhruba 30 hodnocení, kvůli kognitivní únavě.

Test ukázal, že není žádný významný rozdíl v hodnoceních zdrojů mezi podmínkami, což naznačuje, že účastníci nemohou rozlišit AI-generovaný text od lidského:

Distribuce skóre zdroje a autenticity pro strojově generované a lidsky generované fragmenty ukazují podstatné překrytí, bez významného rozdílu mezi podmínkami, a statistické testy – ukazující, že účastníci nemohli spolehlivě rozlišit AI-generovaný text od lidsky psaného obsahu.

Pro druhý aspekt, jak je ukázáno v grafu na začátku článku, selhání detekce se nezměnilo podle modelu, protože výstupy ze všech LLM se seskupily kolem náhodných úrovní hodnocení, bez významných rozdílů mezi nimi. I menší otevřené modely, jako je Mistral 7B a Gemma 7B, byly hodnoceny stejně jako GPT-4o, což naznačuje, že lidsky nerozlišitelný text již nemusí být omezen na největší modely.

Pro třetí aspekt, přesnost byla silněji spojena s doménovou odborností než s politickou orientací, protože znalost padělaných zpráv korelovala s lepšími hodnoceními, zatímco politické názory neukázaly žádný významný efekt, což naznačuje, že naučené analytické dovednosti mohou být důležitější než ideologie:

Výsledky pro třetí linii vyšetřování ukázaly, že politická orientace neměla žádný významný efekt na zdroj atributu nebo hodnocení autenticity, s pouze slabými, statisticky nevýznamnými trendy, zatímco sebehlášená znalost padělaných zpráv byla spojena s vyšší přesností na obou osách. To naznačuje, že zkušenostní analytické dovednosti byly silnějším prediktorem výkonu než ideologická pozice. Prosím, odkážete se na zdroj papíru pro lepší rozlišení.

Čtvrté zjištění ukázalo, že účastníci se seskupili do dvou různých reakčních stylů identifikovaných jako ‘Skeptici’ – kteří přiřazovali nízkou důvěru napříč obsahem bez ohledu na původ – a ‘Věřící’ – kteří udržovali vyšší úroveň důvěry.

Nakonec, pokud jde o pátý cíl, rolovací analýza sekvenčních hodnocení ukázala, že účastníci se zpočátku stali lepšími v úkolu, s přesností, která se zlepšovala během zhruba prvních 15-20 hodnocení, jak se přizpůsobili formátu:

Rolovací průměry skóre zdroje a autenticity napříč sekvencí účastnických hodnocení ukazují krátkou počáteční fázi zlepšení, jak uživatelé zdají se přizpůsobují úkolu během prvních 15–20 položek, následované stálým poklesem obou měření po zhruba 30 hodnocení. Prosím, odkážete se na zdroj papíru pro lepší rozlišení.

To může představovat některé empirické důkazy, že, unaveni perspektivou rozlišení padělaných zpráv od skutečných, AI zpráv od lidských, můžeme tendovat k defaultu na předpoklad, že zprávy jsou AI a/nebo padělané (což nejsou nutně stejné věci), aby byli ‘na bezpečné straně’. Ti, kteří považují toto chování za ‘lenivé’, a kteří si myslí, že lidé by měli sami provést výzkum, aby ověřili potenciální padělanou zprávu, by mohli být intéressováni tím, že se dozvědí, že studie z roku 2024 ukázala, že toto chování pouze zhoršuje problémy.

Autoři navrhují, že selhání lidského úsudku, které je patrné ve výsledcích, naznačuje, že můžeme potřebovat odkázat se na kryptografické technologie prokazování původu, jako je iniciativa C2PA vedená společností Adobe. Další možnými řešeními jsou autorský OriginLens rámec a další autorský projekt nazvaný CRED-1.

Autoři uzavírají:

‘Můžou lidé rozlišit? Naše duální osa studie 2 318 soudů napříč šesti LLM rodinami poskytuje jasnou empirickou odpověď: nemohou.

‘Strojově generovaný text je nerozlišitelný od lidského psaní bez ohledu na velikost modelu nebo rodiny, doménová odbornost předpovídá detekční přesnost silněji než politická orientace, účastníci přijímají různé důvěrné strategie, a kognitivní únava omezuje udržitelnou detekci.

‘Tyto výsledky podporují přechod od uživatelské úrovně detekce k systémovým protižádáním, včetně obsahu prokazování původu, adaptivních důvěrných indikátorů a omezených intervenčních injekcí.’

Závěr

Zajímavým aspektem této studie je podpůrná síť projektů a studií, které autoři – nebo někteří z autorů, v závislosti na práci – založili nebo se na nich podíleli; a určitě by bylo osvěžující prozkoumat vzorky AI a lidsky generovaného textu, které produkují tyto výsledky, aby se lépe pochopilo, jaký typ výstupu popisovaná generační metodologie produkuje.

Nicméně, je zajímavé slyšet, že otevřené, otevřené modely mohou srovnat s API-řízenými giganty, jako je série ChatGPT – může to být úkol, který není tak obtížný, a že model s 200 miliardami parametrů je nadměrný pro takové úkoly? Potřebujeme vědět trochu více o předložených AI a lidsky psaných vzorcích, aby bylo možné tuto otázku zodpovědět.

Mezitím, podle canirun.ai webové stránky, Mistral 7B (který byl více nebo méně na stejné úrovni jako ChatGPT-4o v testech) ‘funguje skvěle’ na NVIDIA RTX 3080 s 16GB VRAM, a funguje ‘dobře’ na 3060 s 6GB VRAM – což nejsou nejnovější nebo nejlepší grafické karty v provozu*. Kdokoli, kdo chce vytvořit vlastní metodologii pro podání vzorků, může tedy také účastnit se těchto experimentů.

* Gemma 7B není uvedena na webu.

Poprvé zveřejněno ve čtvrtek, 9. dubna 2026