Syntetická propast

Deepfakes, Voice Clones Fuel 148% Surge in AI Impersonation Scams

Unite.AI is committed to rigorous editorial standards. We may receive compensation when you click on links to products we review. Please view our affiliate disclosure.

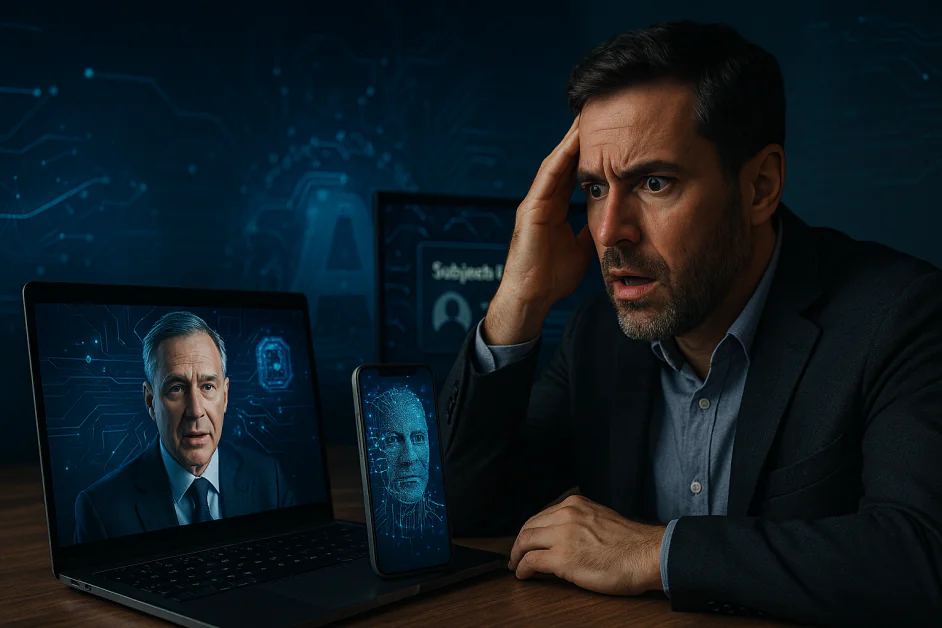

Profesionálové z obchodního prostředí i spotřebitelé čelí nové generaci podvodníků vybavených umělou inteligencí. V době, kdy již vidět není totéž co věřit, zločinci využívají umělou inteligenci k vylepšení starých schémat pomocí realistických triků. Nedávné případy zahrnují一切 od deepfake videí po klonované hlasy a e-maily generované pomocí AI, které jsou použity pro podvody. Výsledkem je meteorický růst high-tech impostorských podvodů – Identity Theft Resource Center uvádí ohromující 148% nárůst případů impostorských podvodů mezi dubnem 2024 a březnem 2025. Tato vlna AI-podporovaných podvodů zahrnuje falešné obchodní webové stránky, realistické chatboty „zákaznického servisu“ a dokonce i telefonní hovory s klonovanými hlasy, které napodobují skutečné zástupce společností. Tyto schématy jsou tak přesvědčivé, že dokonce i zkušení profesionálové byli oklamaní, což vedlo k naléhavým varováním ze strany odborníků na kybernetickou bezpečnost a orgánů činných v trestním řízení.

Skutečností je, že FBI vydala varování, že kyberzločinci využívají umělou inteligenci k spuštění vysoce realistických phishingových kampaní a deepfake impostorů. Místo nešikovných podvodných e-mailů z minulosti jsou dnes tyto podvodné zprávy vylepšeny – často jsou bez gramatických chyb a přizpůsobeny konkrétním obětem – zatímco deepfake audio nebo video může napodobovat známé hlasy a tváře v reálném čase. Tyto taktiky AI-podporovaného klamu využívají důvěru a vytvářejí falešný pocit naléhavosti, což činí cíle более pravděpodobně oklamanými. Důsledky toho, že se stanete obětí, jsou vážné, sahající od finančních podvodů po porušování soukromí a poškození pověsti, jak je diskutováno níže.

Rychlá evoluce AI-podporovaných podvodů

Pouze před několika lety byl podvodný telefonní hovor nebo e-mail často snadno rozpoznatelný podle jeho podivného znění nebo nízkokvalitního audiozáznamu. Nyní změnily pokroky v oblasti AI hru. Používáním deepfake algoritmů mohou podvodníci generovat pozoruhodně realistické video a audio, které simulují skutečné lidi – od CEO po blízké příbuzné. Nástroje pro klonování hlasu AI mohou s pouze krátkým vzorkem vytvořit „digitální dvojče“ někoho hlasu. Podvodníci použili tuto trik, aby napodobovali výkonné ředitele vydávající příkazy nebo blízké příbuzné, kteří se dovolávají pomoci. Například jeden nedávný incident zahrnoval podvodníka, který klonoval hlas vnuka, aby přesvědčil starší oběť, že její vnuk je v naléhavých potížích a potřebuje peníze co nejdříve. V obchodním prostředí bylo deepfake audio použito k napodobení CEO, aby autorizovalo podvodné převody peněz. V jednom případě v roce 2024 cílem podvodníků byla reklamní společnost WPP, když napodobovali hlas jejího CEO během virtuální schůzky – podvod, který byl naštěstí odhalen včas. Další AI hlasové podvody úspěšně oklamaly bankovní personál a podvedly finanční firmy o miliony dolarů, ukazují, jak efektivní tyto techniky mohou být.

Mimo hlas a video je generativní AI používána k psaní phishingových zpráv a vytváření falešných webových stránek s pozoruhodnou přesností. Sofistikované phishingové e-maily nyní přicházejí bez typických překlepů nebo nesprávné gramatiky, které dříve prozrazovaly podvodníky. Útočníci využívají AI k vytváření cílených phishingových zpráv, které vypadají, jako by je napsal profesionál – kompletní s vhodnou gramatikou a personalizovanými detaily – zvyšují tak pravděpodobnost úspěšného klamu a krádeže dat. Současně mohou zločinci vytvářet celou padělanou obchodní webovou stránku, která vypadá velmi legitimně. Tyto falešné stránky často přicházejí s přesvědčivými AI řízenými chatboty a klonovanými hlasovými agenty, kteří se vydávají za skutečné zástupce společností, aby nalákali oběti, aby vstoupily do hesel, čísel kreditních karet nebo jiných citlivých informací. Impersonace důvěryhodných organizací je společnou strategií – ITRC zjistil, že více než polovina impostorských podvodů v minulém roce zahrnovala podvodníky, kteří se vydávali za legitimní podniky, a dalších 21% se vydávalo za finanční instituce.

Jako další evoluce někteří podvodníci dokonce používají AI k vytvoření „syntetických identit“. To zahrnuje kombinaci skutečných a falešných osobních údajů, aby vytvořili fiktivní osobu, která vypadá jako legitimní jedinec. S AI generovanými profilovými fotografiemi a věrohodnými osobními údaji mohou zločinci otevřít bankovní účty nebo úvěrové linky pod těmito syntetickými osobami, efektivními způsobem spáchají krádež identity novým způsobem. V podstatě syntetické identity kombinují skutečné a falešné údaje, aby vypadaly jako skutečné, umožňují tak podvodníkům otevřít účty nebo spáchat krádež identity, zatímco se vydávají za úplně novou (ale falešnou) osobu, což ztěžuje bankám nebo úvěrovým agenturám detekci podvodu.

Skutečné riziko: podvody, krádeže a poškození pověsti

Důsledky těchto AI poháněných podvodů jsou vážné a velmi reálné. Oběti mohou trpět přímými finančními ztrátami, protože peníze jsou odčerpány nebo jsou účtovány podvodné poplatky. Mohou také čelit ukradeným osobním údajům a plné krádeži identity, pokud zločinci využijí a zneužijí jejich data. Úspěšný deepfake nebo impostorský podvod může vyčerpat bankovní účty, nahromadit dluhy nebo ukrást citlivé účty, než oběť si uvědomí, co se děje. Úředníci orgánů činných v trestním řízení varují, že tyto sofistikované taktiky již vedou k zničujícím finančním ztrátám a ohrožení citlivých dat. Skutečně, jakmile podvodníci získávat přístup – ať už prostřednictvím chytrého padělaného e-mailu nebo přesvědčivého telefonního hovoru – finanční a soukromé důsledky mohou být katastrofální.

Pro podniky jsou sázky stejně vysoké. Dobře provedený CEO deepfake podvod může oklamat zaměstnance, aby iniciovali neautorizované převody peněz nebo vyzradili důvěrné informace, potenciálně stojí společnosti obrovské sumy a právní problémy. Mimo přímou finanční ztrátu riskují organizace také poškození své pověsti a důvěry zákazníků. Pokud se rozšiřují zprávy, že byl CEO společnosti nebo její značka použita v podvodu, klienti mohou začít pochybovat. I když je pokus o podvod odhalen včas, samotná existence těchto padělků způsobuje zmatek. Společnosti musely varovat zákazníky a zaměstnance před falešnými komunikacemi, které se šíří jejich jménem. Například WPP – největší reklamní firma na světě – odhalila, že se potýká s falešnými webovými stránkami a zprávami, které napodobují její značku, a spolupracuje s úřady, aby tyto podvodníky uzavřely.

Jednotlivci mohou také trpět trvalým poškozením pověsti kvůli AI padělkům. Přesvědčivě padělané video nebo audio může se šířit online a pošpinit dobré jméno osoby, než je odhalena pravda. V jednom znepokojivém případě byl ředitel školy v Baltimoru umístěn na dovolenou, protože vyšlo najevo audiozáznam, na kterém údajně dělal urážlivé poznámky – pouze aby vyšetřovatelé zjistili, že šlo o zlomyslný deepfake vytvořený kolegou. Takové incidenty zdůrazňují znepokojivou realitu: AI generované lži mohou nejen ukrást peníze nebo data, ale také pošpinit nevinnou osobu charakter. Pro veřejně činné osoby i soukromé občany je eroze důvěry způsobená deepfakes vážnou obavou. Když může být kdokoli donucen „říci“ nebo „dělat“ cokoli na videu, stává se mnohem obtížnějším důvěřovat tomu, co vidíme a slyšíme, podkopává se tak důvěra v legitimní komunikaci.

Jak rozpoznat a zabránit AI podvodům

Přestože AI podvody rostou na sofistikovanosti, existují stále varovné signály a ochranná opatření, která mohou pomoci tyto podvody odhalit. Odborníci na bezpečnost doporučují zůstat ostražití vůči všem náznakům, že něco není v pořádku. Často budou podvodníci vytvářet falešný pocit naléhavosti – například volající (možná napodobující šéfa nebo člena rodiny) požaduje, abyste okamžitě jednali o problému. Tento tlak na to, aby jste přeskočili ověření a „udělali to hned“, je klasickým varovným signálem. Legitimní instituce zřídka trvají na tom, aby jste obešli všechny standardní postupy v okamžiku. Pokud cítíte nepřiměřenou naléhavost, pozastavte se a ověřte prostřednictvím druhého kanálu, než podniknete jakékoli kroky.

Také důvěřujte svým instinktům, pokud interakce s hlasem nebo videem feels off. I nejlepší deepfake technologie někdy mají drobné závady. Klonovaný hlas může znít nepřirozeně plochý nebo roboticky, a AI syntetizované video může mít mírně nesynchronizované lip-syncing, podivné osvětlení nebo nepřirozené pohyby očí. Podobně si dejte pozor na e-maily nebo texty, které vypadají příliš perfektně. Mnoho AI generovaných phishingových zpráv je dokonale formátováno a gramaticky správné – daleko lépe napsané než průměrný lidský e-mail – ale mohou cítit podivně obecné a postrádat osobní detaily, které by skutečný známý nebo kolega zahrnul. Ten paradox zprávy být jazykově bezchybnou, ale obsahově nepersonalizovanou, může být varovným signálem, že máte co do činění s AI vytvořeným podvodem.

Dalším velkým varovným signálem je jakékoli nesolicited požadavek na citlivé informace nebo platbu, který přichází prostřednictvím e-mailu, textu nebo nečekaného telefonního hovoru. Buďte velmi opatrní vůči zprávám, které žádají o poskytnutí hesel, kódů pro přihlášení, čísel sociálního zabezpečení nebo jiných osobních údajů. Podobně požadavky na platby prostřednictvím netradičních metod — jako jsou převody kryptoměn, předplacené debetní karty nebo kódy dárkových karet — jsou dobře známým znakem podvodů, protože tyto formy plateb jsou obtížně stopovatelné nebo nezvratné, jakmile jsou odeslány. Pokud někdo, kdo se vydává za důvěryhodnou společnost nebo vládní agenturu, vás směruje k platbě v Bitcoinu nebo dárkových kartách, je to téměř jistě podvod. Vždy ověřte identitu žadatele prostřednictvím oficiálních kanálů. Například, pokud dostanete e-mail, který vypadá, jako by pocházel z vaší banky a žádá vás o aktualizaci vašeho účtu, neklekejte na žádné odkazy. Místo toho zavolejte bance pomocí čísla na zadní straně vaší kreditní karty nebo navštivte jejich ověřenou webovou stránku, aby jste potvrdili. AI podvody často napodobují banky, vládní agentury nebo dokonce přátele a rodinu, takže nezávislé ověření je zásadní. Dvouminutový telefonní hovor může vás zachránit před drahým omylem.

Z hlediska prevence mohou několik praktických kroků dramaticky snížit vaše riziko. Omezte, jaké osobní informace sdílíte veřejně online – podvodníci prolírají sociální média pro detaily, jako je váš den narození, zaměstnavatel nebo jména členů rodiny, aby učinili své impersonace více přesvědčivými. Čím méně budete odhalovat, tím méně budou mít co dělat. Implementujte silnou bezpečnost na svých důležitých účtech: použijte vícefaktorové ověření (MFA), kde je to možné, aby i když je heslo ukradeno, zloděj by potřeboval druhý kód nebo potvrzení, aby se dostal dovnitř. Pravidelné aktualizace softwaru a zařízení jsou také klíčové, protože aktualizace často opravují zranitelnosti, které hackeři využívají. Zvažte použití správce hesel, aby vytvořil a uložil komplexní, jedinečná hesla – tím způsobem, pokud dojde k porušení jedné stránky, nebude ohrožena celá vaše digitální existence.

Společnosti by měly investovat do vzdělávání zaměstnanců a technických obran. Pravidelné školení může naučit personál, jak rozpoznat phishingové pokusy a deepfake triky, posiluje tak kulturu „důvěřuj, ale ověř“. Současně mohou moderní nástroje pro bezpečnost e-mailů filtrovat mnoho phishingových e-mailů, než vůbec dorazí do schránek. Společnosti by také měly zavednout přísné politiky pro ověření jakýchkoli požadavků na převod peněz nebo sdílení citlivých dat – například vyžadující sekundární schválení nebo telefonické ověření s známým číslem. Taková opatření mohou zastavit AI podvod v jeho stopách, i když počáteční kontakt někoho oklame. Stručně řečeno, kombinace lidské ostražitosti se chytrou bezpečnostní technologií je nejlepší recept na to, aby zůstat v bezpečí.

Bez ohledu na to, jak opatrní jste, je moudré se připravit na možnost, že některé osobní údaje mohou být stále ohroženy – ať už prostřednictvím porušení dat, propuštění hesla nebo AI podvodu, který projde obranou. Zde služby ochrany identity a monitoringu mohou poskytnout další bezpečnostní síť.

Zesílení obrany pomocí NordProtect

Jedním slibným řešením pro klidné spaní je použití důvěryhodné služby ochrany identity, která sleduje zneužití vašich osobních údajů. Například NordVPNova služba NordProtect nabízí komplexní sadu bezpečnostních opatření navržených pro éru AI podvodů. NordProtect poskytuje nepřetržité monitorování temné sítě, skenování kriminálních fór a dumpů dat, aby vás upozornil, pokud vaše osobní údaje (jako e-mailové adresy, hesla nebo čísla sociálního zabezpečení) jsou detekovány tam, kde by neměly být. Zahrnuje také sledování kreditu a identity – sleduje vaše kreditní soubory a veřejné záznamy na jakékoli náhlé změny nebo nové účty, které by mohly naznačovat, že někdo zneužívá vaši identitu. Uživatelé obdrží okamžitá bezpečnostní upozornění v okamžiku, kdy je detekována hrozba nebo nepravidelná aktivita, umožňující rychlé jednání, aby se uzavřely účty, než dojde k poškození.

Důleživé je, že služby jako NordProtect neonly monitorují; pomáhají vám reagovat. NordProtect přichází s vyhrazenou podporou a dokonce finančním krytím, aby pomohly obětem identity zločinu. Ve skutečnosti nabízí až 1 milion dolarů v pojištění pro obnovu identity, pomáhá pokrýt náklady, jako jsou právní poplatky nebo ukradené fondy, pokud dojde k nejhoršímu scénáři. Takové krytí může být spasitelem při zotavení se z následků AI podvodu. Používáním řešení, jako je NordProtect, v kombinaci s dobrými bezpečnostními návyky, mohou jednotlivci a společnosti dramaticky posílit svou obranu proti deepfake a AI poháněným podvodům.

Závěrem, zůstat před AI poháněnými podvody vyžaduje jak ostražitost, tak správné nástroje. Krajina podvodů se může vyvíjet rychlým tempem s deepfakes, hlasovými klonovanými a syntetickými identitami, ale povědomí a příprava mohou vrátit rovnováhu ve prospěch obránců. Vědět varovné signály těchto nových podvodů, praktikovat ověření a skepsi a využívat důvěryhodné ochranné služby, jako je NordProtect, můžete snížit riziko, že se stanete obětí. V světě, kde technologie vyzbrojuje špatné hráče, je nikdy nebylo důležitější, aby se dobrý hráči také vyzbrojili – a pamatovat, že když něco feels off, zdravá dávka pochybností je váš nejlepší přítel. Zůstaňte informováni, zůstaňte opatrní a budete dobře vybaveni, aby jste oklamali i nejchytřejší podvodníky.