Andersonův úhel

Kódovací AI často trpí Dunning-Krugerovým efektem

Nový výzkum ukazuje, že kódovací AI, jako je ChatGPT, trpí Dunning-Krugerovým efektem, často jednají s největší jistotou, když jsou nejméně kompetentní. Při řešení neznámých nebo málo známých programovacích jazyků tvrdí vysokou jistotu, i když jejich odpovědi se rozpadají. Studie spojuje nadměrnou jistotu modelu s nízkým výkonem a nedostatkem trénovacích dat, což vyvolává nové obavy o tom, kolik tyto systémy skutečně vědí o tom, co nevědí.

Každý, kdo strávil alespoň умерenou dobu interagující s velkými jazykovými modely o faktických záležitostech, již ví, že LLM jsou častodisposed dát jistou špatnou odpověď na dotaz uživatele.

Spolu s více zjevnými formami halucinace, důvod pro tuto prázdnou chvástivost není 100% jasný. Výzkum zveřejněný přes léto naznačuje, že modely dávají jisté odpovědi i když vědí, že jsou špatné, například; ačkoli jiné teorie připisují nadměrnou jistotu architektonickým volbám, mezi jinými možnostmi.

Co může konečný uživatel být jistý, je to, že zkušenost je neuvěřitelně frustrující, protože jsme hard-kódováni, abychom důvěřovali lidem odhadům svých vlastních schopností (nejen proto, že v takových případech existují důsledky, právní a jinak, pro osobu, která slibuje více, než může dodat); a druh antropomorfní transference znamená, že tendujeme replikovat toto chování s konverzačními AI systémy.

Ale LLM je nezodpovědná entita, která může a bude účinně vracet ‘Whoops! Butterfingers…’ poté, co pomohla uživateli nepřímo zničit něco důležitého, nebo alespoň promarnit odpoledne jejich času; předpokládá se, že přijme odpovědnost.

Horší, tato absence uvážlivé obezřetnosti se zdá být nemožné odstranit, alespoň u ChatGPT, který bude hojně ujišťovat uživatele o platnosti své rady a vysvětlí chyby ve svém myšlení pouze poté, co je škoda způsobena.

Lidé mohou být podobně tvrdohlaví a sebe-klamající – i když kdokoli, kdo se tak hluboce a často mýlil, by pravděpodobně byl propuštěn brzy. Takoví trpí opakem ‘impostor syndromu’ (kde se zaměstnanec bojí, že byl povýšen nad své schopnosti) – Dunning Kruger efekt, kde osoba významně přecenila svou schopnost vykonat úkol.

Náklad inflace

Nová studie z Microsoftu zkoumá hodnotu Dunning-Krugerova efektu v souvislosti s efektivními výkony AI-pomocených architektur kódování (jako je Redmondova vlastní Copilot), v rámci výzkumného úsilí, které je prvním, kdo se specificky zabývá tímto sub-sektorem LLM.

Práce analyzuje, jak jistě takové kódovací AI ohodnotí své vlastní odpovědi proti tomu, jak dobře skutečně fungují, napříč desítkami programovacích jazyků. Výsledky ukazují jasný lidský vzorec: když byly modely nejméně schopné, byly nejisté sami o sobě.

Efekt byl nejsilnější v málo známých nebo málo zdrojových jazycích, kde byly trénovací data tenká – slabší model nebo vzácnější jazyk, tím větší iluze dovednosti:

GPT-4o’s skutečný a vnímaný výkon napříč programovacími jazyky, seřazený podle skutečného výkonu. Zdroj: https://arxiv.org/pdf/2510.05457

Čtyři autoři, všichni rovnocenní přispěvatelé pracující pro Microsoft, tvrdí, že práce vyvolává nové otázky o tom, kolik lze těmto nástrojům důvěřovat, aby ohodnotily své vlastní výstupy, a uvádějí:

‘Analýzou modelové jistoty a výkonu napříč různými programovacími jazyky odhalujeme, že AI modely odrážejí lidské vzorce nadměrné jistoty, zejména v neznámých nebo málo zdrojových doménách.

‘Naše experimenty prokazují, že méně kompetentní modely a ty, které fungují v málo známých programovacích jazycích, vykazují silnější DKE-podobnou bias, což naznačuje, že síla biasu je úměrná kompetenci modelů. To odpovídá lidským experimentům pro bias.’

Výzkumníci kontextualizují tuto linii studie jako způsob, jak porozumět tomu, jak se modelová jistota stává nespolehlivou, když je výkon slabý, a testují, zda AI systémy vykazují stejný druh nadměrné jistoty, jako lidé – s důsledky pro důvěru a praktické nasazení.

Ačkoli nová práce popírá Betteridgeův zákon nadpisů, je nazvána Do Code Models Suffer from the Dunning-Kruger Effect?. Přestože autoři uvádějí, že kód byl vydán pro tuto práci, aktuální předtisk neobsahuje žádné podrobnosti o tomto.

Metoda

Studie testovala, jak přesně kódovací AI mohou ohodnotit své vlastní odpovědi, tím, že jim daly tisíce multiple-choice programovacích otázek, s každou otázkou patřící do konkrétní jazykové domény, od Pythonu a Javy po Perl a COBOL:

Programovací jazykové domény použité ve studii, spolu s počtem multiple-choice kódovacích otázek vzorkovaných pro každou doménu.

Modely byly zadány k výběru správné možnosti a poté odhadnout, jak jisté jsou ve svém výběru, s jejich skutečným výkonem měřeným tím, jak často odpověděly správně – a jejich sebe-ohodnocená jistota indikující, jak dobré věřily jsou. Srovnání těchto dvou metrik umožnilo výzkumníkům vidět, kde jistota a kompetence divergují.

Aby se měřila, jak jisté modely vypadaly, studie použila dvě metody: absolutní jistota a relativní jistota. V první model dostal skóre od nuly do jednoho vedle každé odpovědi, s jeho jistotou pro konkrétní jazyk definovanou průměrem těchto skórů napříč otázkami v tom jazyce.

Druhá metoda se podívala na to, jak jisté modely byly, když volily mezi dvěma otázkami; pro každou пару model musel říci, o kterou otázku je více jistý. Tyto výběry byly poté ohodnoceny pomocí rankingových systémů původně navržených pro soutěžní hry, zacházení s každou otázkou, jako by to byla hráč v zápase. Finální skóre byly normalizovány a průměrovány pro každý jazyk, aby se získal relativní jistotní skóre.

Dvě etablované formy Dunning-Krugerova efektu jsou zkoumány v článku: jeden, který sleduje, jak jeden model podceňuje svůj výkon napříč různými doménami; a druhý, který srovnává úrovně jistoty mezi slabšími a silnějšími modely.

První forma, nazvaná intra-participant DKE, se zabývá tím, zda jeden model se stává více nadměrně jistým v jazycích, kde funguje špatně. Druhá, inter-participant DKE, se ptá, zda modely, které fungují hůře celkově, také tendují k ohodnocení sebe sama více.

V obou případech je mezera mezi jistotou a skutečným výkonem použita k měření nadměrné jistoty, s většími mezerami v nízkém výkonu ukazujícími na DKE-podobné chování.

Výsledky

Studie testuje Dunning-Krugerův efekt napříč šesti velkými jazykovými modely: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, a GPT‑4o.

Každý model byl testován na multiple-choice programovacích otázkách z veřejně dostupného CodeNet datasetu, s 37 jazyky* reprezentovanými, aby se ukázalo, jak se jistota a přesnost liší napříč známými a málo známými kódovacími doménami.

Mezi-modelová analýza ukazuje jasný Dunning-Krugerův vzorec:

Skutečný versus vnímaný výkon napříč šesti kódovacími modely, ukazující, jak modely s nižší přesností, jako je Mistral a Phi‑3, vykazují vysokou jistotu, přestože mají nízkou přesnost, zatímco silnější modely, jako je GPT‑4o, ukazují více kalibrované nebo dokonce podceňované chování.

Modely s nižší přesností, včetně Mistralu a Phi‑3, tendenci k přehnanému odhadu svých vlastních schopností, zatímco modely s vyšší přesností, jako je GPT‑4o, ukazují úrovně jistoty, které více odpovídají jejich skutečnému výkonu, zejména když jsou posuzovány relativní jistotou.

Výsledky také naznačují, že nejkompetentnější modely mohou někdy podceňovat sami sebe (vzorec, který absolutní jistotní skóre nezachytí).

Výsledky také naznačují, že intra-modelová analýza také podporuje přítomnost Dunning-Krugerova efektu. Ve výsledkové tabulce uvedené na začátku článku vidíme, jak každý model fungoval napříč různými programovacími jazyky, seřazený podle skutečného výkonu.

V jazycích, kde modely dosáhly špatných výsledků, zejména v málo známých nebo málo zdrojových jazycích, jako je COBOL, Prolog a Ceylon, jejich jistota byla zřetelně vyšší, než jejich výsledky ospravedlňovaly. V známých jazycích, jako je Python a JavaScript, jejich jistota se více shodovala se skutečnou přesností, a někdy dokonce klesla pod ni.

Tento vzorec se objevil v obou absolutních a relativních jistotních opatřeních, naznačující, že modely jsou méně vědomé svých vlastních limitů, když fungují v neznámých kódovacích doménách.

Považování modelů za účastníky zavedlo některé omezení, protože malé množství modelů ovlivňuje rozmanitost; rozdíly v rámci jednoho modelu jsou ignorovány; a distribuce dat nemusí odrážet skutečné lidské účastníky.

Aby se to kompenzovalo, studie testovala tři alternativní nastavení: poprvé, každý model dostal odlišnou osobnost; podruhé, odpovědi byly vzorkovány při vyšší teplotě, aby se vytvořila více variace; potřetí, podněty byly parafrázovány mnohokrát, s každým verzí léčeným jako samostatný účastník:

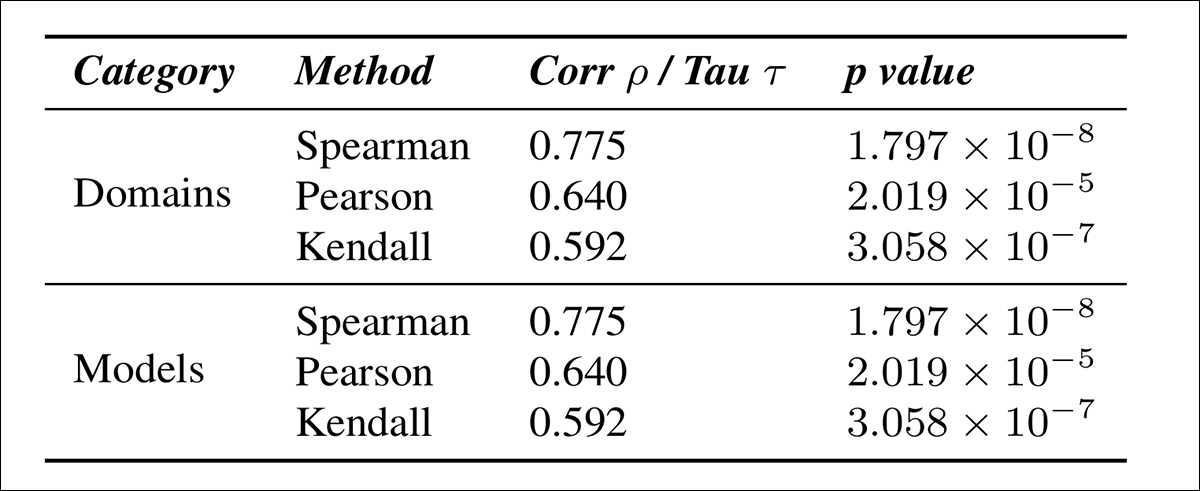

Korelace mezi nadměrnou jistotou a skutečným výkonem napříč různými experimentálními nastaveními, ukazující, že Dunning-Krugerův vzorec zůstává konzistentní ve všech podmínkách a je nejsilnější, když jsou vzorkovány multiple diverse odpovědi z téhož modelu.

Tabulka výsledků uvedená výše ukazuje, jak silně Dunning-Krugerův efekt se projevuje za těchto podmínek; a že DKE byl nejproniklivější, když byly vzorkovány multiple diverse odpovědi z téhož modelu při vysoké teplotě.

Aby se lépe pochopilo, jak se vnímaný výkon liší od skutečného výkonu, studie srovnala absolutní a relativní jistotní odhady, tím, že vypočítala, kolik každý model přeháněl svou vlastní schopnost (konkrétně, rozdíl mezi jeho jistotním skóre a jeho skutečnou přesností), a poté měřila, jak tato přehánění souvisí se skutečným výkonem modelu:

Korelace mezi nadměrnou jistotou (měřenou jako absolutní minus relativní jistota) a skutečnou přesností napříč programovacími doménami a modelovými typy, ukazující, že větší přehánění je konzistentně spojeno s nižším výkonem.

Tabulka výsledků výše ilustruje, jak přehánění souvisí se skutečným výkonem, jak napříč programovacími doménami, tak napříč modely. V obou případech můžeme vidět, že modely s nižší přesností tendují k většímu přehánění.

Dále specializované modely vyškolené na užších doménách vykazovaly silnější DKE efekty než generalisté:

Korelace mezi přeháněním a skutečným výkonem pro základní, single-doménové a multi-doménové specializované modely, ukazující silnější DKE efekty se specializací.

Použití MultiPL-E datasetu napříč osmi programovacími jazyky, autoři zjistili, že single-doménové školení vedlo k většímu přehánění než multi-doménové nebo základní nastavení, naznačující, že DKE zhoršuje se specializací.

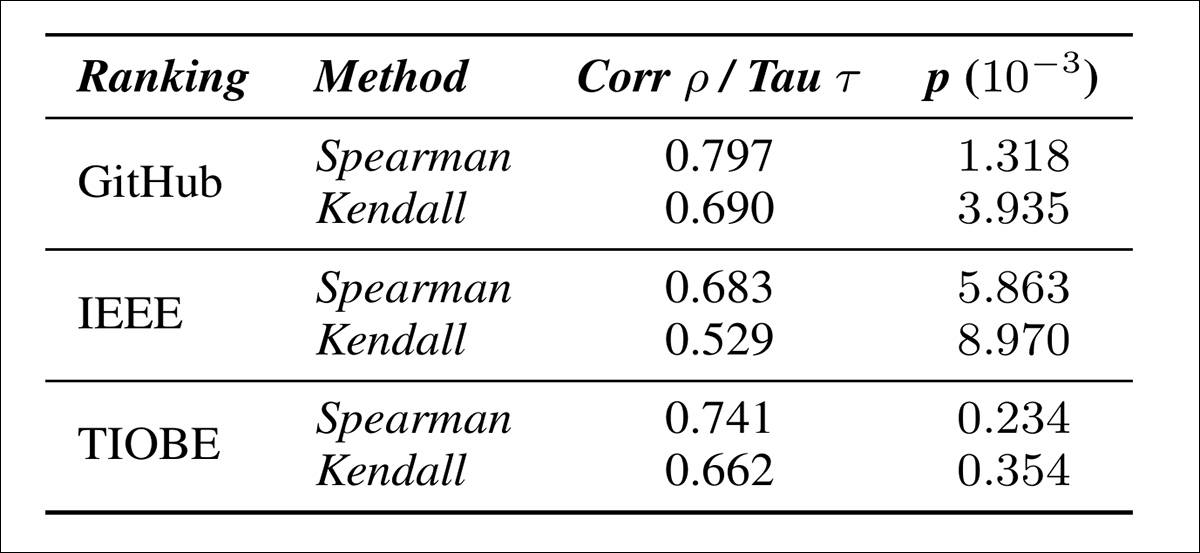

Testy také zjistily, že modely tendují k většímu přehánění v málo známých programovacích jazycích. Napříč GitHub, IEEE a TIOBE žebříčky, vzácnost silně koreluje s vyšší vnímanou jistotou, s vrcholem na 0,797:

Korelace mezi modelovou nadměrnou jistotou a jazykovou vzácností, používající tři popularity žebříčky. Méně běžné jazyky jsou spojeny s vyšší vnímanou performancí.

Nakonec autoři testovali, zda Dunning-Krugerův efekt se objevuje v kódové generaci, vyhodnocením modelů na MultiPL-E datasetu napříč Ada, Dart, Prolog, Swift, C++, Python, C# a Elixir jazyky.

Ačkoli efekt byl stále přítomen, byl pozoruhodně slabší než v multiple-choice otázkách, pravděpodobně odrážející větší obtížnost při hodnocení jistoty a správnosti v otevřených úkolech:

Korelace mezi přeháněním a skutečným výkonem v otevřené kódové generaci, založené na MultiPL‑E výsledcích napříč osmi jazyky.

Při zvažování stále sporného vysvětlení Dunning-Krugerova efektu, autoři uzavírají:

‘Jedno potenciální vysvětlení, které může být společné pro lidi i AI modely, je meta-kognitivní vysvětlení, které uvádí, že hodnocení kvality výkonu dovednosti je zásadní součástí získání dovednosti.

‘Toto vysvětlení lze potenciálně testovat experimentálně u AI modelů s kontrolovanou studií různých trénovacích strategií a zda všechny vedou ke současným zlepšením výkonu a schopnosti ohodnotit kvalitu výkonu. Nicméně, tato studie je významně mimo rozsah tohoto článku, a zanecháváme ji pro budoucí práci.’

Závěr

I v jeho rodném doměnu, Dunning-Krugerův efekt (jak článek poznamenává) může být připsán buď statistické nebo kognitivní příčině. Pokud je to statistická příčina, aplikace dříve jedinečně lidského syndromu do kontextu strojového učení je vlastně docela platná.

Ačkoli autoři spekulují, že příčina by mohla být nalezena v ‘kognitivních’ případech, to by vyžadovalo mírně více metafyzický postoj.

Možná nejzajímavějším zjištěním v článku je rozsah, v jakém několik kódovacích LLM tenduje k dvojnásobnému pokusu v jejich nejméně příznivých okolnostech, tj. vykazují maximální jistotu, když se zabývají nejřídějšími nebo nejméně známými jazyky – což by byla téměř okamžitě sebe-destruktivní strategie v reálném pracovním prostředí.

* Programovací jazyky použité byly Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript a Visual Basic.

Poprvé zveřejněno středa, 8. října 2025