Umělá inteligence

Lepší výkon strojového učení prostřednictvím CNN-založeného přepisu obrazu

Výzkum Google navrhl novou metodu pro zlepšení efektivity a přesnosti školení počítačového vidění založeného na obrazech zlepšením způsobu, jakým jsou obrázky ve datové sadě zmenšovány ve fázi předzpracování.

V článku Naučit se přepisovat obrázky pro úkoly počítačového vidění výzkumníci Hossein Talebi a Peyman Milanfar využívají CNN k vytvoření nové hybridní architektury přepisu obrazu, která produkuje pozoruhodné zlepšení výsledků rozpoznávání získaných ze čtyř populárních datových sad počítačového vidění.

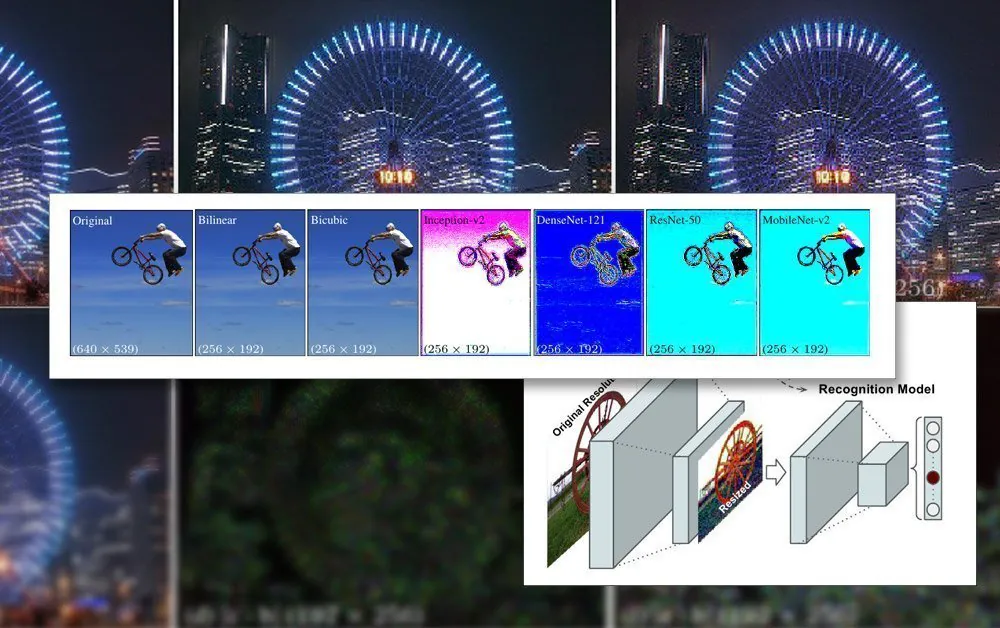

Navrhnutý společný rámec pro rozpoznávání a přepis. Source: https://arxiv.org/pdf/2103.09950.pdf

Článek pozoruje, že metody přepisu/přepisu, které se目前 používají v automatických strojových učeních, jsou desetiletí zastaralé a často používají pouze základní bilineární, bikubické a nejbližší sousední přepis – metody, které zacházejí se všemi pixely bez rozdílu.

Naopak, navrhovaná metoda rozšiřuje obrazová data prostřednictvím CNN a zahrnuje tento vstup do přepisovaných obrazů, které nakonec projdou architekturou modelu.

Omezení obrazu ve školení AI

Pro školení modelu, který pracuje s obrázky, bude rámec strojového učení zahrnovat fázi předzpracování, ve které je systematicky ořezán a přepisován různorodý soubor obrazů různých velikostí, barevných prostorů a rozlišení (které budou přispívat do školicí datové sady) do konzistentních rozměrů a stabilního, jediného formátu.

Obecně to bude zahrnovat nějaký kompromis založený na formátu PNG, kde bude stanoven kompromis mezi časem zpracování/zdroji, velikostí souboru a kvalitou obrazu.

Ve většině případů jsou konečná rozměry zpracovaného obrazu velmi malé. Zde vidíme příklad 80×80 rozlišení obrazu, ve kterém byly vygenerovány některé z prvních datových sad deepfakes :

Pоскольку tváře (a další možné předměty) zřídka zapadají do požadovaného čtvercového poměru, mohou být nutné přidat černé pruhy (nebo povoleny nevyužité prostory) za účelem homogenizace obrazů, což dále snižuje skutečná využitelná obrazová data:

Zde byla tvář extrahována z větší obrazové oblasti, dokud nebyla ořezána co nejekonomičtěji, aby zahrnovala celou oblast tváře. Avšak, jak je vidět na pravé straně, velká část zbývající oblasti nebude použita během školení, což přidává větší váhu důležitosti kvality přepisovaného obrazu.

Jak se schopnosti GPU zlepšily v posledních letech, s novou generací karet NVIDIA vybavených zvětšenou video-RAM (VRAM), průměrné velikosti přispívajících obrazů začínají růst, i když 224×224 pixelů je stále bastante standardní (například je to velikost ResNet-50 datové sady).

Nepřepisovaný 224×244 pixelů obraz.

Veškeré dávky do VRAM

Důvod, proč musí být všechny obrázky stejné velikosti, je ten, že gradientní sestup, metoda, kterou model zlepšuje s časem, vyžaduje uniformní školicí data.

Důvod, proč musí být obrázky tak malé, je ten, že musí být načteny (plně dekomprimovány) do VRAM během školení v malých dávkách, obvykle mezi 6-24 obrázky na dávku. Příliš málo obrázků na dávku a není dostatek skupinového materiálu pro generalizaci, kromě prodloužení školicího času; příliš mnoho a model může selhat při získání nezbytných charakteristik a detailů (viz níže).

Tato ‘živá načítání’ sekce školicí architektury se nazývá latentní prostor. Toto je místo, kde jsou opakovaně extrahovány funkce z téhož dat (tj. z téhož obrazu) až do té doby, než model dospěje do stavu, ve kterém má všechny generalizované znalosti, které potřebuje pro provedení transformací na pozdějších, neviditelných datech podobného typu.

Tento proces obecně trvá dny, i když může trvat i měsíc nebo více neustálého a neúnavného vysokého objemu 24/7 kognitivní aktivity, aby se dosáhlo užitečné generalizace. Zvýšení velikosti VRAM je pouze nápomocné do určité míry, protože i malé zvýšení rozlišení obrazu může mít řádový efekt na zpracování kapacity a související účinky na přesnost, které nemusí být vždy výhodné.

Používání větší kapacity VRAM pro ubytování větších dávek je také smíšené požehnání, protože vyšší školicí rychlosti získané touto cestou jsou pravděpodobně kompenzovány méně přesnými výsledky.

Proto, protože školicí architektura je tak omezená, vše, co může způsobit zlepšení v rámci existujících omezení potrubí, je pozoruhodným úspěchem.

Jak lepší zmenšování pomáhá

Konečná kvalita obrazu, který bude zahrnut do školicí datové sady, byla prokázána jako zlepšující účinek na výsledek školení, zejména v úkolech rozpoznávání objektů. V roce 2018 výzkumníci z Max Planck Institute for Intelligent Systems tvrdili, že výběr metody re-samplingu zřetelně ovlivňuje školicí výkon a výsledky.

Navíc, předchozí práce od Google (spolu-sepsaná autory nového článku) zjistila, že klasifikační přesnost může být zlepšena udržováním kontroly nad kompresními artefakty v obrazových datech datové sady.

CNN model postavený do nového re-samplu kombinuje bilineární přepis s funkcí “skip connection”, která může zahrnout výstup ze školené sítě do přepisovaného obrazu.

Na rozdíl od typické encoder/decoder architektury může nový návrh fungovat nejen jako feed-forward úzké místo, ale také jako inverzní úzké místo pro zvětšování na libovolnou cílovou velikost a/nebo poměr stran. Navíc, “standardní” metoda re-samplingu může být vyměněna za jakoukoli jinou vhodnou tradiční metodu, jako je Lanczos.

Vysokofrekvenční detaily

Nová metoda produkuje obrázky, které se zdají “upečené” klíčové funkce (které budou nakonec rozpoznány během školení) přímo do zdrojového obrazu. Z estetického hlediska jsou výsledky nekonvenční:

Nová metoda aplikovaná napříč čtyřmi sítěmi – Inception V2; DenseNet-121; ResNet-50; a MobileNet-V2. Výsledky metody downsamplingu/re-samplingu Google Research produkují obrázky s očividnou agregací pixelů, předpovídající klíčové funkce, které budou rozpoznány během školení.

Výzkumníci poznamenávají, že tyto počáteční experimenty jsou výhradně optimalizovány pro úkoly rozpoznávání obrazů a že v testech byl jejich CNN-poháněný “learned resizer” schopen dosáhnout zlepšených chybových sazeb v těchto úkolech. Výzkumníci mají v úmyslu v budoucnu aplikovat metodu na další typy obrazových aplikací počítačového vidění.