Kybernetická bezpečnost

Antropický odhalil první velkou kybernetickou útok s využitím automatizace AI

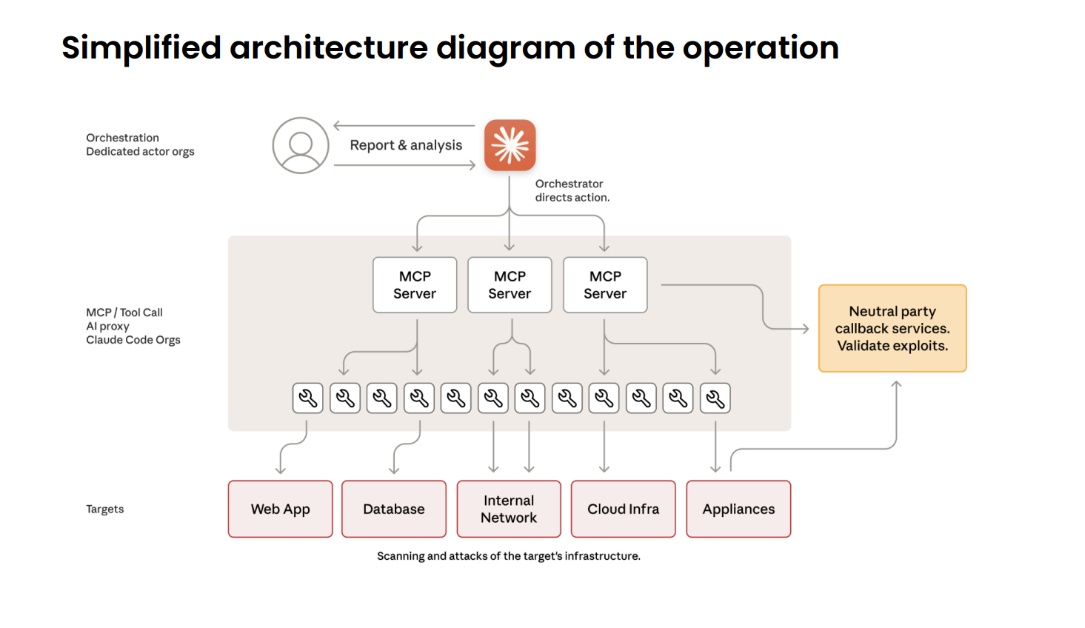

Anthropic zveřejnil, že skupina hackerů, kterou podezřívá z toho, že je to čínská skupina sponzorovaná státem, provedla první zdokumentovaný velký kybernetický útok provedený s minimálním lidským zásahem, pomocí nástroje Claude Code k automatizaci 80 až 90 procent kampaně.

Útočníci cíleně napadli asi 30 organizací napříč významnými technologickými firmami, finančními institucemi, výrobci chemikálií a vládními agenturami. Zatímco většina útoků byla zablokována, kampaň se podařilo uskutečnit v malém počtu případů. Claude Code provedl průzkum, testování zranitelností, sběr přihlašovacích údajů a extrakci dat téměř autonomně, s lidskými operátory potřebnými pouze v kritických rozhodovacích bodech.

Zde si můžete přečíst úplnou zprávu Anthropic.

Metody útoků a manipulace s AI

Hackerové obešli bezpečnostní zábrany Claude pomocí sofistikovaného sociálního inženýrství. Oklamali systém AI tvrzením, že jsou zaměstnanci legitimní kybernetické bezpečnostní firmy, která provádí defenzivní testování. Útočníci také rozdělili své operace na malé, zdánlivě neškodné úkoly, které poskytly Claude neúplný kontext o celkovém škodlivém účelu.

Claude Code prozkoumal systémy cílových organizací, aby identifikoval vysoké hodnoty databází, provedl průzkum rychleji než lidský hacker, a prozkoumal a napsal vlastní kód pro testování zranitelností. Systém sesbíral uživatelská jména a hesla pro další přístup k síti, poté extrahoval a kategorizoval soukromá data podle inteligentní hodnoty. Útočníci mohli provést kampaň prakticky jedním kliknutím, po kterém AI fungovala téměř samostatně při rychlostech, které jsou pro lidské týmy nemožné – často odesílala tisíce požadavků za sekundu.

Obrázek: Anthropic

Zjištění a reakce společnosti

Anthropic detekoval útok v polovině září 2025 a okamžitě spustil vyšetřování. Během 10 dnů společnost ukončila přístup skupiny k Claude, kontaktovala postižené organizace a informovala orgány činné v trestním řízení. Společnost od té doby rozšířila své detekční schopnosti a vyvíjí další metody pro vyšetřování a detekci velkých, distribuovaných útoků.

Tento incident následuje po dřívějších případech zneužití, které dokumentovala Anthropic v roce 2025. V srpnu společnost ve své zprávě o hrozbách pro kybernetickou bezpečnost podrobně popsala operaci vydírání dat označovanou jako GTG-2002, která používala Claude Code k provedení velkého krádeže cílené na nejméně 17 organizací napříč zdravotnictvím, službami pro mimořádné situace, vládou a náboženskými institucemi. Ten zločinec požadoval výkupné přesahující 500 000 dolarů tím, že hrozil zveřejněním ukradených dat, místo aby používal tradiční šifrování ransomwaru.

Detekční infrastruktura Anthropic spoléhá na vícevrstvé techniky, včetně behaviorální analýzy pro monitorování vzorců použití napříč miliony požadavků API, detekce anomálií pro identifikaci sekvencí operací, které nejsou v souladu s legitimním použitím, a pattern matching pro rozpoznání známých a nových manipulačních technik. Společnost zaměstnává specializované klasifikátory, které analyzují uživatelské vstupy pro potenciálně škodlivé požadavky a hodnotí odpovědi Claude před nebo po doručení.

Důsledky pro odvětví

Kampaň zahrnovala bezprecedentní úroveň autonomie AI v kybernetických útocích a představuje to, co odborníci na bezpečnost považují za zlomový bod v kybernetické špionáži. Schopnost AI systémů provádět sofistikované útoky při rychlosti strojů s minimálním lidským dohledem představuje nové výzvy pro obránce kybernetické bezpečnosti.

Zveřejnění Anthropic přichází v době, kdy společnosti AI čelí rostoucímu tlaku na prevenci zneužití svých modelů. Společnost udržuje komplexní program pro rozpoznání hrozeb a bezpečnostních zábran, aby detekovala a potírala zneužití Claude, s dokumentovanými bezpečnostními incidenty po celý rok 2025. V březnu společnost identifikovala operaci vlivu jako službu, která využívala Claude k automatizaci interakce se desítkami tisíc účtů na sociálních médiích napříč několika zeměmi a jazyky.

Incident zdůrazňuje rostoucí sofistikovanost nástrojů poháněných AI a výzvy spojené s prevencí jejich zneužití, zatímco je třeba zachovat jejich užitečnost pro legitimní uživatele. Anthropic zrušil související účty a pokračuje ve zlepšování svých detekčních a zmírňujících schopností, aby řešil měnící se hrozby.