Myslitelé

Od kódu k léku: Další AI revoluce potřebuje pomoc (a oči)

Jak agentic systémy, XR chytré brýle a robotika budou posilovat lidi – ne je nahrazovat

Procházíme prostřednictvím paradoxu v oblasti umělé inteligence.

Na obrazovkách je AI nadlidská. Velké jazykové modely píší funkční Python kód během sekund. Generativní systémy produkují fotorealistické obrázky a videa během minut. Systémy oceněné Nobelovou cenou, jako je AlphaFold, předpověděly struktury téměř všech známých proteinů. Digitální vítězství se hromadí.

Avšak ve fyzickém světě biomedicínského výzkumu zůstává proces objevování bolestivě manuálním. Není cítit, že by AI urychlovala vědu nebo medicínu, alespoň ne zatím. Čísla odhalují hloubku problému. Značný průzkum Nature mezi více než 1 500 vědci ukázal, že více než 70 % z nich se pokusilo a nezdařilo reprodukovat experimenty jiného výzkumníka. Ještě více znepokojivé: více než polovina z nich nemohla reprodukovat svou vlastní práci. V oblasti onkologie konkrétně osmiletý projekt reprodukovatelnosti zjistil, že pouze 40 % high-impact objevů mohlo být replikováno a 68 % experimentů postrádalo dostatečnou dokumentaci, aby se mohla pokusit o replikaci.

Toto je špinavý секрет moderní vědy: máme problém s zachycením znalostí, ne pouze s objevováním. Kritické experimentální detaily žijí v hlavách výzkumníků, ne v papírech. Protokoly se mění. Tacitní znalosti odcházejí, když se studenti stávají absolventy. Systémy AI, které jsou trénovány na publikované literatuře, dědí všechny tyto mezery.

Základní problém spočívá v tom, že zatímco AI může navrhnout nový protein pro onkologickou terapii v digitální simulaci, nemůže vzít do rukou pipetu, aby ji otestovala. Nemůže navigovat v nečistém, nepředvídatelném světě mokré laboratoře, aby ověřila svou vlastní hypotézu. Nemůže sledovat ruce zkušeného vědce a naučit se jemné techniky, které dělají experimenty funkčními.

Tato “mezera ve výkonu” je největší úzkým místem, které brání AI revoluci v tom, aby se stala medicínskou revolucí. Zatímco většina firem v oblasti robotiky je stále zaměstnána učeními strojů, aby složily prádlo nebo naložily myčku, zůstávají pozadu ve skutečně transformačních schopnostech těchto pokroků v oblastech, jako je medicína.

Abychom tento problém vyřešili, musíme jít za hranice chatbotů a směřovat k AI spoluvědcům, agentic systémům, které propojují digitální a fyzický svět, tlačíce za hranice plánování a kódování a do reálného výkonu. Na Stanfordu vyvíjíme LabOS, digitální-fyzický AI rámec, který demonstruje, jak AI agenti, XR chytré brýle a spolupracující robotika mohou spolupracovat, aby uzavřely tuto smyčku, transformovaly vědecké experimenty na spolupráci mezi člověkem a strojem a automaticky zachycovaly znalosti, které se目前 ztrácejí.

Velký rozpor: Proč AI potřebuje “oči” a “ruce”

Mnohé z nejviditelnějších AI vítězství se událiy tam, kde je prostředí plně digitální: repozitáře kódu, kurátorovaná data nebo simulační benchmarky (kde AI soutěží o řízení virtuální firmy nebo digitální investice do akcií).

Mokré laboratoře jsou odlišné. Biologie a obecně vědecké objevy jsou velmi hlučným procesem. Instrumenty se mění, operátoři improvizují a “protokol” často žije částečně v hlavách lidí. Rozdíl mezi čistým výsledkem a neúspěšným během může být úhel pipety, vzor míchání, substituce reagentu nebo inkubace, která trvala o 10 minut déle. Tyto kontextové detaily se zřídka dostanou do papíru a jsou přesně to, co model AI potřebuje, aby se mohl generalizovat za hranice datasetu.

To je důvod, proč laboratorní AI potřebuje oči (aby vnímala, co se děje v kontextu), ruce (aby standardizovala a bezpečně automatizovala kroky s vysokou variabilitou) a paměť (aby zaznamenávala, co se skutečně stalo). Bez těchto schopností mohou modely doporučovat, co dělat, ale nemohou spolehlivě přeložit doporučení do validovaného fyzického výkonu nebo vysvětlit neúspěchy, když realita se odchyluje od plánu.

Mimo chatboty: Od spoluvědců k AI spoluvědcům

Termín “agentic AI” je někdy používán volně. V biomedicínských prostředích by to mělo znamenat něco přesného: systém, který může vzít cíl (například “optimalizovat efektivitu editace genu CRISPR, zatímco minimalizuje cíle mimo”), rozložit ho na posloupnost úkolů, provést tyto úkoly napříč nástroji, vyhodnotit výsledky a přizpůsobit plán pod omezeními a s auditable rozhodováním.

To je důležité, protože výzkumné pracovní postupy nejsou jediným modelem. Jsou to koncové pipeline, které sahají od formulace hypotézy, experimentálního designu, zpracování dat, statistického testování a interpretace. Nedávné myšlení v oblasti objevování léků začalo zdůrazňovat agentic systémy, které mohou škálovat tyto pipeline, spíše než pouze urychlovat jednotlivé kroky (například diskuse Unite.AI o agentech v oblasti malé molekuly).

V softwarovém inženýrství jsme již viděli rané empirické důkazy, že AI spoluvědci mohou zvýšit produktivitu vývojářů. V biomedicíně je analogická příležitost nejen psát kód, ale také psát a ověřovat protokoly, strukturovat data, monitorovat výkon a uzavírat smyčku mezi predikcí a měřením, spojující AI s lidskými vědci v laboratořích.

LabOS: Když AI běží na operačním systému pro laboratoře zítřka

V naší práci na Stanfordu na AI4Science, pokrývající spoluvědce pro editaci genu CRISPR, jako je CRISPR-GPT a systémy AI-XR pro spolupráci, jako je LabOS, které pomáhají vědcům v biomedicínských a materiálových laboratořích, jsme zkoumali architektonický posun:

1. Navrhování koncového “lab operačního systému”, který spojuje digitální (suchou) laboratoř s fyzickou (mokrou) laboratoří.

Předpoklad je jednoduchý: pokud je laboratorní deník pamětí vědy, pak by měl laboratorní OS být vrstvou výkonu, zachycující záměr, překládající ho do akcí, sledující výsledky a měnící každý běh na strukturované znalosti.

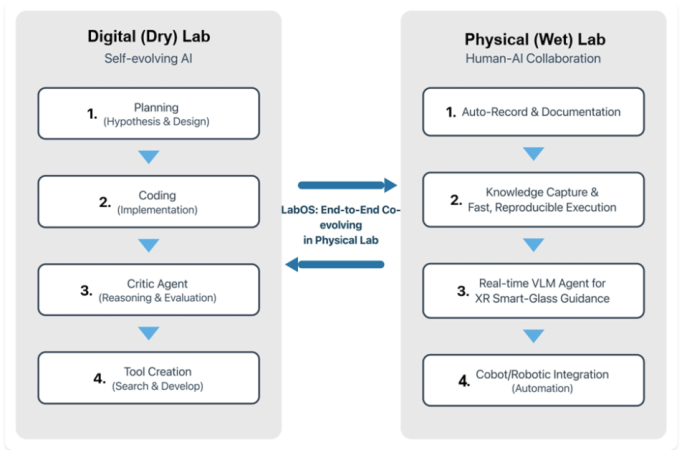

Obrázek. Konceptuální pohled na LabOS, který spojuje samo-řešící digitální laboratorní smyčku (plánování, kódování, kritika, tvorba nástrojů) s lidsko-AI mokrou laboratorní smyčkou (auto-dokumentace, zachycení znalostí, XR vedení a robotická integrace).

2. AI v digitální laboratoři – samo-řešící plánování a tvorba nástrojů

V digitální (suché) laboratoři můžeme nechat AI dělat to, co již dělá dobře: vyhledávat, syntetizovat a navrhovat. Ale chceme, aby se také samo-vylepšovalo. Ne “halucinováním nové vědy”, ale učením se lepších nástrojů a pracovních postupů z feedbacku.

Praktická digitální laboratorní smyčka může být rámcována jako čtyři opakující se fáze:

- Plánování (hypotéza + design): navrhnout hypotézy, vybrat experimentální proměnné, anticipovat rušivé proměnné a specifikovat měřitelné cíle.

- Kódování (implementace): generovat nebo adaptovat analytické skripty, simulační pipeline a šablony pro kontrolu instrumentů, kde je to vhodné.

- Kritický agent (důvod + hodnocení): stresovat předpoklady, kontrolovat statistickou sílu, navrhovat kontrolní skupiny a signalizovat pravděpodobné režimy selhání.

- Tvorba nástrojů (vyhledávání + vývoj): když pracovní postup postrádá komponent (parser, rutina QC, dashboard), vytvořit ji a přidat ji zpět do nástrojové sady.

3. AI v fyzické laboratoři – AI s “očí” (XR brýlemi) a “rukama” (robotikou)

Fyzická (mokrá) laboratoř je místem, kde systém buď získá důvěru – nebo ji ztratí. Cílem není nahradit vědce, ale snížit tření a chyby, zatímco zvyšuje pozorovatelnost.

Považujeme fyzickou laboratorní smyčku za čtyři komplementární schopnosti:

- Auto-záznam a dokumentace: zachytit akce, časové razítko, nastavení instrumentů a odchylky automaticky, aby dokumentace nebyla následnou myšlenkou.

- Zachycení znalostí pro rychlou, reprodukovatelnou realizaci: převést běhy na strukturované, dotazovatelné artefakty (verze protokolu, sady parametrů, výsledky QC) sladěné s principy správy dat, jako je FAIR.

- Reálné vidění-jazykové vedení prostřednictvím XR brýlí: použít multimodální modely k interpretaci scény (co operátor dělá, který reagent je v ruce) a poskytnout krok za krokem vedení a bezpečnostní kontroly. AR/XR již prokázala hodnotu v high-stakes fyzických pracovních postupech, jako je experimentální vedení (LabOS, Stanford, Princeton, ve spolupráci s NVIDIA).

- Cobot/robotická integrace pro automatizaci: standardizovat opakující se kroky, umožnit bezpečné předávání, a snížit variabilitu. Platformy pro simulaci-reálné pracovní postupy (například NVIDIA Isaac) a reálné AI zpracování na okraji, jako je živé streamování a interakce člověk-AI v LabOS, jsou důležité podpůrné vrstvy.

Tato architektura se shoduje s širším směrem v oblasti: “samo-řídící” nebo autonomní laboratoře, které kombinují automatizaci s učením strojů, aby naplánovaly další experiment. Co LabOS přidává, je těsnější lidská rozhraní vrstva, aby autonomie nepřišla na úkor transparentnosti.

Proč laboratorní AI není jen “AI na datasetu”

AI systémy pro biomedicínskou/vědeckou superinteligenci často vypadají působivě v retrospektivní evaluaci nebo při zkouškách, a poté podávají slabý výkon v fyzické laboratoři. Důvodem je zřídka jediný bug. Je to obvykle nesoulad mezi předpoklady modelu a realitou laboratoře.

Tři mezery se opakují:

- Kontextová mezera: datasety typicky opomíjejí kontextové proměnné, které operátoři znají, jako důležité (teplotní výkyvy, čísla šarží reagentů, jemné odchylky protokolu).

- Akční mezera: mnoho AI systémů může doporučit, co dělat, ale nemůže spolehlivě přeložit doporučení do validovaného fyzického kroku.

- Mezera zpětné vazby: bez strukturované, vysoké kvality zpětné vazby z výkonu, modely nemohou se učit, kde selhávají – a vědci nemohou audovat, proč.

Zavření těchto mezer je méně o vynálezu nového neuronového sítě a více o budování instrumentace, rozhraní a datových smluv, které dělají laboratoř čitelnou pro stroje a umožňují AI vidět a pracovat s lidmi.

Důvěra podle návrhu: Bezpečnost a správa pro AI, která může jednat

Agentic AI ve výzkumném objevování neonly zvyšuje známé obavy o přesnost. Zavádí nové režimy selhání, protože může jednat. V laboratoři znamená akce potenciál pro plýtvání, poškození nebo zavádějící závěry, zejména když experimenty krmí klinické hypotézy.

Užitečná mentalita je považovat AI-podporovaný laboratorní stack za socio-technický systém, který potřebuje záruky. Několik existujících rámců pomáhá, ale musí být přeloženo do reality laboratoře:

- Risk management jako kontinuální praxe: NISTův AI Risk Management Framework (AI RMF 1.0) poskytuje praktický slovník pro mapování, měření a řízení AI rizika napříč životním cyklem.

- Regulační soulad pro medicínsky příbuznou AI: FDA práce na AI/ML Software jako zdravotnickém zařízení (SaMD), včetně jeho Akčního plánu a souvisejících pokynů, nabízí konkrétní pohled na to, co “dobrá praxe” vypadá, když AI ovlivňuje péči o pacienty.

Pro editaci genu a další high-konsekvence domény je správa již globální konverzací. Doporučení jsou diskutována na lidské genové editaci, aby zdůraznila potřebu vhodných mechanismů dohledu a zodpovědné správy, jako jsou ty, které navrhuje Americká společnost pro genovou a buněčnou terapii, nebo ASGCT. Systémy, jako je LabOS, by měly být navrženy tak, aby usnadnily dodržování předpisů, ne aby ji ztížily.

Kontrolní seznam: Ovladače pro bezpečné AI spoluvědce pro vědecké objevování

Naším názorem je, že bezpečnostně vědomý laboratorní OS by měl implementovat alespoň následující návrhy:

- Původ podle výchozí hodnoty: každý dataset, verze protokolu a výstup modelu by měl být stopovatelný k vstupům a časovým razítkům.

- Ohraničená autonomie: systém by měl mít explicitní oprávnění (co může dělat bez potvrzení) a pravidla pro eskalaci (kdy musí požádat).

- Lidské přepsání a elegantní degradace: když senzory nebo datové toky selžou, nebo je vysoká nejistota, systém by se měl vrátit do bezpečnějšího, jednoduššího režimu.

- kontinuální validace: in-silico předpovědi by měly být spárovány s fyzickou laboratorní validací; fyzická laboratorní běhy by měly zahrnovat QC brány, než závěry projdou dolů zpět k AI modelům/agentům v digitálním světě.

- Bezpečnost a vědomí dvojího užití: chránit laboratorní infrastrukturu před manipulací.

Posílit lidi všude: Může AI spoluvědci vyrovnat hru?

Jedním z nejvíce přesvědčivých slibů AI-XR “spoluvědce” není jen rychlost pro elitní instituce, ale také dostupnost pro každého. Zvažte, co目前 omezuje menší laboratoře, startupy a vzdálené/venkovské/klinické kliniky:

- Omezený přístup ke specializované odbornosti pro zlatý standard protokolů a instrumentů.

- Vyšší relativní náklad na školení, chyby a přepracování.

- Fragmentované nástroje: poznámkové bloky, tabulky, instrumentální deníky a analytické skripty zřídka spojují čistě.

Systém, který může vést výkon v kontextu (prostřednictvím XR brýlí), zachytit, co se stalo automaticky, a navrhnout nejlepší další krok na základě předchozích běhů, mohl by učinit pokročilé testy více opakovanými napříč místy. V zásadě by mohl také podporovat distribuované klinické výzkumy, kde protokoly musí být prováděny konzistentně, i když zdroje se liší.

Časová osa: Kdy každý vědec a klinický pracovník získá spoluvědce?

Stručně řečeno, jsme blíže, než si mnoho lidí myslí, pro některé high-hodnotné, high-frekvenční úkoly (jako je producción léku spolehlivě v laboratoři) a dále, než většina demonstrací naznačuje, pro jiné (jako je AI úplně vyřeší velké problémy, jako je rakovina nebo Alzheimerova choroba). Realistický roadmap vypadá takto:

- Blízká budoucnost (do 1 roku): Pracovní spoluvědci, kteří snižují administrativní zátěž: návrh protokolu, syntéza literatury, šablony analýzy a automatické zprávy QC. Omezením je integrace, ne schopnost modelu.

- Střední doba (1-2 roky): Systémy pro spolupráci v laboratoři: XR brýle vedení, automatická dokumentace a selektivní robotika pro high-variance kroky. Důvěra bude záviset na auditních stopách a těsném lidském-v-lab-designu.

- Dlouhodobá budoucnost (3+ roky): Mezioboroví spoluvědci, kteří spojují objevy s překladem: propojují laboratorní data s klinickými cíli, monitorují bezpečnostní signály a pomáhají navrhnout studie – zatímco dodržují regulační a etické očekávání.

Od kódu k léku: Cesta vpřed k 1000x vědeckému objevování

LabOS je jeden pokus o odpověď na jednoduchou otázku: co kdyby experiment mohl být proveden jako konverzace, kde záměr, výkon a důkazy jsou spojeny koncově? Pokud postavíme tyto systémy dobře, mohou pomoci řešit překážku, která zpomaluje biomedicínu a mnoho fyzikálních vědeckých disciplín (například materiálovou vědu). Pokud je postavíme špatně, budou zesilovat nereproducibilitu a vytvářet nové bezpečnostní rizika.

Nejimportnější práce v příštích letech bude zakladatelská: standardizované datové a zařízení rozhraní prostřednictvím budování operačního systému (podobně jako iOS běží všechny typy aplikací), budování AI benchmarků, které zahrnují výkon a nejistotu (jako je benchmark LabSuperVision v LabOS), a začínající nasazení do reálného světa, které podporují inovace, zatímco chrání pacienty a výzkumnou integritu.

Pro výzkumníky a klinické pracovníky není otázka, zda AI vstoupí do laboratoře. Už tam je. Otázkou je, zda ji integrujeme jako sbírku nespojených nástrojů nebo jako důvěryhodný, auditable systém navržen pro realitu biomedicínské vědy.

Navrhované čtení a zdroje

- Průzkum reprodukovatelnosti (Nature, 2016): https://www.nature.com/articles/533452a

- Článek CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Zpráva Stanford Medicine o CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Preprint LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Web LabOS a benchmark LabSuperVision: https://ai4lab.stanford.edu

- Rámec NIST pro řízení AI rizika (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Přehled FDA o AI/ML softwaru jako zdravotnickém zařízení: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Zásady FAIR dat (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI o bariérách v objevování malé molekuly: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI o AI a robotické chirurgii: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/