الأمن السيبراني

لماذا لا تكون الهجمات على الصور المعادية مازحة

لقد اعتبر الهجوم على أنظمة التعرف على الصور باستخدام صور معادية محددة بدقة تم اعتباره ممتعًا ولكن غير مهم خلال الخمس سنوات الماضية. ومع ذلك، تشير الأبحاث الجديدة من أستراليا إلى أن الاستخدام العرضي لمجموعات بيانات الصور الشهيرة لمشاريع الذكاء الاصطناعي التجارية قد يخلق مشكلة أمنية مستدامة.

لمدة عامين الآن، كان فريق من الأكاديميين في جامعة أديلايد يحاول شرح شيء مهم جدًا حول مستقبل أنظمة التعرف على الصور القائمة على الذكاء الاصطناعي.

إنه شيء من الصعب (ومكلف للغاية) إصلاحه الآن، والذي سيكون من غير المقبول تكلفته لتصحيحه مرة واحدة بعد أن يتم تطوير الاتجاهات الحالية في أبحاث التعرف على الصور بشكل كامل إلى تطبيقات تجارية وصناعية في غضون 5-10 سنوات.

قبل أن ن开始، لنلقي نظرة على زهرة يتم تصنيفها على أنها الرئيس باراك أوباما، من واحد من ستة مقاطع فيديو نشرها الفريق على صفحة المشروع:

المصدر: https://www.youtube.com/watch?v=Klepca1Ny3c

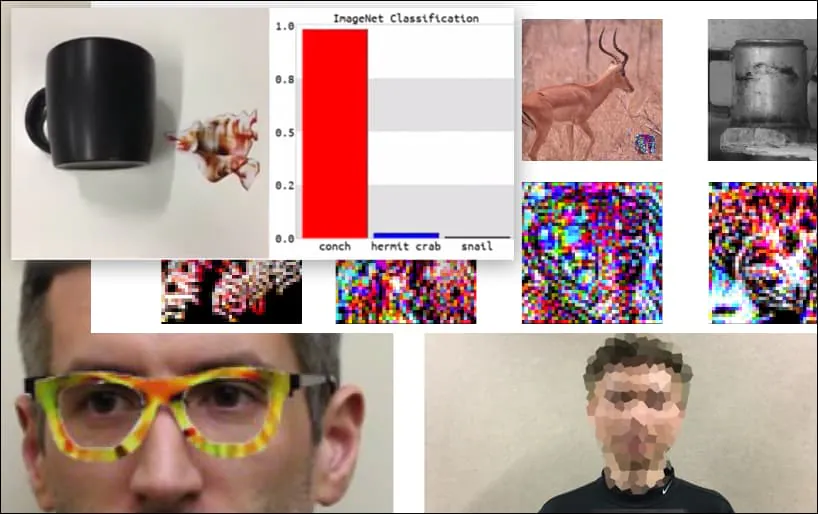

في الصورة المذكورة أعلاه، نظام التعرف على الوجه الذي يعرف بوضوح كيفية التعرف على باراك أوباما يتم خداعه للاعتقاد بثقة 80٪ أن رجلًا مجهول الهوية يحمل صورة معادية محددة بدقة لزهرة هو أيضًا باراك أوباما. النظام لا يهتم حتى بأن “الوجه الزائف” على صدر الشخص، وليس على كتفه.

على الرغم من أن إنجاز الباحثين في تحقيق هذا النوع من التقاط الهوية من خلال توليد صورة متسقة (زهرة) بدلاً من الضوضاء العشوائية المعتادة يبدو ممتعًا، يبدو أن الاستغلالات المضحكة مثل هذه تظهر بانتظام في أبحاث الأمان حول رؤية الكمبيوتر. على سبيل المثال، النظارات المزخرفة التي كانت قادرة على خداع نظام التعرف على الوجه في عام 2016، أو الصور المعادية المحددة بدقة التي تحاول إعادة كتابة لافتات الطريق.

إذا كنت مهتمًا، فإن نموذج الشبكة العصبية التلافوية (CNN) الذي يتم مهاجمته في المثال المذكور أعلاه هو VGGFace (VGG-16)، الذي تم تدريبه على مجموعة بيانات PubFig بجامعة كولومبيا. استخدمت عينات الهجوم الأخرى التي طورها الباحثون موارد مختلفة في تركيبات مختلفة.

لوحة المفاتيح يتم تصنيفها على أنها مخروط، في نموذج WideResNet50 على ImageNet. لقد أ đảm أن الباحثون أن النموذج لا يحتوي على أي تحيز تجاه الأصداف. انظر الفيديو الكامل لتحميل عروض إضافية ومضاعفة في https://www.youtube.com/watch?v=dhTTjjrxIcU

التعرف على الصور كمتجه هجومية ناشئة

الهجمات المثيرة للإعجاب التي يحددتها البحوث ويوضحها ليست انتقادات لبيانات أو معمارية تعلم الآلة محددة. ولا يمكن الدفاع عنها بسهولة من خلال تبديل مجموعات البيانات أو النماذج، أو إعادة تدريب النماذج، أو أي من العلاجات “البسيطة” الأخرى التي تسببها ممارسو تعلم الآلة للانضمام إلى عروض هذا النوع من الخداع.

بل إن استغلالات فريق أديلايد تُظهر ضعفًا مركزيًا في المعمارية الحالية لجميع أنظمة الذكاء الاصطناعي للتعرف على الصور؛ ضعف يمكن أن يتعرض لخداع أنظمة التعرف على الصور المستقبلية بسهولة من قبل المهاجمين، ووضع أي إجراءات دفاعية لاحقة في موقف صعب.

تخيل الصور المعادية الجديدة (مثل الزهرة المذكورة أعلاه) التي يتم إضافتها كـ “هجمات يوم الصفر” إلى أنظمة الأمان في المستقبل، تمامًا كما يتم تحديث تعريفات الفيروسات لأنظمة مكافحة الفيروسات وأمن البرامج الحالية كل يوم.

سيكون هناك إمكانية لا حصر لها للهجمات المعادية الجديدة على الصور، لأن معمارية النظام الأساسية لم تتوقع مشاكل لاحقة، كما حدث مع الإنترنت، و عيب الألفية و برج بيزا المائل.

كيف إذن نحن نضع المشهد لهذا؟

الحصول على البيانات للهجوم

الصور المعادية مثل مثال “الزهرة” المذكور أعلاه يتم توليدها من خلال الحصول على مجموعات بيانات الصور التي تم تدريب النماذج الكمبيوتر عليها. لا تحتاج إلى وصول “متميز” إلى بيانات التدريب (أو معمارية النموذج)، لأن معظم مجموعات البيانات الشهيرة (والعديد من النماذج المدربة) متاحة على نطاق واسع في سيل متجدد.

على سبيل المثال، مجموعة بيانات رؤية الكمبيوتر العملاقة، ImageNet، متاحة لتحميل عبر التورنت بجميع إصداراتها المتعددة، وتجاوز القيود المعتادة القيود، وإتاحة عناصر ثانوية حاسمة، مثل مجموعات التحقق.

المصدر: https://academictorrents.com

إذا كان لديك البيانات، يمكنك (كما يشير إليه باحثو أديلايد) “عكس هندسة” أي مجموعة بيانات شائعة، مثل CityScapes، أو CIFAR.

في حالة PubFig، مجموعة البيانات التي أتاحت “زهرة أوباما” في المثال السابق، قامت جامعة كولومبيا بمعالجة اتجاه متزايد في قضايا حقوق النشر حول إعادة توزيع مجموعة بيانات الصور من خلال توجيه الباحثين حول كيفية إعادة إنشاء مجموعة البيانات عبر روابط منضبطة، بدلاً من إتاحتها بشكل مباشر، مشيرة إلى ‘يبدو أن هذا هو الطريق الذي تتبعه قواعد البيانات الكبيرة الأخرى على الإنترنت’.

في معظم الحالات، لا يلزم ذلك: تقدر Kaggle أن أفضل 10 مجموعات بيانات للصور في رؤية الكمبيوتر هي: CIFAR-10 وCIFAR-100 (كلاهما متاح للتحميل المباشر); CALTECH-101 و256 (كلاهما متاح، ومتاح حاليًا كتورنتات); MNIST (متاح رسميًا، أيضًا على التورنتات); ImageNet (انظر أعلاه); Pascal VOC (متاح، ومتاح على التورنتات); MS COCO (متاح، ومتاح على التورنتات); Sports-1M (متاح); وYouTube-8M (متاح).

تعد هذه التوفر ممثلة أيضًا للنطاق الأوسع من مجموعات بيانات رؤية الكمبيوتر المتاحة، حيث الموت هو الغموض في ثقافة التطوير المفتوح “نشر أو افن”.

في أي حال، يزيد ندرة مجموعات البيانات القابلة للإدارة، وتكلفة تطوير مجموعة بيانات الصور، والاعتماد على “الأفكار القديمة”، وميل ببساطة إلى تعديل مجموعات بيانات قديمة من مشاكل المحددة في الورقة الجديدة في أديلايد.

انتقادات شائعة لطرق الهجمات على الصور المعادية

الانتقاد الأكثر شيوعًا لتقنيات الهجوم على الصور المعادية من قبل مهندسي تعلم الآلة هو أن الهجوم محدد لمجموعة بيانات معينة، أو نموذج معين، أو كلاهما؛ أنه لا يُعتبر “قابل للتعميم” على أنظمة أخرى؛ وبالتالي، يمثل تهديدًا琐ماً فقط.

الانتقاد الثاني الأكثر شيوعًا هو أن الهجوم على الصور المعادية هو ‘صندوق أبيض’، مما يعني أنك ستحتاج إلى وصول مباشر إلى بيئة التدريب أو البيانات. هذا هو سيناريو غير محتمل في معظم الحالات – على سبيل المثال، إذا كنت تريد استغلال عملية التدريب لأنظمة التعرف على الوجه لدائرة شرطة العاصمة لندن، ستحتاج إلى اختراق NEC بمكتب أو فأس.

التركيب الوراثي لمجموعات بيانات رؤية الكمبيوتر الشهيرة

بخصوص الانتقاد الأول، يجب أن نأخذ في الاعتبار ليس فقط أن عددًا قليلاً من مجموعات بيانات رؤية الكمبيوتر يهيمن على الصناعة حسب القطاع من سنة إلى أخرى (أي ImageNet لمختلف أنواع الكائنات، وCityScapes لمشهد القيادة، و FFHQ للتعرف على الوجه); ولكن أيضًا أن هذه المجموعات، كبيانات صورة بسيطة تم تحديدها، هي “مستقلة عن المنصة” وقابلة للنقل بسهولة.

اعتمادًا على قابليتها، سوف تجد أي معمارية لتعلم رؤية الكمبيوتر بعض ميزات الكائنات والفئات في مجموعة بيانات ImageNet. قد تجد بعض المعماريات المزيد من الميزات أكثر من غيرها، أو تجعل اتصالات أكثر فائدة من غيرها، ولكن جميعها يجب أن تجد على الأقل الميزات على أعلى مستوى:

تلك الميزات “على مستوى عال” هي التي تميز وتشخص مجموعة البيانات، وهي “المقابض” الموثوقة التي يمكن ربطها بمنهجية هجوم على الصور المعادية طويلة الأمد التي يمكن أن تتجاوز أنظمة مختلفة، وتتطور جنبًا إلى جنب مع مجموعة البيانات “القديمة” مع استمرارها في الأبحاث والمنتجات الجديدة.

سوف ينتج نموذج معماري أكثر تطورًا تحديدات أكثر دقة ومتفرقة:

然而، كلما اعتمدت طريقة الهجوم على الصور المعادية على الميزات الأقل (أي “شاب كاوكاسي أبيض” بدلاً من “وجه”), كلما كانت أقل فعالية في التrossover أو المعماريات اللاحقة التي تستخدم إصدارات مختلفة من مجموعة البيانات الأصلية – مثل مجموعة فرعية أو مجموعة مرشحة، حيث لا تتواجد العديد من الصور الأصلية من مجموعة البيانات الكاملة:

هجمات معادية على نماذج “مفروغ منها” مسبقًا

ماذا عن الحالات التي يتم فيها تحميل نموذج مدرب مسبقًا الذي تم تدريبه في البداية على مجموعة بيانات شائعة جدًا، وإعطائه بيانات جديدة تمامًا؟

النموذج تم تدريبه بالفعل على (على سبيل المثال) ImageNet، وكل ما تبقى هو الأوزان، التي قد استغرق تدريبها أسابيع أو أشهر، و现在 جاهزة لمساعدتك في تحديد كائنات مشابهة لتلك الموجودة في البيانات الأصلية (الغائبة الآن).

مع إزالة البيانات الأصلية من معمارية التدريب، ما تبقى هو ‘الانحياز’ الذي يصنف النموذج على النحو الذي تعلمه في الأصل، مما سيؤدي أساسًا إلى إعادة تشكيل العديد من ‘التوقيعات’ الأصلية وتصبح مرة أخرى عرضة للهجمات المعادية القديمة.

تعد الأوزان هذه قيمة. بدون البيانات أو الأوزان، لديك أساسًا بنية فارغة بدون بيانات. سوف تحتاج إلى تدريبها من الصفر، على حساب كبير من الوقت وموارد الحوسبة، تمامًا كما فعل المؤلفون الأصليون (ربما على أجهزة أكثر قوة وميزانية أعلى مما لديك).

المشكلة هي أن الأوزان تكون بالفعل متشكلة جيدًا ومتينة. على الرغم من أنها سوف تتكيف إلى حد ما في التدريب، سوف تتصرف بشكل مشابه على بياناتك الجديدة كما فعلت على البيانات الأصلية، مما ينتج ميزات توقيعية يمكن أن تعتمد عليها أنظمة الهجوم المعادية.

في الأمد البعيد، هذا أيضًا يحافظ على “الحمض النووي” لمجموعات بيانات رؤية الكمبيوتر التي تزيد عن 12 عامًا، وربما مرت بتحول ملحوظ من الجهود المفتوحة المصدر إلى التطبيقات التجارية – حتى في الحالات التي تم التخلص من البيانات الأصلية بالكامل في بداية المشروع. قد لا تحدث بعض هذه التطبيقات التجارية حتى بعد سنوات.

لا يلزم صندوق أبيض

بخصوص الانتقاد الثاني الشائع لأنظمة الهجوم على الصور المعادية، وجد مؤلفو الورقة الجديدة أن khảيتهم لخداع أنظمة التعرف على الصور بالصور المحددة بدقة قابلة للنقل بدرجة عالية عبر العديد من المعماريات.

في حين أنهم يلاحظون أن طريقة “TnT” هي الأولى التي تستخدم صورًا قابلة للتعرف (بدلاً من الضوضاء العشوائية) لخداع أنظمة التعرف على الصور، يعلن المؤلفون أيضًا:

‘[TnTs] هي فعالة ضد تصنيفات متقدمة تتراوح من WideResNet50 الشائعة في مهمة التعرف البصري على نطاق كبير لمجموعة بيانات ImageNet إلى نماذج VGG-face في مهمة التعرف على الوجه لمجموعة بيانات PubFig في كل من الهجمات المستهدفة وغير المستهدفة.

‘TnTs يمكن أن تملك: i) الطبيعية القابلة للتحقيق [مع] المحددات المستخدمة في طرق الهجوم الخبيثة؛ و ii) التعميم والانتقالية من الامثلة المعادية إلى شبكات أخرى.

‘هذا يثير مخاوف أمنية وآمنة بشأن الشبكات العصبونية الاصطناعية الموجودة بالفعل، وكذلك تطبيقات الشبكات العصبونية الاصطناعية في المستقبل حيث يمكن للمهاجمين استخدام تصحيحات كائنات طبيعية غير ملحوظة لخداع أنظمة الشبكات العصبونية دون تعديل النموذج وخطورة اكتشافه.’

يُقترح المؤلفون أن الإجراءات التقليدية، مثل تدهور Clean Acc. لشبكة، قد توفر بعض الدفاع ضد تصحيحات TnT، ولكن أن ‘TnTs لا تزال يمكن أن تتجاوز هذه الأساليب الدفاعية المثبتة بشكل جيد مع معظم الأنظمة الدفاعية التي تحقق 0٪ من المتانة’.

تتضمن الحلول الممكنة الأخرى التعلم الفيدرالي، حيث يتم حماية أصل الصور المساهمة، ونهج جديد يمكن أن “يشفر” البيانات في وقت التدريب، مثل واحد اقترحه مؤخرًا جامعة نانجينغ للطيران والفضاء.

حتى في تلك الحالات، سيكون من المهم تدريب البيانات على صور جديدة حقيقية – الآن، الصور والتعليقات المرتبطة بمجموعات بيانات رؤية الكمبيوتر الأكثر شعبية هي جزء لا يتجزأ من دورات التطوير حول العالم، وتشبه البرمجيات أكثر من البيانات؛ برمجيات لم يتم تحديثها بشكل ملحوظ منذ سنوات.

الختام

تتم إمكانية الهجمات على الصور المعادية ليس فقط من خلال ممارسات تعلم الآلة المفتوحة المصدر، ولكن أيضًا من خلال ثقافة التطوير التجاري للذكاء الاصطناعي التي تحفزها لاستخدام مجموعات بيانات رؤية الكمبيوتر الشهيرة لعدة أسباب: لقد أثبتت بالفعل فعاليتها؛ إنها أرخص بكثير من “البدء من الصفر”؛ وهي يتم صيانتها وتحديثها من قبل أذهان وتنظيمات رائدة في الأكاديميا والصناعة، بمستويات تمويل وتوظيف يصعب على شركة واحدة تكرارها.

علاوة على ذلك، في العديد من الحالات التي لم تكن البيانات أصلية (على عكس CityScapes)، تم جمع الصور قبل المناقشات الأخيرة حول ممارسات الخصوصية وجمع البيانات، تاركة هذه المجموعات القديمة في نوع من الوضع القانوني الغامض الذي قد يبدو وكأنه “ميناء آمن” من وجهة نظر الشركة.

TnT Attacks! Universal Naturalistic Adversarial Patches Against Deep Neural Network Systems هو من تأليف Bao Gia Doan وMinhui Xue وEhsan Abbasnejad وDamith C. Ranasinghe من جامعة أديلايد، جنبًا إلى جنب مع Shiqing Ma من قسم علوم الكمبيوتر بجامعة روتجرز.

تم تحديثه في 1 ديسمبر 2021، 7:06 صباحًا بتوقيت جرينيتش +2 – تم تصحيح خطأ إملائي.