زاوية Anderson

تجربة الملابس الجديدة افتراضياً من خلال الذكاء الاصطناعي

يمكن لنموذج الذكاء الاصطناعي الآن تحويل صورة واحدة وصور الملابس إلى فيديو متحرك لشخص يرتدي ملابس جديدة ، وتجنب الأخطاء الشائعة في الأنظمة القديمة ذات الخطوتين.

تعتبر فئة ‘الجلسة الافتراضية’ (VTON) في أبحاث الرؤية الحاسوبية من بين أفضل الفئات الممولة وأكثرها إنتاجاً في الأدبيات – ويرجع ذلك بشكل رئيسي إلى أن هذا الهدف يحصل على تمويل كبير من صناعة الأزياء الغنية ، كما يمكن استخلاص ذلك من التعاونات الصناعية والأكاديمية المتكررة التي تنشر كل عام :

من الورقة ‘Image-Based Virtual Try-On: A Survey’ ، أمثلة على أنواع تمثيل الشخص ، وبعض مراحل التصفية والتعدين التي يجب أن يمر بها حتى الصور الأساسية للجلسة الافتراضية (VTON). المصدر

هناك العديد من الاختلافات في الهدف ، مثل استخراج الملابس من صور الأشخاص ، و تلبية الشكل الأكبر عند الحاجة . تم تنفيذ بعض الأنظمة القائمة على الصور تجارياً ، على منصات مثل veesual.ai و wanna.fashion و fashn.ai .

بالنسبة للفيديو ، قام تطبيق Doppl التجريبي من Google Labs بتجربة هذه الوظيفة ، حيث تم إطلاقه في الصيف الماضي :

الرجاء النقر للعب إذا لم يكن الفيديو يلعب تلقائياً. مقتطفات من مشروع Google Doppl المهمَل للجلسة الافتراضية. المصدر

然而 ، يتم إغلاق Doppl في أبريل 2026 بعد استقبال بارد ، حيث يتم إحالة المشاهدين الآن إلى خدمة تجربة الجلسة الافتراضية الخاصة بالشركة فقط † :

برنامج تجربة الجلسة الافتراضية فقط للصور من Google ، حيث يتم إحالة المشاهدين إليه من منصة Doppl المهمَلة للشركة. المصدر

على الرغم من وجود عدد قليل من المنصات التي تقدم تجربة الجلسة الافتراضية مع الفيديو ، لا يبدو أن أي منها مرتبط بمنفذ فعلي ؛ وجميعها منتجات “حافة النصل” هامشية (وغالبًا ما تكون “مثيرة للشك”) لتذاكر الرمز .

في حين هناك العديد من المساعي المثيرة للاهتمام من قطاع البحث ، فهي تقليدياً هياكل معقدة يصعب تنفيذها لاتساق منخفض و質ية عالية :

الرجاء النقر للعب إذا لم يكن الفيديو يلعب تلقائياً. من مشروع Fashion-VDM لعام 2024 ، مثال على نقل الملابس “بدون رأس” . المصدر

الحقيقة هي أن مهمة توجيه الملابس إلى شخص حقيقي ، دون تشويه الملابس أو الشخص ، مع الحفاظ على نوع من الحركة الإيضاحية المفيدة (التي دقيقة تظهر الجزء الخلفي من المنتج عندما يلتفت الشخص إلى الخلف) ، هو تحدي كبير للوضع الحالي للفن .

Vanast

إنه تحدٍ يحاول ورقة جديدة من كوريا مواجهته ، من خلال استخدام حل متكامل جديد تمامًا لتحليل الملابس + الشخص + الحركة :

الرجاء النقر للعب إذا لم يكن الفيديو يلعب تلقائياً. أمثلة من موقع المواد الإضافية لمشروع Vanast. المصدر

النظام الجديد ، الذي يحمل عنوان Vanast ، يستفيد من مجموعة بيانات مخصصة تحتوي على دمج وتنسيق كلا العوامل الثلاثة الضرورية لإنجاز المهمة : الملابس ؛ الشخص ؛ والحركة :

انقر للعب.مزيد من الأمثلة من موقع مشروع Vanast.

يستفيد النظام من إطارات متنوعة مثل Flux و Qwen و ChatGPT ، لإنشاء مجموعة بيانات “ثلاثية” قادرة على إعلام هيكل من النهاية إلى النهاية :

من الورقة الجديدة ، أمثلة على نقاط بيانات مجموعة البيانات المستخدمة للتحليل والتدريب. المصدر –

الورقة الجديدة بعنوان Vanast: Virtual Try-On with Human Image Animation via Synthetic Triplet Supervision ، وهي من تأليف أربعة باحثين من جامعة سول الوطنية . هناك أيضًا موقع مشروع يحتوي على فيديوهات موقع مشروع .

الطريقة

الهدف المعلن للباحثين في العمل هو توحيد الجوانب الثلاثة المذكورة أعلاه في إطار مرحلي واحد – ليس فقط لأن العملية ستكون منفصلة ، ولكن أيضًا لأنها تعطي الجوانب المختلفة المزيد من الفرص للتفاعل أثناء التدريب ، مع نظر إلى توليد أكثر شمولاً :

يجمع Vanast صورة شخص واحدة وصور ملابس منفصلة ومرجع حركة لإنشاء تسلسل متحرك حيث يرتدي الشخص نفسه ملابس جديدة ، مع توجيه وضع يضمن حركة متسقة بينما يتم الحفاظ على هوية و细يات الملابس عبر الإطارات.

لتحقيق ذلك ، يستخدم النظام صورًا للملابس المستهدفة ؛ صورة للشخص يرتدي ملابس مختلفة ؛ فيديو مرجع للحركة يحدد كيف يجب على الشخص التحرك ؛ ونصًا يصف الإجراء والإعداد ؛ وينتج تسلسل فيديو كامل حيث يبدو أن الشخص يرتدي الملابس الجديدة ، بينما يتبع الحركة المفروضة ، مع الحفاظ على كل إطار متسقًا بمرور الوقت .

بدلاً من فصل الملابس والتحريك إلى مراحل منفصلة – وهو النهج المتبع في معظم الأعمال المماثلة السابقة – يتعامل Vanast مع الملابس والهوية والحركة معًا في عملية واحدة ، مما يسمح لهذه العناصر بالتفاعل أثناء التوليد ، ويتقلص من أنواع عدم التطابق وعدم الاستقرار التي ظهرت في الأساليب السابقة .

مجموعة البيانات

يستند التدريب على مشروع على أمثلة متوافقة لصورة شخص وملابس معينة وفيديو للشخص يتحرك بينما يرتدي تلك الملابس ، مع استخراج الحركة باستخدام هيكل سابق ، لتوفير توجيه وضع مستقر عبر الإطارات .

في غياب مجموعة بيانات عامة تفي بمتطلبات المشروع ، تم جمع البيانات من منصات تسوق عبر الإنترنت (غير محددة) ، مما يوفر ذخيرة من الفيديوهات ذات الملابس المتنوعة . ومع ذلك ، تتطلب المهمة فيديوهات للشخص نفسه يرتدي ملابس متعددة ، وهو اكتشاف نادر في البيانات البرية ، والتي تتطلب إنشاء بيانات اصطناعية .

العملية الثلاثية تضمنت اختيار إطارات مناسبة من الفيديوهات المجمعة ، والتي تمت من خلال نموذج Qwen2.5-VL ، مع تقليم وتقييم الملاءمة (أي لا توجد عوائق ، الموضوع في الموضع الصحيح ، إلخ) ؛ وإنشاء قناع تلوين مناسب لتحديد المناطق المتأثرة – الذي (وفقًا للعمل السابق PERSE) يتم التعامل معه بواسطة نموذج SDXL القديم .

نظرة عامة على خط أنابيب Vanast ، حيث يتم ترميز صورة الشخص وصور الملابس المستهدفة ومرجع الفيديو للحركة ومعالجتها في نموذج انتشار فيديو موحد . يولد النظام تحريكًا يحافظ على الهوية ، يتبع تسلسل الوضع ، ويطبق الملابس المستهدفة ، مع دعم توليد الثلاثية الاصطناعية للتدريب ، وتصميم مزدوج Module يفصل التحريك عن نقل الملابس ، للحفاظ على الاتساق.

في المرحلة الثالثة ، يقوم Qwen مرة أخرى بتصنيف الصور حسب الجنس ، ويتم استخدام إطار Flux الشعبي لإنشاء تعديلات على الملابس في الصورة (منذ Flux قادر على دمج عناصر الإدخال المتعددة) . تم تجميع نصوص التلوين بواسطة ChatGPT (الإصدار غير محدد) .

لزيادة تنوع الوضع والخلفية ، تم إدخال خط أنابيب لإنشاء ثلاثيات التدريب من فيديوهات البرية ، باستخدام مجموعة بيانات HumanVid . تم استخدام نفس العملية لإنشاء صورة الشخص المحافظة على الهوية .

الهيكل

تم تقديم هيكل مزدوج Module للتعامل مع التلاقي البطيء التلاقي والتوازن الضعيف للمراقبة الذي شوهد في تلك الأساليب السابقة التي حاولت دمج جميع الشروط . استفاد النهج من معامل التخفيض من الصوت إلى الفيديو من Wan ، واستفاد أيضًا من مشروع VACE (انظر أدناه) .

تم تقسيم النموذج إلى وحدة تحريك الإنسان (HAM) ، الذي يتعامل مع الحركة والهوية من الإدخال البشري ووضع الإدخال ؛ و وحدة نقل الملابس (GTM) ، الذي يتعامل مع الملابس من صور الملابس . يشارك كلاهما في الوصول إلى العمود الفقري ، بينما يتم دمج الميزات بطريقة موزعة ومتسلسلة ، لتحسين الشروط .

تم إجراء التدريب عن طريق تجميد العمود الفقري وتنظيم معاملات HAM و GTM فقط ، مع توازن مساهماتهما خلال دمج الميزات . تم تحويل الإدخالات من مجموعة بيانات الثلاثية الاصطناعية إلى تمثيلات الفراغ اللاتنتي باستخدام معامل التباين من WAN .

تم بناء السياق المتأثر بالحركة من خلال دمج المعلومات البشرية ووضع المعلومات عبر الوقت ، بينما تم معالجة ميزات الملابس بشكل منفصل ، وتم تسليطها من خلال الإسقاط إلى تمثيلات الرمز .

تم توسيع النموذج أيضًا لدعم تدرج الملابس . هنا ، تم دمج تمثيلات الملابس من ملابس منفصلة لإنشاء انتقالات سلسة ، مما يسمح بالخلط المتسق والمتناسق بين عناصر الملابس ، دون تحسين إضافي .

البيانات والاختبارات

تم تدريب النموذج على 9,135 فيديو ، بأطوال تتراوح من ثلاثة إلى عشرة ثوان ، تم الحصول عليها من مواقع “التسوق في المراكز التجارية” المذكورة أعلاه ؛ مجموعة بيانات المشروع التي تم إنشاؤها بواسطة المؤلفين ؛ ومجموعة بيانات HumanVid .

من هذه ، تم إنشاء مجموعات بيانات تقييمية : “مجموعة بيانات الإنترنت” ، التي تتميز بفيديوهات وصور المنتجات من المراكز التجارية ؛ ومجموعة بيانات الاختبار الرسمية لمجموعة بيانات ViViD من Alibaba .

由于 بيانات ViViD تفتقر إلى الوجوه (انظر الفيديو أعلاه ، لمثال على ذلك ، وهو شائع جدًا في أدبيات الجلسة الافتراضية) ، تمت إضافتها بواسطة تلوين Flux .

تم استخدام المعايير التالية : خسارة L1 ؛ نسبة الإشارة إلى الضوضاء القصوى (PSNR) ؛ مؤشر التشابه الهيكلي (SSIM) ؛ تشابه الصورة المكتسبة (LPIPS) ؛ مسافة إنCEPTION من Fréchet (FID) ؛ و مسافة الفيديو من Fréchet†† (FVD)

النظم التي تم اختبارها لنقل الملابس كانت OOTDiffusion ؛ CatVTON ؛ OmniTry ؛ و Any2AnyTryon . تم اختبار نماذج توليد الصور من موضوع إلى صورة VisualCloze ؛ MOSAIC ؛ و UNO من ByteDance .

للتحريك الثاني لصورة الإنسان ، تم استخدام إطارات StableAnimator و DisPose .

في سياق محدود (لأنه لا يدعم مباشرة الهدف) ، تم اختبار VACE أيضًا ، مع بعض الجهد لتحقيق توازن في الوظيفة الناقصة :

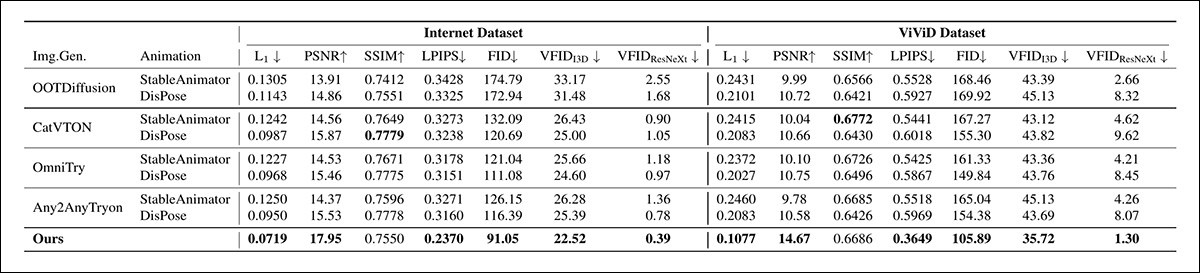

المقارنة الكمية مع مجموعات من نماذج الصورة إلى الصورة والتحريك على مجموعات بيانات الإنترنت و ViViD ، حيث حقق الأسلوب المقترح أفضل أداء عبر جميع المقاييس المبلغ عنها. القيم الغامقة تشير إلى أعلى درجة في كل عمود.

من بين النتائج الأولية المذكورة أعلاه ، يقول المؤلفون :

‘[نظامنا] يحقق أفضل أداء عبر جميع المقاييس عند مقارنته بمجموعات من نماذج توليد الصورة إلى الصورة والتحريك.

‘النتائج النوعية [الموضحة أدناه] تؤكد أيضًا أن نهجنا ينتج عنها اتباع وضع أكثر دقة ونقل ملابس ، مع الحفاظ على الهوية بشكل أكثر إخلاصًا من جميع أساسيات الصورة إلى الصورة.’

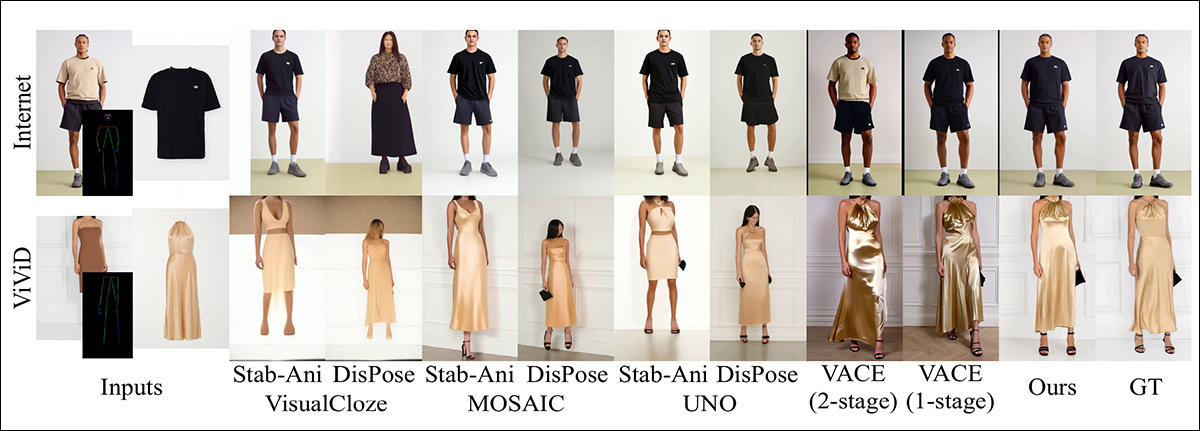

المقارنة النوعية على مجموعات بيانات الإنترنت و ViViD مقابل أساسيات الصورة إلى الصورة والتحريك ، حيث يزعم المؤلفون أن الأسلوب المقترح يقدم تحريكًا أكثر دقة وتحويل ملابس ، مع الحفاظ على الهوية بشكل أكثر اتساقًا من VisualCloze و MOSAIC و UNO و VACE.

للفئة الثانية من الاختبارات ، حيث تم اختبار مجموعات من تجارب الملابس الافتراضية القائمة على الصور ونماذج التحريك ، تمكن العمل الجديد من تحقيق أعلى درجة :

المقارنة الكمية مع مجموعات من نماذج تجربة الملابس الافتراضية القائمة على الصور والتحريك على مجموعات بيانات الإنترنت و ViViD . حقق الأسلوب المقترح أفضل أداء عام عبر المقاييس ، مع بقاء SSIM مشابهًا لأقوى أساسيات المقارنة. القيم الغامقة تشير إلى أعلى درجة.

يضيف المؤلفون :

‘المقارنات النوعية [الموضحة أدناه] تظهر أن نتائجنا تشبه الحقيقة أكثر من جميع أساسيات نقل الملابس القائمة على الصورة.’

الاختبارات النوعية باستخدام أساسيات تم إنشاؤها بواسطة دمج نماذج VTON مع نماذج التحريك.

الختام

على الرغم من أن مشروع Vanast يحقق حلًا من النهاية إلى النهاية المنفصل ، فإن نقص الورقة في التفاصيل حول متطلبات الموارد للتدريب والاستدلال يشير إلى أن هذا قد لا يكون هو الحل الأكثر مرونة أو سرعة . في الحقيقة ، التحدي نفسه صعب للغاية لتحقيقه حتى في نظام غير محسّن – وأكثر من ذلك في التوزيع التجاري الذي سيتطلب انخفاض الزمن والكفاءة / العائد على الاستثمار في المقايسة .

تجربة الملابس الافتراضية هي واحدة من أهداف الذكاء الاصطناعي “هجوم القمر” حيث يخفي الحالة الحالية للفن ، كما تم نشرها من خلال عناوين الأخبار والنماذج المحددة ، صعوبة المهمة ، التي قد تحل في النهاية بواسطة تقنيات لاحقة وأخف .

† متاح في الولايات المتحدة ، محظور في العديد من المناطق الأخرى ، إن لم يكن جميعها.

†† يشير المؤلفون إلى ‘VFID’ ، ولكن يرتبطون فقط بالورقة ViViD ، والتي لا تبرر الإشارة ، على ما أستطيع أن أتبعه ، مع وقت محدود لمتابعته . افترضت أنهم يعنيون في الواقع مسافة الفيديو من Fréchet (FVD) ، وكانوا قصيري النظر . يرجى الاتصال بي لتعديلات ، حسب الضرورة.

نشر لأول مرة يوم الأربعاء ، 8 أبريل 2026