健康防护

通过工作中的面部分析识别员工压力

在上下文中 改变文化 围绕 Zoom 会议礼仪,以及 变焦疲劳剑桥大学的研究人员发布了一项研究,利用机器学习通过人工智能网络摄像头对我们工作时面部表情的覆盖来确定我们的压力水平。

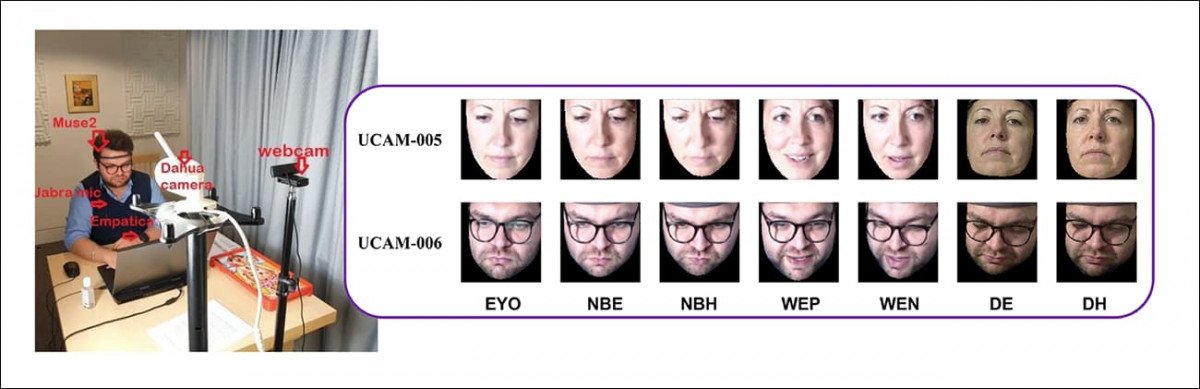

左边是数据收集环境,有多个监控设备,这些设备要么经过训练,要么附在志愿者身上; 右侧是测试对象在不同任务难度级别下产生的面部表情示例。 资料来源:https://arxiv.org/pdf/2111.11862.pdf

该研究旨在进行情感分析(即 情绪识别)在“环境辅助生活”系统中,大概是为了在此类系统中启用基于视频的人工智能面部表情监控框架而设计的; 尽管本文没有在这方面进行扩展,但研究工作在任何其他情况下都没有意义。

该项目的具体范围是学习面部表情模式 在工作环境中 – 包括远程工作安排 – 而不是“休闲”或“被动”情况,例如旅行。

工作场所基于面部的情绪识别

虽然“环境辅助生活”听起来像是一项老年人护理计划,但事实并非如此。 谈到目标“最终用户”,作者指出*:

'为周围辅助生活环境创建的系统 [†] 目标是能够执行自动情感分析和响应。 环境辅助生活依靠信息和通信技术(ICT)的使用来帮助改善人们的日常生活和工作环境,使他们保持更健康和更活跃的状态,并使他们能够随着年龄的增长而独立生活。 因此, 环境辅助生活旨在通过感知、评估和干预为卫生工作者、护士、医生、工厂工人、司机、飞行员、教师以及各行业提供便利.

“该系统旨在确定身体、情绪和精神压力,并在需要时做出反应和适应,例如,配备睡意检测系统的汽车可以通知驾驶员要集中注意力,并可以建议他们休息一下以免发生意外 [††]。'

纸 标题为 在类似工作的环境中推断用户面部表情,来自剑桥情感智能与机器人实验室的三名研究人员。

测试条件

自 以前的工作 在这一领域,剑桥大学的研究人员对 12 名校园志愿者(其中 5 名男性和 7 名女性)进行了本地数据收集实验,这在很大程度上依赖于从互联网上临时收集的图像。 这些志愿者来自22个国家,年龄在41-XNUMX岁之间。

该项目旨在重建三种潜在压力的工作环境:办公室; 工厂生产线; 以及电话会议——例如已经成为一种方式的 Zoom 群聊 频繁出现的特征 自疫情爆发以来,在家办公的情况越来越普遍。

通过多种方式对受试者进行监控,包括三个摄像头、一个 Jabra 颈戴式麦克风、一个 Empatica 腕带 (一款无线多传感器可穿戴设备,提供实时生物反馈)和 Muse 2 头带传感器(也提供生物反馈)。 此外,志愿者还被要求完成调查并定期自我评估自己的情绪。

然而,这并不意味着未来的环境辅助生活设备将“插入”到那种程度(如果只是出于成本原因); 数据收集中使用的所有非摄像头监测设备和方法,包括书面自我评估,都是为了验证由摄像头镜头启用的基于面部的情感识别系统。

增加压力:办公室场景

在三个场景中的前两个(“办公室”和“工厂”)中,志愿者以轻松的节奏开始,压力在四个阶段中逐渐增加,每个阶段都有不同类型的任务。

在最高水平的诱发压力下,志愿者还必须忍受有人回头看的“白大褂效应”,以及 85 分贝的额外噪音,这只是 低于五分贝 美国办公环境的法定限制,以及美国国家职业安全与健康研究所 (NIOSH) 指定的确切最高限制。

在类似办公室的数据收集阶段,受试者的任务是记住屏幕上闪过的先前字母,难度越来越大(例如必须记住两个屏幕前出现的两个字母序列)。

工厂场景

为了模拟体力劳动环境,受试者被要求玩游戏 操作,它要求玩家通过狭窄的金属边框孔从板上取出小物体而不接触侧面,该事件会触发“失败”蜂鸣器,从而挑战用户的灵活性。

当最困难的阶段到来时,志愿者面临的挑战是在一分钟内准确无误地提取所有 12 件物品。 作为背景,这项任务的世界纪录于 2019 年在英国创下, 12.68秒.

电话会议场景

最后,在家庭作业/电话会议测试中,实验者通过 MS Teams 电话要求志愿者回忆自己的积极和消极记忆。 在这种情况下压力最大的阶段,志愿者被要求回忆起最近一段非常消极或悲伤的记忆。

各种任务和场景以随机顺序执行,并编译成名为工作环境上下文感知数据集(WECARE-DB)的自定义数据集。

方法与训练

用户对其情绪的自我评估结果被用作基本事实,并映射到效价和唤醒维度。 实验捕获的视频通过面部标志检测进行运行 网络,并将对齐的图像馈送到 ResNet-18网络 受过训练的 影响网 数据集。

该论文称,来自 AffectNet 的 450,000 张图像全部使用情感相关查询从互联网上绘制/标记,并通过效价和唤醒维度进行了手动注释。

接下来,研究人员仅根据自己的 WECARE 数据集完善了网络,同时 频谱表示编码 用于总结基于帧的预测。

成果

该模型的性能根据通常与自动情感预测相关的三个指标进行评估:一致性系数相关性; 皮尔逊系数相关性; 和均方根误差 (RMSE)。

作者指出,在他们自己的 WECARE 数据集上微调的模型优于 ResNet-18,并由此推断,我们在工作环境中控制面部表情的方式与之前研究得出的更抽象的环境中的方式有很大不同素材来自互联网。

他们声明:

“从表格中我们观察到,在 WECARE-DB 上微调的模型优于在 [AffectNet] 上预训练的 ResNet-18 模型,这表明在类似工作的环境中显示的面部行为与在真实环境中显示的面部行为不同。 - AffectNet DB 中使用的狂野互联网设置。 因此,有必要获取数据集并训练模型来识别工作环境中的面部表情。

关于工作中情绪识别的未来,通过对员工进行训练的摄像头网络来实现,并不断预测他们的情绪状态,作者得出结论*:

“最终目标是在实际工作环境中实时实施和使用训练有素的模型,为决策支持系统提供输入,以促进人们在工作年龄阶段的健康和福祉。 欧盟工作年龄项目.'

*我的重点。

† 此处作者引用了三处:

自动、立体、连续的情绪识别 – https://ibug.doc.ic.ac.uk/media/uploads/documents/GunesPantic_IJSE_2010_camera.pdf

探索环境辅助生活领域:系统回顾 – https://link.springer.com/article/10.1007/s12652-016-0374-3

环境辅助生活环境物联网技术综述 – https://mdpi-res.com/d_attachment/futureinternet/futureinternet-11-00259/article_deploy/futureinternet-11-00259-v2.pdf

†† 这里作者引用了两次:

使用深度神经网络模型压缩的嵌入式系统实时驾驶员困倦检测 – https://openaccess.thecvf.com/content_cvpr_2017_workshops/w4/papers/Reddy_Real-Time_Driver_Drowsiness_CVPR_2017_paper.pdf

利用面部特征的实时驾驶员困倦检测系统 – https://www.semanticscholar.org/paper/Real-Time-Driver-Drowsiness-Detection-System-Using-Deng-Wu/1f4b0094c9e70bf7aa287234e0fdb4c764a5c532