Trí tuệ nhân tạo

Tại Sao Hệ Thống Video Tạo Sinh Không Thể Tạo Ra Phim Hoàn Chỉnh?

Sự ra đời và tiến bộ của video tạo sinh AI đã khiến nhiều người quan sát không chuyên đoán rằng học máy sẽ chứng minh là cái chết của ngành công nghiệp điện ảnh như chúng ta biết – thay vào đó, các nhà tạo nội dung đơn lẻ sẽ có thể tạo ra các bộ phim bom tấn theo phong cách Hollywood tại nhà, trên hệ thống GPU cục bộ hoặc dựa trên đám mây.

Liệu điều này có thể xảy ra? Ngay cả khi nó có thể xảy ra, liệu nó có đúng lúc, như nhiều người tin?

Rằng các cá nhân cuối cùng sẽ có thể tạo ra phim, dưới dạng mà chúng ta biết, với các nhân vật nhất quán, tính liên tục của câu chuyện và hình ảnh hoàn toàn thực tế, là hoàn toàn có thể – và có thể là không thể tránh khỏi.

Tuy nhiên, có một số lý do cơ bản thực sự tại sao điều này không có khả năng xảy ra với các hệ thống video dựa trên Mô hình khuếch tán tiềm ẩn.

Điều này rất quan trọng vì, tại thời điểm này, danh mục này bao gồm mọi hệ thống văn bản-sang-video (T2) và hình ảnh-sang-video (I2V) phổ biến có sẵn, bao gồm Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (và, theo như chúng tôi có thể nhận thấy, chức năng video sắp tới của Adobe Firefly’s pending); trong số nhiều khác.

Tại đây, chúng tôi đang xem xét khả năng của các sản phẩm đầy đủ auteur dài, được tạo ra bởi các cá nhân, với các nhân vật nhất quán, quay phim và hiệu ứng hình ảnh ít nhất tương đương với tình trạng hiện tại của nghệ thuật ở Hollywood.

Hãy cùng xem một số rào cản thực tế lớn nhất đối với các thách thức liên quan.

1: Bạn Không Thể Có Được Một Cảnh Tiếp Theo Chính Xác

Thất nhất quán trong câu chuyện là rào cản lớn nhất trong số này. Thực tế là không có hệ thống tạo video nào hiện có thể tạo ra một cảnh tiếp theo chính xác.

Điều này là vì mô hình khuếch tán làm giảm tiếng ồn ở trung tâm của các hệ thống này dựa trên tiếng ồn ngẫu nhiên, và nguyên tắc cốt lõi này không dễ dàng giải thích lại chính xác cùng một nội dung hai lần (tức là từ các góc độ khác nhau, hoặc bằng cách phát triển cảnh trước đó thành một cảnh tiếp theo duy trì tính nhất quán với cảnh trước).

Khi sử dụng các lời nhắc văn bản, riêng lẻ hoặc cùng với hình ảnh ‘hạt giống’ được tải lên (đầu vào đa phương thức), các token được派 sinh từ lời nhắc sẽ kích hoạt nội dung phù hợp về mặt ngữ nghĩa từ không gian tiềm ẩn của mô hình.

Tuy nhiên, bị cản trở thêm bởi yếu tố ‘tiếng ồn ngẫu nhiên’, nó sẽ không bao giờ làm điều đó theo cùng một cách hai lần.

Điều này có nghĩa là bản dạng của những người trong video sẽ có xu hướng thay đổi, và các vật thể và môi trường sẽ không khớp với cảnh ban đầu.

Đây là lý do tại sao các đoạn clip lan truyền mô tả các hình ảnh và đầu ra cấp độ Hollywood thường là một cảnh duy nhất, hoặc một ‘tổng hợp giới thiệu’ về khả năng của hệ thống, nơi mỗi cảnh có các nhân vật và môi trường khác nhau.

Trích đoạn từ một tổng hợp tạo sinh AI từ Marco van Hylckama Vlieg – nguồn: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Ám chỉ trong những bộ sưu tập này về các tạo sinh video ad hoc (có thể không trung thực trong trường hợp của các hệ thống thương mại) là rằng hệ thống cơ bản có thể tạo ra các câu chuyện liên tục và nhất quán.

Tương tự được khai thác ở đây là một đoạn giới thiệu phim, có thể chỉ có một hoặc hai phút cảnh từ phim, nhưng mang lại cho khán giả lý do để tin rằng toàn bộ phim tồn tại.

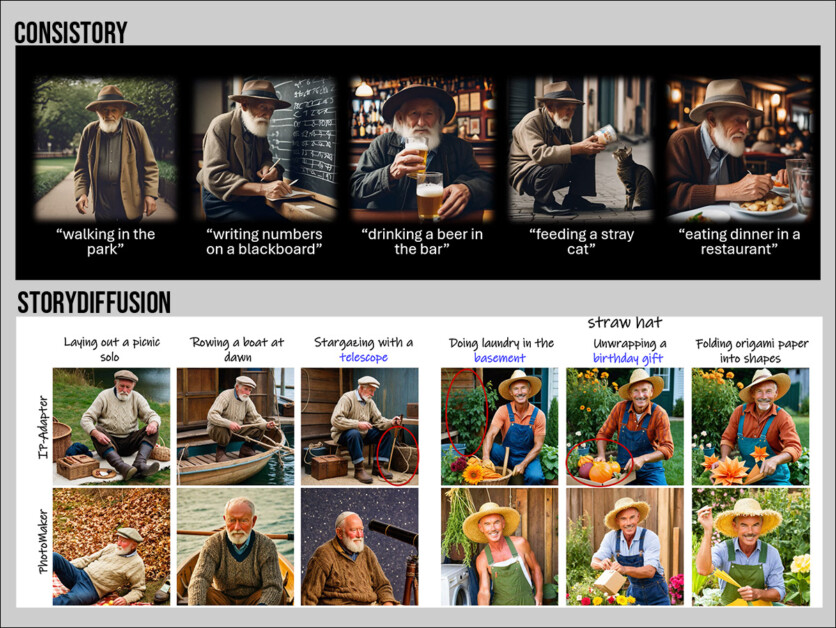

Các hệ thống duy nhất hiện cung cấp tính nhất quán trong câu chuyện trong một mô hình khuếch tán là những hệ thống tạo ra hình ảnh tĩnh. Những hệ thống này bao gồm ConsiStory của NVIDIA, và các dự án đa dạng trong tài liệu khoa học, chẳng hạn như TheaterGen, DreamStory, và StoryDiffusion.

Hai ví dụ về tính nhất quán trong câu chuyện ‘tĩnh’, từ các mô hình gần đây:: Nguồn: https://research.nvidia.com/labs/par/consistory/ và https://arxiv.org/pdf/2405.01434

Trong lý thuyết, bạn có thể sử dụng một phiên bản tốt hơn của các hệ thống như vậy (không có hệ thống nào trong số trên thực sự nhất quán) để tạo ra một loạt các cảnh hình ảnh-sang-video, có thể được kết nối thành một chuỗi.

Ở trạng thái hiện tại của nghệ thuật, cách tiếp cận này không tạo ra các cảnh tiếp theo có thể thuyết phục; và, trong mọi trường hợp, chúng tôi đã rời khỏi giấc mơ auteur bằng cách thêm một lớp phức tạp.

Chúng tôi cũng có thể sử dụng Low Rank Adaptation (LoRA) mô hình, được đào tạo cụ thể trên các nhân vật, sự vật hoặc môi trường, để duy trì tính nhất quán tốt hơn trên các cảnh.

Tuy nhiên, nếu một nhân vật muốn xuất hiện trong một trang phục mới, một LoRA hoàn toàn mới thường cần được đào tạo để bao gồm nhân vật mặc trang phục đó (mặc dù các khái niệm con như ‘đỏ’ có thể được đào tạo thành các LoRA riêng, cùng với hình ảnh phù hợp, chúng không phải lúc nào cũng dễ làm việc).

Điều này thêm một sự phức tạp đáng kể, thậm chí đối với một cảnh mở đầu trong một bộ phim, nơi một người bước ra khỏi giường, mặc một chiếc áo choàng tắm, ngáp, nhìn ra cửa sổ phòng ngủ và đi vào phòng tắm để đánh răng.

Một cảnh như vậy, chứa khoảng 4-8 cảnh, có thể được quay trong một buổi sáng bằng các thủ tục làm phim thông thường; ở trạng thái hiện tại của nghệ thuật tạo sinh AI, nó có khả năng đại diện cho vài tuần làm việc, nhiều LoRA được đào tạo (hoặc các hệ thống phụ trợ khác) và một lượng lớn hậu sản xuất

Hoặc, video-sang-video có thể được sử dụng, nơi các cảnh quay thông thường hoặc CGI được biến đổi thông qua lời nhắc văn bản thành các diễn giải thay thế. Runway cung cấp một hệ thống như vậy, ví dụ.

CGI (bên trái) từ Blender, được giải thích trong một thí nghiệm video-sang-video được hỗ trợ bởi văn bản của Mathieu Visnjevec – Nguồn: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Có hai vấn đề ở đây: bạn đã phải tạo cảnh quay cốt lõi, vì vậy bạn đang làm phim hai lần, ngay cả khi bạn đang sử dụng một hệ thống tổng hợp như MetaHuman của UnReal.

Nếu bạn tạo mô hình CGI (như trong đoạn clip trên) và sử dụng chúng trong một biến đổi video-sang-hình ảnh, tính nhất quán của chúng trên các cảnh không thể được tin cậy.

Điều này là vì các mô hình khuếch tán video không nhìn thấy ‘tổng thể’ – thay vào đó, chúng tạo ra một khung hình mới dựa trên khung hình trước / các khung hình trước, và, trong một số trường hợp, xem xét một khung hình tương lai gần; nhưng, để so sánh quá trình này với một trò chơi cờ, chúng không thể suy nghĩ ‘mười bước trước’ và không thể nhớ mười bước trước.

Thứ hai, một mô hình khuếch tán sẽ vẫn gặp khó khăn trong việc duy trì một hình ảnh nhất quán trên các cảnh, ngay cả khi bạn bao gồm nhiều LoRA cho nhân vật, môi trường và phong cách ánh sáng, vì những lý do được đề cập ở đầu phần này.

2: Bạn Không Thể Chỉnh Sửa Một Cảnh Dễ Dàng

Nếu bạn mô tả một nhân vật đang đi xuống đường bằng các phương pháp CGI cũ, và bạn quyết định thay đổi một số khía cạnh của cảnh, bạn có thể điều chỉnh mô hình và kết xuất lại.

Nếu đó là một cảnh quay trong đời thực, bạn chỉ cần đặt lại và quay lại, với các thay đổi phù hợp.

Tuy nhiên, nếu bạn tạo ra một cảnh quay video tạo sinh AI mà bạn yêu thích, nhưng muốn thay đổi một khía cạnh của nó, bạn chỉ có thể đạt được điều này bằng các phương pháp hậu sản xuất đau đớn được phát triển trong 30-40 năm qua: CGI, rotoscoping, mô hình hóa và tạo mặt nạ – tất cả đều là các thủ tục tốn thời gian và tốn kém, tốn thời gian.

Cách các mô hình khuếch tán hoạt động, chỉ thay đổi một khía cạnh của một lời nhắc văn bản (ngay cả trong một lời nhắc đa phương thức, nơi bạn cung cấp một hình ảnh ‘hạt giống’ nguồn hoàn chỉnh) sẽ thay đổi nhiều khía cạnh của đầu ra được tạo, dẫn đến một trò chơi ‘gõ mole’.

3: Bạn Không Thể Tùy Thuộc Vào Các Định Luật Vật Lý

Các phương pháp CGI truyền thống cung cấp nhiều mô hình dựa trên thuật toán và vật lý có thể mô phỏng các thứ như động lực học chất lỏng, chuyển động khí, động học ngược (mô hình hóa chính xác chuyển động của con người), động lực học vải, vụ nổ và nhiều hiện tượng thế giới thực khác.

Tuy nhiên, các phương pháp dựa trên khuếch tán, như chúng ta đã thấy, có trí nhớ ngắn và cũng có một phạm vi hạn chế của động thái trước (các ví dụ về các hành động như vậy, bao gồm trong tập dữ liệu đào tạo) để dựa vào.

Trong một phiên bản trước của trang đích của OpenAI cho hệ thống tạo sinh Sora được ca ngợi, công ty đã thừa nhận rằng Sora có những hạn chế trong khía cạnh này (mặc dù văn bản này đã được xóa):

‘[Sora] có thể gặp khó khăn trong việc mô phỏng vật lý của một cảnh phức tạp, và có thể không hiểu các trường hợp cụ thể của nguyên nhân và kết quả (ví dụ: một chiếc bánh quy có thể không hiển thị dấu vết sau khi một nhân vật cắn nó).

‘Mô hình cũng có thể nhầm lẫn các chi tiết không gian bao gồm trong một lời nhắc, chẳng hạn như phân biệt trái từ phải, hoặc gặp khó khăn với các mô tả chính xác về các sự kiện diễn ra theo thời gian, như các đường dẫn camera cụ thể.’

Sử dụng thực tế các hệ thống tạo video tạo sinh API dựa trên khác nhau cho thấy những hạn chế tương tự trong việc mô tả vật lý chính xác. Tuy nhiên, một số hiện tượng vật lý phổ biến, như vụ nổ, dường như được đại diện tốt hơn trong các tập dữ liệu đào tạo của chúng.

Một số bản nhúng động thái trước, được đào tạo vào mô hình tạo sinh hoặc được cấp từ một video nguồn, mất một thời gian để hoàn thành (chẳng hạn như một người thực hiện một chuỗi nhảy phức tạp và không lặp lại trong một bộ trang phục phức tạp) và, một lần nữa, cửa sổ chú ý ngắn của mô hình khuếch tán có khả năng biến đổi nội dung (định danh khuôn mặt, chi tiết trang phục, v.v.) vào thời điểm động thái đã được phát.

Tuy nhiên, LoRA có thể giảm bớt điều này, đến một mức độ nhất định.

Sửa Lỗi Trong Hậu Sản Xuất

Có những điểm yếu khác của việc tạo video AI ‘người dùng đơn’ thuần túy, chẳng hạn như khó khăn chúng gặp phải khi mô tả các chuyển động nhanh, và vấn đề chung và cấp bách hơn về đạt được tính nhất quán thời gian trong video đầu ra.

Ngoài ra, việc tạo ra các hiệu suất khuôn mặt cụ thể là gần như một vấn đề may mắn trong video tạo sinh, cũng như đồng bộ hóa môi cho đối thoại.

Trong cả hai trường hợp, việc sử dụng các hệ thống phụ trợ như LivePortrait và AnimateDiff đang trở nên rất phổ biến trong cộng đồng VFX, vì điều này cho phép việc chuyển vị của ít nhất các biểu cảm khuôn mặt rộng và đồng bộ hóa môi đến đầu ra được tạo sinh hiện có.

Một ví dụ về chuyển giao biểu cảm (đầu vào video ở góc dưới bên trái) được áp đặt lên một video mục tiêu với LivePortrait. Video là từ Generative Z TunisiaGenerative. Xem phiên bản đầy đủ với chất lượng tốt hơn tại https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Hơn nữa, một loạt các giải pháp phức tạp, kết hợp các công cụ như giao diện người dùng Stable Diffusion ComfyUI và ứng dụng compositing và xử lý chuyên nghiệp Nuke, cũng như việc xử lý không gian tiềm ẩn, cho phép các nhà thực hành VFX AI có được quyền kiểm soát lớn hơn đối với biểu cảm khuôn mặt và tư thế.

Mặc dù anh mô tả quá trình hoạt hình khuôn mặt trong ComfyUI là ‘torture’, chuyên gia VFX Francisco Contreras đã phát triển một quy trình như vậy, cho phép việc áp đặt các phoneme môi và các khía cạnh khác của biểu diễn đầu / khuôn mặt

Stable Diffusion, được hỗ trợ bởi một quy trình ComfyUI được hỗ trợ bởi Nuke, cho phép chuyên gia VFX Francisco Contreras có được quyền kiểm soát không thường見 đối với các khía cạnh khuôn mặt. Để xem video đầy đủ, với độ phân giải tốt hơn, hãy truy cập https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Kết Luận

Không có gì trong số này là đáng khích lệ cho triển vọng của một người dùng đơn lẻ tạo ra các bộ phim đầy đủ, mạch lạc và thực tế, với đối thoại thực tế, đồng bộ hóa môi, hiệu suất và tính nhất quán.

Hơn nữa, những chướng ngại vật được mô tả ở đây, ít nhất là liên quan đến các mô hình video tạo sinh dựa trên khuếch tán, không nhất thiết phải giải quyết ‘bất cứ lúc nào’ bây giờ, mặc dù các bình luận trên diễn đàn và sự chú ý của truyền thông cho rằng điều này. Những hạn chế được mô tả dường như là固 có trong kiến trúc.

Trong nghiên cứu tổng hợp AI, cũng như trong mọi nghiên cứu khoa học, những ý tưởng tuyệt vời định kỳ làm cho chúng ta choáng ngợp với tiềm năng của chúng, chỉ để nghiên cứu thêm phát hiện ra những hạn chế cơ bản của chúng.

Trong không gian tạo sinh / tổng hợp, điều này đã xảy ra với Mạng đối kháng tạo sinh (GAN) và Trường bức xạ thần kinh (NeRF), cả hai đều cuối cùng đã chứng minh rất khó được công cụ hóa thành các hệ thống thương mại hiệu suất, mặc dù nhiều năm nghiên cứu học thuật nhằm mục đích đó. Những công nghệ này hiện xuất hiện thường xuyên nhất như các thành phần phụ trong các kiến trúc thay thế.

Giống như các xưởng phim hy vọng rằng đào tạo trên các danh mục phim được cấp phép hợp pháp có thể loại bỏ các nghệ sĩ VFX, AI thực sự thêm vai trò vào lực lượng lao động tại thời điểm này.

Liệu các hệ thống video dựa trên khuếch tán có thể thực sự được biến thành các máy tạo phim nhất quán và thực tế, hay liệu toàn bộ việc này chỉ là một cuộc theo đuổi alchemic, nên trở nên rõ ràng trong 12 tháng tới.

Có thể chúng tôi cần một cách tiếp cận hoàn toàn mới; hoặc có thể Gaussian Splatting (GSplat), được phát triển vào đầu những năm 1990 và gần đây đã cất cánh trong không gian tổng hợp hình ảnh, đại diện cho một giải pháp thay thế tiềm năng cho việc tạo video dựa trên khuếch tán.

Vì GSplat mất 34 năm để nổi lên, cũng có thể những người cạnh tranh cũ như NeRF và GAN – và thậm chí cả mô hình khuếch tán tiềm ẩn – vẫn chưa có ngày của họ.

* Tính năng AI Storyboard của Kaiber cung cấp chức năng này, nhưng kết quả tôi đã thấy không phải là chất lượng sản xuất.

Martin Anderson là cựu trưởng nhóm nội dung nghiên cứu khoa học tại metaphysic.ai

Đăng lần đầu vào Thứ hai, ngày 23 tháng 9 năm 2024