Góc nhìn Anderson

Hướng tới Kiểm soát Toàn diện trong Tạo Video AI

Các mô hình nền tảng video như Hunyuan và Wan 2.1, mặc dù mạnh mẽ, nhưng không cung cấp cho người dùng loại kiểm soát chi tiết mà sản xuất phim và truyền hình (đặc biệt là sản xuất hiệu ứng hình ảnh) đòi hỏi.

Trong các phòng thu hiệu ứng hình ảnh chuyên nghiệp, các mô hình mã nguồn mở như những mô hình này, cùng với các mô hình dựa trên hình ảnh (thay vì video) trước đó như Stable Diffusion, Kandinsky và Flux, thường được sử dụng cùng với một loạt các công cụ hỗ trợ để điều chỉnh đầu ra thô của chúng để đáp ứng các nhu cầu sáng tạo cụ thể. Khi một đạo diễn nói, “Điều đó trông tuyệt vời, nhưng chúng ta có thể làm cho nó trở nên [n] hơn một chút không?” bạn không thể trả lời bằng cách nói rằng mô hình không chính xác đủ để xử lý các yêu cầu như vậy.

Thay vào đó, một đội ngũ hiệu ứng hình ảnh AI sẽ sử dụng một loạt các kỹ thuật CGI truyền thống và kỹ thuật thành phần, cùng với các quy trình và quy trình làm việc tùy chỉnh được phát triển theo thời gian, để cố gắng đẩy giới hạn tổng hợp video một chút进一步.

Vì vậy, theo cách tương tự, một mô hình nền tảng video rất giống với một cài đặt mặc định của một trình duyệt web như Chrome; nó làm được rất nhiều việc ngoài hộp, nhưng nếu bạn muốn nó thích nghi với nhu cầu của mình, chứ không phải ngược lại, bạn sẽ cần một số tiện ích mở rộng.

Control Freaks

Trong thế giới tổng hợp hình ảnh dựa trên khuếch tán, hệ thống thứ ba quan trọng nhất là ControlNet.

ControlNet là một kỹ thuật để thêm kiểm soát cấu trúc vào các mô hình tạo sinh dựa trên khuếch tán, cho phép người dùng hướng dẫn tạo hình ảnh hoặc video với các đầu vào bổ sung như bản đồ cạnh, bản đồ độ sâu hoặc thông tin tư thế.

hình ảnh (hàng trên), phân đoạn ngữ nghĩa > hình ảnh (phải dưới) và tạo hình ảnh được hướng dẫn bởi tư thế của con người và động vật (phải dưới).” width=”779″ height=”422″ /> Các phương pháp khác nhau của ControlNet cho phép độ sâu > hình ảnh (hàng trên), phân đoạn ngữ nghĩa > hình ảnh (phải dưới) và tạo hình ảnh được hướng dẫn bởi tư thế của con người và động vật (phải dưới).

Thay vì chỉ dựa vào các lời nhắc văn bản, ControlNet giới thiệu các nhánh mạng nơ-ron riêng biệt, hoặc adapters, xử lý các tín hiệu điều kiện này trong khi vẫn giữ nguyên khả năng tạo sinh của mô hình cơ bản.

Điều này cho phép đầu ra được tinh chỉnh để tuân thủ chặt chẽ hơn các thông số kỹ thuật của người dùng, khiến nó đặc biệt hữu ích trong các ứng dụng mà yêu cầu kiểm soát thành phần, cấu trúc hoặc chuyển động chính xác:

Với tư thế hướng dẫn, nhiều loại đầu ra chính xác có thể được thu được thông qua ControlNet. Nguồn: https://arxiv.org/pdf/2302.05543

Tuy nhiên, các khuôn khổ dựa trên adapter như thế này hoạt động bên ngoài một tập hợp các quá trình mạng nơ-ron rất tập trung vào nội bộ. Các phương pháp này có một số nhược điểm.

Trước hết, các adapter được đào tạo độc lập, dẫn đến conflict giữa các nhánh khi kết hợp nhiều adapter, điều này có thể dẫn đến chất lượng tạo sinh bị suy giảm.

Thứ hai, chúng giới thiệu sự dư thừa của tham số, đòi hỏi tính toán và bộ nhớ bổ sung cho mỗi adapter, khiến việc mở rộng trở nên không hiệu quả.

Thứ ba, mặc dù chúng linh hoạt, các adapter thường tạo ra kết quả không tối ưu so với các mô hình được tinh chỉnh hoàn toàn cho tạo sinh đa điều kiện. Những vấn đề này khiến các phương pháp dựa trên adapter trở nên kém hiệu quả hơn cho các nhiệm vụ đòi hỏi tích hợp mịn màng của nhiều tín hiệu điều khiển.

Ideally, các khả năng của ControlNet sẽ được đào tạo natively vào mô hình, theo một cách mô-đun có thể thích nghi với các đổi mới sau này và được mong đợi rõ ràng như tạo sinh video/audio đồng thời, hoặc khả năng đồng bộ hóa âm thanh tự nhiên (cho âm thanh ngoài).

Như nó đứng, mỗi mảnh chức năng bổ sung đại diện cho một nhiệm vụ hậu sản xuất hoặc một thủ tục không bản địa phải điều hướng các trọng số nhạy cảm và gắn kết chặt chẽ của bất kỳ mô hình nền tảng nào nó đang hoạt động trên.

FullDiT

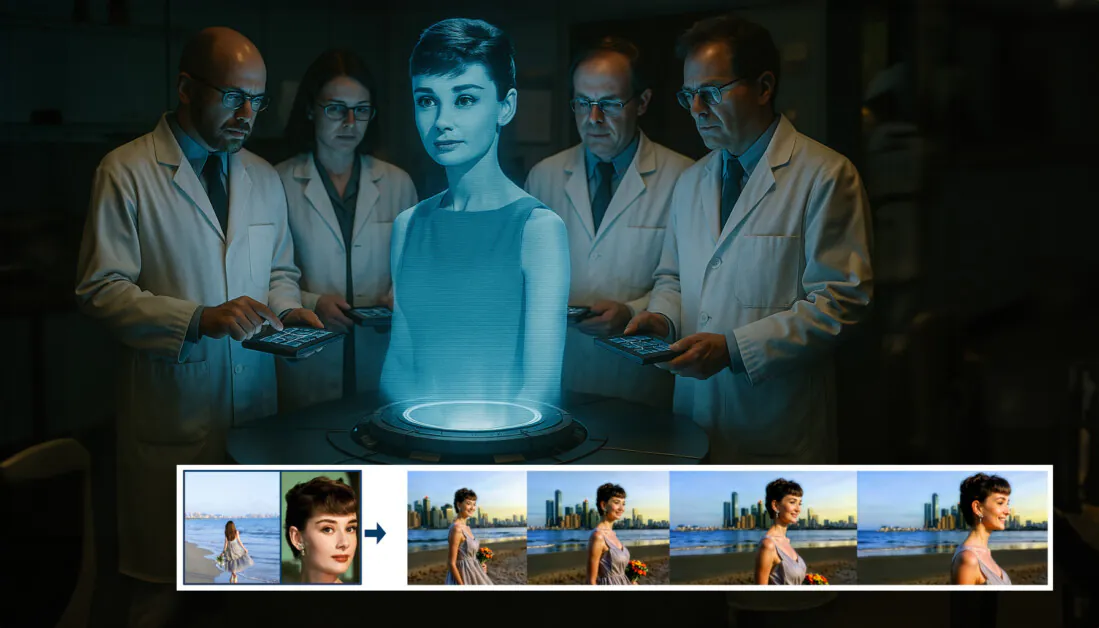

Vào tình huống này, một đề xuất mới từ Trung Quốc xuất hiện, đưa ra một hệ thống trong đó các biện pháp kiểu ControlNet được nướng trực tiếp vào một mô hình tạo sinh video tại thời điểm đào tạo, thay vì được coi là một ý tưởng sau.

Từ bài báo mới: cách tiếp cận FullDiT có thể kết hợp việc áp đặt danh tính, độ sâu và chuyển động máy ảnh vào một tạo sinh bản địa, và có thể triệu tập bất kỳ sự kết hợp nào trong số chúng cùng một lúc. Nguồn: https://arxiv.org/pdf/2503.19907

Được đặt tên là FullDiT, cách tiếp cận mới này kết hợp các điều kiện đa nhiệm như chuyển giao danh tính, lập bản đồ độ sâu và chuyển động máy ảnh vào một phần tích hợp của một mô hình tạo sinh video được đào tạo, cho mà các tác giả đã tạo ra một mô hình được đào tạo và các đoạn video đi kèm tại một trang web dự án.

Trong ví dụ dưới đây, chúng ta thấy các tạo sinh kết hợp chuyển động máy ảnh, thông tin danh tính và thông tin văn bản (tức là các lời nhắc văn bản hướng dẫn của người dùng):

Click để phát. Ví dụ về việc áp đặt kiểm soát kiểu ControlNet với chỉ một mô hình nền tảng được đào tạo bản địa. Nguồn: https://fulldit.github.io/

Nó nên được lưu ý rằng các tác giả không đề xuất mô hình được đào tạo thử nghiệm của họ như một mô hình nền tảng chức năng, mà như một khái niệm chứng minh cho các mô hình video đến văn bản (T2V) và hình ảnh đến video (I2V) bản địa cung cấp cho người dùng nhiều kiểm soát hơn chỉ là một lời nhắc hình ảnh hoặc một lời nhắc văn bản.

Kể từ khi không có mô hình nào tương tự như thế này, các nhà nghiên cứu đã tạo ra một điểm chuẩn mới có tên FullBench, để đánh giá các video đa nhiệm, và tuyên bố đạt được hiệu suất hàng đầu trong các thử nghiệm tương tự mà họ đã tạo ra.

Tuy nhiên, vì FullBench được thiết kế bởi chính các tác giả, tính khách quan của nó vẫn chưa được kiểm tra, và tập dữ liệu 1.400 trường hợp của nó có thể quá hạn chế cho các kết luận rộng hơn.

Có lẽ khía cạnh thú vị nhất của kiến trúc mà bài báo đưa ra là tiềm năng của nó để kết hợp các loại kiểm soát mới. Các tác giả tuyên bố:

‘Trong công việc này, chúng tôi chỉ khám phá các điều kiện kiểm soát của máy ảnh, danh tính và thông tin độ sâu. Chúng tôi không điều tra thêm các điều kiện và phương thức khác như âm thanh, lời nói, đám mây điểm, hộp giới hạn đối tượng, dòng chảy quang học, v.v. Mặc dù thiết kế của FullDiT có thể tích hợp liền mạch các phương thức khác với sự thay đổi kiến trúc tối thiểu, nhưng làm thế nào để nhanh chóng và hiệu quả thích nghi các mô hình hiện có với các điều kiện và phương thức mới vẫn là một câu hỏi quan trọng cần được khám phá thêm.’

Phương pháp

Các tác giả cho rằng cơ chế chú ý thống nhất của FullDiT cho phép học tập đại diện chéo mô-đun mạnh mẽ hơn bằng cách nắm bắt cả mối quan hệ không gian và thời gian trên các điều kiện:

Theo bài báo mới, FullDiT tích hợp các điều kiện đầu vào nhiều thông qua chú ý tự đầy đủ, chuyển đổi chúng thành một chuỗi thống nhất. Ngược lại, các mô hình dựa trên adapter (trái nhất) sử dụng các mô-đun riêng biệt cho mỗi đầu vào, dẫn đến sự dư thừa, xung đột và hiệu suất yếu hơn.

Không giống như các thiết lập dựa trên adapter xử lý mỗi luồng đầu vào riêng biệt, cấu trúc chú ý chung này tránh xung đột giữa các nhánh và giảm tải tham số. Họ cũng tuyên bố rằng kiến trúc có thể mở rộng đến các loại đầu vào mới mà không cần thay đổi thiết kế lớn – và rằng sơ đồ mô hình cho thấy dấu hiệu của việc tổng quát hóa đến các kết hợp điều kiện không được nhìn thấy trong quá trình đào tạo, chẳng hạn như liên kết chuyển động máy ảnh với danh tính nhân vật.

Click để phát. Ví dụ về tạo sinh danh tính từ trang web dự án.

Trong kiến trúc của FullDiT, tất cả các tín hiệu điều kiện đầu vào – như văn bản, chuyển động máy ảnh, danh tính và độ sâu – đều được chuyển đổi trước vào định dạng token thống nhất. Các token này sau đó được kết hợp thành một chuỗi dài duy nhất, được xử lý thông qua một chồng các lớp transformer bằng cách sử dụng chú ý tự đầy đủ. Cách tiếp cận này tuân theo các công việc trước đó như Open-Sora Plan và Movie Gen.

Sức mạnh của Ba

FullDiT chuyển đổi mỗi tín hiệu kiểm soát thành một định dạng token chuẩn hóa để tất cả các điều kiện có thể được xử lý cùng nhau trong một khuôn khổ chú ý thống nhất. Đối với chuyển động máy ảnh, mô hình mã hóa một chuỗi các tham số bên ngoài – như vị trí và định hướng – cho mỗi khung hình. Các tham số này được gắn thẻ thời gian và chiếu vào các vector nhúng phản ánh bản chất thời gian của tín hiệu.

Thông tin danh tính được xử lý khác nhau, vì nó vốn là không gian hơn là thời gian. Mô hình sử dụng các bản đồ danh tính chỉ ra những nhân vật nào có mặt trong những phần nào của mỗi khung hình. Những bản đồ này được chia thành miếng, với mỗi miếng được chiếu vào một nhúng để nắm bắt các gợi ý về danh tính không gian, cho phép mô hình liên kết các vùng cụ thể của khung hình với các thực thể cụ thể.

Độ sâu là một tín hiệu không gian và thời gian, và mô hình xử lý nó bằng cách chia video độ sâu thành các miếng 3D bao phủ cả không gian và thời gian. Những miếng này sau đó được nhúng theo cách bảo tồn cấu trúc của chúng trên các khung hình.

Khi đã được nhúng, tất cả những token điều kiện này (máy ảnh, danh tính và độ sâu) được kết hợp vào một chuỗi dài duy nhất, cho phép FullDiT xử lý chúng cùng nhau bằng cách sử dụng chú ý tự đầy đủ. Sự đại diện chung này cho phép mô hình học tập các tương tác trên các mô-đun và trên thời gian mà không dựa vào các luồng xử lý riêng biệt.

Dữ liệu và Thử nghiệm

Cách tiếp cận đào tạo của FullDiT dựa trên các tập dữ liệu được chú thích chọn lọc cho từng loại điều kiện, thay vì yêu cầu tất cả các điều kiện phải có mặt đồng thời.

Đối với các điều kiện văn bản, sáng kiến này tuân theo cách tiếp cận chú thích cấu trúc được phác thảo trong dự án MiraData.

Quy trình thu thập và chú thích video từ dự án MiraData. Nguồn: https://arxiv.org/pdf/2407.06358

Đối với chuyển động máy ảnh, tập dữ liệu RealEstate10K là nguồn dữ liệu chính do các chú thích tham số máy ảnh chất lượng cao.

Tuy nhiên, các tác giả quan sát thấy rằng đào tạo chỉ trên các tập dữ liệu cảnh tĩnh như RealEstate10K có xu hướng giảm các chuyển động đối tượng và con người trong các video được tạo. Để chống lại điều này, họ đã thực hiện tinh chỉnh thêm bằng cách sử dụng các tập dữ liệu nội bộ bao gồm nhiều chuyển động máy ảnh động hơn.

Các chú thích danh tính được tạo bằng cách sử dụng đường ống được phát triển cho dự án ConceptMaster, cho phép lọc và trích xuất hiệu quả thông tin danh tính chi tiết.

Khung ConceptMaster được thiết kế để giải quyết các vấn đề tách danh tính trong khi vẫn giữ nguyên tính trung thực của khái niệm trong các video tùy chỉnh. Nguồn: https://arxiv.org/pdf/2501.04698

Các chú thích độ sâu được thu được từ tập dữ liệu Panda-70M bằng cách sử dụng Depth Anything.

Tối ưu hóa Thông qua Trình tự Dữ liệu

Các tác giả cũng thực hiện một lịch trình đào tạo tiến bộ, giới thiệu các điều kiện thách thức hơn sớm trong quá trình đào tạo để đảm bảo mô hình có được các biểu diễn mạnh mẽ trước khi thêm các nhiệm vụ đơn giản hơn.

Thứ tự đào tạo bắt đầu từ văn bản đến máy ảnh điều kiện, sau đó danh tính, và cuối cùng độ sâu, với các nhiệm vụ dễ dàng hơn thường được giới thiệu muộn hơn và với ít ví dụ hơn.

Một minh họa về trình tự đào tạo dữ liệu được các nhà nghiên cứu áp dụng, với màu đỏ chỉ ra khối lượng dữ liệu lớn hơn.

Sau giai đoạn đào tạo trước, một giai đoạn tinh chỉnh cuối cùng giúp cải thiện chất lượng hình ảnh và động lực của mô hình. Sau đó, đào tạo theo đuổi cách tiếp cận của một khuôn khổ khuếch tán tiêu chuẩn*: nhiễu được thêm vào các yếu tố video, và mô hình học cách dự đoán và loại bỏ nó, sử dụng các token điều kiện nhúng làm hướng dẫn.

Để đánh giá hiệu quả FullDiT và cung cấp một so sánh công bằng với các phương pháp hiện có, và trong sự vắng mặt của bất kỳ điểm chuẩn phù hợp nào khác, các tác giả giới thiệu FullBench, một bộ thử nghiệm được quản lý bao gồm 1.400 trường hợp thử nghiệm riêng biệt.

Một thể hiện trình khám phá dữ liệu cho điểm chuẩn mới FullBench. Nguồn: https://huggingface.co/datasets/KwaiVGI/FullBench

Mỗi điểm dữ liệu cung cấp chú thích thực sự cho các tín hiệu điều kiện khác nhau, bao gồm chuyển động máy ảnh, danh tính và độ sâu.

Đo lường

Các tác giả đánh giá FullDiT bằng mười thước đo bao gồm năm khía cạnh chính của hiệu suất: căn chỉnh văn bản, kiểm soát máy ảnh, tương tự danh tính, độ chính xác độ sâu và chất lượng video chung.

Căn chỉnh văn bản được đo bằng tương đồng CLIP, trong khi kiểm soát máy ảnh được đánh giá thông qua sai số quay (RotErr), sai số dịch (TransErr) và tính nhất quán chuyển động máy ảnh (CamMC), theo cách tiếp cận của CamI2V (trong dự án CameraCtrl).

Tương tự danh tính được đánh giá bằng DINO-I và CLIP-I, và độ chính xác kiểm soát độ sâu được lượng hóa bằng Sai số tuyệt đối trung bình (MAE).

Chất lượng video được đánh giá bằng ba thước đo từ MiraData: tương đồng CLIP cấp khung cho sự mịn màng; khoảng cách chuyển động dựa trên dòng chảy quang học cho động lực; và điểm thẩm mỹ LAION cho thu hút thị giác.

Đào tạo

Các tác giả đào tạo FullDiT bằng một mô hình khuếch tán video nội bộ không được tiết lộ chứa khoảng một tỷ tham số. Họ chọn một kích thước tham số khiêm tốn để duy trì sự công bằng trong các so sánh với các phương pháp trước đó và đảm bảo khả năng tái tạo.

Vì các video đào tạo khác nhau về chiều dài và độ phân giải, các tác giả tiêu chuẩn hóa mỗi lô bằng cách thay đổi kích thước và làm đầy các video thành một độ phân giải chung, lấy mẫu 77 khung hình mỗi chuỗi, và sử dụng chú ý áp dụng và mặt nạ tổn thất để tối ưu hóa hiệu quả đào tạo.

Bộ tối ưu hóa Adam được sử dụng với tốc độ học 1×10−5 trên một cụm 64 GPU NVIDIA H800, với tổng cộng 5.120GB VRAM (xem xét rằng trong các cộng đồng tổng hợp đam mê, 24GB trên một RTX 3090 vẫn được coi là một tiêu chuẩn sang trọng).

Mô hình được đào tạo trong khoảng 32.000 bước, bao gồm tối đa ba danh tính mỗi video, cùng với 20 khung hình điều kiện máy ảnh và 21 khung hình điều kiện độ sâu, tất cả đều được lấy mẫu đều từ tổng 77 khung hình.

Đối với suy luận, mô hình tạo ra video ở độ phân giải 384×672 pixel (khoảng năm giây ở 15 khung hình mỗi giây) với 50 bước suy luận khuếch tán và thang hướng dẫn phân loại miễn phí là năm.

Các phương pháp trước

Để đánh giá máy ảnh đến video, các tác giả so sánh FullDiT với MotionCtrl, CameraCtrl và CamI2V, với tất cả các mô hình được đào tạo bằng cách sử dụng tập dữ liệu RealEstate10K để đảm bảo tính nhất quán và công bằng.

Trong tạo sinh có điều kiện danh tính, vì không có mô hình đa danh tính mở nào có sẵn, mô hình được so sánh với mô hình ConceptMaster 1B tham số, sử dụng cùng dữ liệu đào tạo và kiến trúc.

Đối với các nhiệm vụ độ sâu đến video, so sánh được thực hiện với Ctrl-Adapter và ControlVideo.

Kết quả định lượng cho tạo sinh video nhiệm vụ đơn. FullDiT được so sánh với MotionCtrl, CameraCtrl và CamI2V cho tạo sinh máy ảnh đến video; ConceptMaster (phiên bản 1B tham số) cho tạo sinh danh tính đến video; và Ctrl-Adapter và ControlVideo cho tạo sinh độ sâu đến video.

Kết quả cho thấy FullDiT, mặc dù xử lý nhiều tín hiệu điều kiện cùng một lúc, đạt được hiệu suất hàng đầu trong các thước đo liên quan đến văn bản, chuyển động máy ảnh, danh tính và kiểm soát độ sâu.

Trong các thước đo chất lượng chung, hệ thống thường vượt trội so với các phương pháp khác, mặc dù sự mịn màng của nó thấp hơn một chút so với ConceptMaster. Ở đây, các tác giả bình luận:

‘Sự mịn màng của FullDiT thấp hơn một chút so với ConceptMaster vì tính toán sự mịn màng dựa trên sự tương đồng CLIP giữa các khung hình liền kề. Vì FullDiT thể hiện động lực đáng kể hơn so với ConceptMaster, thước đo mịn màng bị ảnh hưởng bởi sự thay đổi lớn giữa các khung hình liền kề.

‘Đối với điểm thẩm mỹ, vì mô hình đánh giá ưa thích hình ảnh theo phong cách vẽ, ControlVideo đạt được điểm thẩm mỹ cao vì nó thường tạo ra video theo phong cách này.’

Về so sánh định tính, có thể tốt hơn nếu tham khảo các video mẫu tại trang web dự án FullDiT, vì các ví dụ PDF là tĩnh (và cũng quá lớn để tái tạo hoàn toàn ở đây).

Phần đầu tiên của kết quả định tính được tái tạo trong PDF.

Các tác giả bình luận:

‘FullDiT thể hiện sự bảo tồn danh tính vượt trội và tạo ra video với động lực và chất lượng hình ảnh tốt hơn so với [ConceptMaster]. Vì ConceptMaster và FullDiT được đào tạo trên cùng một kiến trúc, điều này nhấn mạnh hiệu quả của việc tiêm điều kiện với chú ý đầy đủ.

‘… Các kết quả khác cho thấy khả năng kiểm soát và chất lượng tạo sinh vượt trội của FullDiT so với các phương pháp hiện có về độ sâu đến video và máy ảnh đến video.’

Một phần của các ví dụ trong PDF về đầu ra của FullDiT với nhiều tín hiệu.

Kết luận

Mặc dù FullDiT là một nỗ lực thú vị hướng tới một loại mô hình nền tảng video tính năng đầy đủ hơn, người ta có thể tự hỏi liệu nhu cầu về các tiện ích kiểu ControlNet có đủ để biện minh cho việc thực hiện các tính năng như vậy trên quy mô lớn, ít nhất là đối với các dự án FOSS, những dự án này sẽ gặp khó khăn trong việc có được lượng lớn sức mạnh xử lý GPU cần thiết mà không có sự hỗ trợ thương mại.

Thử thách chính là sử dụng các hệ thống như Độ sâu và Tư thế thường đòi hỏi sự quen thuộc không tầm thường với các giao diện người dùng phức tạp như ComfyUI. Do đó, dường như một mô hình FOSS chức năng của loại này có nhiều khả năng được phát triển bởi một nhóm các công ty VFX nhỏ hơn thiếu nguồn lực (hoặc ý chí, cho rằng các hệ thống như vậy thường bị làm cho lỗi thời bởi các bản cập nhật mô hình) để tạo và đào tạo một mô hình như vậy đằng sau cánh cửa đóng.

Mặt khác, các hệ thống ‘thuê AI’ dựa trên API có thể được thúc đẩy để phát triển các phương pháp giải thích đơn giản và thân thiện với người dùng hơn cho các mô hình đã được đào tạo trực tiếp với các hệ thống kiểm soát bổ sung.

Click để phát. Kiểm soát độ sâu + văn bản được áp đặt trên tạo sinh video bằng FullDiT.

* Các tác giả không chỉ định bất kỳ mô hình cơ bản nào (ví dụ: SDXL, v.v.)

Được xuất bản lần đầu vào thứ Năm, ngày 27 tháng 3 năm 2025