Góc nhìn Anderson

Phát trực tuyến Trí tuệ nhân tạo Avatars như năm 1999

Nghiên cứu mới trình bày một cách để phát trực tuyến các avatar 3D giống như thật xuất hiện gần như ngay lập tức và sắc nét theo thời gian thực, thay vì buộc người dùng phải chờ đợi các tải xuống lớn để hoàn thành.

Trong nhiều cách, nhu cầu tài nguyên khổng lồ của trí tuệ nhân tạo và hệ thống kết xuất hỗ trợ trí tuệ nhân tạo đã đưa sự sẵn sàng của người tiêu dùng trở lại二十 hoặc nhiều năm trước. Chỉ trong năm 2023, phân bổ 64GB RAM trong máy tính xách tay hoặc máy tính để bàn dường như là quá mức; bây giờ, với sự phổ biến ngày càng tăng của RAM và / hoặc xử lý CPU ngoài, 64GB khá khiêm tốn cho nhu cầu trí tuệ nhân tạo địa phương; và những yếu tố từng bình thường và phải chăng này của PC tiếp tục tăng giá khi các tập đoàn đấu tranh để đáp ứng nhu cầu về dịch vụ trí tuệ nhân tạo.

Quy mô và tham lam của trí tuệ nhân tạo và các quy trình và môi trường của nó thường vượt quá phần cứng cấp người tiêu dùng, và thậm chí chạy ‘phiên bản slim’ mô hình định hướng địa phương như phiên bản GGUF sẽ thường gây áp lực cho hệ thống trung bình.

Thậm chí các dịch vụ trí tuệ nhân tạo dựa trên văn bản như ChatGPT cũng chịu áp lực đáng kể cả ở mức khách hàng và máy chủ. Do đó, một khi trí tuệ nhân tạo được giao nhiệm vụ cung cấp trải nghiệm đa phương tiện trực tuyến theo thời gian thực, chúng ta có thể hợp lý mong đợi một số thỏa hiệp nghiêm trọng về độ trễ và / hoặc chất lượng – tương tự như những khó khăn ban đầu của internet với việc phát trực tuyến phương tiện, và các biểu tượng ‘đang tải’ hoạt hình ghét bỏ của RealPlayer và QuickTime.

Lần cuối cùng mà các vấn đề đa phương tiện và mạng tạo ra ma sát trong trải nghiệm người dùng, phần cứng cấp người tiêu dùng vẫn vẫn đang phát triển thông qua Luật Moore, trở nên tốt hơn gần như theo cấp số nhân mỗi năm, ngay cả khi các hệ điều hành, mạng và cơ sở hạ tầng hỗ trợ khác phát triển để đáp ứng nhu cầu; và trong mười năm qua, hơn hoặc ít hơn, khả năng của công nghệ người tiêu dùng đã vượt quá nhu cầu đa phương tiện (có thể thậm chí đến mức cần phải kích hoạt để duy trì doanh số).

Nhưng sự sung túc về khả năng địa phương có thể sắp kết thúc sớm, vì phần cứng địa phương trở nên thấp hơn và đắt hơn, và vì các dịch vụ dựa trên trí tuệ nhân tạo đòi hỏi nhiều tài nguyên hơn ở phía máy chủ và địa phương.

Lấy Đầu

Trở lại thời kỳ trước băng thông rộng, ngay trước khi video phát trực tuyến có thể sử dụng được, người dùng web đã quen với hình ảnh dần dần rõ ràng, vì hình ảnh JPEG tiến bộ cho phép người dùng có băng thông thấp có thể xem hình ảnh đang tải, đôi khi chậm một cách đau đớn, vì nhiều dữ liệu hình ảnh được tải xuống địa phương.

Bây giờ, dường như chúng ta có thể trải qua một trải nghiệm tương tự với các avatar Gaussian Splat được hỗ trợ bởi trí tuệ nhân tạo:

Nhấn để phát. Từ dự án ProgressiveAvatars mới, một so sánh về việc phát trực tuyến các avatar Gaussian. Nguồn

Trên đây, chúng ta thấy hai phiên bản của một avatar Gaussian Splat – một biểu diễn con người được kích hoạt một phần bởi một kỹ thuật kết xuất không phải trí tuệ nhân tạo có từ những năm 1990, và cũng bởi các phương pháp hiện đại hơn, chẳng hạn như mô hình parametric FLAME của con người, và các phương pháp đào tạo dựa trên trí tuệ nhân tạo:

Gaussian Splatting sử dụng một biểu diễn Gaussian của màu sắc và thông tin 3D thay cho một pixel hoặc voxel, và ánh xạ texture siêu thực này lên một loại lưới CGI truyền thống, được hỗ trợ bởi một ‘con người tham số’, một khuôn mặt CGI và / hoặc cơ thể, trong các hệ thống như FLAME và STAR. Nguồn

Ở bên trái trong video trên, chúng ta có thể thấy rằng một triển khai truyền thống của một avatar Gaussian splat trông khá khủng khiếp khi chúng ta chờ đợi dữ liệu tải. Ở bên phải, một triển khai mới từ Trung Quốc, được gọi là ProgressiveAvatars, có thể giải quyết một cách tinh tế hơn khi dữ liệu tải, trình bày một hình ảnh con người không gây khó chịu ngay từ đầu.

Các tác giả tuyên bố rằng phương pháp của họ là phương pháp đầu tiên thực sự ‘phát trực tuyến’ một avatar Gaussian, và chắc chắn là phương pháp đầu tiên làm như vậy theo cách tiến bộ, nơi hình ảnh được xây dựng một cách tinh tế, và các khu vực quan trọng nhất – chẳng hạn như mắt và môi – có thể được ưu tiên, để avatar có thể trở nên đối thoại ngay cả khi chỉ tải một phần:

Nhấn để phát. Từ trang web dự án ProgressiveAvatars, một minh họa về việc tải có nhận thức.

Trước đây, một cách tiếp cận ‘cấp độ chi tiết’ (LOD) đã được sử dụng trong các nỗ lực trước để giảm bớt ‘GSplat’ avatar, tương tự như tối ưu hóa trò chơi, nơi các phiên bản chi tiết hơn của một người được tải xuống tùy thuộc vào việc họ chiếm đủ viewport hoặc sự chú ý của người xem để xứng đáng với nỗ lực.

Tất nhiên, điều này đòi hỏi một lượng dư thừa đáng kể ‘avatar dự phòng’, và các tác giả mô tả cách tiếp cận của họ như một hệ thống hợp lý hơn. Bằng cách ngụ ý, một phương pháp như vậy cũng cho phép thực hiện các thay đổi đối với một hình ảnh GSplat (tức là, tùy chỉnh) mà không cần phải truyền các thay đổi đó qua một chuỗi các ‘họ hàng’ LOD khác nhau.

Một Lĩnh vực mới nổi

Nếu điều này có vẻ như là một vấn đề hẹp, thì phát trực tuyến video cũng vậy, vào những ngày khi việc nhận được các plugin sớm nhất hoạt động được giao cho người nerd gần nhất. Hơn nữa, tiềm năng cho các biểu diễn dựa trên trí tuệ nhân tạo phát trực tuyến vượt ra ngoài các avatar con người, mở rộng đến tạo thành phố, trò chơi, và các phiên bản 3D dựa trên * hầu như mọi lĩnh vực trực tuyến – chẳng hạn như Thử trên ảo, cho việc mua sắm quần áo:

Nhấn để phát. Từ một dự án năm 2024, một cái nhìn thô về tương lai của ‘thử trên’ trực tuyến. Các dự án khác nhằm thêm chuyển động và tương tác – các khía cạnh đòi hỏi để phát trực tuyến và quản lý. Nguồn

Giống như các cách tiếp cận dựa trên LOD đã được tận dụng cho đến nay chủ yếu bởi các trò chơi, nhiều cân nhắc khác mà trước đây chỉ là tỉnh của phát triển trò chơi có thể sẽ chuyển sang các biểu diễn dựa trên splat. Ví dụ, hầu hết các lần ra mắt GSplat sớm này mô tả một con người đơn nhai và nhai, hoặc có thể nói; nhưng nhiều tình huống sẽ cần có nhiều con người, cũng như các tính năng môi trường và âm thanh – một kịch bản mà các hệ thống ‘hỗ trợ’ hiệu suất cao sẽ xác định nơi dữ liệu phát trực tuyến cần được ưu tiên, để giữ người xem trong khoảnh khắc.

Bài báo mới có tiêu đề ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, và đến từ ba nhà nghiên cứu tại Đại học Khoa học và Công nghệ Trung Quốc ở Hefei.

Phương pháp

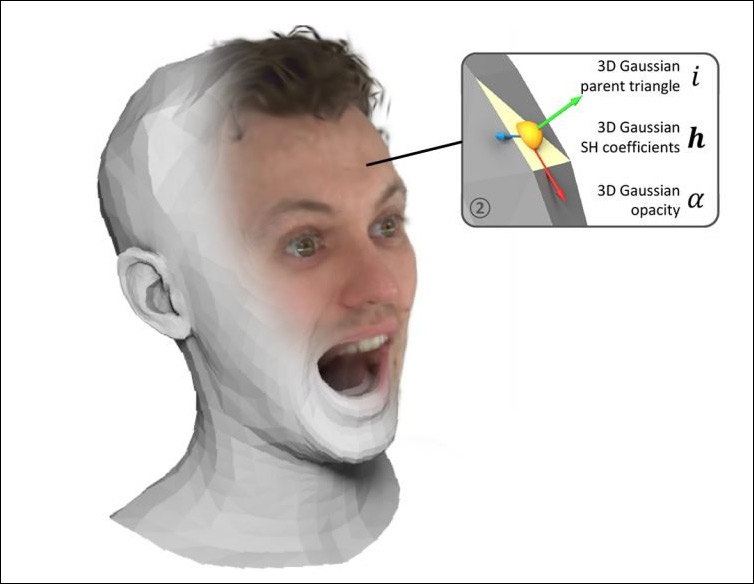

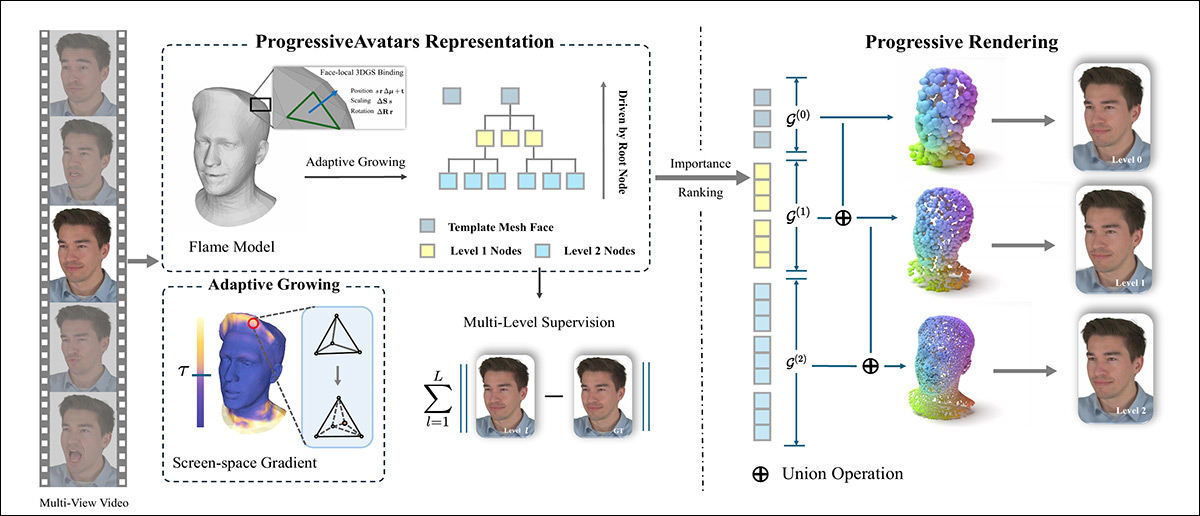

Cách tiếp cận ban đầu tận dụng video của đầu người. Đối với mỗi khung hình, một mô hình mặt parametric FLAME tiêu chuẩn được điều chỉnh phù hợp, để hình dạng và biểu cảm thay đổi theo thời gian, trong khi cấu trúc lưới cơ bản vẫn giữ nguyên. Bởi vì cấu trúc topology cơ bản không thay đổi, một mẫu FLAME ổn định có thể được tái sử dụng và tinh chỉnh thay vì xây dựng lại từ đầu tại mọi thời điểm, như xảy ra trong các công việc trước đây tương tự:

Video đầu được điều chỉnh phù hợp với lưới FLAME được theo dõi, sau đó 3D Gaussians được gắn vào mỗi mặt và phát triển phân cấp nơi các gradient không gian màn hình chỉ ra chi tiết bị thiếu. Trong quá trình đào tạo, việc phân chia này xây dựng một biểu diễn nhiều cấp dưới sự giám sát đa góc nhìn, và tại thời điểm suy luận, các điểm số quan trọng của mỗi mặt xác định các Gaussians được phát trực tuyến trước, cho phép avatar xuất hiện nhanh và tinh chỉnh tiến bộ khi các cấp độ chi tiết cao hơn được thêm vào.

Trên cấu trúc cơ bản này, chi tiết được thêm vào các lớp; bề mặt được chia nhỏ một cách隐式 thành một phân cấp, và các Gaussians 3D nhỏ được gắn vào các mặt tại mỗi cấp độ chi tiết.

Mặc dù các lớp thô hơn ban đầu bắt được hình dạng đầu và chuyển động tổng thể, các lớp tinh hơn sau đó cung cấp nếp nhăn, biến dạng tinh tế, và texture tần số cao. Các hình ảnh sau đó được kết xuất từ các Gaussians này bằng cách sử dụng một Gaussian rasterizer khác biệt và được đào tạo chống lại các hình ảnh thực tế đa góc nhìn, để avatar học cách tái tạo lại ngoại hình của người thật.

Trong quá trình đào tạo, phân cấp này phát triển tự động: các khu vực cần thêm chi tiết được chia nhỏ thêm, được hướng dẫn bởi các tín hiệu không gian màn hình, để nỗ lực tính toán tập trung vào nơi mắt người xem có nhiều khả năng nhận thấy lỗi nhất.

Trong quá trình suy luận, phân cấp này cho phép phát trực tuyến tiến bộ, trong đó một phiên bản thô của avatar có thể được hiển thị trước, và, khi các lớp thêm được tải, các Gaussians mới có thể được thêm vào mà không thay đổi những gì đã được hiển thị, cho phép một avatar đầu có thể hoạt hình xuất hiện nhanh và trở nên sắc nét và chi tiết hơn khi thêm dữ liệu đến.

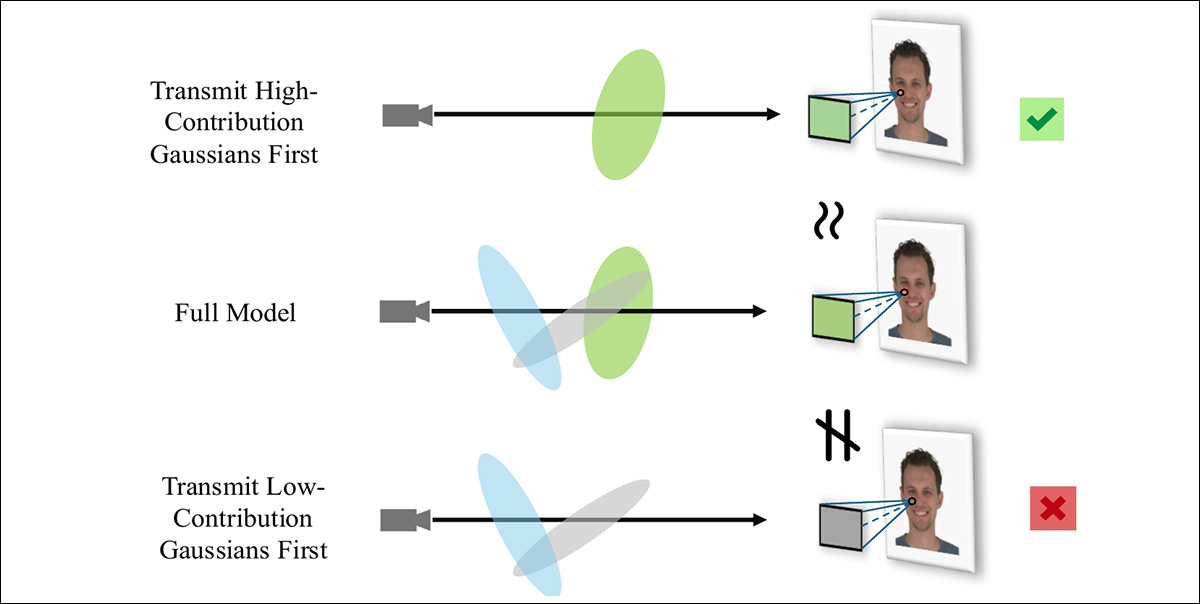

Các tác giả quan sát rằng toàn bộ hệ thống phụ thuộc vào việc ưu tiên dữ liệu đến:

Khi tất cả các Gaussians ở một cấp độ nhất định có sẵn, mô hình đầy đủ được kết xuất với độ trung thực tối đa; nhưng trong quá trình phát trực tuyến, việc gửi các Gaussians có đóng góp cao nhất trước cho phép kết quả một phần sớm khớp gần với hình ảnh cuối cùng, trong khi việc truyền các Gaussians có đóng góp thấp trước làm biến dạng cân bằng màu sắc và nhấn mạnh các thành phần nhỏ.

Dữ liệu và Kiểm tra

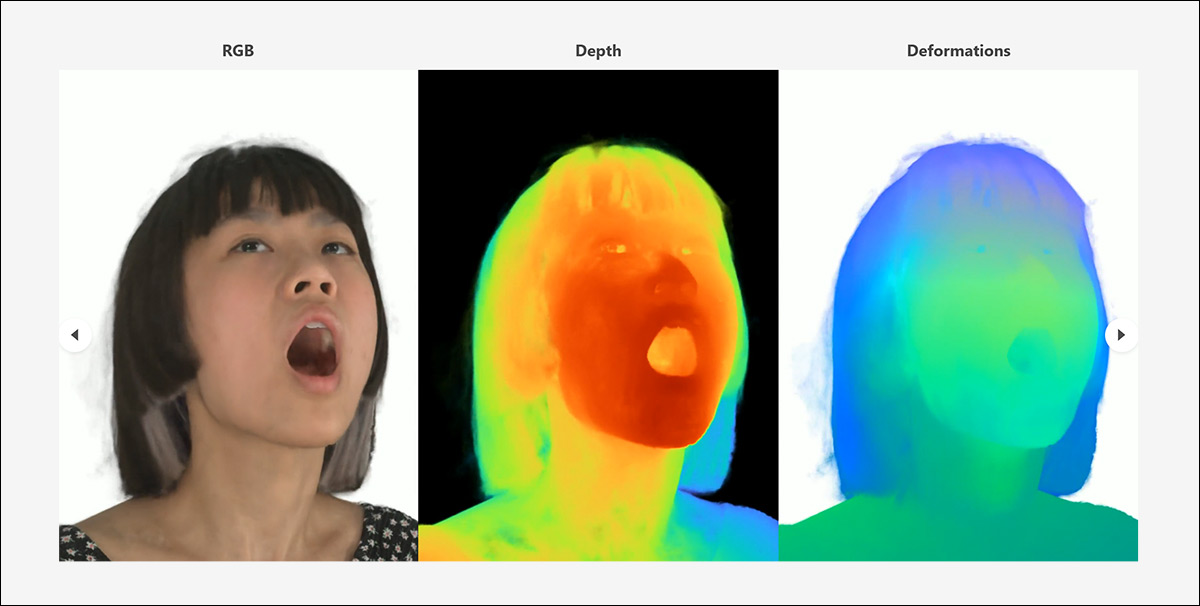

Để kiểm tra, phương pháp mới được đánh giá trên tập dữ liệu NeRSemble, bao gồm các video đa góc nhìn cho mỗi đối tượng được bao phủ, với các tham số được hiệu chỉnh trên tất cả các góc nhìn:

Ví dụ về các cách giải thích đa dạng của các đối tượng được bao gồm trong tập dữ liệu NeRSemble được sử dụng trong các kiểm tra cho ProgressiveAvatars. Nguồn

Theo cách tiếp cận GaussianAvatars ban đầu, các hình ảnh được giảm mẫu xuống 802x550px một mặt nạ nền được tạo, và việc chia đào tạo / kiểm tra ban đầu của dự án được áp dụng.

Bộ tối ưu hóa Adam được sử dụng để cập nhật tham số, với tốc độ học là 1×10-2 trên tất cả các tọa độ barycentric. Việc đào tạo chạy trong 60.000 lần lặp, với phân cấp được tự động mở rộng mọi 2.000 lần lặp.

Ban đầu, các tác giả đã kiểm tra khôi phục và hoạt hình – nhiệm vụ chuyển đổi video phẳng thành một hệ thống 3D nhận thức (x / y / x), sử dụng biểu diễn CGI tiêu chuẩn của FLAME làm lưới neo. Đối với điều này, tất cả các baseline được đào tạo từ đầu, và các khuôn khổ đối thủ được kiểm tra là GaussianAvatars đã nói và PointAvatar.

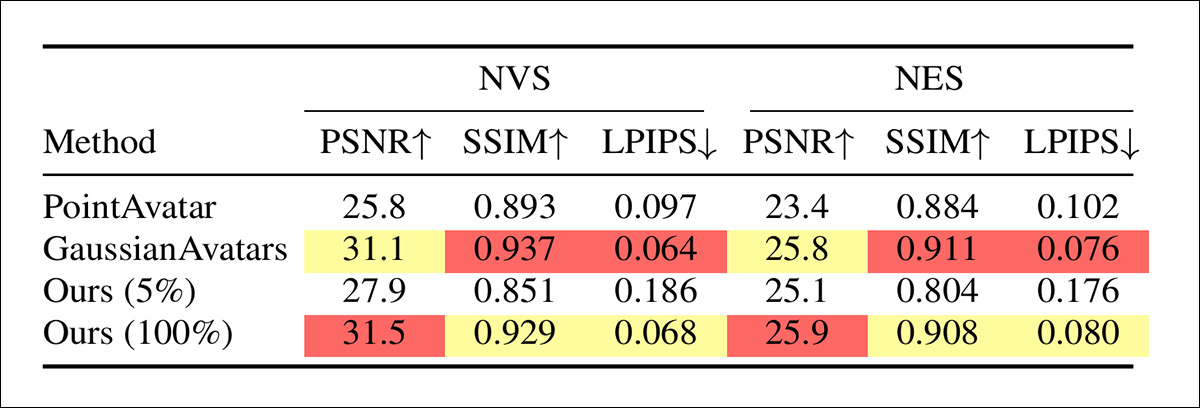

Đối với những kiểm tra này, các chỉ số được sử dụng là Tỷ lệ tín hiệu trên nhiễu đỉnh (PSNR), Chỉ số tương tự cấu trúc (SSIM), và Tương đồng hình ảnh bản vá học được (LPIPS):

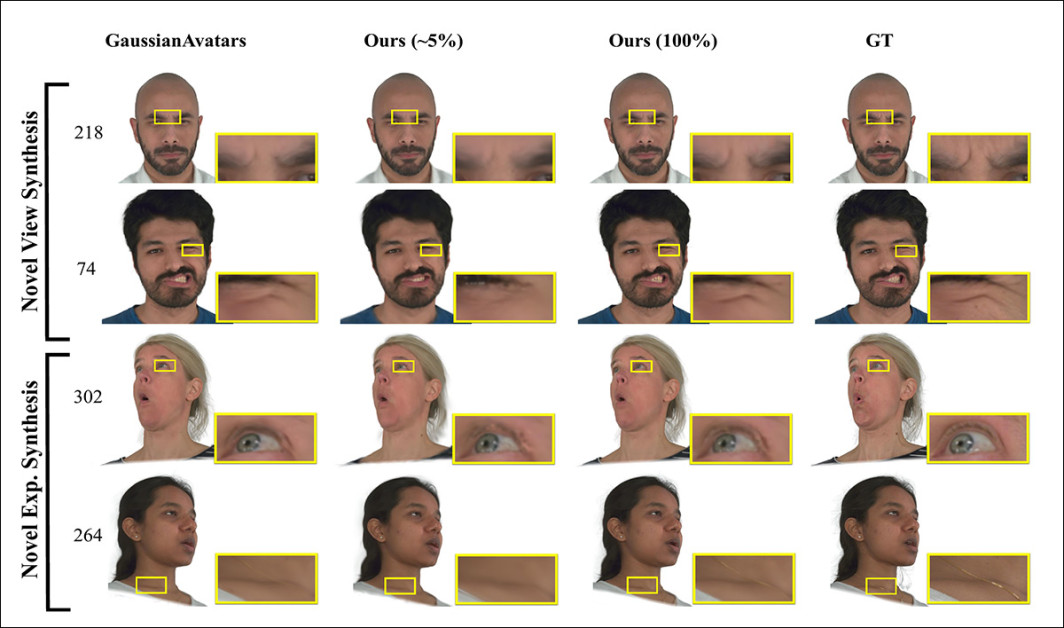

So sánh định tính về tổng hợp mới về góc nhìn và biểu cảm. Baseline GaussianAvatars gặp khó khăn với các chi tiết tinh tế xung quanh mắt, nếp nhăn và texture da, trong khi phương pháp được đề xuất đã bảo tồn cấu trúc khuôn mặt chính tại khoảng năm phần trăm dữ liệu được truyền và hội tụ đến chân thực khi nhiều Gaussians được phát trực tuyến, khớp gần với mô hình đầy đủ và hình ảnh tham chiếu (chân thực).

Về những kết quả này, các tác giả khẳng định:

‘Phương pháp của chúng tôi tái tạo các chi tiết sắc nét hơn trong một số khu vực, đặc biệt là xung quanh cổ, vai và quần áo. Những khu vực này tương đối thô trong mẫu FLAME so với các khu vực mặt có độ phân giải cao (ví dụ, khu vực xung quanh mắt).

‘Do đó, các phương pháp trước đây thường phân bổ quá ít 3D Gaussians cho những khu vực này để bắt được chi tiết tinh tế của chúng. Ngược lại, chiến lược phát triển thích ứng của chúng tôi tăng số lượng Gaussians và tinh chỉnh phân cấp chỉ khi cần, làm cho phân bổ không nhạy cảm với tessellation không đồng đều của FLAME.’

Các tác giả lưu ý thêm rằng cách tiếp cận của họ tương đương với các phương pháp hiện đại, mang lại một avatar có thể hoạt động với một lượng băng thông cho phép nhỏ:

So sánh định lượng về tổng hợp mới về góc nhìn và biểu cảm bằng PSNR, SSIM và LPIPS. Ở truyền đầy đủ, phương pháp được đề xuất đạt được PSNR cao nhất trong cả hai nhiệm vụ và vẫn cạnh tranh với GaussianAvatars về các chỉ số nhận thức, trong khi cài đặt 5% minh họa sự đánh đổi chất lượng dưới các hạn chế băng thông cực đoan.

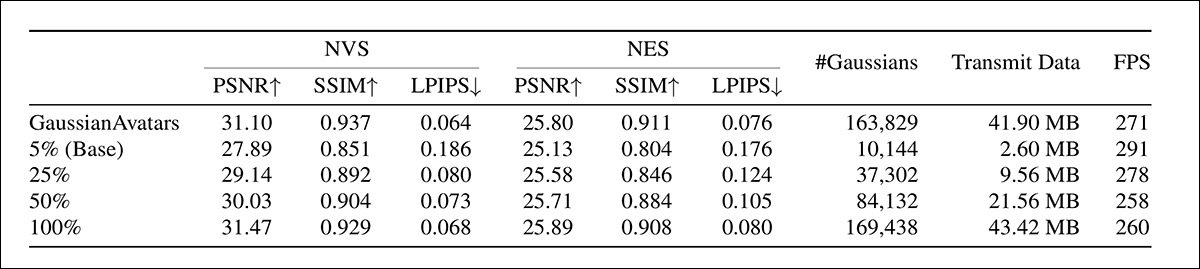

Tiếp theo, các nhà nghiên cứu đã kiểm tra việc kết xuất tiến bộ chính nó. Điều này được thực hiện trên một NVIDIA RTX 4090, với 24Gb VRAM, ở độ phân giải 550x802px. Trong kịch bản này, các tác giả chỉ ra rằng một ngân sách 25% sẽ sử dụng tất cả các Gaussians ‘cấp 1’, cũng như một tập hợp con của Gaussians cấp 2, điều này cho chúng ta một cái nhìn thô về cách các nhóm Gaussians tích lũy chi tiết trong các nhóm số cao hơn, và cách các nhóm số thấp hơn cơ bản xây dựng nền tảng:

Hiệu suất dưới các ngân sách truyền khác nhau cho tổng hợp mới về góc nhìn và biểu cảm, cho thấy chất lượng dần dần tiếp cận hoặc vượt qua GaussianAvatars khi nhiều Gaussians và dữ liệu được phát trực tuyến, trong khi tốc độ thời gian thực được duy trì, trên một RTX 4090.

Các tác giả bình luận:

‘Với chỉ 2,60 MB được truyền (5% ngân sách), avatar đã đạt được chất lượng hợp lý. Khi các Gaussians cấp cao hơn được phát trực tuyến, các cấu trúc tinh tế như nút áo, răng và tóc dần dần sắc nét trong khi độ ổn định thời gian được duy trì.

‘Ở 100% truyền, cách tiếp cận của chúng tôi đạt được chất lượng kết xuất tương đương với các phương pháp hiện đại. Đáng chú ý, tốc độ khung hình không giảm đáng kể, có lẽ vì khối lượng công việc 3DGS chưa bị bão hòa GPU.’

Tuy nhiên, các tác giả chỉ ra rằng trong các kịch bản VR đa người dùng, số lượng Gaussians 3D sẽ nhanh chóng tăng đến mức mà việc kết xuất GPU trở thành một nút thắt. Trong những kịch bản nặng hơn, cách tiếp cận được đề xuất cung cấp một lợi thế bằng cách cho phép hệ thống đánh đổi số lượng nguyên thủy với chất lượng hình ảnh, giảm tải mà không làm sụp đổ kết xuất.

Mặc dù bài báo không nêu chi tiết, trang web dự án có các so sánh kiểm tra bổ sung, cũng có MeGA Dự án avatar Gaussian lai:

Nhấn để phát. Một trong các video bổ sung từ trang web dự án đi kèm, so sánh cách tiếp cận mới về tổng hợp mới về góc nhìn.

Kết luận

Gaussian Splatting có thể hoặc không thể tồn tại, hoặc thậm chí được nhớ đến nhiều hơn RealPlayer bây giờ, liên quan đến sự xuất hiện của phát trực tuyến tương tác: các trải nghiệm đại diện 3D nhận thức được hỗ trợ bởi trí tuệ nhân tạo, bao gồm trò chuyện video, mua sắm ảo, điều hướng tuyến đường và các ứng dụng giải trí đa dạng. Có thể các công nghệ hoặc cách tiếp cận thay thế sẽ thắng, hoặc GSplat sẽ chứng minh là biểu diễn video trí tuệ nhân tạo đáng tin cậy nhất.

Nếu không có gì khác, bài báo mới thú vị này báo trước một chút về phạm vi của lĩnh vực mới này, trong khi nhắc chúng ta, có thể một cách hoài niệm, về internet nghèo băng thông của ngày xưa.

* Bằng ‘3D’, tôi không có nghĩa là loại trải nghiệm đòi hỏi kính đặc biệt, mà là trải nghiệm mà nội dung đa phương tiện có một số hiểu biết về tọa độ X / Y / Z.

Được xuất bản lần đầu vào thứ Tư, ngày 18 tháng 3 năm 2026