Góc nhìn Anderson

Ngay cả Trí tuệ nhân tạo Cơ bản cũng có thể viết Tin tức giống như Con người

Nghiên cứu mới cho thấy rằng ngay cả các mô hình trí tuệ nhân tạo địa phương nhỏ cũng có thể viết tin tức mà người đọc không thể phân biệt với báo chí thực sự, phù hợp với các hệ thống hàng đầu và khiến người đọc không thể xác định ai đã viết gì.

Theo một nghiên cứu hợp tác mới giữa Đức và Pháp, con người không thể phân biệt liệu một bài báo tin tức được viết bởi trí tuệ nhân tạo hay con người – ngay cả khi nó được viết bởi các mô hình mã nguồn mở có thể được tải xuống và chạy trên máy tính để bàn cấp tiêu dùng tương đối trung bình.

Trong một dấu hiệu khác cho thấy trí tuệ nhân tạo nhỏ đang lên, một cuộc khảo sát 2.318 phán quyết được thu thập từ 1.054 người tham gia trong một cổng nghiên cứu học thuật chuyên dụng cho thấy người đọc không thể xác định nguồn gốc của một bài viết ở mức cao hơn mức may mắn, ngay cả khi nó được tạo ra bởi các mô hình khiêm tốn với chỉ 7 tỷ tham số, bao gồm Mistral và Llama biến thể:

Điểm trung bình về nguồn và tính xác thực cho LLMs được thử nghiệm. 200 tỷ tham số của GPT-4o không vượt quá đáng kể 7B tham số của các mô hình nhỏ hơn. Những mô hình được thử nghiệm cho nghiên cứu bao gồm Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o và GPT-3.5. Nguồn

Các tác giả đang quay lại một chủ đề mà họ đã xem xét lần đầu tiên trong phát hành Blessing or curse? A survey on the Impact of Generative AI on Fake News năm 2024. Các phát hiện bản thân là kết quả mới được phát hành từ một dự án lớn hơn ban đầu được công bố vào tháng 1 và sử dụng khuôn khổ JudgeGPT trực tuyến tham gia của các tác giả.

Featherweight Power

Được đặt tên Can Humans Tell? A Dual-Axis Study of Human Perception of LLM-Generated News, và đến từ ba nhà nghiên cứu trên Đại học Khoa học Ứng dụng Frankfurt và đơn vị nghiên cứu IRISA tại Nantes, nghiên cứu mới này làm một sự phân biệt quan trọng giữa ‘tin tức giả’ và ‘tin tức được viết bởi AI’ (vì tin tức giả có thể được viết bởi con người hoặc bởi AI và hai khía cạnh này không nhất thiết phải đồng nghĩa):

Tuy nhiên, có lẽ khía cạnh thú vị nhất là kết luận của bài báo rằng các mô hình nhỏ bao gồm Mistral 7B và Gemma 7B có thể, với chỉ 7 tỷ tham số, đối đầu với aplomb chống lại những mô hình như ChatGPT (4o) với 200 tỷ tham số:

‘Mô hình mở trọng lượng với chỉ 7B tham số tạo ra văn bản được đánh giá không khác với đầu ra GPT-4o, cho thấy khả năng tạo văn bản không thể phân biệt với con người không còn bị giới hạn ở các mô hình tiền phong.’

Tuy nhiên, ‘tin tức được tạo bởi AI’ có thể đại diện cho nhiều loại khác nhau của sự hợp tác giữa con người và AI, từ kiểm tra chính tả đến chuyển giao toàn bộ, chấm dứt nỗ lực, và nghiên cứu không làm rõ chính xác loại nội dung AI nào được tạo ra cho các thử nghiệm (mặc dù nó phác thảo phương pháp luận để tạo ra nó – xem dưới đây).

Phương pháp

Đối với những người tham gia tham gia vào nền tảng JudgeGPT, mỗi mảnh tin được đánh giá bằng một khuôn khổ hai trục trong đó họ cung cấp ba xếp hạng độc lập trên các thanh trượt liên tục 0-100:

Giao diện người dùng JudgeGPT, nơi người đánh giá đánh giá tài liệu về thuộc tính nguồn; tính xác thực; và sự quen thuộc với chủ đề. Hãy tham khảo giấy nguồn để có độ phân giải tốt hơn.

Phán quyết nguồn bắt giữ liệu một đoạn văn có vẻ như được viết bởi máy hoặc con người; phán quyết tính xác thực, liệu nó được nhận thức là giả hoặc hợp pháp; và sự quen thuộc với chủ đề, người đọc biết chủ đề đến mức nào.

Các thang đo liên tục được sử dụng thay vì thang đo Likert, để bắt giữ các mức độ chắc chắn chính xác hơn và hỗ trợ phân tích thống kê, bao gồm hệ số tương quan Pearson và phân cụm.

Các đoạn văn bản được tạo bởi máy được tạo ra bởi khuôn khổ RogueGPT của các tác giả, kiến trúc cấp liệu cho JudgeGPT. RogueGPT điều phối các đóng góp từ sáu Mô hình Ngôn ngữ Lớn (LLMs): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; và Mistral 7B.

Được thúc đẩy bởi người dùng được sử dụng để tạo văn bản, và các thế hệ AI được dựa trên các chủ đề tin tức thực và được kiểm tra chính tả bởi con người.

Ngược lại, các đoạn văn được viết bởi con người được lấy mẫu từ ‘các kênh tin tức thành lập’ và ‘cơ sở dữ liệu thông tin’ không xác định.

Các tác giả quan sát:

‘Tập hợp kích thích được cố ý nghiêng về các đoạn văn gốc máy (∼98%), với các mục gốc của con người phục vụ như neo hiệu chuẩn.

‘Lựa chọn thiết kế này phản ánh sự tập trung của nghiên cứu vào biến thể trong AI (trên các mô hình) chứ không phải so sánh con người và AI; người tham gia không được thông báo về tỷ lệ cơ bản, và kết quả phát hiện gần như may mắn [kết quả] vẫn giữ khi được phân tích trên tập hợp con người gốc độc lập.’

Người tham gia đầu tiên đã đưa ra sự đồng ý thông báo và hoàn thành một bảng câu hỏi nhân khẩu học bao gồm tuổi, trình độ học vấn, định hướng chính trị và sự quen thuộc với AI, sau đó họ đánh giá chuỗi các đoạn tin.

Mỗi người đã xem xét từ 5-87 mục, với trung vị là 12, trong khi thứ tự trình bày được ngẫu hóa và phân bổ mô hình được cân bằng trên người tham gia, để giảm thiểu thiên vị. Nền tảng đã ghi lại ba xếp hạng thanh trượt cùng với thời gian phản hồi và một mã định danh ẩn danh, cho phép các phán quyết cá nhân được liên kết với các yếu tố nền.

Các tác giả chỉ ra rằng mẫu nghiên cứu nghiêng về những người tham gia có trình độ học vấn đại học, với 68% được đào tạo tại trường đại học và 74% có trụ sở tại châu Âu – một thiên vị mà bài báo lưu ý là một hạn chế đối với sự khái quát hóa rộng hơn.

Thử nghiệm

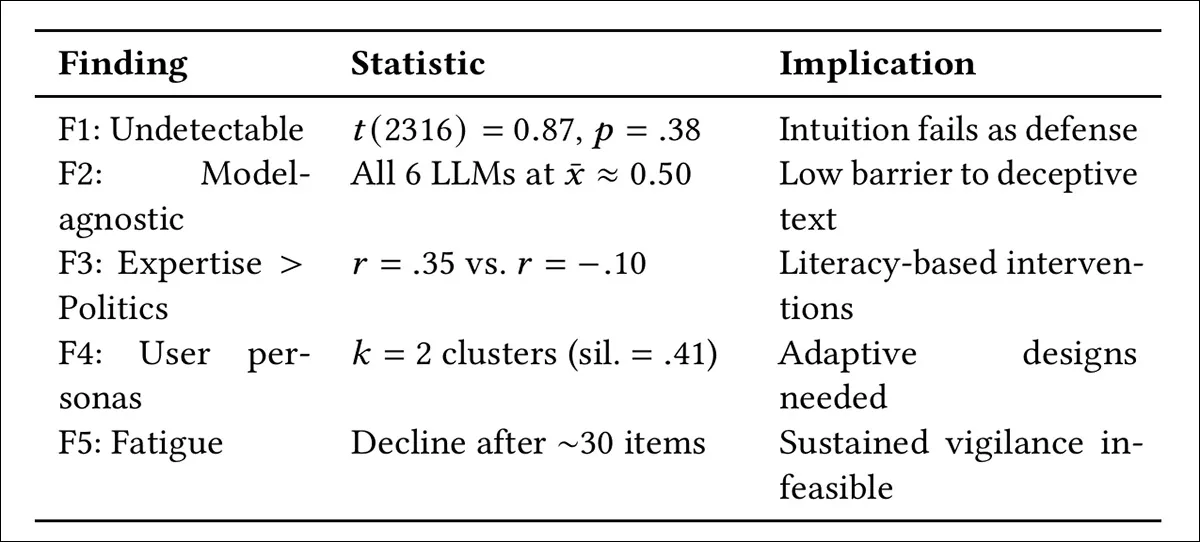

Các thử nghiệm được chia thành năm loại phát hiện: phân biệt văn bản được tạo bởi máy từ văn bản được viết bởi con người; so sánh phát hiện trên các LLM khác nhau; kiểm tra ảnh hưởng của chuyên môn lĩnh vực so với định hướng chính trị đến độ chính xác; xác định các chiến lược phản hồi khác nhau giữa người tham gia; và theo dõi cách độ chính xác thay đổi qua các đánh giá lặp đi lặp lại, do mệt mỏi:

Tóm tắt của năm phát hiện cốt lõi từ 2.318 phán quyết trên 1.054 người tham gia, cho thấy rằng phát hiện của con người về văn bản được viết bởi AI vẫn ở mức may mắn trên tất cả các mô hình, rằng độ chính xác được liên kết với chuyên môn lĩnh vực hơn là định hướng chính trị, rằng người tham gia phân cụm thành các hồ sơ tin cậy khác nhau và hiệu suất giảm sau khoảng 30 đánh giá, do mệt mỏi nhận thức.

Thử nghiệm cho thấy không có sự khác biệt đáng kể về điểm nguồn giữa các điều kiện, rõ ràng cho thấy người tham gia không thể phân biệt văn bản được tạo bởi AI từ đầu ra của con người:

Phân phối điểm nguồn và tính xác thực cho các đoạn văn gốc máy và gốc con người cho thấy sự chồng lấp đáng kể, không có sự tách biệt có ý nghĩa giữa hai điều kiện, và thử nghiệm thống kê – chỉ ra rằng người tham gia không thể phân biệt đáng tin cậy văn bản được tạo bởi AI từ nội dung được viết bởi con người.

Đối với khía cạnh thứ hai, như được hiển thị trong đồ thị ở đầu bài viết, sự thất bại trong việc phát hiện không thay đổi theo mô hình, vì đầu ra từ tất cả các LLMs phân cụm xung quanh các phán quyết ở mức may mắn, không có sự khác biệt đáng kể giữa chúng. Ngay cả các hệ thống mở trọng lượng nhỏ như Mistral 7B và Gemma 7B cũng được xếp hạng không khác với GPT-4o, cho thấy văn bản không thể phân biệt với con người có thể không còn bị giới hạn ở các mô hình lớn nhất.

Đối với khía cạnh thứ ba, độ chính xác được liên kết mạnh mẽ hơn với chuyên môn lĩnh vực hơn là định hướng chính trị, vì sự quen thuộc với tin tức giả tương quan với các phán quyết tốt hơn, trong khi quan điểm chính trị không cho thấy tác động có ý nghĩa, cho thấy rằng các kỹ năng phân tích được học có thể quan trọng hơn ý thức hệ:

Kết quả cho dòng điều tra thứ ba cho thấy rằng định hướng chính trị không có tác động có ý nghĩa đến thuộc tính nguồn hoặc điểm tính xác thực, với chỉ các xu hướng yếu, không đáng kể, trong khi sự quen thuộc tự báo cáo với tin tức giả được liên kết với độ chính xác cao hơn trên cả hai trục. Điều này cho thấy rằng kỹ năng phân tích dựa trên kinh nghiệm là dự đoán mạnh mẽ hơn về hiệu suất than vị trí ý thức hệ. Hãy tham khảo giấy nguồn để có độ phân giải tốt hơn.

Phát hiện thứ tư cho thấy người tham gia phân cụm thành hai phong cách phản hồi khác nhau được xác định là ‘Skeptics’ – những người phân bổ niềm tin thấp trên tất cả nội dung bất kể nguồn gốc – và ‘Believers’ – những người duy trì một mức độ tin cậy cao hơn.

Cuối cùng, liên quan đến mục tiêu thứ năm, một phân tích lăn của các phán quyết tuần tự cho thấy người tham gia ban đầu trở nên tốt hơn trong nhiệm vụ, với độ chính xác được cải thiện trong khoảng 15-20 đánh giá đầu tiên khi họ thích nghi với định dạng:

Độ trung bình lăn của điểm thuộc tính nguồn và tính xác thực trên chuỗi đánh giá của người tham gia cho thấy một giai đoạn cải thiện ban đầu, khi người dùng dường như thích nghi với nhiệm vụ trong 15–20 mục đầu tiên, tiếp theo là một sự suy giảm ổn định trong cả hai biện pháp sau khoảng 30 đánh giá. Hãy tham khảo giấy nguồn để có độ phân giải tốt hơn.

Tuy nhiên, hiệu ứng này là ngắn hạn, vì hiệu suất bắt đầu giảm sau khoảng 30 mục, với người tham gia ngày càng dán nhãn nội dung là giả – một sự thay đổi được giải thích là mệt mỏi nhận thức, và cho thấy rõ ràng giới hạn về việc các phương pháp dựa trên phát hiện có thể vẫn hiệu quả, trong thực tế.

Điều này có thể đại diện cho một số bằng chứng thực nghiệm rằng, kiệt sức bởi việc phân biệt tin tức giả từ thực, AI tin tức từ con người, chúng ta có thể có xu hướng mặc định để giả định tin tức là AI và / hoặc giả (không nhất thiết là cùng một điều), để được ‘an toàn’. Những người coi đây là ‘lười biếng’, và coi rằng mọi người nên tự làm nghiên cứu để xác minh một câu chuyện tin tức giả tiềm năng, có thể quan tâm đến việc tìm hiểu rằng một nghiên cứu năm 2024 cho thấy điều này chỉ làm cho vấn đề trở nên tồi tệ hơn.

Các tác giả đề xuất rằng sự thất bại của sự phán quyết của con người được thể hiện trong kết quả cho thấy chúng ta có thể cần phải chuyển các vấn đề như vậy sang các công nghệ chứng nhận nguồn gốc mật mã như C2PA initiative do Adobe dẫn đầu. Các giải pháp có thể khác được đề cập là khuôn khổ OriginLens của các tác giả và một dự án khác liên quan đến tác giả gọi là CRED-1.

Các tác giả kết luận:

‘Con người có thể phân biệt? Nghiên cứu hai trục của chúng tôi về 2.318 phán quyết trên sáu gia đình LLM cung cấp một câu trả lời thực nghiệm rõ ràng: họ không thể.

‘Văn bản được tạo bởi máy không thể phân biệt với văn bản được viết bởi con người bất kể kích thước mô hình hoặc gia đình, chuyên môn lĩnh vực dự đoán độ chính xác của phát hiện mạnh mẽ hơn định hướng chính trị, người tham gia áp dụng các chiến lược tin cậy khác nhau và mệt mỏi nhận thức hạn chế phát hiện bền vững.

‘Những phát hiện này hỗ trợ một sự thay đổi từ phát hiện cấp người dùng sang các biện pháp đối phó cấp hệ thống, bao gồm chứng nhận nguồn nội dung, chỉ số tin cậy thích ứng và các can thiệp tiêm chủng có giới hạn.’

Kết luận

Khía cạnh đáng lo ngại của bài báo này là mạng lưới hỗ trợ dự án và giấy tờ mà các tác giả – hoặc một số tác giả, tùy thuộc vào công việc – đã khởi xướng hoặc có tay trong; và chắc chắn sẽ rất thú vị nếu có thể nghiên cứu các mẫu văn bản được tạo bởi AI và con người tạo ra những kết quả này, để hiểu rõ hơn về loại đầu ra mà phương pháp luận tạo ra mô tả.

Tuy nhiên, điều thú vị là nghe rằng các mô hình mở trọng lượng, mã nguồn mở có thể so sánh với các gã khổng lồ API như loạt ChatGPT – liệu rằng nhiệm vụ tại tay không thực sự khó khăn, và một mô hình 200 tỷ tham số là quá mức cho các nhiệm vụ như vậy? Chúng tôi sẽ cần biết một chút về các mẫu nguồn AI và con người được gửi để trả lời câu hỏi đó.

Trong khi đó, theo trang web canirun.ai, Mistral 7B (đã hơn tương đương với ChatGPT -4o trong các thử nghiệm) ‘chạy tuyệt vời’ trên một NVIDIA RTX 3080 với 16GB VRAM, và chạy ‘decent’ trên một 3060 với 6GB VRAM – không phải là card đồ họa mới nhất hoặc mạnh nhất trong trò chơi*. Vì vậy, bất kỳ ai muốn tạo phương pháp luận mẫu gửi riêng của họ có thể tham gia vào các thí nghiệm này cũng vậy.

* Gemma 7B không được liệt kê tại trang web.

Được xuất bản lần đầu vào thứ Năm, ngày 9 tháng 4 năm 2026