Góc nhìn Anderson

Viết lách được tạo bởi AI ‘không bao giờ’ mệt mỏi, và do đó tiết lộ bản thân

Trí tuệ nhân tạo kiểu ChatGPT tiết lộ bản thân bằng cách tăng tính nhất quán, trong khi viết lách của con người vẫn còn bất thường trên toàn bộ nội dung.

Cửa sổ ngữ cảnh hạn chế của hầu hết các mô hình ngôn ngữ lớn (LLM) hướng đến người tiêu dùng là một trong những yếu tố có thể khiến chúng quên hoặc nhớ lại các phần trước của cuộc trò chuyện của người dùng không chính xác – những lỗi nhớ lại có thể dần dần biến đầu ra thành hoàn toàn vô nghĩa – hoặc, tồi tệ hơn, văn bản có vẻ hợp lý một cách lừa dối nhưng chứa các lỗi tinh vi.

Vì những tình huống này dẫn đến sự ảo giác, và vì ảo giác vẫn là chướng ngại vật lớn nhất đối với sự tiến bộ thị trường tổng thể của AI, rất nhiều nỗ lực nghiên cứu đã được đầu tư vào việc tạo ra các hệ thống trí tuệ nhân tạo có thể tạo ra các đoạn văn bản dài hơn nhưng nhất quán hơn.

Thực tế, tiến bộ đang được thực hiện đến mức việc nhận biết nội dung AI dài (tức là nội dung được tạo hoàn toàn bởi AI, với -假设 – sự chăm sóc của con người tối thiểu hoặc không có) được coi là một vấn đề ngày càng tăng.

Phá vỡ một cuộc filibuster của AI

Tuy nhiên, các nghiên cứu thực nghiệm gần đây cho rằng rằng càng nhiều đầu ra mà các máy tạo văn bản AI tạo ra trong một lần, thì càng dễ dàng xác định liệu văn bản đó có được viết bởi con người hay không; nhưng sự khôn ngoan được chấp nhận liên quan đến ‘neo’ này đã giả định rằng AI có thể được phân biệt vì bất cứ điều gì nó làm khác với con người , nó có cơ hội làm thường xuyên hơn trong các đoạn văn dài .

Không có giả định nào được thực hiện về phân phối của những ‘tells’ này trong văn bản chính nó.

Để thách thức điều này và mở rộng vấn đề, một nghiên cứu thú vị gần đây từ Trung Quốc cung cấp một phương pháp mới để phân biệt các nhà tạo nội dung AI dài với các tác giả con người thực sự. Các nhà nghiên cứu đứng sau công việc này cho rằng token -upon-token theo đó văn bản AI được tạo ra có nghĩa là nó trở nên nhất quán hơn với chiều dài lớn hơn , trong khi những đặc điểm riêng của con người không giảm đi với chiều dài.

Bằng cách này, các tác giả đề xuất rằng sự hiểu biết của họ cung cấp một số liệu đo mới cho các hệ thống phát hiện văn bản AI *:

‘Các token được tạo bởi AI trong phần sau của văn bản thể hiện sự biến động nhỏ hơn và ổn định hơn trong các dao động xác suất khi các dự đoán của mô hình trở nên nhất quán hơn khi ngữ cảnh tích lũy.

‘Chúng tôi gọi mẫu này là Hiện tượng suy giảm biến động giai đoạn cuối. Hiện tượng này phản ánh hành vi vốn có của việc tạo ra tự hồi quy: khi ngữ cảnh trở nên có sẵn hơn, phân phối dự đoán của mô hình trở nên sắc nét hơn, dẫn đến giảm biến động trong thống kê cấp token.

‘Ngược lại, viết lách của con người tiếp tục giới thiệu các lựa chọn từ vựng không mong muốn và duy trì biến động cao hơn trên toàn bộ nội dung.’

Để nắm bắt được sự ‘mịn màng’ kỳ lạ này tích lũy trong văn bản AI về phía cuối, các nhà nghiên cứu định nghĩa hai tính năng đơn giản: tính năng đầu tiên đo lường mức độ hành vi thống kê của văn bản ‘nhảy’ giữa các token; tính năng thứ hai kiểm tra mức độ ổn định của mọi thứ trên các đoạn văn ngắn .

Cả hai đều được tính toán chỉ từ nửa sau của đầu ra, nơi AI trở nên đều đặn hơn và viết lách của con người không. Các tác giả lưu ý rằng trong khi những tín hiệu này hoạt động tốt riêng lẻ, chúng thậm chí còn hiệu quả hơn khi kết hợp với các phương pháp phát hiện cũ hơn quét các mẫu rộng hơn. Họ cũng lưu ý rằng phương pháp này hoạt động tốt nhất trên các văn bản dài hơn, nơi sự tương phản có thể trở nên rõ ràng hơn.

Bài báo mới cung cấp một phương pháp để kiểm tra ‘tính AI’ thông qua phân tích tính năng thời gian của nửa sau, không yêu cầu đào tạo hoặc tinh chỉnh thêm, hoặc truy cập mô hình đặc quyền.

Công việc mới này có tiêu đề Khi AI ổn định: Sự ổn định giai đoạn cuối là một chữ ký của phát hiện văn bản được tạo bởi AI , và đến từ bốn tác giả tại Đại học Westlake ở Hàng Châu.

Phương pháp

Để nắm bắt sự mịn màng ngày càng tăng trong văn bản AI được tạo, các nhà nghiên cứu đã thiết kế hai phép đo tập trung chỉ vào nửa sau của một đoạn văn. Những phép đo này dựa trên điểm số xác suất log từ một mô hình ngôn ngữ tiêu chuẩn và không yêu cầu tinh chỉnh, đào tạo lại, hoặc mẫu thêm:

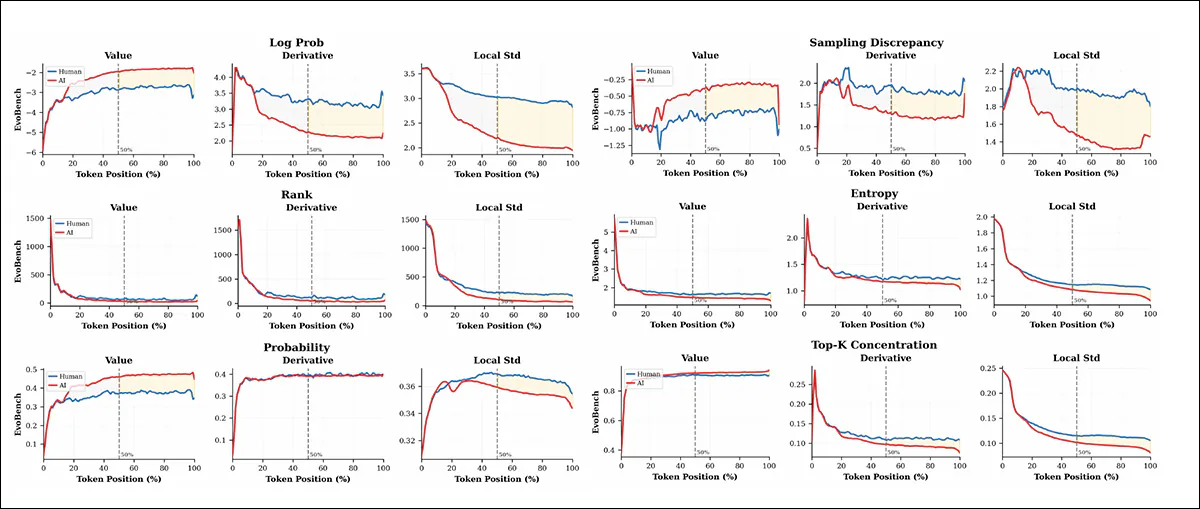

Từ bài báo mới – mỗi hàng hiển thị hành vi của một chỉ số cơ sở từ EvoBench trên chuỗi token: giá trị thô (trái), đạo hàm tuyệt đối (giữa), và độ lệch chuẩn địa phương (phải). Các dòng của con người và AI được hiển thị bằng màu xanh lam và đỏ. Sự phân kỳ nhất xuất hiện ở nửa sau của văn bản, đặc biệt là đối với Log Probability và Sampling Discrepancy, cho thấy sự tách biệt ngày càng tăng và đầu ra AI mịn màng hơn. Entropy và Top-K Concentration cho thấy ít thay đổi theo thời gian. Nguồn

Phép đo đầu tiên, được gọi là Sự phân tán đạo hàm (DD), theo dõi mức độ thay đổi sắc nét của sự tự tin của mô hình từ một từ này sang từ khác. Văn bản AI có xu hướng ổn định vào một nhịp điệu, vì vậy những thay đổi này trở nên nhỏ hơn và có thể dự đoán được ở nửa sau. Ngược lại, viết lách của con người vẫn còn ‘không đều’.

Phép đo thứ hai, Biến động cục bộ (LV), xem xét mức độ ‘nhảy’ của sự tự tin của mô hình ‘nhảy’ trong một cửa sổ văn bản nhỏ. Một lần nữa, AI có xu hướng trở nên ổn định hơn theo thời gian, trong khi các lựa chọn của con người vẫn còn bất ngờ và không nhất quán:

Văn bản AI trở nên mịn màng hơn khi nó tiến triển, trong khi viết lách của con người vẫn còn không đều. Những đồ thị này theo dõi sự thay đổi của sự tự tin của mô hình trên toàn bộ đoạn văn, phản ánh cả sự sắc nét của sự thay đổi giữa các từ liên tiếp và mức độ biến động trong các đoạn văn ngắn. Trong cả hai khía cạnh, sự suy giảm là rõ ràng hơn trong đầu ra được tạo bởi máy, với sự tương phản trở nên rõ ràng hơn sau điểm giữa. Các hộp màu vàng突出 sự khác biệt ngày càng tăng trong nửa sau, nơi viết lách của AI đạt đến 32% ổn định hơn so với viết lách của con người.

Một lần nữa, cả hai phép đo đều được tính toán chỉ từ nửa sau của văn bản, nơi sự khác biệt giữa viết lách của con người và máy trở nên rõ ràng nhất. Những tín hiệu này sau đó được kết hợp vào một giá trị duy nhất gọi là Điểm phát hiện ổn định thời gian (TSD) – giá trị này có xu hướng tăng khi viết lách trở nên ‘mịn màng’ hơn (và do đó có khả năng được tạo bởi AI). Một ngưỡng đơn giản sau đó được sử dụng để quyết định liệu một đoạn văn nhất định có được viết bởi máy hay không.

Vì những tính năng này tập trung vào khi một mẫu xuất hiện, chứ không chỉ là mẫu đó trông như thế nào, chúng được bổ sung bởi các phương pháp cũ hơn tìm kiếm các bất thường thống kê trên toàn bộ đoạn văn. Thêm điểm TSD vào đầu ra của Fast-DetectGPT (cũng trong sự hợp tác với Westlake) cung cấp một sự cải thiện bổ sung trong kết quả (đặc biệt là đối với nội dung dài nơi hiệu ứng làm mịn giai đoạn cuối mạnh nhất).

Dữ liệu và Kiểm tra

Các tác giả đã thực hiện các kiểm tra trên hai tập dữ liệu chuẩn liên quan: EvoBench chứa 32.000 cặp văn bản con người / AI được tạo ra trên bảy họ mô hình, bao gồm GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; và Qwen, với tổng cộng 29 phiên bản mô hình được giới thiệu.

Khung công việc khác là MAGE, cung cấp 30.000 cặp kiểm tra trên tám họ mô hình, bao gồm (nhưng không giới hạn ở) loạt GPT từ OpenAI, và các họ LLaMA, OPT, và FLAN-T5.

Đề thủ

Phương pháp mới được kiểm tra chống lại một loạt các bộ phát hiện không có shot sử dụng cùng một mô hình thay thế. Xác suất , Entropy , Hạng , và Log-Rank (DetectGPT) đo lường thống kê cấp token trên toàn bộ đoạn văn; LLR (DetectLLM) áp dụng chuẩn hóa để cho phép so sánh trực tiếp giữa các mô hình; và Fast-Detect ước tính độ cong cục bộ thông qua các nhiễu loạn dựa trên lấy mẫu.

Lastde phân tích các chuỗi con phân biệt trong tín hiệu xác suất, trong khi FourierGPT hoạt động trong miền tần số. Diveye nắm bắt sự thay đổi trong ‘bất ngờ’ đa dạng trên toàn bộ chuỗi.

Cuối cùng, UCE đánh giá hồ sơ không chắc chắn của dự đoán token, để xác định các mẫu tự tin không tự nhiên.

Triển khai và Kết quả

Tất cả các phương pháp phát hiện đều được chạy bằng Llama-3-8B-Instruct làm mô hình thay thế chung, với các chuỗi đầu vào bị giới hạn ở 512 token. Các tính năng thời gian được trích xuất chỉ từ nửa sau của mỗi đoạn văn, bằng cách sử dụng một cửa sổ trượt 20 token để đo lường biến động. Một phiên bản kết hợp của phương pháp, được gọi là TSD+ , kết hợp tín hiệu được đề xuất với Fast-DetectGPT.

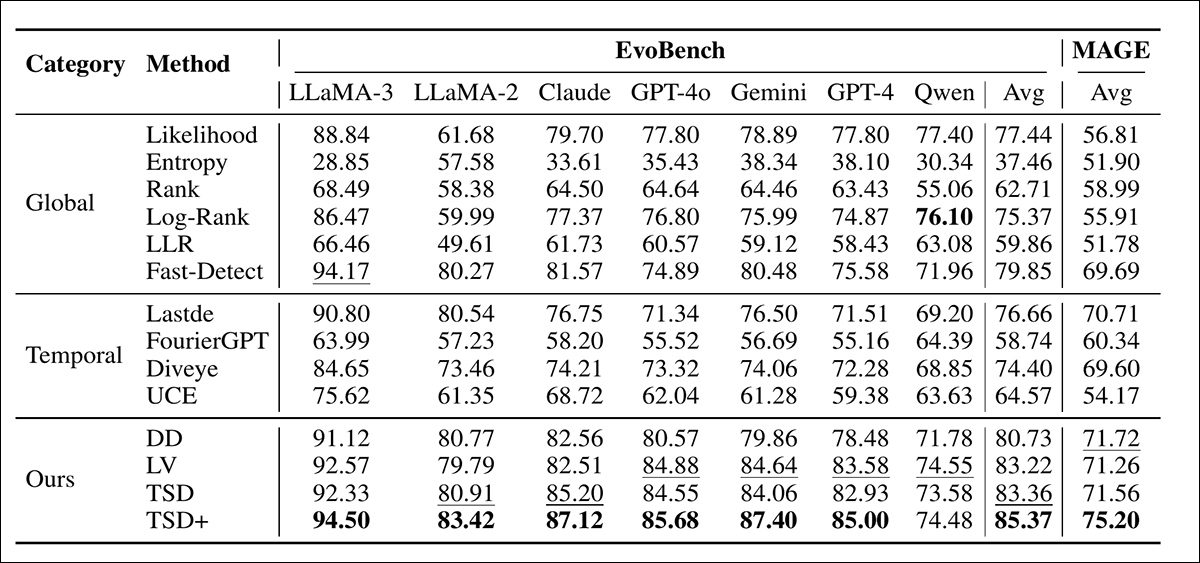

Diện tích dưới đường cong ROC (AUROC) là chỉ số đánh giá chính †:

Hiệu suất đa dạng giữa các phương pháp kiểm tra khác nhau đối với văn bản được tạo bởi AI. Độ chính xác của phát hiện được hiển thị trên hai tập dữ liệu: EvoBench, bao gồm nhiều mô hình LLM nổi bật, và MAGE, một tập dữ liệu bổ sung. Các chỉ số được nhóm theo loại phương pháp: thống kê toàn cầu, tính năng thời gian và các biến thể được đề xuất. Các điểm AUROC trung bình được đưa ra trong các cột cuối cùng. Kết quả từ các biến thể phương pháp của tác giả liên tục vượt trội so với các baseline trước đó, với TSD+ mang lại điểm số cao nhất trong hầu hết mọi cài đặt mô hình.

Trong số những kết quả ban đầu này, các tác giả tuyên bố:

‘Các tính năng thời gian đơn giản của chúng tôi đạt được hiệu suất tốt nhất trong số các phương pháp độc lập, với TSD đạt 83,36% trên EvoBench và 71,56% trên MAGE, vượt trội so với tất cả các baseline, bao gồm cả Fast-DetectGPT.

‘Điều này đáng chú ý, xét đến sự đơn giản của phương pháp chúng tôi: chúng tôi chỉ tính toán thống kê thứ hai từ nửa sau của các chuỗi, mà không cần lấy mẫu nhiễu loạn hoặc biến đổi miền tần số.’

Phương pháp mới này hoạt động đặc biệt tốt trên các mô hình AI mới hơn như GPT-4 và GPT-4o, xác định văn bản được viết bởi AI một cách chính xác hơn so với bộ phát hiện hàng đầu gần nhất, với khoảng cách hiệu suất lên đến 9,66%. Mặc dù các mô hình tiên tiến mới tạo ra văn bản ít nhất quán hơn, điều này che giấu một số dấu hiệu của tự động hóa, nhưng vẫn có thể nhận thấy một số mẫu thời gian tinh vi gần cuối.

Các phương pháp cạnh tranh tập trung vào các tính năng cấu trúc rộng lớn không thành công trong việc nắm bắt những mẫu giai đoạn cuối này. Bằng cách tích hợp một bộ phát hiện toàn cầu, hệ thống lai dường như thu hồi những tín hiệu bị bỏ lỡ, và cải thiện hiệu suất, đặc biệt là trên các tập dữ liệu mà đầu ra AI ngắn hơn có thể làm yếu đi các tín hiệu thời gian.

Kết luận

Một khía cạnh không được giải quyết trực tiếp trong công việc mới là xu hướng của các nhà văn để lặp lại công việc của họ thông qua việc soạn thảo và các lớp giám sát khác nhau – đôi khi bao gồm cả giám sát bên ngoài, chẳng hạn như đầu vào của các biên tập viên và người kiểm tra, cũng như các thay đổi được đề xuất có thể có từ các bộ phận pháp lý, tùy thuộc vào ngữ cảnh.

Sự tham gia của nhiều bên liên quan trong các tài liệu đơn giản như một bài báo trên báo có thể xóa bỏ các đặc điểm riêng biệt mà hệ thống mới được đề xuất đang dựa vào, và về cơ bản là một phiên bản ‘tương tự’ của một quá trình soạn thảo được hỗ trợ bởi AI.

Một sự xem xét khác là nội dung văn bản mà nhiều người đã đóng góp cũng có thể là những đoạn văn rời rạc, không hoàn hảo và lặp đi lặp lại nhất trong một tập dữ liệu, vì chúng thường không có lợi thế của một giọng nói thống nhất cuối cùng, để lại tính chất rời rạc của sự phát triển của chúng rõ ràng trong văn bản.

* Authors’ văn bản được tạo kiểu từ bài báo; không phải là sự nhấn mạnh của tôi.

† Các tác giả tuyên bố ‘chính’, trong khi liệt kê không có chỉ số đánh giá khác.

Được xuất bản lần đầu vào thứ hai, ngày 26 tháng 1 năm 2026