Góc nhìn Anderson

Đưa Hình Ảnh Tạo Bởi Trí Tuệ Nhân Tạo Vào Ánh Sáng Với HDR

Hình ảnh và video do trí tuệ nhân tạo tạo ra có thể ấn tượng, nhưng chúng không đạt tiêu chuẩn ‘chuyên nghiệp’ – một vấn đề mà một dự án nghiên cứu mới đang cố gắng giải quyết.

Trong cộng đồng audio-visual chuyên nghiệp, một trong những phản đối thường xuyên nhất đối với sự xâm nhập của trí tuệ nhân tạo là thiếu tiêu chuẩn chuyên nghiệp về tái tạo hình ảnh và video. Không kém phần quan trọng là khả năng làm việc với hình ảnh và video High Dynamic Range (HDR).

Hình ảnh HDR là tương đương hiện đại của một thực hành nhiếp ảnh thế kỷ 19/20 gọi là bracketing, nơi cùng một bức tranh được chụp nhiều lần với số lượng ánh sáng tăng dần được phép tiếp xúc với phim:

Trên, một chuỗi bracketed ngắn. Chèn dưới, phạm vi động cao có thể được ngoại suy từ những bức ảnh này vào một hình ảnh duy nhất. Nguồn

Trong nhiếp ảnh truyền thống, điều này dẫn đến nhiều bức tranh có thể, với một số chuyên môn và nỗ lực, được tạo thành một bản in duy nhất có lợi từ tất cả các mức độ chi tiết khác nhau có sẵn trên phạm vi của các lần tiếp xúc. Nhưng đó không phải là một quá trình đơn giản hoặc dễ dàng.

Những ngày này, một ‘chuỗi hình ảnh tự động bracketed’ có thể tạo ra nhiều hình ảnh hoặc được kết hợp thành một hình ảnh HDR duy nhất – hiệu quả là một đa dạng các lần tiếp xúc trong một hình ảnh, mà các ứng dụng chỉnh sửa hình ảnh hỗ trợ HDR như Photoshop có thể lặp lại và cho phép nhiếp ảnh gia dàn xếp thành một hình ảnh đầu ra lý tưởng.

Nếu bạn đang thắc mắc tại sao bạn nên quan tâm, hoặc cách điều này ảnh hưởng đến nhiếp ảnh của riêng bạn, hình minh họa cho bài viết này nhằm mục đích minh họa điều này theo một cách quen thuộc:

Trên, bên trái chúng ta thấy một ví dụ điển hình của một hình ảnh sRGB (tức là không phải HDR). Chỉ cần làm sáng (được hiển thị ở bên phải) nó không cho thấy con quái vật trong tủ, vì chi tiết đó đã bị loại bỏ khi nhiếp ảnh gia và các quá trình tự động của máy ảnh quyết định những gì nên được ưu tiên trong bức tranh:

Dưới đây là một dấu hiệu (bên trái) của cách ‘washed out’ tiền cảnh sẽ phải ở thời điểm tiếp xúc để đăng ký con quái vật trong tủ trong một bức ảnh không phải HDR, và (bên phải) cách con quái vật bị nhấn chìm trong bóng tối khi độ phơi sáng được thực hiện phù hợp cho tiền cảnh sáng sủa:

Dưới đây, chúng ta thấy loại chi tiết có thể được ‘cứu’ từ một hình ảnh HDR hoặc chuỗi hình ảnh. Trong trường hợp này, con quái vật đang ‘ẩn náu’ trong các thanh ghi hình ảnh thấp nhất của chuỗi HDR, ở mức mà phần nội dung còn lại sẽ bị ‘blown out’ thành gần trắng (trên, bên trái). Bằng cách chỉ định rằng một phạm vi rộng của các mức độ sáng nên được biểu thị, có chọn lọc, trong cùng một hình ảnh, những yếu tố không hòa hợp này có thể được tạo thành một bức tranh hợp lý:

Một hình ảnh không phải HDR được gọi là hình ảnh được tham chiếu hiển thị, và một hình ảnh HDR có gamut cao được gọi là hình ảnh được tham chiếu cảnh.

Video HDR cũng là một điều, và loại tính linh hoạt và dẻo dai về âm sắc này thực sự mang lại cho các nhà làm phim một số độ tự do để cứu, phân loại và diễn giải cảnh quay theo nhiều cách sáng tạo và nhất quán; không ngạc nhiên, thì, rằng các nhà sáng tạo không muốn làm việc với đầu ra sRGB ‘phẳng’ điển hình của hầu hết các khung khổ tạo ra bởi trí tuệ nhân tạo.

HDR trong Trí Tuệ Nhân Tạo

Tự nhiên, cảnh nghiên cứu quan tâm đến việc đưa các khung khổ tạo ra bởi trí tuệ nhân tạo vào kỷ nguyên HDR. Tuy nhiên, điều này không phải là một nhiệm vụ đơn giản, cả vì kiến trúc cơ bản của các hệ thống tạo ra dựa trên khuếch tán, và vì dữ liệu HDR tốt đòi hỏi một lượng lớn không gian đĩa, khiến cho các bộ sưu tập trở nên cồng kềnh; do đó, các bộ dữ liệu phù hợp cho nhiệm vụ này là khan hiếm.

Mặc dù vậy, một sự hợp tác giữa một trường đại học tại Singapore và Adobe Research đang cung cấp một phương pháp để tạo ra các chuỗi hình ảnh HDR, trong một phương pháp có thể được áp dụng cho cả video và hình ảnh tĩnh:

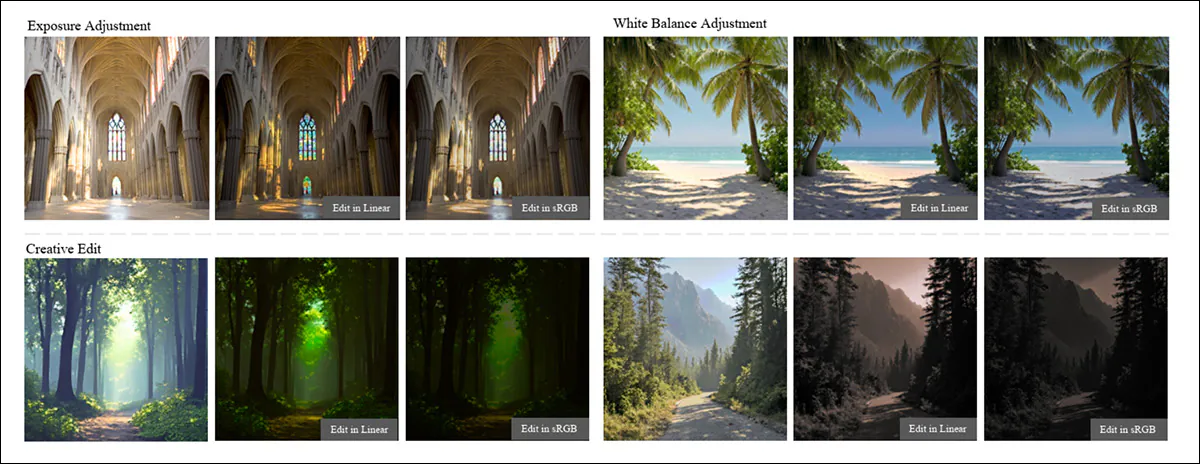

Từ trang web dự án cho công việc mới, các ví dụ về ‘bracketed’ văn bản-sang-hình ảnh. Nguồn

Hệ thống mới tạo ra nhiều phiên bản được căn chỉnh của cùng một hình ảnh ở các mức độ sáng khác nhau và học cách sáng như thế nào cảnh thực sự là, sau đó kết hợp những điều này vào một kết quả duy nhất mà giữ chi tiết trong cả bóng tối và vùng sáng, cho phép các chỉnh sửa sau về độ phơi sáng hoặc màu sắc để hành xử giống như các điều chỉnh đối với một bức tranh được chụp bởi máy ảnh thực, chứ không phải các điều chỉnh dễ vỡ đối với một hình ảnh đã được xử lý hoàn toàn.

Hệ thống tận dụng sự đa dạng của các mô hình khác nhau cho nhiệm vụ, bao gồm các biến thể của Qwen và Flux:

Các ví dụ từ bài báo mới, cho thấy hệ thống có thể tạo ra nhiều phiên bản tiếp xúc của cùng một cảnh trong khi giữ cấu trúc cơ bản cố định. Nguồn

Các tác giả tuyên bố:

‘Tạo ra hình ảnh tuyến tính là một thách thức, vì các VAE được đào tạo trước trong các mô hình khuếch tán khó khăn để bảo tồn đồng thời các vùng sáng và bóng tối cực đoan do phạm vi động cao hơn và độ sâu bit.

‘Để giải quyết vấn đề này, chúng tôi đại diện cho một hình ảnh tuyến tính như một chuỗi các khung hình tiếp xúc, mỗi khung hình bắt một phần cụ thể của phạm vi động, và đề xuất một kiến trúc dòng chảy phù hợp dựa trên DiT cho việc tạo khung hình tiếp xúc có điều kiện văn bản.

‘Chúng tôi cũng chứng minh các ứng dụng hạ nguồn bao gồm chỉnh sửa hình ảnh tuyến tính được hướng dẫn bởi văn bản và tạo ra có điều kiện cấu trúc thông qua ControlNet.’

Công việc mới có tiêu đề Linear Image Generation by Synthesizing Exposure Brackets, và đến từ bốn tác giả trên S-Lab tại Nanyang Technological University, Adobe NextCam, và Adobe Research. Ngoài trang web dự án và video YouTube đi kèm với bản phát hành, cũng có một trang GitHub (hiện đang trống), và lời hứa về một bộ dữ liệu sẽ được phát hành.

Mặc dù các tác giả cung cấp nhiều ví dụ về đầu ra từ hệ thống tại trang web dự án, người xem sẽ cần một màn hình hỗ trợ HDR để thực sự phân biệt các đặc điểm của đầu ra HDR được trình bày. Tuy nhiên, vui lòng tìm video tổng quan của nhà nghiên cứu trên YouTube được nhúng ở cuối bài viết này – nhưng hãy lưu ý rằng sự khác biệt giữa các ví dụ được hiển thị có thể không rõ ràng trên một màn hình không phải HDR.

Phương Pháp và Dữ Liệu

Các tác giả nhấn mạnh mức độ mà việc thu thập dữ liệu là một thách thức trong việc theo đuổi này:

‘Việc thu được một số lượng lớn hình ảnh tuyến tính là cực kỳ khó khăn trong thực tế. Hơn nữa, hầu hết các bộ dữ liệu HDR công khai đều là toàn cảnh (vì vậy tập trung gần như độc quyền vào nội dung cảnh lớn) hoặc không cung cấp hình ảnh tuyến tính thực sự, khiến chúng không phù hợp với mục đích của chúng tôi.

‘Do đó, chúng tôi chủ yếu sử dụng các bộ dữ liệu hình ảnh RAW làm cơ sở cho đào tạo.’

Các nhà nghiên cứu đã sử dụng sáng tạo các tùy chọn hạn chế, tận dụng bộ dữ liệu RAISE làm dữ liệu đào tạo thực sự, và bộ dữ liệu MIT-Adobe FiveK làm dữ liệu đánh giá*.

Để xây dựng dữ liệu đào tạo HDR có thể sử dụng, các nhà nghiên cứu đã chạy các tệp camera RAW thông qua một đường ống tiêu chuẩn hóa để loại bỏ các đặc điểm cụ thể của máy ảnh, chuyển đổi các hình ảnh thành một định dạng tuyến tính nhất quán:

Schema cho luồng làm việc của tác giả: hệ thống bắt đầu từ tiếng ồn đại diện cho bốn mức độ tiếp xúc của cùng một cảnh, cùng với một lời nhắc văn bản và một mã thông báo độ sáng. Điều này sau đó được xử lý thông qua các khối biến đổi xếp chồng mà giữ các tiếp xúc khác nhau được căn chỉnh trong khi điều chỉnh cho ánh sáng.

Điều này bao gồm việc xây dựng lại RGB đầy đủ từ dữ liệu cảm biến, áp dụng hiệu chỉnh màu, chuẩn hóa cân bằng trắng, và di chuyển ngắn gọn vào một không gian màu cảm nhận để làm mịn trước khi quay lại một tín hiệu tuyến tính sạch. Ánh sáng thực trong cảnh sau đó được phục hồi bằng cách sử dụng cài đặt độ phơi sáng của máy ảnh, để mỗi pixel sẽ phản ánh độ sáng thực chứ không phải một xấp xỉ sẵn sàng hiển thị.

Vì những giá trị này có thể thay đổi rộng rãi, dữ liệu sau đó được ổn định bằng cách缩 mỗi hình ảnh dựa trên phân bố độ sáng của riêng nó, sử dụng thống kê trung bình và vùng sáng để tránh cả hình ảnh bị rửa trôi và vùng sáng bị cháy, cuối cùng nhận được một hình ảnh tuyến tính được chuẩn hóa mà bảo tồn phạm vi thực của ánh sáng trong cảnh, trong khi vẫn ổn định đủ cho đào tạo.

Nhãn văn bản cho các hình ảnh sau đó được tạo ra với mô hình Qwen2.5-VL 7B, với các lời nhắc được tạo ra để phù hợp với các đặc điểm của mô hình Flux sẽ được sử dụng tại thời điểm tạo:

Mỗi hình ảnh được chia thành các ‘lát’ tiếp xúc và truyền qua một máy mã hóa VAE chung, chuyển đổi tất cả các tiếp xúc thành một không gian latent chung được thiết kế để bắt tất cả phạm vi độ sáng. Các latent sau đó được tinh chỉnh từ tiếng ồn, và giải mã lại thành hình ảnh, cho phép xây dựng nhất quán trên các vùng tối và sáng, mà không làm chúng bị sụp đổ thành một tiếp xúc ‘phẳng’ duy nhất.

LoRA tinh chỉnh được sử dụng để thích nghi với khung sườn Flux được đào tạo trước với dữ liệu hình ảnh tuyến tính với số lượng tham số tối thiểu, giúp mô hình Single-Diffusion Transformers (single-DiT) vẫn ổn định, ngay cả khi độ sáng thay đổi trên các khung hình tiếp xúc.

Chú ý tự điều chỉnh Modulation Exposure (cột trung tâm trong hình minh họa schema trên) được giới thiệu để xử lý chung tất cả các khung hình, cho phép độ sáng được điều chỉnh cho mỗi khung hình trong khi giữ cấu trúc và chi tiết mịn được căn chỉnh.

3D Rotary Positional Embedding (3D-R[o]PE) được sử dụng để mã hóa cả vị trí không gian và danh tính tiếp xúc, để mô hình có thể phân biệt khung hình nào thuộc về mỗi mã thông báo, trong khi vẫn giữ tính nhất quán không gian, cho phép tách biệt sạch sẽ sự thay đổi độ sáng từ nội dung cảnh.

Tổng quan về bộ dữ liệu được sử dụng trong nghiên cứu, cho thấy cách hình ảnh được phân phối trên các loại nội dung và cảnh trong nhà so với ngoài trời, cùng với sự phân bố của các giá trị độ sáng trong dữ liệu đã xử lý.

3D-RoPE tách biệt ở đâu một tính năng và ‘khung hình tiếp xúc nào nó đến từ’ thành các tín hiệu riêng biệt, để sự thay đổi độ sáng có thể được điều chỉnh độc lập, mà không làm hỏng chi tiết không gian.

Thử Nghiệm

Các nhà nghiên cứu đã sử dụng Flux-dev làm khung sườn tạo, với đào tạo xảy ra trên bốn GPU NVIDIA A100, mỗi GPU có 80GB VRAM. Kích thước lô được đặt ở 4 (trên mỗi GPU), trong 10.000 lần lặp.

Tinh chỉnh LoRA sử dụng hạng 64. Bộ tối ưu hóa AdamW được sử dụng ở tốc độ học 2×102 (cho khía cạnh điều chỉnh tiếp xúc).

Các tác giả lưu ý rằng trong khi có hai công việc trước đây tương tự về phạm vi, không có công việc nào trong số đó là một ứng cử viên rõ ràng cho một giai đoạn thử nghiệm. Công việc dẫn đầu bởi Max Planck vào năm 2022 GlowGAN bị giới hạn ở việc tạo ra các loại hình ảnh cụ thể, trong khi Bracket Diffusion (lại một lần nữa do Viện Max Planck dẫn đầu) vào năm 2025 chỉ có thể tạo ra một hình ảnh HDR ở 256x256px, và mất vài phút để thực hiện:

Từ bài báo GlowGAN gốc, các hình ảnh độ phân giải thấp (LDR) điển hình mất chi tiết trong bóng tối và vùng sáng, trong khi mô hình học cách tạo ra các phiên bản HDR giữ lại chi tiết trên các mức độ sáng và cho phép phục hồi các vùng bão hòa thông qua ánh xạ ngược. Nguồn

Do đó, trong sự vắng mặt của các đường cơ sở trực tiếp cho việc tạo hình ảnh tuyến tính, các tác giả đã so sánh phương pháp của họ với các phiên bản được điều chỉnh của các mô hình mạnh mẽ hiện có, thay vì các giải pháp thay thế được xây dựng riêng.

Một tập hợp các thí nghiệm (‘T2I Fine-Tuning’) tinh chỉnh mô hình khuếch tán hình ảnh-văn bản Flux bằng cách sử dụng LoRA, đào tạo nó để tạo ra hình ảnh tuyến tính trực tiếp, và đánh giá cách một mô hình T2I hiện đại thích nghi với lĩnh vực này.

Một so sánh khác (‘T2V fine-tuning’) sử dụng mô hình văn bản-sang-video Wan 2.1, mà VAE của nó nén nhiều khung hình vào một biểu diễn latent chung; trong thiết lập này, bốn khung hình tiếp xúc được mã hóa vào một biểu diễn latent duy nhất, và sau đó giải mã lại, kiểm tra xem một đường ống video có thể mô hình hóa sự thay đổi tiếp xúc:

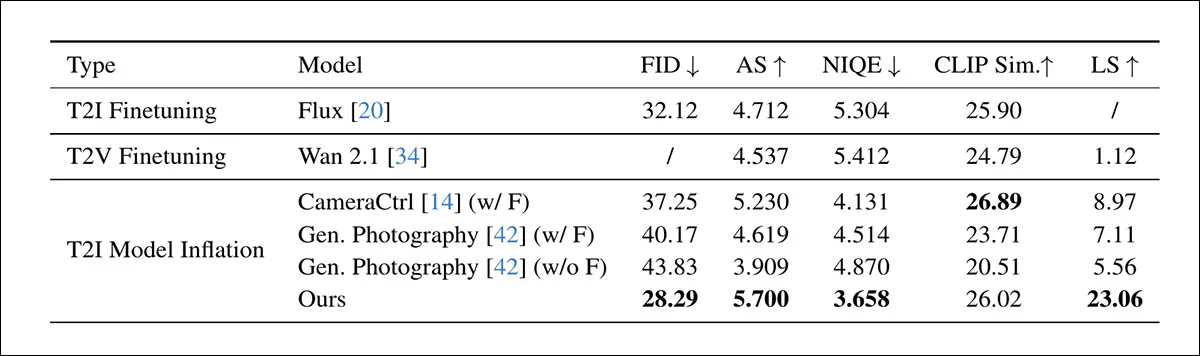

Thử nghiệm thứ ba (‘T2I Model Inflation’) so sánh với CameraCtrl và Generative Photography, cả hai đều mở rộng mô hình khuếch tán hình ảnh thông qua các mô-đun thời gian, để tạo ra đầu ra nhiều khung hình. Những mô hình này cũng được tinh chỉnh trên cùng một dữ liệu, cho một so sánh nhất quán:

Các chỉ số được sử dụng bao gồm Fréchet Inception Distance (FID); Điểm thẩm mỹ (AS); Trình đánh giá chất lượng hình ảnh tự nhiên (NIQUE); Điểm tương đồng CLIP; và Tương đồng độ sáng (LS):

So sánh phương pháp của tác giả với một số đường cơ sở được điều chỉnh cho việc tạo ra hình ảnh tuyến tính, được tham chiếu cảnh.

Về những kết quả này, các tác giả tuyên bố:

‘Do sự phân bố rộng của hình ảnh tuyến tính, việc tinh chỉnh trực tiếp mô hình T2I trên dữ liệu tuyến tính khiến nó khó khăn để cân bằng chi tiết bóng tối và vùng sáng. Các phương pháp T2I Model Inflation gặp phải cả phạm vi động hạn chế và sự suy giảm chất lượng hình ảnh đáng kể ngay cả sau khi tinh chỉnh.

‘Đối với T2V Fine-tuning, việc giảm mẫu 4× thời gian của Wan 2.1 trộn 4 khung hình tiếp xúc vào một biểu diễn latent duy nhất, gây ra một sự không phù hợp phân bố nghiêm trọng mà không thể được giải quyết thông qua tinh chỉnh alone.

‘Bằng cách mô hình hóa trực tiếp các thuộc tính được tham chiếu cảnh bằng cách sử dụng khung hình tiếp xúc, phương pháp của chúng tôi đạt được chất lượng hình ảnh và phạm vi động vượt trội trên tất cả các đường cơ sở.’

So sánh với Flux và Wan 2.1 được điều chỉnh bởi LoRA, minh họa cách mỗi phương pháp xử lý các thay đổi tiếp xúc trên cùng một cảnh.

Vui lòng tham khảo phần thí nghiệm mở rộng và tài liệu phụ của bài báo nguồn để biết thêm các thử nghiệm.

Kết Luận

Đối với các chuyên gia truyền thông, chẳng hạn như những người làm việc trong sản xuất phim và truyền hình, cùng một đầu ra đã thu hút sự tưởng tượng (và, ngày càng nhiều, sự không hài lòng) của thế giới đã để lại họ không ấn tượng, vì hầu hết các đường ống của họ phụ thuộc vào việc thu hình HDR.

Do đó, đây là một dự án kịp thời, đại diện cho một tiện ích mà người ta hy vọng sẽ trở thành một tiêu chuẩn tùy chọn trên các khung sườn mới – mặc dù nó chắc chắn sẽ ít nhất là tăng gấp đôi thời gian kết xuất; rõ ràng, cũng, độ trễ sẽ cần được giải quyết nghiêm túc nếu nội dung trí tuệ nhân tạo HDR không bị giới hạn ở thể loại ‘sau sản xuất’ chứ không phải trong máy ảnh.

* Thông thường chúng tôi sẽ hiển thị các ví dụ, nhưng vì người đọc có thể không có màn hình hỗ trợ HDR, chúng tôi bỏ qua những điều này trong trường hợp này.

Được xuất bản lần đầu vào Chủ nhật, ngày 26 tháng 4 năm 2026