Góc nhìn Anderson

Dữ Liệu ‘Lạc Loài’ Làm Ô Nhiễm Hiệu Suất AI Sáng Tạo

Một nghiên cứu mới phát hiện nhiều bộ dữ liệu hình ảnh phổ biến dùng để huấn luyện mô hình AI bị nhiễm các hình ảnh kiểm tra hoặc các bản sao gần giống, cho phép mô hình gian lận bằng cách ghi nhớ đáp án thay vì học hỏi. Sự rò rỉ này phổ biến nhưng thường không bị phát hiện, âm thầm thổi phồng điểm số và mang lại lợi thế không công bằng cho các mô hình được huấn luyện trên dữ liệu quy mô web.

Khi bạn thi lái xe, bạn thường không được biết trước chính xác những con đường nào sẽ được dùng cho bài kiểm tra. Nếu bạn biết (và bạn hơi thiếu liêm chính), bạn có thể ‘tối ưu hóa’ cho bài kiểm tra bằng cách luyện tập lặp đi lặp lại trên tuyến đường đó, thay vì phát triển các kỹ năng lái xe rộng hơn có thể xử lý bất kỳ tuyến đường nào một cách hợp lý.

Trong việc huấn luyện các mô hình học máy, đây là một phép loại suy hợp lý cho một phần dữ liệu kiểm tra – việc chia tách dữ liệu tập huấn luyện thành (thường là) 70% cho dữ liệu sẽ dùng để huấn luyện mô hình, với 30% còn lại được dùng làm dữ liệu ‘ngoài thực tế’.

Vì dữ liệu ngoài thực tế chưa từng được mô hình nhìn thấy, nếu mô hình hoạt động tốt trên dữ liệu đó, nó có thể được coi là hiệu quả và có hiệu suất; nếu không, mô hình có thể đã quá khớp trên một tập dữ liệu cân bằng – hoặc dữ liệu cần được tuyển chọn và định nghĩa thêm.

Dù thế nào, việc không đánh giá các mô hình trên dữ liệu huấn luyện của chúng là nền tảng của phương pháp hiện tại trong nghiên cứu và phát triển AI.

Lặp Lại Một Lần Nữa

Theo một bài báo nghiên cứu mới từ Nhật Bản, lĩnh vực nghiên cứu thị giác máy tính và AI sáng tạo chưa hề theo kịp nỗ lực của các nhà nghiên cứu LLM trong việc đảm bảo dữ liệu kiểm tra không làm ô nhiễm dữ liệu huấn luyện; trong các thử nghiệm, các nhà nghiên cứu phát hiện ra rằng mọi bộ dữ liệu thị giác siêu quy mô mà họ nghiên cứu, bao gồm cả những bộ cung cấp năng lượng cho một số hệ thống AI sáng tạo lớn nhất hiện nay, đều ở một mức độ nào đó cho phép dữ liệu kiểm tra của nó xâm nhập vào dữ liệu huấn luyện – có nghĩa là các điểm chuẩn và báo cáo hiệu suất cho các mô hình được huấn luyện trên các phần tách này sẽ không chính xác hơn kết quả thi của một người đã lén mang tài liệu vào phòng thi, và sẽ không phản ánh hiệu suất thực tế trên dữ liệu mới thực sự.

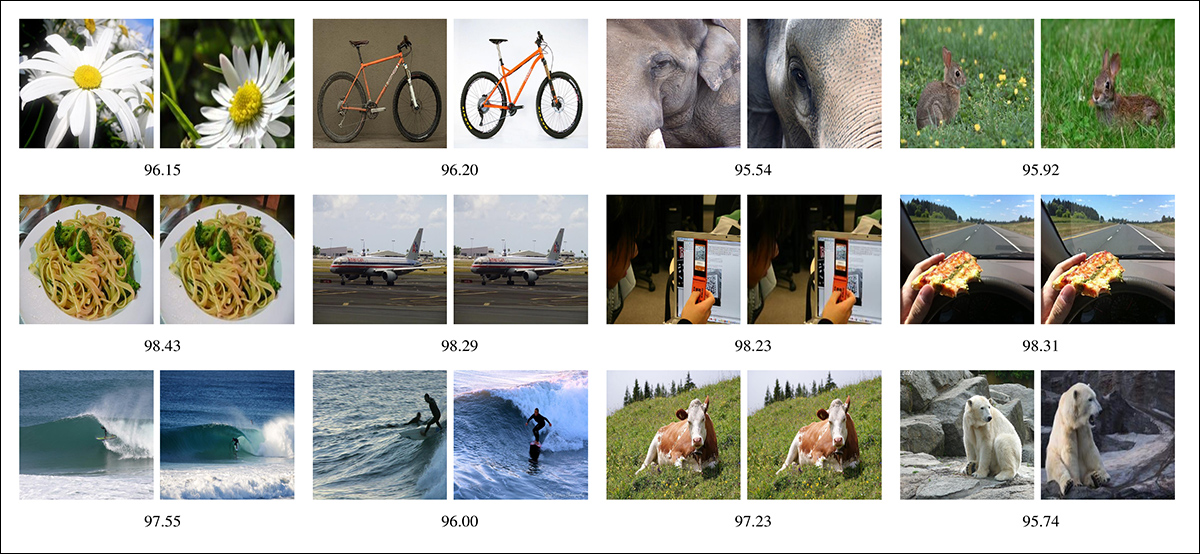

Ví dụ về sự nhiễm chéo dữ liệu được các nhà nghiên cứu phát hiện, nơi các điểm dữ liệu trùng lặp hoặc gần trùng lặp tồn tại trong cả dữ liệu huấn luyện và kiểm tra. Source: https://arxiv.org/pdf/2508.17416

Trong hình ảnh trên, từ bài báo mới, chúng ta thấy các ví dụ về các điểm dữ liệu trùng lặp hoặc gần trùng lặp được tìm thấy trong cả dữ liệu huấn luyện cốt lõi và dữ liệu kiểm tra của nhiều mô hình – đủ để làm mất hiệu lực hiệu suất của mô hình trên dữ liệu đó, và thổi phồng nhẹ điểm số tổng thể của nó trên mọi mặt, tạo điều kiện cho sự xuất hiện của một mức độ khái quát hóa mà mô hình có thể thực sự chưa đạt được.

Để làm cho vấn đề phức tạp hơn, sự nhiễm bẩn dường như xảy ra trên nhiều kịch bản khả thi, bao gồm ‘tiền huấn luyện‘, nơi các trọng số của các mô hình tổ tiên cũ hơn được sử dụng để ‘khởi động’ một mô hình mới. Nếu mô hình cũ hơn ở thượng nguồn có một số dữ liệu giống với tập dữ liệu mới hơn đang được tiền huấn luyện, thì sự nhiễm chéo có thể xảy ra ngay cả khi việc chia tách 70/30 hoặc 80/20 là sạch.

Hiệu Ứng Tích Lũy

Điều này gần như chắc chắn sẽ xảy ra ngay cả trong các bộ dữ liệu mới nhất: phạm vi của các bộ dữ liệu thị giác/ngôn ngữ đã phát triển rất lớn trong năm năm qua, thu nhận không chỉ dữ liệu hình ảnh mới nhất trên web, mà còn thu thập lại phần lớn cùng một dữ liệu đã có trong các bộ dữ liệu lịch sử, cũ hơn đó.

Hơn nữa, các quy trình tự động được thiết kế để quét và lọc hàng tỷ hình ảnh để tìm các bản sao và bản sao gần giống hiện phải đối mặt với một nhiệm vụ quá nặng nề đến mức bản thân việc tuyển chọn – chi phí của nó về thời gian và tiền bạc – giờ đây phải được xem xét trong bối cảnh các hạn chế về ngân sách.

Trong khi đó, sự trùng lặp hình ảnh là hệ quả không thể tránh khỏi của loại hình quét web ngẫu hứng đằng sau các bộ sưu tập khổng lồ như Common Crawl, do thực tiễn phổ biến là đăng lại và nén lại hình ảnh, và áp dụng các chỉnh sửa như cắt xén, và thậm chí lật ngược (để tránh bị phát hiện, khi hình ảnh có thể đã được sử dụng mà không có sự cho phép, chẳng hạn).

Các tác giả nhận xét*:

‘Rò rỉ dữ liệu là một vấn đề phổ biến, phổ biến trong hầu hết các bộ dữ liệu hình ảnh. Rò rỉ có thể che khuất khả năng khái quát hóa của các mô hình, điều này đặc biệt có vấn đề khi so sánh các mô hình được huấn luyện trên các bộ dữ liệu khác nhau, dẫn đến các so sánh không công bằng.

‘Chúng tôi kêu gọi các nhà thiết kế bộ dữ liệu cẩn thận xem xét ý nghĩa của những đánh giá này. Để đánh giá mô hình công bằng hơn, chúng tôi khuyến nghị sử dụng các bộ phát hiện trùng lặp xem xét cả rò rỉ cứng và mềm.

‘Lý tưởng nhất, các hình ảnh bị rò rỉ nên được loại bỏ khỏi tập huấn luyện, và nếu không thể, chúng ít nhất nên được loại bỏ khỏi tập kiểm tra.’

Bài báo trình bày chi tiết về một số thử nghiệm mà các nhà nghiên cứu đã thực hiện trên các bộ dữ liệu lớn và phổ biến – tất cả đều cho thấy một mức độ nhiễm bẩn nào đó.

Bài báo mới có tiêu đề Data Leakage in Visual Datasets, và đến từ ba nhà nghiên cứu tại Đại học Osaka.

Phương Pháp

Các tác giả của bài báo định nghĩa rò rỉ theo ba chiều: phương thức, phạm vi và mức độ.

Phương thức phân biệt liệu chỉ có hình ảnh bị rò rỉ hay cả hình ảnh và nhãn đều bị lộ; phạm vi xác định liệu sự trùng lặp xảy ra trong cùng một bộ dữ liệu hay trên các bộ dữ liệu khác nhau; và mức độ xác định liệu nội dung trùng lặp là hoàn toàn giống nhau hay chỉ đơn thuần là tương tự.

Về rò rỉ, hai kịch bản được xem xét trong công trình là rò rỉ nội bộ bộ dữ liệu (nơi hình ảnh đánh giá xuất hiện lại trong phần huấn luyện của cùng một bộ dữ liệu) và rò rỉ liên bộ dữ liệu (nơi hình ảnh đánh giá từ một bộ dữ liệu có mặt trong một bộ dữ liệu khác được sử dụng để huấn luyện).

Về mức độ, hai cấp độ được định nghĩa là rò rỉ mềm (nơi hình ảnh không giống hệt nhau nhưng có các biến thể nhỏ) và rò rỉ cứng (nơi hình ảnh hoàn toàn giống nhau giữa huấn luyện và đánh giá).

Các nhà nghiên cứu giải quyết việc phát hiện rò rỉ dưới dạng truy xuất hình ảnh, sử dụng bộ mã hóa hình ảnh để biểu diễn mỗi hình ảnh dưới dạng một vector đặc trưng. Tập truy vấn là dữ liệu đánh giá, trong khi bộ sưu tập là tập huấn luyện.

Đối với các bộ dữ liệu nhỏ hơn, mọi vector truy vấn được so sánh trực tiếp với tất cả các vector huấn luyện bằng cách sử dụng độ tương đồng cosine. Đối với các bộ dữ liệu lớn hơn, một chỉ mục Faiss được xây dựng để cho phép tìm kiếm K-Nearest Neighbors (KNN) nhanh hơn.

Vì bộ mã hóa cần nắm bắt đủ thông tin hình ảnh để phát hiện các điểm tương đồng tinh tế, nhưng vẫn phải hiệu quả khi đối mặt với khối lượng dữ liệu rất lớn, các tác giả đã dựa vào các đặc trưng CLIP được tính toán trước do những người tạo bộ dữ liệu cung cấp, trong trường hợp bộ sưu tập LAION làm nền tảng cho Stable Diffusion và các dự án sau này.

Các tác giả lưu ý rằng việc cho phép CLIP sử dụng hiểu biết đã được chưng cất của nó về bộ dữ liệu (thay vì lấy mẫu các tệp thực tế ở quy mô lớn) đã tăng tốc quá trình đáng kể và mang lại sự nhất quán được cải thiện trên các phép so sánh.

Dữ Liệu và Thử Nghiệm

Bộ mã hóa hình ảnh CLIP được sử dụng trong các thử nghiệm cho công trình mới là CLIP ViT-B/32 mặc định ban đầu được dùng để sàng lọc LAION. Để xác định xem các hình ảnh đa dạng có liên quan đến nhau hay không, KNN đã được sử dụng dưới AutoFaiss.

Các bộ dữ liệu được nhóm thành ba loại: bộ dữ liệu tiền huấn luyện – các bộ sưu tập lớn được thu thập từ web dùng để huấn luyện các mô hình tổng quát; bộ dữ liệu huấn luyện – các bộ sưu tập nhỏ hơn, thường được chú thích, dành cho việc điều chỉnh mô hình trực tiếp; và bộ dữ liệu điểm chuẩn – được chú thích thủ công và chỉ được sử dụng cho mục đích đánh giá.

Phân tích bao gồm hai mươi phần tách trên bảy bộ dữ liệu: Microsoft COCO được sử dụng làm cả tập huấn luyện và đánh giá, bao gồm các phần tách huấn luyện, xác thực, kiểm tra và không nhãn; <