Góc nhìn Anderson

Mang lại cảm giác mùi cho sự phát triển Trí tuệ nhân tạo

Một bộ dữ liệu Trí tuệ nhân tạo mới dạy máy tính cách ngửi bằng cách liên kết dữ liệu mùi với hình ảnh, cho phép mô hình khớp mùi với vật thể, cảnh và vật liệu.

Có lẽ vì máy móc có đầu ra mùi có lịch sử phức tạp, khứu giác là một giác quan khá bị bỏ qua trong tài liệu nghiên cứu về Trí tuệ nhân tạo. Trừ khi bạn đang lên kế hoạch sản xuất một mục nhập khác trong loạt smell-o-vision đang chạy (hơn một thế kỷ đến nay), các trường hợp sử dụng luôn似乎 khá ‘hẹp’ so với khả năng khai thác dữ liệu hình ảnh, âm thanh và video, và các mô hình Trí tuệ nhân tạo được đào tạo từ chúng.

Thực tế, khả năng tự động hóa, công nghiệp hóa và phổ biến các cơ sở phát hiện được cung cấp bởi chó bom, chó xác, chó phát hiện bệnh, và nhiều loại đơn vị đánh hơi khác, sẽ là một lợi ích đáng chú ý trong các dịch vụ đô thị và an ninh. Mặc dù nhu cầu cao, nhưng quá mức cung, đào tạo và duy trì chó phát hiện là một hoạt động kinh doanh tốn kém không luôn cung cấp giá trị tốt cho tiền bạc.

Cho đến nay, hầu hết nghiên cứu xâm phạm vào lĩnh vực nghiên cứu này đã bị giới hạn trong phòng thí nghiệm, với các bộ sưu tập được tạo thủ công thường bao gồm các ví dụ có tính năng được tạo thủ công – một hồ sơ nghiêng nhiều hơn về các giải pháp công nghiệp hóa hơn là các ứng dụng công nghiệp.

Ahead by a Nose

Vào khí hậu khá cũ kỹ này, một sự hợp tác học thuật/công nghiệp thú vị từ Mỹ, trong đó một nhóm nhà nghiên cứu đã dành vài tháng để lập danh mục các mùi khác nhau trong môi trường trong nhà và ngoài trời ở Thành phố New York – và, lần đầu tiên, thu thập hình ảnh liên kết với các mùi được thu thập:

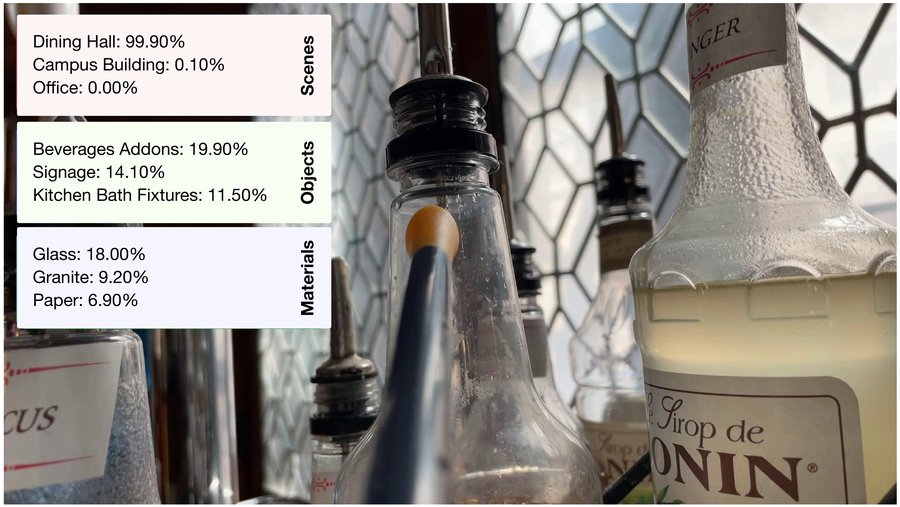

Lưu ý cảm biến trung tâm, ‘mũi’ của thiết bị olfactory. Được đào tạo chỉ trên mùi, mô hình đoán liệu nó có đang ngửi granite, nhựa hoặc da – và thậm chí xác định phòng nó đang ở, mà không nhìn thấy một pixel duy nhất. Nguồn

Nghiên cứu này đã dẫn các tác giả của công việc mới đến việc tạo ra một phiên bản của khuôn khổ Contrastive Language-Image Pretraining (CLIP) phổ biến, kết nối văn bản và hình ảnh, dưới dạng Contrastive Olfaction-Image Pretraining (COIP) – kết nối mùi và hình ảnh.

Trên: dữ liệu cảm biến olfactory và video được thu thập trong các thiết lập tự nhiên bằng cách sử dụng một bộ gắn camera-e-nose. Dưới trái (b): một bản nhúng chung được học thông qua tự giám sát chéo modal. (c): hệ thống thu lại các trận đấu hình ảnh dựa trên một truy vấn mùi duy nhất. (d): các mẫu mùi riêng lẻ được sử dụng để phân loại các danh mục môi trường, vật thể và vật liệu. (e): các mùi tương tự cao, chẳng hạn như hai loại cỏ, được phân biệt mà không có đầu vào hình ảnh. Nguồn

Bộ dữ liệu mới, có tên New York Smells, chứa 7.000 cặp mùi-hình ảnh với 3.500 vật thể khác nhau. Khi được đào tạo trong các thử nghiệm, dữ liệu mới được tìm thấy để vượt trội so với các tính năng được tạo thủ công trong số lượng nhỏ các bộ dữ liệu tương tự trước đó.

Các tác giả hy vọng rằng lần ra mắt ban đầu của họ sẽ mở đường cho các công việc sau này và các công trình tiếp theo hướng tới các hệ thống phát hiện olfactory được thiết kế để hoạt động trong tự nhiên, giống như cách chó đánh hơi làm*:

‘Chúng tôi xem bộ dữ liệu này là một bước tiến tới nhận thức olfactory đa phương thức trong tự nhiên, cũng như một bước tiến tới liên kết tầm nhìn với mùi. Trong khi olfaction truyền thống đã được tiếp cận trong các thiết lập bị giới hạn, chẳng hạn như đảm bảo chất lượng, có nhiều ứng dụng trong các thiết lập tự nhiên.

‘Ví dụ, như con người, chúng ta liên tục sử dụng cảm giác mùi của mình để đánh giá chất lượng thực phẩm, xác định các mối nguy và phát hiện các vật thể không nhìn thấy.

‘Hơn nữa, nhiều động vật, chẳng hạn như chó, gấu và chuột, thể hiện khả năng khứu giác siêu phàm, gợi ý rằng nhận thức mùi của con người còn xa so với giới hạn của khả năng máy móc.’

Mặc dù bài báo mới, có tên New York Smells: Một bộ dữ liệu đa phương thức lớn cho Olfaction, hứa hẹn rằng dữ liệu và mã sẽ được phát hành, một tệp dữ liệu 27GB đã có sẵn thông qua trang web dự án. Bài báo được sản xuất bởi chín nhà nghiên cứu trên toàn Đại học Columbia, Đại học Cornell và Osmo Labs.

Phương pháp

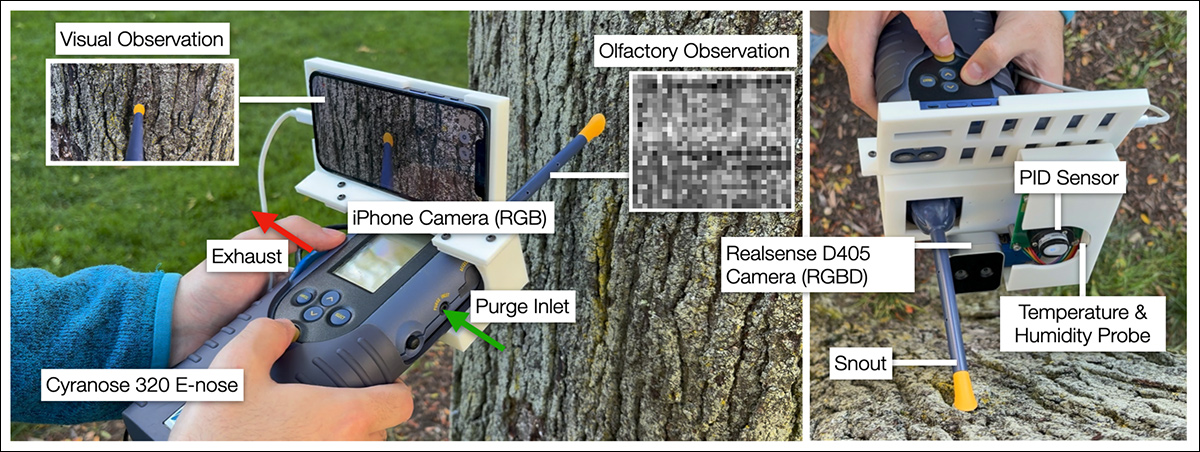

Để thu thập vật liệu cho bộ sưu tập mới, các nhà nghiên cứu đã sử dụng Cyranose 320 mũi điện tử, với một iPhone gắn trên đầu vào phía trước để chụp lại hình ảnh của những gì đang được đăng ký:

Một bộ cảm biến cầm tay thu thập dữ liệu video và mùi được ghép nối bằng cách gắn một camera iPhone vào một Cyranose 320 e-nose. Mũi được nhắm vào các vật thể trong khi đầu vào và đầu ra quản lý luồng không khí trong quá trình lấy mẫu. Một camera RGB‑D chụp độ sâu, trong khi nồng độ hợp chất hữu cơ dễ bay hơi (VOC), nhiệt độ và độ ẩm được ghi lại thông qua các cảm biến tích hợp bao gồm một mô-đun PID và đầu dò môi trường.

Thiết bị Cyranose hoạt động tại 2Hz, ghi lại 32 bước thời gian olfactory. Nồng độ VOC được ghi lại với một cảm biến MiniPID2 PPM WR.

Đơn vị di động hoạt động như một cảm biến linh hoạt, truyền dữ liệu đến một trạm di động có khả năng tính toán hơn để xử lý.

Để đặt mùi mục tiêu vào bối cảnh, một ‘mùi cơ bản’ được đăng ký, trước khi đối tượng cụ thể được nhắm mục tiêu trực tiếp với ‘mũi’ của Cyranose. Mẫu môi trường được lấy từ một cổng bên trong đơn vị, để đảm bảo nó đủ xa khỏi nguồn mùi chính để không bị ô nhiễm.

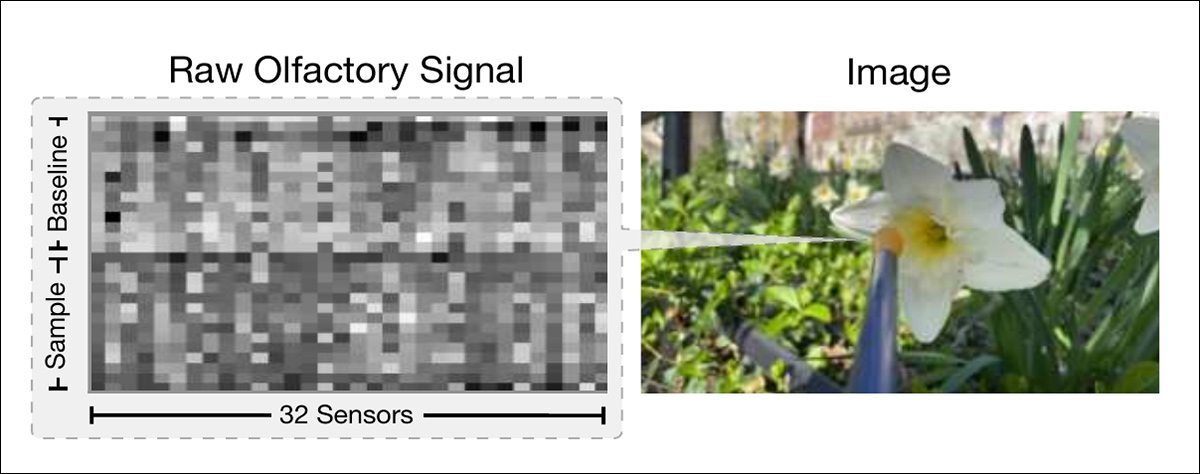

Hai mẫu được lấy thông qua đầu vào chính của cảm biến, với mỗi bản ghi 10 giây được thu từ một vị trí khác nhau xung quanh vật thể, để cải thiện hiệu quả dữ liệu. Các mẫu sau đó được kết hợp với mẫu cơ bản để tạo thành một ma trận 28×32, đại diện cho toàn bộ phép đo olfactory:

Ví dụ này cho thấy tín hiệu và hình ảnh tương ứng cho một bông hoa. Tín hiệu olfactory đầy đủ bao gồm một ma trận 28×32, kết hợp một mẫu cơ bản 14 khung với hai mẫu 10 giây lấy từ các góc khác nhau xung quanh vật thể mục tiêu.

Dữ liệu và Thử nghiệm

Mô hình ngôn ngữ hình ảnh (VLMs) được sử dụng để tự động gắn nhãn cho các vật thể và vật liệu được chụp bởi iPhone trong bộ gắn Cyranose, với GPT-4o được sử dụng cho nhiệm vụ; tuy nhiên, các danh mục cảnh được gắn nhãn thủ công:

Một mẫu nhỏ từ một minh họa rộng rãi trong bài báo nguồn chi tiết các nguồn mùi và môi trường được thu thập trong dự án.

Bộ dữ liệu được chia thành các phần đào tạo và xác thực chia, với cả hai mẫu từ mỗi vật thể được chỉ định cho cùng một phần để tránh ô nhiễm chéo. Bộ sưu tập cuối cùng bao gồm 7.000 cặp olfactory-vision được thu từ 3.500 vật thể không được gắn nhãn, cùng với 70 giờ video và 196.000 bước thời gian olfactory thô từ cả giai đoạn cơ bản và mẫu.

Dữ liệu được thu thập trong 60 phiên trong một khoảng thời gian hai tháng, bao gồm các công viên, tòa nhà đại học, văn phòng, đường phố, thư viện, căn hộ và phòng ăn, với nhiều phiên được thực hiện tại mỗi địa điểm. Bộ dữ liệu kết quả chứa 41% môi trường ngoài trời và 59% môi trường trong nhà.

Để phát triển các biểu diễn olfactory chung, các tác giả đã đào tạo một mô hình tương phản để liên kết các cặp hình ảnh-mùi được đồng bộ hóa từ bộ dữ liệu. Cách tiếp cận này, COIP được đề cập trước đó, sử dụng một hàm mất mát được điều chỉnh từ CLIP để căn chỉnh các bản nhúng của các tín hiệu hình ảnh và olfactory đồng thời.

Đào tạo sử dụng cả một bộ mã hóa hình ảnh và một bộ mã hóa mùi, với mục tiêu dạy cho mô hình cách đưa các mùi và hình ảnh khớp nhau lại gần nhau trong một không gian biểu diễn chung. Các biểu diễn kết quả hỗ trợ một loạt các nhiệm vụ hạ lưu, bao gồm thu hồi hình ảnh-mùi, nhận dạng cảnh và vật thể, phân loại vật liệu và phân biệt mùi tinh tế.

Mô hình được đào tạo bằng cách sử dụng hai loại đầu vào olfactory: tín hiệu cảm biến thô và một bản tóm tắt được tạo thủ công gọi là smellprints – các tính năng được sử dụng rộng rãi trong nghiên cứu olfaction mà nén phản ứng của mỗi cảm biến thành một số duy nhất bằng cách so sánh điện trở đỉnh trong quá trình lấy mẫu với điện trở trung bình trong mẫu cơ bản.

Ngược lại, đầu vào thô được ghi lại trên toàn NYC bao gồm một chuỗi thời gian từ 32 cảm biến hóa học bên trong thiết bị Cyranose, ghi lại cách mỗi cảm biến thay đổi điện trở theo thời gian khi nó phản ứng với mùi.

Đối với việc thu thập bộ dữ liệu, tín hiệu này được đưa trực tiếp vào một mạng nơ-ron, cho phép học hỏi từ đầu đến cuối với một hệ thống dựa trên convolutional hoặc transformer. Các mô hình được đào tạo bằng cách sử dụng cả smellprints và đầu vào thô thu từ các môi trường khác nhau ở Thành phố New York, với cả hai loại đầu vào được đánh giá bằng cách học tương phản.

Thu hồi Chéo Modal

Thu hồi chéo modal được đánh giá bằng cách nhúng mỗi mẫu mùi và hình ảnh ghép nối của nó vào một không gian biểu diễn chung, và kiểm tra xem liệu hình ảnh chính xác có thể được thu hồi dựa chỉ trên đầu vào olfactory.

Xếp hạng được xác định bởi sự gần gũi của mỗi bản nhúng hình ảnh với truy vấn mùi trong không gian này, và hiệu suất được đo bằng xếp hạng trung bình, xếp hạng trung vị và độ nhớ ở nhiều ngưỡng:

Độ chính xác của thu hồi chéo modal cho các bộ mã hóa mùi khác nhau, cho thấy mô hình nào xác định hình ảnh chính xác từ một truy vấn mùi. Kết quả so sánh các kiến trúc được đào tạo trên tín hiệu olfactory thô với những kiến trúc sử dụng smellprints.

Về những kết quả này, các tác giả tuyên bố:

‘Đào tạo trước tương phản bằng cách sử dụng smellprint thực hiện tốt hơn may mắn trong tất cả các chỉ số. Tuy nhiên, đào tạo bộ mã hóa mùi trên tín hiệu olfactory thô dẫn đến sự cải thiện đáng kể so với bộ mã hóa smellprint, độc lập với kiến trúc.

‘Điều này cho thấy thông tin phong phú hơn có trong dữ liệu olfactory thô, mở khóa các liên kết chéo modal mạnh mẽ hơn giữa tầm nhìn và mùi.’

Một chi tiết từ minh họa thứ bảy trong bài báo nguồn, không thể tái tạo có ý nghĩa ở đây. Ở đây, các ví dụ về thu hồi chéo modal cho thấy mô hình liên kết các mùi với hình ảnh khớp. Mỗi hàng bắt đầu với một truy vấn mùi, theo sau là các dự đoán hình ảnh hàng đầu trong không gian nhúng chung. Hình ảnh chính xác cho mỗi truy vấn được bao quanh bởi màu xanh lá cây, minh họa cách các mùi từ sách, thực vật, đá và các vật liệu khác kéo mô hình đến các cảnh và ngữ nghĩa liên quan về mặt hình ảnh.

Các tác giả cũng lưu ý rằng kết quả thu hồi cho thấy các mẫu ngữ nghĩa rõ ràng:

‘Thu hồi từ mô hình của chúng tôi thường cho thấy các nhóm ngữ nghĩa. Mùi của một cuốn sách thu hồi hình ảnh của các cuốn sách khác, mùi của lá cây thu hồi hình ảnh của lá cây.

‘Những kết quả này cho thấy rằng biểu diễn đã học nắm bắt cấu trúc chéo modal có ý nghĩa.’

Nhận dạng Cảnh, Vật thể và Vật liệu

Khả năng của mô hình để nhận dạng mùi mà không có đầu vào hình ảnh được đánh giá bằng cách đào tạo nó để xác định các cảnh, vật thể và vật liệu dựa chỉ trên dữ liệu olfactory; để thực hiện việc này, một dấu hiệu tuyến tính (một phân loại đơn giản được đào tạo trên các biểu diễn bị đóng băng) được sử dụng để đánh giá bao nhiêu thông tin được mã hóa trong các biểu diễn mùi đã học.

Nhãn được dẫn xuất từ các hình ảnh ghép nối trong tập đào tạo bằng cách sử dụng GPT-4o – nhưng chỉ tín hiệu olfactory được sử dụng trong quá trình phân loại.

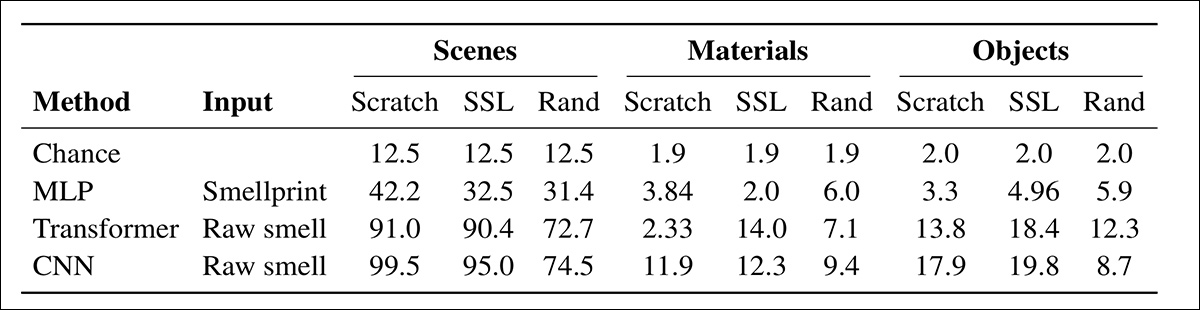

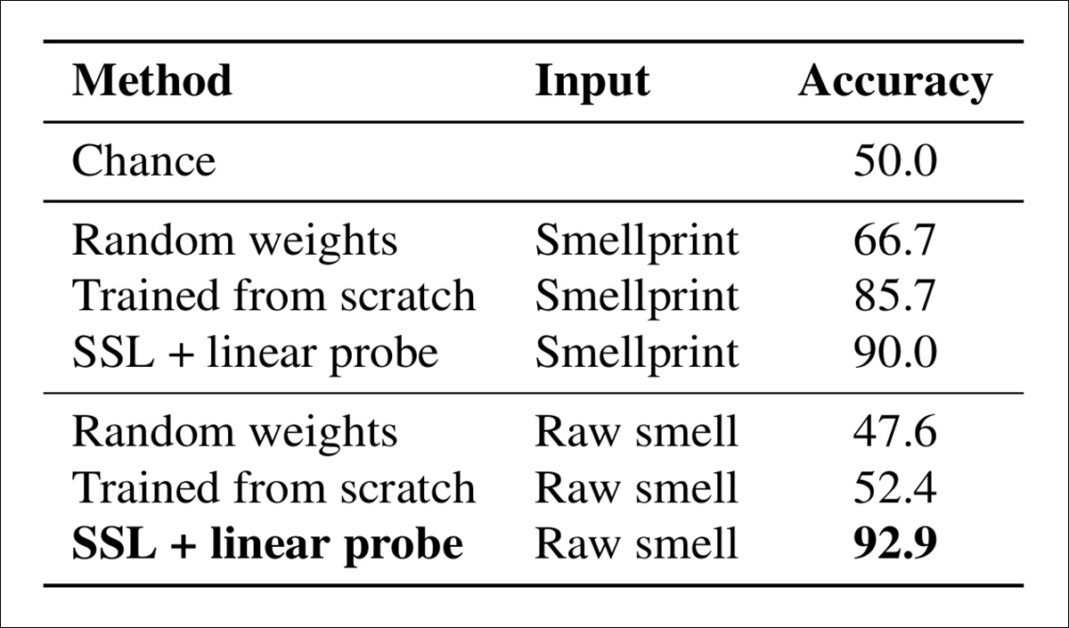

Một số loại bộ mã hóa được kiểm tra: một số được khởi tạo ngẫu nhiên, một số được đào tạo từ đầu và một số được đào tạo bằng cách sử dụng học tương phản để căn chỉnh mùi và tầm nhìn trong một không gian biểu diễn chung, với dữ liệu thô và smellprints được đánh giá:

Độ chính xác phân loại cho các cảnh, vật liệu và vật thể được đánh giá bằng cách sử dụng tín hiệu olfactory alone. Đầu vào cảm biến thô vượt trội so với smellprints, với CNN được đào tạo từ đầu cho kết quả cao nhất, bao gồm 99,5% cho các cảnh. SSL tiền đào tạo giúp trong một số trường hợp, nhưng thường bị vượt qua bởi đào tạo giám sát. Các baseline trọng lượng ngẫu nhiên cho thấy khả năng của mô hình alone là không đủ.

Độ chính xác cao hơn đáng kể được đạt được khi dữ liệu olfactory thô được sử dụng, đặc biệt là trong các mô hình được đào tạo với giám sát chéo modal. Các tác giả nhận xét**:

‘Các mô hình được đào tạo trên đầu vào cảm biến thô cũng đạt được độ chính xác cao hơn so với các mô hình được đào tạo với các tính năng smellprint được tạo thủ công. Những kết quả này cho thấy rằng học sâu từ tín hiệu olfactory thô là tốt hơn đáng kể so với các tính năng được tạo thủ công.’

Phân biệt tinh tế

Để đánh giá liệu các phân biệt mùi tinh tế có thể được học hay không, một chuẩn mực được xây dựng từ hai loài cỏ cùng tồn tại trên một cánh đồng trường đại học. Các mẫu thay thế được thu trong sáu phiên 30 phút, cho ra 256 ví dụ. Một phân loại tuyến tính được đào tạo trên các tính năng từ học tương phản olfactory-vision, và được đánh giá trên một tập hợp được giữ lại của 42 mẫu:

Độ chính xác của phân loại loài cỏ từ mùi alone. Các mô hình được đánh giá về khả năng phân biệt giữa hai loại cỏ tương tự về mặt hình ảnh bằng cách sử dụng chỉ đầu vào olfactory. Hiệu suất được so sánh trên smellprints và dữ liệu cảm biến thô, với các mô hình được khởi tạo ngẫu nhiên, đào tạo từ đầu hoặc đào tạo bằng cách sử dụng học tự giám sát (SSL) sau đó là một dấu hiệu tuyến tính. Độ chính xác cao nhất, 92,9%, được đạt được bằng cách sử dụng tín hiệu olfactory thô với SSL, cho thấy rằng các khác biệt mùi tinh tế được bắt tốt nhất thông qua đầu vào thô và đào tạo hướng dẫn bởi tầm nhìn.

Ở đây, các nhà nghiên cứu tuyên bố:

‘Đào tạo trên tín hiệu cảm biến olfactory thô (thay vì các tính năng được tạo thủ công) cho ra độ chính xác cao nhất – vượt trội so với tất cả các biến thể dựa trên smellprints.

‘Những kết quả này cho thấy rằng học olfactory-vision bảo tồn nhiều thông tin tinh tế hơn so với học bằng smellprints, và rằng giám sát tầm nhìn cung cấp một tín hiệu để khai thác thông tin này.’

Kết luận

Mặc dù tổng hợp mùi có vẻ sẽ vẫn là một vấn đề chưa được giải quyết trong một thời gian, một hệ thống phân tích mùi trong tự nhiên hiệu quả và tiết kiệm chi phí có tiềm năng khổng lồ, không chỉ cho các mục đích cảnh sát, an ninh và y tế, mà còn cho các dịch vụ giám sát chất lượng cuộc sống và đô thị.

Tại thời điểm hiện tại, thiết bị liên quan là một sản phẩm đặc biệt và thường khá đắt tiền; do đó, tiến bộ thực sự trong ‘Trí tuệ nhân tạo olfactory’ cho việc phát hiện có vẻ sẽ đòi hỏi một cảm biến tầm nhìn và tiết kiệm chi phí trong tinh thần Raspberry PI.

* Sự chuyển đổi của tôi từ các trích dẫn nội tuyến của tác giả sang các liên kết.

** Xin lưu ý rằng các minh họa thêm (hình 8) có sẵn trong bài báo nguồn, nhưng tốt nhất nên xem trong bối cảnh đó.

Được xuất bản lần đầu vào thứ Sáu, ngày 28 tháng 11 năm 2025