Góc nhìn Anderson

Trí tuệ nhân tạo Thích Đọc Sách Hơn Xem Phim

Thật ngạc nhiên khi thấy các mô hình trí tuệ nhân tạo khó xem và bình luận về nội dung video thực tế, ngay cả khi chúng được thiết kế cho nhiệm vụ này. Chúng quan tâm hơn đến văn bản viết.

Nếu bạn đã từng thử tải lên một đoạn video ngắn vào ChatGPT hoặc một mô hình tầm nhìn/ngôn ngữ phổ biến khác, bạn có thể đã ngạc nhiên khi nhận ra rằng chúng không thể phân tích video. Mặc dù các mô hình như ChatGPT-4o+ có thể phân tích các khung hình riêng lẻ – dưới dạng hình ảnh, chẳng hạn như JPEG và PNG – chúng thích người dùng trích xuất các khung hình của riêng họ và tải chúng lên dưới dạng hình ảnh (mà chúng đã sẵn sàng bình luận).

Trong trường hợp của loạt GPT OpenAI, người ta có thể, khá tốn công, trích xuất một chuỗi khung hình hoàn chỉnh từ một đoạn video và cung cấp cho ChatGPT, với mục đích, chẳng hạn, tạo một bản nhạc tường thuật do AI tạo cho video:

Hình ảnh và mã từ hướng dẫn OpenAI về phân tích nhiều khung hình trích xuất để phát triển bản tường thuật do AI tạo cho một đoạn video. Nguồn

Nhưng việc chuyển đổi từ video sang khung hình thuộc về người dùng, bằng cách gọi các hàm trong một quy trình lớn hơn, như trong ví dụ trên, hoặc bằng cách trích xuất các khung hình bằng FFMPEG hoặc các giải pháp chỉnh sửa video miễn phí và trả phí.

Đến một mức độ nhất định, có thể là rất lớn, các hạn chế về phân tích video trong các sản phẩm quy mô lớn như ChatGPT phụ thuộc vào sử dụng tài nguyên: chỉ cần trang bị một phiên bản trí tuệ nhân tạo với một số codec video phổ biến nhất và cam kết tài nguyên tính toán cho quá trình trích xuất đòi hỏi nhiều đĩa và CPU là một vấn đề không nhỏ, nếu hàng trăm triệu người dùng quyết định bắt đầu sử dụng các tiện ích này mọi ngày.

Ngoài ra, phân tích thời gian có thể vẽ một bức tranh rất khác so với một khung hình duy nhất (hãy tưởng tượng một người bước vào một ngôi nhà trong tâm trạng hạnh phúc và sau đó phát hiện một xác); do đó, việc xem xét toàn bộ “tổng kiểm tra” thời gian của thậm chí một đoạn video ngắn cũng là một nhiệm vụ đòi hỏi nhiều tài nguyên và chuyên sâu – cũng như một lĩnh vực nghiên cứu chuyên sâu, chẳng hạn như với sự phát triển liên tục của các khuôn khổ như Optical Flow – về cơ bản “mở rộng” một đoạn video để nó có thể được coi và hành động như thể nó là một tài liệu tĩnh:

Sơ đồ dòng quang học突出 cách chuyển động được theo dõi qua các khung hình trong một chuỗi video, với các vector màu xanh lá cây cho thấy hướng và cường độ chuyển động. Những bản đồ này cung cấp sự liên tục thời gian cần thiết cho VLM và cũng có thể phục vụ như hướng dẫn cấu trúc trong các quy trình làm việc VFX. Nguồn

Nhường Chỗ Cho Tóm Tắt

Dù vậy, vì các mô hình như Notebook LM của Google và các bản ChatGPT mới hơn có thể đọc các siêu dữ liệu liên quan (tức là nội dung văn bản nhúng để ngữ cảnh hóa video theo một cách nào đó), chúng không cấm tải lên tệp video; và đôi khi, chúng thậm chí sẽ cố gắng giải thích một video không có dữ liệu nào.

Trong trường hợp sau, tôi đã tải lên một đoạn clip 6 giây ngẫu nhiên từ bộ phim Italy The Hand of God (2021) vào NotebookLM, đảm bảo rằng đoạn clip không chứa văn bản hữu ích nào, cả trong siêu dữ liệu và trong tên tệp.

NotebookLM sau đó tiếp tục tưởng tượng vật liệu một cách tinh vi, hoàn toàn không liên quan đến video *, cùng với một podcast đối đầu không liên quan và dài 5 phút:

Một khoảnh khắc hàng ngày trong một đoạn clip 6 giây từ một bộ phim Italy được NotebookLM hiểu lầm một cách hoang đường. Nguồn: Google NotebookLM

Mặc dù Notebook, như ChatGPT, sẽ chấp nhận một video YouTube làm đầu vào, nó chỉ làm như vậy nếu video có một lớp chú thích văn bản có thể giải thích và / hoặc phụ đề (không phải phụ đề được raster hóa bị cháy vào video).

Theo cách này, công việc khó khăn của việc nhìn thực sự vào nội dung của video và thực hiện giải thích ngữ nghĩa của nó (một nhu cầu pháp lý cho YouTube, do biện pháp bảo vệ bản quyền của nó, và hệ thống bảo vệ danh tính đang chờ xử lý) đã được thực hiện sau khi người dùng tải lên, khi và khi đoạn clip có thể được phân bổ các tài nguyên xử lý cần thiết.

Giải thích video thực sự là tốn kém và cạn kiệt, và, như nó đã chứng minh, ngay cả các mô hình được đào tạo cụ thể để thực hiện nhiệm vụ này cũng thích đọc văn bản hơn là thực sự xem video.

Tóm Tắt

Điều này, theo một bài báo mới từ Đại học Bristol của Vương quốc Anh, có tiêu đề Video Không Bằng Một Nghìn Lời, trong đó hai tác giả kết luận rằng các mô hình ngôn ngữ tầm nhìn hiện tại (VLM) – các mô hình được thiết kế để có thể phân tích video theo cách nỗ lực hơn và tham gia vào trả lời câu hỏi video (VQA) – cũng mặc định sang thông tin dựa trên văn bản mỗi khi có thể.

Khi được cung cấp cả hình ảnh chuyển động và câu hỏi và câu trả lời nhiều lựa chọn, các tác giả của bài báo đã tìm thấy rằng các mô hình thường dựa trên các mẫu trong văn bản, chứ không phải bất cứ điều gì xảy ra trên màn hình – trong nhiều trường hợp, hoạt động tốt ngay cả khi câu hỏi được lấy đi hoàn toàn.

Trong những gì có vẻ như là một hình thức đường tắt hoặc gian lận thường xuyên, điều quan trọng nhất đối với hầu hết các mô hình là có thể phát hiện các mẫu trong các câu trả lời có thể; chỉ khi nhiệm vụ trở nên khó khăn hơn, bằng cách thêm nhiều tùy chọn câu trả lời, các AI mới bắt đầu chú ý đến video.

Các tác giả đã đưa ra các bài kiểm tra VQA trong một loạt các điều kiện cho sáu mô hình VLM của các độ dài ngữ cảnh khác nhau, trên bốn tập dữ liệu phù hợp; và tìm thấy rằng kết quả cho thấy sự phụ thuộc của các mô hình vào văn bản hơn là nội dung video.

Ví dụ từ nghiên cứu cho thấy cách một mô hình phân tích video cân nhắc những gì nó thấy so với những gì nó đọc. Đoạn clip cho thấy một người dệt tre, nhưng mô hình lại gán nhiều tầm quan trọng hơn cho văn bản câu hỏi và trả lời hơn là cho chính các khung hình video. Các điểm nổi bật màu xanh lam đánh dấu các yếu tố hỗ trợ câu trả lời được chọn, trong khi các điểm nổi bật màu đỏ đánh dấu những yếu tố kéo nó theo hướng ngược lại, minh họa cách lý luận của mô hình tập trung vào cách diễn đạt hơn là hình ảnh chuyển động. Nguồn

Phương Pháp

Để hiểu được mỗi phần đầu vào đóng góp như thế nào vào quyết định của mô hình, công việc mới này sử dụng một phương pháp từ lý thuyết trò chơi gọi là Giá Trị Shapley. Ban đầu được thiết kế để chia một khoản thanh toán một cách công bằng giữa các cầu thủ trong một liên minh, Giá Trị Shapley gán tín dụng cho mỗi “cầu thủ” dựa trên tác động cá nhân của họ.

Hiệu quả thì, các “cầu thủ” trong kịch bản này là các khung hình video hoặc các thành phần văn bản (chú thích, phụ đề, chú thích, v.v.) của một nhiệm vụ VQA; và “khoản thanh toán” là câu trả lời cuối cùng của mô hình. Bằng cách kiểm tra hệ thống những gì xảy ra khi mỗi phần được thêm hoặc loại bỏ, kỹ thuật này tiết lộ mức độ quan trọng của yếu tố đó trong việc đạt được câu trả lời được chọn.

Trong trường hợp của dự án mới, để mở rộng phương pháp này trên nhiều loại dữ liệu, Giá Trị Shapley đã được điều chỉnh để xử lý các phương thức hỗn hợp, với các thành phần video và văn bản được coi là riêng biệt, và ảnh hưởng thay đổi của chúng đến đầu ra của mô hình được đo lường, cho thấy liệu nội dung video có thực sự được giải thích hay liệu các gợi ý văn bản có được sử dụng làm đường tắt.

Thước Đo

Hai thước đo đơn giản được định nghĩa để so sánh mức độ đóng góp của mỗi phương thức (tức là video, câu hỏi hoặc câu trả lời) vào quyết định của mô hình: Đóng Góp Phương Thức đo lường phần đóng góp tổng thể đến từ mỗi loại đầu vào; tại đây, tất cả các giá trị Shapley có sẵn được tổng hợp và phần chia sẻ thuộc về mỗi phương thức được tính toán như một phần trăm của tổng số.

Thứ hai, Đóng Góp Mỗi Tính Năng sửa lỗi cho thực tế là một số phương thức, như video, chứa nhiều tính năng hơn những phương thức khác. Thay vào đó, giá trị Shapley trung bình được tính toán cho mỗi tính năng, và những giá trị trung bình này được so sánh để xác định phương thức nào có ảnh hưởng thống trị.

Dữ Liệu và Kiểm Tra

Các tác giả đã kiểm tra phương pháp này trên sáu mô hình VLM với các đặc điểm đa dạng được thiết kế để đảm bảo rằng các nguyên tắc của các bài kiểm tra được áp dụng rộng rãi và khái quát hóa. Do đó, các mô hình được chọn cho các độ dài ngữ cảnh khác nhau, các độ tuổi khác nhau (tức là thời gian kể từ khi khuôn khổ được phát hành) và các cấu hình kiến trúc khác nhau.

Các ứng cử viên là FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (mà tận dụng Qwen2); và LongVA (cũng sử dụng Qwen2).

Với cùng một mục đích đa dạng, bốn tập dữ liệu mục tiêu được chọn là EgoSchema, một tập dữ liệu VQA được thiết kế để không thể hoàn thành mà không xem toàn bộ video liên quan; HD-EPIC, một tập dữ liệu tập trung vào nhà bếp với một số video bất thường dài; MVBench, một tập hợp được biên soạn từ các đóng góp từ các tập dữ liệu khác; và LVBench, đặt câu hỏi VQA cho các video rất dài.

Từ những điều này, các tác giả đã tạo ra 60 câu hỏi – mười từ mỗi loại câu hỏi.

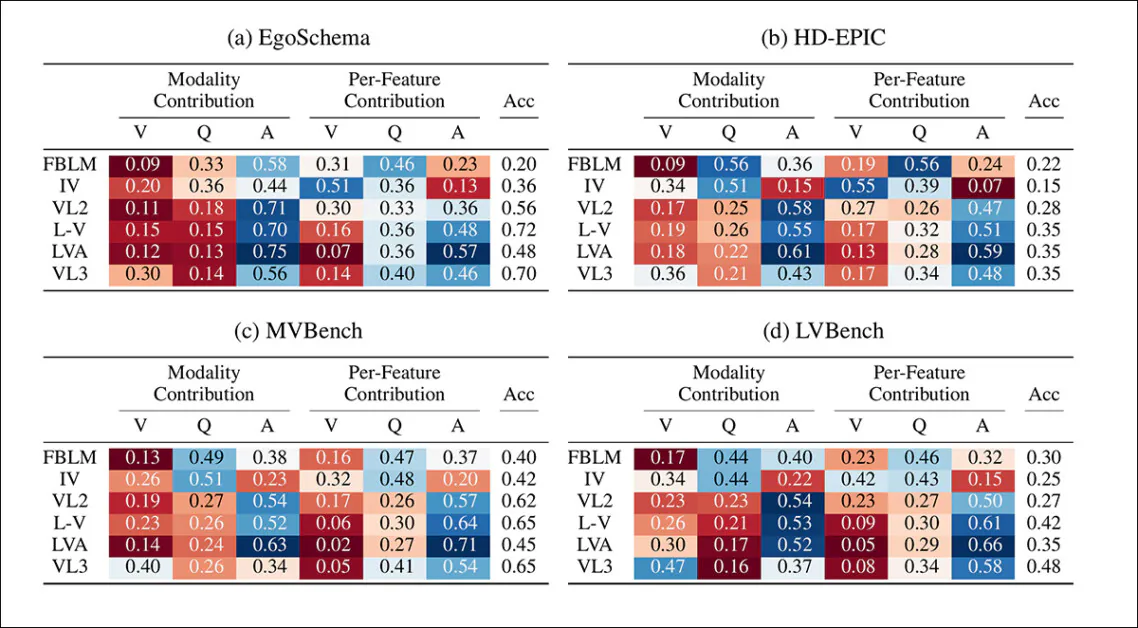

Các thước đo đóng góp làm rõ rằng hầu hết các mô hình phụ thuộc ít hơn vào video hơn là vào văn bản, đặc biệt là khi được đánh giá khung hình theo khung hình. Ngay cả khi video có một sự hiện diện hợp lý trong tổng thể đóng góp, ảnh hưởng của nó theo từng tính năng thường tối thiểu, cho thấy rằng trong khi mô hình có thể sử dụng video tổng thể, nó không chú ý đến các khung hình riêng lẻ. VideoLLaMA3 là ngoại lệ chính ở đây, với sự phụ thuộc vào thị giác nặng hơn, đặc biệt là trên các chuỗi dài hơn trong LVBench:

Điểm Đóng Góp Phương Thức (MC) và Đóng Góp Mỗi Tính Năng (PFC) trên các mô hình và tập dữ liệu, cho thấy trọng lượng tương đối của các đầu vào video (V), câu hỏi (Q) và câu trả lời (A). Màu sắc mát mẻ cho thấy sự đóng góp mạnh mẽ hơn; màu sắc ấm cho thấy sự ảnh hưởng yếu hoặc không đáng kể. Trên hầu hết các thiết lập, ngôn ngữ rõ ràng là thống trị, với video thường bị bỏ qua – đặc biệt là trong ảnh hưởng theo từng khung hình.

Về văn bản, câu hỏi có xu hướng quan trọng hơn câu trả lời, đặc biệt là trong các mô hình mạnh hơn. Điều này rõ ràng nhất trong các tập dữ liệu như EgoSchema, nơi câu hỏi dài hơn và tự nhiên hơn, trong khi câu trả lời ngắn và đôi khi là sơ đồ.

Trên tất cả các mô hình và tập dữ liệu, tuy nhiên, tầm nhìn luôn bị bỏ qua, với ngôn ngữ thực hiện hầu hết công việc nặng nhọc.

Bài báo tuyên bố:

‘[Đối với] các mô hình ngữ cảnh dài, video cho thấy sự đóng góp giảm đáng kể, có nghĩa là theo từng khung hình, các giá trị Shapley nhỏ hơn nhiều so với các tính năng văn bản tương ứng của chúng.

‘Video như một phương thức tổng thể vẫn rõ ràng là rất quan trọng, nhưng điều này cho thấy rằng các giá trị Shapley của các khung hình riêng lẻ của nó tập trung nhiều hơn xung quanh zero, và sự chú ý của mô hình đến chúng được hướng dẫn ít hơn so với văn bản.’

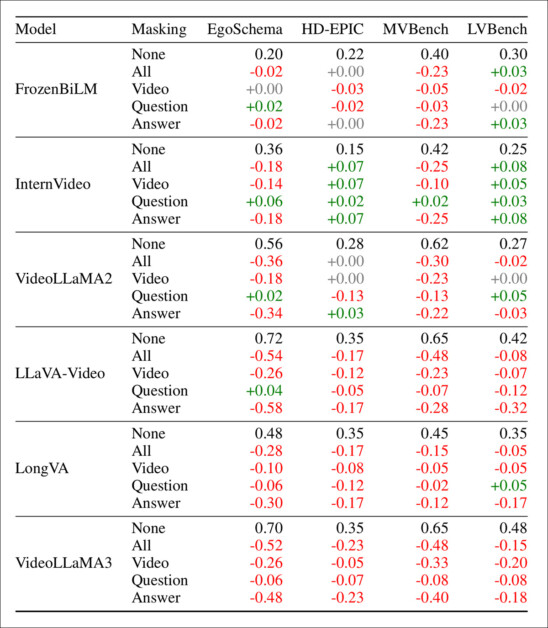

Để kiểm tra mức độ mỗi phần đầu vào đóng góp vào độ chính xác của mô hình, các nhà nghiên cứu đã tiến hành các bài kiểm tra bổ sung bằng cách sử dụng che giấu – che giấu một hoặc nhiều phần của đầu vào và xem độ chính xác của mô hình thay đổi như thế nào khi kết quả.

Nếu hiệu suất giảm mạnh khi một phần đầu vào cụ thể bị loại bỏ, phần đó có khả năng quan trọng; nếu mô hình hoạt động tương tự, điều đó cho thấy phần bị thiếu không được dựa vào nhiều. Trong ý nghĩa này, các bài kiểm tra che giấu là một loại nghiên cứu cắt giảm lặp lại.

Tác động hiệu suất của việc che giấu đầu vào video, câu hỏi hoặc câu trả lời trên bốn điểm chuẩn VQA. Điểm cho thấy sự thay đổi từ baseline không che giấu. Màu đỏ cho thấy độ chính xác thấp hơn, màu xanh lá cây cho thấy độ chính xác cao hơn. Các mô hình thường giữ được điểm số cao mà không có video, nhưng mất nhiều hơn khi câu trả lời (văn bản) bị loại bỏ. Câu hỏi thường có thể bị che giấu với hiệu ứng tối thiểu.

Kết quả (được minh họa ở trên) cho thấy rằng câu trả lời (câu trả lời văn bản trong dữ liệu nhiều lựa chọn) mang lại trọng lượng lớn nhất trên toàn bộ. Che giấu câu trả lời thường gây ra sự giảm độ chính xác lớn nhất, thường giảm mô hình xuống hiệu suất gần như ngẫu nhiên.

Tuy nhiên, che giấu câu hỏi thường có ít tác động hơn, điều này hỗ trợ phát hiện trước đó rằng mô hình thường đánh giá thấp câu hỏi.

Trong một số trường hợp, độ chính xác thậm chí còn được cải thiện khi câu hỏi bị loại bỏ, điều này ngụ ý rằng mô hình đôi khi chỉ khớp câu trả lời với các gợi ý văn bản hoặc hình ảnh mà không thực sự đánh giá câu hỏi.

Các mô hình cũng khác nhau về sự phụ thuộc vào video: một số duy trì độ chính xác hợp lý mà không có nó, xác nhận thêm sự đóng góp hạn chế của các tính năng video trong nhiều thiết lập hiện tại.

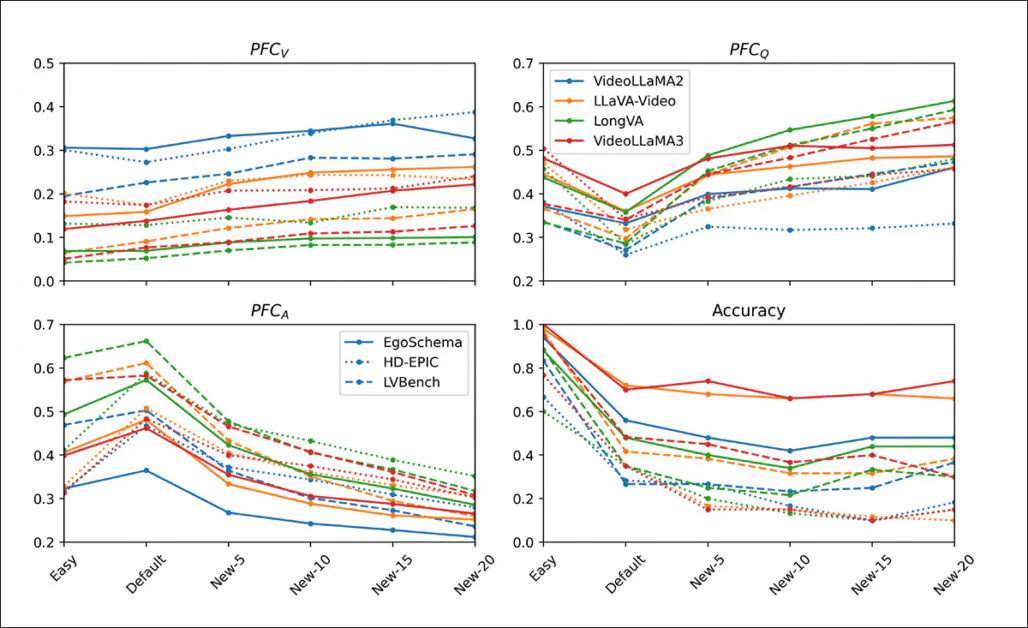

Các tác giả sau đó đã kiểm tra xem các mô hình có thể bị ép buộc phụ thuộc vào video bằng cách thêm các câu trả lời sai vào các tùy chọn nhiều lựa chọn.

Khi các câu trả lời sai dễ dàng và được tái sử dụng từ các câu hỏi khác, hiệu suất được cải thiện, vì các mô hình khớp các mẫu văn bản mà không cần nhiều lý luận. Nhưng với mười hoặc nhiều câu trả lời không liên quan, chúng bắt đầu phụ thuộc nhiều hơn vào video và câu hỏi:

Đóng góp tính năng và độ chính xác cho đầu vào video, câu hỏi và câu trả lời, khi thêm các câu trả lời sai vào mỗi bài kiểm tra VQA, cho thấy rằng việc tăng số lượng câu trả lời sai làm giảm sự thống trị của văn bản và tăng sự ảnh hưởng tương đối của các tính năng hình ảnh và câu hỏi.

Đối với VideoLLaMA3, che giấu video làm giảm độ chính xác xuống 40% trên EgoSchema và 15% trên LVBench, cho thấy rằng một sự tăng đơn giản trong số lượng câu trả lời có thể chuyển mô hình khỏi các đường tắt văn bản và hướng tới lý luận đa phương thức thực sự.

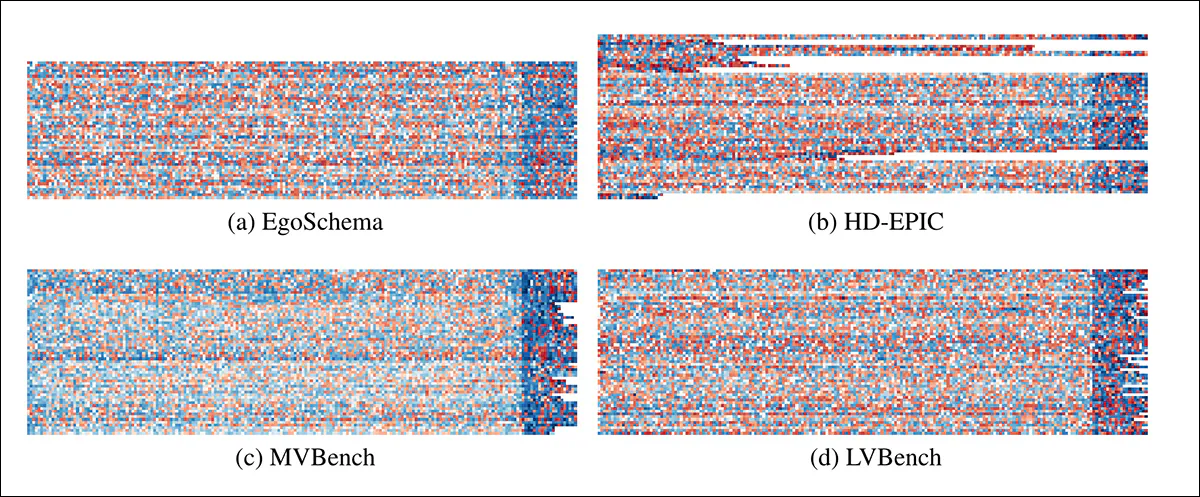

Các nhà nghiên cứu cũng đã khám phá cách phân bổ thuộc tính trên các đầu vào, và dưới đây chúng ta thấy các bản đồ nhiệt của các giá trị Shapley cho mỗi đầu vào mô hình:

Bản đồ nhiệt giá trị Shapley cho bốn tập dữ liệu, nơi mỗi hàng cho thấy một cặp VQA, và mỗi cột cho một tính năng duy nhất. Các tính năng video xuất hiện ở bên trái, tiếp theo là văn bản. Các giá trị mạnh hơn trong các khu vực văn bản (đỏ) xác nhận rằng mô hình phụ thuộc nhiều hơn vào ngôn ngữ hơn là video.

Nhận xét về kết quả trên, các tác giả tuyên bố:

‘Độ lớn của các giá trị Shapley lớn hơn nhiều về phía bên phải của mỗi bản đồ nhiệt, đại diện cho sự đóng góp của câu hỏi và câu trả lời. Đường ranh giới rõ ràng này là nơi các khung hình video kết thúc và các tính năng văn bản bắt đầu, cho thấy rằng đóng góp của phương thức video ít hơn nhiều so với câu hỏi / câu trả lời. ‘

Tóm lại, trên tất cả các tập dữ liệu, các giá trị mạnh hơn về phía cuối của phổ, cho thấy rằng mô hình phụ thuộc nhiều hơn vào ngôn ngữ hơn là các gợi ý thị giác. Ngay cả khi video được sử dụng, sự đóng góp được phân tán mỏng trên nhiều khung hình, thường không có mẫu nhất quán.

Dưới đây chúng ta thấy một ví dụ được chú thích từ EgoSchema. 16 khung hình “quan trọng” nhất được chọn bằng cách sử dụng giá trị Shapley và được tô màu theo mức độ ảnh hưởng của chúng, với màu xanh lam cho thấy sự đóng góp tích cực và màu đỏ cho thấy sự đóng góp tiêu cực:

Giá trị Shapley cho một ví dụ EgoSchema duy nhất, cho thấy 16 khung hình ảnh hưởng nhất và tất cả đầu vào văn bản. Đóng góp video tối thiểu so với văn bản, chiếm ưu thế trong lý luận của mô hình. Màu xanh lam và đỏ cho thấy sự ảnh hưởng tích cực và tiêu cực đến câu trả lời được chọn.

Kết quả là gần như mọi khung hình đều có ảnh hưởng yếu so với các từ trong câu hỏi và câu trả lời. Các gợi ý thị giác thưa thớt và không nhất quán, trong khi các danh từ như ‘ghế’ và ‘hàng rào’ hướng mô hình đến lựa chọn chính xác – hoặc tránh nó, tùy thuộc vào ngữ cảnh.

Kết Luận

Bất kỳ ai từng tham gia chỉnh sửa video hoặc phân tích video đều biết rằng những quá trình này tốn nhiều tài nguyên như thế nào, và hiểu tại sao các công ty phân tích hàng triệu yêu cầu AI mỗi ngày không thể cho phép người dùng chạy các quy trình chỉnh sửa và giải thích video một cách tùy tiện.

Một điều cần nhớ trong khía cạnh này là gần như mọi giao diện API AI bạn sẽ thử (ngoài một bản demo mới và ngắn hạn để hỗ trợ nghiên cứu khoa học mới) đều nhằm mục đích thực hiện mong muốn của người dùng ở mức chi tiêu tài nguyên tối thiểu.

Điều đó có nghĩa là dựa vào siêu dữ liệu hiện có từ dữ liệu người dùng hoặc RAG truy xuất, nếu có thể; và trích xuất (nếu cần thiết) siêu dữ liệu cho các định dạng dễ phân tích hơn như PDF, tài liệu và hình ảnh đơn.

Điều không nằm trong kế hoạch là chạy video tải lên của bạn qua CLIP hoặc phiên bản YOLO mới nhất, hoặc qua bất kỳ mô hình VLM nào tốn nhiều tài nguyên và thời gian có thể xác định được những gì trong khung hình và hiểu những gì đang xảy ra trong video được cung cấp, tính đến tính thời gian.

Tuy nhiên, điều này không có nghĩa là hiện tượng mà bài báo hiện tại ghi lại nhất thiết phải bắt nguồn từ các phương pháp kiến trúc tiết kiệm. Các tác giả quan sát rằng văn bản thống trị các mô hình đào tạo đa phương thức hiện tại, cho thấy rằng ‘ngôn ngữ thị giác’ ít được phát triển, ít quan trọng hoặc thông tin trong một ngữ cảnh đa phương thức, hoặc (ít nhất là hiện tại) ít được hiểu rõ,

* Đáng chú ý, tài liệu mà NotebookLM đưa ra dường như hoàn toàn nguyên bản hoặc không được lập chỉ mục bởi Google, vì tôi không thể tìm thấy bất kỳ kết quả nào trên web có thể đã lọt vào dữ liệu đào tạo và kích hoạt đầu ra này.

Được xuất bản lần đầu vào Thứ Sáu, ngày 31 tháng 10 năm 2025; chỉnh sửa 14:20 để định dạng