Góc nhìn Anderson

Đưa ra các So sánh Tương tự về Hình ảnh cho Trí tuệ Nhân tạo

Các mô hình Trí tuệ Nhân tạo hiện tại không thể nhận ra sự tương tự ‘quan hệ’ giữa các hình ảnh, chẳng hạn như sự tương tự giữa các lớp của Trái đất và một quả đào, thiếu một khía cạnh quan trọng của cách con người nhận thức hình ảnh.

Mặc dù có nhiều mô hình thị giác máy tính có khả năng so sánh hình ảnh và tìm kiếm sự tương tự giữa chúng, thế hệ hệ thống so sánh hiện tại có rất ít hoặc không có khả năng tưởng tượng. Hãy xem xét một số lời bài hát trong bài hát kinh điển những năm 1960, Windmills of Your Mind:

Giống như một chiếc xe điện đang quay, chạy vòng quanh mặt trăng

Giống như một chiếc đồng hồ mà tay đang quay qua các phút trên mặt đồng hồ

Và thế giới giống như một quả táo quay im lặng trong không gian

Các so sánh loại này đại diện cho một lĩnh vực liên quan đến ẩn dụ thơ ca, có ý nghĩa đối với con người theo cách vượt xa biểu đạt nghệ thuật; hơn thế, nó gắn liền với cách chúng ta phát triển hệ thống nhận thức; khi chúng ta tạo ra ‘lĩnh vực đối tượng’ của mình, chúng ta phát triển khả năng tương tự về hình ảnh, để – ví dụ – các mặt cắt thể hiện một quả đào và hành tinh Trái đất, hoặc các hồi quy fractal như xoắn ốc cà phê và nhánh thiên hà, đăng ký như tương tự với chúng ta.

Bằng cách này, chúng ta có thể suy luận các kết nối giữa các đối tượng và loại đối tượng không liên quan rõ ràng, và suy luận hệ thống (chẳng hạn như trọng lực, động lượng và độ kết dính bề mặt) có thể áp dụng cho nhiều lĩnh vực ở nhiều quy mô khác nhau.

Nhìn thấy Điều gì

Ngay cả thế hệ mới nhất của các hệ thống so sánh hình ảnh Trí tuệ Nhân tạo, chẳng hạn như Tương tự Hình ảnh Nhận thức Học được (LPIPS) và DINO, được thông báo bởi phản hồi của con người, chỉ thực hiện các so sánh bề mặt theo nghĩa đen.

Khả năng tìm kiếm khuôn mặt ở nơi không có – tức là pareidolia – không đại diện cho loại cơ chế tương tự về hình ảnh mà con người phát triển, mà xảy ra vì các thuật toán tìm kiếm khuôn mặt sử dụng các tính năng cấu trúc khuôn mặt cấp thấp các tính năng đôi khi phù hợp với các đối tượng ngẫu nhiên:

Ví dụ về dương tính giả cho nhận dạng khuôn mặt trong tập dữ liệu ‘Khuôn mặt với Điều gì’. Nguồn

Để xác định liệu máy móc có thể thực sự phát triển khả năng tưởng tượng của chúng ta để nhận ra sự tương tự về hình ảnh trên các lĩnh vực, các nhà nghiên cứu ở Mỹ đã thực hiện một nghiên cứu về Tương tự Hình ảnh Quan hệ, thu thập và đào tạo một tập dữ liệu mới được thiết kế để buộc các mối quan hệ trừu tượng hình thành giữa các đối tượng khác nhau nhưng vẫn gắn liền với một mối quan hệ trừu tượng:

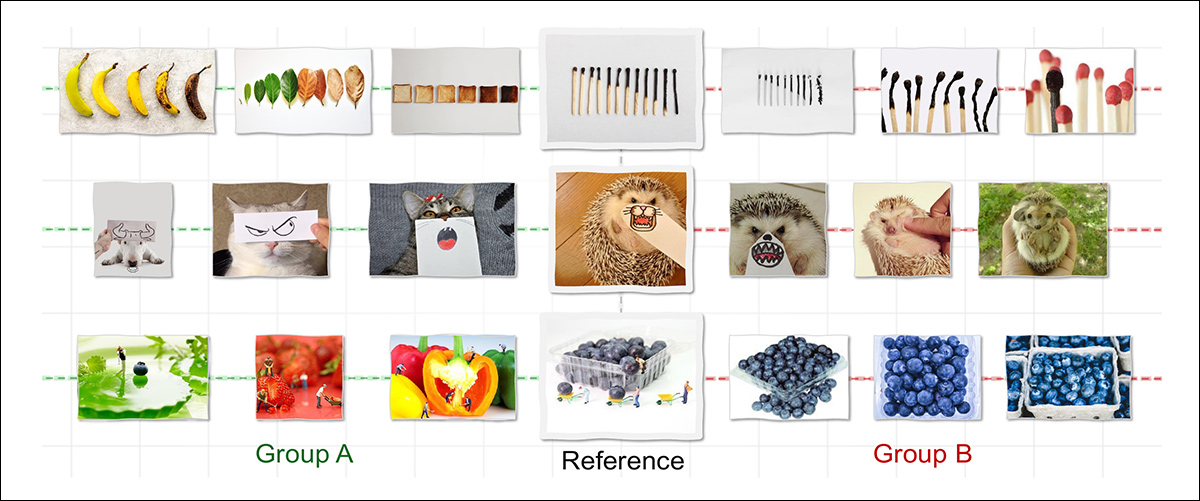

Hầu hết các mô hình Trí tuệ Nhân tạo chỉ nhận ra sự tương tự khi hình ảnh chia sẻ các đặc điểm bề mặt như hình dạng hoặc màu sắc, đó là lý do tại sao chúng chỉ liên kết nhóm B (trên) với hình ảnh tham chiếu. Con người, ngược lại, cũng coi nhóm A là tương tự – không phải vì hình ảnh trông giống nhau, mà vì chúng tuân theo cùng một logic cơ bản, chẳng hạn như thể hiện một sự thay đổi theo thời gian. Công việc mới này cố gắng tái tạo loại tương tự cấu trúc hoặc quan hệ này, nhằm đưa nhận thức máy móc gần hơn với lý luận của con người. Nguồn: https://arxiv.org/pdf/2512.07833

Hệ thống chú thích được phát triển cho tập dữ liệu này cho phép các chú thích trừu tượng bất thường, được thiết kế để buộc các hệ thống Trí tuệ Nhân tạo tập trung vào các đặc điểm cơ bản hơn là các chi tiết cục bộ cụ thể:

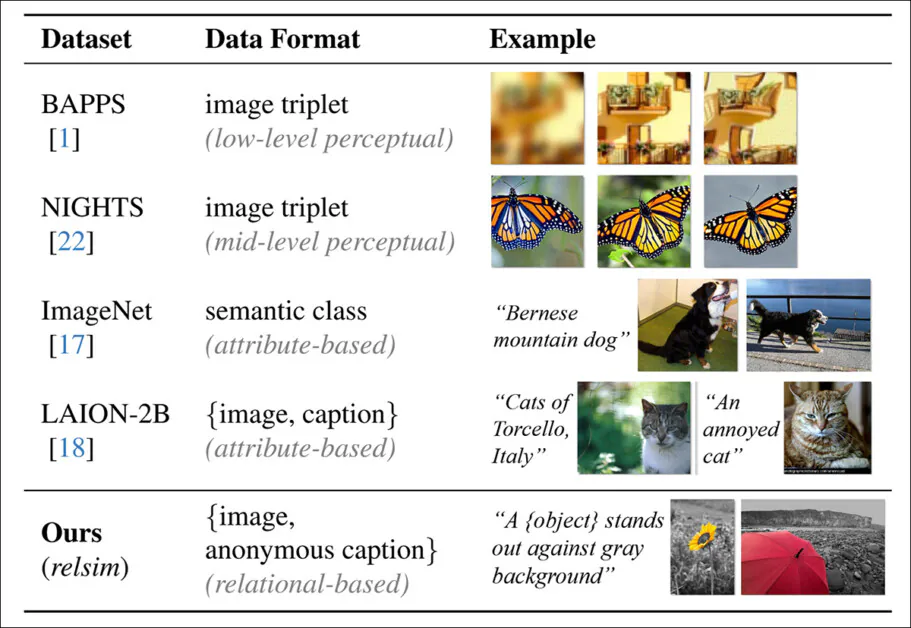

Các chú thích ‘nặc danh’ dự đoán đóng góp cho số liệu ‘relsim’ của tác giả.

Tập dữ liệu được thu thập và phong cách chú thích không phổ biến này thúc đẩy số liệu mới được đề xuất relsim, mà các tác giả đã tinh chỉnh thành một mô hình ngôn ngữ-hình ảnh (VLM).

So sánh giữa phong cách chú thích của các tập dữ liệu thông thường, tập trung vào sự tương tự thuộc tính, trong khi phương pháp relsim (hàng dưới) nhấn mạnh sự tương tự quan hệ.

Phương pháp mới này dựa trên các phương pháp từ khoa học nhận thức, đặc biệt là lý thuyết Đồng cấu trúc (một nghiên cứu về ẩn dụ) của Dedre Gentner và định nghĩa về sự tương tự quan hệ và thuộc tính của Amos Tversky.

Từ trang web dự án liên quan, một ví dụ về sự tương tự quan hệ. Nguồn

Các tác giả tuyên bố:

‘[Con người] xử lý sự tương tự thuộc tính một cách nhận thức, nhưng sự tương tự quan hệ đòi hỏi phải trừu tượng hóa khái niệm, thường được hỗ trợ bởi ngôn ngữ hoặc kiến thức trước đó. Điều này cho thấy rằng việc nhận ra sự tương tự quan hệ trước tiên đòi hỏi phải hiểu hình ảnh, dựa vào kiến thức và trừu tượng hóa cấu trúc cơ bản của nó.’

Bài báo mới có tiêu đề Tương tự Hình ảnh Quan hệ, và đi kèm với một trang web dự án (xem video nhúng ở cuối bài viết).

Phương pháp

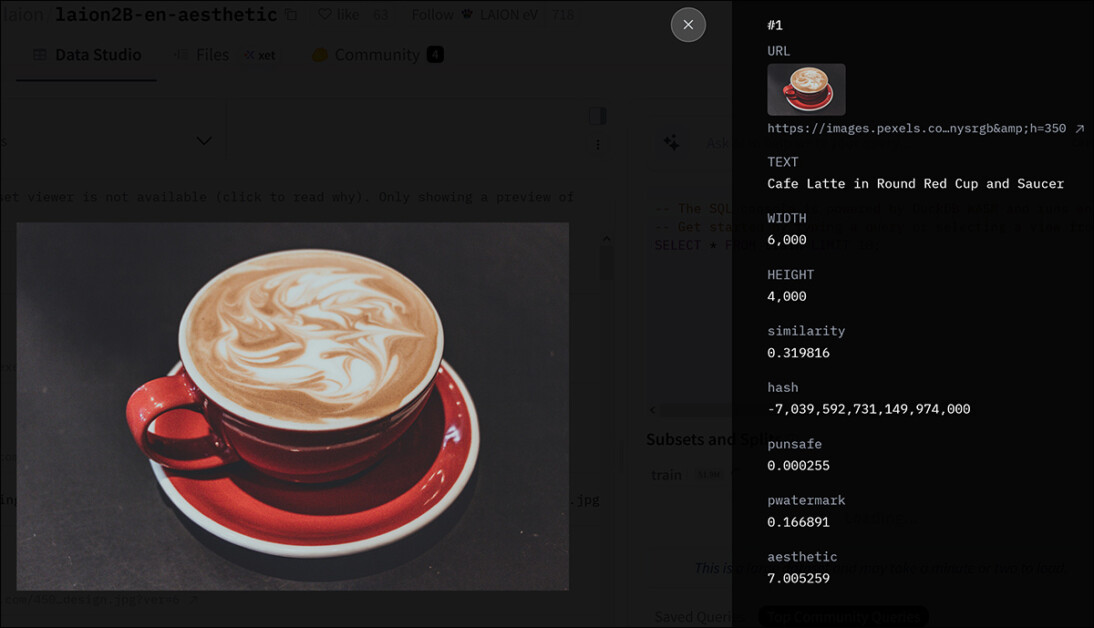

Các nhà nghiên cứu đã sử dụng một trong những tập dữ liệu siêu quy mô nổi tiếng nhất làm điểm xuất phát cho bộ sưu tập của họ – LAION-2B:

Thành phần siêu dữ liệu cho một mục trong tập LAION-2B. Nguồn

114.000 hình ảnh có khả năng chứa cấu trúc quan hệ đàn hồi đã được trích xuất từ LAION-2B, bao gồm việc lọc nhiều hình ảnh chất lượng thấp có trong tập dữ liệu được quản lý tối thiểu.

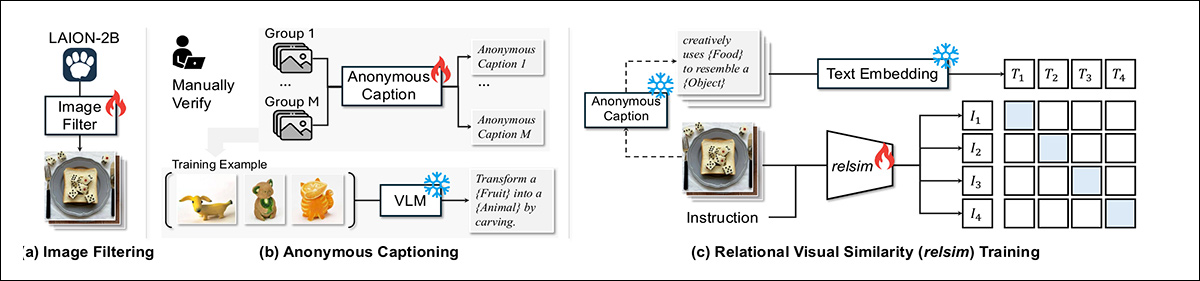

Để tạo một đường ống cho quá trình chọn lọc này, các tác giả đã sử dụng Qwen2.5-VL-7B, tận dụng 1.300 ví dụ được dán nhãn tích cực và 11.000 ví dụ được dán nhãn tiêu cực của con người:

Hệ thống relsim được đào tạo trong ba giai đoạn: lọc hình ảnh từ LAION-2B cho nội dung quan hệ; gán cho mỗi nhóm một chú thích nặc danh chung mà nắm bắt logic cơ bản của chúng; và học cách khớp hình ảnh với các chú thích đó bằng cách sử dụng sự mất mát tương phản.

Bài báo tuyên bố:

‘Các người chú thích được hướng dẫn: “Bạn có thể nhìn thấy bất kỳ mẫu quan hệ, logic hoặc cấu trúc nào trong hình ảnh này có thể hữu ích cho việc tạo hoặc liên kết đến một hình ảnh khác không?”. Mô hình tinh chỉnh đạt được 93% thỏa thuận với các phán quyết của con người, và khi áp dụng cho LAION-2B, nó cho ra N = 114k hình ảnh được xác định là quan hệ thú vị.’

Để tạo nhãn quan hệ, các nhà nghiên cứu đã yêu cầu mô hình Qwen mô tả logic chung đằng sau các tập hợp hình ảnh mà không đặt tên cho các đối tượng cụ thể. Sự trừu tượng này khó có thể đạt được khi mô hình chỉ nhìn thấy một hình ảnh, nhưng trở nên khả thi khi nhiều ví dụ thể hiện mẫu cơ bản.

Các chú thích cấp nhóm kết quả thay thế các thuật ngữ cụ thể bằng các giá trị thay thế như ‘{Chủ thể}’ hoặc ‘{Loại chuyển động}’, khiến chúng có thể áp dụng rộng rãi.

Sau khi xác minh của con người, mỗi chú thích được ghép với tất cả hình ảnh trong nhóm của nó. Hơn 500 nhóm như vậy đã được sử dụng để đào tạo mô hình, sau đó được áp dụng cho 114.000 hình ảnh đã lọc để tạo ra một tập hợp lớn các mẫu được chú thích quan hệ trừu tượng.

Dữ liệu và Kiểm tra

Sau khi trích xuất các đặc điểm quan hệ bằng Qwen2.5-VL-7B, một mô hình đã được tinh chỉnh trên dữ liệu bằng cách sử dụng LoRA, trong 15.000 bước, thông qua tám GPU A100*. Đối với phía văn bản, các chú thích quan hệ được nhúng bằng cách sử dụng all-MiniLM-L6-v2 từ Thư viện Sentence-Transformers.

Tập dữ liệu 114.000 hình ảnh được chú thích đã được chia thành 100.000 cho đào tạo và 14.000 cho đánh giá. Để kiểm tra hệ thống, một thiết lập truy xuất đã được sử dụng: cho một hình ảnh truy vấn, mô hình phải tìm một hình ảnh khác từ một nhóm 28.000 mục mà thể hiện cùng một ý tưởng quan hệ. nhóm truy xuất bao gồm 14.000 hình ảnh đánh giá và 14.000 mẫu bổ sung từ LAION-2B, với 1.000 truy vấn được chọn ngẫu nhiên từ tập đánh giá để tạo điểm chuẩn.

Để đánh giá chất lượng truy xuất, GPT-4o đã được sử dụng để đánh giá sự tương tự quan hệ giữa mỗi truy vấn và hình ảnh được truy xuất trên thang điểm từ 0 đến 10. Một nghiên cứu của con người riêng biệt cũng được thực hiện để đo lường sự ưu tiên của người dùng (xem dưới đây).

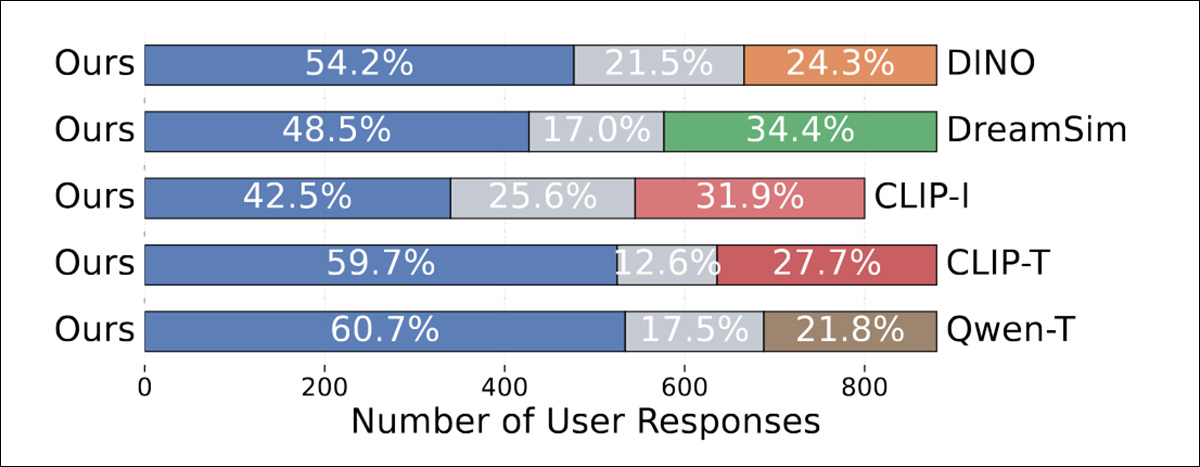

Mỗi người tham gia được hiển thị một hình ảnh truy vấn nặc danh với hai ứng cử viên, một được truy xuất bởi phương pháp được đề xuất và ứng cử viên khác bởi một đường cơ sở. Người tham gia được yêu cầu xác định hình ảnh nào tương tự quan hệ hơn với truy vấn, hoặc nếu cả hai đều gần như nhau. Đối với mỗi đường cơ sở, 300 bộ ba đã được tạo và đánh giá bởi ít nhất ba người mỗi bộ, cho ra khoảng 900 phản hồi.

Phương pháp relsim đã được so sánh với một số phương pháp tương tự hình ảnh đến hình ảnh đã được thiết lập, bao gồm cả dreamsim và CLIP-I. Ngoài các đường cơ sở tính toán trực tiếp điểm số tương tự giữa các cặp hình ảnh, chẳng hạn như LPIPS, DINO, dreamsim và CLIP-I, các tác giả cũng đã kiểm tra các phương pháp dựa trên chú thích, trong đó Qwen được sử dụng để tạo một chú thích nặc danh hoặc trừu tượng cho mỗi hình ảnh.; điều này sau đó đóng vai trò là truy vấn truy xuất.

Hai biến thể truy xuất đã được đánh giá, với truy xuất hình ảnh đến văn bản CLIP (CLIP-T) được sử dụng cho truy xuất văn bản đến hình ảnh, và Qwen-T sử dụng truy xuất văn bản đến văn bản. Cả hai đường cơ sở dựa trên chú thích đều sử dụng mô hình Qwen được đào tạo trước thay vì phiên bản được tinh chỉnh trên logic quan hệ. Điều này cho phép các tác giả cô lập hiệu ứng của đào tạo dựa trên nhóm, vì mô hình tinh chỉnh đã được tiếp xúc với các tập hợp hình ảnh, chứ không phải các ví dụ riêng lẻ.

Các Chỉ số Hiện có và Tương tự Quan hệ

Các tác giả ban đầu đã kiểm tra xem các chỉ số hiện có có thể bắt được sự tương tự quan hệ:

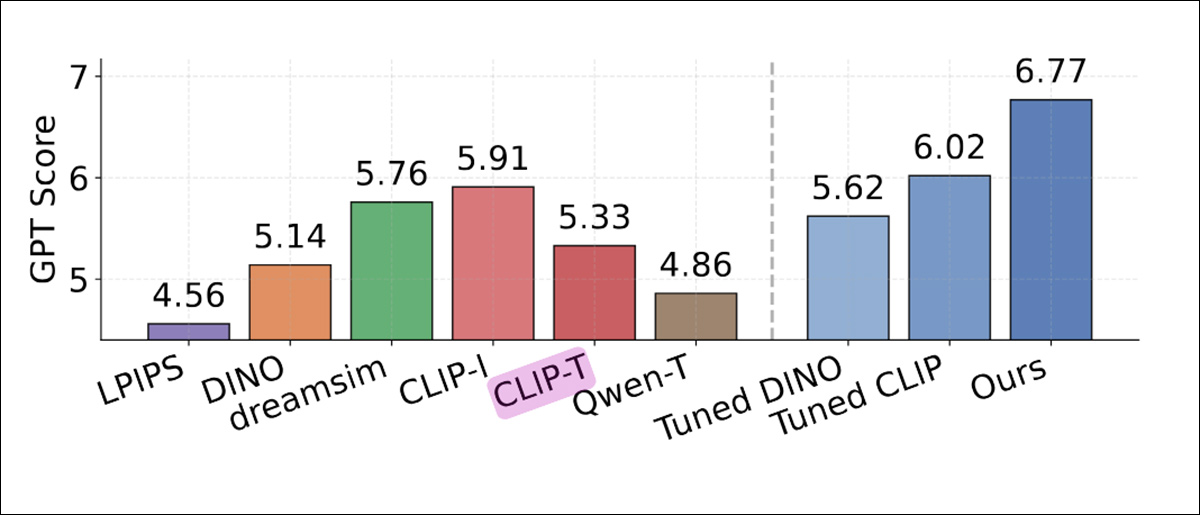

So sánh hiệu suất truy xuất như được phán quyết bởi GPT-4o, cho thấy điểm số tương tự quan hệ trung bình cho mỗi phương pháp. Các chỉ số tương tự thông thường như LPIPS, DINO và CLIP-I đạt điểm thấp hơn. Các đường cơ sở dựa trên chú thích Qwen-T và CLIP-T cũng đạt hiệu suất thấp hơn. Điểm số cao nhất được đạt được bởi relsim (6,77, cột xanh bên phải), cho thấy rằng việc tinh chỉnh trên các mẫu quan hệ dựa trên nhóm đã cải thiện sự phù hợp với các đánh giá của GPT-4o.

Về những kết quả này, các tác giả tuyên bố**:

‘[LPIPS], tập trung hoàn toàn vào sự tương tự nhận thức, đạt được điểm số thấp nhất (4,56). [DINO] hoạt động tốt hơn một chút (5,14), có thể vì nó được đào tạo hoàn toàn theo cách tự giám sát trên dữ liệu hình ảnh. [CLIP-I] cho ra kết quả mạnh nhất trong số các đường cơ sở (5,91), có lẽ vì một số trừu tượng hóa đôi khi có mặt trong các chú thích hình ảnh.

‘Tuy nhiên, CLIP-I vẫn đạt hiệu suất thấp hơn so với phương pháp của chúng tôi, vì việc đạt được điểm số tốt hơn có thể đòi hỏi khả năng đạt được trừu tượng hóa ở cấp độ cao hơn, chẳng hạn như những gì có trong các chú thích nặc danh.’

Trong nghiên cứu của con người, con người nhất quán ưu tiên phương pháp relsim trên tất cả các đường cơ sở:

Điểm số tương tự quan hệ được GPT-4o phân bổ cho mỗi phương pháp. Các chỉ số tương tự thông thường như LPIPS, DINO và CLIP-I đạt điểm thấp hơn, và các biến thể dựa trên chú thích Qwen-T và CLIP-T hoạt động tốt hơn một chút. Thậm chí các phiên bản tinh chỉnh của DINO và CLIP cũng không thể thu hẹp khoảng cách. Điểm số cao nhất, 6,77, được đạt được bởi mô hình được đề xuất, được đào tạo với giám sát dựa trên nhóm.

Các tác giả lưu ý:

‘Điều này rất đáng khích lệ, vì nó chứng tỏ không chỉ rằng mô hình của chúng tôi, relsim, có thể thành công trong việc truy xuất hình ảnh tương tự quan hệ, mà còn một lần nữa xác nhận rằng con người thực sự nhận thức được sự tương tự quan hệ – không chỉ là sự tương tự thuộc tính!’

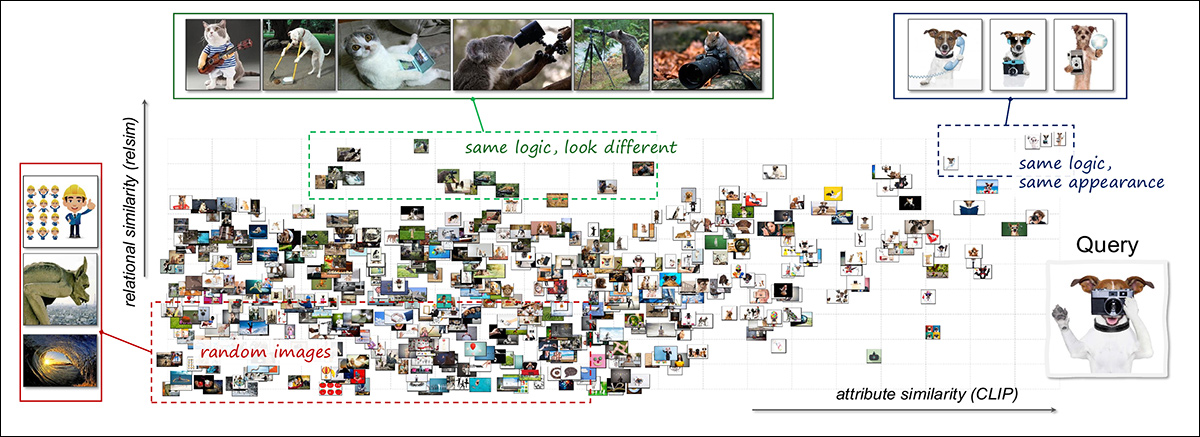

Để khám phá cách sự tương tự quan hệ và thuộc tính có thể bổ sung cho nhau, các nhà nghiên cứu đã sử dụng một phương pháp trực quan hóa kết hợp. Một hình ảnh truy vấn duy nhất (‘Một con chó đang cầm máy ảnh’) đã được so sánh với 3.000 hình ảnh ngẫu nhiên, và sự tương tự được tính toán bằng cách sử dụng cả mô hình quan hệ và thuộc tính:

Trực quan hóa không gian tương tự hình ảnh bằng cách sử dụng các trục quan hệ và thuộc tính. Một hình ảnh truy vấn duy nhất, mô tả một con chó sử dụng máy ảnh, đã được so sánh với 3.000 hình ảnh khác. Kết quả được tổ chức theo sự tương tự quan hệ (theo chiều dọc) và sự tương tự thuộc tính (theo chiều ngang). Vùng phía trên bên phải chứa hình ảnh trông giống với truy vấn về cả logic và ngoại hình, chẳng hạn như các con chó khác sử dụng công cụ. Vùng phía trên bên trái chứa các trường hợp liên quan về mặt ngữ nghĩa nhưng khác biệt về mặt trực quan, chẳng hạn như các loài động vật khác thực hiện các hành động liên quan đến máy ảnh. Hầu hết các ví dụ còn lại nhóm lại thấp hơn trong không gian, phản ánh sự tương tự yếu hơn. Bố cục minh họa cách các mô hình quan hệ và thuộc tính làm nổi bật các khía cạnh bổ sung của dữ liệu hình ảnh. Vui lòng tham khảo bài báo nguồn để có độ phân giải tốt hơn.

Kết quả cho thấy các nhóm tương ứng với các loại tương tự khác nhau: một số hình ảnh cả tương tự quan hệ và trực quan; những hình ảnh khác chia sẻ logic quan hệ nhưng không phải ngoại hình; phần còn lại không có sự tương tự nào.

Phân tích này cho thấy rằng hai loại tương tự này phục vụ các vai trò riêng biệt và tạo ra cấu trúc phong phú hơn khi kết hợp.

Trường hợp Sử dụng

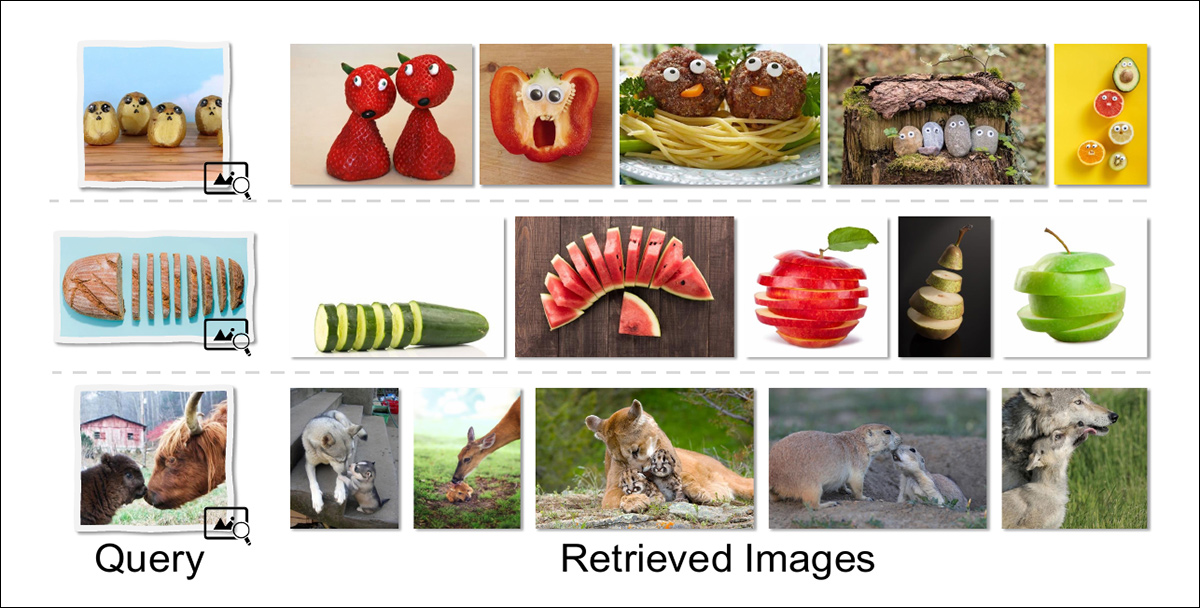

Bài báo cũng khám phá một số trường hợp sử dụng có thể có cho sự tương tự quan hệ, bao gồm truy xuất hình ảnh quan hệ, cho phép tìm kiếm hình ảnh phù hợp hơn với cách sáng tạo của con người khi nhìn vào thế giới:

Truy xuất quan hệ trả về hình ảnh chia sẻ một cấu trúc khái niệm sâu sắc hơn với truy vấn, thay vì khớp với các đặc điểm bề mặt. Ví dụ, một món ăn được thiết kế để giống một khuôn mặt sẽ tìm thấy các bữa ăn nhân hóa khác; một vật thể được cắt lát sẽ tìm thấy các hình dạng cắt lát khác; và các cảnh tương tác giữa bố mẹ và con cái sẽ trả về hình ảnh có vai trò quan hệ tương tự, ngay cả khi loài và thành phần khác nhau.

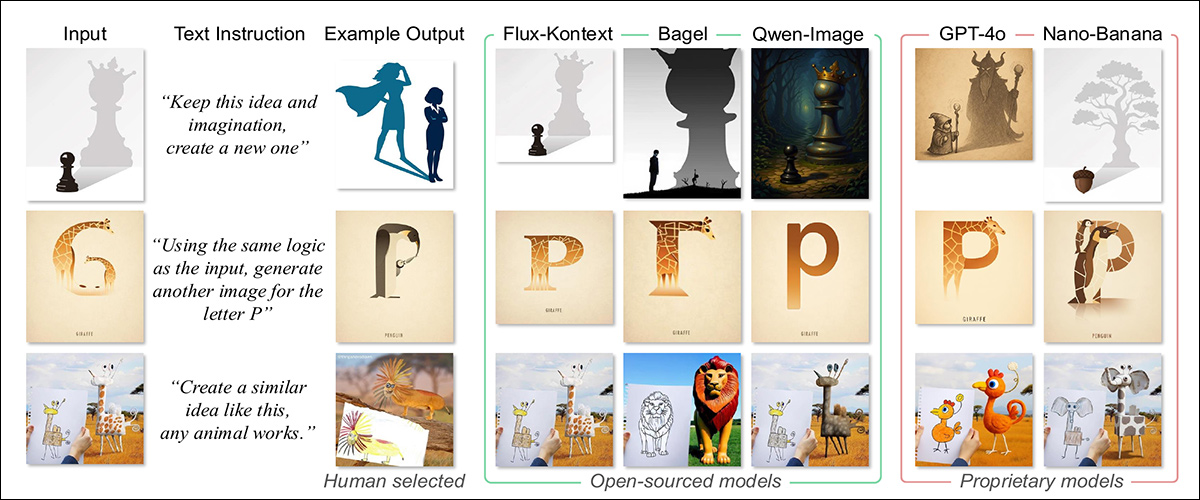

Một khả năng khác là sự tạo ra hình ảnh tương tự, cho phép tổng hợp các truy vấn sử dụng cấu trúc quan hệ thay vì mô tả trực tiếp. Trong một so sánh kết quả thu được từ thế hệ hiện tại của các mô hình văn bản đến hình ảnh, chúng ta có thể thấy rằng kết quả của một phương pháp như vậy có khả năng đa dạng hơn:

Cho một hình ảnh đầu vào và một lời nhắc quan hệ, các mô hình được yêu cầu tạo ra một hình ảnh mới thể hiện cùng một khái niệm cơ bản. Các mô hình độc quyền tạo ra các ẩn dụ trung thành hơn, bảo tồn logic cấu trúc trên các thay đổi lớn về hình thức, và các mô hình mã nguồn mở có xu hướng suy giảm thành các trận đấu theo nghĩa đen hoặc phong cách, không thể chuyển giao ý tưởng sâu sắc. Đầu ra được so sánh với các ẩn dụ được con người kiểm tra, thể hiện sự chuyển đổi dự định.

Kết luận

Các hệ thống Trí tuệ Nhân tạo tạo ra sẽ, có vẻ như, được nâng cao đáng kể bởi khả năng kết hợp đại diện trừu tượng vào các khái niệm hóa của chúng. Như nó đứng, việc yêu cầu hình ảnh dựa trên khái niệm như ‘tức giận’ hoặc ‘hạnh phúc’ có xu hướng trả về hình ảnh được tạo kiểu từ các hình ảnh phổ biến hoặc đông đảo nhất có những liên kết này trong tập dữ liệu; điều này là nhớ thay vì trừu tượng hóa.

Có lẽ nguyên tắc này có thể thậm chí còn có lợi nếu nó có thể được áp dụng cho việc viết tạo ra – đặc biệt là đầu ra phân tích, suy đoán hoặc hư cấu.

Nhấn để phát. Nguồn

* Một A100 có thể có 40Gb hoặc 80GB VRAM; điều này không được chỉ định trong bài báo.

** Các trích dẫn của tác giả bị trùng lặp và bị loại bỏ.

Được xuất bản lần đầu vào Thứ Ba, ngày 16 tháng 12 năm 2025