Trí tuệ nhân tạo

EAGLE: Khám phá Không gian Thiết kế cho Mô hình Ngôn ngữ Lớn Đa phương thức với Hỗn hợp Mã hóa

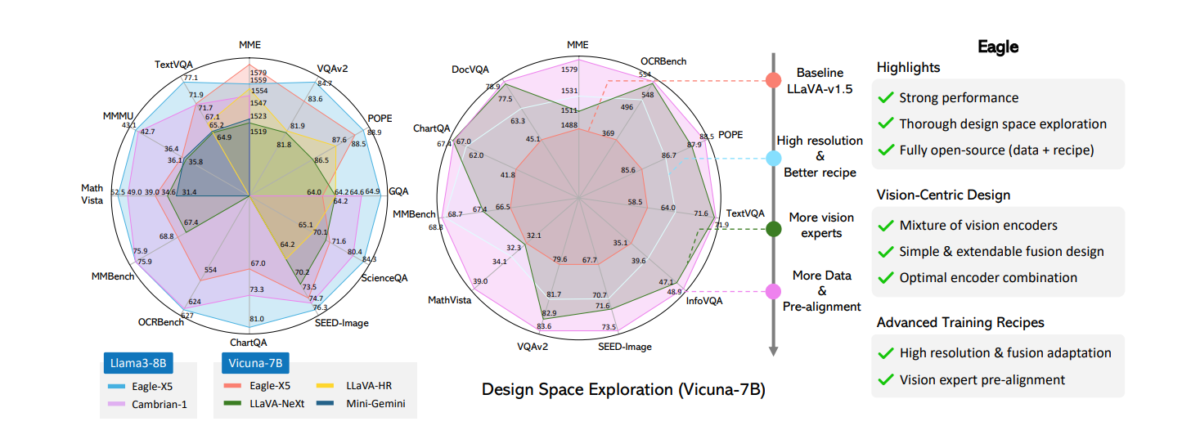

Khả năng diễn giải chính xác thông tin hình ảnh phức tạp là một焦 điểm quan trọng của mô hình ngôn ngữ lớn đa phương thức (MLLMs). Các công việc gần đây cho thấy rằng việc tăng cường nhận thức thị giác đáng kể làm giảm ảo giác và cải thiện hiệu suất trên các nhiệm vụ nhạy cảm với độ phân giải, chẳng hạn như nhận dạng ký tự quang học và phân tích tài liệu. Một số MLLM gần đây đạt được điều này bằng cách sử dụng hỗn hợp mã hóa thị giác. Mặc dù chúng đã thành công, nhưng vẫn còn thiếu so sánh hệ thống và nghiên cứu cắt giảm chi tiết về các khía cạnh quan trọng, chẳng hạn như lựa chọn chuyên gia và tích hợp nhiều chuyên gia thị giác. Bài viết này cung cấp một cuộc khám phá rộng rãi về không gian thiết kế cho MLLM sử dụng hỗn hợp mã hóa thị giác và độ phân giải, khuôn khổ Eagle cố gắng khám phá không gian thiết kế cho mô hình ngôn ngữ lớn đa phương thức với hỗn hợp mã hóa. Các phát hiện cho thấy một số nguyên tắc cơ bản chung cho các chiến lược hiện có, dẫn đến một cách tiếp cận thiết kế hiệu quả nhưng tinh gọn. Eagle phát hiện ra rằng việc đơn giản nối các token thị giác từ một tập hợp các mã hóa thị giác bổ sung là hiệu quả như các kiến trúc hoặc chiến lược trộn phức tạp hơn. Ngoài ra, Eagle giới thiệu Pre-Alignment để bắc cầu khoảng cách giữa mã hóa tập trung vào thị giác và token ngôn ngữ, tăng cường sự nhất quán của mô hình. Gia đình MLLM kết quả, Eagle, vượt qua các mô hình mã nguồn mở hàng đầu khác trên các chuẩn mực MLLM chính.

Công việc của Eagle liên quan đến thiết kế kiến trúc chung của mô hình ngôn ngữ lớn đa phương thức (MLLMs). Ngoài dòng nghiên cứu mã nguồn mở đại diện được đề cập trước đó, các gia đình MLLM đáng chú ý khác bao gồm, nhưng không giới hạn ở, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini và Llama 3.1. Tùy thuộc vào cách tín hiệu thị giác được tích hợp vào mô hình ngôn ngữ, MLLM có thể được phân loại rộng rãi thành “chú ý đa phương thức” và “prefix-tuning”. Người trước tiên tiêm thông tin thị giác vào các lớp khác nhau của LLMs sử dụng chú ý đa phương thức, trong khi người sau đối xử với token thị giác như một phần của chuỗi token ngôn ngữ và trực tiếp thêm chúng với nhúng văn bản. Mô hình Eagle thuộc về gia đình prefix-tuning bằng cách theo kiến trúc đa phương thức theo phong cách LLaVA. Xem xét rằng MLLM là một lĩnh vực phát triển nhanh, Eagle khuyến nghị tham khảo các nghiên cứu và khảo sát chi tiết hơn để có thêm thông tin.

Công việc của Eagle liên quan chặt chẽ đến nghiên cứu tập trung vào việc cải thiện thiết kế mã hóa thị giác cho MLLM. Các công việc đầu tiên thường áp dụng mã hóa thị giác được tiền huấn luyện trên các nhiệm vụ căn chỉnh thị giác-ngôn ngữ như CLIP và EVA-CLIP. Các mã hóa thị giác mạnh hơn, chẳng hạn như SigLIP và InternVL, đã được đề xuất để tăng cường nhiệm vụ ngôn ngữ-thị giác với thiết kế tốt hơn, kích thước mô hình lớn hơn và công thức đào tạo hiệu quả hơn. Vì các mô hình thường được tiền huấn luyện trên hình ảnh độ phân giải thấp và có thể thiếu khả năng mã hóa chi tiết tinh粒, việc thích nghi độ phân giải cao thường được thực hiện để tăng độ phân giải đầu vào của MLLM. Ngoài việc thích nghi độ phân giải cao, các mô hình như LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer và InternVL sử dụng gạch hoặc gạch tự động để xử lý đầu vào độ phân giải cao, nơi hình ảnh được chia thành các bản vá độ phân giải thấp hơn và được xử lý riêng biệt. Mặc dù khả năng xử lý độ phân giải cao được thực hiện bằng cách giới thiệu các chuyên gia thị giác bổ sung, nhưng cách tiếp cận này khác slightly so với các kỹ thuật gạch, mặc dù cả hai đều tương thích và có thể được kết hợp.

EAGLE: Sử dụng Hỗn hợp Mã hóa để Khám phá Không gian Thiết kế cho MLLM

Sự thành công của mô hình ngôn ngữ lớn (LLM) đã tạo ra sự quan tâm đáng kể trong việc kích hoạt khả năng nhận thức thị giác, cho phép chúng nhìn, hiểu và lý luận trong thế giới thực. Ở cốt lõi của các mô hình ngôn ngữ lớn đa phương thức (MLLM) này là một thiết kế điển hình nơi hình ảnh được chuyển đổi thành một loạt token thị giác bởi mã hóa thị giác và được thêm vào với nhúng văn bản. CLIP thường được chọn làm mã hóa thị giác vì đại diện thị giác của nó được căn chỉnh với không gian văn bản bằng cách tiền huấn luyện trên các cặp hình ảnh-văn bản. Tùy thuộc vào kiến trúc, công thức đào tạo và cách token thị giác được tiêm vào mô hình ngôn ngữ, các gia đình MLLM đáng chú ý bao gồm Flamingo, BLIP, PaLI, PaLM-E và LLaVA. Hầu hết các mô hình này duy trì độ phân giải đầu vào tương đối thấp do hạn chế của mã hóa thị giác tiền huấn luyện và độ dài chuỗi LLM. Công việc của Eagle được căn chỉnh chặt chẽ với các mô hình sử dụng nhiều mã hóa thị giác để cải thiện nhận thức.

Ví dụ, các mô hình như Mousi và Brave kết hợp token thị giác từ các mã hóa thị giác khác nhau bằng cách nối theo kênh hoặc hướng token. RADIO giới thiệu một phương pháp khuếch tán đa giáo viên để thống nhất khả năng của các mã hóa thị giác khác nhau vào một mô hình duy nhất. MoAI, IVE và Prismer sử dụng đầu ra của các chuyên gia thị giác, chẳng hạn như OCR, phát hiện hoặc ước tính độ sâu, để bổ sung thông tin thêm cho MLLM để tạo ra câu trả lời. MoVA thiết kế một mạng lưới định tuyến để phân bổ mô hình thị giác tối ưu dựa trên hình ảnh và hướng dẫn cho trước.

Các nghiên cứu gần đây đã chỉ ra rằng thiết kế mã hóa thị giác mạnh hơn là quan trọng để giảm ảo giác MLLM và cải thiện hiệu suất trên các nhiệm vụ nhạy cảm với độ phân giải như nhận dạng ký tự quang học (OCR). Một số công việc tập trung vào việc tăng cường khả năng của mã hóa thị giác, либо bằng cách tăng quy mô dữ liệu và tham số tiền huấn luyện, hoặc bằng cách chia hình ảnh thành các bản vá độ phân giải thấp hơn. Tuy nhiên, các cách tiếp cận này thường giới thiệu nhu cầu tài nguyên đào tạo lớn. Một chiến lược hiệu quả nhưng mạnh mẽ là trộn mã hóa thị giác được tiền huấn luyện với các nhiệm vụ và độ phân giải đầu vào khác nhau, либо bằng cách kết hợp mã hóa độ phân giải cao hơn với mã hóa CLIP, hoặc bằng cách áp dụng các chiến lược trộn và định tuyến phức tạp hơn để tối đa hóa lợi ích của các mã hóa khác nhau. Cách tiếp cận “hỗn hợp chuyên gia thị giác” này đã được chứng minh là hiệu quả, mặc dù một nghiên cứu chi tiết về không gian thiết kế của nó với cắt giảm nghiêm ngặt vẫn còn thiếu, động viên Eagle quay lại khu vực này. Các câu hỏi quan trọng vẫn còn:哪 chuyên gia thị giác nào để chọn, làm thế nào để kết hợp các chuyên gia khác nhau, và làm thế nào để điều chỉnh chiến lược đào tạo với nhiều mã hóa thị giác hơn.

Để giải quyết các câu hỏi này, Eagle điều tra một cách hệ thống không gian thiết kế hỗn hợp mã hóa thị giác cho nhận thức MLLM được cải thiện. Việc khám phá không gian thiết kế này bao gồm các bước sau: 1) So sánh các mã hóa thị giác khác nhau và tìm kiếm thích nghi độ phân giải cao hơn; 2) Thực hiện so sánh “táo với táo” giữa các chiến lược kết hợp mã hóa thị giác; 3) Xác định dần dần sự kết hợp tối ưu của nhiều mã hóa thị giác; 4) Cải thiện căn chỉnh trước và hỗn hợp dữ liệu. Các bước khám phá được minh họa trong hình ảnh sau.

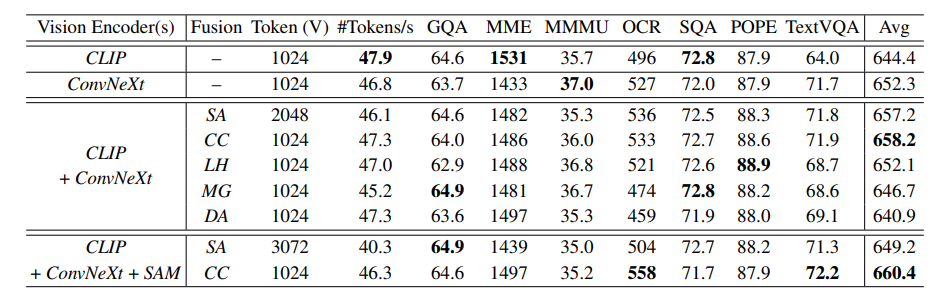

Nghiên cứu của Eagle bao gồm hiệu suất của các mã hóa thị giác được tiền huấn luyện trên các nhiệm vụ và độ phân giải khác nhau, chẳng hạn như căn chỉnh thị giác-ngôn ngữ, học tự giám sát, phát hiện, phân đoạn và OCR. Sử dụng cách tiếp cận vòng tròn, Eagle bắt đầu với mã hóa cơ bản CLIP và thêm một chuyên gia bổ sung tại một thời điểm, chọn chuyên gia cung cấp sự cải thiện tốt nhất trong mỗi vòng.

Mặc dù công việc của Eagle không phải là công việc đầu tiên tận dụng nhiều mã hóa thị giác trong MLLM, nhưng nghiên cứu hệ thống dẫn đến một số phát hiện quan trọng trong thiết lập này:

- Mở khóa mã hóa thị giác trong quá trình đào tạo MLLM là quan trọng. Điều này trái ngược với các mô hình như LLaVA và các mô hình khác sử dụng nhiều mã hóa thị giác hoặc giáo viên, nơi mã hóa thị giác bị đóng băng đã trở thành một thực hành phổ biến.

- Một số chiến lược kết hợp gần đây được đề xuất không cho thấy lợi thế đáng kể. Thay vào đó, việc nối kênh trực tiếp xuất hiện như một chiến lược kết hợp cạnh tranh nhưng đơn giản, cung cấp hiệu suất và hiệu quả tốt nhất.

- Thêm chuyên gia thị giác bổ sung dẫn đến lợi ích nhất quán. Điều này làm cho nó trở thành một con đường đầy hứa hẹn để tăng cường nhận thức MLLM một cách hệ thống, ngoài việc tăng quy mô mã hóa đơn.

- Giai đoạn căn chỉnh trước là quan trọng. Eagle giới thiệu một giai đoạn căn chỉnh trước nơi các chuyên gia thị giác không được căn chỉnh với ngôn ngữ được tinh chỉnh riêng lẻ với một mô hình ngôn ngữ bị đóng băng trước khi được đào tạo cùng nhau. Giai đoạn này tăng cường đáng kể hiệu suất MLLM trong thiết kế hỗn hợp mã hóa thị giác.

Eagle: Phương pháp và Kiến trúc

Không giống như các phương pháp trước đó tập trung vào các chiến lược kết hợp mới hoặc kiến trúc giữa các mã hóa thị giác, mục tiêu của Eagle là xác định một thiết kế tối giản để kết hợp các mã hóa thị giác khác nhau, được hỗ trợ bởi các cắt giảm chi tiết và loại bỏ bất kỳ thành phần không cần thiết nào. Như được hiển thị trong hình sau, Eagle bắt đầu bằng cách mở rộng mã hóa cơ bản CLIP thành một tập hợp các chuyên gia thị giác với các kiến trúc, nhiệm vụ tiền huấn luyện và độ phân giải khác nhau. Với các chuyên gia này, Eagle sau đó so sánh các kiến trúc và phương pháp kết hợp khác nhau và khám phá cách tối ưu hóa chiến lược đào tạo với nhiều mã hóa.

Cuối cùng, Eagle kết hợp tất cả các phát hiện và mở rộng cách tiếp cận này sang nhiều chuyên gia mã hóa thị giác với các độ phân giải và kiến thức lĩnh vực khác nhau. Sử dụng cùng dữ liệu đào tạo như LLaVA-1.5, bao gồm 595k cặp hình ảnh-văn bản, Eagle chuyển sang giai đoạn tinh chỉnh giám sát bằng cách thu thập dữ liệu từ một loạt các nhiệm vụ và chuyển đổi chúng thành các cuộc trò chuyện đa phương thức, bao gồm LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA và AI2D, kết quả là 934k mẫu.

Mô hình được đào tạo trước với các cặp hình ảnh-văn bản trong một kỷ với kích thước batch 256, nơi toàn bộ mô hình bị đóng băng và chỉ có lớp projector được cập nhật. Trong giai đoạn thứ hai, mô hình được tinh chỉnh trên dữ liệu tinh chỉnh giám sát trong một kỷ với kích thước batch 128. Đối với việc khám phá này, Eagle sử dụng Vicuna-7B làm mô hình ngôn ngữ cơ bản. Tốc độ học được đặt ở 1e-3 cho giai đoạn đầu và 2e-5 cho giai đoạn thứ hai.

Mã hóa CLIP Mạnh hơn

Eagle bắt đầu khám phá với mô hình CLIP, vì nó đã trở thành lựa chọn chính cho nhiều MLLM. Mặc dù các mô hình CLIP được biết đến với việc tăng cường nhiệm vụ đa phương thức, nhưng hạn chế của chúng cũng đã được ghi nhận. Ví dụ, nhiều MLLM hiện có tend sử dụng độ phân giải tiền huấn luyện CLIP (chẳng hạn như 224 × 224 hoặc 336 × 336) làm độ phân giải đầu vào của chúng. Trong những trường hợp này, các mã hóa thường gặp khó khăn trong việc bắt捉 các chi tiết tinh粒 quan trọng cho các nhiệm vụ nhạy cảm với độ phân giải như OCR và hiểu tài liệu.

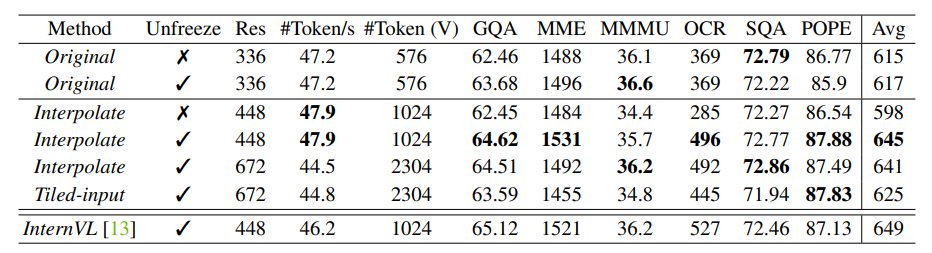

Để xử lý độ phân giải đầu vào tăng, một cách tiếp cận phổ biến là gạch, nơi hình ảnh đầu vào được chia thành các bản vá và được mã hóa riêng biệt. Một phương pháp đơn giản hơn là tăng độ phân giải đầu vào trực tiếp và nội suy các vị trí nhúng của mô hình biến đổi thị giác nếu cần. Eagle so sánh các cách tiếp cận này với mã hóa thị giác bị đóng băng và không bị đóng băng trên các độ phân giải khác nhau, với kết quả được chứa trong bảng trên. Các phát hiện có thể được tóm tắt như sau:

- Mở khóa mã hóa CLIP dẫn đến sự cải thiện đáng kể khi nội suy đến độ phân giải đầu vào MLLM cao hơn khác với độ phân giải tiền huấn luyện CLIP, mà không làm giảm hiệu suất khi độ phân giải vẫn giống nhau.

- Đóng băng mã hóa CLIP và thích nghi trực tiếp với độ phân giải đầu vào cao hơn làm giảm đáng kể hiệu suất.

- Trong số các chiến lược được so sánh, việc nội suy trực tiếp đến 448 × 448 với mã hóa CLIP không bị đóng băng chứng minh là hiệu quả và hiệu quả về hiệu suất và chi phí.

- Mã hóa CLIP tốt nhất đạt được hiệu suất gần với InternVL, mặc dù nó là một mô hình nhỏ hơn (300M so với 6B) với ít dữ liệu tiền huấn luyện hơn.

Điều đáng chú ý là CLIP-448 cho phép Eagle khớp với thiết lập của LLaVA-HR và InternVL, nơi các mã hóa CLIP được thích nghi tương tự để nhận đầu vào 448 × 448 và đầu ra 1024 token bản vá. Để điều tra thêm, Eagle theo đuổi chiến lược đơn giản này để tăng độ phân giải đầu vào và mở khóa mã hóa thị giác trong quá trình đào tạo.

Eagle quan sát thấy rằng các chiến lược kết hợp phổ biến hiện có, mặc dù có sự đa dạng trong thiết kế, có thể được phân loại rộng rãi như sau:

- Append Chuỗi: Thêm trực tiếp token thị giác từ các xương sống khác nhau như một chuỗi dài hơn.

- Kênh Nối: Nối token thị giác dọc theo chiều kênh mà không tăng chiều dài chuỗi.

- LLaVA-HR: Tiêm tính năng độ phân giải cao vào mã hóa thị giác độ phân giải thấp sử dụng một bộ chuyển đổi hỗn hợp độ phân giải.

- Mini-Gemini: Sử dụng token CLIP làm truy vấn độ phân giải thấp để chú ý chéo một mã hóa thị giác độ phân giải cao khác trong các cửa sổ cục bộ.

- Chú ý Biến dạng: Một baseline mới được giới thiệu trên cơ sở Mini-Gemini, nơi chú ý cửa sổ vanilla được thay thế bằng chú ý biến dạng.

Thay vì đào tạo một projector để căn chỉnh đồng thời nhiều chuyên gia thị giác như trong chiến lược tiền huấn luyện ban đầu của LLaVA, chúng tôi trước tiên căn chỉnh biểu diễn của từng chuyên gia riêng lẻ với một mô hình ngôn ngữ nhỏ hơn (Vicuna-7B trong thực tế) sử dụng giám sát dự đoán token tiếp theo. Như được hiển thị trong hình dưới, với căn chỉnh trước, quá trình đào tạo toàn bộ bao gồm ba bước: 1) đào tạo từng chuyên gia thị giác được tiền huấn luyện với projector riêng của chúng trên dữ liệu SFT, trong khi giữ mô hình ngôn ngữ bị đóng băng; 2) kết hợp tất cả chuyên gia thị giác từ bước đầu tiên và đào tạo chỉ projector với dữ liệu cặp hình ảnh-văn bản; 3) đào tạo toàn bộ mô hình trên dữ liệu SFT.

Eagle: Thử nghiệm và Kết quả

Sau khi phát triển chiến lược của mình một cách tỉ mỉ, Eagle đã thiết lập các nguyên tắc sau cho mô hình: (1) tích hợp nhiều chuyên gia thị giác với công thức đào tạo được tối ưu hóa; (2) kết hợp nhiều chuyên gia thị giác thông qua nối kênh trực tiếp; (3) đào tạo trước các chuyên gia thị giác riêng lẻ thông qua căn chỉnh trước. Trong phần này, để chứng minh thêm lợi thế của mô hình Eagle, dữ liệu đào tạo bổ sung được kết hợp và Eagle được so sánh với các MLLM hiện tại hàng đầu trên các nhiệm vụ khác nhau. Eagle sử dụng Vicuna-v1.5-7B, Llama3-8B và Vicuna-v1.5-13B làm mô hình ngôn ngữ. Đối với mã hóa thị giác, dựa trên kết quả trong Phần 2.6, mô hình Eagle được ký hiệu là Eagle-X4, bao gồm bốn mã hóa thị giác: CLIP, ConvNeXt, Pix2Struct và EVA-02, và Eagle-X5, bao gồm thêm một mã hóa thị giác SAM.

Nhiệm vụ Trả lời Câu hỏi Thị giác

Eagle so sánh loạt mô hình trên ba chuẩn mực Trả lời Câu hỏi Thị giác (VQA), bao gồm GQA, VQAv2 và VizWiz. Như được hiển thị trong bảng sau, Eagle-X5 đạt được hiệu suất hàng đầu trên GQA và VQAv2, nhấn mạnh lợi thế của việc kết hợp thêm chuyên gia thị giác.

Nhiệm vụ OCR và Hiểu Biểu đồ

Để đánh giá khả năng OCR, hiểu tài liệu và biểu đồ của Eagle, mô hình được chuẩn mực trên OCRBench, TextVQA và ChartQA. Như được hiển thị trong bảng trên, Eagle vượt qua các đối thủ cạnh tranh một cách đáng kể trên TextVQA, nhờ vào kiến trúc độ phân giải cao và tích hợp các mã hóa thị giác khác nhau. Đáng chú ý, Eagle duy trì một thiết kế đơn giản, hỗ trợ lên đến 1024 token mà không cần phân tích gạch phức tạp của hình ảnh.

Hình dưới đây trình bày các ví dụ về trường hợp hiểu OCR và tài liệu. Với thích nghi độ phân giải cao và bao gồm nhiều chuyên gia thị giác, Eagle có thể xác định văn bản nhỏ trong hình ảnh và trích xuất thông tin chính xác dựa trên hướng dẫn của người dùng.

Để hiểu rõ hơn về lợi ích của việc giới thiệu chuyên gia được đào tạo trên các nhiệm vụ thị giác khác, hình sau minh họa kết quả từ một mô hình chỉ có mã hóa thị giác ConvNeXt và CLIP, so với kết quả của Eagle-X5. Với toàn bộ tập hợp mã hóa thị giác, mô hình thành công trong việc sửa lỗi, chứng minh rằng ngay cả khi được trang bị mã hóa thị giác độ phân giải cao được tiền huấn luyện trên căn chỉnh thị giác-ngôn ngữ, khả năng của Eagle được tăng cường hơn nữa bằng cách tích hợp thêm chuyên gia thị giác được đào tạo trên các nhiệm vụ thị giác đa dạng.

Đánh giá Chuẩn mực Đa phương thức

Eagle được đánh giá trên bảy chuẩn mực cho MLLM để chứng minh khả năng của nó từ các góc độ khác nhau, bao gồm MME, MMBench, SEED, MathVista, MMMU, ScienceQA và POPE. Cụ thể, MME, MMBench và SEED đánh giá hiệu suất tổng thể trên các nhiệm vụ thực tế khác nhau liên quan đến lý luận, nhận dạng, kiến thức và OCR. MMMU tập trung vào các vấn đề thách thức từ các lĩnh vực đa dạng đòi hỏi kiến thức cấp đại học. POPE đánh giá ảo giác thị giác của MLLM. Các chỉ số sử dụng trong đánh giá này tuân theo các thiết lập mặc định của các chuẩn mực này. Eagle báo cáo điểm nhận thức cho MME, phân chia en_dev cho MMBench, phân chia hình ảnh của SEED, phân chia test-mini của MathVista, phân chia val của MMMU, điểm F1 của POPE và điểm hình ảnh cho ScienceQA, đảm bảo sự phù hợp với các điểm số được báo cáo từ các mô hình khác.

Suy nghĩ Cuối cùng

Trong bài viết này, chúng ta đã thảo luận về Eagle, một phân tích sâu về không gian thiết kế cho việc tích hợp mã hóa thị giác vào mô hình ngôn ngữ lớn đa phương thức. Không giống như các công việc trước đó tập trung vào việc thiết kế các mô hình kết hợp mới, Eagle tìm thấy rằng các lựa chọn thiết kế hệ thống quan trọng và khám phá một loạt các kỹ thuật hữu ích. Bước từng bước, Eagle tối ưu hóa công thức đào tạo của từng mã hóa thị giác riêng lẻ, xác định một phương pháp kết hợp hiệu quả và có thể mở rộng, và dần dần kết hợp các mã hóa thị giác với kiến thức lĩnh vực khác nhau. Các kết quả nhấn mạnh tầm quan trọng quan trọng của các xem xét không gian thiết kế cơ bản.