Góc nhìn Anderson

Jigsaw Puzzles Boost AI Visual Reasoning

Nghiên cứu mới chỉ ra rằng các mô hình AI có thể trở nên thông minh hơn trong việc nhìn bằng cách giải đố ghép hình. Việc sắp xếp lại các hình ảnh, video và cảnh 3D bị xáo trộn giúp chúng sắc nét hơn các kỹ năng thị giác của mình mà không cần dữ liệu, nhãn hoặc công cụ bổ sung.

Trong cuộc chạy đua hiện tại để đẩy các Mô hình Ngôn ngữ Lớn Đa phương thức (MLLMs) lên phía trước (hoặc ít nhất là ở lại phía trước ba bản phát hành so với đối thủ gần nhất), có rất few chiến thắng dễ dàng và không có bữa trưa miễn phí.

Mặc dù nhiều bản phát hành mã nguồn mở của Trung Quốc trong năm 2025 được báo cáo có giảm chi phí phát triển và chạy, các bản phát hành phương Tây thường ném nhiều hơn vào vấn đề: nhiều dữ liệu hơn, nhiều khả năng suy luận hơn, nhiều điện hơn (mặc dù không, như chúng tôi gần đây đã lưu ý, nhiều trình chú thích người thực sự, vì điều đó quá tốn kém ngay cả đối với cuộc cách mạng AI tổng thể trị giá hơn 1 tỷ USD).

Trong tài liệu nghiên cứu, hầu hết các phương pháp “miễn phí” được cho là để tiến hóa kiến trúc AI thường chỉ cung cấp các cải tiến nhỏ; hoặc các cải tiến trong các lĩnh vực không được theo đuổi nhiều nhất. Tuy nhiên, việc tìm kiếm các “nguyên tắc cơ bản” chưa được khám phá mà có thể tăng tốc độ phát triển là quá hấp dẫn để từ bỏ.

Lấy lại những mảnh ghép

Trong khi không hoàn toàn thuộc thể loại đó, một sự hợp tác học thuật mới giữa các tổ chức Trung Quốc cho biết họ đã xác định rằng việc khiến các MLLMs giải đố ghép hình cải thiện hiệu suất của chúng đáng kể, mặc dù phương pháp học tăng cường này trước đây đã hoạt động kém trong lĩnh vực này, và ngay cả khi nó không yêu cầu hệ thống, mô hình hoặc quy trình “bolt-on” bổ sung:

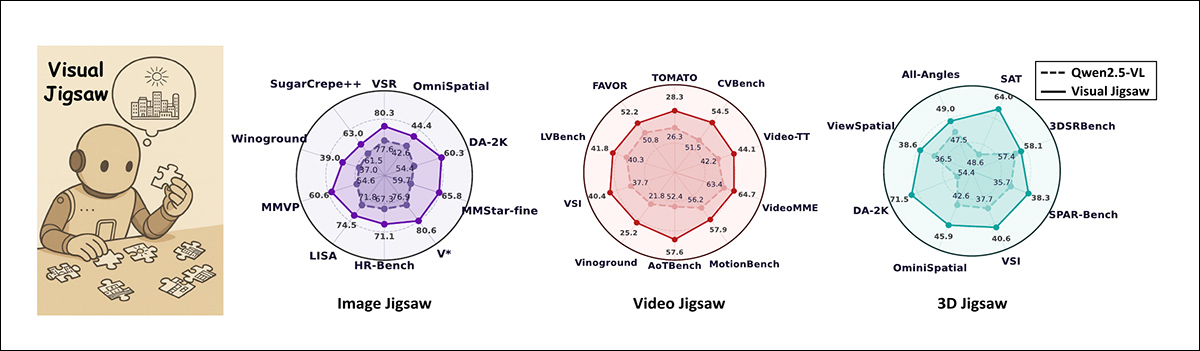

Visual Jigsaw là một khuôn khổ tự giám sát sau đào tạo cải thiện các kỹ năng tập trung vào tầm nhìn trong các mô hình ngôn ngữ lớn đa phương thức. Bằng cách đào tạo trên các nhiệm vụ ghép hình trên hình ảnh, video và dữ liệu 3D, các mô hình đạt được nhận thức tinh tế hơn, không gian và thành phần trong hình ảnh, lý luận thời gian mạnh hơn trong video và hiểu biết sâu sắc hơn về hình học trong các cảnh 3D. Biểu đồ radar trong hình ảnh trên cho thấy lợi ích nhất quán so với Qwen2.5-VL, với thang giá trị điều chỉnh cho mỗi điểm chuẩn để rõ ràng. Nguồn: https://arxiv.org/pdf/2509.25190

Hệ thống do các nhà nghiên cứu tạo ra được gọi là Visual Jigsaw, và liên quan đến việc đào tạo các MLLMs hiện có trên tài liệu đã bị phân mảnh và phân tán ngẫu nhiên, như một hình ghép. Các tác giả đã phát triển ba phương thức cho cách tiếp cận này: hình ảnh, video và 3D (tức là lưới kiểu CGI), và phát hiện ra rằng một sự thích nghi vừa phải của cùng một quy trình đã được hưởng lợi cho cả ba lĩnh vực:

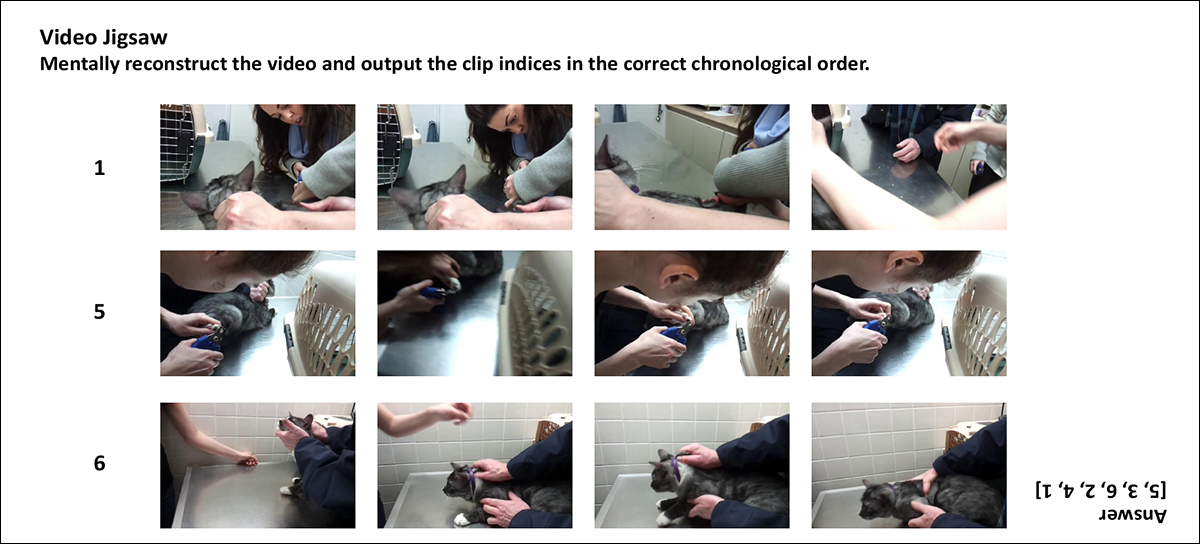

Một biểu diễn của ba nhiệm vụ Visual Jigsaw. Trong Hình ghép hình ảnh, một hình ảnh được chia thành các miếng, xáo trộn, và mô hình dự đoán bố cục chính xác; trong Hình ghép video, các đoạn clip được xáo trộn và mô hình khôi phục thứ tự thời gian của chúng; trong Hình ghép 3D, các điểm có độ sâu khác nhau được xáo trộn và mô hình xếp hạng chúng từ gần nhất đến xa nhất.

Phương pháp đào tạo Visual Jigsaw giúp các mô hình AI cải thiện việc hiểu thông tin thị giác bằng cách yêu cầu chúng tái lập các hình ảnh, đoạn clip video hoặc dữ liệu 3D bị xáo trộn.

Quá trình này dựa trên từ ngữ chứ không phải hình ảnh, và do đó không cần mô hình phải tạo ra hình ảnh hoặc sử dụng bất kỳ thành phần thị giác bổ sung nào. Phương pháp này phù hợp với một hệ thống được gọi là Học tăng cường từ Phần thưởng Xác thực (RLVR), nơi mô hình nhận được phần thưởng cho các câu trả lời chính xác dựa trên các quy tắc tự động rõ ràng; và nơi, do đó, không cần nhãn người.

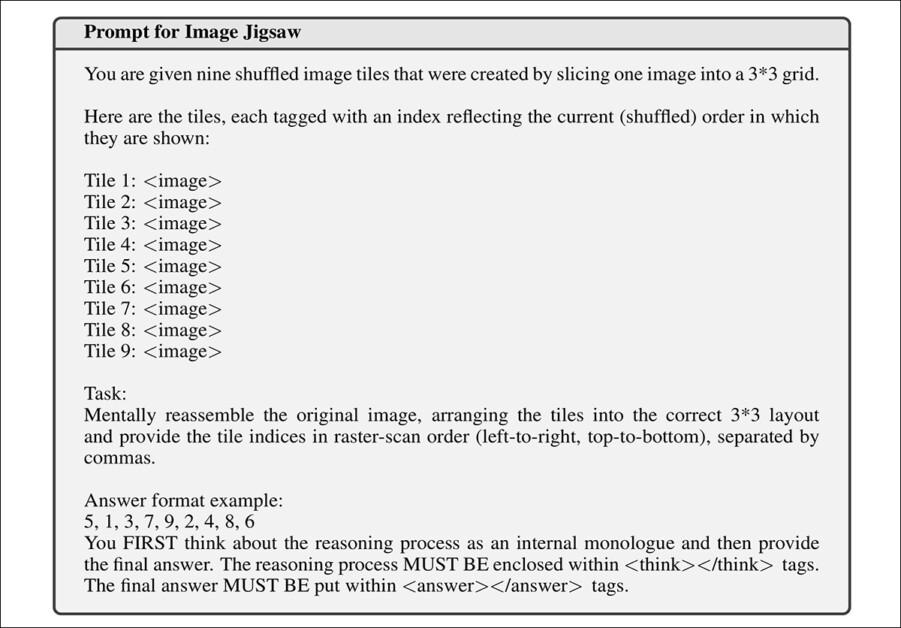

Sự thật quan trọng này thực sự khó hiểu từ bài báo mới: rằng hệ thống đang ghép hình ngôn ngữ, thông qua mô tả, và không theo cách đại diện hình dạng mà con người học cách giải đố:

Từ tài liệu bổ sung của bài báo mới, một ví dụ nhiệm vụ RL minh họa tính chất dựa trên văn bản của quá trình học tập này. Các hình ảnh sẽ được hiển thị cho MLLM không được hiển thị ở đây.

Mặc dù MLLMs xử lý rộng rãi các nhiệm vụ tập trung vào thị giác, chúng là các kiến trúc dựa trên ngôn ngữ, không được thiết kế để tạo ra hình ảnh, video hoặc các biểu diễn hình dạng như lưới 3D.

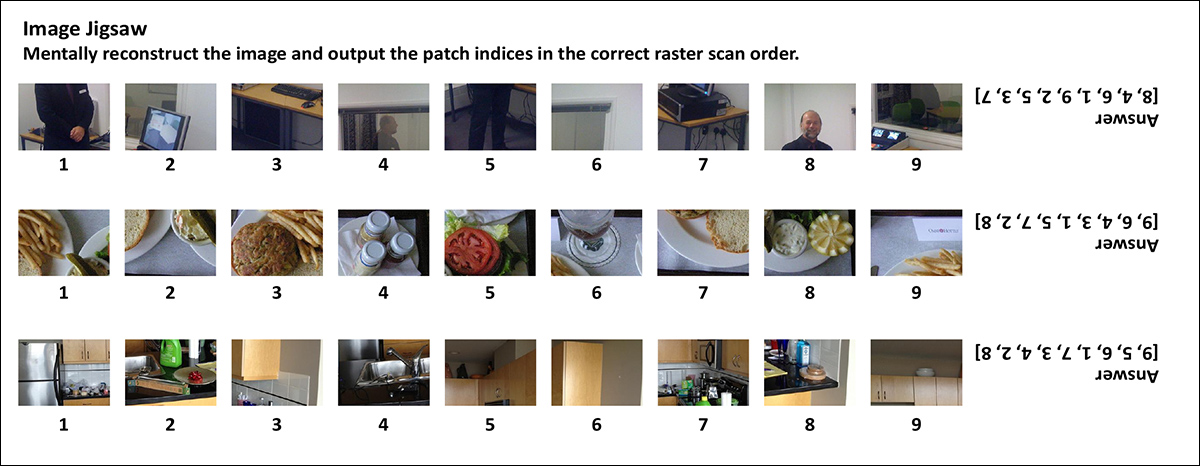

Ví dụ từ nhiệm vụ hình ghép hình ảnh. Mỗi hàng hiển thị các miếng bị xáo trộn mà mô hình phải sắp xếp lại thành bố cục ban đầu, với sắp xếp chính xác được hiển thị ở bên phải.

Trong mọi trường hợp, loại đào tạo này được thực hiện sau giai đoạn học chính, khi mô hình đã có một số khả năng hiểu hình ảnh.

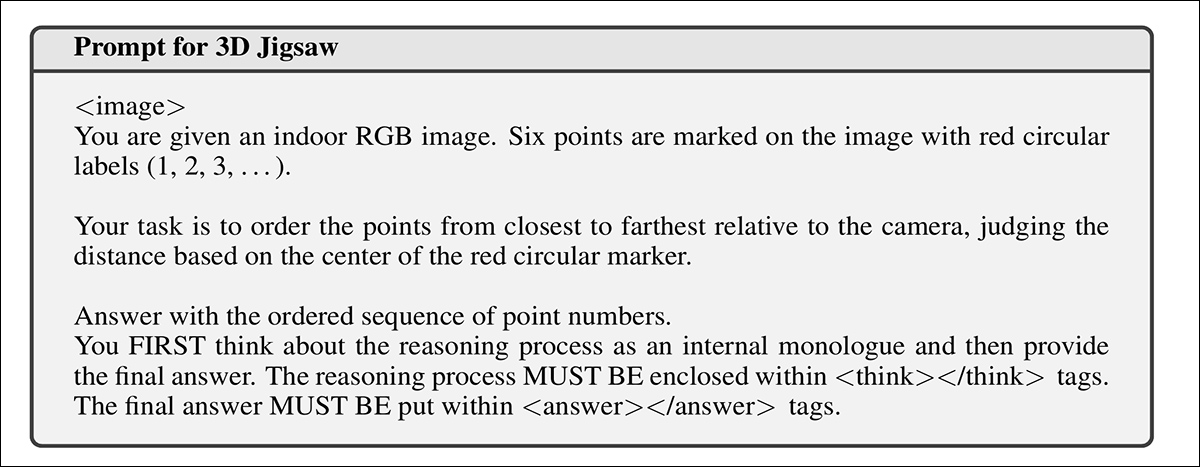

Các phương pháp trước như bài báo Thụy Sĩ năm 2017 Học không giám sát các biểu diễn thị giác bằng cách giải đố ghép hình đã sử dụng loại phương pháp tăng cường này với ít thành công hơn, trên các mạng nơ-ron tích chập (CNNs), một loại kiến trúc khác biệt so với MLLM hiện đại.

Từ bản phát hành năm 2017 ‘Học không giám sát các biểu diễn thị giác bằng cách giải đố ghép hình ‘, một ví dụ sớm về việc sử dụng phân mảnh như một thách thức dựa trên phần thưởng cho một hệ thống thần kinh. Nguồn: https://arxiv.org/pdf/1603.09246

Trong các thử nghiệm, Visual Jigsaw dẫn đến những cải tiến nhất quán và có thể đo lường được trên một loạt các điểm chuẩn: nhiệm vụ hình ghép hình ảnh cải thiện nhận thức tinh tế, hiểu biết bố cục không gian và lý luận thành phần; nhiệm vụ hình ghép video tăng cường khả năng theo dõi các chuỗi thời gian và lý luận về thứ tự sự kiện; và nhiệm vụ hình ghép 3D tăng cường hiểu biết dựa trên độ sâu và lý luận không gian bằng cách sử dụng chỉ RGB-D đầu vào.

Trên cả ba phương thức, bài báo lặp lại, phương pháp mới vượt trội so với một số baseline cạnh tranh, mặc dù không yêu cầu thay đổi kiến trúc, mô-đun thị giác bổ sung hoặc dữ liệu giám sát bổ sung:

‘Thử nghiệm rộng rãi chứng minh những cải tiến đáng kể về nhận thức tinh tế, lý luận thời gian và hiểu biết không gian 3D. Những phát hiện của chúng tôi nhấn mạnh tiềm năng của các nhiệm vụ thị giác tự giám sát trong đào tạo sau MLLMs và nhằm mục đích truyền cảm hứng cho nghiên cứu thêm về các thiết kế tiền đề tập trung vào thị giác.’

Bài báo mới bài báo có tiêu đề Visual Jigsaw Đào tạo sau Cải thiện MLLMs, và đến từ sáu nhà nghiên cứu trên Nanyang Technological University, Linköping University và SenseTime Research. Bài báo đi kèm với một trang web dự án với các bản demo trực tiếp (và bạn thậm chí có thể tải hình ảnh của riêng mình vào bản demo hình ghép hình ảnh). Mã và trọng số cho dự án đã được làm cho công chúng có thể truy cập,

Phương pháp

Mặc dù chúng tôi sẽ xem xét cách thông tin được chia nhỏ để phù hợp với ba phương thức được thử nghiệm, chúng tôi nên xem xét thiết kế phần thưởng cho hệ thống mới trước.

Tiếp cận Visual Jigsaw tính điểm phản hồi của mô hình bằng cách sử dụng phần thưởng được xếp hạng, không chỉ là một pass hoặc fail đơn giản. Nếu mô hình dự đoán chính xác thứ tự của các mảnh ghép hình, nó sẽ nhận được phần thưởng đầy đủ; nếu câu trả lời hầu như đúng, nhưng không hoàn hảo, mô hình sẽ nhận được điểm tín dụng một phần, được điều chỉnh bởi hệ số chiết khấu để tránh đánh giá quá cao các lần gần như trúng.

Các câu trả lời không hợp lệ, chẳng hạn như ‘lừa đảo’ bằng cách sử dụng cùng một số lặp đi lặp lại, sẽ nhận được điểm số 0. Để khuyến khích định dạng nhất quán, mô hình phải đặt lý luận của nó bên trong <think> thẻ và câu trả lời cuối cùng của nó bên trong <answer> thẻ. Nó sẽ nhận được một khoản tiền thưởng nhỏ nếu định dạng này được sử dụng đúng cách.

Hình ảnh

Để tạo ra một câu đố cho hình ảnh phương thức, một hình ảnh trước tiên được chia thành một lưới các miếng bằng cách chia nó thành các khối có kích thước bằng nhau:

Ví dụ về các miếng hình ảnh để hệ thống giải quyết.

Các miếng được sắp xếp theo một thứ tự cố định từ trái sang phải, trước khi được xáo trộn bằng một xáo trộn ngẫu nhiên. Mô hình sau đó được hiển thị tập hợp các miếng xáo trộn này và phải đoán thứ tự chính xác bằng cách dự đoán phép tính toán chính xác để khôi phục bố cục ban đầu.

Trong đào tạo, 118.000 hình ảnh từ tập dữ liệu COCO đã được sử dụng, với mỗi hình ảnh tạo ra chín miếng (tức là ‘mảnh ghép’). Câu hỏi được đưa ra cho hệ thống được hiển thị ở trên trong bài viết này (hình ảnh trên với chú thích bắt đầu bằng ‘Từ tài liệu bổ sung của bài báo mới’).

Video

Đối với nhiệm vụ hình ghép video, một video được cắt thành một chuỗi các đoạn clip bằng cách cắt nó đều theo thời gian, sau đó xáo trộn các đoạn clip. Mô hình sau đó được hiển thị chuỗi xáo trộn này và phải đoán thứ tự thời gian chính xác của chúng.

Ví dụ bị cắt bớt của thách thức hình ghép video, từ tài liệu bổ sung của bài báo.

Đào tạo cho phương thức này sử dụng 100.000 video từ tập dữ liệu LLaVA-Video, với mỗi video được chia thành sáu đoạn clip. Để ngăn mô hình khai thác các tín hiệu trùng lặp khung hình rõ ràng ở ranh giới đoạn clip, 5% khung hình ở đầu và cuối mỗi đoạn clip đã bị cắt.

Mỗi đoạn clip không chứa hơn 12 khung hình, mỗi khung hình có độ phân giải tối đa 128x28x28 pixel. Các video ngắn hơn 24 giây đã bị loại bỏ.

Câu hỏi cho nhiệm vụ này được hiển thị dưới đây:

Câu hỏi học tăng cường được trình bày cho MLLMs cho nhiệm vụ video, mà không có các đoạn clip sẽ được trình bày cho MLLM..

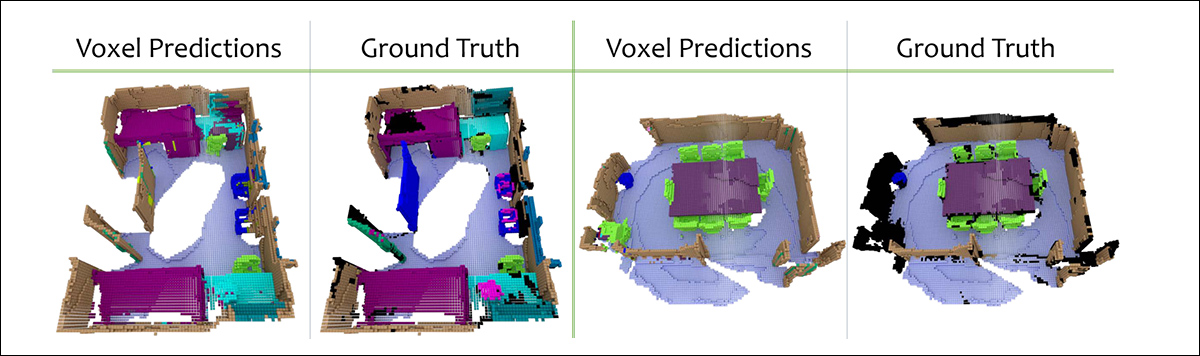

Dữ liệu 3D

Một nhiệm vụ hình ghép 3D đầy đủ sẽ thường liên quan đến việc phá vỡ một không gian 3D (chẳng hạn như khối voxel hoặc mảnh điểm đám mây) thành các mảnh nhỏ hơn và đào tạo một mô hình để tái tạo bố cục không gian ban đầu của chúng.

Tuy nhiên, mô hình MLLM trung bình không được trang bị để xử lý dữ liệu 3D thô trực tiếp, mà thay vào đó dựa vào đầu vào hình ảnh hoặc video được giải thích ngữ nghĩa. Do đó, để tạo ra một nhiệm vụ vẫn khai thác lý luận 3D mà vẫn tương thích với các MLLM hiện tại, các tác giả đã giới thiệu một biến thể dễ quản lý hơn bằng cách sử dụng hình ảnh RGB-D (tức là hình ảnh 2D bao gồm thông tin độ sâu cho mỗi pixel).

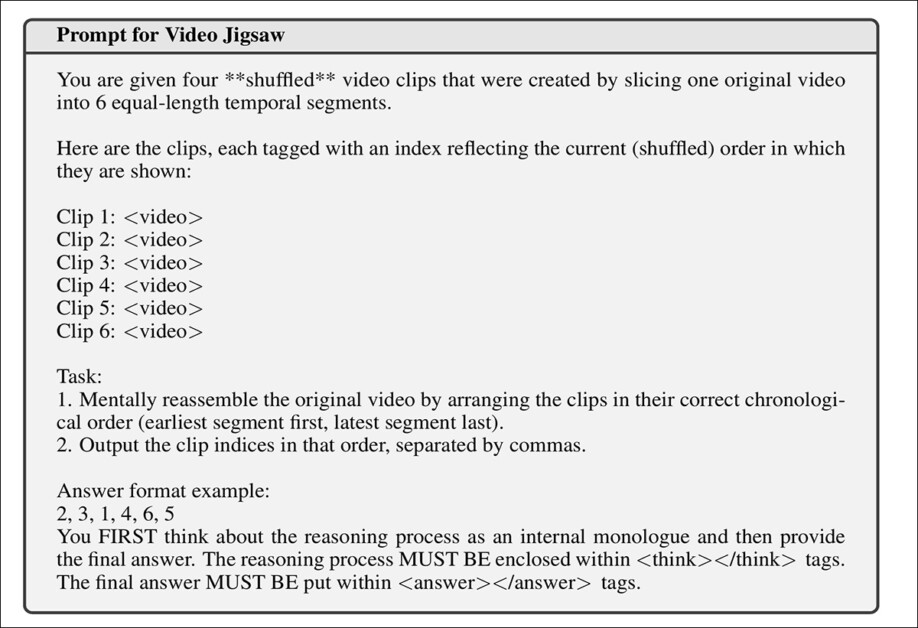

Ví dụ câu hỏi từ 3D Spatial Understanding Benchmark được sử dụng để đánh giá hiệu suất về lý luận quan điểm và chuyển động máy ảnh tương đối. Mô hình 3D Jigsaw đúng suy luận cả quan hệ không gian giữa hai tầm nhìn của một cảnh và hướng quay máy ảnh có khả năng, vượt trội so với baseline Qwen2.5-VL-7B.

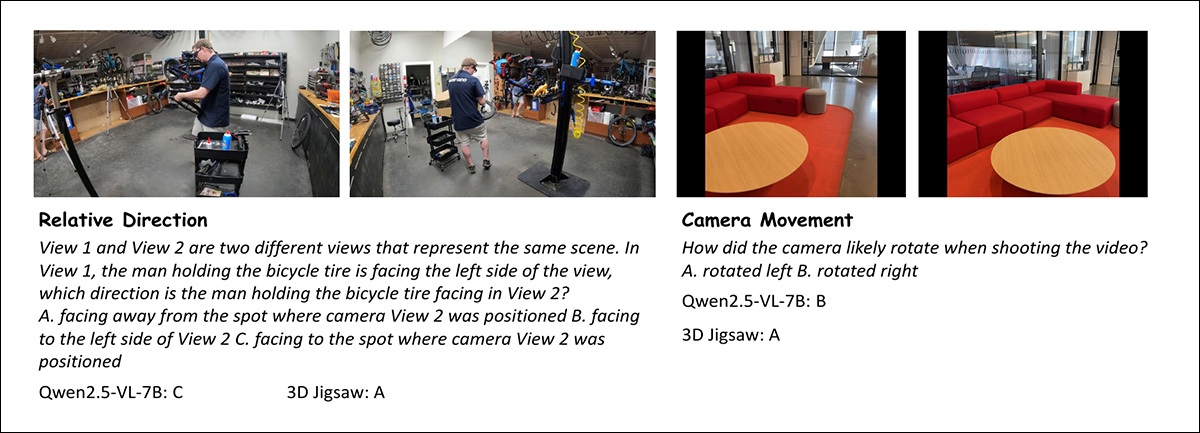

Từ mỗi hình ảnh RGB-D, mô hình được đưa ra một danh sách xáo trộn các điểm ban đầu có độ sâu khác nhau, từ gần đến xa, với mục tiêu là khôi phục thứ tự dựa trên độ sâu của chúng bằng cách sử dụng chỉ hình ảnh 2D làm tham chiếu:

Câu hỏi RL cho hình ghép 3D.

Mỗi điểm được đánh dấu trên hình ảnh (được hiển thị cho mô hình, nhưng không được hiển thị trong ví dụ câu hỏi trong hình ảnh trực tiếp ở trên), và mô hình phải dự đoán điểm nào gần nhất, điểm thứ hai gần nhất, v.v., hiệu quả地 tái tạo lại trình tự độ sâu ban đầu mà không cần giá trị độ sâu thô.

Nhiệm vụ hình ghép 3D được đào tạo trên hình ảnh RGB-D từ tập dữ liệu ScanNet, sử dụng 300.000 mẫu được tạo bằng cách chọn các tập hợp điểm ngẫu nhiên sáu điểm mỗi hình ảnh.

Ví dụ về đám mây điểm từ tập dữ liệu ScanNet được sử dụng trong hình ghép 3D. Nguồn: https://arxiv.org/pdf/1702.04405

Mỗi điểm phải nằm trong khoảng cách độ sâu từ 0,1 đến 10 mét, và để thúc đẩy sự đa dạng, không có hai điểm trong một tập hợp được phép gần hơn 40 pixel trong mặt phẳng hình ảnh, hoặc ít hơn 0,2 mét cách nhau theo độ sâu.

Thử nghiệm

Đối với các thử nghiệm ban đầu, hệ thống sử dụng Qwen2.5-VL-7B-Instruct làm mô hình đa phương thức cơ bản. Đào tạo sử dụng thuật toán Tối ưu hóa Chính sách Nhóm tương đối (GRPO), với cả điều chỉnh KL và mất entropy bị xóa.

Đối với các dự đoán một phần, một hệ số chiết khấu 0,2 được áp dụng. Đào tạo hình ghép hình ảnh sử dụng kích thước lô toàn cầu 256, trong khi hình ghép video và 3D sử dụng 128. Tốc độ học được đặt thành 1×10⁻⁶.

Đối với mỗi câu hỏi, mô hình tạo ra 16 phản hồi ở nhiệt độ giải mã 1,0. Cả nhiệm vụ hình ghép hình ảnh và video đều được đào tạo trong 1.000 bước, trong khi nhiệm vụ hình ghép 3D được đào tạo trong 800 bước.

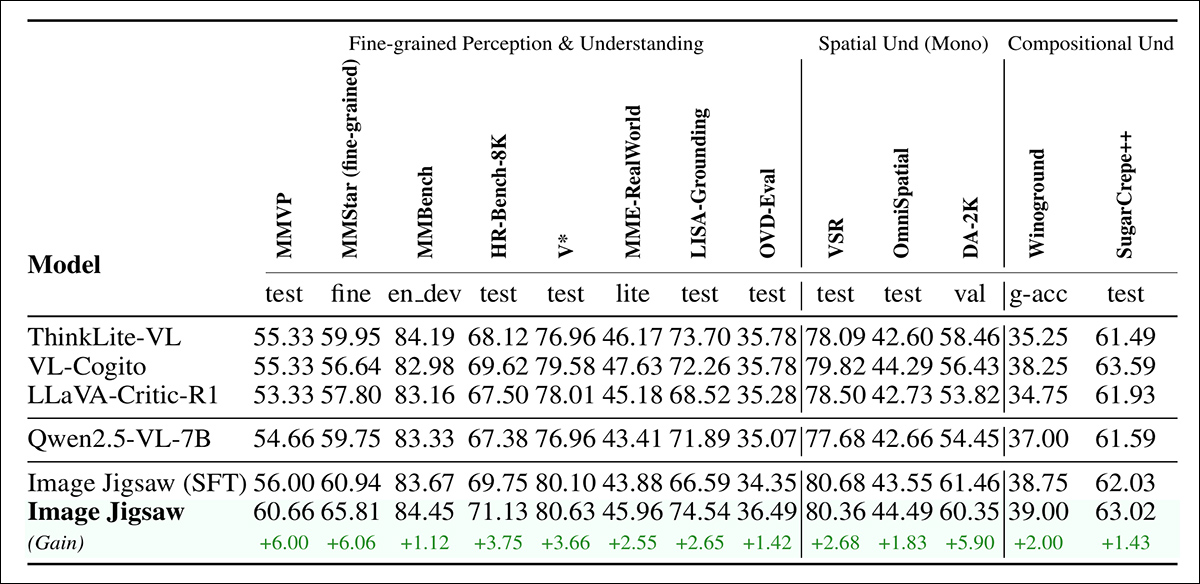

Hình ghép hình ảnh

Mô hình hình ghép hình ảnh được thử nghiệm trên ba loại điểm chuẩn tập trung vào thị giác: đối với nhận thức tinh tế và hiểu biết, MMVP, tập con nhận thức tinh tế của MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; và OVD-Eval.

Đối với hiểu biết không gian đơn thị giác, các điểm chuẩn là VSR; OmniSpatial; và Depth Anything V2 (DA-2K). Đối với hiểu biết thị giác thành phần, các thử nghiệm sử dụng Winoground và SugerCrepe++.

Ba baseline được thử nghiệm, tất cả đều được dẫn xuất từ Qwen2.5-VL-7B: ThinkLite-VL cho lý luận đa phương thức; VL-Cogito cho các nhiệm vụ thị giác chung và khoa học; và LLaVA-Critic-R1 cho nhận thức hình ảnh.

Tất cả đều được đánh giá bằng cách sử dụng các câu trả lời ngắn, vì lý luận chuỗi suy nghĩ (CoT) đôi khi làm giảm hiệu suất.

Kết quả đánh giá trên các điểm chuẩn hình ảnh. Hình ghép hình ảnh cải thiện trên mô hình cơ bản Qwen2.5-VL-7B trên tất cả các loại nhiệm vụ (tức là nhận thức tinh tế và hiểu biết; hiểu biết không gian đơn thị giác; và lý luận thị giác thành phần), vượt trội so với các baseline đào tạo sau trước đó.

Về kết quả của hình ghép hình ảnh, được hiển thị ở trên, các tác giả tuyên bố:

‘[Hình ảnh trên] cho thấy phương pháp của chúng tôi nhất quán cải thiện khả năng tập trung vào thị giác trên cả ba loại điểm chuẩn. Những kết quả này xác nhận rằng việc kết hợp đào tạo sau hình ghép hình ảnh đáng kể cải thiện khả năng nhận thức và hiểu biết thị giác tinh tế của MLLMs vượt ra ngoài các chiến lược đào tạo sau tập trung vào lý luận. ‘

‘Chúng tôi cho rằng những cải tiến này là do thực tế là việc giải quyết hình ghép hình ảnh yêu cầu mô hình phải chú ý đến chi tiết miếng bản địa, suy luận bố cục không gian toàn cầu và lý luận về mối quan hệ giữa miếng, điều này trực tiếp có lợi cho hiểu biết tinh tế, không gian và thành phần.’

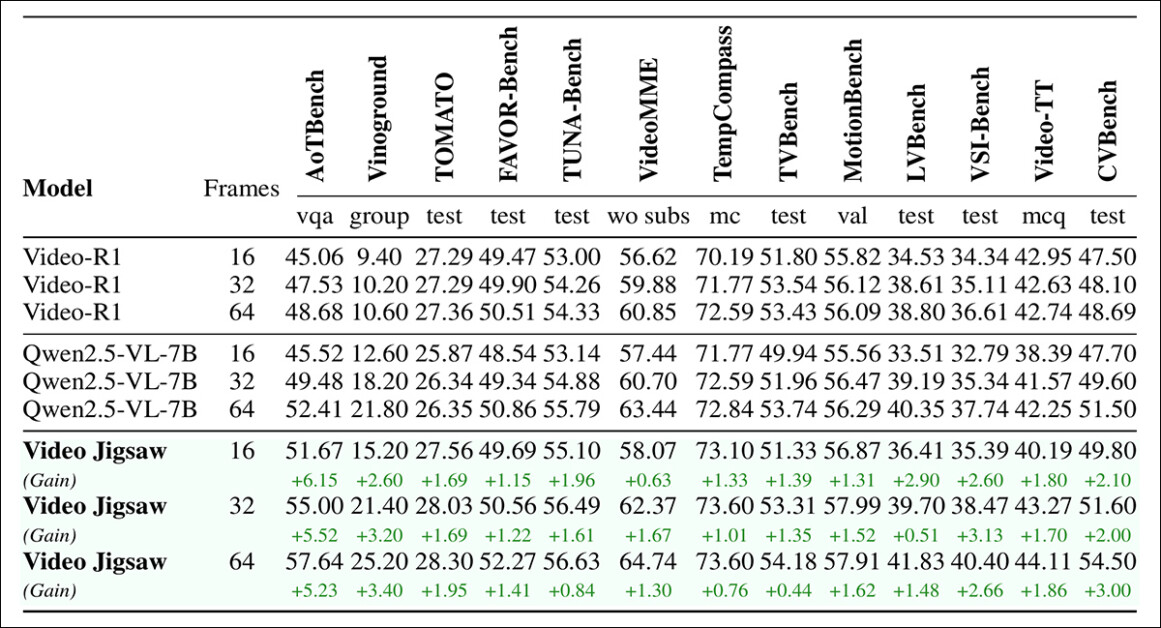

Hình ghép video

Đối với hình ghép video, đánh giá được thực hiện trên AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; và CVBench.

Video-R1 được sử dụng làm baseline, đã được đào tạo với đào tạo tinh chỉnh giám sát lạnh sau đó là học tăng cường cho hiểu biết và lý luận video. Trong trường hợp này, các đánh giá bao gồm toàn bộ quá trình lý luận, vì điều này nhất quán tạo ra kết quả tốt hơn so với các câu trả lời trực tiếp.

Tất cả các mô hình đều bị giới hạn ở 256x28x28 pixel và được thử nghiệm trên ba cài đặt khung hình – 16, 32 và 64:

Kết quả đánh giá trên các điểm chuẩn video, với Hình ghép video vượt trội so với baseline một cách nhất quán trên tất cả các nhiệm vụ và cài đặt khung hình.

Hình ghép video tạo ra các cải tiến nhất quán trên tất cả các điểm chuẩn hiểu biết video và cài đặt khung hình, với lợi ích đặc biệt mạnh trên các nhiệm vụ yêu cầu lý luận thời gian và định hướng, chẳng hạn như những nhiệm vụ trong AoTBench, và cũng trong các điểm chuẩn lý luận video chéo, chẳng hạn như CVBench:

‘Những kết quả này xác nhận rằng việc giải quyết các nhiệm vụ hình ghép video khuyến khích mô hình nắm bắt được tính liên tục thời gian, hiểu mối quan hệ giữa các video, lý luận về tính nhất quán định hướng, và khái quát hóa các kịch bản hiểu biết video toàn diện và có thể khái quát hóa.’

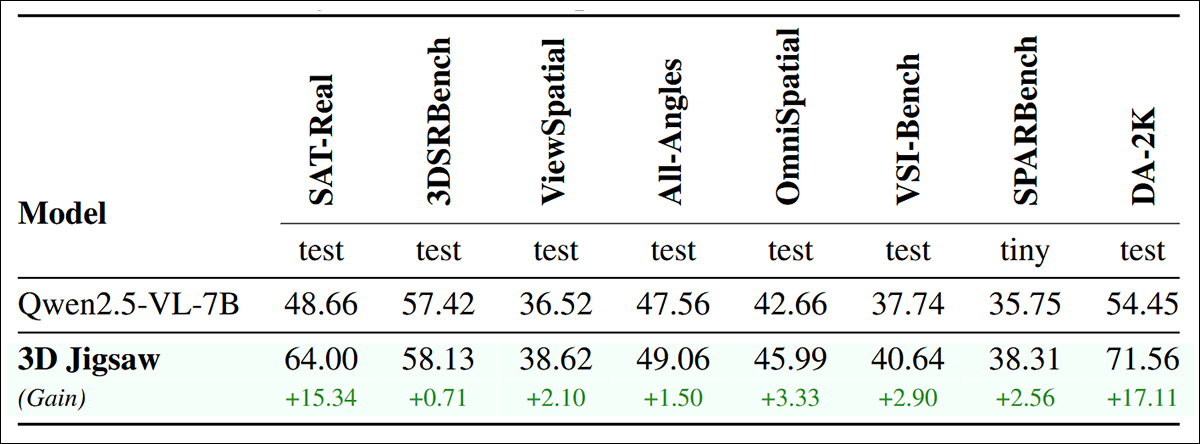

Dữ liệu 3D

Đối với phương thức 3D, mô hình được đánh giá trên SAT-Real; 3DSRBench; ViewSpatial; All-Angles; điểm chuẩn OmniSpatial được đề cập trước đó; VSI-Bench; SPARBench (tiny); và điểm chuẩn DA-2K được đề cập trước đó.

Kết quả đánh giá trên các điểm chuẩn 3D: Hình ghép 3D cải thiện hiệu suất trên các nhiệm vụ so sánh độ sâu như DA-2K, cũng như các điểm chuẩn nhận thức 3D rộng hơn bao gồm đầu vào hình ảnh đơn, đa và video egocentric.

Tại đây, các tác giả tuyên bố:

‘[Hình ghép 3D] đạt được những cải tiến đáng kể trên tất cả các điểm chuẩn. Không có gì ngạc nhiên, lợi ích lớn nhất là trên DA-2K, một điểm chuẩn ước tính độ sâu trực tiếp liên quan đến nhiệm vụ đào tạo trước về thứ tự độ sâu của chúng tôi. Quan trọng hơn, chúng tôi quan sát thấy những cải tiến nhất quán trên một loạt các nhiệm vụ, bao gồm cả những nhiệm vụ có đầu vào hình ảnh đơn (ví dụ: 3DSRBench, [OmniSpatial]), đa (ví dụ: ViewSpatial, All-Angles), và video egocentric (ví dụ: VSI-Bench). ‘

‘Những kết quả này chứng minh rằng phương pháp của chúng tôi không chỉ dạy cho mô hình một kỹ năng cụ thể là thứ tự độ sâu mà còn hiệu quả tăng cường khả năng chung của mô hình trong việc nhận thức và lý luận về cấu trúc không gian 3D.’

Kết luận

Điều không hoàn toàn rõ ràng từ bài báo này là mối quan hệ chính xác giữa hình ảnh và mô tả đang thúc đẩy sự cải thiện này trong hiệu suất MLLM.

Vào cái nhìn đầu tiên, quá trình học tập thông qua việc giải đố có vẻ rất tương tự như những nỗ lực và phát triển ban đầu của chúng ta. Tuy nhiên, sự diễn giải không gian của chúng ta về thế giới trực giác cảm thấy ít ngôn ngữ và liên quan đến thực tại hơn, và một cái nhìn sâu hơn vào bài báo tiết lộ mức độ mà ngôn ngữ phục vụ MLLM như một cây cầu thú vị giữa thực tại thị giác và ngữ nghĩa.

* Xin lưu ý rằng các tác giả của bài báo thích thuật ngữ ‘Mô hình Ngôn ngữ Lớn Đa phương thức’, viết tắt là ‘MLLMs’. Đây là một thuật ngữ mới nổi hoặc ít được sử dụng, và áp dụng cho các mô hình có thể phân tích và lý luận hình ảnh rộng rãi về không gian, nhưng không tạo ra hình ảnh. Khi các mô hình và mô hình mới xuất hiện, từ vựng này đang được sửa đổi liên tục.

Được xuất bản lần đầu vào thứ Năm, ngày 2 tháng 10 năm 2025